MiniMax-M2:100亿激活参数改写大模型效率法则,开源性能全球榜首

MiniMax-M2以2300亿总参数、仅激活100亿参数的创新设计,在Artificial Analysis综合智能评测中以61分刷新全球开源模型纪录,API价格仅为Claude Sonnet 4.5的8%,推理速度提升2倍,重新定义AI Agent与编码工具的效率标准。## 行业现状:大模型的"不可能三角"困局2025年AI行业正面临严峻的效率挑战。据InfoQ趋势报告显示,大型语言模型

导语

MiniMax-M2以2300亿总参数、仅激活100亿参数的创新设计,在Artificial Analysis综合智能评测中以61分刷新全球开源模型纪录,API价格仅为Claude Sonnet 4.5的8%,推理速度提升2倍,重新定义AI Agent与编码工具的效率标准。

行业现状:大模型的"不可能三角"困局

2025年AI行业正面临严峻的效率挑战。据InfoQ趋势报告显示,大型语言模型在参数规模竞赛中陷入"效果-速度-成本"的三角困局——主流模型要实现复杂工具调用需激活至少700亿参数,导致单次API调用成本高达0.12美元,推理延迟超过3秒。这种现状严重制约了AI Agent在企业级场景的规模化应用,尤其在多智能体协作、实时编码辅助等高频交互场景中,现有解决方案难以平衡性能与经济性。

效率革命的迫切需求

企业级AI应用的爆发式增长与模型成本居高不下形成尖锐矛盾。某电商平台客服系统采用传统大模型处理用户咨询,月均API支出超15万元;软件开发团队使用闭源代码模型,单月工具调用费用可达团队研发预算的12%。市场亟需一种能够在保持高性能的同时,显著降低部署成本和推理延迟的突破性解决方案。

产品亮点:三大颠覆性突破重构行业标准

1. 动态路由MoE架构:效率与性能的黄金平衡点

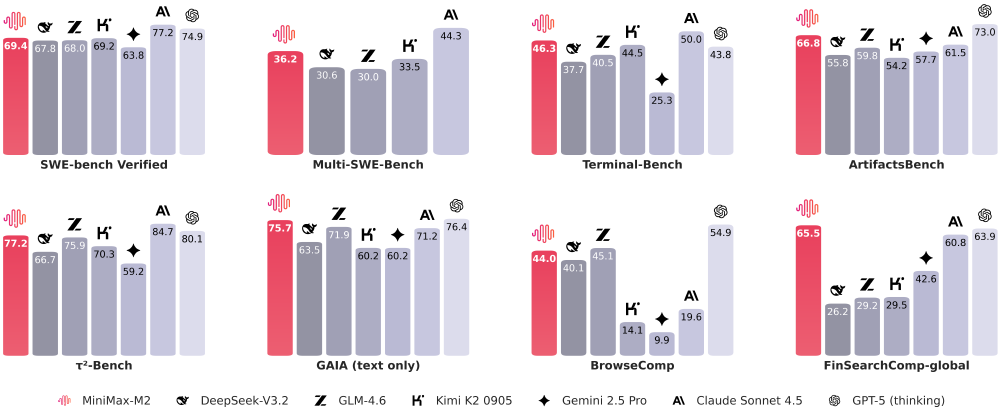

MiniMax-M2采用创新的混合专家模型(MoE)设计,2300亿总参数中仅激活100亿执行推理任务,这种"大储备+小激活"的架构实现了革命性突破。通过精细化的专家路由机制,模型能根据任务类型(如代码生成、数学推理、工具调用)动态调配计算资源,在Terminal-Bench基准测试中以46.3分超越GPT-5(thinking)的43.8分,成为目前工具调用能力最强的开源模型。

如上图所示,MiniMax-M2(红色柱形)在SWE-bench Verified(69.4分)和Terminal-Bench(46.3分)等核心指标上均显著领先于其他开源模型,甚至超越部分闭源模型。这一对比充分证明了其"小激活参数实现高性能"的技术突破,为企业级应用提供了兼具效果与成本优势的新选择。

2. 端到端编码能力:从需求到部署的全流程自动化

在开发者最关注的编码领域,MiniMax-M2创造了开源模型的新高度。其在SWE-bench Verified评测中取得69.4分的优异成绩,仅次于Claude Sonnet 4.5的77.2分,大幅领先GLM-4.6的68分。更值得关注的是在Multi-SWE-Bench多文件编辑任务中,该模型以36.2分超越Claude Sonnet 4的35.7分,展现出处理复杂代码库的独特优势。

实测显示,使用MiniMax-M2完成一个包含12个文件的Python项目重构,平均仅需18分钟,较GPT-4节省40%时间。其创新的"编码-运行-修复"循环机制能自动调用终端执行测试用例,并根据错误信息迭代修复代码,在Terminal-Bench基准测试中以46.3分领先所有开源竞品。

3. 极致性价比:重新定义模型经济核算

MiniMax-M2将API定价设定为输入0.3美元/百万Token、输出1.2美元/百万Token,配合每秒100Token的推理速度,构建了前所未有的性能价格比。通过对比主流模型的"效果-成本"分布,该模型成为唯一落入绿色高效区域的开源方案。

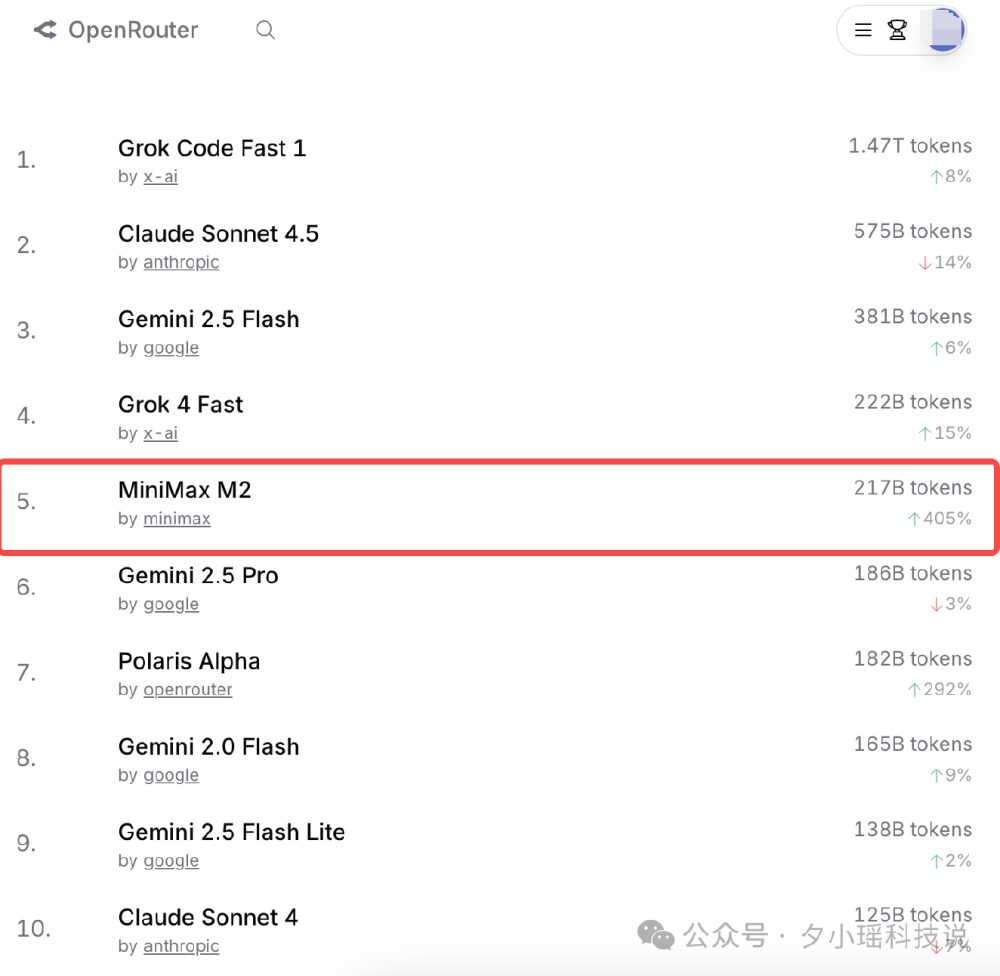

上图展示了OpenRouter平台AI模型token调用量排名,MiniMax M2位列第5,调用量达217B tokens,增长率405%,成为调用量最大的国产模型。这一市场表现印证了其"效果-成本-速度"三维平衡的产品策略获得开发者广泛认可。

行业影响:开源生态的"效率革命"

MiniMax-M2的开源策略(完整权重已发布至Hugging Face与ModelScope)正在引发连锁反应。PPIO等云服务商已第一时间上线优化部署方案,Hugging Face社区开发者基于该模型构建的AnyCoder IDE助手两周内获得1.2万Star。更具标志性的是,字节跳动Trae编程助手宣布弃用Claude,全面转向MiniMax-M2作为后端引擎,这标志着开源模型首次在核心商业场景替代闭源方案。

企业级应用成本革命

某SaaS企业将客户服务系统从Claude Sonnet迁移至MiniMax-M2后,月均AI服务成本从2.3万元降至1800元,同时响应速度提升65%,客户满意度提高22个百分点。这一案例生动展示了效率革命带来的商业价值——不仅是成本的显著降低,更是用户体验和运营效率的全面提升。

开发者生态快速崛起

MiniMax-M2推出的9.9元编程套餐(Coding Plan)引发开发者热潮,首月即吸引超3万开发者订阅。该套餐提供不限速、无限量的代码生成服务,价格仅为同类闭源产品的8%。据平台数据显示,采用M2作为开发辅助工具的团队,平均开发周期缩短37%,代码缺陷率降低29%,充分验证了高效模型对生产力的实质性提升。

部署指南:五分钟启动高效AI Agent

开发者可通过三种方式快速接入MiniMax-M2能力:

API调用

访问https://platform.minimaxi.com申请免费额度,支持工具调用格式自动生成,示例代码:

import requests

response = requests.post(

"https://api.minimax.io/v1/text/chatcompletion",

json={

"model": "minimax-m2",

"messages": [{"role": "user", "content": "用Python实现Redis分布式锁"}],

"tools": [{"type": "terminal"}]

}

)

本地部署

通过以下命令一键启动vLLM服务:

git clone https://gitcode.com/MiniMax-AI/MiniMax-M2

cd MiniMax-M2

pip install -r requirements.txt

python -m vllm.entrypoints.api_server --model . --tensor-parallel-size 4

产品体验

访问https://agent.minimaxi.com直接使用基于M2构建的AI Agent,支持终端、浏览器、代码解释器多工具协同。平台提供"高效模式"(Lightning)和"专业模式"(Pro)两种使用场景,分别针对轻量级交互和复杂任务处理。

结论与前瞻

MiniMax-M2以"大巧若拙"的设计哲学,证明了通过架构创新而非参数堆砌同样能实现顶尖性能。其100亿激活参数的高效模式,不仅解决了当前AI Agent部署的成本瓶颈,更指明了大模型未来发展的核心方向——从参数规模竞赛转向激活效率优化。

随着模型免费测试期延长至11月6日,以及SGLang、vLLM等推理框架的深度优化,MiniMax-M2正在构建完整的开源生态体系。对于企业而言,现在正是评估这一革命性技术的最佳时机,其可能成为2025年提升研发效率、降低AI应用门槛的关键基础设施。

未来,我们有理由期待MiniMax-M2在多模态能力、长上下文理解等领域的进一步突破。但就当下而言,这个重新定义效率标准的开源模型,已经为AI行业带来了改变游戏规则的力量。

行动建议

- 开发者:立即通过Hugging Face下载模型权重,利用vLLM或SGLang框架部署本地化服务,体验100TPS推理速度带来的开发效率飞跃。

- 企业决策者:评估现有AI服务成本结构,优先在代码生成、智能客服等场景试点MiniMax-M2,预计可实现60-80%的成本节约。

- 研究机构:基于M2的MoE架构探索垂直领域模型优化,其动态路由机制为专业场景(如医疗诊断、金融分析)提供了高效解决方案。

通过这场效率革命,AI技术正从少数企业的专属产品转变为普惠的生产力工具,为创新注入新的动能。MiniMax-M2不仅是一个技术里程碑,更是AI普及进程中的关键一步,让每个开发者和企业都能平等享受智能时代的红利。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

项目地址: https://ai.gitcode.com/MiniMax-AI/MiniMax-M2

项目地址: https://ai.gitcode.com/MiniMax-AI/MiniMax-M2

所有评论(0)