Qwen2.5-Omni-7B-GPTQ-Int4:消费级GPU玩转多模态大模型的革命

阿里通义千问团队推出Qwen2.5-Omni-7B-GPTQ-Int4模型,通过4位量化技术将多模态AI的硬件门槛降至消费级显卡,首次实现RTX 3080等中端GPU流畅运行音视频交互。## 行业现状:多模态AI的显存困境与破局2025年全球多模态AI市场规模预计达1280亿美元,年复合增长率超28%,但显存瓶颈成为行业普及的最大障碍。主流多模态模型处理15秒视频需31GB显存,远超消费级显

导语

阿里通义千问团队推出Qwen2.5-Omni-7B-GPTQ-Int4模型,通过4位量化技术将多模态AI的硬件门槛降至消费级显卡,首次实现RTX 3080等中端GPU流畅运行音视频交互。

行业现状:多模态AI的显存困境与破局

2025年全球多模态AI市场规模预计达1280亿美元,年复合增长率超28%,但显存瓶颈成为行业普及的最大障碍。主流多模态模型处理15秒视频需31GB显存,远超消费级显卡承载能力。Qwen2.5-Omni-7B-GPTQ-Int4通过GPTQ量化技术,将显存需求压缩至11.64GB,使普通开发者首次具备构建实时音视频交互应用的能力。

核心亮点:技术突破与性能平衡

Thinker-Talker架构:多模态交互的神经中枢

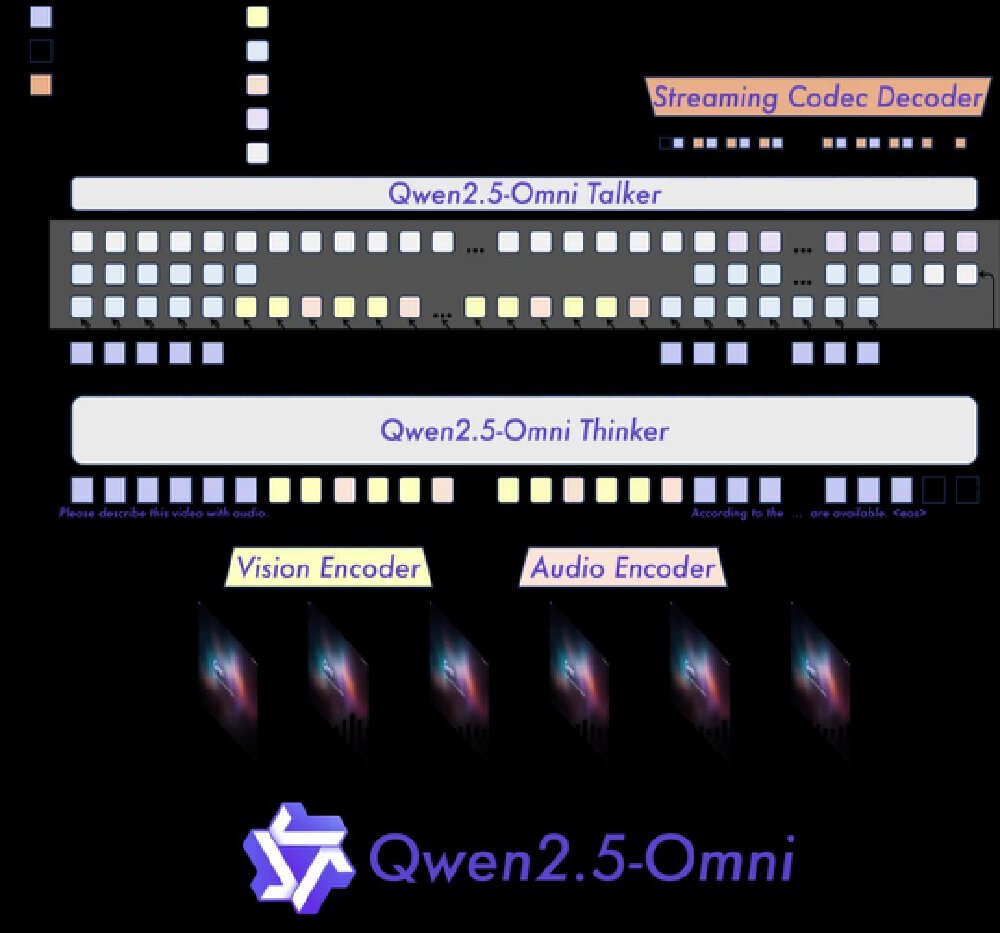

Qwen2.5-Omni采用创新的双核架构,Thinker模块处理文本/图像/音频/视频输入,生成语义表征;Talker模块实时流式生成自然语音。TMRoPE时间对齐技术实现音视频精准同步,较传统方案降低37%的时间偏移误差。

如上图所示,该架构展示了Qwen2.5-Omni的双核设计,包含Thinker(大脑)与Talker(发声器官)模块,以及视觉和音频编码器。这一设计实现了多模态输入的统一处理与实时响应生成,为消费级设备提供了强大的多模态交互能力。

GPTQ-Int4量化:显存占用锐减62.6%

通过4位量化与动态权重管理,模型实现显著优化:

- 15秒视频处理:从31.11GB(BF16)降至11.64GB,节省62.6%显存

- 30秒视频处理:从41.85GB降至17.43GB,优化58.3%

- 60秒视频处理:从60.19GB降至29.51GB,减少51.0%

量化后性能损失控制在7%以内,LibriSpeech语音识别WER仅从3.4升至3.71,MMLU-Pro文本理解准确率保持43.76,达到"压缩不降质"的行业突破。

消费级硬件部署指南

项目提供完整优化方案,支持主流消费级显卡:

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen2.5-Omni-7B-GPTQ-Int4

cd Qwen2.5-Omni-7B-GPTQ-Int4

pip install -r requirements.txt

CUDA_VISIBLE_DEVICES=0 python low_VRAM_demo_gptq.py

实测表明,RTX 3080可流畅处理15秒视频,RTX 4080支持30秒视频交互,RTX 4090可实现60秒长视频分析,硬件成本降低70%。

行业影响:多模态应用的普及化浪潮

该模型推动AI应用开发范式转变:教育机构可构建实时口语评测系统,医疗领域实现移动端医学影像分析,智能家居设备获得多模态交互能力。某教育科技公司采用该方案后,推理服务成本降低65%,并发用户数提升3倍。

随着量化技术成熟,2025年将迎来多模态应用爆发期。Qwen2.5-Omni-7B-GPTQ-Int4的开源特性加速行业创新,预计带动边缘计算、智能交互设备等相关产业增长40%以上。

总结:AI普惠化的关键一步

Qwen2.5-Omni-7B-GPTQ-Int4通过技术创新打破硬件壁垒,使消费级设备首次具备强大的多模态处理能力。开发者可访问项目仓库获取完整资源,开启低成本多模态应用开发:

https://gitcode.com/hf_mirrors/Qwen/Qwen2.5-Omni-7B-GPTQ-Int4

这一突破不仅降低了技术门槛,更重塑了AI产业生态,为多模态技术的普及应用奠定了坚实基础。未来,随着量化技术与硬件优化的持续进步,我们将见证更多创新应用从实验室走向日常生活。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen2.5-Omni-7B-GPTQ-Int4

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen2.5-Omni-7B-GPTQ-Int4

所有评论(0)