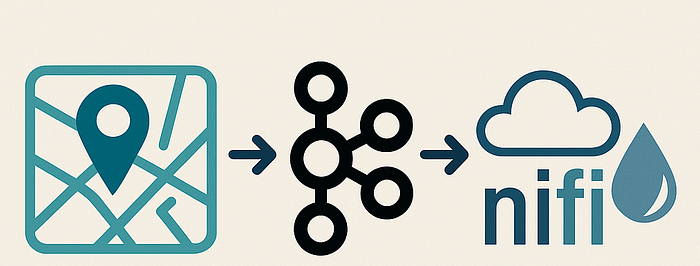

使用 Apache Kafka 和 NiFi 构建可扩展的地理空间数据流架构

本文探讨如何将 Apache Kafka 与 Apache NiFi 相结合,构建一个强大的地理空间数据流式传输和处理架构。Apache Kafka 与 Apache NiFi 的结合,构建了一个强大的平台,用于大规模传输地理空间数据。该架构提供了现代基于位置的应用程序所需的吞吐量、灵活性和处理能力。在当今数据驱动的世界里,地理空间信息已成为物流、交通运输、城市规划和应急响应等各行各业的关键组成部

在当今数据驱动的世界里,地理空间信息已成为物流、交通运输、城市规划和应急响应等各行各业的关键组成部分。挑战何在?如何实时、大规模地处理这些基于位置的数据。

本文探讨如何将 Apache Kafka 与 Apache NiFi 相结合,构建一个强大的地理空间数据流式传输和处理架构。我将介绍关键概念、实现方法,并分享实际实现中的一些代码片段。

流式地理空间数据的挑战

地理空间数据面临着独特的挑战:

- 高容量:现代应用程序每分钟产生数百万个位置点

- 复杂格式:GeoJSON、WKT、Shapefile 和专有格式

- 地图投影:不同的位置有不同的地图投影,带来不同的挑战

- 处理开销:空间操作(交叉、包含、接近)计算成本高昂

- 集成复杂性:连接到专门的空间数据库和可视化工具

为什么选择 Kafka + NiFi?

Apache Kafka 和 Apache NiFi 各自具有互补的优势:

Apache Kafka提供:

- 事件流的海量吞吐量

- 容错、分布式架构

- 强持久性保证

- 基于主题的组织

Apache NiFi提供:

- 可视化工作流程设计

- 300多个用于数据转换的处理器

- 与地理空间工具直接集成

- 数据来源和沿袭追踪

它们共同构成了构建强大的地理空间数据管道的理想平台。

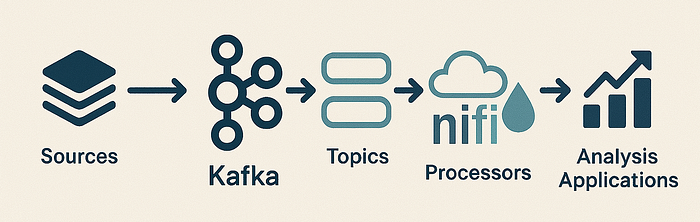

架构概述

采用 Kafka 和 NiFi 的典型地理空间流架构遵循以下模式:

- 数据生产者:GPS 设备、移动应用程序、物联网传感器和其他空间数据源

- Kafka 主题:按数据类型、区域或应用程序组织

- NiFi 工作流:使用 Kafka 主题并执行空间转换的处理器

- 丰富:向原始坐标添加上下文(反向地理编码,与参考数据连接)

- 分析:实时空间计算

- 输出:流式传输到专用数据库、仪表板或返回 Kafka

设置Kafka环境

让我们看看如何配置 Kafka 以实现最佳地理空间数据处理:

// 针对地理空间数据优化的 Kafka 主题配置

Properties props = new Properties ();

props.put( "bootstrap.servers" , "localhost:9092" );

props.put( "compression.type" , "lz4" ); // 适用于二进制地理空间数据

props.put( "retention.ms" , "604800000" ); // 保留 1 周

props.put( "segment.bytes" , "1073741824" ); // 1GB 段

// 创建一个具有适当地理区域分区的主题

AdminClient adminClient = AdminClient.create(props);

NewTopic geoTopic = new NewTopic (

"vehicle-positions" ,

8 , // 8 个分区用于并行处理

( short ) 3 // 副本因子为 3 以实现容错

);

adminClient.createTopics(Collections.singleton(geoTopic));对于空间数据,需要特别注意:

- 分区策略:考虑基于地理位置的分区

- 序列化格式:Avro 或 Protocol Buffers 非常适合地理空间数据

- 保留策略:历史分析需求与存储成本之间的平衡

为 GeoJSON 构建自定义处理程序

处理地理空间数据时,通常需要自定义序列化器:

public class GeoJsonSerializer implements Serializer <Feature> {

private final ObjectMapper mapper;

public GeoJsonSerializer () {

this .mapper = new ObjectMapper ();

SimpleModule module = new SimpleModule ();

module .addSerializer(Point.class, new PointSerializer ());

mapper.registerModule( module );

}

@Override

public byte [] serialize(String topic, Feature feature) {

try {

return mapper.writeValueAsBytes(feature);

} catch (JsonProcessingException e) {

throw new SerializationException ( "Error serializing GeoJSON" , e);

}

}

// JTS Point 对象的自定义序列化器

private static class PointSerializer extends JsonSerializer <Point> {

@Override

public void serialize (Point point, JsonGenerator gen,

SerializerProvider provider) throws IOException {

gen.writeStartObject();

gen.writeStringField( "type" , "Point" );

gen.writeArrayFieldStart( "坐标" );

gen.writeNumber(point.getX());

gen.writeNumber(point.getY());

if (!Double.isNaN(point.getZ())) {

gen.writeNumber(point.getZ());

}

gen.writeEndArray();

gen.writeEndObject();

}

}

}向 Kafka 生成地理空间事件

以下是向 Kafka 生成车辆位置事件的方法:

public void sendVehicleLocations (KafkaProducer<String, Feature> producer) {

GeometryFactory gf = new GeometryFactory ();

// 创建车辆位置更新

Point location = gf.createPoint( new Coordinate (- 122.431297 , 37.773972 ));

// 创建 GeoJSON 要素

Feature feature = new Feature ();

feature.setGeometry(location);

// 添加属性

Map<String, Object> properties = new HashMap <>();

properties.put( "vehicleId" , "bus-1234" );

properties.put( "speed" , 35.7 );

properties.put( "heading" , 90.0 );

properties.put( "timestamp" , System.currentTimeMillis());

feature.setProperties(properties);

// 创建并发送记录

ProducerRecord<String, Feature> record = new ProducerRecord <>(

"vehicle-positions" ,

"bus-1234" , // 使用车辆 ID 作为一致分区的键

feature

);

producer.send(record, (metadata, exception) -> {

if (exception != null ) {

logger.error( "发送地理空间数据时出错" , exception);

}

});

}设计NiFi数据流

在 NiFi 中,我们将创建包含以下关键步骤的工作流程:

- 使用Kafka处理器订阅Kafka主题

- 如果需要, JoltTransformJSON可重塑为 GeoJSON

- 使用 Python 或 Groovy 执行ExecuteScript进行空间计算

- 用于反向地理编码的GeoEnrichment自定义处理器

- SplitGeoJSON处理要素集合

- RouteOnGeometry用于基于地理的路线规划

- PublishKafka将处理后的数据发送回 Kafka

在 NiFi 中实现地理空间处理

让我们看一下执行地理围栏的 ExecuteScript 处理器的示例脚本:

# 使用 Python 执行脚本处理器

import json

from org.apache.commons.io import IOUtils

from java.nio.charset import StandardCharsets

from org.locationtech.jts.geom import GeometryFactory

from org.locationtech.jts.io import WKTReader

from org.locationtech.jts.operation.buffer import BufferOp

# 获取FlowFile

flowFile = session.get()

if flowFile != null :

# 读取内容

inputStream = session.read(flowFile)

text = IOUtils.toString(inputStream, StandardCharsets.UTF_8)

inputStream.close()

# 解析GeoJSON

feature = json.loads(text)

# 提取坐标

coords = feature[ 'geometry' ][ 'coordinates' ]

point_wkt = f "POINT({coords[0]} {coords[1]})"

# 创建 JTS几何对象

reader = WKTReader()

factory = GeometryFactory()

point = reader.read(point_wkt)

# 定义地理围栏 (例如:旧金山周围的多边形)

geofence_wkt = "POLYGON((-122.51 37.77, -122.43 37.81, -122.35 37.79, -122.38 37.73, -122.51 37.77))"

geofence = reader.read(geofence_wkt)

# 检查点是否在地理围栏内并添加属性

is_in_fence = geofence.contains(point)

feature[ 'properties' ][ 'inGeofence' ] = is_in_fence #如果实时地理空间分析

一旦数据流经该系统,我们就可以执行实时空间分析:

- 聚类:识别活动热点

- 路径优化:计算最佳路线

- 异常检测:发现不寻常的运动模式

- 预测分析:预测未来位置

以下是如何使用丰富数据的示例:

// 用于地理空间分析的 Kafka Streams 拓扑

StreamsBuilder builder = new StreamsBuilder ();

// 从丰富的主题中使用

KStream<String, Feature> VehicleStream = builder.stream(

"enriched-vehicle-positions" ,

Consumed.with(Serdes.String(), new GeoJsonSerde ())

);

// 按 geohash 分组(H3 索引级别 8)

KGroupedStream<String, Feature> groupedByH3 = VehicleStream

.map((key, feature) -> {

Point point = (Point) feature.getGeometry();

String h3Index = H3.geoToH3(

point.getY(), point.getX(), 8

);

return KeyValue.pair(h3Index, feature);

})

.groupByKey(Grouped.with(Serdes.String(), new GeoJsonSerde ()));

// 使用 1 分钟滚动窗口计算每个 H3 单元的车辆数量

KTable<Windowed<String>, Long> VehicleCountByCell = groupedByH3

.windowedBy(TimeWindows.of(Duration.ofMinutes( 1 )))

.count();性能考虑

在实施地理空间流架构时,请考虑以下因素:

- 消息大小优化:最小化 GeoJSON 冗长程度

- 索引策略:使用 H3、Geohash 或 Quadkeys 进行高效的空间索引

- 缓存:实现地理围栏和参考数据缓存

- 拓扑设计:在管道中分配计算密集型操作

- 扩展策略:水平扩展 NiFi 以实现并行处理

案例研究:车队管理系统

为了说明这种架构的实际应用,我们来看一个每分钟处理 100,000 辆车更新的车队管理系统的案例研究:

- 数据来源:车载 GPS 设备每 5 秒发送一次位置信息

- Kafka 摄取:8 节点 Kafka 集群,每个主题有 24 个分区

- NiFi 处理:具有专用处理器组的 12 节点 NiFi 集群

- 实时分析:Kafka Streams 应用程序计算流量密度

- 可视化:实时仪表板显示车辆运动

该系统将延迟从 12 秒缩短至 200 毫秒以下,同时实现了以前不可能实现的复杂空间查询。

结论

Apache Kafka 与 Apache NiFi 的结合,构建了一个强大的平台,用于大规模传输地理空间数据。该架构提供了现代基于位置的应用程序所需的吞吐量、灵活性和处理能力。

主要优势包括:

- 可扩展性:每秒处理数百万个空间事件

- 灵活性:使用可定制的工作流程处理任何地理空间格式

- 可靠性:容错操作,保证交付

- 可见性:完整的数据沿袭和来源追踪

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)