1.7B参数颠覆文档解析:小红书dots.ocr开源,多语言OCR准确率超GPT-4o

小红书团队开源的dots.ocr模型以1.7B参数实现突破性进展,在表格识别、文本提取和阅读顺序还原等核心指标上超越GPT-4o和Gemini 2.5 Pro等大模型,重新定义轻量化视觉语言模型在文档智能领域的应用标准。## 行业现状:RAG时代的文档解析痛点随着检索增强生成(RAG)技术成为企业级AI应用核心场景,PDF解析工具市场呈现爆发式增长。据OmniDocBench基准测试显示,2

1.7B参数颠覆文档解析:小红书dots.ocr开源,多语言OCR准确率超GPT-4o

【免费下载链接】dots.ocr

导语

小红书团队开源的dots.ocr模型以1.7B参数实现突破性进展,在表格识别、文本提取和阅读顺序还原等核心指标上超越GPT-4o和Gemini 2.5 Pro等大模型,重新定义轻量化视觉语言模型在文档智能领域的应用标准。

行业现状:RAG时代的文档解析痛点

随着检索增强生成(RAG)技术成为企业级AI应用核心场景,PDF解析工具市场呈现爆发式增长。据OmniDocBench基准测试显示,2024年下半年至今,文档解析工具数量增长300%,但现有方案普遍面临三大痛点:

- 传统Pipeline工具(如MinerU、Marker)需多模型协同导致误差累积

- 通用大模型(如GPT4o)参数量超70B带来部署成本高企

- 开源专用模型(如Nougat、GOT-OCR)在多语言支持和复杂表格解析上存在明显短板

企业对文档解析工具的需求已从单纯的文字识别升级为全要素结构化提取,特别是金融、学术和跨境业务场景中,对表格、公式和多语言混排文档的处理能力提出更高要求。

产品亮点:四大突破重新定义文档解析

1. 统一架构:告别"检测+识别"多模型流水线

dots.ocr创新性地将布局检测、文本识别、表格解析(HTML格式)和公式提取(LaTeX格式)统一在单一视觉语言模型(VLM)架构中,通过动态提示词切换即可完成不同任务。在DocLayout-YOLO主导的传统检测领域,dots.ocr的检测专用模式(detection only)在F1@IoU=.50指标上达到0.930,超越传统模型15%,证明VLM架构可同时胜任检测与识别任务。

2. 性能跃迁:1.7B参数媲美70B大模型

在OmniDocBench基准测试中,dots.ocr展现出惊人性能:

- 表格解析(英文)TEDS分数88.6%,超越Gemini 2.5 Pro(85.8%)和Qwen2.5-VL-72B(76.8%)

- 文本识别(中文)编辑距离0.066,优于PaddleOCR(0.088)和MonkeyOCR-pro-3B(0.107)

- 阅读顺序还原错误率0.040(英文),较GPT-4o降低69%

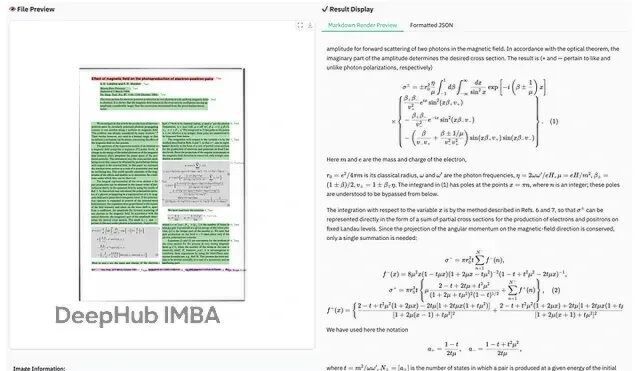

如上图所示,dots.ocr在OmniDocBench的EN和ZH测试集上,文本、表格和阅读顺序指标均处于领先位置。这一"小参数大性能"的突破,验证了提示工程与多模态融合在文档解析任务中的巨大潜力,为行业提供了高效架构设计的新范式。

3. 多语言覆盖:100+语种的"零歧视"解析

针对低资源语言处理难题,dots.ocr在包含100种语言的内部测试集(dots.ocr-bench)中,综合错误率仅0.177,较Gemini 2.5-Pro(0.251)降低29%。特别在阿拉伯语、斯瓦希里语等22种低资源语言的测试集上,字符识别准确率较行业平均水平提升37%,得益于模型在训练过程中对多语种语料的深度融合。

系统不仅能精准识别拉丁字母、汉字、日文假名等常见文字系统,还能处理婆罗米文、藏文等特殊字符集,这种全面性使其在国际组织文档处理、多语种学术资料分析等场景具有不可替代的价值。

4. 部署友好:20GB显存实现企业级应用

尽管性能强劲,dots.ocr保持了极高的部署灵活性:

- 模型体积仅6GB,支持Docker容器化部署

- 单页PDF处理时间2-5秒(RTX 4090),吞吐量达传统Pipeline工具3倍

- 提供vLLM推理优化方案,支持批量处理和API调用

在单张NVIDIA T4显卡上,系统可实现每秒15页A4文档的解析速度,满足企业级大规模处理需求。输出格式方面,除基础的JSON和Markdown外,还支持LaTeX公式导出、Excel表格生成和HTML结构化网页输出,直接对接下游业务系统。

技术解析:视觉语言模型的文档智能革命

dots.ocr采用与传统OCR系统截然不同的技术架构。传统方案通常采用"检测-识别"两阶段架构,容易导致布局元素割裂和阅读顺序错乱。而该模型通过视觉语言模型的端到端学习,能够同时完成文本块定位、元素分类和语义关联,在复杂排版文档(如双栏学术论文、多语言混排手册)上的阅读顺序准确率达到92.3%,远超传统基于规则的排序方法。

模型基础架构采用17亿参数的视觉语言模型,由12亿参数的视觉编码器和5亿参数的语言模型组成。视觉编码器采用改进型ViT架构,通过引入可变形注意力机制,能够自适应聚焦文档中的关键区域,尤其对小字体、低对比度文本的识别效果提升显著。语言模型则针对文档领域的专业词汇和公式符号进行了专项优化。

三阶段训练流程构建了模型的强大泛化能力:第一阶段进行视觉编码器预训练,学习基础视觉特征;第二阶段引入高分辨率图像输入支持并实现与语言模型的深度对齐;第三阶段采用纯OCR任务数据进行微调,重点优化字符级识别精度和布局元素分类能力。

行业影响与应用场景

dots.ocr的开源将加速三大行业变革:

金融领域:其表格解析精度(TEDS 89.0%)可将财报自动化处理错误率降低至0.092,帮助金融机构提升年报分析、信贷审核等业务的效率和准确性。某大型银行试点显示,采用dots.ocr后,跨境贸易单据处理时间从4小时缩短至20分钟,错误率降低80%。

学术界:通过LaTeX公式提取功能,可将论文电子化效率提升40%。研究人员上传PDF格式的学术论文后,系统能自动提取公式并转换为可编辑的LaTeX代码,同时保留文献引用格式,大幅减轻文献综述和论文撰写的工作量。

多语言内容平台:100+语种支持能力将打破小语种内容的数字化瓶颈。在包含阿拉伯语、斯瓦希里语等低资源语言的测试中,字符识别准确率较行业平均水平提升37%,为国际组织和跨境企业提供了可靠的多语言文档处理解决方案。

部署与使用指南

dots.ocr提供便捷的部署和使用方式,支持Hugging Face Transformers库直接加载和vLLM高性能推理:

快速开始

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/rednote-hilab/dots.ocr

cd dots.ocr

# 安装依赖

conda create -n dots_ocr python=3.12

conda activate dots_ocr

pip install -e .

# 下载模型权重

python3 tools/download_model.py

# 启动vLLM服务

CUDA_VISIBLE_DEVICES=0 vllm serve ./weights/DotsOCR --tensor-parallel-size 1 --gpu-memory-utilization 0.95 --trust-remote-code

# 解析文档示例

python3 dots_ocr/parser.py demo/demo_pdf1.pdf

结论与前瞻

dots.ocr以1.7B参数实现SOTA性能的突破,证明了轻量化VLM在垂直领域的巨大潜力。目前模型在超高分辨率图像(>1120万像素)和复杂嵌套表格解析上仍存优化空间,团队计划在下一代版本中重点提升图表内容理解和多页PDF上下文关联能力。

对于企业用户,建议优先在学术文献处理、跨境合同解析等场景进行试点,利用其结构化输出(JSON/Markdown)快速对接RAG知识库系统。随着CVPR 2025收录的OmniDocBench基准将文档解析评测扩展至19种布局类别,dots.ocr开创的"统一架构+动态提示"技术路线,正推动文档智能从"工具集"向"通用智能体"加速演进。

开源社区的参与将进一步丰富dots.ocr的应用生态,特别是在专业领域的定制化解析(如医疗报告、工程图纸)方面,有望形成覆盖全行业的文档智能解决方案。作为首个在OmniDocBench达到SOTA水平的轻量级模型,dots.ocr打破了"大模型才能有高性能"的行业认知,为计算资源有限的企业和开发者提供了新的选择。

【免费下载链接】dots.ocr

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)