【16】特征匹配RootSIFT:如何用简单变换让SIFT特征匹配更精准

本文围绕SIFT特征匹配的核心疑问展开——为何作为梯度直方图的SIFT描述子,却一直用欧氏距离度量相似性?我们将揭示这一“矛盾”的根源,并详细解读RootSIFT的改进逻辑:通过**ℓ1\ell_1ℓ1归一化+平方根变换**,将SIFT转换为更适合直方图相似性的形式,最终用欧氏距离实现更准确的特征匹配。文中还包含Python/C++的完整实现代码,以及RootSIFT在图像检索中的应用价值。Ro

简介

本文围绕SIFT特征匹配的核心疑问展开——为何作为梯度直方图的SIFT描述子,却一直用欧氏距离度量相似性?我们将揭示这一“矛盾”的根源,并详细解读RootSIFT的改进逻辑:通过**ℓ1\ell_1ℓ1归一化+平方根变换**,将SIFT转换为更适合直方图相似性的形式,最终用欧氏距离实现更准确的特征匹配。文中还包含Python/C++的完整实现代码,以及RootSIFT在图像检索中的应用价值。

一、SIFT的“矛盾”:直方图与欧氏距离的碰撞

SIFT(尺度不变特征变换)的描述子本质是关键点邻域的梯度直方图——将邻域划分为4×4块,每块统计8个方向的梯度,最终形成128维向量。

但直方图的相似性度量,欧氏距离并非最优选择。通常,直方图更适合用卡方距离(χ2=∑(ai−bi)2ai+bi\chi^2 = \sum \frac{(a_i - b_i)^2}{a_i + b_i}χ2=∑ai+bi(ai−bi)2)或Hellinger核(H(a,b)=∑aibiH(a,b) = \sum \sqrt{a_i b_i}H(a,b)=∑aibi),因为它们能更好地捕捉“概率分布”的差异。

那为什么SIFT一直用欧氏距离?原因很简单:SIFT提出时,欧氏距离是最常用的高维向量度量方式,但这并不意味着它适合直方图。RootSIFT的出现,就是为了解决这个“错配”问题。

二、RootSIFT的核心逻辑:用Hellinger核优化相似性

RootSIFT的本质,是将SIFT描述子转换为Hellinger核的形式,从而让欧氏距离计算等价于更准确的直方图相似性。

Hellinger核的计算需要两个关键步骤:

- ℓ1\ell_1ℓ1归一化:将直方图转换为“概率分布”(所有元素之和为1);

- 平方根变换:让向量的差异更符合直方图的相似性逻辑。

经过这两步处理后,两个RootSIFT向量的欧氏距离平方,恰好等于Hellinger距离的平方:∥x−y∥22=2(1−∑ixi′yi′)\|x - y\|_2^2 = 2\left(1 - \sum_i \sqrt{x'_i y'_i}\right)∥x−y∥22=2(1−i∑xi′yi′)其中x′x'x′和y′y'y′是ℓ1\ell_1ℓ1归一化后的SIFT向量。这意味着,用欧氏距离比较RootSIFT向量,本质上就是在计算Hellinger距离——这正是直方图最适合的相似性度量。

三、RootSIFT的具体步骤

RootSIFT对SIFT向量的处理分为三步,其中前两步是必须的,第三步可选:

1. ℓ1\ell_1ℓ1归一化

将原始SIFT向量xxx转换为x′x'x′,使得所有元素之和为1。公式:xi′=xi∑jxjx'_i = \frac{x_i}{\sum_j x_j}xi′=∑jxjxi

这一步的目的是将SIFT向量从“计数直方图”转换为“概率分布”——只有这样,Hellinger核才能正确计算。

2. 平方根变换

对x′x'x′的每个元素取平方根,得到x′′x''x′′。公式:xi′′=xi′x''_i = \sqrt{x'_i}xi′′=xi′

这是Hellinger核的核心:平方根让向量的“小差异”更显著,“大差异”更平缓,完美匹配直方图的相似性逻辑。

3. 可选的ℓ2\ell_2ℓ2归一化

将x′′x''x′′转换为x′′′x'''x′′′,使得ℓ2\ell_2ℓ2范数为1。公式:xi′′′=xi′′∑j(xj′′)2x'''_i = \frac{x''_i}{\sqrt{\sum_j (x''_j)^2}}xi′′′=∑j(xj′′)2xi′′

这一步并非论文要求,但在实际应用中,ℓ2\ell_2ℓ2归一化能让高维向量的距离计算更稳定。是否使用,可根据任务需求调整。

四、RootSIFT的代码实现

RootSIFT的实现非常简单——只需在SIFT描述符的基础上,添加两步变换即可。

import numpy as np

import cv2

from matplotlib import pyplot as plt

plt.rcParams['font.family'] = 'SimHei' # 选择一个支持中文的字体

class RootSIFT:

def __init__(self):

# 初始化SIFT特征提取器

self.sift_extractor = cv2.SIFT_create() # 对于OpenCV 4.5+

# 如果使用OpenCV 3.x,请使用下面这行:

# self.sift_extractor = cv2.xfeatures2d.SIFT_create()

def compute(self, image, keypoints, eps=1e-7):

# 计算原始SIFT描述符

keypoints, descriptors = self.sift_extractor.compute(image, keypoints)

# 处理空情况

if len(keypoints) == 0:

return ([], None)

# 1. ℓ₁归一化:除以每行的和(加eps防止除零)

descriptors /= (descriptors.sum(axis=1, keepdims=True) + eps)

# 2. 平方根变换

descriptors = np.sqrt(descriptors)

return (keypoints, descriptors)

def match_images(img1_path, img2_path, ratio_test=0.5):

"""

使用RootSIFT匹配两张图像

参数:

img1_path: 第一张图像路径

img2_path: 第二张图像路径

ratio_test: Lowe's ratio test阈值

返回:

matched_image: 匹配结果图像

good_matches: 好的匹配点数量

"""

# 读取图像

img1 = cv2.imread(img1_path)

img2 = cv2.imread(img2_path)

if img1 is None or img2 is None:

print("错误: 无法读取图像文件")

return None, 0

# 转换为灰度图

gray1 = cv2.cvtColor(img1, cv2.COLOR_BGR2GRAY)

gray2 = cv2.cvtColor(img2, cv2.COLOR_BGR2GRAY)

# 初始化SIFT检测器

sift = cv2.SIFT_create() # OpenCV 4.5+

# sift = cv2.xfeatures2d.SIFT_create() # OpenCV 3.x

# 检测关键点

kp1 = sift.detect(gray1, None)

kp2 = sift.detect(gray2, None)

print(f"图像1关键点数量: {len(kp1)}")

print(f"图像2关键点数量: {len(kp2)}")

# 计算RootSIFT描述符

root_sift = RootSIFT()

kp1, desc1 = root_sift.compute(gray1, kp1)

kp2, desc2 = root_sift.compute(gray2, kp2)

print(f"图像1描述符形状: {desc1.shape if desc1 is not None else 'None'}")

print(f"图像2描述符形状: {desc2.shape if desc2 is not None else 'None'}")

# 检查是否有足够的特征点

if desc1 is None or desc2 is None or len(kp1) < 2 or len(kp2) < 2:

print("错误: 没有足够的特征点进行匹配")

return None, 0

# 使用FLANN匹配器进行特征匹配

# FLANN参数

FLANN_INDEX_KDTREE = 1

index_params = dict(algorithm=FLANN_INDEX_KDTREE, trees=5)

search_params = dict(checks=50)

flann = cv2.FlannBasedMatcher(index_params, search_params)

matches = flann.knnMatch(desc1, desc2, k=2)

# 应用Lowe's ratio test筛选好的匹配点

good_matches = []

for match_pair in matches:

if len(match_pair) == 2:

m, n = match_pair

if m.distance < ratio_test * n.distance:

good_matches.append(m)

print(f"总匹配点数: {len(matches)}")

print(f"好的匹配点数: {len(good_matches)}")

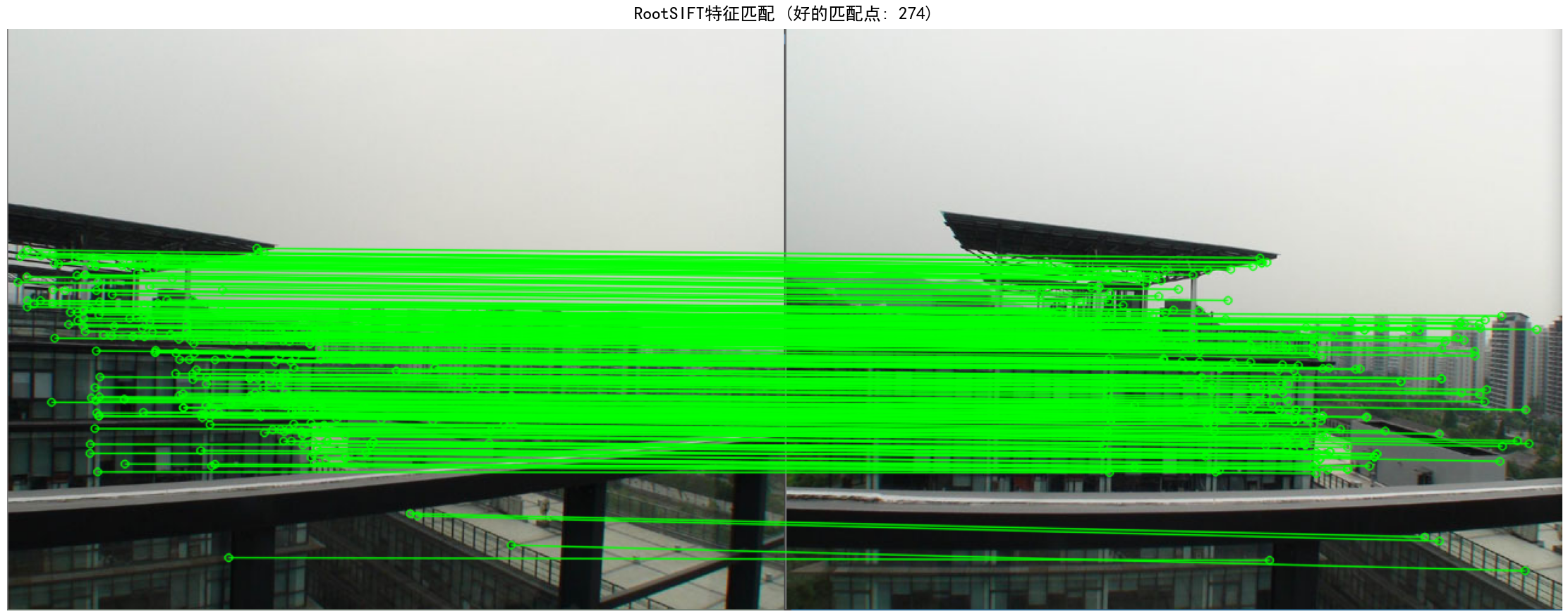

# 绘制匹配结果

matched_image = cv2.drawMatches(

img1, kp1,

img2, kp2,

good_matches,

None,

flags=cv2.DrawMatchesFlags_NOT_DRAW_SINGLE_POINTS,

matchColor=(0, 255, 0), # 绿色连线

singlePointColor=(255, 0, 0) # 蓝色关键点

)

return matched_image, len(good_matches)

# 测试代码

if __name__ == "__main__":

# 图像路径 - 请替换为您的实际图像路径

img1_path = "images/im1.png" # 第一张图像

img2_path = "images/im2.png" # 第二张图像

print("使用FLANN匹配器进行RootSIFT匹配:")

result_img, good_matches = match_images(img1_path, img2_path)

if result_img is not None:

# 显示结果

plt.figure(figsize=(15, 10))

plt.imshow(cv2.cvtColor(result_img, cv2.COLOR_BGR2RGB))

plt.title(f"RootSIFT特征匹配 (好的匹配点: {good_matches})")

plt.axis('off')

plt.tight_layout()

plt.show()

# 保存结果图像

cv2.imwrite("root_sift_matching_result.jpg", result_img)

print("匹配结果已保存为 'root_sift_matching_result.jpg'")

else:

print("匹配失败!")

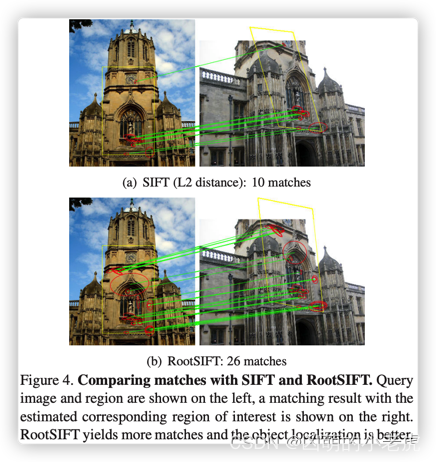

五、RootSIFT的应用:提升图像检索精度

RootSIFT的最大价值在于图像检索——通过更准确的特征匹配,直接提升检索结果的相关性。

例如,在Oxford Building数据库(5000+张建筑图像)中,RootSIFT的检索精度比原始SIFT高5-10%(论文《Three things everyone should know to improve object retrieval》结果)。这是因为RootSIFT更好地捕捉了直方图的相似性,减少了“假阳性”匹配。

六、总结

RootSIFT是对SIFT的极简但高效的改进——只需两步变换,就能将SIFT的“直方图属性”与“欧氏距离”完美结合。它的核心逻辑是用Hellinger核优化相似性度量,让欧氏距离计算更适合直方图特征。

无论是图像检索、全景拼接还是物体识别,RootSIFT都能以极低的计算成本,带来显著的性能提升。如果你正在使用SIFT,不妨试试RootSIFT——它可能会给你带来惊喜。

关注获取更多资料

我给大家整理了一套全网最全的人工智能学习资料(1.5T),包括:机器学习,深度学习,大模型,CV方向,NLP方向,kaggle大赛,实战项目、自动驾驶,AI就业等,扫码关注免费获取。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献29条内容

已为社区贡献29条内容

所有评论(0)