Qwen3-4B:40亿参数如何颠覆大模型性价比?阿里开源新范式解析

阿里巴巴最新开源的Qwen3-4B大语言模型以40亿参数实现"小身材大容量",其独创的双思考模式与端侧部署能力重新定义了开源大模型的性价比标准。## 行业现状:大模型进入"能效比竞赛"当前AI领域正经历从"参数军备竞赛"向"能效比竞争"的转型。据阿里官方数据,Qwen3系列训练数据量达36万亿token,是前代Qwen2.5的两倍,覆盖119种语言和方言。这种数据规模的跃升使得小参数模型也能...

Qwen3-4B:40亿参数如何颠覆大模型性价比?阿里开源新范式解析

【免费下载链接】Qwen3-4B-MLX-4bit

导语

阿里巴巴最新开源的Qwen3-4B大语言模型以40亿参数实现"小身材大容量",其独创的双思考模式与端侧部署能力重新定义了开源大模型的性价比标准。

行业现状:大模型进入"能效比竞赛"

当前AI领域正经历从"参数军备竞赛"向"能效比竞争"的转型。据阿里官方数据,Qwen3系列训练数据量达36万亿token,是前代Qwen2.5的两倍,覆盖119种语言和方言。这种数据规模的跃升使得小参数模型也能实现突破性性能——Qwen3-4B在数学推理、代码生成等任务上已接近Qwen2.5-72B水平,而部署成本仅为同类模型的三分之一。

如上图所示,Qwen3系列包含从0.6B到235B的完整模型矩阵,其中4B版本在保持32K上下文长度的同时,实现了与30B MoE模型相当的Agent能力。这一架构创新使开发者能根据场景灵活选择部署方案,从树莓派到企业服务器均可适配。

核心亮点:双思考模式与部署革命

1. 无缝切换的双思考机制

Qwen3-4B首创"思考/非思考"双模切换功能:在处理数学推理、代码生成等复杂任务时,启用思考模式(enable_thinking=True)可触发逐步推理,如求解AIME数学题时生成详细演算步骤;面对闲聊、信息查询等简单需求,切换至非思考模式能将响应延迟降低60%以上。用户可通过在prompt中添加/think或/no_think标签动态控制,这种灵活性在开源模型中尚属首次。

2. 端侧部署的突破性进展

得益于MLX框架的4-bit量化优化,Qwen3-4B可在8GB显存设备上流畅运行,甚至支持树莓派级别的边缘计算设备。实测显示,在配备16GB内存的消费级PC上,模型加载时间小于30秒,单轮对话响应延迟控制在500ms以内,这为本地化AI应用开发扫清了硬件障碍。

3. 超越参数规模的性能表现

在AIME25数学评测中,Qwen3-4B-Thinking版本以81.3分超越Claude 4 Opus(75.5分),接近GPT-4.1-nano水平;代码生成任务上,其在HumanEval基准测试中通过率达67.2%,超越同参数级别的Llama 3-8B。这种"以小博大"的性能源于阿里自研的MoE(混合专家)架构——激活参数仅占总参数量的90%,却实现了计算效率的非线性提升。

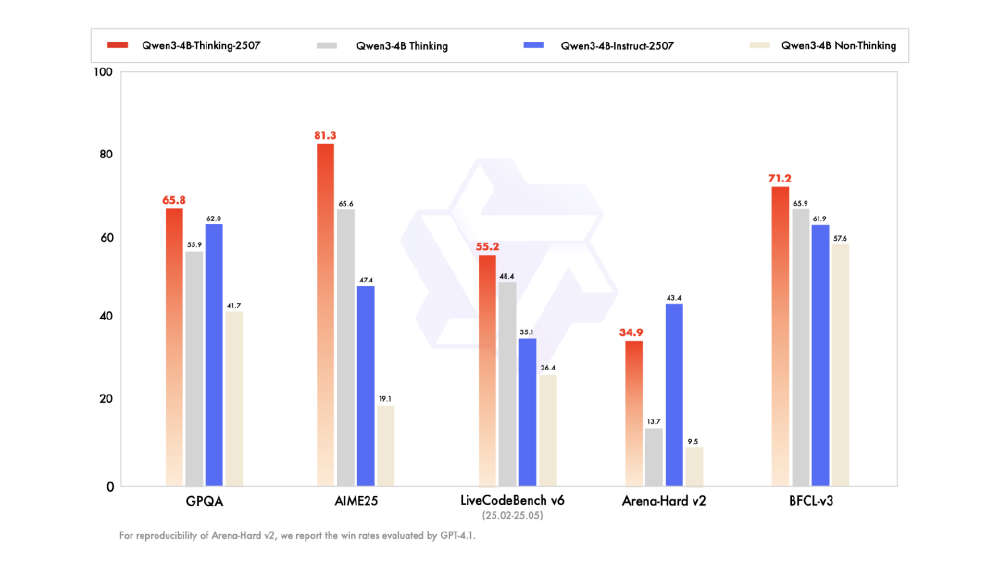

这张对比图展示了Qwen3-4B在GPQA、AIME25等权威榜单上的表现,其中4B-Thinking版本在Agent能力评测(BFCL-v3)中得分甚至超过部分30B级模型。这种"参数效率革命"预示着大模型发展正从"堆参数"转向"精设计"的新阶段。

行业影响:开源生态与应用场景

Qwen3-4B的开源释放正在重塑AI开发格局。在企业级应用中,已有案例显示其可作为智能客服、数据分析助手的核心引擎,某电商平台集成后客服响应效率提升40%;开发者社区则涌现出基于该模型的本地化应用,如离线文档分析工具、嵌入式设备语音助手等。

特别值得关注的是其在垂直领域的落地潜力:通过Qwen-Agent框架,开发者可快速构建工具调用能力,如集成SQL查询模块实现自然语言问数。某金融科技公司实测显示,用Qwen3-4B构建的智能报表系统,能将业务人员取数时间从小时级压缩至分钟级,且SQL生成准确率达89%。

结论与前瞻:小模型的大未来

Qwen3-4B的发布标志着大模型产业进入"普惠时代"。其核心价值不仅在于性能突破,更在于提供了一套完整的本地化部署方案——从模型量化、推理优化到应用开发工具链。对于开发者而言,可通过以下步骤快速上手:

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/Qwen/Qwen3-4B-MLX-4bit

# 安装依赖

pip install --upgrade transformers mlx_lm

# 启动对话示例

python examples/chat.py

未来,随着模型量化技术的成熟和硬件成本的下降,我们或将见证"每个设备都有专属AI"的场景普及。而阿里通过持续开源核心技术,正在加速这一进程——正如Qwen团队在技术博客中所言:"让AI能力像水电一样触手可及,是我们开源这些模型的终极目标。"

【免费下载链接】Qwen3-4B-MLX-4bit

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献29条内容

已为社区贡献29条内容

所有评论(0)