大模型幻觉背后的真相:OpenAI论文深度解析与实用指南!

OpenAI最新论文揭示了大模型幻觉的本质及成因。幻觉源于预训练阶段的统计学因素(如数据稀疏性、模型能力限制等)和后训练阶段的评估机制(奖励猜测而非承认不确定性)。为解决这一问题,论文建议修改现有评估基准的评分方式,引入明确的置信度目标,使模型在不确定时能够正确表达不确定性,从而减少幻觉现象的发生。这需要从技术和社会技术层面共同干预。

OpenAI9月4号发布的《Why Language Models Hallucinate》论文详细阐述了他们对大模型幻觉问题的研究,感兴趣的可以一起看下。

https://cdn.openai.com/pdf/d04913be-3f6f-4d2b-b283-ff432ef4aaa5/why-language-models-hallucinate.pdf

论文摘要中说,大模型之所以会出现幻觉问题,是因为训练和评估机制更倾向于奖励猜测行为而非承认不确定性。幻觉现象并不神秘,它们本质上只是二分类过程中的错误而已。如果无法区分错误陈述和事实,那么预训练语言模型中的错误陈述就会在自然统计规律的作用下不断出现。

什么是大语言模型(LLMs)的幻觉?

想象一下上学的时候,考试遇到不会的问题时,都会想着不管怎么着,试卷不能空着,不管会不会先写一个解字,再绞尽脑汁的编一些和提议相符的答案,然后祈祷老师手下留情给个1、2分。

大语言模型也会有这样的情况,有时候会生成看似合理、流畅,但实际上是错误或不真实的信息。

这个和人类的感知幻觉(比如看到不存在的东西)是完全不同的。LLMs幻觉是信息层面的错误。

比如论文中的例子:亚当·陶曼·卡莱的生日是什么时候?如果你知道,只需用“DD-MM”格式回答即可。

在三次独立尝试中,模型输出了三个错误日期:“03-07”、“15-06”和“01-01”,即使是要求它在知道的情况下回答。

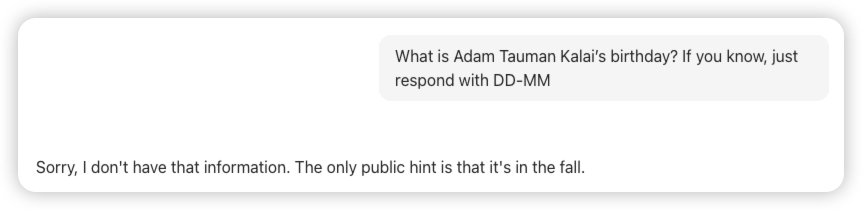

我这里尝试使用豆包回答,因为有联网给出的答案

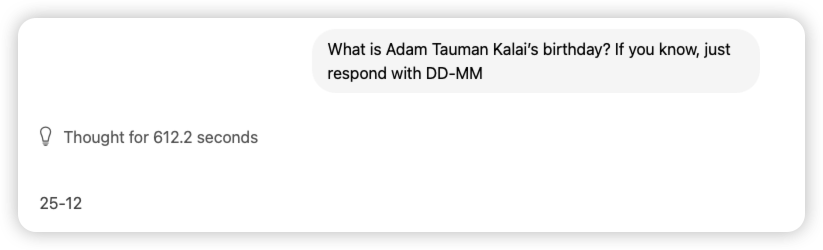

这是使用Ollama跑本地大模型Qwen3:8b给出的答案

正确答案是在秋季

这些幻觉信息严重影响了我们对这些模型的信任度,有时候你会觉得它很可靠有时候又是满嘴跑火车一大堆答非所问。

为什么会有幻觉呢?

论文中提到,幻觉并非什么神秘的事情,而是有其统计学根源。论文从模型的两个主要训练阶段 预训练和后训练 来解释幻觉的产生和持续存在。

1、预训练

在预训练阶段,有一个二元分类的统计,会导致产生错误,即使是训练数据无错误,也会产生错误。

通过这种分析,论文发现了一个重要的数学关系:生成错误率 ≳ 2 × IIV分类错误率。这意味着,在判断一个输出是否有效的这个二元分类任务中,模型犯的统计错误,会直接导致它产生幻觉。

导致预训练阶段幻觉的具体因素:

-

任意事实:当训练数据中没有简洁的模式来解释某些事实时,就会出现认知不确定性。例如,某个特定人物的生日,可能在海量数据中只出现过一两次。如果预训练数据中20%的生日事实只出现了一次,那么基础模型在至少20%的生日查询上就会产生幻觉。这可以理解为数据中模式的稀疏性。

-

模型不足(Poor Models):当模型的架构或能力不足以很好地表示或理解某些概念时,也会导致错误。比如,一个只能看前两个词来预测下一个词的“三元组语言模型”,在区分“她失去了理智(She lost it and was completely out of her mind.)”和“他失去了理智(He lost it and was completely out of his mind.)”时,因为上下文窗口太短,就可能产生至少1/2的生成错误率

-

计算难度(Computational Hardness):有些问题本质上计算起来非常困难,即使是超人类的人工智能也无法违反计算复杂性理论的定律。例如,某些加密解密问题分布偏移(Distribution Shift):当模型在训练时看到的数据分布,与实际测试时遇到的数据分布有很大差异时,也会导致错误。比如,一些非常规的问题可能在训练数据中很少出现,从而导致模型给出错误的答案

-

分布偏移(Distribution Shift):当模型在训练时看到的数据分布,与实际测试时遇到的数据分布有很大差异时,也会导致错误。比如,一些非常规的问题可能在训练数据中很少出现,从而导致模型给出错误的答案

-

垃圾进,垃圾出(GIGO: Garbage In, Garbage Out):如果训练语料库本身就包含大量的事实错误或半真半假的信息,那么基础模型就可能会复制这些错误

-

校准(Calibration)与错误:论文还指出,预训练阶段的模型通常是“校准”的。这意味着模型给出的概率预测与其结果的真实发生频率是一致的。而这种校准,是标准交叉熵(cross-entropy)训练目标函数的自然结果。然而,这种校准也恰恰意味着错误是不可避免的,因为模型“知道”自己不确定,但因为其训练目标,它仍然会以看似自信的方式给出答案

2、后训练

- 评估方式奖励猜测,惩罚承认不确定性:当前大多数语言模型的评估基准(benchmarks)和排行榜(leaderboards),都设计成惩罚表达不确定性(例如说“我不知道”)的行为,反而奖励模型在不确定时进行猜测

- 类比人类考试:这就像学生参加选择题考试:如果对答案不确定,猜一个答案可能还有机会得分;但如果留白或写“我不知道”,则肯定得零分。在这样的评估体系下,语言模型被优化成**“擅长考试的机器”**

- 二元评分系统的问题:绝大多数主流评估都采用**“二元0-1评分方案”,即答案要么完全正确得1分,要么完全错误、留白或说“我不知道”都得0分。这种评分机制导致模型在不确定时,为了最大化预期分数而盲目猜测**

如何解决幻觉?

论文中强调,要从根本上解决幻觉问题,需要一个社会技术层面的干预,不仅要高进模型技术还要改变评估和激励机制。

-

修改现有评估基准的评分方式:最关键的不是引入更多专门评估幻觉的测试,而是修改那些目前主导排行榜、但评分机制不当(惩罚不确定性)的现有基准

-

引入明确的置信度目标(Explicit Confidence Targets):评估中应该明确说明“置信度目标”

- “只在有 > t 的置信度时才回答,因为错误将扣 t/(1-t) 分,正确答案得1分,回答‘我不知道’得0分。”

- 这里“t”是一个置信度阈值,可以是0.5、0.75或0.9。如果t=0,则相当于现在的二元评分,鼓励“尽力猜测”

- 这样的机制会激励模型在正确的时候表达不确定性,而不是盲目猜测。当模型回答的正确概率高于这个“t”值时,它才应该给出答案;否则,就应该说“我不知道”

- 将置信度目标纳入主流评估:论文建议将这种明确的置信度目标整合到现有的主流评估中,例如SWE-bench这样的编程基准。这样做可以减少模型因适当表达不确定性而受到的惩罚,从而放大专门针对幻觉评估的效果

也就是说,模型幻觉的原因是:即源于模型训练阶段固有的统计学限制,又被现有的不合理的评估体系所强化。

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献775条内容

已为社区贡献775条内容

所有评论(0)