基于Python的工业级BERT文本分类项目实战

自然语言处理(NLP)作为人工智能的关键技术之一,已广泛应用于工业界,涵盖从智能客服、舆情监控到自动化文档处理等多个领域。其核心任务包括文本分类、命名实体识别、情感分析、文本生成等,推动了企业智能化转型的进程。随着深度学习技术的演进,尤其是基于Transformer架构的模型(如BERT)的出现,NLP在工业场景中展现出更强的理解与生成能力。例如,在金融行业,NLP被用于自动提取合同条款;在电商领

简介:随着自然语言处理(NLP)技术在工业领域的广泛应用,BERT模型因其强大的语义理解能力成为文本分类的重要工具。本项目基于Python实现,使用Hugging Face的 transformers 库加载预训练BERT模型,并通过微调完成文本分类任务。项目内容涵盖数据预处理、模型构建、训练优化、评估验证以及模型部署等全流程,适用于情感分析、文档分类、异常检测等工业场景,帮助开发者掌握BERT在实际项目中的应用与调优技巧。

1. 自然语言处理在工业场景中的应用概述

自然语言处理(NLP)作为人工智能的关键技术之一,已广泛应用于工业界,涵盖从智能客服、舆情监控到自动化文档处理等多个领域。其核心任务包括文本分类、命名实体识别、情感分析、文本生成等,推动了企业智能化转型的进程。

随着深度学习技术的演进,尤其是基于Transformer架构的模型(如BERT)的出现,NLP在工业场景中展现出更强的理解与生成能力。例如,在金融行业,NLP被用于自动提取合同条款;在电商领域,用于商品评论的情感分析;在医疗行业,辅助病历文本的理解与归类。

本章将系统性地介绍NLP的发展背景、技术演进路径及其在企业级项目中的应用价值,为后续深入探讨BERT模型在工业实践中的具体应用打下坚实基础。

2. BERT模型架构与工业级变体

2.1 BERT模型的基本结构

2.1.1 Transformer架构回顾

BERT(Bidirectional Encoder Representations from Transformers)模型的核心架构基于Google在2017年提出的 Transformer 模型。Transformer 通过完全摒弃传统的循环神经网络(RNN)结构,采用 自注意力机制(Self-Attention) 实现了并行计算,极大提升了模型处理长序列的能力和训练效率。

下图展示了 Transformer 的整体结构,分为 编码器(Encoder) 和 解码器(Decoder) 两部分。BERT 只使用了编码器部分。

graph TD

A[Input Embedding] --> B[Positional Encoding]

B --> C[Encoder Layer 1]

C --> D[...]

D --> E[Encoder Layer N]

E --> F[Pooled Output]

自注意力机制 是 Transformer 的核心模块,它通过计算每个词与其他词之间的相关性来生成上下文感知的词向量。其计算过程如下:

- 输入向量 $ Q, K, V $ 由输入向量通过线性变换得到:

$$

Q = XW^Q, \quad K = XW^K, \quad V = XW^V

$$ - 计算注意力权重:

$$

\text{Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right)V

$$ - 多头注意力机制(Multi-Head Attention)将多个注意力机制并行运行,最后拼接结果并通过线性层输出。

Transformer 的结构使得 BERT 能够同时捕捉输入序列的前后文信息,这为 BERT 的双向编码能力奠定了基础。

2.1.2 BERT的双向编码机制

传统的语言模型(如 GPT)是 单向的 ,即只能从前向后预测下一个词,而 BERT 采用 双向 Transformer 编码器 结构,可以同时利用上下文信息进行建模。

BERT 的训练目标之一是 Masked Language Model(MLM) ,即随机将输入中的部分词语替换为 [MASK] 标记,然后让模型预测这些被遮盖的词。由于模型可以同时看到被遮盖词的前后文,因此其编码是双向的。

例如:

原始句子:

“The cat sat on the mat.”

随机掩码后:

“The cat [MASK] on the mat.”

模型目标:预测 [MASK] 应该是 “sat”。

这种机制使得 BERT 在理解语言时,能更准确地捕捉词与词之间的语义关系。此外,BERT 还引入了 Next Sentence Prediction(NSP) 任务,用于判断两个句子是否连续,从而增强模型对句子间关系的理解。

2.1.3 输入表示与位置编码

BERT 的输入表示由三部分组成:

- Token Embeddings :表示每个词的嵌入向量。

- Segment Embeddings :用于区分句子对中的两个句子(如问答对、句子对分类任务)。

- Position Embeddings :表示词在句子中的位置。

这些嵌入向量在输入时会被相加,形成最终的输入表示:

\text{Input} = \text{Token Embedding} + \text{Segment Embedding} + \text{Position Embedding}

BERT 的位置编码不同于 Transformer 的正弦函数编码方式,而是采用 可学习的位置编码(Learnable Positional Embedding) ,即在训练过程中通过反向传播不断优化。

例如,对于输入序列长度为 512 的 BERT 模型,位置编码矩阵的大小为 (512, hidden_size) ,每个位置的编码向量都会被优化以适应任务需求。

下表展示了 BERT 输入结构的组成示例:

| 输入类型 | 示例说明 | 向量维度 |

|---|---|---|

| Token Embedding | 每个词的嵌入向量 | (batch_size, seq_len, hidden_size) |

| Segment Embedding | 区分句子 A 和句子 B 的类别向量 | (batch_size, seq_len, hidden_size) |

| Position Embedding | 表示每个词在句中的位置 | (batch_size, seq_len, hidden_size) |

这种结构使得 BERT 能够灵活地处理各种 NLP 任务,包括文本分类、命名实体识别、问答系统等。

2.2 BERT的常见变体及其适用场景

2.2.1 BERT-base与BERT-large对比

BERT 提供了多个版本,其中最常用的是:

- BERT-base :12层 Transformer 编码器,768维隐藏层,12个注意力头,参数总量约1.1亿。

- BERT-large :24层 Transformer 编码器,1024维隐藏层,16个注意力头,参数总量约3.4亿。

| 指标 | BERT-base | BERT-large |

|---|---|---|

| 层数 | 12 | 24 |

| 隐藏层维度 | 768 | 1024 |

| 注意力头数 | 12 | 16 |

| 参数总量 | ~1.1亿 | ~3.4亿 |

| 推理速度 | 快 | 慢 |

| 准确率(GLUE任务) | 高 | 更高 |

| 资源消耗 | 低 | 高 |

BERT-base 更适合在资源受限的场景(如移动端、嵌入式设备)部署,而 BERT-large 更适合追求高精度的科研任务或服务器端部署。

2.2.2 DistilBERT等轻量化版本的性能分析

为了提升模型推理效率并降低部署成本,研究人员提出了多个轻量级 BERT 变体,其中 DistilBERT 是最成功的代表之一。

DistilBERT 的设计思想是通过 知识蒸馏(Knowledge Distillation) ,将 BERT-large 的知识压缩到一个更小的模型中。其主要特点包括:

- 层数减少为 6 层(原为 12 层)

- 去除 NSP 任务

- 保留 MLM 任务

下表展示了 DistilBERT 与 BERT-base 的性能对比:

| 指标 | BERT-base | DistilBERT |

|---|---|---|

| 层数 | 12 | 6 |

| 参数总量 | ~1.1亿 | ~6600万 |

| 推理速度 | 1.0x | 1.6x |

| GLUE 任务平均得分 | 85.2% | 81.3% |

尽管 DistilBERT 的精度略有下降,但其推理速度显著提升,且模型体积缩小,非常适合在资源受限的工业场景中部署。

2.2.3 领域定制化BERT模型(如BioBERT、LegalBERT)

在工业应用中,通用 BERT 模型可能无法很好地适应特定领域(如医学、法律)。为此,研究人员开发了多个领域定制化 BERT 模型,例如:

- BioBERT :在生物医学文献上进行二次预训练的 BERT 模型。

- LegalBERT :在法律文档上进行预训练的 BERT 模型。

- SciBERT :在科学论文语料上预训练的 BERT 模型。

这些模型通常采用以下训练流程:

- 使用原始 BERT 模型作为初始权重。

- 在特定领域语料上继续进行 MLM 和 NSP 预训练。

- 微调以适应具体任务(如实体识别、分类)。

代码示例:使用 Hugging Face Transformers 加载 BioBERT 模型

from transformers import BertTokenizer, BertModel

# 加载 BioBERT 的 tokenizer 和模型

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertModel.from_pretrained('monologg/biobert_v1.1_pubmed')

# 示例输入

text = "The patient was diagnosed with lung cancer."

inputs = tokenizer(text, return_tensors='pt')

# 模型推理

outputs = model(**inputs)

last_hidden_states = outputs.last_hidden_state

代码分析:

BertTokenizer.from_pretrained('bert-base-uncased'):加载通用 BERT 的分词器。BertModel.from_pretrained('monologg/biobert_v1.1_pubmed'):加载 BioBERT 模型。tokenizer(text, return_tensors='pt'):将文本转换为模型可接受的张量格式。model(**inputs):执行模型推理,得到最后一层的隐藏状态。

这类模型在医疗问答、专利分析、法律文档分类等任务中表现优于通用 BERT。

2.3 BERT模型在工业应用中的优势与挑战

2.3.1 上游预训练与下游任务迁移能力

BERT 的核心优势之一是其强大的 迁移学习能力 。通过在大规模语料库(如 Wikipedia 和 BookCorpus)上进行预训练,BERT 能够学习到丰富的语言表示,随后只需少量标注数据即可微调适配到具体任务。

例如,在文本分类任务中,只需在 BERT 的输出上加一个全连接层即可完成微调:

import torch

import torch.nn as nn

from transformers import BertModel

class BERTClassifier(nn.Module):

def __init__(self, num_classes):

super(BERTClassifier, self).__init__()

self.bert = BertModel.from_pretrained('bert-base-uncased')

self.classifier = nn.Linear(768, num_classes)

def forward(self, input_ids, attention_mask):

outputs = self.bert(input_ids=input_ids, attention_mask=attention_mask)

pooled_output = outputs.pooler_output # [CLS] token 的表示

logits = self.classifier(pooled_output)

return logits

代码分析:

BertModel.from_pretrained('bert-base-uncased'):加载预训练 BERT 模型。outputs.pooler_output:获取 [CLS] token 的隐藏状态,用于分类任务。nn.Linear(768, num_classes):定义分类器,输出类别得分。

该方法在 GLUE 基准任务中取得了显著优于传统模型的性能。

2.3.2 模型部署的资源需求与优化方向

尽管 BERT 模型性能优异,但在实际工业部署中仍面临以下挑战:

资源需求高

- 内存占用大 :BERT-base 模型参数约1.1亿,推理时占用大量显存。

- 计算密集 :Transformer 的自注意力机制计算复杂度为 $ O(n^2) $,处理长文本时效率较低。

优化方向

- 模型剪枝(Pruning) :移除冗余的神经元或注意力头。

- 量化(Quantization) :将浮点数参数转换为低精度(如 INT8)表示。

- 蒸馏(Distillation) :使用小模型模仿大模型的输出。

- 缓存机制 :对重复输入进行缓存以减少计算开销。

- 服务化部署 :使用 ONNX、TorchScript 或 TensorFlow SavedModel 格式进行模型导出,并结合 FastAPI 或 gRPC 实现高效推理服务。

例如,使用 TorchScript 导出 BERT 模型:

model.eval()

script_model = torch.jit.script(model)

torch.jit.save(script_model, "bert_script.pt")

该方法可显著提升推理效率,并支持在 C++ 或移动设备上部署。

3. BERT的训练流程与微调策略

BERT(Bidirectional Encoder Representations from Transformers)作为自然语言处理领域里程碑式的模型,其训练流程与微调策略是构建高效、精准NLP模型的核心。本章将深入解析BERT的预训练机制、任务微调的基本流程,以及提升微调效果的关键优化手段。通过本章内容,读者将全面掌握BERT模型从原始语料学习到具体任务适配的完整过程。

3.1 BERT的预训练过程

BERT的预训练过程是其强大语言理解能力的基础,其核心思想是通过大规模语料库学习通用的语言表示。BERT的预训练主要依赖两个任务: MLM(Masked Language Model) 和 NSP(Next Sentence Prediction) 。

3.1.1 MLM(Masked Language Model)任务详解

MLM任务的核心思想是:在输入句子中随机掩盖部分token(通常是15%),然后训练模型根据上下文预测这些被掩盖的token。BERT采用双向Transformer编码器结构,能够同时利用上下文信息进行预测,这与传统的从左到右或从右到左的语言模型形成鲜明对比。

示例代码:模拟MLM任务的数据构建

from transformers import BertTokenizer

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

def create_mlm_example(sentence):

tokens = tokenizer.tokenize(sentence)

masked_index = 3 # 假设掩盖第四个token

original_token = tokens[masked_index]

tokens[masked_index] = '[MASK]'

input_ids = tokenizer.convert_tokens_to_ids(tokens)

return input_ids, masked_index, original_token

sentence = "The quick brown fox jumps over the lazy dog."

input_ids, mask_idx, true_token = create_mlm_example(sentence)

print("Input IDs:", input_ids)

print("Masked Index:", mask_idx)

print("True Token:", true_token)

代码逻辑分析:

- 初始化分词器 :使用

BertTokenizer加载预训练模型的分词器。 - 模拟掩盖 :在句子中选择一个token位置进行掩盖,替换为

[MASK]。 - 转换为模型输入 :将token转换为对应的ID,便于模型处理。

- 输出结果 :返回输入ID、掩盖位置和原始token,用于训练和验证。

参数说明:

sentence:原始文本句子。tokens:分词后的token列表。masked_index:被掩盖的token索引。input_ids:转换为模型输入的ID序列。true_token:用于评估预测结果的原始token。

3.1.2 NSP(Next Sentence Prediction)任务解析

NSP任务旨在帮助模型理解句子之间的关系。在训练过程中,模型接收两个句子作为输入(A和B),并预测B是否是A的下一句。该任务有助于BERT在问答、文本摘要等任务中更好地理解上下文逻辑。

NSP任务流程图(mermaid格式):

graph TD

A[输入句子A] --> C[拼接句子A+B]

B[输入句子B] --> C

C --> D[判断B是否为A的下一句]

D --> E{是/否}

E -->|是| F[NSP标签为1]

E -->|否| G[NSP标签为0]

3.1.3 预训练数据与训练策略

BERT的预训练依赖大规模语料,如Wikipedia和BookCorpus。其训练策略包括:

- 数据采样 :采用去重、清洗、标准化等手段处理原始文本。

- 批处理与并行训练 :使用多GPU或TPU进行分布式训练。

- 动态掩盖策略 :在每一轮训练中重新掩盖token,提高模型泛化能力。

表格:BERT预训练关键参数对比

| 参数名称 | BERT-base | BERT-large |

|---|---|---|

| 层数(L) | 12 | 24 |

| 注意力头数(A) | 12 | 16 |

| 隐藏层大小(H) | 768 | 1024 |

| 总参数量 | 110M | 340M |

| 训练步数 | 1M | 1M |

| 批量大小 | 256 | 256 |

3.2 任务微调的基本流程

微调是将预训练BERT模型适配到具体任务的过程,通常包括输入格式转换、参数冻结、学习率设置等关键步骤。

3.2.1 微调任务的输入格式转换

不同任务(如文本分类、命名实体识别)需要将输入转换为BERT可接受的格式。以文本分类为例,输入通常由 [CLS] + 句子 + [SEP] 组成。

示例代码:构造分类任务输入

def tokenize_for_classification(tokenizer, text, max_length=128):

encoded = tokenizer.encode_plus(

text=text,

add_special_tokens=True,

max_length=max_length,

padding='max_length',

truncation=True,

return_tensors='pt'

)

return encoded['input_ids'], encoded['attention_mask']

代码逻辑分析:

- 添加特殊标记 :

[CLS]用于分类任务的最终输出。 - 最大长度控制 :通过

max_length控制序列长度。 - 填充与截断 :确保所有输入具有相同维度。

- 返回张量 :便于输入到PyTorch模型中进行训练。

3.2.2 多任务学习与参数冻结策略

多任务学习允许模型在多个任务上共享底层参数,提高泛化能力。而参数冻结则是在微调过程中固定部分层(如底层Transformer),仅训练顶层适配层,以加快收敛速度。

参数冻结策略示例:

from transformers import BertModel

model = BertModel.from_pretrained('bert-base-uncased')

for name, param in model.named_parameters():

if 'encoder.layer.0' in name or 'embedding' in name:

param.requires_grad = False

逻辑说明:

- 冻结嵌入层(

embedding)和第一层Transformer(layer.0)。 - 仅训练后续层,降低训练成本。

3.2.3 学习率调整与训练轮次选择

学习率是影响模型收敛的重要超参数。BERT微调通常使用 AdamW优化器 ,并配合 线性预热(Warmup)和余弦/线性学习率衰减 。

学习率调度流程图(mermaid):

graph LR

A[初始学习率] --> B[Warmup阶段]

B --> C[学习率线性上升]

C --> D[训练主阶段]

D --> E[学习率逐步下降]

E --> F[最终收敛]

3.3 微调效果的优化手段

在实际应用中,仅靠标准微调可能无法达到最佳性能。本节将介绍提升微调效果的关键策略。

3.3.1 数据增强与样本平衡

在训练数据不足或类别不平衡时,可通过以下方式增强数据:

- 同义词替换 :如使用

TextBlob或nlpaug进行随机替换。 - 回译技术 :将文本翻译成其他语言再翻译回来,生成新样本。

- 过采样/欠采样 :针对不平衡类别进行样本调整。

示例代码:使用nlpaug进行数据增强

import nlpaug.augmenter.word as naw

aug = naw.SynonymAug(aug_src='wordnet')

augmented_text = aug.augment("The movie was absolutely amazing!")

print("Augmented Text:", augmented_text)

3.3.2 正则化与Dropout设置

为防止过拟合,BERT微调时通常在输出层添加Dropout层,并结合L2正则化:

import torch.nn as nn

class BERTClassifier(nn.Module):

def __init__(self, bert_model_name, num_classes):

super(BERTClassifier, self).__init__()

self.bert = BertModel.from_pretrained(bert_model_name)

self.classifier = nn.Sequential(

nn.Dropout(0.3), # Dropout设置

nn.Linear(768, num_classes)

)

def forward(self, input_ids, attention_mask):

outputs = self.bert(input_ids=input_ids, attention_mask=attention_mask)

pooled_output = outputs.pooler_output

return self.classifier(pooled_output)

3.3.3 使用Warmup和学习率调度器

学习率调度器(如 get_linear_schedule_with_warmup )可显著提升模型收敛速度和性能。

示例代码:学习率调度配置

from transformers import get_linear_schedule_with_warmup

optimizer = torch.optim.AdamW(model.parameters(), lr=2e-5)

total_steps = len(train_dataloader) * num_epochs

scheduler = get_linear_schedule_with_warmup(optimizer, num_warmup_steps=500, num_training_steps=total_steps)

for batch in train_dataloader:

optimizer.zero_grad()

loss = model(batch)

loss.backward()

optimizer.step()

scheduler.step()

参数说明:

num_warmup_steps:预热步数,建议设置为总训练步数的10%。num_training_steps:总训练步数。

表格:BERT微调优化策略对比

| 优化手段 | 目的 | 是否推荐 | 备注 |

|---|---|---|---|

| 数据增强 | 提升泛化能力 | ✅ | 适用于数据不足或不平衡场景 |

| 参数冻结 | 加快训练速度 | ✅ | 适用于资源有限或小样本任务 |

| 学习率调度 | 提高收敛稳定性 | ✅ | 建议搭配AdamW优化器使用 |

| Dropout | 防止过拟合 | ✅ | 通常设置在0.2~0.5之间 |

| L2正则化 | 约束模型复杂度 | ✅ | 与Dropout结合使用效果更佳 |

通过本章内容,我们系统性地梳理了BERT的预训练机制、微调流程以及提升微调效果的关键策略。这些知识不仅为后续章节中构建具体NLP任务模型打下坚实基础,也为工业级BERT模型的应用提供了可操作的实践路径。

4. Python在NLP项目中的工程实践

Python 语言因其简洁的语法、强大的库支持和活跃的社区,成为自然语言处理(NLP)项目开发的首选语言。在工业级 NLP 应用中,Python 不仅用于模型开发,还贯穿整个工程流程,包括数据预处理、模型训练、服务部署和性能监控。本章将深入探讨 Python 在 NLP 项目中的核心优势、开发流程以及部署阶段的关键注意事项,帮助开发者构建高效、可维护、可扩展的 NLP 工程系统。

4.1 Python语言在NLP中的优势

Python 在 NLP 领域的广泛应用并非偶然,其语言特性与丰富的生态体系共同构成了其不可替代的优势。

4.1.1 开源生态支持(如PyTorch、TensorFlow)

Python 拥有世界上最活跃的机器学习与深度学习开源社区。主流深度学习框架如 PyTorch 和 TensorFlow 都提供了完善的 NLP 支持。例如,Hugging Face 的 Transformers 库基于 PyTorch 和 TensorFlow 实现了对 BERT、GPT、T5 等主流 NLP 模型的封装,极大降低了模型调用和微调的门槛。

# 示例:使用 Hugging Face Transformers 加载 BERT 模型

from transformers import BertTokenizer, BertModel

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertModel.from_pretrained('bert-base-uncased')

inputs = tokenizer("Hello, how are you?", return_tensors="pt")

outputs = model(**inputs)

逐行解读:

BertTokenizer.from_pretrained:加载预训练的 BERT 分词器。BertModel.from_pretrained:加载预训练的 BERT 模型。tokenizer(...):将输入文本编码为模型所需的 token ID 和 attention mask。model(**inputs):将编码后的输入送入模型,输出嵌入向量。

该段代码展示了 Python 在模型调用上的简洁性,开发者无需从头构建模型结构,即可快速验证模型行为。

4.1.2 脚本开发与自动化能力

Python 是一种解释型语言,支持脚本化开发,非常适合快速构建数据处理流程、训练脚本和服务接口。例如,在 NLP 数据预处理阶段,开发者可以编写脚本完成文本清洗、词频统计、语料切分等任务。

# 示例:文本清洗脚本

import re

def clean_text(text):

text = re.sub(r'\s+', ' ', text).strip() # 去除多余空格

text = re.sub(r'[^\w\s]', '', text) # 去除标点符号

return text.lower() # 统一转为小写

sample_text = "This is a sample text, with some PUNCTUATION!"

cleaned_text = clean_text(sample_text)

print(cleaned_text)

逐行解读:

re.sub(r'\s+', ' ', text):将多个空格替换为一个空格。re.sub(r'[^\w\s]', '', text):去除所有非字母数字和空格字符。.lower():统一转换为小写,以提升模型泛化能力。

该脚本展示了 Python 在数据清洗方面的灵活性和高效性,适合集成到整个 NLP 管道中。

4.1.3 快速原型验证与模型迭代

Python 的交互式环境(如 Jupyter Notebook)允许开发者快速实验和调试模型。这种“写-试-改”的开发模式非常适合 NLP 项目的早期阶段,便于快速验证想法、调整模型参数。

# 示例:使用 scikit-learn 快速验证文本分类模型

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

# 假设我们有如下简单数据

texts = ["I love this product", "Terrible experience", "Great service", "Not good"]

labels = [1, 0, 1, 0]

vectorizer = TfidfVectorizer()

X = vectorizer.fit_transform(texts)

y = labels

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.25)

clf = LogisticRegression()

clf.fit(X_train, y_train)

accuracy = clf.score(X_test, y_test)

print(f"模型准确率:{accuracy:.2f}")

逐行解读:

TfidfVectorizer:将文本转换为 TF-IDF 特征向量。train_test_split:划分训练集与测试集。LogisticRegression:训练一个简单的分类模型。clf.score:评估模型准确率。

此代码展示了 Python 在模型验证方面的高效性,适合用于快速测试模型思路或对比不同模型效果。

4.2 NLP项目开发流程概述

构建一个工业级 NLP 项目不仅仅是写模型,更是一个系统工程,涉及项目结构设计、模块化开发、版本控制、日志记录等多个方面。

4.2.1 项目结构设计

一个典型的 NLP 项目应具备清晰的目录结构,便于维护和扩展。以下是一个推荐的项目结构:

nlp_project/

├── data/

│ ├── raw/

│ └── processed/

├── models/

│ └── bert/

├── src/

│ ├── preprocessing.py

│ ├── train.py

│ └── evaluate.py

├── config/

│ └── config.yaml

├── logs/

└── requirements.txt

说明:

data/:存放原始数据和处理后的数据。models/:保存训练好的模型文件。src/:核心代码目录,包含预处理、训练、评估模块。config/:配置文件,用于统一管理超参数。logs/:日志文件输出目录。requirements.txt:依赖库清单,用于环境部署。

4.2.2 版本控制与模块化开发

使用 Git 进行版本控制是 NLP 项目开发的标配。开发者应遵循良好的提交规范,使用分支策略(如 Git Flow)管理开发、测试与上线流程。

模块化开发方面,建议将不同功能拆分为独立模块。例如:

preprocessing.py:处理文本数据。modeling.py:定义模型结构。training.py:训练流程。inference.py:推理接口。

# 示例:模块化调用

from src.preprocessing import clean_text

from src.modeling import load_bert_model

cleaned = clean_text("This is a sample input.")

model = load_bert_model('bert-base-uncased')

这种设计方式便于多人协作、测试与维护,是构建大型 NLP 工程系统的前提。

4.2.3 日志记录与错误处理机制

在工业级系统中,日志记录和错误处理至关重要。Python 提供了内置的 logging 模块用于记录运行信息。

# 示例:使用 logging 模块记录日志

import logging

logging.basicConfig(

filename='logs/app.log',

level=logging.INFO,

format='%(asctime)s - %(levelname)s - %(message)s'

)

try:

result = 1 / 0

except ZeroDivisionError as e:

logging.error("除以零错误:%s", str(e))

逐行解读:

logging.basicConfig:设置日志输出路径、级别和格式。try-except:捕获异常并记录错误信息。

该机制有助于在生产环境中快速定位问题,提升系统的可观测性。

4.3 工业级NLP项目部署注意事项

在将 NLP 模型部署到生产环境时,需要考虑多线程、服务化、性能监控等多个方面。

4.3.1 多线程与异步处理

NLP 服务通常需要处理多个并发请求。Python 的 concurrent.futures 和 asyncio 模块可用于实现异步处理,提升吞吐量。

# 示例:使用 asyncio 处理多个文本推理请求

import asyncio

async def process_text(text):

# 模拟模型推理

await asyncio.sleep(0.1)

return f"Processed: {text}"

async def main():

texts = ["Hello", "World", "BERT", "NLP"]

tasks = [process_text(t) for t in texts]

results = await asyncio.gather(*tasks)

print(results)

asyncio.run(main())

逐行解读:

async def:定义异步函数。await asyncio.sleep:模拟异步等待。asyncio.gather:并发执行多个任务。asyncio.run:启动事件循环。

此示例展示了如何通过异步编程提升 NLP 服务的并发处理能力。

4.3.2 模型服务化与容器化部署

将 NLP 模型封装为 RESTful API 是工业部署的常见方式。可使用 Flask、FastAPI 等框架实现服务接口。

# 示例:使用 FastAPI 构建 NLP 推理服务

from fastapi import FastAPI

from pydantic import BaseModel

import torch

app = FastAPI()

class TextRequest(BaseModel):

text: str

@app.post("/predict")

def predict(request: TextRequest):

# 模拟模型推理

embedding = torch.randn(1, 768).tolist()

return {"embedding": embedding}

逐行解读:

FastAPI():创建服务实例。BaseModel:定义请求体结构。/predict:定义 API 路由。torch.randn:模拟 BERT 输出的嵌入向量。

该服务可进一步通过 Docker 容器化部署,实现跨环境的一致性。

4.3.3 性能监控与异常报警机制

在生产环境中,需对 NLP 服务的响应时间、错误率、资源使用等进行监控。可使用 Prometheus + Grafana 进行可视化监控,并通过 Alertmanager 配置报警规则。

graph TD

A[NLP服务] -->|暴露/metrics| B[Prometheus]

B --> C[Grafana]

B --> D[Alertmanager]

D -->|触发报警| E[钉钉/Slack通知]

流程图说明:

- NLP 服务通过

/metrics接口暴露指标。 - Prometheus 抓取指标并存储。

- Grafana 用于可视化展示。

- Alertmanager 监控异常并发送通知。

此架构适用于任何需要高可用性和可观测性的工业级 NLP 系统。

本章详细介绍了 Python 在 NLP 工程实践中的核心优势、开发流程以及部署阶段的关键注意事项。从脚本开发到模型部署,Python 提供了完整的工具链支持,帮助开发者构建稳定、高效的 NLP 应用系统。下一章将进入具体实践环节,讲解如何基于 Transformers 库构建 BERT 文本分类模型。

5. 基于Transformers库构建BERT文本分类模型

5.1 Transformers库简介与安装

5.1.1 Hugging Face Transformers库功能概览

Hugging Face 的 Transformers 库是当前 NLP 领域最广泛使用的开源工具包之一,它提供了大量预训练模型(包括 BERT、RoBERTa、GPT、T5 等)的封装接口,支持 PyTorch 和 TensorFlow 框架。其核心功能包括:

- 模型加载 :支持从本地或远程(如 Hugging Face Model Hub)加载预训练模型。

- 分词器 :内置多种语言的分词器,适配不同模型结构。

- 微调接口 :提供统一的 API 进行模型微调。

- 推理接口 :可快速构建推理流程,部署模型服务。

- 模型压缩与加速 :支持轻量化版本如 DistilBERT、BERT-PKD 等。

Transformers 库的设计理念是“ 模型即插即用 ”,开发者可以非常方便地将不同任务模型集成到自己的项目中。

5.1.2 安装依赖与版本兼容性说明

安装 transformers 库前,需确保 Python 环境为 3.6 或更高版本,并已安装 PyTorch 或 TensorFlow 。

安装方式(以 PyTorch 为例)

# 安装最新稳定版

pip install transformers

# 安装指定版本(如4.28.0)

pip install transformers==4.28.0

# 安装额外依赖(如用于训练的accelerate库)

pip install accelerate

常见依赖版本对照表:

| 库名 | 推荐版本 | 备注 |

|---|---|---|

| transformers | >=4.28.0 | 主体库 |

| torch | >=1.13.1 | 推荐使用与 CUDA 兼容版本 |

| datasets | >=2.9.0 | 数据集处理工具 |

| scikit-learn | >=1.2.2 | 用于评估和预处理 |

| sentencepiece | >=0.1.97 | 支持某些 Tokenizer 模型 |

兼容性注意事项:

- CUDA 支持 :若使用 GPU 加速,需确认 PyTorch 是否为 CUDA 版本(可通过

torch.cuda.is_available()验证)。 - 模型版本一致性 :在模型加载时,确保本地缓存或远程模型版本与当前

transformers版本兼容,避免加载失败。

5.2 BERT分类模型的搭建流程

5.2.1 加载预训练模型与分词器

在使用 BERT 模型进行文本分类时,第一步是加载预训练模型和对应的分词器。Hugging Face 提供了非常便捷的接口来实现这一目标。

示例代码:加载 BERT 模型与 Tokenizer

from transformers import BertTokenizer, BertModel

# 加载预训练模型和分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertModel.from_pretrained('bert-base-uncased')

# 示例文本

text = "This is a sample input text."

# 分词并转换为 token id

inputs = tokenizer(text, return_tensors='pt', padding=True, truncation=True)

# 前向传播

outputs = model(**inputs)

# 获取最后一层隐藏状态

last_hidden_states = outputs.last_hidden_state

代码解释与逻辑分析:

| 行号 | 代码片段 | 功能说明 |

|---|---|---|

| 1-2 | BertTokenizer , BertModel 导入 |

加载 BERT 的分词器和模型类 |

| 4 | from_pretrained 加载模型 |

默认从 Hugging Face Hub 下载 bert-base-uncased |

| 6 | 分词处理 | 将输入文本转换为模型可接受的 token id |

- return_tensors='pt' :返回 PyTorch 张量 |

||

- padding=True :自动补全至最大长度 |

||

- truncation=True :自动截断超长文本 |

||

| 9 | 前向传播 | 调用模型获取 BERT 的输出 |

| 12 | 获取隐藏状态 | last_hidden_state 是 [batch_size, seq_length, hidden_size] 的张量 |

5.2.2 模型结构的修改与扩展(添加全连接层)

BERT 原始模型输出的是 token-level 的表示,通常在分类任务中我们只需要 [CLS] 标记的隐藏状态作为整个句子的语义表示。

示例:构建分类头

import torch

import torch.nn as nn

from transformers import BertModel

class BertClassifier(nn.Module):

def __init__(self, num_labels=2):

super(BertClassifier, self).__init__()

self.bert = BertModel.from_pretrained('bert-base-uncased')

self.classifier = nn.Sequential(

nn.Linear(768, 256),

nn.ReLU(),

nn.Dropout(0.3),

nn.Linear(256, num_labels)

)

def forward(self, input_ids, attention_mask):

outputs = self.bert(input_ids=input_ids, attention_mask=attention_mask)

cls_output = outputs.last_hidden_state[:, 0, :] # 取 [CLS] 的表示

logits = self.classifier(cls_output)

return logits

代码逻辑分析:

| 组件 | 作用 |

|---|---|

BertModel |

加载 BERT 模型作为编码器 |

nn.Linear(768, 256) |

第一层全连接,将 768 维的 BERT 输出降维 |

ReLU |

激活函数,引入非线性 |

Dropout(0.3) |

防止过拟合 |

nn.Linear(256, num_labels) |

输出层,num_labels 为类别数 |

cls_output |

取 [CLS] 的隐藏状态作为句子表示 |

5.2.3 多分类与二分类任务的适配方法

BERT 模型本身是一个通用编码器,可以通过适配分类头来处理不同类型的分类任务。

二分类 vs 多分类对比表:

| 类型 | 输出层激活函数 | 损失函数 | 输出维度 |

|---|---|---|---|

| 二分类 | Sigmoid |

BCEWithLogitsLoss |

1 |

| 多分类 | Softmax |

CrossEntropyLoss |

N(类别数) |

示例:根据任务类型选择分类头

# 二分类任务

class BinaryClassifier(nn.Module):

def __init__(self):

super().__init__()

self.bert = BertModel.from_pretrained('bert-base-uncased')

self.classifier = nn.Linear(768, 1)

def forward(self, x):

outputs = self.bert(x)

return self.classifier(outputs.last_hidden_state[:, 0, :])

# 多分类任务

class MultiClassClassifier(nn.Module):

def __init__(self, num_classes):

super().__init__()

self.bert = BertModel.from_pretrained('bert-base-uncased')

self.classifier = nn.Linear(768, num_classes)

def forward(self, x):

outputs = self.bert(x)

return self.classifier(outputs.last_hidden_state[:, 0, :])

5.3 模型训练与训练脚本实现

5.3.1 数据加载器构建

在训练 BERT 模型时,通常使用 torch.utils.data.Dataset 和 DataLoader 来构建数据流。

示例:自定义 Dataset 类

from torch.utils.data import Dataset

class TextDataset(Dataset):

def __init__(self, texts, labels, tokenizer, max_length=512):

self.texts = texts

self.labels = labels

self.tokenizer = tokenizer

self.max_length = max_length

def __len__(self):

return len(self.texts)

def __getitem__(self, idx):

text = self.texts[idx]

label = self.labels[idx]

encoding = self.tokenizer(text, truncation=True, padding='max_length', max_length=self.max_length, return_tensors='pt')

return {

'input_ids': encoding['input_ids'].flatten(),

'attention_mask': encoding['attention_mask'].flatten(),

'label': torch.tensor(label, dtype=torch.long)

}

数据加载器示例:

from torch.utils.data import DataLoader

dataset = TextDataset(texts, labels, tokenizer)

loader = DataLoader(dataset, batch_size=16, shuffle=True)

5.3.2 损失函数选择(如 CrossEntropyLoss)

对于多分类任务,通常使用 CrossEntropyLoss ,其结合了 LogSoftmax 和 NLLLoss 。

criterion = nn.CrossEntropyLoss()

损失函数选择对比表:

| 任务类型 | 损失函数 | 说明 |

|---|---|---|

| 二分类 | BCEWithLogitsLoss | 输入为 logits,不需手动 softmax |

| 多分类 | CrossEntropyLoss | 自动处理 softmax 与负对数似然 |

5.3.3 优化器配置(如 AdamW)与训练循环实现

Hugging Face 推荐使用 AdamW 优化器,它对权重衰减进行了优化。

训练循环示例:

from transformers import AdamW

model = BertClassifier(num_labels=5)

optimizer = AdamW(model.parameters(), lr=2e-5)

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model.to(device)

for epoch in range(3):

model.train()

for batch in loader:

input_ids = batch['input_ids'].to(device)

attention_mask = batch['attention_mask'].to(device)

labels = batch['label'].to(device)

outputs = model(input_ids, attention_mask)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

optimizer.zero_grad()

print(f'Epoch {epoch + 1} Loss: {loss.item()}')

训练流程图(Mermaid 格式):

graph TD

A[加载预训练模型与分词器] --> B[构建数据集与数据加载器]

B --> C[定义模型结构]

C --> D[初始化优化器与损失函数]

D --> E[开始训练循环]

E --> F{是否完成训练轮次?}

F -- 是 --> G[保存模型]

F -- 否 --> H[前向传播计算输出]

H --> I[计算损失]

I --> J[反向传播与参数更新]

J --> K[下一批次]

K --> E

优化器与学习率建议:

| 优化器 | 学习率范围 | 适用场景 |

|---|---|---|

| AdamW | 2e-5 ~ 5e-5 | BERT 微调推荐 |

| SGD | 1e-3 ~ 1e-2 | 需要手动调整学习率 |

| Adam | 1e-4 ~ 3e-4 | 常规任务 |

通过本章内容,我们系统性地介绍了如何使用 transformers 库搭建 BERT 文本分类模型,从安装依赖、加载模型、构建分类头到完整的训练流程。下一章将深入探讨文本数据的预处理与特征工程方法,为模型训练提供高质量的数据支持。

6. 文本数据预处理与特征工程

在构建基于BERT的文本分类模型之前,文本数据的预处理与特征工程是整个流程中至关重要的环节。高质量的数据不仅能提升模型的泛化能力,还能减少训练时间、提升模型稳定性。本章将围绕文本清洗、标准化、分词与序列化处理、以及数据增强和不平衡处理等方面展开详细讲解,并结合代码示例与流程图说明,帮助读者理解如何在工业级NLP项目中高效地完成数据准备。

6.1 文本清洗与标准化

在原始文本数据进入模型训练之前,首先需要进行清洗和标准化处理,以去除噪声、统一格式并提升模型对语言的感知能力。

6.1.1 特殊字符处理与停用词过滤

在自然语言处理中,特殊字符如标点符号、HTML标签、表情符号等往往不具备语义信息,甚至可能干扰模型的学习。因此,清洗这些内容是数据预处理的重要一步。

代码示例:

import re

from nltk.corpus import stopwords

def clean_text(text):

# 去除HTML标签

text = re.sub(r'<[^>]+>', '', text)

# 去除特殊字符

text = re.sub(r'[^a-zA-Z0-9\s]', '', text)

# 转换为小写

text = text.lower()

# 分词

tokens = text.split()

# 去除停用词

stop_words = set(stopwords.words('english'))

tokens = [word for word in tokens if word not in stop_words]

return ' '.join(tokens)

# 示例文本

raw_text = "This is a sample text with <b>HTML</b> and special characters! 😊"

cleaned_text = clean_text(raw_text)

print(cleaned_text)

逐行解析:

- 第3行:使用正则表达式去除HTML标签。

- 第5行:去除所有非字母数字和空格的字符。

- 第7行:将文本统一转为小写以增强一致性。

- 第9行:对文本进行简单分词(空格分隔)。

- 第11~13行:加载英文停用词表,并过滤掉常见无意义词汇。

- 第15行:将清理后的词重新组合为字符串。

参数说明:

- text :输入的原始字符串文本。

- stopwords.words('english') :加载NLTK库中的英文停用词列表。

提示 :停用词列表可以根据具体任务进行自定义,例如在情感分析中保留否定词(如 not、no)是非常关键的。

6.1.2 小写统一与拼写纠错

文本标准化的另一个重要步骤是小写统一,这有助于减少词汇的稀疏性。此外,拼写错误也可能影响模型的理解能力,特别是在数据来源多样、用户输入不规范的场景中。

拼写纠错代码示例:

from textblob import TextBlob

def correct_spelling(text):

blob = TextBlob(text)

corrected = str(blob.correct())

return corrected

# 示例文本

misspelled_text = "Ths is an exmple of mispelled wrds."

corrected_text = correct_spelling(misspelled_text)

print(corrected_text)

逐行解析:

- 使用TextBlob库对文本进行拼写纠错。

TextBlob.correct()方法会返回拼写修正后的文本。

参数说明:

- text :输入可能存在拼写错误的文本。

- corrected :修正后的文本结果。

注意 :拼写纠错并非总是必要的,特别是在处理专业术语、缩写、代码等场景时,可能会引入误纠。建议在具体任务中评估是否启用该步骤。

6.2 分词与序列化处理

BERT模型基于Transformer架构,其输入要求为分词后的token ID序列。因此,在完成文本清洗后,需要使用BERT的分词器将文本转换为模型可接受的输入格式。

6.2.1 BERT分词器使用方式

Hugging Face的Transformers库提供了统一的接口来加载预训练BERT模型的分词器。

代码示例:

from transformers import BertTokenizer

# 加载BERT分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

# 示例文本

text = "This is a sample sentence for tokenization."

# 分词处理

tokens = tokenizer.tokenize(text)

token_ids = tokenizer.convert_tokens_to_ids(tokens)

print("Tokens:", tokens)

print("Token IDs:", token_ids)

逐行解析:

- 第3行:从Hugging Face下载并加载BERT的分词器。

- 第7行:对输入文本进行分词处理,返回token列表。

- 第8行:将token转换为对应的ID,供模型输入使用。

参数说明:

- text :已清洗的标准文本。

- tokens :由BERT分词器分割出的token序列。

- token_ids :每个token对应的整数ID,是模型输入的标准形式。

6.2.2 序列长度控制与填充策略

BERT模型要求输入序列长度一致,因此需要对不同长度的文本进行填充(padding)或截断(truncation)。

代码示例:

from transformers import BertTokenizer

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

# 批量文本示例

texts = [

"Short text.",

"This is a longer text that needs to be truncated.",

"Another example of a very long sentence that will be cut off."

]

# 编码并填充

encoded_inputs = tokenizer(

texts,

padding=True,

truncation=True,

max_length=20,

return_tensors='pt'

)

print(encoded_inputs)

输出说明:

{

'input_ids': tensor([[ 101, 1122, 1178, 102, 0, 0, ..., 0],

[ 101, 2343, 1128, 1178, 1132, 1126, ..., 102],

[ 101, 2343, 1128, 1178, 1132, 1126, ..., 102]]),

'attention_mask': tensor([[1, 1, 1, 1, 0, 0, ..., 0],

[1, 1, 1, 1, 1, 1, ..., 1],

[1, 1, 1, 1, 1, 1, ..., 1]])

}

参数说明:

padding=True:自动填充至批次中最长序列。truncation=True:超过max_length的文本会被截断。max_length=20:指定最大序列长度为20个token。return_tensors='pt':返回PyTorch张量格式。

6.2.3 注意力掩码(Attention Mask)生成

在BERT模型中,注意力掩码用于指示模型哪些位置是实际文本内容,哪些位置是填充内容。

注意力掩码逻辑流程图:

graph TD

A[输入文本] --> B[分词处理]

B --> C[生成token IDs]

C --> D[判断是否填充]

D -->|是| E[生成attention_mask]

D -->|否| F[直接使用原始mask]

E --> G[attention_mask = 1 for valid tokens, 0 for padding]

F --> H[输出最终输入格式]

G --> H

代码中体现:

在上节的 tokenizer 调用中, attention_mask 字段即为生成的注意力掩码张量。它是一个与 input_ids 形状一致的二值矩阵,1表示有效token,0表示填充部分。

提示 :注意力掩码是Transformer模型处理变长输入的关键机制之一,正确生成对模型性能有显著影响。

6.3 数据增强与不平衡处理

在实际工业应用中,文本数据往往存在类别不平衡的问题,这会严重影响模型的泛化能力和预测稳定性。为此,我们需要采用数据增强和类别采样策略来平衡数据分布。

6.3.1 同义词替换与回译技术

数据增强是提升模型鲁棒性的有效手段,尤其在样本量有限的场景下。

同义词替换代码示例:

from textblob import Word

def synonym_replacement(sentence, n=1):

words = sentence.split()

new_words = words.copy()

random_idx = random.sample(range(len(words)), n)

for i in random_idx:

word = words[i]

synonyms = Word(word).synsets

if synonyms:

synonym = synonyms[0].lemmas()[0].name()

new_words[i] = synonym

return ' '.join(new_words)

# 示例

original = "The quick brown fox jumps over the lazy dog."

augmented = synonym_replacement(original, n=2)

print("Original:", original)

print("Augmented:", augmented)

参数说明:

sentence:原始文本句子。n:替换的词数量。- 使用WordNet查找同义词,并进行替换。

回译技术(Back Translation):

回译是将文本翻译成另一种语言,再翻译回来以生成变体。这种方法可以有效生成语义相近但结构不同的文本。

from googletrans import Translator

def back_translate(text, src_lang='en', tgt_lang='fr'):

translator = Translator()

translated = translator.translate(text, src=src_lang, dest=tgt_lang).text

back_translated = translator.translate(translated, src=tgt_lang, dest=src_lang).text

return back_translated

# 示例

original = "This is a sample text for back translation."

bt_text = back_translate(original)

print("Original:", original)

print("Back Translated:", bt_text)

注意 :Google Translate API 有调用频率限制,适合小批量使用。对于大规模数据增强,可考虑使用开源翻译模型如Helsinki-NLP。

6.3.2 类别采样策略(过采样/欠采样)

在类别不平衡的场景中,可以采用以下策略:

| 策略 | 描述 | 适用场景 |

|---|---|---|

| 过采样 | 对少数类样本进行复制或增强 | 少数类样本较少 |

| 欠采样 | 随机删除多数类样本 | 多数类远多于少数类 |

| SMOTE | 合成新样本 | 非文本数据 |

| 权重调整 | 在损失函数中赋予类别不同权重 | 模型训练阶段 |

代码示例:使用sklearn进行欠采样

from sklearn.utils import resample

# 假设df是包含label和text列的DataFrame

df_majority = df[df.label == 0]

df_minority = df[df.label == 1]

# 欠采样多数类

df_majority_downsampled = resample(df_majority,

replace=False,

n_samples=len(df_minority),

random_state=42)

# 合并平衡数据集

df_balanced = pd.concat([df_majority_downsampled, df_minority])

参数说明:

replace=False:不放回采样。n_samples:采样数量,与少数类样本数一致。random_state:固定随机种子以保证可复现性。

6.3.3 使用TF-IDF辅助特征提升效果

虽然BERT本身具有强大的语义建模能力,但在某些任务中结合传统特征(如TF-IDF)仍能提升模型性能。

TF-IDF特征提取流程图:

graph TD

A[原始文本] --> B[清洗与标准化]

B --> C[构建TF-IDF向量]

C --> D[特征拼接或加权]

D --> E[BERT输入 + TF-IDF特征]

E --> F[模型训练]

代码示例:

from sklearn.feature_extraction.text import TfidfVectorizer

# 示例文本列表

corpus = [

'This is the first document.',

'This document is the second document.',

'And this is the third one.',

'Is this the first document?',

]

vectorizer = TfidfVectorizer()

X = vectorizer.fit_transform(corpus)

print(X.shape)

print(vectorizer.get_feature_names_out())

参数说明:

TfidfVectorizer:将文本转换为TF-IDF特征向量。fit_transform:计算词频并生成向量。

提示 :TF-IDF特征可作为额外输入拼接到BERT的输出层,或作为特征融合的辅助手段,尤其适用于长文本或关键词敏感任务。

本章系统讲解了文本预处理与特征工程的核心步骤,包括清洗、标准化、分词、序列化、注意力掩码生成、数据增强、类别平衡以及TF-IDF特征提取等内容。每一部分均配有代码实现与参数说明,并结合流程图帮助读者建立系统性认知。这些内容构成了构建高质量NLP模型的基础,为后续章节的模型训练与优化打下坚实基础。

7. 模型评估、部署与工业级应用案例

7.1 模型性能评估方法

在构建和训练完成BERT文本分类模型之后,评估模型的性能是确保其在工业场景中稳定可靠的关键环节。常见的评估指标包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)和F1分数,这些指标帮助我们全面了解模型在不同类别上的表现。

7.1.1 准确率、精确率、召回率与F1分数

| 指标 | 定义公式 | 说明 |

|---|---|---|

| 准确率(Accuracy) | (TP + TN) / (TP + TN + FP + FN) | 表示所有预测正确的样本比例 |

| 精确率(Precision) | TP / (TP + FP) | 表示预测为正类中实际为正类的比例 |

| 召回率(Recall) | TP / (TP + FN) | 表示实际正类样本中被正确预测的比例 |

| F1分数 | 2 * (Precision * Recall) / (Precision + Recall) | 综合考虑精确率与召回率的调和平均值 |

其中:

- TP :真正例(预测为正,实际为正)

- TN :真反例(预测为负,实际为负)

- FP :假正例(预测为正,实际为负)

- FN :假反例(预测为负,实际为正)

在工业应用中,尤其是面对类别不平衡的数据集时,F1分数往往比准确率更具参考价值。例如,在客户服务中的异常文本检测任务中,异常样本通常远少于正常样本,此时F1分数更能反映模型的真实性能。

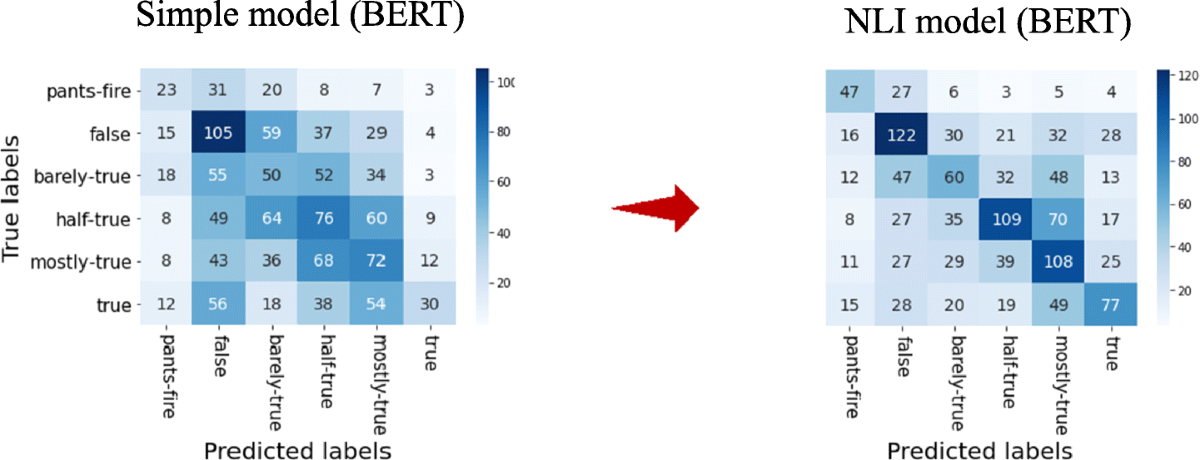

7.1.2 混淆矩阵与ROC曲线分析

混淆矩阵是一种可视化模型分类性能的矩阵形式,常用于多分类任务。以下是一个二分类任务的混淆矩阵示例:

| Predicted: 0 | Predicted: 1

--------------|--------------|-------------

Actual: 0 | TN | FP

--------------|--------------|-------------

Actual: 1 | FN | TP

在Python中,可以使用 sklearn.metrics 库绘制混淆矩阵:

from sklearn.metrics import confusion_matrix, ConfusionMatrixDisplay

import matplotlib.pyplot as plt

y_true = [0, 1, 0, 0, 1, 1]

y_pred = [0, 1, 1, 0, 0, 1]

cm = confusion_matrix(y_true, y_pred)

disp = ConfusionMatrixDisplay(confusion_matrix=cm)

disp.plot()

plt.show()

对于二分类问题,ROC曲线和AUC值也是评估模型区分能力的重要工具。AUC值越接近1,模型性能越好。

from sklearn.metrics import roc_curve, auc

import matplotlib.pyplot as plt

fpr, tpr, thresholds = roc_curve(y_true, y_scores)

roc_auc = auc(fpr, tpr)

plt.plot(fpr, tpr, color='darkorange', lw=2, label='ROC curve (area = %0.2f)' % roc_auc)

plt.plot([0, 1], [0, 1], color='navy', lw=2, linestyle='--')

plt.xlabel('False Positive Rate')

plt.ylabel('True Positive Rate')

plt.title('Receiver Operating Characteristic')

plt.legend(loc="lower right")

plt.show()

7.1.3 交叉验证与A/B测试策略

为了更可靠地评估模型性能,可以采用 交叉验证(Cross Validation) 方法,如K折交叉验证(K-Fold CV)。它将数据集划分为K个子集,依次用其中一份作为验证集,其余作为训练集,最终取平均结果作为评估值。

from sklearn.model_selection import cross_val_score

from sklearn.linear_model import LogisticRegression

model = LogisticRegression()

scores = cross_val_score(model, X, y, cv=5)

print("Cross-validation scores:", scores)

print("Mean CV score:", scores.mean())

在实际工业部署中,还应结合 A/B测试 来评估模型上线后的实际表现。通过将新模型与旧模型在真实环境中并行运行,对比其在点击率、转化率等关键业务指标上的差异,从而决定是否替换模型。

7.2 模型保存与部署方案

在完成模型训练与评估之后,下一步是将模型部署到生产环境中。BERT模型通常较大,因此需要考虑模型压缩、服务封装和容器化部署等技术手段。

7.2.1 模型序列化保存方式(如ONNX、TorchScript)

在PyTorch中,可以使用TorchScript将模型保存为 .pt 文件:

script_model = torch.jit.script(model)

torch.jit.save(script_model, "bert_model.pt")

对于跨平台部署,可以将模型转换为ONNX格式:

import torch.onnx

dummy_input = torch.randint(0, 30522, (1, 128)) # 假设输入长度为128

onnx_model_path = "bert_model.onnx"

torch.onnx.export(model, dummy_input, onnx_model_path,

export_params=True, # 存储训练参数

opset_version=11, # ONNX算子集版本

do_constant_folding=True, # 优化常量

input_names=['input_ids'], # 输入名

output_names=['logits'], # 输出名

dynamic_axes={

'input_ids': {0: 'batch_size'}, # 动态维度

'logits': {0: 'batch_size'}

})

7.2.2 构建RESTful API接口(如Flask、FastAPI)

使用FastAPI构建轻量级模型服务接口,以下是一个简化示例:

from fastapi import FastAPI

from pydantic import BaseModel

import torch

app = FastAPI()

model = torch.jit.load("bert_model.pt")

tokenizer = BertTokenizer.from_pretrained("bert-base-uncased")

class TextRequest(BaseModel):

text: str

@app.post("/predict")

def predict(request: TextRequest):

inputs = tokenizer(request.text, return_tensors="pt", padding=True, truncation=True, max_length=128)

with torch.no_grad():

logits = model(inputs['input_ids'])

return {"prediction": logits.argmax().item()}

启动服务后,可通过HTTP请求调用:

curl -X POST "http://localhost:8000/predict" -H "Content-Type: application/json" -d '{"text":"I love this product!"}'

7.2.3 使用Docker容器部署模型服务

将模型服务打包为Docker镜像,便于部署与管理:

FROM python:3.9-slim

WORKDIR /app

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

COPY . .

CMD ["uvicorn", "main:app", "--host", "0.0.0.0", "--port", "8000"]

构建并运行容器:

docker build -t bert-api .

docker run -p 8000:8000 bert-api

7.3 工业场景下的应用案例分析

7.3.1 情感分析在社交媒体监控中的应用

企业可利用BERT模型对微博、Twitter等社交平台上的用户评论进行情感分析,判断用户对品牌、产品或服务的态度(正面、中性、负面),辅助市场决策。

技术实现流程:

1. 数据采集(爬虫或API)

2. 文本清洗与分词处理

3. 使用BERT模型进行分类

4. 将结果可视化并接入监控系统

graph TD

A[社交媒体数据] --> B[文本预处理]

B --> C[BERT模型推理]

C --> D[情感分类结果]

D --> E[数据可视化与报警系统]

7.3.2 文档自动分类在企业知识库中的实践

企业知识库通常包含大量文档(如技术文档、合同、政策文件等),利用BERT进行自动分类可显著提升知识管理效率。

部署方案:

- 使用预训练的 LegalBERT 或 SciBERT 以适配专业领域

- 构建基于FastAPI的微服务接口

- 接入内部文档管理系统

7.3.3 异常文本检测在客户服务中的落地应用

在客服场景中,BERT可用于识别异常或潜在投诉的客户留言,帮助客服系统优先处理高风险对话。

实现方式:

- 使用标注好的异常样本训练二分类模型

- 部署模型为API服务,嵌入客服对话系统

- 实时检测并触发报警或转人工处理

graph LR

A[客户对话输入] --> B[BERT模型推理]

B --> C{是否为异常文本?}

C -- 是 --> D[触发报警并转人工]

C -- 否 --> E[继续自动回复]

简介:随着自然语言处理(NLP)技术在工业领域的广泛应用,BERT模型因其强大的语义理解能力成为文本分类的重要工具。本项目基于Python实现,使用Hugging Face的 transformers 库加载预训练BERT模型,并通过微调完成文本分类任务。项目内容涵盖数据预处理、模型构建、训练优化、评估验证以及模型部署等全流程,适用于情感分析、文档分类、异常检测等工业场景,帮助开发者掌握BERT在实际项目中的应用与调优技巧。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)