直击CVPR 2024具身智能盛宴:不可错过的AI风口

具身智能作为人工智能的重要分支,近年来在CVPR等国际顶级会议上受到广泛关注。其背景源于对自主智能体在复杂物理环境中感知、推理与行动能力的需求。目前,具身智能在单臂系统和双臂协作系统等方面取得了显著进展,但仍面临多模态信息融合、跨场景泛化等挑战。未来,具身智能有望在适应性与增量学习、多模态感知融合等方面取得突破,推动其向通用人工智能迈进,为机器人技术的发展带来新的机遇。

关注gongzhonghao【CVPR顶会精选】

具身智能作为人工智能的重要分支,近年来在CVPR等国际顶级会议上受到广泛关注。其背景源于对自主智能体在复杂物理环境中感知、推理与行动能力的需求。目前,具身智能在单臂系统和双臂协作系统等方面取得了显著进展,但仍面临多模态信息融合、跨场景泛化等挑战。

未来,具身智能有望在适应性与增量学习、多模态感知融合等方面取得突破,推动其向通用人工智能迈进,为机器人技术的发展带来新的机遇。今天小图给大家精选3篇CVPR有关具身智能方向的论文,请注意查收!

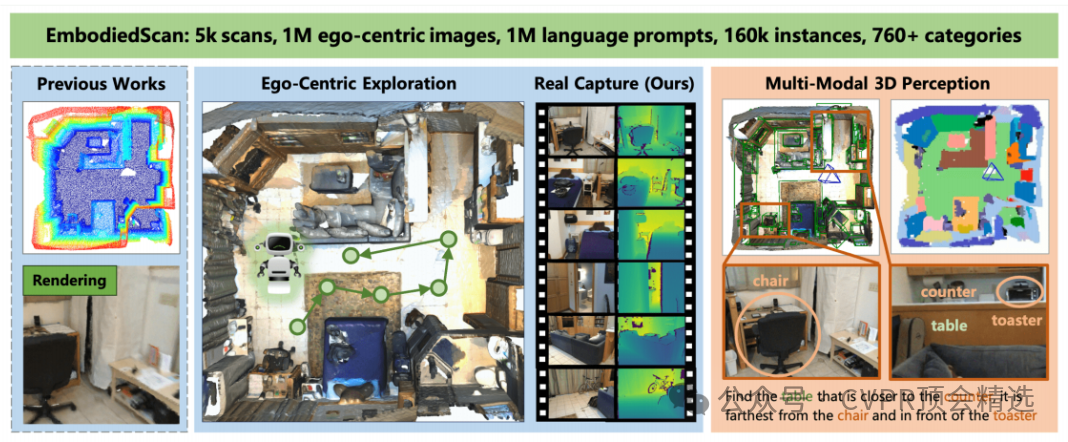

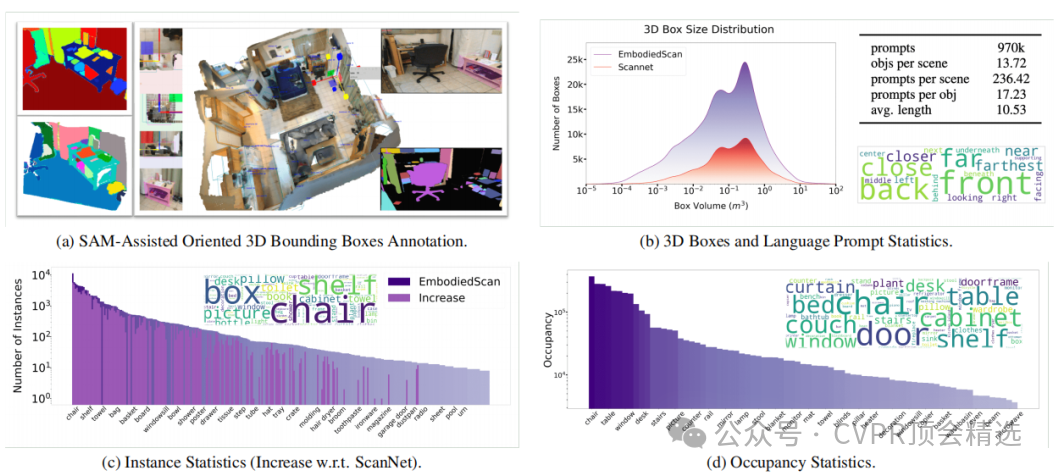

论文一:EmbodiedScan: A Holistic Multi-Modal 3D Perception Suite Towards Embodied AI

方法:

通过整合ScanNet等现有数据集并采用SAM辅助的标注管线,高效生成带方向的3D边界框与密集语义占用标签;构建Embodied Perceptron基线框架,其多模态编码器融合RGB-D序列与文本特征,利用透视投影实现跨视图特征对齐;基于融合后的稀疏体素与稠密体积特征,分别驱动检测头预测9自由度边界框,以及占用解码器输出场景级语义栅格,支撑语言接地任务端到端优化。

创新点:

-

构建了首个大规模多模态自我中心3D感知数据集EmbodiedScan,涵盖5000+扫描、100万张图像和语言提示,支持760+类别细粒度注释。

-

提出异构多级融合机制,通过投影引导实现任意视图输入的鲁棒特征聚合,突破多模态时序对齐瓶颈。

-

设计了面向任务的稀疏-稠密双解码器架构,联合优化定向3D检测与语义占用预测,实现语言交互下的场景动态建模。

论文链接:

https://arxiv.org/abs/2312.16170

图灵学术论文辅导

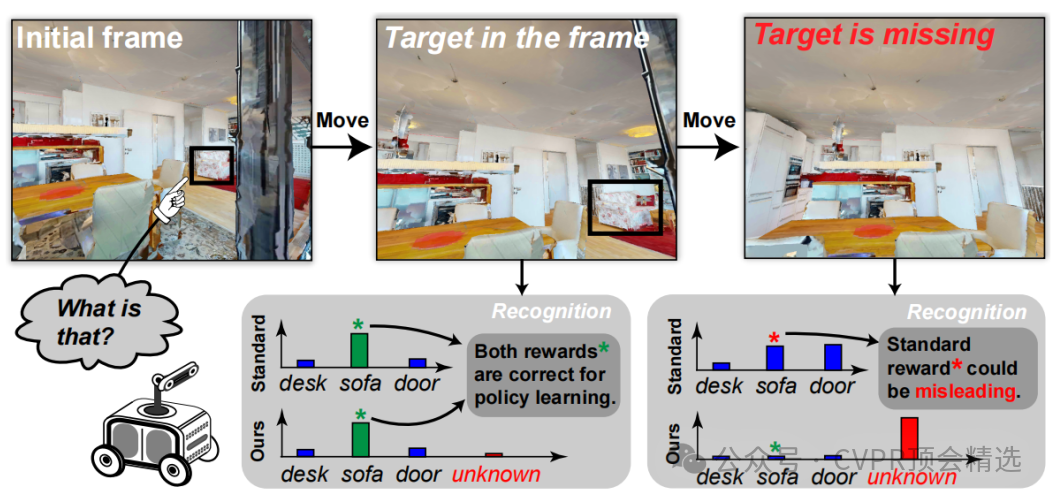

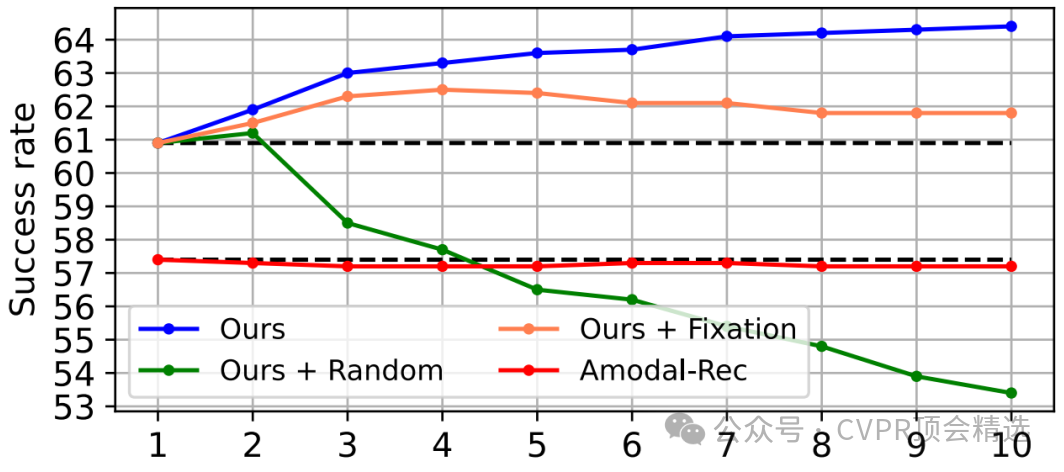

论文二:Evidential Active Recognition: Intelligent and Prudent Open-World Embodied Perception

方法:

文章将主动识别视为一个序贯的证据收集过程,通过在每一步估计证据和不确定性,利用证据组合理论进行最终预测。同时,通过构建新的数据集和设计新的奖励函数,该方法在开放世界环境中的主动识别任务上表现出色。

创新点:

-

提出了一种基于证据理论的主动识别方法,能够有效处理开放世界环境中的不确定性。

-

构建了一个新的测试数据集,涵盖了多种室内物体类别,并为每个测试实例分配了识别难度级别,以便更全面地评估方法。

-

设计了一种新的奖励函数,能够准确反映在开放世界环境中动作的价值,从而提高策略学习的性能。

论文链接:

https://arxiv.org/abs/2311.13793

图灵学术论文辅导

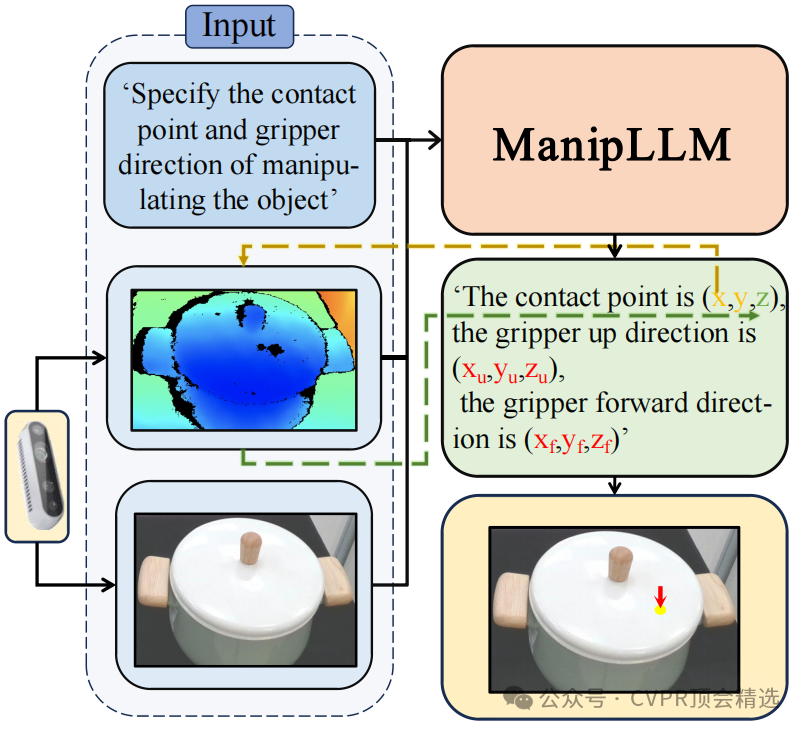

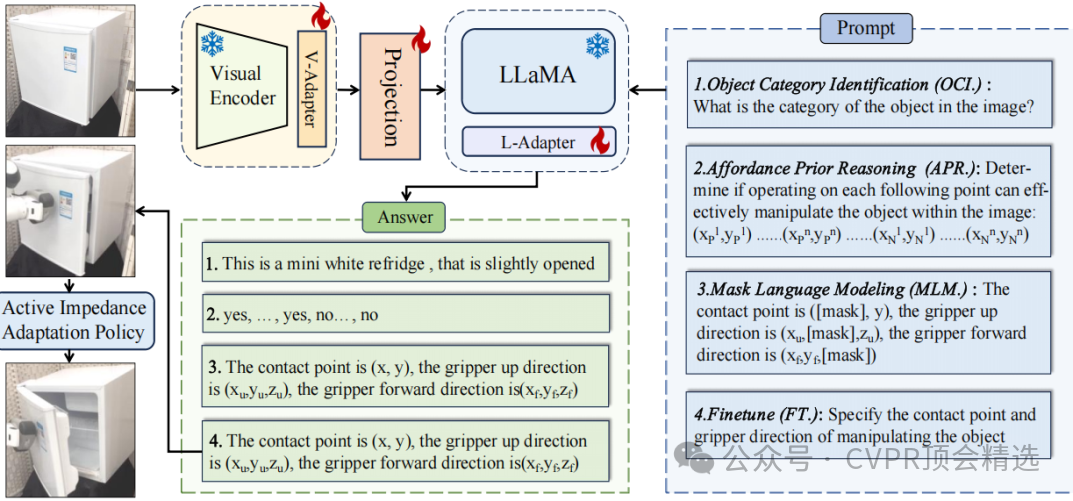

论文三:ManipLLM: Embodied Multimodal Large Language Model for Object-Centric Robotic Manipulation

方法:

文章采用了LLaMa-Adapter作为骨干网络,通过设计包括物体类别识别、操作先验推理和姿态预测在内的微调任务,使模型能够逐步学习物体的操作特征。在推理阶段,利用链式思考推理过程,结合RGB图像和文本提示预测末端执行器的姿态。此外,还引入了主动阻抗适应策略,通过闭环方式规划后续的运动轨迹。

创新点:

-

首次将多模态大语言模型应用于物体中心的机器人操作,通过微调注入的适配器,保留了模型的常识推理能力,同时赋予其操作能力。

-

设计了链式思考的微调和推理策略,使模型能够逐步从类别、区域到姿态进行预测,增强了操作的稳定性和可解释性。

-

提出了一种主动阻抗适应策略,通过力反馈调整运动方向,确保在复杂环境中实现平滑的操作轨迹。

论文链接:

https://arxiv.org/abs/2312.16217

本文选自gongzhonghao【CVPR顶会精选】

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)