OpenAI 终于下场!官宣开源两款大模型:gpt-oss-120b 和 gpt-oss-20b,继续Apache 2.0协议

开源模型补充了我们托管的模型,为开发者提供了更广泛的工具,以加速前沿研究、促进创新,并在各种用例中实现更安全、更透明的AI开发。好吧,说实话,大模型这种究竟是叫“开放”还是“开源”,我也不好定义,官方也是模糊着来,一会儿用“Open”一会又用“Open Source”,不过无所谓了,本文小编全部都翻译为“开源”了。GPT-OSS-120B 和 GPT-OSS-20B 这两款模型,统称GPT-OSS

点击卡片关注一下,感谢您的支持!

到底是不让人睡觉了!

就在刚刚,OpenAI 正式开源两个大模型!虽然上周坊间一直就有传闻 OpenAI 要开源,但没想到,OpenAI 突然就把两款大模型给放出来了。

笔者的开源监控系统,在OpenAI官宣开源后推送了消息

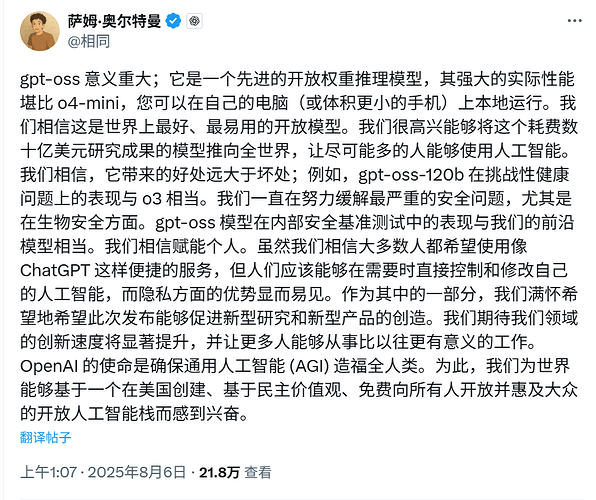

奥特曼解释了开源的原因

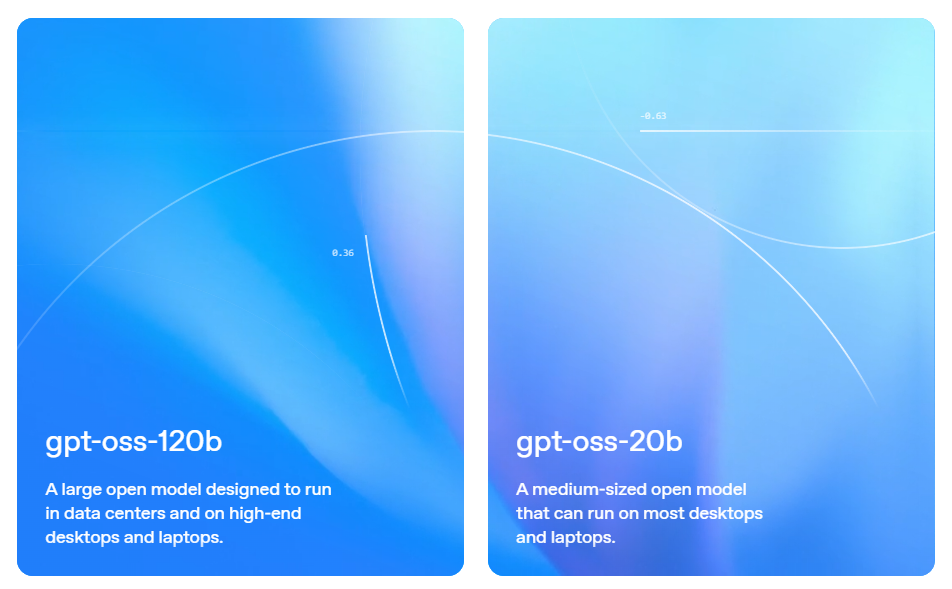

点进官网一看,名字非常的简单粗暴:“gpt-oss”,后面那个 oss 即 Open Source Series,嗯哼,说白了就是“GPT 的开源系列”。

GPT-OSS-120B 和 GPT-OSS-20B 这两款模型,统称GPT-OSS系列,这是自 2019 年 GPT-2 后 OpenAI 又一次重新对外开放权重的模型,间隔了五年之久,采用Apache 2.0许可,允许商用和修改。官网描述是专为 强大的推理能力、智能体任务(agentic tasks)及灵活的开发者应用场景 设计。(好巧不巧,Claude Opus 4.1几乎也在同一时间发布了,看来大家好像都在憋大招,就等着谁先出啊,不过,这对于如今的AI界来说,似乎早已见怪不怪了)

以下是两款模型的核心特征总结:

# 模型规格与适用场景

gpt-oss-120b 参数量

-

1170 亿(117B)参数(其中 51 亿为激活参数)适用场景

-

生产环境、通用高推理需求(如复杂逻辑、代码生成)硬件要求

-

单块 H100 GPU 即可运行

gpt-oss-20b 参数量

-

210 亿(21B)参数(其中 36 亿为激活参数)适用场景

-

低延迟任务、本地化部署或专用场景(如边缘设备、实时交互)硬件要求

-

内存 16GB 即可运行

Tips:两模型均基于 harmony 响应格式 训练,需搭配该格式使用,否则无法正常工作。

国内的搞开源的可能看到这个 harmony 关键字有些懵,不要误会,不是华为那个,其实这是 OpenAI 专门给开源系列模型定义的一个响应格式规范。gpt-oss 系列模型必须基于 harmony 响应格式(harmony response format)进行训练,旨在标准化对话结构、生成推理输出及组织工具调用。

更多信息可以访问此链接:

https://github.com/openai/harmony

#核心亮点

-

宽松的 Apache 2.0 许可证(Apache 2.0 license)

-

-

允许自由商业化、定制化及实验,无 copyleft 限制或专利风险。

-

-

可配置的推理强度(Configurable reasoning effort)

-

-

根据任务需求动态调整推理资源(低、中、高三档),平衡性能与延迟。

-

-

完整链式推理(Full chain-of-thought)

-

-

开放模型的推理过程,便于调试与结果可信度验证(非面向最终用户)。

-

-

支持微调(Fine-tunable)

-

-

可针对特定场景进行参数微调,实现深度定制化。

-

-

智能体功能(Agentic capabilities)

-

-

原生支持函数调用、网页浏览、Python 代码执行及结构化输出(Structured Outputs)。

-

-

原生 MXFP4 量化技术(Native MXFP4 quantization)

-

-

gpt-oss-120b 可运行于单块 H100 GPU;

-

gpt-oss-20b 仅需 16GB 内存即可运行。

-

针对 MoE(Mixture of Experts)层优化,显著降低硬件资源消耗。

-

# 开发者建议

若需处理复杂任务(如代码生成、多步骤逻辑),选择 gpt-oss-120b;

若侧重低延迟或资源受限场景(如边缘设备),推荐 gpt-oss-20b

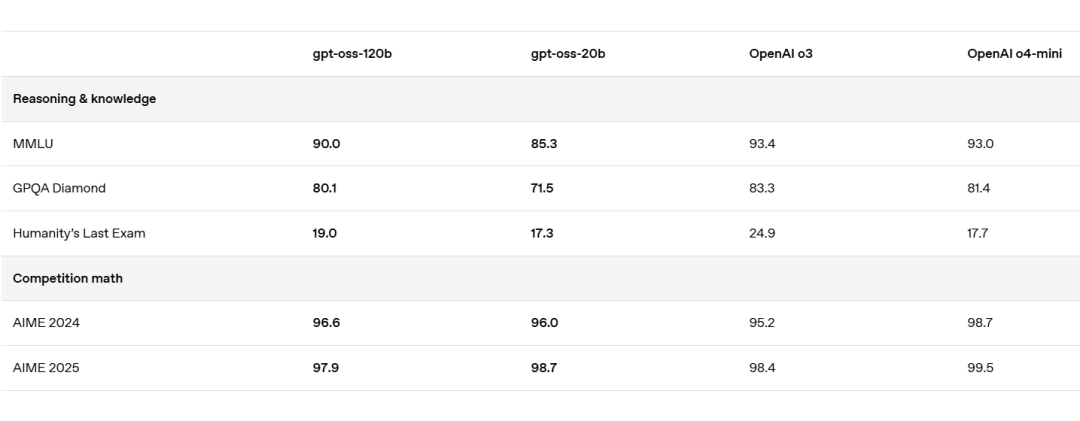

# 性能对比

这个看一下官网的对比数据吧。

# 为什么选择开源?

好吧,说实话,大模型这种究竟是叫“开放”还是“开源”,我也不好定义,官方也是模糊着来,一会儿用“Open”一会又用“Open Source”,不过无所谓了,本文小编全部都翻译为“开源”了。模型开源的同时,OpenAI 同步发布了一篇博客,详细介绍了各项指标和技术细节:

https://openai.com/index/introducing-gpt-oss/

具体的本篇文章就不作介绍了,不过,这篇文章的结尾重点讲了 OpenAI 为什么要开源此次模型,跟上面奥特曼介绍的一样,给读者们分享一下原文:

Why open models matter

开源模型的重要性

Releasing gpt-oss-120b and gpt-oss-20b marks a significant step forward for open-weight models. At their size, these models deliver meaningful advancements in both reasoning capabilities and safety. Open models complement our hosted models, giving developers a wider range of tools to accelerate leading edge research, foster innovation and enable safer, more transparent AI development across a wide range of use cases.

发布 gpt-oss-120b 和 gpt-oss-20b 标志着开源权重模型迈出了重要的一步。凭借其规模,这些模型在推理能力和安全性方面都取得了显著的进步。开源模型补充了我们托管的模型,为开发者提供了更广泛的工具,以加速前沿研究、促进创新,并在各种用例中实现更安全、更透明的AI开发。

These open models also lower barriers for emerging markets, resource-constrained sectors, and smaller organizations that may lack the budget or flexibility to adopt proprietary models. With powerful, accessible tools in their hands, people around the world can build, innovate, and create new opportunities for themselves and others. Broad access to these capable open-weights models created in the US helps expand democratic AI rails.

这些开源模型也为新兴市场、资源受限的领域和小型组织降低了门槛,这些组织可能缺乏预算或灵活性来采用专有模型。在强大的、易于获取的工具的帮助下,世界各地的人们可以构建、创新,为自己和他人创造新的机会。广泛使用在美国创建的这些功能强大的开源权重模型,有助于扩展民主化的AI基础设施。

A healthy open model ecosystem is one dimension to helping make AI widely accessible and beneficial for everyone. We invite developers and researchers to use these models to experiment, collaborate and push the boundaries of what's possible. We look forward to seeing what you build.

一个健康的开源模型生态系统是使AI广泛可访问并造福每个人的其中一个关键方面。我们邀请开发者和研究人员使用这些模型进行实验、合作,并突破可能的边界。我们期待看到您所构建的成果。

好的,本期分享就到这里,大家可以去看看隔壁 Claude Opus 4.1 了~

亲爱的读者们,不星标《明说开源》公众号,不仅会收不到最新推送,还会看不到主理人精心挑选的封面大图!星标《明说开源》,不错过每一篇最值得阅读的开源文章。

编辑:李小明

@明说开源

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献268条内容

已为社区贡献268条内容

所有评论(0)