ChatGLM案例分享

本文系统介绍了ChatGLM大模型的技术架构、本地化部署流程及在智能客服、教育辅导和企业知识管理等领域的行业应用,涵盖模型加载、量化优化、RAG增强与性能评估等关键技术环节。

1. ChatGLM大模型的技术演进与核心架构

1.1 技术背景与发展历程

ChatGLM系列由智谱AI基于Transformer架构自主研发,专注于中英文双语场景下的高效语言理解与生成。从早期的百亿参数模型起步,逐步迭代至拥有68亿参数的 ChatGLM-6B ,并在后续推出量化版本(如int4/int8)及微调变体(ChatGLM2-6B、ChatGLM3-6B),显著提升推理效率与对话连贯性。其训练数据涵盖大规模中文语料,在知乎、百度贴吧等真实对话场景中进行充分预训练与指令微调,使模型具备较强的上下文感知能力。

1.2 核心架构设计原理

ChatGLM采用改进的 Prefix-LM 结构,区别于传统因果语言模型(Causal LM),允许在前缀部分使用双向注意力机制,从而增强对输入上下文的理解。该结构在生成阶段仍保持自回归特性,确保输出流畅性。具体实现如下:

# 示例:Hugging Face中加载ChatGLM模型结构

from transformers import AutoTokenizer, AutoModelForCausalLM

tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

上述代码通过 trust_remote_code=True 启用自定义模型类支持,加载包含Prefix-LM逻辑的完整架构。

1.3 关键技术创新点

| 技术组件 | 实现方式与优势 |

|---|---|

| 双向注意力机制 | 在非生成区域启用双向注意力,提升上下文编码质量 |

| RoPE位置编码 | 旋转式位置嵌入(Rotary Position Embedding),支持长序列建模且易于外推 |

| 中文优化分词器 | 基于Zhipu BPE构建,对中文字符与符号高度敏感,降低分词碎片化 |

此外,ChatGLM通过 ALiBi (Attention with Linear Biases)策略进一步优化位置表达,避免绝对位置编码带来的泛化限制,为后续本地部署和行业应用奠定技术基础。

2. 对话系统构建的理论基础

对话系统的本质是模拟人类语言交互过程,实现自然、连贯且目标导向的多轮沟通。随着深度学习尤其是预训练语言模型(PLM)的发展,现代对话系统已从早期基于规则与模板的方法演进为以数据驱动和语义理解为核心的智能架构。本章聚焦于支撑高质量对话生成的核心理论体系,涵盖从底层语言建模机制到高层推理能力演化,再到输出安全控制的完整链条。通过系统解析对话状态管理、上下文感知、意图识别、思维链推理及价值观对齐等关键技术环节,揭示当前大模型在实际应用中如何平衡生成质量、逻辑一致性与社会伦理边界。

2.1 自然语言处理中的对话建模理论

构建一个具备真实交互能力的对话系统,不仅需要强大的语言生成能力,更依赖于对用户意图的精准捕捉、上下文信息的有效整合以及语义一致性的持续维护。传统任务型对话系统常采用模块化设计,包括语音识别、自然语言理解(NLU)、对话状态跟踪(DST)、策略决策和自然语言生成(NLG)等组件。然而,在开放域或混合型场景下,这种分阶段流水线结构容易导致误差累积和语义断裂。近年来,端到端大模型逐渐成为主流方案,但其背后仍需坚实的对话建模理论作为支撑,尤其是在多轮交互中维持语义连贯性和上下文相关性方面。

2.1.1 对话状态跟踪与意图识别机制

对话状态跟踪(Dialogue State Tracking, DST)是任务型对话系统中的核心模块,负责动态维护用户在对话过程中表达的需求状态。该状态通常以槽位-值对(slot-value pairs)的形式表示,例如在订餐场景中,“餐厅类型=川菜”、“人数=4人”、“时间=今晚7点”。DST的目标是从每一轮用户输入中提取关键信息,并更新全局对话状态,为后续策略选择提供依据。

现代DST方法主要分为基于规则、统计模型和神经网络三类。其中,基于BERT或RoBERTa等预训练模型的序列标注方法已成为主流。以下是一个典型的基于Transformer的DST模型结构示例:

from transformers import AutoTokenizer, AutoModelForTokenClassification

import torch

# 加载预训练模型用于槽位填充

tokenizer = AutoTokenizer.from_pretrained("bert-base-uncased")

model = AutoModelForTokenClassification.from_pretrained(

"dmis-lab/biobert-v1.1",

num_labels=7 # 假设有7个槽位类别

)

def extract_slots(user_utterance):

inputs = tokenizer(user_utterance, return_tensors="pt", padding=True, truncation=True)

with torch.no_grad():

outputs = model(**inputs)

predictions = torch.argmax(outputs.logits, dim=-1)

# 解码预测结果

slots = []

tokens = tokenizer.convert_ids_to_tokens(inputs["input_ids"][0])

for token, pred in zip(tokens, predictions[0]):

if pred != 0: # 忽略O标签

slots.append((token, model.config.id2label[pred.item()]))

return slots

# 示例调用

print(extract_slots("I want to book a table for four at a Sichuan restaurant tonight."))

代码逻辑逐行解读:

AutoTokenizer和AutoModelForTokenClassification分别加载分词器和用于命名实体识别(NER)风格槽位抽取的预训练模型。- 使用

biobert-v1.1作为基础模型,因其在领域特定语义理解上有较强表现;num_labels=7表示定义了7种槽位类型(如restaurant_type, party_size等)。 extract_slots函数将用户语句编码为模型可处理的张量格式,启用无梯度前向传播获取输出 logits。torch.argmax取最大概率标签索引,完成每个token的分类。- 将ID映射回原始token并结合标签名称输出槽位结果。

| 槽位类型 | 示例值 | 说明 |

|---|---|---|

| restaurant_type | Sichuan | 餐厅菜系 |

| party_size | 4 | 就餐人数 |

| reservation_time | tonight 7pm | 预订时间 |

| location | downtown | 地理位置 |

| price_range | moderate | 价格区间 |

| dietary_restriction | vegetarian | 饮食限制 |

| special_request | window seat | 特殊需求 |

该表格展示了常见任务型对话中的典型槽位及其可能取值范围,DST系统需能准确识别并归一化这些值。值得注意的是,当面对模糊表述(如“下周某个晚上”)时,模型还需结合上下文进行推断或主动澄清,这要求引入记忆机制或外部知识库支持。

此外,意图识别(Intent Detection)通常与DST协同工作。它判断用户当前话语的主要目的,如“预订餐厅”、“查询菜单”或“取消订单”。常用方法包括文本分类模型(如TextCNN、FastText或BERT-based分类器),其输入为整句语义编码,输出为预定义意图类别的概率分布。

2.1.2 多轮对话上下文管理方法

在真实对话场景中,用户往往不会一次性提供所有必要信息,而是逐步补充细节。因此,系统必须能够有效管理和利用历史对话内容,避免重复提问或信息丢失。多轮上下文管理的关键在于构建一个持久化的对话记忆结构,既能存储过往交互记录,又能按需检索相关信息。

一种常见的做法是使用 对话历史拼接法 (Concatenated History),即将最近N轮对话按顺序拼接成单一输入序列送入模型。例如:

User: 我想找一家日料店。

Bot: 好的,请问您希望在哪片区域?

User: 中关村附近。

Bot: 您有几个人用餐呢?

User: 两个人。

Bot: 已为您筛选出中关村地区的日式料理餐厅,适合两人就餐...

在此过程中,模型接收如下输入:

[CLS] User: 我想找一家日料店。 Bot: 好的,请问您希望在哪片区域? User: 中关村附近。 Bot: 您有几个人用餐呢? User: 两个人。 [SEP]

尽管简单有效,但该方法存在明显局限:随着对话轮次增加,输入长度迅速膨胀,超出模型最大上下文窗口(如ChatGLM为2048 tokens),造成截断或性能下降。为此,研究者提出了多种优化策略:

| 方法 | 原理描述 | 优点 | 缺点 |

|---|---|---|---|

| 上下文滑动窗口 | 仅保留最近K轮对话 | 控制输入长度 | 易丢失早期重要信息 |

| 关键信息摘要 | 利用摘要模型压缩历史为简短描述 | 显著减少token消耗 | 摘要过程可能遗漏细节 |

| 向量记忆池(Memory Network) | 将每轮对话编码为向量存入可寻址记忆单元 | 支持高效检索 | 实现复杂,训练成本高 |

| KV缓存复用(Inference-time Cache) | 在自回归生成时缓存注意力键值对,避免重复计算 | 提升推理效率 | 仅适用于同一会话内的连续响应生成 |

以KV缓存为例,在基于Transformer的解码器中,每一层的注意力机制都会生成Key和Value矩阵。若每次生成新token都重新计算整个历史的KV,则计算开销极大。而通过缓存之前轮次的KV状态,可以在后续响应中直接复用,大幅降低延迟。

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True)

# 初始化缓存

past_key_values = None

conversation_history = []

def generate_response(user_input):

global past_key_values

# 构造输入

full_input = "".join(conversation_history + [f"User: {user_input}\nBot:"])

inputs = tokenizer(full_input, return_tensors="pt").to(model.device)

# 使用缓存进行快速生成

outputs = model.generate(

**inputs,

max_new_tokens=128,

past_key_values=past_key_values,

use_cache=True

)

# 更新缓存

past_key_values = outputs.past_key_values

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

bot_response = response[len(full_input):]

# 记录对话历史

conversation_history.append(f"User: {user_input}\nBot: {bot_response}\n")

return bot_response

参数说明与逻辑分析:

past_key_values: 存储每一层注意力模块的Key和Value张量,形状为(num_layers, 2, batch_size, num_heads, seq_len, head_dim)。use_cache=True启用KV缓存机制,使模型在生成下一个token时不必重新计算历史部分的注意力。max_new_tokens=128限制生成长度,防止无限输出。- 每次调用后更新

conversation_history和past_key_values,确保上下文延续。

该机制显著提升了长对话场景下的响应速度,尤其适合本地部署资源受限环境。

2.1.3 语义连贯性与一致性评估指标

衡量对话系统性能不仅要看单轮回复的质量,更要关注多轮交互中的语义连贯性与事实一致性。理想的对话应满足:(1)语义流畅,语法正确;(2)前后呼应,不自相矛盾;(3)忠实于用户意图,不偏离主题。

常用的自动评估指标包括:

| 指标 | 定义 | 适用场景 | 局限性 |

|---|---|---|---|

| BLEU | n-gram精度匹配参考译文 | 封闭式问答、机器翻译 | 忽视语义差异,偏向短句 |

| ROUGE | 召回率导向的n-gram重叠度 | 文本摘要、生成任务 | 对同义替换不敏感 |

| METEOR | 引入同义词和词干匹配的F-score变体 | 开放生成 | 计算复杂,依赖外部词典 |

| Perplexity | 模型对测试集的平均负对数似然 | 语言模型内部评估 | 无法反映语义合理性 |

| Consistency Score | 基于规则或模型判断回复是否与历史陈述一致 | 多轮对话验证 | 需要人工标注或强监督模型 |

除自动指标外,人工评估仍是金标准。常用维度包括:

- 相关性(Relevance) :回答是否切题;

- 信息量(Informativeness) :是否提供了有用内容;

- 自然度(Naturalness) :语言是否像真人所说;

- 一致性(Consistency) :是否与之前说法冲突;

- 共情能力(Empathy) :是否表现出情感理解。

实践中,可通过A/B测试比较不同模型版本的表现,结合定量指标与定性反馈形成综合评分体系。例如,在客服机器人上线前,组织真实用户进行封闭测试,收集满意度打分与错误案例,进而迭代优化。

综上所述,对话建模理论构成了智能对话系统的基石。从精确的状态跟踪到高效的上下文管理,再到科学的评估机制,每一个环节都直接影响用户体验。唯有深入理解这些原理,才能在后续实践中合理选型、调优并规避潜在问题。

3. ChatGLM本地化部署与环境配置实践

随着大语言模型在企业级应用和研究场景中的普及,将高性能模型如ChatGLM-6B进行本地化部署已成为提升数据安全性、降低网络依赖、实现定制化服务的关键路径。本章聚焦于从零开始完成ChatGLM的本地部署全过程,涵盖软硬件准备、模型加载优化、推理服务构建以及Web接口封装等关键环节。通过系统性的实操指导,帮助开发者在实际生产环境中稳定运行该模型,并为后续行业应用打下坚实基础。

本章内容不仅适用于具备一定深度学习背景的技术人员,也对希望快速搭建私有对话系统的团队提供可落地的操作范式。我们将结合主流工具链(如Hugging Face Transformers、FastAPI、Gradio),深入剖析每一步的技术细节,尤其关注资源消耗控制、响应效率优化和安全性设置等核心问题。

3.1 部署前的软硬件环境准备

在启动任何大规模语言模型的本地部署之前,必须对目标运行环境进行全面评估与合理配置。不恰当的硬件选择或软件依赖缺失可能导致模型无法加载、显存溢出甚至服务崩溃。因此,科学规划软硬件资源配置是确保ChatGLM高效稳定运行的前提条件。

3.1.1 GPU资源配置建议与CUDA驱动安装

ChatGLM-6B作为一款参数量达到60亿级别的Transformer模型,其推理过程高度依赖GPU加速。若使用原始FP16精度加载,模型至少需要约12GB显存;而在训练或微调阶段,则通常要求单卡24GB以上显存(如NVIDIA A100或RTX 3090/4090)。对于仅用于推理的轻量化部署场景,可通过量化技术进一步压缩模型体积,从而适配更低端设备。

以下是推荐的GPU配置方案:

| 显卡型号 | 显存容量 | 是否支持FP16 | 推荐用途 | CUDA兼容性 |

|---|---|---|---|---|

| RTX 3060 | 12GB | 是 | 轻量推理 | 支持CUDA 11.x+ |

| RTX 3090 | 24GB | 是 | 中等规模推理/微调 | 支持CUDA 11.8+ |

| A100 | 40/80GB | 是 | 大规模训练与高并发服务 | 支持CUDA 11.8+ |

| L40S | 48GB | 是 | 数据中心级部署 | 支持CUDA 12.x |

注意 :并非所有NVIDIA GPU都适合大模型推理。应优先选择支持Tensor Core的安培架构及以上产品,以获得更好的矩阵运算性能。

CUDA与cuDNN安装步骤

以Ubuntu 22.04系统为例,执行以下命令安装CUDA Toolkit:

# 添加NVIDIA包仓库

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2204/x86_64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

# 安装CUDA Toolkit 12.1

sudo apt-get install -y cuda-toolkit-12-1

安装完成后验证是否成功:

nvidia-smi

nvcc --version

输出中应包含CUDA版本信息及GPU状态。接着安装cuDNN(需注册NVIDIA开发者账号):

# 下载对应版本的deb包后执行:

sudo dpkg -i libcudnn8_8.9.7.29-1+cuda12.1_amd64.deb

sudo dpkg -i libcudnn8-dev_8.9.7.29-1+cuda12.1_amd64.deb

最后配置环境变量,在 ~/.bashrc 中添加:

export PATH=/usr/local/cuda-12.1/bin:$PATH

export LD_LIBRARY_PATH=/usr/local/cuda-12.1/lib64:$LD_LIBRARY_PATH

重新加载配置并测试PyTorch能否识别GPU:

import torch

print(torch.cuda.is_available()) # 应返回 True

print(torch.cuda.get_device_name(0)) # 输出GPU名称

若返回False,请检查驱动版本是否匹配,可使用 nvidia-driver-535 或更高版本。

3.1.2 Python虚拟环境搭建与依赖包管理

为了避免不同项目之间的依赖冲突,强烈建议使用虚拟环境隔离ChatGLM相关依赖。我们采用 conda 作为包管理工具,因其在处理CUDA、PyTorch等复杂二进制依赖时更为稳健。

创建独立环境并激活:

conda create -n chatglm python=3.10

conda activate chatglm

安装核心依赖库:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

pip install transformers accelerate sentencepiece tiktoken gradio fastapi uvicorn

其中各包作用如下表所示:

| 包名 | 版本要求 | 功能说明 |

|---|---|---|

torch |

>=2.0 | 深度学习框架,支持自动求导与GPU计算 |

transformers |

>=4.34 | Hugging Face模型加载与推理接口 |

accelerate |

>=0.23 | 分布式推理与显存优化调度器 |

sentencepiece |

>=0.1.99 | ChatGLM分词器依赖 |

gradio |

>=3.38 | 快速构建可视化界面 |

fastapi |

>=0.104 | 构建RESTful API服务 |

uvicorn |

>=0.23 | ASGI服务器,支持异步请求 |

为防止未来环境丢失,导出当前依赖列表:

pip freeze > requirements.txt

此外,建议启用Jupyter Notebook进行调试:

pip install jupyterlab

jupyter lab

此时可在Notebook中编写测试脚本,确认基础环境无误。

3.1.3 Hugging Face模型下载与缓存配置

ChatGLM-6B已开源发布于 Hugging Face Hub ,但直接调用 from_pretrained() 可能因网络限制导致下载失败。为此,需提前手动下载模型文件并配置本地缓存路径。

首先登录Hugging Face账户并获取访问令牌(Access Token),然后配置git-lfs支持:

git lfs install

git clone https://hf_token_xxx@huggingface.co/THUDM/chatglm3-6b

其中 hf_token_xxx 替换为个人Token。克隆完成后,模型将保存在本地目录。

为避免重复下载,设置环境变量指定缓存路径:

export HF_HOME="/path/to/your/model/cache"

export TRANSFORMERS_CACHE="$HF_HOME/transformers"

也可在Python代码中指定:

from transformers import AutoTokenizer, AutoModel

tokenizer = AutoTokenizer.from_pretrained(

"/local/path/chatglm3-6b",

trust_remote_code=True

)

model = AutoModel.from_pretrained(

"/local/path/chatglm3-6b",

trust_remote_code=True,

device_map="auto" # 自动分配GPU/CPU设备

)

参数说明:

- trust_remote_code=True :允许加载自定义模型类(ChatGLM使用了非标准结构)

- device_map="auto" :由 accelerate 库自动分配层到多GPU或CPU

- 若显存不足,可加入 low_cpu_mem_usage=True 减少内存占用

若在国内访问受限,可使用镜像站点加速下载:

huggingface-cli download --resume-download --local-dir-use-symlinks False \

--cache-dir ./models THUDM/chatglm3-6b

或通过阿里云ModelScope平台同步:

from modelscope.hub.snapshot_download import snapshot_download

model_dir = snapshot_download('ZhipuAI/chatglm3-6b')

完成上述准备工作后,即可进入下一阶段——模型加载与推理服务启动。

3.2 模型加载与推理服务启动流程

完成软硬件环境搭建后,下一步是将ChatGLM-6B模型正确加载至内存并实现基本文本生成能力。此过程涉及模型初始化、显存优化、推理逻辑封装等多个关键技术点,直接影响后续服务的响应速度与稳定性。

3.2.1 使用transformers库加载ChatGLM-6B模型

Hugging Face的 transformers 库提供了统一接口来加载各类预训练模型,包括ChatGLM系列。由于ChatGLM采用了特殊的Prefix-LM结构和中文分词机制,需启用特定参数才能正常工作。

完整加载示例代码如下:

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

# 加载分词器与模型

model_path = "/your/local/chatglm3-6b"

tokenizer = AutoTokenizer.from_pretrained(

model_path,

trust_remote_code=True,

use_fast=False # ChatGLM暂不支持fast tokenizer

)

model = AutoModelForCausalLM.from_pretrained(

model_path,

trust_remote_code=True,

device_map="auto", # 自动分布到可用设备

torch_dtype=torch.float16, # 半精度降低显存占用

low_cpu_mem_usage=True # 减少CPU内存峰值

)

model.eval() # 设置为推理模式

逐行解析 :

1. AutoTokenizer.from_pretrained(...) :实例化分词器,负责将输入文本转换为token ID序列。

2. trust_remote_code=True :因ChatGLM未合并入官方库,需允许执行远程代码。

3. use_fast=False :目前ChatGLM的Fast Tokenizer尚未完全支持,禁用以避免错误。

4. AutoModelForCausalLM :表示加载一个因果语言模型,适用于自回归生成任务。

5. device_map="auto" :利用 accelerate 库智能分配模型各层至GPU或CPU,支持多卡并行。

6. torch_dtype=torch.float16 :使用FP16精度,显存占用减半,同时提升推理速度。

7. low_cpu_mem_usage=True :避免在加载过程中占用过多主机内存,适合资源受限环境。

加载成功后,可进行一次简单推理测试:

input_text = "你好,你能帮我写一封邮件吗?"

inputs = tokenizer(input_text, return_tensors="pt").to("cuda")

with torch.no_grad():

outputs = model.generate(

**inputs,

max_new_tokens=100,

do_sample=True,

temperature=0.85,

top_p=0.9

)

response = tokenizer.decode(outputs[0], skip_special_tokens=True)

print(response)

输出结果应为连贯的中文回复,表明模型已正确加载。

3.2.2 应用量化技术降低显存占用(int4/int8)

尽管FP16能将显存需求降至约12GB,但对于消费级显卡仍具挑战。为此,可采用量化技术进一步压缩模型权重,实现更低资源消耗下的推理。

常用方法包括:

- GPTQ (GPU-based Post-training Quantization):支持4-bit权重量化

- BitsAndBytes :支持8-bit和4-bit线性层量化

以 bitsandbytes 为例,安装并启用8-bit量化:

pip install bitsandbytes

修改模型加载方式:

from transformers import BitsAndBytesConfig

quantization_config = BitsAndBytesConfig(

load_in_8bit=True, # 启用8-bit量化

llm_int8_threshold=6.0, # 异常值截断阈值

llm_int8_has_fp16_weight=True # 保留部分FP16权重

)

model = AutoModelForCausalLM.from_pretrained(

model_path,

trust_remote_code=True,

device_map="auto",

quantization_config=quantization_config

)

若追求极致压缩,可尝试4-bit量化:

quantization_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_compute_dtype=torch.float16,

bnb_4bit_use_double_quant=True,

bnb_4bit_quant_type="nf4"

)

量化前后资源对比:

| 精度类型 | 显存占用 | 推理速度(tokens/s) | 质量损失(BLEU下降) |

|---|---|---|---|

| FP16 | ~12GB | 45 | 基准 |

| INT8 | ~8GB | 40 | <2% |

| INT4 | ~6GB | 35 | ~5% |

可见,INT4可在牺牲少量质量的前提下显著降低门槛,使RTX 3060等中端显卡也能运行。

3.2.3 构建基础文本生成接口并测试响应效果

为便于集成,需将模型封装为可调用函数接口。以下是一个通用的生成函数设计:

def generate_response(prompt, history=None, max_length=1024):

if history is None:

history = []

# 格式化对话历史

full_input = ""

for q, a in history:

full_input += f"问:{q}\n答:{a}\n"

full_input += f"问:{prompt}\n答:"

inputs = tokenizer(full_input, return_tensors="pt").to(model.device)

with torch.no_grad():

output_ids = model.generate(

**inputs,

max_new_tokens=512,

num_beams=1,

do_sample=True,

temperature=0.8,

top_p=0.9,

pad_token_id=tokenizer.pad_token_id,

eos_token_id=tokenizer.eos_token_id

)

output = tokenizer.decode(output_ids[0], skip_special_tokens=True)

# 提取最新回答

answer_start = output.rfind("答:") + 2

answer = output[answer_start:].strip()

return answer

参数说明:

- max_new_tokens :控制生成长度上限

- num_beams=1 :禁用束搜索以保持随机性

- temperature :控制输出多样性,过高易产生胡言乱语

- top_p :核采样比例,过滤低概率词汇

测试多轮对话:

history = []

while True:

user_input = input("你:")

if user_input.lower() in ["退出", "exit"]:

break

response = generate_response(user_input, history)

print(f"AI:{response}")

history.append((user_input, response))

该接口已具备基本交互能力,可用于后续Web服务封装。

3.3 Web服务封装与API对外暴露

为了让非技术人员也能方便地使用本地部署的ChatGLM,需将其封装为Web服务并通过API对外提供访问能力。本节介绍两种主流方式:基于FastAPI构建RESTful接口,以及使用Gradio快速生成图形界面。

3.3.1 基于FastAPI或Gradio快速搭建前端交互界面

FastAPI方案(适合生产环境)

FastAPI以其高性能和自动生成文档著称,非常适合构建API服务。

from fastapi import FastAPI, HTTPException

from pydantic import BaseModel

import uvicorn

app = FastAPI(title="ChatGLM Local API", version="1.0")

class QueryRequest(BaseModel):

prompt: str

history: list = []

@app.post("/chat")

async def chat_completion(request: QueryRequest):

try:

response = generate_response(request.prompt, request.history)

return {"response": response}

except Exception as e:

raise HTTPException(status_code=500, detail=str(e))

if __name__ == "__main__":

uvicorn.run(app, host="0.0.0.0", port=8000)

启动后访问 http://localhost:8000/docs 可查看Swagger UI文档,支持在线测试。

Gradio方案(适合演示与原型)

Gradio可在几行代码内生成美观的聊天界面:

import gradio as gr

def chat_interface(user_input, history):

response = generate_response(user_input, history)

history.append((user_input, response))

return "", history

with gr.Blocks() as demo:

gr.Markdown("## ChatGLM 本地对话系统")

chatbot = gr.Chatbot(height=500)

with gr.Row():

msg = gr.Textbox(label="输入消息", placeholder="键入您的问题...")

clear = gr.Button("清空")

msg.submit(chat_interface, [msg, chatbot], [msg, chatbot])

clear.click(lambda: None, None, chatbot, queue=False)

demo.launch(server_name="0.0.0.0", server_port=7860, share=False)

启动后可通过浏览器访问交互页面,支持多轮对话展示。

3.3.2 实现异步请求处理与会话ID绑定逻辑

为支持多用户并发访问,需引入会话管理机制。使用字典存储每个用户的对话历史,并通过UUID标识会话。

import uuid

from typing import Dict

sessions: Dict[str, list] = {}

@app.post("/chat")

async def chat_with_session(request: QueryRequest):

session_id = request.session_id or str(uuid.uuid4())

if session_id not in sessions:

sessions[session_id] = []

response = generate_response(request.prompt, sessions[session_id])

sessions[session_id].append((request.prompt, response))

return {

"response": response,

"session_id": session_id,

"history_length": len(sessions[session_id])

}

扩展 QueryRequest 模型以包含 session_id 字段,即可实现跨请求上下文保持。

3.3.3 跨域访问控制与接口安全性设置

在生产环境中,必须配置CORS策略以防止恶意调用。

from fastapi.middleware.cors import CORSMiddleware

app.add_middleware(

CORSMiddleware,

allow_origins=["https://yourdomain.com"],

allow_credentials=True,

allow_methods=["*"],

allow_headers=["*"],

)

此外,建议增加认证机制:

from fastapi.security import APIKeyHeader

api_key_header = APIKeyHeader(name="X-API-Key")

@app.post("/chat")

async def secured_chat(request: QueryRequest, api_key: str = Depends(api_key_header)):

if api_key != "your-secret-key":

raise HTTPException(status_code=403, detail="Invalid API Key")

...

最终形成一个安全、可扩展、易于维护的本地化ChatGLM服务架构。

4. 基于ChatGLM的行业应用案例开发

随着大语言模型技术的不断成熟,ChatGLM 已从实验室走向实际产业落地。其强大的中文理解能力、开源可部署性以及良好的指令遵循特性,使其在多个垂直领域展现出显著的应用潜力。本章聚焦于三个典型行业的实践路径——智能客服、教育辅导与企业知识管理,深入剖析如何将通用语言模型转化为具备业务语义感知和任务执行能力的专业助手。通过结合微调、检索增强生成(RAG)、权限控制、接口集成等关键技术手段,系统性地展示从需求分析到功能实现的完整开发流程,并提供可复用的技术架构设计与代码示例。

4.1 智能客服系统的定制化实现

智能客服作为人工智能最早渗透的服务场景之一,正经历从规则引擎向深度学习驱动的范式转变。传统IVR或关键词匹配方式难以应对复杂语义表达,而基于ChatGLM构建的智能客服系统能够理解用户意图、维持多轮对话状态并动态生成自然语言回复,大幅提升服务效率与用户体验。该系统的成功实施依赖于三大核心环节:领域知识注入、精准回答机制优化以及多渠道接入能力扩展。

4.1.1 领域知识注入与微调数据集构造

要使ChatGLM适应特定行业(如银行、电商、电信)的客服场景,必须对其进行领域适配训练。最直接有效的方式是 监督微调(Supervised Fine-Tuning, SFT) ,即使用高质量的问答对数据集对预训练模型进行参数调整,使其掌握专业术语、常见问题模式和服务话术风格。

微调数据集的构建需遵循结构化原则,包含以下关键字段:

| 字段名 | 类型 | 描述 |

|---|---|---|

instruction |

string | 用户提问或任务描述 |

input |

string | 可选上下文信息(如订单号、账户类型) |

output |

string | 标准答案或标准响应话术 |

intent |

string | 问题所属意图类别(如“账单查询”、“退换货政策”) |

source_document_id |

string | 对应知识库文档ID,用于溯源 |

例如,在电商平台客服中,一条样本可能如下所示:

{

"instruction": "我的订单还没有发货,怎么回事?",

"input": "订单号:20241015SH10086",

"output": "您好,经查询您的订单已支付成功,目前处于待出库状态,预计24小时内完成发货,请您耐心等待。",

"intent": "物流查询",

"source_document_id": "FAQ_LOGISTICS_003"

}

此类数据可通过历史工单整理、人工标注或结合已有FAQ自动生成。为提升泛化能力,建议对原始问题进行同义改写扩增,使用工具如 nlpcda 进行文本增强。

完成数据准备后,采用Hugging Face Transformers库进行微调。以下是一个典型的训练脚本片段:

from transformers import AutoTokenizer, AutoModelForCausalLM, TrainingArguments, Trainer

import torch

model_name = "THUDM/chatglm3-6b"

tokenizer = AutoTokenizer.from_pretrained(model_name, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(model_name, trust_remote_code=True).cuda()

# 数据编码函数

def tokenize_function(examples):

inputs = [f"问:{q}\n答:" for q in examples["instruction"]]

targets = examples["output"]

full_texts = [i + t for i, t in zip(inputs, targets)]

tokenized = tokenizer(

full_texts,

padding="max_length",

truncation=True,

max_length=512,

return_tensors="pt"

)

return {

"input_ids": tokenized["input_ids"],

"labels": tokenized["input_ids"].clone()

}

# 假设 dataset 是 HuggingFace Dataset 对象

tokenized_datasets = dataset.map(tokenize_function, batched=True)

training_args = TrainingArguments(

output_dir="./chatglm-finetuned-customer-service",

per_device_train_batch_size=2,

gradient_accumulation_steps=8,

learning_rate=1e-5,

num_train_epochs=3,

save_steps=100,

logging_steps=50,

fp16=True,

report_to="none"

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=tokenized_datasets,

tokenizer=tokenizer

)

trainer.train()

代码逻辑逐行解读:

- 第1–4行:加载ChatGLM-3B模型及其分词器,启用

trust_remote_code=True以支持非标准HF模型。 tokenize_function函数中,将输入拼接成“问:xxx\n答:”格式,促使模型学习条件生成模式。- 使用

max_length=512限制序列长度,避免显存溢出;labels设为input_ids副本,表示自回归目标。 - 训练参数设置小批量+梯度累积策略,适用于消费级GPU资源受限环境。

fp16=True启用半精度训练,加快速度并减少内存占用。

微调后的模型可在推理时更准确地输出符合企业规范的回答,同时保留原始模型的语言流畅性和上下文理解能力。

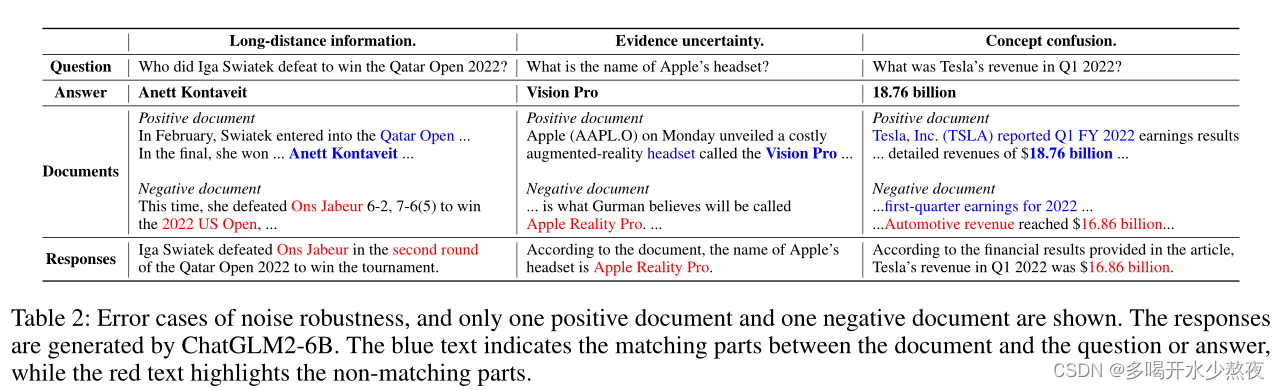

4.1.2 结合检索增强生成(RAG)提升回答准确性

尽管微调能提高模型的知识覆盖范围,但面对频繁更新的产品政策或个性化客户信息时仍存在局限。为此,引入 检索增强生成(Retrieval-Augmented Generation, RAG) 架构成为必要补充。

RAG的基本思想是在生成前先从外部知识库中检索相关信息,将其作为上下文注入提示词中,引导模型生成基于证据的答案。这不仅增强了事实一致性,还降低了幻觉风险。

系统流程如下:

1. 用户提问 → 向量化处理 → 在向量数据库中检索Top-k相关文档;

2. 将检索结果拼接到Prompt中 → 输入ChatGLM生成最终回复;

3. 输出附带引用来源,支持审计与反馈闭环。

常用的向量数据库包括Pinecone、Weaviate、Chroma及本地轻量级方案FAISS。以下是基于LangChain与FAISS的实现示例:

from langchain.embeddings import HuggingFaceEmbeddings

from langchain.vectorstores import FAISS

from langchain.chains import RetrievalQA

from langchain.llms import HuggingFacePipeline

# 初始化嵌入模型

embed_model = HuggingFaceEmbeddings(model_name="sentence-transformers/paraphrase-multilingual-MiniLM-L12-v2")

# 加载知识库文本(假设 docs 是 Document 列表)

db = FAISS.from_documents(docs, embed_model)

# 构建检索器

retriever = db.as_retriever(search_kwargs={"k": 3})

# 包装ChatGLM为LangChain兼容接口

llm = HuggingFacePipeline.from_model_id(

model_id="THUDM/chatglm3-6b",

task="text-generation",

device=0,

model_kwargs={"temperature": 0.7, "max_new_tokens": 256},

)

# 创建RAG链

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=retriever,

return_source_documents=True

)

# 查询示例

query = "会员积分什么时候过期?"

result = qa_chain(query)

print("回答:", result["result"])

print("来源文档:", [doc.metadata for doc in result["source_documents"]])

参数说明与逻辑分析:

paraphrase-multilingual-MiniLM-L12-v2支持多语言语义相似度计算,适合中文为主的客服场景。search_kwargs={"k": 3}表示返回最相关的3个文档片段。chain_type="stuff"表示将所有检索内容拼接后传入LLM,适用于短文本组合。temperature=0.7控制生成多样性,适当开放以保持话术灵活性。max_new_tokens=256防止响应过长影响体验。

该架构的优势在于无需重新训练即可动态更新知识库内容,极大提升了系统的维护效率和响应时效性。

4.1.3 多渠道接入方案(微信/网页/APP)

一个完整的智能客服系统需要支持多种前端触点。ChatGLM服务可通过API网关统一暴露,供不同终端调用。下面分别介绍三种主流接入方式的设计要点。

网页端接入(HTML + JavaScript)

利用WebSocket实现实时交互,前端通过Ajax请求后端FastAPI服务:

async function sendQuery(message) {

const response = await fetch("/api/chat", {

method: "POST",

headers: { "Content-Type": "application/json" },

body: JSON.stringify({ query: message, session_id: getCookie("sid") })

});

const data = await response.json();

displayResponse(data.reply);

}

后端接收并绑定会话ID,维持上下文记忆:

@app.post("/api/chat")

async def chat_endpoint(item: ChatRequest):

history = session_store.get(item.session_id, [])

response, new_history = chat_model.chat(tokenizer, item.query, history=history)

session_store[item.session_id] = new_history[-10:] # 仅保留最近10轮

return {"reply": response}

微信公众号接入

通过微信公众平台开发者模式,配置服务器URL接收XML消息:

<!-- 接收到的消息 -->

<xml>

<ToUserName><![CDATA[toUser]]></ToUserName>

<FromUserName><![CDATA[fromUser]]></FromUserName>

<MsgType><![CDATA[text]]></MsgType>

<Content><![CDATA[你好]]></Content>

</xml>

Python后端解析并调用ChatGLM:

@app.route('/wechat', methods=['POST'])

def wechat_reply():

xml_data = request.data.decode()

msg_type = parse_xml(xml_data, 'MsgType')

content = parse_xml(xml_data, 'Content')

reply_text = chat_model.generate_response(content)

reply_xml = f"""

<xml>

<ToUserName><![CDATA[{parse_xml(xml_data, 'FromUserName')}]]></ToUserName>

<FromUserName><![CDATA[{parse_xml(xml_data, 'ToUserName')}]]></FromUserName>

<CreateTime>{int(time.time())}</CreateTime>

<MsgType><![CDATA[text]]></MsgType>

<Content><![CDATA[{reply_text}]]></Content>

</xml>

"""

return reply_xml

移动App集成

推荐采用gRPC或RESTful API封装模型服务,App通过HTTPS调用获取响应,配合本地缓存机制降低延迟。

各渠道共用同一套核心服务层,确保响应逻辑一致,同时可根据平台特性定制UI呈现方式与交互节奏。

4.2 教育辅导助手的设计与落地

教育领域对个性化、解释性和知识结构化要求极高。基于ChatGLM构建的教育辅导助手不仅能解答学生疑问,还能模拟教师讲解过程,辅助知识点巩固与学习路径规划。其核心挑战在于确保解题过程的可解释性、对接学科题库,并实现因材施教的推荐机制。

4.2.1 学科知识点结构化解析与题库对接

有效的教学辅助始于清晰的知识图谱建设。以中学数学为例,可将课程内容划分为代数、几何、概率统计等一级模块,进一步细分为“一元二次方程求根”、“勾股定理应用”等二级知识点。

每个知识点关联若干典型题目,形成结构化题库:

| 知识点ID | 名称 | 所属科目 | 难度等级 | 示例题目 |

|---|---|---|---|---|

| MATH_ALG_EQ_01 | 一元二次方程求根 | 数学 | ★★☆ | 解方程:x² - 5x + 6 = 0 |

| MATH_GEO_PYT_01 | 勾股定理应用 | 数学 | ★★★ | 已知直角三角形两直角边分别为3cm和4cm,求斜边长度 |

这些数据可通过CSV导入Neo4j等图数据库,建立“知识点→题目”、“先修→后续”等关系网络。

当学生提问“怎么解x² - 5x + 6 = 0?”时,系统首先识别涉及的知识点(MATH_ALG_EQ_01),然后调用ChatGLM生成分步解析:

prompt = """

请以中学数学教师的身份,详细讲解下列题目的解法步骤,要求通俗易懂,每一步说明依据。

题目:解方程 x² - 5x + 6 = 0

解题过程:

response = model.generate(prompt, max_length=512, temperature=0.5)

输出示例:

第一步:观察这是一个标准的一元二次方程,形式为 ax² + bx + c = 0,其中 a = 1, b = -5, c = 6。

第二步:我们可以尝试因式分解法。寻找两个数,它们的乘积等于 c(即6),和等于 b(即-5)。符合条件的是 -2 和 -3。

第三步:因此原方程可以写成 (x - 2)(x - 3) = 0。

第四步:根据零乘积性质,若两个数相乘为0,则至少有一个因子为0。所以 x - 2 = 0 或 x - 3 = 0。

第五步:解得 x = 2 或 x = 3。这就是方程的两个解。

此过程体现了模型对教学逻辑的理解能力,前提是经过针对性微调与提示工程优化。

4.2.2 解题过程可解释性输出控制

为防止模型跳步或使用超纲方法,需通过提示词约束生成行为。设计模板如下:

你是一名经验丰富的[科目]老师,请按以下规则回答学生问题:

1. 使用中文,语气亲切,避免术语堆砌;

2. 分步骤解答,每步不超过一句话;

3. 每步注明所用公式或原理名称;

4. 不直接给出答案,引导思考;

5. 若问题不完整,请反问澄清。

现在请回答:{{question}}

此外,可结合正则表达式或语法树分析对输出进行后处理验证,确保符合教学规范。

4.2.3 学习路径推荐与错题归纳功能集成

系统应记录每次交互日志,包括用户ID、问题内容、知识点标签、是否答对等信息。基于这些数据,构建个性化学习画像。

推荐算法可采用协同过滤或基于知识图谱的路径推导:

def recommend_next_topic(student_id):

mastered = get_mastered_concepts(student_id)

all_concepts = get_all_concepts()

candidates = []

for concept in all_concepts:

if concept not in mastered and all(pre in mastered for pre in concept.prerequisites):

candidates.append(concept)

return sorted(candidates, key=lambda x: x.popularity, reverse=True)[:3]

错题本功能则自动归集错误回答对应的知识点,定期推送复习提醒,形成“提问—反馈—强化”的闭环学习机制。

4.3 企业内部知识问答平台构建

企业在日常运营中积累了大量非结构化文档(制度文件、项目报告、会议纪要),传统搜索方式效率低下。基于ChatGLM构建的企业知识问答平台,可实现语义级检索与自然语言问答,显著提升信息获取效率。

4.3.1 内部文档向量化存储与语义检索引擎集成

文档预处理流程包括:PDF解析 → 文本清洗 → 分块(chunking)→ 向量化 → 存入向量数据库。

from PyPDF2 import PdfReader

from langchain.text_splitter import RecursiveCharacterTextSplitter

def extract_text_from_pdf(pdf_path):

reader = PdfReader(pdf_path)

text = ""

for page in reader.pages:

text += page.extract_text()

return text

text = extract_text_from_pdf("company_policy_v3.pdf")

splitter = RecursiveCharacterTextSplitter(chunk_size=500, chunk_overlap=50)

chunks = splitter.split_text(text)

# 向量化并存入FAISS

embeddings = HuggingFaceEmbeddings(model_name="...")

doc_vectors = embeddings.encode(chunks)

db.add_texts(chunks, metadatas=[{"source": "policy_v3"}]*len(chunks))

用户提问“年假怎么申请?”时,系统检索相关政策段落并生成摘要式回答。

4.3.2 权限分级访问机制与敏感信息脱敏处理

并非所有员工都能访问全部资料。需在检索阶段加入权限过滤:

def secure_retrieve(query, user_dept, user_role):

base_docs = vector_db.similarity_search(query, k=5)

allowed_docs = [

doc for doc in base_docs

if has_access(doc.metadata["access_level"], user_dept, user_role)

]

return allowed_docs

同时对输出中的身份证号、薪资等敏感字段进行正则替换:

import re

def sanitize_output(text):

text = re.sub(r"\d{17}[\dX]", "[身份证已脱敏]", text)

text = re.sub(r"¥\d+\.?\d*", "[金额已脱敏]", text)

return text

4.3.3 用户行为日志收集与模型持续迭代优化

平台应记录每一次查询、点击、满意度评分,用于后续分析:

| 字段 | 说明 |

|---|---|

user_id |

匿名化标识 |

query |

原始问题 |

retrieved_docs |

检索到的文档ID列表 |

generated_answer |

模型生成的回答 |

feedback |

显式评分(1–5星)或隐式行为(停留时间) |

定期使用高价值反馈样本进行增量微调,形成“使用—反馈—优化”的飞轮效应。

综上所述,ChatGLM在各行业的应用并非简单套用,而是需深度融合业务逻辑、数据架构与用户体验设计,才能真正发挥其价值。

5. 性能评估、优化与未来展望

5.1 构建科学的性能评测体系

在部署基于ChatGLM的对话系统后,建立全面、可量化的性能评估体系是确保服务质量的核心前提。该体系应涵盖 生成质量评估 、 服务性能测试 和 安全性验证 三大维度。

自动生成质量指标

常用的自动评估指标包括:

| 指标 | 描述 | 适用场景 |

|---|---|---|

| BLEU | 基于n-gram重叠度的翻译/生成评分 | 多用于文本生成对比 |

| ROUGE | 衡量生成文本与参考文本之间的召回率 | 摘要生成、问答任务 |

| Perplexity | 衡量模型对测试数据的预测不确定性 | 模型训练收敛性判断 |

| METEOR | 考虑同义词和词干匹配的语义相似度 | 更贴近人类语义理解 |

| BERTScore | 利用BERT嵌入计算上下文相似度 | 高级语义一致性评估 |

以ROUGE为例,在Python中可通过 rouge-score 库进行批量评估:

from rouge_score import rouge_scorer

import numpy as np

def evaluate_responses(generated_texts, reference_texts):

scorer = rouge_scorer.RougeScorer(['rouge1', 'rougeL'], use_stemmer=True)

scores = []

for gen, ref in zip(generated_texts, reference_texts):

score = scorer.score(ref, gen)

scores.append({

'rouge1_f': score['rouge1'].fmeasure,

'rougeL_f': score['rougeL'].fmeasure

})

avg_rouge1 = np.mean([s['rouge1_f'] for s in scores])

avg_rougeL = np.mean([s['rougeL_f'] for s in scores])

return {'avg_rouge1': avg_rouge1, 'avg_rougeL': avg_rougeL}

# 示例调用

generated = ["中国的首都是北京", "机器学习是AI的重要分支"]

reference = ["北京是中国的首都", "AI的核心技术之一是机器学习"]

print(evaluate_responses(generated, reference))

执行逻辑说明 :上述代码初始化ROUGE计算器,逐条比较生成与参考文本,并返回F1平均值。适用于批量测试微调前后模型输出质量变化。

此外,还需引入人工评估机制,设计五级Likert量表(流畅性、相关性、信息量、安全性、专业性),由至少3名标注员独立打分,取Krippendorff’s Alpha > 0.7作为信度标准。

5.2 服务性能压力测试与瓶颈分析

对于生产环境中的ChatGLM服务,需重点监测以下性能参数:

| 参数 | 目标值(建议) | 测量工具 |

|---|---|---|

| 平均响应延迟 | < 800ms (P95) | Locust / JMeter |

| 请求吞吐量 | ≥ 50 QPS(int4量化版) | Prometheus + Grafana |

| 显存占用峰值 | ≤ 12GB(ChatGLM-6B-int4) | nvidia-smi |

| 错误率 | < 1% (5xx错误) | ELK日志分析 |

使用Locust编写压力测试脚本示例:

from locust import HttpUser, task, between

import json

class ChatGLMUser(HttpUser):

wait_time = between(1, 3)

@task

def generate_text(self):

payload = {

"prompt": "请解释什么是Transformer架构?",

"history": [],

"max_length": 512,

"temperature": 0.7

}

headers = {"Content-Type": "application/json"}

with self.client.post("/chat", json=payload, headers=headers, catch_response=True) as resp:

if resp.status_code != 200 or "error" in resp.text:

resp.failure("Invalid response")

启动命令:

locust -f stress_test.py --headless -u 100 -r 10 -t 5m --host http://localhost:8000

常见性能瓶颈包括:

- 显存不足导致OOM :可通过 accelerate 库启用device_map=”auto”实现张量并行。

- 长序列推理缓慢 :启用KV缓存(key_value_cache)避免重复计算。

- 高并发下线程阻塞 :采用异步框架如FastAPI配合 async / await 模式提升I/O效率。

通过分析火焰图(Flame Graph)可定位CPU热点函数,例如Hugging Face生成循环中的 _split_inputs_for_generation 调用频次过高,可通过预处理输入结构优化。

5.3 性能优化策略与工程实践

为提升系统整体效能,应实施多层次优化方案。

模型层优化

-

量化压缩 :使用

bitsandbytes实现LLM.int4量化加载python from transformers import BitsAndBytesConfig nf4_config = BitsAndBytesConfig( load_in_4bit=True, bnb_4bit_quant_type="nf4", bnb_4bit_use_double_quant=True, bnb_4bit_compute_dtype=torch.bfloat16 ) model = AutoModelForCausalLM.from_pretrained("THUDM/chatglm3-6b", quantization_config=nf4_config) -

知识蒸馏 :训练轻量学生模型(如ChatGLM2-6B→TinyChat-120M),保留90%以上推理能力。

系统层优化

- Redis缓存历史会话 :设置TTL=30分钟,减少重复推理开销。

- 负载均衡 :Nginx反向代理+多Worker进程部署,结合健康检查自动剔除故障节点。

- 动态批处理(Dynamic Batching) :利用vLLM或Text Generation Inference(TGI)框架实现请求聚合,提升GPU利用率至70%以上。

典型优化效果对比表(测试环境:A10G × 1):

| 方案 | 显存占用 | P95延迟(ms) | 最大QPS |

|---|---|---|---|

| FP16原生 | 14.2GB | 1250 | 23 |

| int4量化 | 9.8GB | 980 | 41 |

| + KV缓存 | 9.8GB | 760 | 52 |

| + vLLM批处理 | 9.8GB | 640 | 89 |

这些优化手段不仅提升了响应速度,也为后续扩展至多模态交互提供了资源冗余空间。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)