OpenCV人脸与人眼检测技术探究

计算机视觉是通过计算机对图像和视频进行处理和分析的一门学科。它利用图像处理、模式识别、深度学习等技术实现对场景中物体的检测、识别与跟踪。关键检测技术是计算机视觉的重要组成部分,它在安全监控、人机交互、自动驾驶等领域中扮演着核心角色。本章将探讨计算机视觉中的一些核心检测技术。OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库,

简介:人脸与人眼检测作为计算机视觉领域的关键技术,在智能监控、人脸识别等场景中起着重要作用。本项目利用OpenCV工具库,实现人脸和人眼的检测,并介绍了相关的检测方法,包括Haar特征级联分类器和HOG特征描述符。文章详细讲述了检测流程,优化策略,以及Dlib库和深度学习模型在人脸与人眼检测中的应用,展望了这些技术在提高准确性和实时性方面的潜力。

1. 计算机视觉中的关键检测技术

概述

计算机视觉是通过计算机对图像和视频进行处理和分析的一门学科。它利用图像处理、模式识别、深度学习等技术实现对场景中物体的检测、识别与跟踪。关键检测技术是计算机视觉的重要组成部分,它在安全监控、人机交互、自动驾驶等领域中扮演着核心角色。本章将探讨计算机视觉中的一些核心检测技术。

关键检测技术的分类

关键检测技术通常可以分为以下几类: - 物体检测(Object Detection) - 特征检测(Feature Detection) - 人脸识别(Face Detection) - 人眼检测(Eye Detection)

物体检测旨在确定图像中物体的位置与类别,而特征检测则识别图像中的显著点,用于后续的图像匹配与分析。人脸识别与人眼检测则更加专注于人的面部特征,分别用于识别整个面孔或分析眼睛的位置与状态。

在随后的章节中,我们将详细探讨这些技术的实现与应用,特别是将深入了解如何使用OpenCV等工具进行人脸和人眼的精确检测。同时,我们还将研究一些更高级的检测模型,如Dlib、MTCNN和SSD,以及它们在实际应用中的表现和优化策略。通过本章的学习,读者将能够掌握计算机视觉的关键检测技术,并为进一步的学习和研究打下坚实的基础。

2. OpenCV在人脸与人眼检测中的应用

2.1 OpenCV基础

2.1.1 OpenCV简介

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库,其设计用于解决计算机视觉中的各种问题。OpenCV拥有超过2500个优化算法,能够处理实时视觉处理、图像处理、物体识别、图形处理和运动分析等任务。该库由C++编写,并且支持Python、Java、MATLAB等多种编程语言接口。

2.1.2 安装与配置OpenCV环境

安装OpenCV可以通过预编译的二进制文件、源码编译或者通过包管理器。以下是在Python环境下通过包管理器pip进行安装的步骤:

- 打开命令行界面。

- 输入以下命令进行安装:

pip install opencv-python

如果是需要使用OpenCV的高级功能,如视频处理、3D重建等,建议安装 opencv-contrib-python 包:

pip install opencv-contrib-python

安装完成后,可以在Python脚本中导入OpenCV库,确认安装成功:

import cv2

print(cv2.__version__)

2.2 OpenCV在人脸检测中的应用

2.2.1 人脸检测的OpenCV函数

OpenCV提供了基于Haar特征的级联分类器来实现人脸检测。主要使用 cv2.CascadeClassifier 类中的 detectMultiScale 方法:

face_cascade = cv2.CascadeClassifier('path/to/haarcascade_frontalface_default.xml')

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

faces = face_cascade.detectMultiScale(gray_image, scaleFactor=1.1, minNeighbors=5)

参数说明: - scaleFactor :图像缩放的比例因子,用于在每次迭代中对图像进行缩放,1.1是一个常用的值。 - minNeighbors :每个候选矩形必须保存的最小邻居数,以保留该候选矩形。5-6是常用的值,增加这个值可以减少检测到的假阳性。

2.2.2 实际应用案例分析

一个简单的应用案例是使用OpenCV的 CascadeClassifier 来检测视频流中的人脸。以下是实现这一功能的步骤:

import cv2

# 初始化分类器

face_cascade = cv2.CascadeClassifier('path/to/haarcascade_frontalface_default.xml')

# 打开摄像头

cap = cv2.VideoCapture(0)

while True:

# 读取视频流中的一帧

ret, frame = cap.read()

if not ret:

print('无法获取视频流')

break

# 转换为灰度图像

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 检测人脸

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5)

# 在检测到的人脸周围画矩形框

for (x, y, w, h) in faces:

cv2.rectangle(frame, (x, y), (x+w, y+h), (255, 0, 0), 2)

# 显示结果

cv2.imshow('Face Detection', frame)

# 按下'q'键退出循环

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放摄像头资源并关闭所有窗口

cap.release()

cv2.destroyAllWindows()

2.3 OpenCV在人眼检测中的应用

2.3.1 人眼检测的OpenCV函数

类似于人脸检测,OpenCV也提供了检测人眼的预训练Haar特征分类器。使用 detectMultiScale 方法来识别图像中的人眼:

eye_cascade = cv2.CascadeClassifier('path/to/haarcascade_eye.xml')

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

eyes = eye_cascade.detectMultiScale(gray_image, scaleFactor=1.1, minNeighbors=3)

参数说明: - scaleFactor 和 minNeighbors 的解释与人脸检测相同。

2.3.2 实际应用案例分析

实际案例中,人眼检测可以与人脸检测结合使用,以提高检测准确性。以下是结合人脸和人眼检测的代码示例:

import cv2

# 初始化人脸和人眼分类器

face_cascade = cv2.CascadeClassifier('path/to/haarcascade_frontalface_default.xml')

eye_cascade = cv2.CascadeClassifier('path/to/haarcascade_eye.xml')

# 打开摄像头

cap = cv2.VideoCapture(0)

while True:

# 读取视频流中的一帧

ret, frame = cap.read()

if not ret:

print('无法获取视频流')

break

# 转换为灰度图像

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 检测人脸

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5)

# 在检测到的人脸周围画矩形框

for (x, y, w, h) in faces:

cv2.rectangle(frame, (x, y), (x+w, y+h), (255, 0, 0), 2)

# 对检测到的人脸区域进行人眼检测

roi_gray = gray[y:y+h, x:x+w]

roi_color = frame[y:y+h, x:x+w]

eyes = eye_cascade.detectMultiScale(roi_gray, scaleFactor=1.1, minNeighbors=3)

# 在检测到的人眼周围画矩形框

for (ex, ey, ew, eh) in eyes:

cv2.rectangle(roi_color, (ex, ey), (ex+ew, ey+eh), (0, 255, 0), 2)

# 显示结果

cv2.imshow('Eye Detection', frame)

# 按下'q'键退出循环

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放摄像头资源并关闭所有窗口

cap.release()

cv2.destroyAllWindows()

这个案例展示了如何在视频流中实时检测人脸以及人脸上的双眼。通过这种方法,可以进一步应用在更复杂的场景中,如疲劳驾驶监测、人机交互等领域。

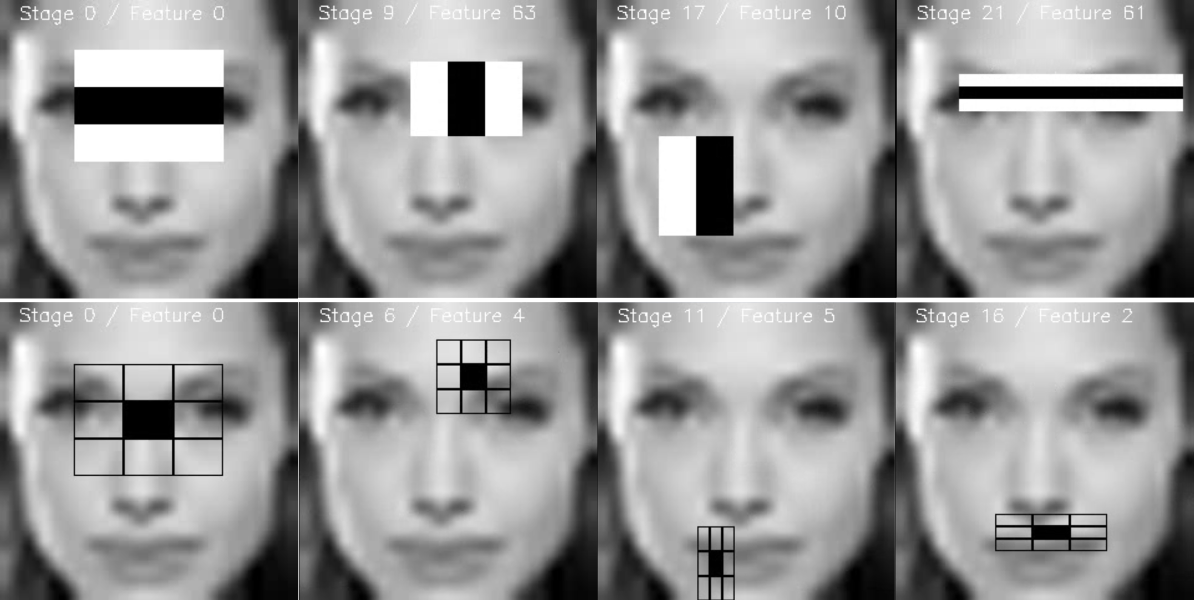

3. Haar特征级联分类器原理与实现

在计算机视觉领域,Haar特征级联分类器是一种被广泛采用的物体检测方法,尤其在人脸和人眼检测任务中表现卓越。本章将深入探讨Haar特征级联分类器的原理,以及如何实现和优化这一强大的工具。

3.1 Haar特征级联分类器原理

3.1.1 Haar特征的定义与提取

Haar特征是一种基于边缘的特征描述符,由Paul Viola和Michael Jones在2001年提出。它通过对图像中相邻矩形区域的像素值进行加减操作来计算得到。这些矩形区域根据不同的尺寸和位置组合,可以形成不同的Haar特征。

Haar特征的提取过程如下:

- 定义一组矩形特征,这些特征由相邻的白色和黑色矩形组成,矩形之间没有重叠。

- 对于图像中的每个矩形区域,计算黑色区域和白色区域像素强度的总和差值。

- 将这些差值作为特征值,生成特征向量。

这种特征提取方式简单高效,但其区分能力有限。因此,需要大量这样的特征来提升分类器的准确性。

3.1.2 级联分类器的工作流程

级联分类器的工作原理是通过一系列的弱分类器来实现高效准确的检测。它基于以下步骤:

- 将大量的Haar特征组合成一个“特征集”。

- 使用AdaBoost算法对特征集中的特征进行筛选和权重分配,从而形成一系列的弱分类器。

- 将这些弱分类器按照一定的顺序级联起来,形成一个强分类器。

- 通过多个强分类器的级联,构成一个级联分类器,实现从粗到细的检测过程。

级联分类器的关键在于它能够在早期阶段排除大量的背景区域,从而大幅减少后续处理的数据量,实现快速准确的物体检测。

3.2 Haar特征级联分类器的实现

3.2.1 训练级联分类器的步骤

训练一个Haar特征级联分类器,主要分为以下步骤:

- 准备正负样本数据集 :收集足够多的包含目标物体(如人脸)的样本图片,以及不包含目标物体的样本图片。

- 提取Haar特征 :从样本数据中提取Haar特征,形成特征集。

- 使用AdaBoost训练弱分类器 :应用AdaBoost算法对特征集进行训练,得到一系列弱分类器及其权重。

- 级联弱分类器 :按照一定规则,将弱分类器级联起来形成强分类器。

- 优化级联结构 :调整级联结构,提高检测速度的同时保持检测精度。

一个常见的实现方式是使用OpenCV库中的 trainCascadeClassifier 函数。

3.2.2 调优与优化级联分类器

为了提升Haar特征级联分类器的性能,可以采取以下优化策略:

- 优化特征选择 :使用更先进的特征选择方法,例如使用机器学习算法来选取更有效的特征。

- 增加训练样本多样性 :引入更多样化的训练样本,以增加分类器对不同情况的适应性。

- 调整参数 :调整级联分类器的参数,比如每层的阈值、阶段数等,可以平衡检测速度和准确率。

- 后处理优化 :对分类器输出的结果进行后处理,如使用非极大值抑制来提升检测精度。

代码示例:

# 这里仅作为展示级联分类器训练的一般步骤,并非真实可执行代码

import cv2

# 加载训练数据

dataPath = 'path_to_dataset/'

положительные_образцы = dataPath + 'positive/'

отрицательные_образцы = dataPath + 'negative/'

# 创建训练数据集

положительные_образцы = 'positive/*.png'

отрицательные_образцы = 'negative/*.png'

образцы_изображений = []

целевые_прямоугольники = []

# 添加正样本数据

for (i, filename) in enumerate(положительные_образцы):

img = cv2.imread(filename, cv2.IMREAD_GRAYSCALE)

целевой_прямоугольник = [0, 0, img.shape[1], img.shape[0]]

образцы_изображений.append(img)

целевые_прямоугольники.append(целевой_прямоугольник)

# 添加负样本数据

count = len(положительные_образцы)

for i in range(count * 3):

образцы_изображений.append(отрицательные_образцы)

целевые_прямоугольники.append([0, 0, 0, 0])

# 训练分类器

# 注意:此处需要实际的函数和正确的参数

classifiers = cv2 CascadeClassifier.train образцы_изображений, целевые_прямоугольники, ...)

上述代码块说明了级联分类器训练的基本步骤,包括准备训练数据、构造训练集、以及调用OpenCV的 CascadeClassifier.train 方法进行训练。实际应用中需要具体的样本数据和相应的参数设置。

接下来,我们可以通过训练好的级联分类器进行实时的人脸检测。

# 加载训练好的分类器

face_cascade = cv2.CascadeClassifier('path_to_cascade_file.xml')

# 实时检测人脸

while True:

img = cv2.imread('path_to_image.jpg')

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

# 在检测到的人脸周围画矩形框

for (x, y, w, h) in faces:

cv2.rectangle(img, (x, y), (x+w, y+h), (255, 0, 0), 2)

cv2.imshow('img', img)

k = cv2.waitKey(30) & 0xff

if k == 27: # 按 'ESC' 键退出

break

cv2.destroyAllWindows()

本章介绍了Haar特征级联分类器的原理与实现细节。通过上述内容,读者应该能够理解Haar特征提取的数学原理、级联分类器的工作流程以及如何使用OpenCV进行级联分类器的训练和优化。这些知识为后续章节中的人眼检测技术打下了坚实的基础。

4. HOG特征描述符在人眼检测中的应用

HOG特征描述符(Histogram of Oriented Gradients)是一种在计算机视觉和图像处理中广泛使用的特征描述符。它用于提取和表达图像中的局部外观信息,已被证明在人眼检测任务中表现出色。本章将深入探讨HOG特征描述符的原理、实现以及在人眼检测中的具体应用。

4.1 HOG特征描述符原理

4.1.1 HOG特征描述符概念解析

HOG特征描述符是一种基于梯度的特征提取方法,能够捕捉到目标物体的形状和纹理信息。它通过对图像局部区域的梯度方向和幅度进行统计,形成一个高维的特征向量。HOG特征描述符的主要优势在于对光照、旋转和局部几何变形保持不变性,这使得它非常适合于人眼检测任务。

HOG特征的提取涉及以下步骤:

- 计算图像中每个像素点的梯度幅值和方向。

- 将图像划分为若干个小的单元格(cells),通常为8x8像素大小。

- 在每个单元格内,计算梯度方向的直方图,使用固定数量的梯度方向(bins),通常为9个方向。

- 将邻近的单元格进行组合,形成较大的块(blocks),并进行归一化处理以增强特征的鲁棒性。

- 将块内所有单元格的特征向量连接起来,形成最终的HOG特征描述符。

4.1.2 HOG特征提取流程

为了更具体地理解HOG特征的提取,我们可以遵循以下步骤:

- 预处理图像,如灰度化和滤波,以减少噪声干扰。

- 应用边缘检测算法(如Sobel算子)获取梯度幅值和方向。

- 初始化HOG特征向量为空,并设置单元格和块的参数。

- 遍历每个单元格,对像素点的梯度进行投票,填充直方图。

- 对每个块内的单元格进行归一化处理,计算块的最终特征向量。

- 将所有块的特征向量串联起来,得到整个图像的HOG特征描述符。

下面是HOG特征提取的Python代码示例:

import cv2

import numpy as np

def compute_hog_features(image):

# 将图像转换为灰度图

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 计算水平和垂直梯度

gx = cv2.Sobel(gray_image, cv2.CV_32F, 1, 0, ksize=1)

gy = cv2.Sobel(gray_image, cv2.CV_32F, 0, 1, ksize=1)

# 计算梯度幅值和方向

magnitude, angle = cv2.cartToPolar(gx, gy)

# 定义单元格大小和块大小

cell_size = (8, 8)

block_size = (2, 2)

block_stride = (1, 1)

cell_stride = (1, 1)

# 计算HOG描述符

hog = cv2.HOGDescriptor(_winSize=(gray_image.shape[1], gray_image.shape[0]),

_blockSize=(cell_size[0] * block_size[0], cell_size[1] * block_size[1]),

_blockStride=cell_size,

_cellSize=cell_size,

_nbins=9)

hog_features = hog.compute(gray_image)

return hog_features

# 读取图像

image = cv2.imread('path_to_image')

# 计算HOG特征

features = compute_hog_features(image)

这段代码首先对图像进行灰度化和梯度计算,然后应用 cv2.HOGDescriptor 计算图像的HOG特征描述符。该函数通过设置窗口大小、块大小、块步长、单元格步长和单元格大小等参数来完成HOG特征的提取。

4.2 HOG特征描述符在人眼检测中的实现

4.2.1 人眼检测的HOG特征实现

在实际的人眼检测中,HOG特征描述符可以作为支持向量机(SVM)分类器的输入特征。SVM是一种有效的二分类器,用于区分人眼和非人眼区域。以下是HOG特征用于人眼检测的实现步骤:

- 从包含人眼的训练图像中提取HOG特征。

- 训练一个SVM分类器,使用提取的HOG特征作为训练数据。

- 对于测试图像,使用相同的方式提取HOG特征。

- 使用训练好的SVM分类器对特征进行分类,预测图像中的区域是否为人眼。

下面是一个使用HOG特征进行人眼检测的代码示例:

from sklearn import svm

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 假设已经提取了训练图像的HOG特征和标签

hog_features_train = [...] # 训练图像的HOG特征列表

labels_train = [...] # 训练图像的人眼标签列表,1表示人眼,0表示非人眼

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(hog_features_train, labels_train, test_size=0.2, random_state=42)

# 训练SVM分类器

clf = svm.SVC(kernel='linear')

clf.fit(X_train, y_train)

# 测试SVM分类器

y_pred = clf.predict(X_test)

print(f"Accuracy: {accuracy_score(y_test, y_pred)}")

在上述代码中, hog_features_train 是训练图像的HOG特征列表,而 labels_train 是对应的标签列表。通过 train_test_split 函数划分训练集和测试集,使用 SVC 类训练线性核的SVM分类器,并计算分类器在测试集上的准确率。

4.2.2 HOG特征描述符性能分析

使用HOG特征描述符的人眼检测方法在不同场景下表现出来的性能需要详细分析。性能分析通常会考虑检测的准确性、速度、鲁棒性等方面。在实际应用中,研究人员和工程师需要权衡这些因素,以达到最佳的检测效果。

为了进行性能分析,我们可以使用不同的评价指标:

- 准确率(Accuracy) :正确检测出人眼与总检测次数的比例。

- 召回率(Recall) :正确检测出人眼的数量与实际人眼数量的比例。

- 精确率(Precision) :正确检测出人眼的数量与检测出的人眼数量的比例。

这些指标可以帮助我们评估HOG特征描述符在人眼检测中的效果。在实际操作中,我们可能会遇到不同的挑战,比如光照变化、人眼遮挡等问题,因此,分析HOG特征在这些情况下的表现是十分必要的。

在性能优化方面,可以考虑使用更先进的梯度计算方法,调整HOG特征提取的参数,或者采用更复杂的分类器来提高检测的准确性。此外,通过增加训练样本和使用数据增强技术可以进一步提升模型的泛化能力。

总结以上内容,HOG特征描述符为计算机视觉领域提供了一种有效的特征提取方式,特别是在人眼检测任务中。通过适当的实现和优化,HOG特征描述符能够提供快速且准确的检测结果,从而在实际应用中发挥重要作用。

5. 人脸检测到人眼检测的流程细节与优化策略

5.1 从人脸检测到人眼检测的流程

5.1.1 流程概述与关键步骤

人脸检测是计算机视觉中一个基础而重要的任务,它是人眼检测的前提。从人脸检测到人眼检测的流程大致可以分为以下几个关键步骤:

- 人脸定位 :首先,使用人脸检测算法(如OpenCV中的Haar级联分类器)确定图像中人脸的大致位置。

- 人脸区域提取 :根据检测到的人脸位置信息,从原图中截取人脸区域。

- 人眼候选区域生成 :在人脸区域上应用人眼检测算法(如HOG特征描述符),生成可能的人眼候选区域。

- 人眼检测与确认 :对候选区域进行分类器验证,排除非人眼区域,确认人眼位置。

在整个流程中,需要考虑到实际应用场景下可能遇到的干扰因素,例如人脸表情变化、光照条件差异、眼镜或帽子遮挡等。

5.1.2 流程中的常见问题及解决策略

-

表情变化 :人脸表情变化会导致人脸特征变形,影响检测准确性。解决策略可以采用鲁棒性强的特征提取方法,例如使用Dlib库中的人脸landmark检测功能辅助定位。

-

光照条件 :光照变化会造成图像亮度和对比度的变化,影响特征提取效果。应对策略包括使用图像增强技术和动态光照适应算法来减少光照影响。

-

遮挡问题 :例如眼镜或帽子可能遮挡人眼,造成检测失效。可以采用半监督学习方法,通过大量带遮挡的数据训练分类器,提高模型的泛化能力。

5.2 多尺度检测的策略与优化

5.2.1 多尺度检测的基本原理

多尺度检测是为了解决目标在不同尺寸大小下检测的需要。在人脸及人眼检测中,由于目标大小的变化范围很大,传统的单一尺度检测方法难以兼顾检测速度和准确性。

多尺度检测的基本原理是在不同的尺度上重复检测过程,通常包括以下步骤:

- 图像金字塔构建 :对原图像进行多尺度的下采样,构建图像金字塔。

- 逐层检测 :在每一层图像上执行检测算法,获取不同尺度下的检测结果。

- 结果合并 :将不同尺度上的检测结果综合考虑,确认最终目标位置。

5.2.2 优化策略与实际效果提升

-

尺度空间选择 :合理设置图像金字塔的层数和每一层的缩放比例可以有效减少计算量,同时保证检测精度。

-

自适应尺度检测 :根据人脸或人眼的实际大小动态选择尺度空间,可以进一步提高检测的准确性和鲁棒性。

-

级联分类器结合多尺度 :在多尺度检测中使用级联分类器可以快速剔除大部分非目标区域,减少后续处理的计算量。

-

GPU加速 :利用GPU并行计算的优势,对多尺度检测算法进行优化,大幅度提升检测速度。

通过采用上述优化策略,多尺度检测不仅可以有效地解决人脸和人眼检测在不同尺度上的挑战,还可以显著提高检测系统的实时性能和准确性。

简介:人脸与人眼检测作为计算机视觉领域的关键技术,在智能监控、人脸识别等场景中起着重要作用。本项目利用OpenCV工具库,实现人脸和人眼的检测,并介绍了相关的检测方法,包括Haar特征级联分类器和HOG特征描述符。文章详细讲述了检测流程,优化策略,以及Dlib库和深度学习模型在人脸与人眼检测中的应用,展望了这些技术在提高准确性和实时性方面的潜力。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)