构建一个基于YOLOv8的人脸表情识别系统,包括UI界面设计、实时摄像头检测、表情识别模型训练以及整体代码实现。

数据集准备:收集人脸表情数据集,如FER2013、RAF-DB等。1.YOLOv8人脸检测:使用YOLOv8进行人脸检测。1.表情识别模型:训练一个表情识别模型(如CNN、ResNet等)。1.UI界面设计:使用PyQt5设计一个简洁的UI界面。1.实时摄像头检测:使用OpenCV进行实时摄像头检测。1.表情识别:结合YOLOv8检测的人脸区域,使用表情识别模型进行表情识别。通过上述步骤,你可以构

如何构建一个基于YOLOv8的人脸表情识别系统,包括UI界面设计、实时摄像头检测、表情识别模型训练以及整体代码实现。

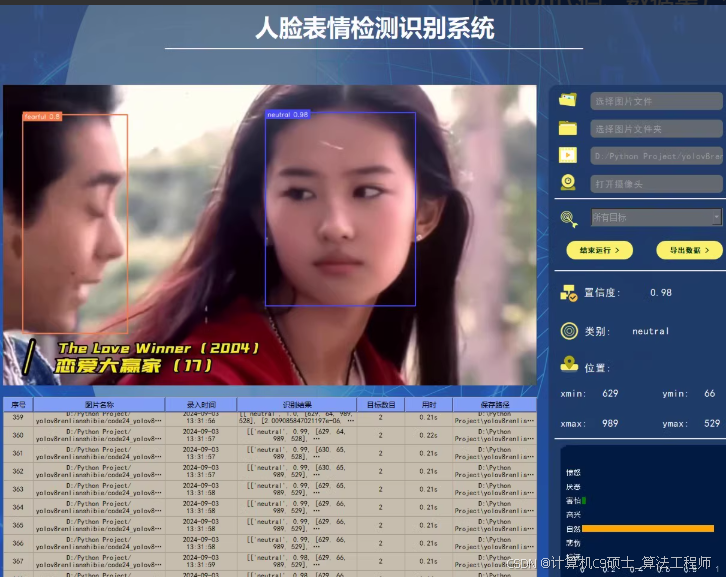

基于深度学习的人脸表情识别系统(含UI界面、yolov8、Python代码、数据集)外接摄像头实时检测识别表情

以官方yolov8为主干,实现对人脸表情的检测识别(OpenCV实现对人脸的检测,训练的分类模型识别对表情的检测),且利用PyQt5设计了简约的系统UI界面。在界面中,您可以选择自己的视频文件、图片文件进行检测。

此外,还可选择添加SE注意力机制的主干模型,您还可以更换自己训练的主干模型,进行自己数据的检测。它具备多目标实时检测,同时可以自由选择感兴趣的检测目标。

好的,让我们详细介绍一下如何构建一个基于YOLOv8的人脸表情识别系统,包括UI界面设计、实时摄像头检测、表情识别模型训练以及整体代码实现。

项目概述

- 数据集准备:收集人脸表情数据集,如FER2013、RAF-DB等。1. YOLOv8人脸检测:使用YOLOv8进行人脸检测。1. 表情识别模型:训练一个表情识别模型(如CNN、ResNet等)。1. UI界面设计:使用PyQt5设计一个简洁的UI界面。1. 实时摄像头检测:使用OpenCV进行实时摄像头检测。1. 表情识别:结合YOLOv8检测的人脸区域,使用表情识别模型进行表情识别。

数据集准备

假设你已经有了一个表情数据集,例如FER2013,数据集结构如下:

fer2013/

├── train/

│ ├── 0/

│ ├── 1/

│ ├── 2/

│ ├── 3/

│ ├── 4/

│ ├── 5/

│ ├── 6/

├── val/

│ ├── 0/

│ ├── 1/

│ ├── 2/

│ ├── 3/

│ ├── 4/

│ ├── 5/

│ ├── 6/

└── test/

├── 0/

├── 1/

├── 2/

├── 3/

├── 4/

├── 5/

├── 6/

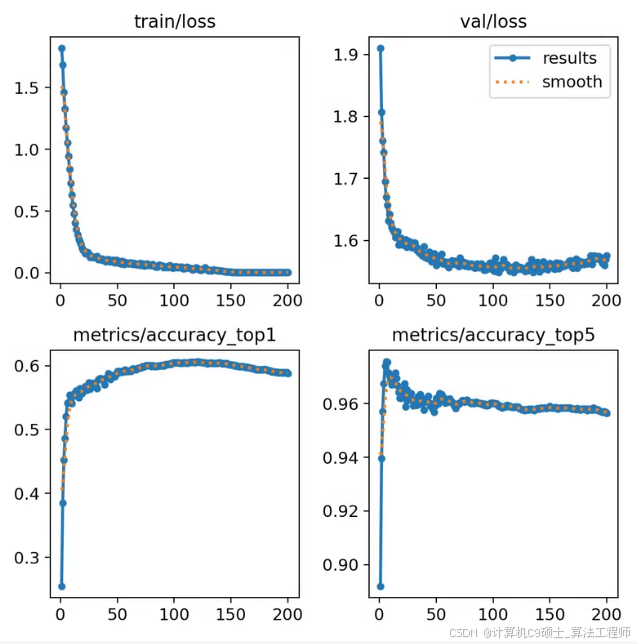

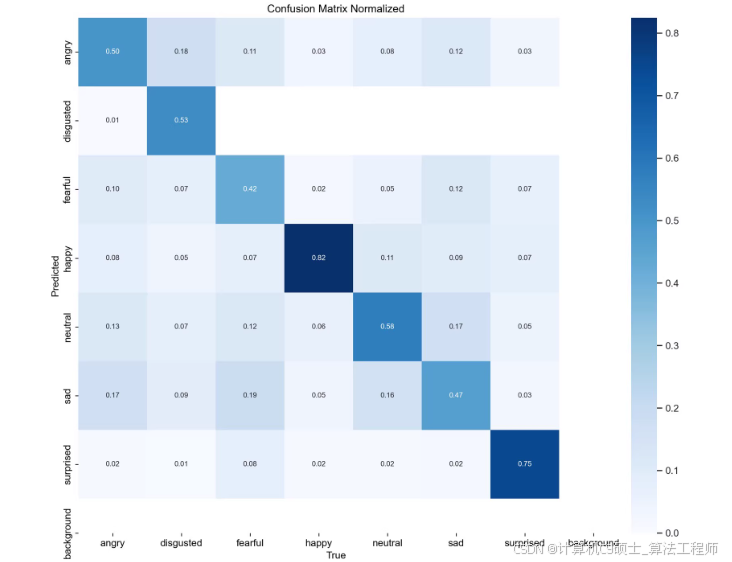

表情识别模型训练

假设你已经训练了一个表情识别模型,并保存了权重文件(例如best.pt)。

UI界面设计

使用PyQt5设计一个简洁的UI界面。

实时摄像头检测

使用OpenCV进行实时摄像头检测,并结合YOLOv8进行人脸检测。

代码实现

1. 安装依赖

pip install ultralytics opencv-python pyqt5

2. 表情识别模型训练(假设已经完成)

假设你已经训练了一个表情识别模型,并保存了权重文件。

3. UI界面设计

import sys

import cv2

import numpy as np

from PyQt5.QtWidgets import QApplication, QMainWindow, QLabel, QPushButton, QVBoxLayout, QWidget, QFileDialog

from PyQt5.QtGui import QImage, QPixmap

from PyQt5.QtCore import QTimer

from ultralytics import YOLO

class MainWindow(QMainWindow):

def __init__(self):

super().__init__()

self.setWindowTitle("Face Expression Recognition")

self.setGeometry(100, 100, 800, 600)

self.central_widget = QWidget(self)

self.setCentralWidget(self.central_widget)

self.layout = QVBoxLayout(self.central_widget)

self.image_label = QLabel(self)

self.layout.addWidget(self.image_label)

self.detect_button = QPushButton("Detect from Camera", self)

self.detect_button.clicked.connect(self.start_camera)

self.layout.addWidget(self.detect_button)

self.file_button = QPushButton("Load Image/Video", self)

self.file_button.clicked.connect(self.load_file)

self.layout.addWidget(self.file_button)

self.yolov8_model = YOLO('yolov8n.pt')

self.cap = None

self.timer = QTimer(self)

self.timer.timeout.connect(self.update_frame)

def start_camera(self):

self.cap = cv2.VideoCapture(0)

self.timer.start(30)

def load_file(self):

file_dialog = QFileDialog()

file_path, _ = file_dialog.getOpenFileName(self, "Open File", "", "Images (*.png *.jpg *.jpeg);;Videos (*.mp4 *.avi)")

if file_path:

self.cap = cv2.VideoCapture(file_path)

self.timer.start(30)

def update_frame(self):

ret, frame = self.cap.read()

if ret:

frame = cv2.cvtColor(frame, cv2.COLOR_BGR2RGB)

results = self.yolov8_model(frame)

for result in results:

boxes = result.boxes

for box in boxes:

x1, y1, x2, y2 = box.xyxy[0].tolist()

cv2.rectangle(frame, (int(x1), int(y1)), (int(x2), int(y2)), (0, 255, 0), 2)

face = frame[int(y1):int(y2), int(x1):int(x2)]

face = cv2.resize(face, (48, 48))

face = face.astype(np.float32) / 255.0

face = np.expand_dims(face, axis=0)

face = np.expand_dims(face, axis=3)

# Assuming you have a pre-trained model for expression recognition

expression = self.expression_model.predict(face)

label = np.argmax(expression)

cv2.putText(frame, str(label), (int(x1), int(y1) - 10), cv2.FONT_HERSHEY_SIMPLEX, 0.9, (0, 255, 0), 2)

qimage = QImage(frame.data, frame.shape[1], frame.shape[0], QImage.Format_RGB888)

pixmap = QPixmap.fromImage(qimage)

self.image_label.setPixmap(pixmap)

def closeEvent(self, event):

if self.cap:

self.cap.release()

self.timer.stop()

event.accept()

if __name__ == "__main__":

app = QApplication(sys.argv)

window = MainWindow()

window.show()

sys.exit(app.exec_())

说明

- UI界面:使用PyQt5设计了一个简单的界面,包含一个图像标签和两个按钮(检测摄像头、加载文件)。1. YOLOv8人脸检测:使用YOLOv8进行人脸检测,并在检测到的人脸区域上绘制矩形框。1. 表情识别:假设你已经训练了一个表情识别模型,并使用该模型对检测到的人脸区域进行表情识别。1. 实时摄像头检测:使用OpenCV进行实时摄像头检测,并在UI界面上显示检测结果。

表情识别模型

假设你已经训练了一个表情识别模型,并保存了权重文件。你需要将模型加载到代码中,并进行表情识别。

from keras.models import load_model

# Load your pre-trained expression model

self.expression_model = load_model('path_to_your_model.h5')

总结

通过上述步骤,你可以构建一个基于YOLOv8的人脸表情识别系统,包括UI界面设计、实时摄像头检测、表情识别模型训练以及整体代码实现。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献33条内容

已为社区贡献33条内容

所有评论(0)