SD-细节控制

【AI绘画精准控制技巧】本教程主要讲解如何解决AI绘画中面部扭曲问题,并精准控制人物姿势。面部修复建议:1)使用F.1类模型;2)设置较大分辨率;3)开启高分辨率修复;4)使用ADetailer插件(含多种面部/手部/服饰检测模型)。姿势控制主要通过ControlNet实现,支持硬边缘、深度图、姿态等多种控制类型。实操时需注意:选择合适预处理模型,调整控制权重(0.7-1),保持参考图与生成图比例

视频教程:2025最新AI绘画系统教程(十三):OpenPose手把手教程!精准控制人物姿势!_哔哩哔哩_bilibili

推荐uu前去观看这个系列的教程。

目录

一、人脸修复

面部扭曲问题常见于在使用基础模型V1.5和XL系列模型生成全身人像时,因为这两种模型适用的出图尺寸较小——512~1024px之间,面部区域内像素量过少,无法生成精致的细节。由于F.1支持一键生成更高清的图片,有更多像素用于生成脸部细节,于是很少出现该状况。

*建议优先使用F.1类模型进行生图。

解决办法

1.设置较大的图片尺寸

将画面分辨率设置为683*1024等较大的尺寸。

2.使用高分辨率修复

开启后能够在生成过程中放大图像,实际上也是通过增加面部区域的像素占比的思路提升出图质量。

3.使用专门的面部插件——ADetailer

该插件对V1.5类的模型很有效。

ADetailer在生图过程中对自动对面部进行重绘修复。

除了对面部细节的修复,该插件同样可以用于准确控制人物面部表情,只需要在ADetailer中的提示词输入框中输入表情描述即可。

各种ADetailer模型的适用范围

| 面部 | 手部 | 身体 | 服饰 | |

|

Mediapipe //适用于写实图像面部修复 |

mediapipe_face_full mediapipe_face_mesh //mediapipe开头 |

- | - | - |

| Yolov8系列 //2D、3D等、卡通、写实等多种风格 |

face_yolov8m face_yolov8n face_yolov8n_v2 face_yolov8s //face开头 |

hand_yolov8n hand_yolov8s |

person_yolov8m_seg person_yolov8n_seg person_yolov8s_seg |

deepfasion2_yolov8s_seg |

在使用ADetailer插件后,可以对角色的表情实现更精准的控制,下图分别使用基本一致的提示词,只是在ADetailer中设置不同的表情提示词得出的结果。uu们也可以基于上述提到的模型针对的风格,对该模型进行使用。

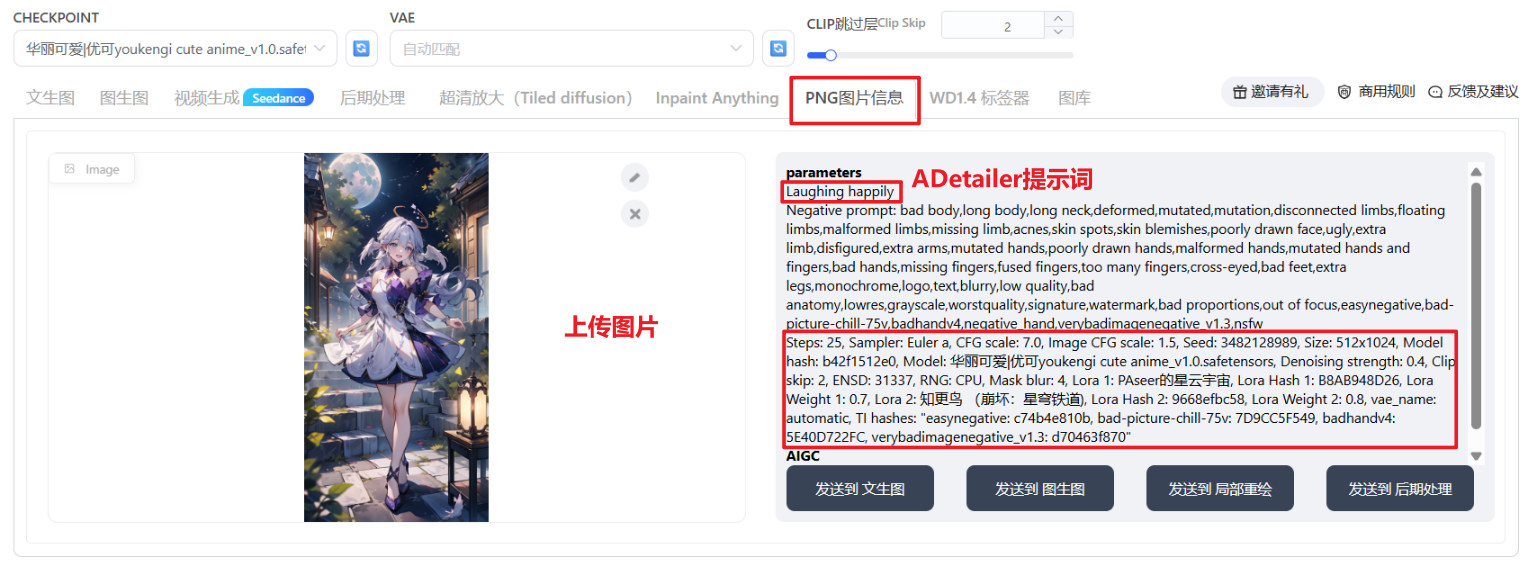

详细参数检测

如果只有图片,没有相关的参数说明,可以利用平台中的"PNG图片信息"功能获得图片相关参数,该方法适用于由WebUI直出的图,如果图片经过二次编辑,该方法就会失效。

二、动作设置

控制类型——ControlNet

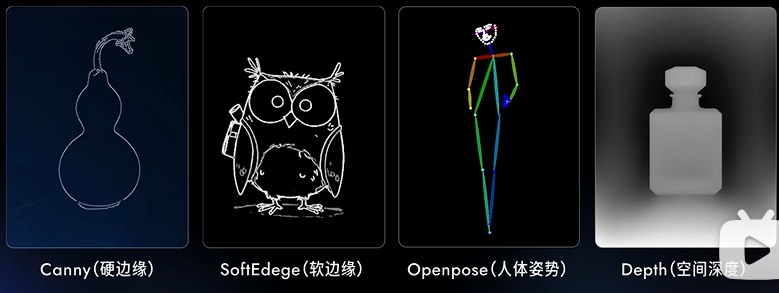

理论补充

需要知道有这些技术,以及在具体使用过程中能够联想到相关技术并对其进行合理运用。

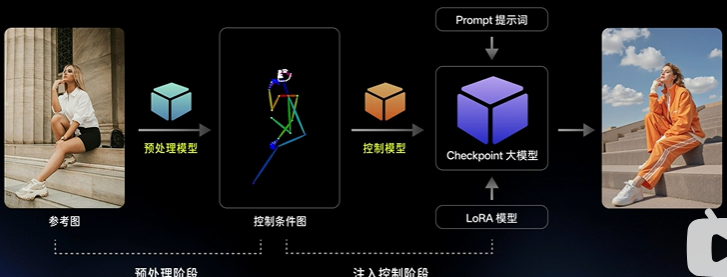

ControNet的具体流程使用为:在预处理阶段通过预处理模型获取参考图片中的姿势,将获取的人物姿势通过控制模型导入Checkpoint大模型,配合提示词以及LoRA模型对生图进行控制,从而得到目标图片。

各种类型的模型支持的控制类型不尽相同, ControlNet只能和相同系列的大模型或者LoRA模型搭配使用。

| 基础算法V1.5 | 基础算法XL | 基础算法F.1 | |

| 控制类型 | Cenny(硬边缘)、Depth(深度图)、open pose(姿态)、Lineart(线稿)、soft edge(软边缘)、MISD(直线)、scribble/sketch(涂鸦/草图)seg(语义分割)tile /blur(分块/模糊)、instructor P2P Reference(参考)、normal正太(法线贴图)、recolor(重上色)、IP-adapter(风格迁移)、T2I adapter Sufle(随机洗牌)、reversion in paint(局部重绘) | Cenny(硬边缘)、Depth(深度图)、open pose(姿态)、Lineart(线稿)、soft edge(软边缘)、MISD(直线)、scribble/sketch(涂鸦/草图)seg(语义分割)、tile /blur(分块/模糊)、normal正太(法线贴图)、recolor(重上色)、IP-adapter(风格迁移)、reversion in paint(局部重绘)、InstantID(换脸) | Cenny(硬边缘)、open pose(姿态)、Depth(深度图)、Lineart(线稿)、soft edge(软边缘)、tile /blur(分块/模糊)、reversion in paint(局部重绘)、normal正太(法线贴图)、IP-adapter(风格迁移)、PuLID(换脸) |

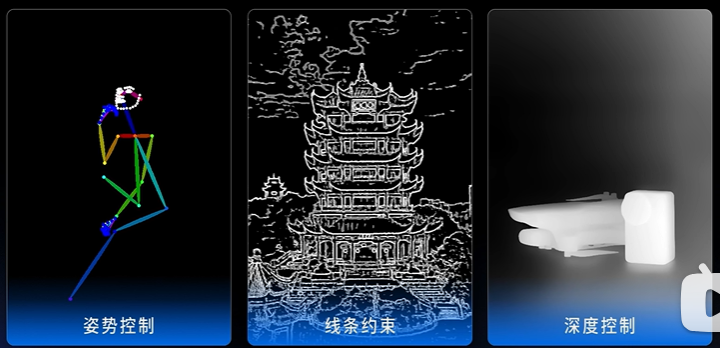

虽然上述提到的控制类型诸多,但是ControlNet中最常用的还是姿势控制,线条约束以及深度控制。

参数说明

预处理模型

根据需求选择合适的预处理器,如仅提取姿态,或仅提取姿态+手部,或提取全部姿态。

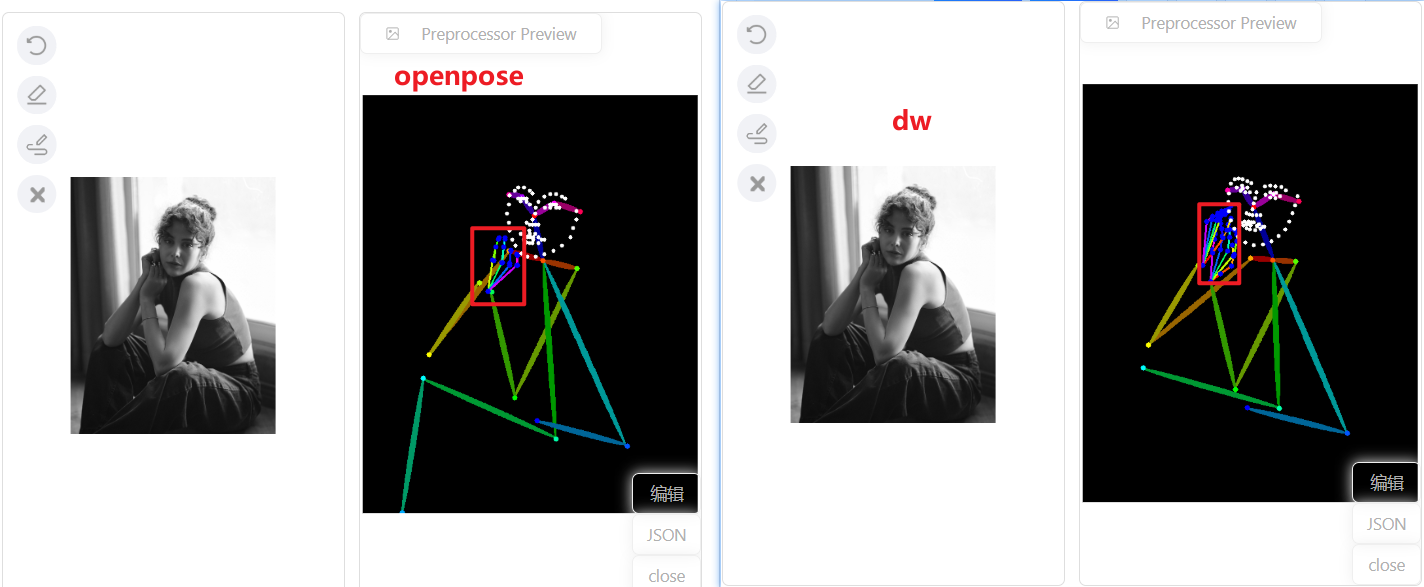

openpose_full姿态+手部+脸部和dw_openpose_full姿态+手部+脸部都能提取脸部、手部 、姿态的全部特征。lz试了一下,dw在细节上确实表现得比openpose变现得更好。

下图为一个例子。具体使用情况uu们可以自行调节查看。

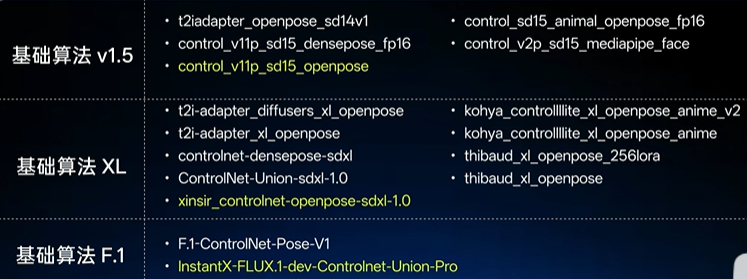

控制模型

不同的模型对应的控制模型,高亮黄色为表现较好的模型。

控制权重

决定了ControlNet对画面控制的权重,数值为0~2,数过低可能导致画面控制效果失效。推荐在0.7~1之间进行尝试,根据实际生成效果进行微调。

起始步数建议设置为0,让ControlNet一开始就接手人物的姿态控制。结束步数可以适当降低,可以在0.6-1之间进行尝试,让底模有一些自由发挥的空间。

使用说明

可以在CtrolNet面板中看到详细的控制生成。

照片/插画都可以作为参考图,但是画面中人物的肢体关系必须明确。肢体不能被严重遮挡。

参考图与生成图画幅比例保持一致。参考图的尺寸最好在512-1280之间。

如果姿势的提取符合目标预期,就可以正常进行生图了。

基于上图提取的姿势生成的图片如下,这个方法的好处在于,省去了我们需要自己撰写姿态提示词的麻烦,更容易实现姿态的复用。

以上end

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)