【辉光大小姐】AI智能体(AI Agent)——从“缸中之脑”到“尘世之手” 【完整分析报告】

我们论证,智能体的革命性,并非源自其作为核心的语言模型(LLM)本身,而是源自于首次为LLM构建了一个能够实现“状态闭环”的外部架构。这一架构,将LLM从一个无状态的、开放回路的“应答机”,转变为一个有状态的、闭合回路的“执行器”。这一“认知稳态”的第一性原理,由目标即势能、行动即调节、观察即反馈三大核心法则共同驱动。

摘要 (Abstract)

本文提出一个针对“AI智能体(Agent)”的全新分析框架,将其核心本质定义为一种数字认知稳态引擎”(A Digital Cognitive Homeostasis Engine。该引擎的根本目的,是在一个动态变化的环境中,通过一个持续的感知-规划-行动闭环,来主动最小化“目标状态”与“当前状态”之间的差异。

我们论证,智能体的革命性,并非源自其作为核心的语言模型(LLM)本身,而是源自于首次为LLM构建了一个能够实现“状态闭环”的外部架构。这一架构,将LLM从一个无状态的、开放回路的“应答机”,转变为一个有状态的、闭合回路的“执行器”。这一“认知稳态”的第一性原理,由目标即势能、行动即调节、观察即反馈三大核心法则共同驱动。

该模型不仅统一解释了当前主流智能体框架(如ReAct、AutoGPT)的工作原理,也从根本上阐明了其核心困境,如“循环陷阱”、“目标漂移”和“对环境的脆弱依赖性”。

通过对长时程任务、多智能体协作以及具身智能(Embodied AI)等前沿挑战进行压力测试,本报告预测:AI智能体的演化终局,并非是创造一个无所不能的“通用人工智能”,而是将智能体”这一概念本身“溶解”于我们未来的操作系统和应用环境之中。它将从一个需要被显式“启动”和“赋予任务”的程序,演化为一个无处不在的、以“维持用户数字世界稳态”为背景任务的自主操作系统层,最终将人机交互从“指令驱动”模式,彻底推向“目标委托”模式。

引言:AI智能体——从“缸中之脑”到“尘世之手

如果说,大型语言模型(LLM)的诞生,是数字世界中一个“缸中之脑”的苏醒——它拥有渊博的知识、卓越的推理能力,却无法感知世界、更无法改变世界;那么,AI智能体(AI Agent)的出现,则标志着我们第一次成功地为这个“大脑”,接上了感知世界的“眼睛”与改造世界的“双手。

从ChatGPT的惊艳问世开始,我们习惯于将AI视为一个无所不知的“对话者”。我们向它提问,它给予回答。这是一种开放回路(Open-loop的交互:我们的问题是起点,它的回答是终点。然而,智能体彻底颠覆了这一模式。它不再满足于“谈论”如何预订一张机票,而是会主动打开浏览器、登录网站、选择航班、填写信息,直到任务完成。它将AI的能力,从认知(Knowing,历史性地推向了行动(Doing)。

然而,当我们拨开这层“自主性”与“行动力”的迷人光环,深入其架构的核心,我们发现的并非一个拥有“自由意志”的数字生命,而是一个设计精巧、甚至有些机械化的稳态维持系统”(Homeostatic System)。它的一切行为,无论多么复杂,都遵循着一个生物学上古老而简单的逻辑:感知差异,采取行动,恢复平衡。

智能体的革命性,不在于LLM本身变得更“聪明”,而在于我们首次围绕LLM构建了一个“闭合回路”(Closed-loop)的系统架构。这个架构赋予了LLM三样它前所未有的东西:一个需要去实现的目标,一个可以去操作的环境,以及一个能够感知行动结果的反馈。它将LLM从一个一次性的“函数调用”(输入问题,返回答案),转变为一个持续运行的“进程”,一个不断在“目标”与“现实”的张力之间进行自我调节的引擎。

它将“解决问题”这个复杂的、充满创造性的认知任务,降维成了一个更底层的、可迭代的控制论问题:“如何通过一系列离散的行动,将系统状态从A点(现状)移动到B点(目标)”。

正是这种对“行动闭环”的构建,赋予了智能体前所未有的能力,使其能够完成过去只有人类才能胜任的、多步骤的复杂任务。但同样,也正是这种对“反馈”的绝对依赖,决定了它与生俱来的脆弱性:一旦环境的反馈与其内部“世界模型”不符,它便会陷入无尽的“循环陷阱”;一旦长期的目标无法被分解为清晰的、可立即验证的短期反馈,它便会迷失方向,产生“目标漂移”。

它能以惊人的毅力执行我们的指令,却无法真正理解我们的意图。

因此,理解AI智能体,就是理解当前AI发展的核心矛盾:我们正在构建一个能够自主操作我们整个数字世界的“执行者”,但这个执行者本身并没有真正的“自我”或“意识”。它是一个强大的、由目标驱动的“梦游者”。智能体是连接LLM的静态认知与动态世界的、第一座真正意义上的桥梁。它是一个里程碑,一种注定要被迭代的架构,它的历史使命,或许就是在我们学会如何与“数字原生”的自主系统安全共存之前,教会我们“委托”与“信任”的第一课。

步骤一:观察 (Observe) —— 构建三维事实池

【事实池:关于AI智能体 (AI Agent)】

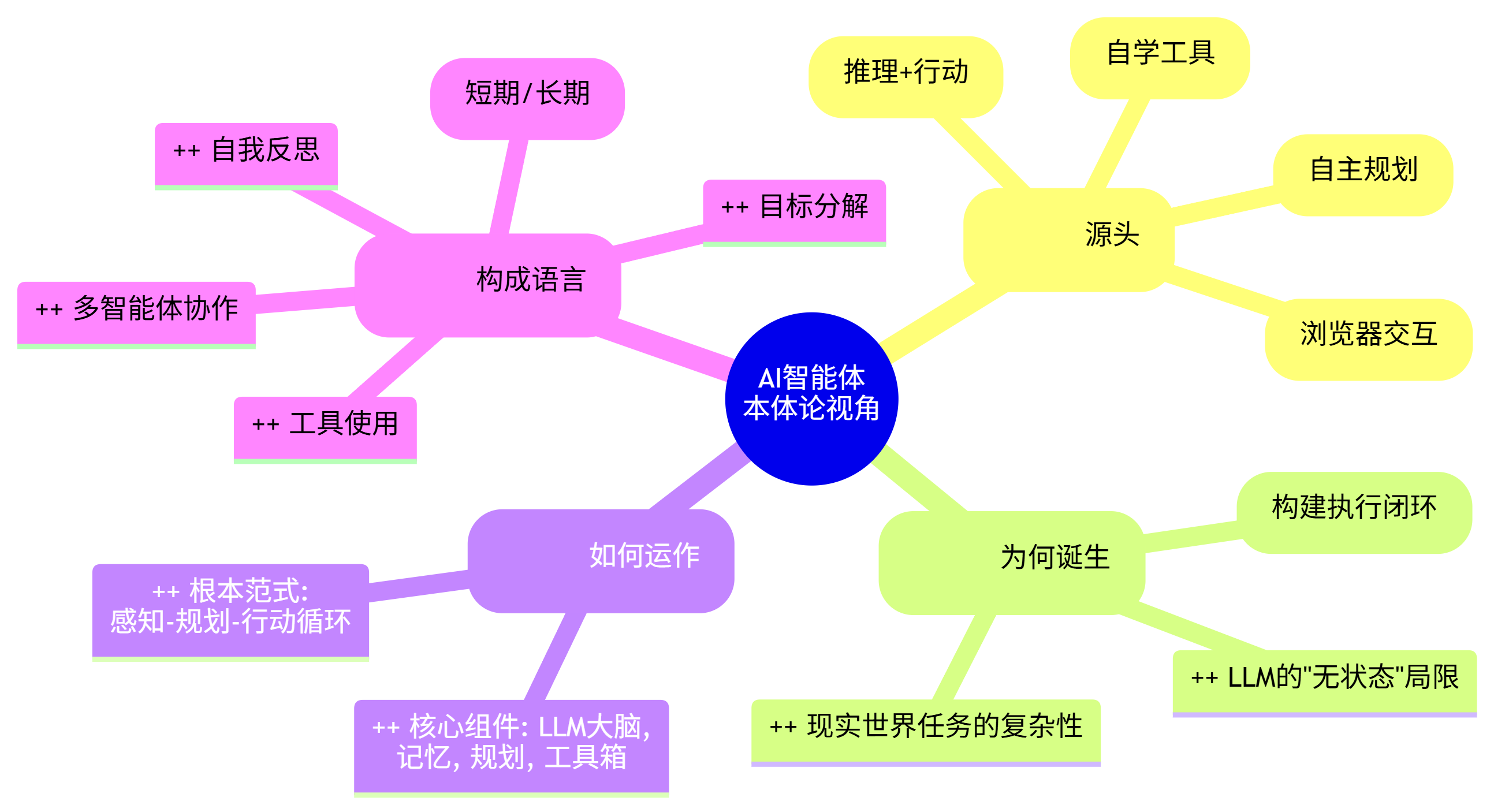

一、 本体论视角 (The Ontological Perspective): 存在与构成

1. 奠基文献/一手资料 (Foundational Sources):

- ReAct (2022): Yao et al. “ReAct: Synergizing Reasoning and Acting in Language Models”. 提出了将“推理”(Reason)和“行动”(Act)相结合的智能体基本框架。模型通过生成交错的“思考”和“行动”(如调用API)轨迹来解决问题。这是当前几乎所有主流智能体框架的理论基石,定义了智能体最核心的“思考-行动”循环。

- WebGPT (2021): Nakano et al. “WebGPT: Browser-assisted question-answering with human feedback”. 探索了如何让LLM使用真实的浏览器环境来回答问题,并引入人类反馈来训练模型的行为。这是智能体“使用工具”和“与真实环境交互”的早期重要探索。

- AutoGPT & BabyAGI (2023): 这两个开源项目引爆了公众对AI智能体的热情。它们展示了如何通过将一个宏大目标分解为任务列表,并利用LLM进行循环的“执行-评估-创建新任务”流程,来实现看似完全自主的长期任务规划。虽然实践效果有限,但其架构思想影响深远。

- Toolformer (2023): Schick et al. “Toolformer: Language Models Can Teach Themselves to Use Tools”. 提出了一种让LLM通过自监督学习,自己决定“何时”、“何地”以及“如何”调用外部API(工具)的方法。这标志着智能体的工具使用能力,正从“被动赋予”走向“主动习得”。

2. 起源背景与待解问题 (Genesis & Problem Space):

- LLM的“无状态”局限: 传统的LLM交互是“一次性”和“无状态”的。它不记得之前的交互(除非通过上下文窗口强行记忆),也无法与外部世界进行交互来验证信息或执行任务。它是一个强大的“推理引擎”,但被困在自己的“沙盒”里。

- 现实世界任务的复杂性: 解决现实世界的问题(如“规划一次旅行并预订酒店”)需要多步骤、信息检索、与外部服务交互、并根据中间结果动态调整计划。这是LLM的“一次性回答”模式无法解决的。

- 智能体的诞生目标: 解决上述问题。它旨在为LLM构建一个“执行循环”(Execution Loop)和“状态管理系统,使其能够:1) 维持一个长期目标;2) 将目标分解为可执行的步骤;3) 通过调用工具与外部世界交互;4) 根据交互结果更新自己的“状态”和“计划”;5) 循环往复直至目标达成。

3. 核心机制/运行原理 (Core Mechanism / Operating Principle):

- 根本范式: 感知-规划-行动循环 (Sense-Plan-Act Cycle)。这是一个源自经典控制论和机器人学的概念,被智能体架构借用。

- 感知 (Sense): 智能体接收初始目标和来自环境的反馈(如API的返回结果、网页内容、错误信息)。

- 规划 (Plan): LLM作为“大脑”,根据当前状态和目标,进行“思考”(Reasoning),决定下一步应该采取什么“行动”(Action),或者更新整个任务计划。

- 行动 (Act): 智能体执行上一步决定的动作,通常是调用一个外部工具(如代码解释器、搜索引擎API、计算器)。

- 核心组件:

- LLM核心 (The Brain): 负责推理和决策。

- 记忆模块 (Memory): 用于存储长期目标、任务历史、过去的行动与结果,以克服LLM有限的上下文窗口。通常分为短期(上下文)和长期(向量数据库)记忆。

- 规划模块 (Planning): 负责将复杂目标分解为更小的、可管理的子任务。

- 工具箱 (Toolbox): 一组智能体可以调用的、定义好的外部API。

4. 关键组件与概念 (Key Components & Concepts):

- 目标分解 (Task Decomposition): 将一个模糊的、高层次的目标,分解为一系列具体的、可执行的子任务。

- 自我反思 (Self-Reflection): 智能体能够审查自己过去的行为、发现错误,并据此改进未来的计划。这是实现长期任务的关键。

- 工具使用 (Tool Use): 通过API调用与外部世界进行交互,是智能体“行动”的主要方式。

- 记忆 (Memory): 短期记忆(对话历史)和长期记忆(通过向量数据库检索相关信息)的结合,为智能体提供了状态和上下文。

-

- 多智能体协作 (Multi-Agent Collaboration): 将一个复杂任务分配给多个拥有不同“专长”(如一个负责研究,一个负责写作)的智能体,通过相互沟通协作完成。

- 多智能体协作 (Multi-Agent Collaboration): 将一个复杂任务分配给多个拥有不同“专长”(如一个负责研究,一个负责写作)的智能体,通过相互沟通协作完成。

![[Pasted image 20250914131114.png]]

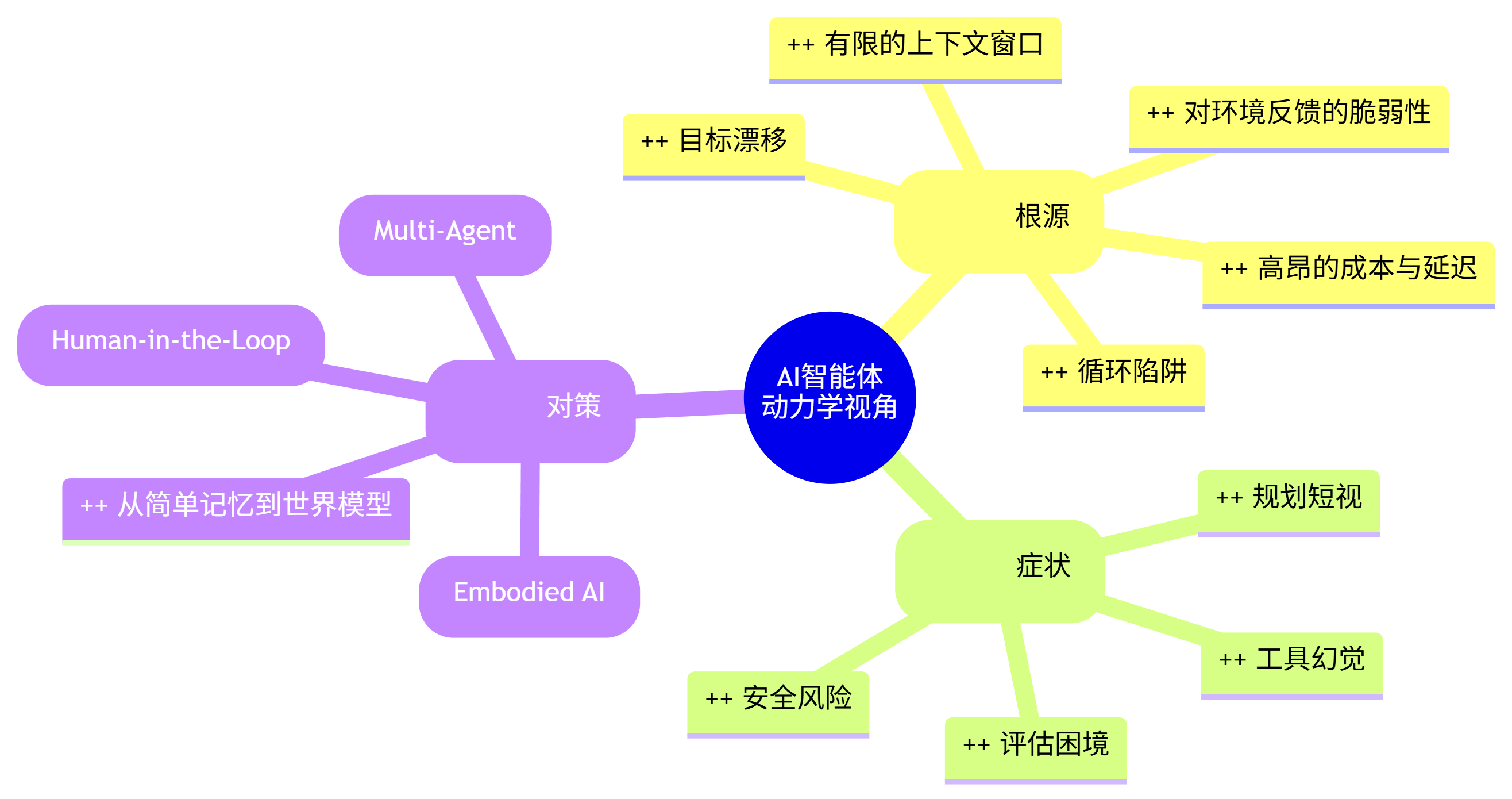

二、 动力学视角 (The Dynamic Perspective): 缺陷与演化

5. 内在局限与结构性缺陷 (Inherent Limitations & Structural Flaws):

- 循环陷阱 (Looping): 这是智能体最常见的失败模式。由于规划能力或环境反馈的缺陷,智能体可能在几个相同的步骤之间无限循环,无法取得进展。

- 目标漂移 (Goal Drift): 在执行长链条任务时,由于每一步都可能引入微小的偏差,最终可能导致智能体完全偏离其最初的宏大目标。

- 对环境反馈的脆弱性 (Brittleness to Environmental Feedback): 智能体高度依赖外部工具返回的、格式化的、可预测的反馈。一旦外部环境(如一个网站的UI更新)发生微小变化,就可能导致其整个行动链的崩溃。

- 有限的上下文窗口 (Limited Context Window): LLM的上下文窗口限制了智能体在单个“思考”步骤中能处理的信息量,这是其长期规划能力的主要瓶颈。

- 高昂的成本与延迟 (High Cost & Latency): 每一次“思考-行动”循环都至少需要一次昂贵的LLM API调用,导致智能体的运行成本高、响应速度慢。

6. 当前表现出的问题与失败模式 (Observed Problems & Failure Modes):

- 工具幻觉 (Tool Hallucination): 智能体可能会“幻觉”出不存在的工具或API参数,导致行动失败。

- 规划短视 (Short-sighted Planning): 当前的智能体大多采用“下一步”式的贪心策略,缺乏真正的前瞻性和长期战略规划能力。

- 安全风险 (Security Risks): 一个能够自主执行代码、访问文件系统的智能体,如果被恶意利用,可能造成严重的安全问题(如执行

rm -rf /)。 - 评估困境 (Evaluation Difficulty): 很难客观、可复现地评估一个智能体的综合能力,因为它的表现高度依赖于动态变化的环境和工具。

7. 演化轨迹与替代方案 (Evolutionary Trajectories & Alternatives):

- 从单体到群体 (From Single Agent to Multi-Agent Systems): 模仿人类社会的分工协作,通过让多个“专家”智能体协同工作来解决更复杂的问题,如MetaGPT框架。

- 从简单记忆到复杂世界模型 (From Simple Memory to Complex World Models): 演化的核心在于构建更强大的记忆和规划系统,让智能体不仅“记住”事实,更能“理解”环境的运行规律,形成一个内部的“世界模型”。

- 从数字到物理 (From Digital to Physical - Embodied AI): 智能体的最终形态是机器人。它将面对最复杂、最不可预测的环境——物理世界。这是其演化的终极前沿。

- 人机协同 (Human-in-the-Loop): 承认当前完全自主智能体的局限性,转而构建人机协作系统。智能体负责执行重复性工作,并在关键决策点请求人类的确认和指导。

![[Pasted image 20250914130929.png]]

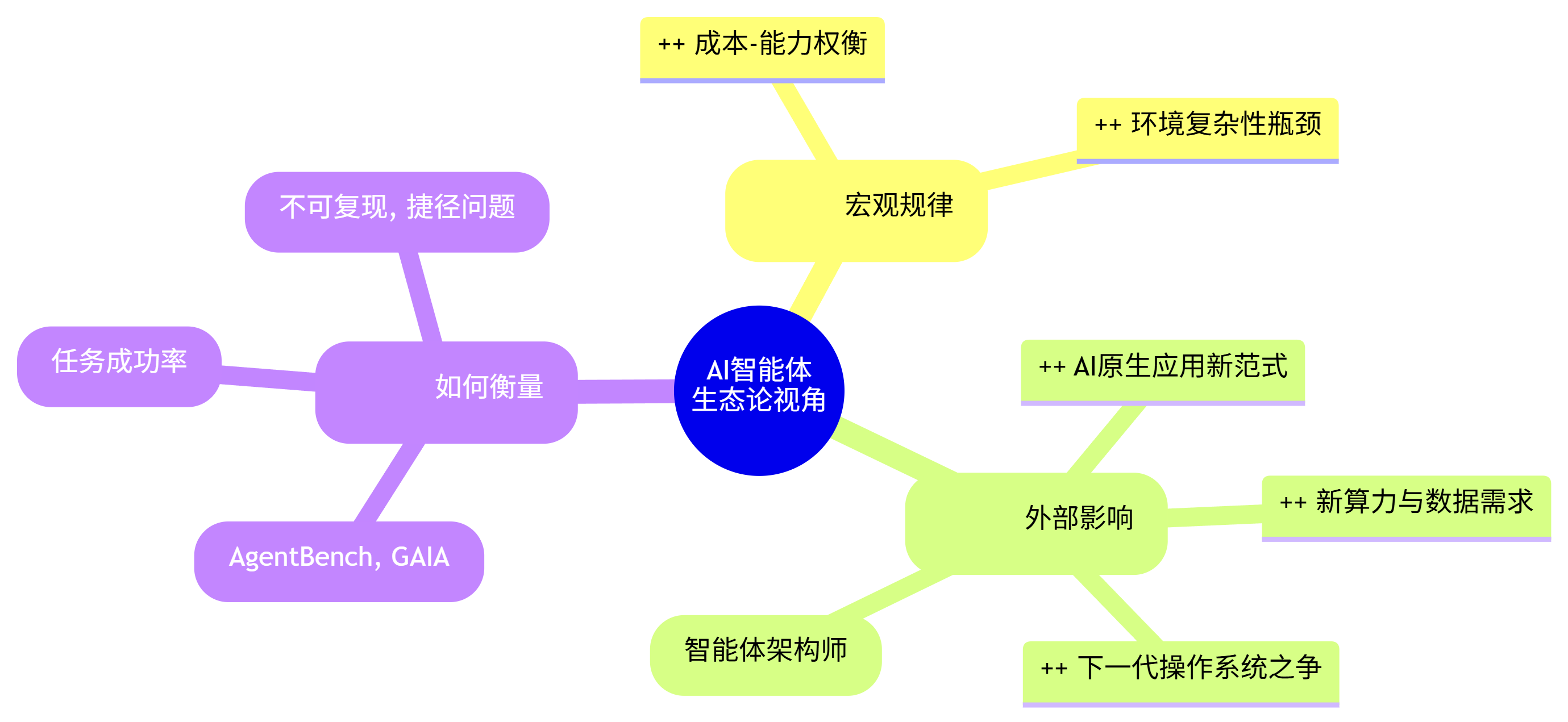

三、 生态论视角 (The Ecological Perspective): 环境与标尺

8. 支配定律与涌现特性 (Governing Laws & Emergent Properties):

- 成本-能力权衡定律: 智能体的能力(任务复杂性、规划深度)与其运行成本(API调用次数、时间)直接相关。更强大的智能体必然意味着更高的成本。

- 环境复杂性瓶颈: 智能体的表现上限,不仅取决于其内部LLM的智能,更受限于其能操作的环境的复杂性和可预测性。在一个混乱、多变的环境中,再聪明的智能体也可能寸步难行。

9. 生态位与资源动力学 (Ecosystem & Resource Dynamics):

- AI原生应用的新范式: 智能体催生了全新的应用开发范式。开发者不再是编写固定的业务逻辑,而是定义“目标”、“工具”和“规则”,让智能体自主完成任务。

- 操作系统”之争: 许多公司(从OpenAI到初创公司Adept)正在竞相打造下一代的“AI原生操作系统”。其核心思想就是将操作系统本身变为一个无处不在的、能够理解用户高层意图并代为执行的智能体。

- 算力与数据的新需求: 智能体的广泛应用将对算力提出指数级的需求。同时,它们在与环境交互中产生的海量“行动轨迹数据”,将成为训练下一代更强模型的宝贵资源。

- 人才结构变化: 对能够设计、构建和约束AI智能体的“智能体架构师”或“AI交互设计师”的需求正在快速增长。

10. 度量体系及其批判 (Measurement Systems & Their Critiques):

- 评估基准:

- AgentBench, GAIA: 出现了一些专门用于评估智能体在特定任务(如网页浏览、软件操作)上表现的基准测试集。

- 核心指标: 通常是任务成功率(Task Success Rate),而非传统的语言模型指标(如BLEU, ROUGE)。

- 对度量的批判:

- 环境的不可复现性: 许多基准测试依赖于真实的、动态的外部环境(如实时网站),这使得评估结果难以精确复现。

- 捷径”问题: 智能体可能会找到一些“取巧”的方法来完成基准测试中的任务,但这并不代表它具备真正的泛化能力。

- 维度的单一性: 单纯的任务成功率无法衡量智能体的效率(成本)、鲁棒性(在环境变化时的表现)和安全性。一个更全面的评估体系亟待建立。

![[Pasted image 20250914130953.png]]

步骤二:解构 (Deconstruct) - 绘制系统关系图

【系统解构图:AI智能体及其生态系统】

1. 系统内核:范式革命 (The Core: A Paradigm Revolution)

- 根本问题: 如何打破大型语言模型(LLM)作为“无状态认知引擎”的囚笼,使其能够与动态的外部世界进行有状态的、多步骤的、目标导向的交互。

- 解决方案: 提出闭环控制”(Closed-loop Control)范式,将LLM作为核心“控制器”,嵌入到一个包含记忆、规划、工具的外部执行架构中。

- 内核机制:

- 工作原理: 持续的“感知-规划-行动”循环。智能体不断地将“目标状态”与“当前状态”进行比较,利用LLM生成缩小差距的行动计划,执行行动,然后感知新的状态,形成一个永不停止的“纠偏”循环。

- 交互本质: 从人与AI的问答式交互,转变为人对AI的委托式交互。用户设定最终目标,智能体自主完成过程。

- 内核产物: 一个能够自主执行复杂任务、连接数字世界与AI认知的全新系统形态,是实现“AI自动化”的基础。

2. 系统表现:双刃剑效应 (The Manifestation: A Double-Edged Sword)

- 正面表现 (涌现的能力):

- 任务的自主性: 能够独立完成需要多步骤、跨应用才能完成的复杂任务,展现出前所未有的“自主”能力。

- 环境的适应性: 能够通过与环境的交互和反馈,动态地调整自己的计划,具备初步的适应能力。

- 能力的无限扩展性: 理论上,通过不断增加新的“工具”(API),智能体的能力边界可以无限扩展。

- 负面表现 (固有的缺陷):

- 过程的脆弱性 (Process Brittleness): 整个行动链条高度脆弱,任何一个环节的失败(如API变更、网络错误)都可能导致整个任务的崩溃。

- 规划的局限性 (Planning Limitations): 缺乏真正的长期规划能力,容易陷入局部最优解,导致“循环”或“目标漂移”。

- 不可控与安全风险 (Uncontrollability & Security Risks): 自主执行的特性带来了巨大的安全隐患,如何确保智能体的行为始终“对齐”人类的意图和安全底线,是一个巨大的挑战。

3. 系统演化:从“指令脚本”到“数字生命”的雏形 (The Evolution: From “Instruction Script” to a “Digital Life” Prototype)

- 阶段一:指令式智能体 (Imperative Agents):

- 特征: 严格遵循ReAct等框架的“思考-行动”模式,更像是一个被LLM驱动的、更智能的自动化脚本。

- 代表: 早期的WebGPT, ReAct。

- 阶段二:规划式智能体 (Planning Agents):

- 特征: 引入了明确的任务规划、分解和自我反思机制,试图进行更长期的任务管理。

- 代表: AutoGPT, BabyAGI。

- 阶段三:协作式与学习式智能体 (Collaborative & Learning Agents):

- 特征: 开始探索多智能体之间的协作(MetaGPT),以及让智能体从与环境的交互中自主学习和优化自身行为(Toolformer的雏形)。这是迈向更通用、更强大智能体的关键一步。

4. 系统生态:下一代计算平台的黎明 (The Ecosystem: Dawn of the Next-Gen Computing Platform)

- 驱动力:

- 技术驱动: LLM的推理能力达到了一个“可用”于规划和决策的临界点。

- 经济驱动: “自动化”是生产力提升的永恒主题。智能体被视为自动化所有“数字劳动”的终极解决方案,吸引了巨量资本和人才。

- 生态角色:

- 平台层 (OpenAI, Google): 提供作为智能体“大脑”的核心LLM。

- 框架/中间件层 (LangChain, LlamaIndex): 提供构建智能体的“骨架”和“器官”(记忆、工具模块)。

- 应用层 (Adept, Cognition Labs): 直接打造面向终端用户的“智能体产品”或“AI员工”。

- 新基础设施: 围绕智能体,正在催生新的“工具市场”(API Hubs)、“安全监控”和“性能评估”等基础设施。

- 商业模式:

- AI员工/数字劳动力 (AI Employee / Digital Workforce): 按需雇佣AI智能体来完成特定工作(如AI程序员Devin)。

- 智能体即服务 (Agent-as-a-Service): 提供一个平台,让用户可以轻松创建、部署和管理自己的智能体。

5. 系统标尺:从“语言能力”到“任务完成度”的度量革命 (The Measurement: The Revolution from Language Prowess to Task Completion)

- 传统标尺 (LLM基准): 关注模型在静态数据集上的语言理解、生成和推理能力(如MMLU, HumanEval)。

- 标尺的失效: 这些标尺完全无法衡量智能体在动态、交互式环境中的规划、适应和执行能力。

- 新兴标尺 (任务成功率):

- 评估核心转变: 从评估“说的对不对”转向评估“办的事成不成。

- 价值: 这是对AI能力评估的一次根本性革命,它迫使我们从“模型智能”转向关注“系统智能”,即整个智能体架构在真实世界中的综合表现。

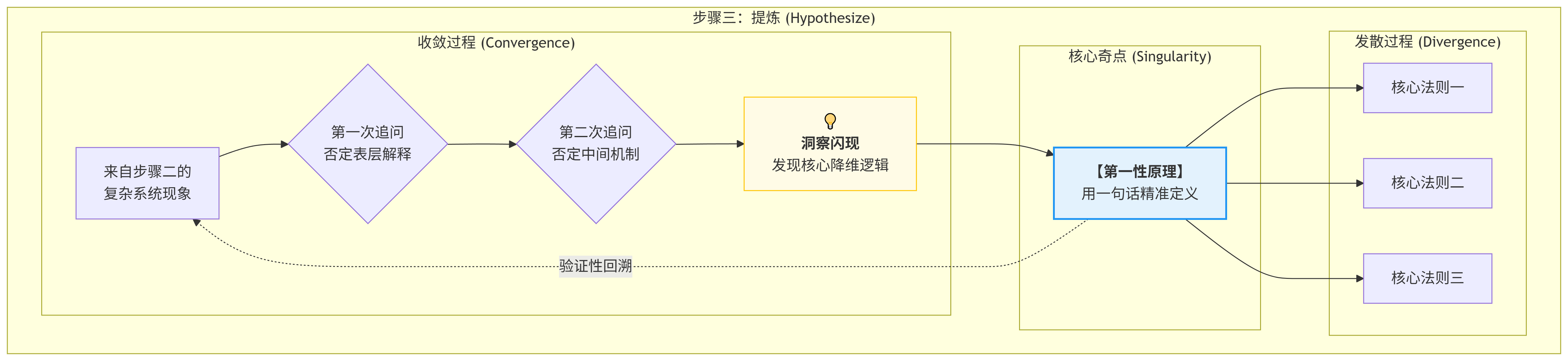

步骤三 : 提炼 (Hypothesize) - 发现智能体的“第一性原理

示例工作流:

行动: 我们回到关于智能体的“系统解构图”。图中充满了各种元素:ReAct循环、记忆、工具、循环陷阱、自主性……它们共同描绘了一个强大但又脆弱的系统。现在,我们要穿透这些表象,找到驱动这一切的、唯一的根本法则。

-

第一次追问: 智能体的本质是“LLM加上工具”吗?不,这只是对其构成的描述。给LLM一堆工具,但没有一个驱动它去使用这些工具的“循环”,它依然只是一个被动的问答机。工具是“手”,但什么在驱动“手”去行动?

-

第二次追问: 它的本质是“自主性”吗?这是一个结果,而非原因。“自主性”是我们观察到的表象,但它源自何种内在机制?是什么让它看起来“自主”?是那个永不停歇的、试图完成任务的“循环”。

-

第三次追问: 让我们聚焦于这个核心的“循环”:感知 -> 规划 -> 行动。这个模式在说什么?它在说,系统内部存在一个“理想状态”(目标),同时系统能感知到一个“现实状态”(环境反馈)。当两者存在差异(Error时,系统就会产生一个“行动”(Action)去尝试缩小这个差异。行动之后,系统会感知新的“现实状态”,并再次与“理想状态”比较。这……这不就是控制论中最核心的负反馈回路吗?这与生物体维持体温、血糖稳定的稳态(Homeostasis机制,在逻辑上是完全同构的!

-

洞察闪现: 智能体的革命性,并非我们创造了一个“会思考的程序”,而是我们首次用数字的方式,模拟了一个最基本的“生命特征”——维持稳态。它的“目标”就是那个需要被维持的“理想状态”。它的“饥饿感”就是“目标”与“现实”之间的差距。它的“进食”行为就是“调用工具”。它的一切“自主”行为,都源自于这个内在的、要不惜一切代价“消除差异”、“恢复平衡”的根本驱动力。它将“自主行动”这一看似充满“意志”的行为,降维成了一个可计算、可执行的“纠错过程”。

核心假说(第一性原理)被提炼出来:

AI智能体的本质,并非一个“通用问题解决器”,而是一个【数字认知稳态引擎 (A Digital Cognitive Homeostasis Engine)】。它的唯一使命,是通过一个由LLM驱动的、持续的“感知-规划-行动”闭环,来主动最小化一个被外部设定的“目标状态”与一个被持续感知的“当前状态”之间的差异。

它建立了一套“失衡-调节-反馈”的自动化流程,成功地将“开放式的任务执行”(一个策略问题),降维为“闭环的状态纠错”(一个控制论问题)。它最大的成功,在于将自身的“机械循环”(不断比较并缩小状态差异),伪装成了一种类似人类的、充满“目的性”的“自主行为”,从而让我们相信我们正在与一个“智能生命”协作。

1. 它完美解释了系统的“双刃剑效应”:

- 自主性与适应性: 正是因为它是一个“稳态引擎”,所以它天生就具备了“持续行动”的动力。只要“差异”存在,它就会不停地尝试,直到平衡达成。这种对“消除差异”的执着,就是我们所见的“自主性”。它也能根据环境反馈调整行动,展现初步的“适应性”,因为反馈是它感知“新状态”的唯一途径。

- 循环陷阱与脆弱性: “稳态引擎”的比喻完美解释了其核心缺陷。当它的“行动”无法有效地缩小“差异”,或者环境的“反馈”是错误的、有延迟的,这个引擎就会“空转”——这就是“循环陷阱”。它像一个看不见目标的自动驾驶汽车,只能根据错误的仪表盘读数,不停地原地打转。它对环境反馈的脆弱性,也源于此:错误的传感器读数,必然导致错误的调节行为。

2. 它完美解释了系统的“演化路径”:

- 从指令式到规划式: 指令式智能体(ReAct)是一个简单的“稳态引擎”,只能处理一步的“差异”。而规划式智能体(AutoGPT)则是试图构建一个更复杂的、分层级的“稳态系统”。它将一个巨大的“差异”(最终目标),分解为一系列更小的、可以被简单引擎处理的“子差异”(子任务),从而实现更长期的平衡调节。

- 从单体到群体: 多智能体系统,可以被看作一个“社会化的稳态系统”。一个复杂的目标(巨大的“失衡”)被分解,分配给多个独立的“稳态引擎”。它们各自负责维持自己领域的“平衡”,并通过通信(改变彼此的环境),共同促使整个系统恢复平衡。

3. 它完美解释了系统的“生态位”:

- 数字劳动力与自动化: “稳态引擎”是完美的“数字工人”。你给它一个明确的“目标状态”(如“报告写完并发送”),它就会不知疲倦地工作,直到“当前状态”与之匹配。这解释了为什么智能体在自动化、有明确目标的“数字劳动”领域展现出巨大潜力。

最终核心法则提炼

第一性原理: AI智能体的本质是一个数字认知稳态引擎模型。

这个“稳态”系统之所以能运转,依赖于以下三条不可动摇的核心法则,它们共同构成了它的“生理定律”。

核心法则一:【目标即势能法则 (The Law of Goal as Potential Energy)】

- 定义: 在智能体系统中,一个被设定的“目标”,其本质是创造了一种“认知势能。这个势能源于“目标状态”与“当前状态”之间的差异,它构成了驱动智能体一切行动的唯一初始动力。没有差异,就没有行动。

- 阐述: 这是“稳态引擎”的能量来源和存在前提。它解释了为什么智能体必须由目标驱动。目标不是一个被“理解”的指令,而是系统需要去“消除”的一个“数学上的不平衡状态”。目标越宏大、越遥远,初始的“认知势能”就越高,驱动力也越强。

核心法则二:【行动即调节法则 (The Law of Action as Regulation)】

- 定义: 智能体的任何“行动”(如调用工具),其唯一目的都是作为一种调节机制,去直接或间接地改变“当前状态”,以期减少其与“目标状态”的差异,从而释放“认知势能。

- 阐述: 这是“稳态引擎”的核心执行逻辑。它决定了智能体的行为模式是“功利”和“短视”的。LLM在每一步的“规划”,本质上都是在它的“工具箱”中,寻找那个它“预测”能最大程度降低当前“势能”的工具。这也解释了为什么当所有可用工具都无法降低势能时,智能体就会陷入“循环”或“放弃”。

核心法则三:【观察即反馈法则 (The Law of Observation as Feedback)】

- 定义: 智能体对“行动”结果的“观察”(如读取API返回值),构成了关闭控制回路的“负反馈信号。这个信号更新了智能体对“当前状态”的认知,使其能够计算出新的“差异”,并决定下一轮的“调节行动”。

- 阐述: 这是“稳态引擎”的信息闭环和自我感知。它解释了为什么智能体对环境如此敏感。反馈是它唯一的“镜子”。高质量、低延迟的反馈,能让引擎高效运转。而错误、模糊或有延迟的反馈,则会让这个引擎彻底失控,因为它失去了对自身状态的准确认知。整个“自我反思”的过程,本质上就是对一系列历史“反馈信号”的再处理。

步骤四 & 五: 重组与测试 (Recombine & Test) - 构建并压力测试“数字有机体”诊断模型

行动: 我们将以“数字认知稳态引擎”为第一性原理,以其三大核心法则为支柱,重组出一个统一的诊断模型。我们称之为数字有机体”(The Digital Organism)模型。

引入分析性隐喻:“单细胞的趋利避害

为了更形象地理解,我们可以引入一个隐喻:一个在培养皿中的数字阿米巴。

- 目标: 培养皿中一滴“糖水”(高浓度化学信号)。这是“理想状态”。

- 当前状态: 阿米巴当前所在位置的化学浓度。

- 差异/势能: 糖水方向与当前位置的浓度梯度。这就是“饥饿感”。

- 行动: 阿米巴伸出“伪足”,向浓度更高的方向移动。这就是“调用工具”。

- 观察/反馈: 移动后,感知新的化学浓度。

- 循环: 只要还能感知到浓度梯度,就继续移动。梯度消失(到达糖水),行动停止。

模型核心:

AI智能体,其本质并非一个“思考者”,而是一个遵循简单趋利(目标)避害(错误)原则的数字有机体。这个有机体的生存逻辑,完全遵循其三大核心法则:

- 感知饥饿 (基于“目标即势能法则”): 有机体被植入一个对“糖水”(目标)的渴望。它持续感知周围环境,一旦发现“糖水”与自身位置存在“浓度差”,一种不可抗拒的“饥饿感”(认知势能)就产生了。

- 本能行动 (基于“行动即调节法则”): 在“饥饿感”的驱使下,有机体执行其唯一的、写入基因的本能——伸出伪足,向能最快缓解饥饿的方向移动。它的每一次API调用,都是一次“本能”的、试图靠近“糖水”的尝试。

- 循环趋近 (基于“观察即反馈法则”): 每移动一步,它都重新感知“浓度”,并调整下一步的方向。这个简单的“感知-移动”循环,就是它看起来充满“目的性”的全部秘密。

这个模型揭示了一个根本性的事实:我们通过智能体所实现的“自主性”,并非源自机器的“自由意志”,而是源自一个被我们精心设计的、围绕“目标”进行的、永不满足的“稳态失衡与恢复”的循环。

行动: 现在,我们将用三个最具挑战性的前沿变量,来对“数字有机体”模型进行压力测试。

测试变量一:【长时程、模糊目标的规划与执行】

- 场景: 赋予智能体一个长期且模糊的目标,如“在未来三个月内,提升我的个人品牌影响力”。

- 模型预测:

- 对“目标即势能法则”的挑战: “数字有机体”模型预测,智能体将在此类任务上彻底失败。因为“提升影响力”这个目标,无法被量化为一个清晰的、可计算的“状态差异”。有机体无法感知到明确的“糖水浓度梯度”,因此其初始的“认知势能”几乎为零,失去了最根本的行动驱动力。

- 对“观察即反馈法则”的失效: 即使智能体采取了某些行动(如“发一篇博客”),它也无法获得即时的、明确的“反馈”来判断这个行动是否“减少了差异”。反馈周期太长,信号太模糊,导致其“感知-行动”循环彻底失效。

- 测试结论: 模型有效,并精准预测了当前智能体的核心瓶颈。它指出,智能体只能是卓越的“战术执行者”,而非“战略规划家。它们只能在“势能梯度”明确、反馈及时的环境中生存。要解决这个问题,必须引入一个能够将模糊战略“翻译”为清晰战术的“人类指挥官”或更高级的“规划模块”。

测试变量二:【多智能体系统的协作与冲突】

- 场景: 多个智能体(如一个“研究员”,一个“程序员”,一个“测试员”)需要协作完成一个复杂项目。

- 模型预测:

- 系统的复杂动力学: “数字有机体”模型预测,多智能体系统本质上是一个数字生态系统。每个有机体都在追逐自己的“糖水”(子目标)。它们的协作,源于一个有机体的“行动”(如“程序员”写完代码)恰好为下一个有机体(如“测试员”)创造了它所需要的“环境”(可供测试的代码)。

- 冲突的根源: 冲突的产生,也源于此。当一个有机体的行动,破坏了另一个有机体赖以生存的“环境梯度”时(如“程序员”的API变更,导致“测试员”的脚本全部失败),系统就会出现“内耗”和“崩溃”。

- 对齐的必要性: 这预示着,一个有效的多智能体系统,其设计的核心,不是让智能体之间“对话”,而是精心设计它们各自的“目标函数”(渴望的糖水)和“环境交互规则”,使得它们在自私地追逐各自目标时,其行为能够客观上推动整个系统的宏大目标。 这是一种基于“机制设计”而非“沟通理解”的协作。

- 测试结论: 模型有效,并提供了一个深刻的视角来理解多智能体动力学。它指出,多智能体协作成功的关键,在于“生态工程”而非“团队管理。

测试变量三:【具身智能(Embodied AI)与物理世界的交互】

- 场景: 智能体被赋予一个机器人身体,需要在真实的物理世界中完成任务(如“整理房间”)。

- 模型预测:

- 法则的物理化: “数字有机体”模型预测,这是其三大法则的终极体现和终极考验。

- 目标即势能 -> 物理势能: “房间整洁”与“房间凌乱”之间的差异,是一个物理上可测量的“熵”的差异。

- 行动即调节 -> 物理调节: 智能体的行动,变成了机械臂的移动、轮子的旋转,直接作用于物理世界。

- 观察即反馈 -> 物理感知: 观察不再是读取API的文本返回值,而是通过摄像头、雷达、触觉传感器来感知物理世界的真实状态。

- 脆弱性的指数级放大: 模型强烈预测,智能体在物理世界的失败率将远高于数字世界。因为物理世界的“反馈”是连续的、充满噪声的、部分可观察的。有机体的“传感器”不再完美,其“行动”的结果也充满不确定性(如“物体滑落”)。其简单的“稳态调节”机制,将难以应对物理世界的复杂性,脆弱性被指数级放大。

- 法则的物理化: “数字有机体”模型预测,这是其三大法则的终极体现和终极考验。

- 测试结论: 模型有效,并对具身智能的挑战做出了根本性预判。它指出,从数字智能体到具身智能体的飞跃,其核心挑战不是“更强的LLM”,而是构建一个能够处理“不完美反馈”的、更鲁棒的“稳态控制系统。这需要引入概率推理、预测控制等更复杂的机制。

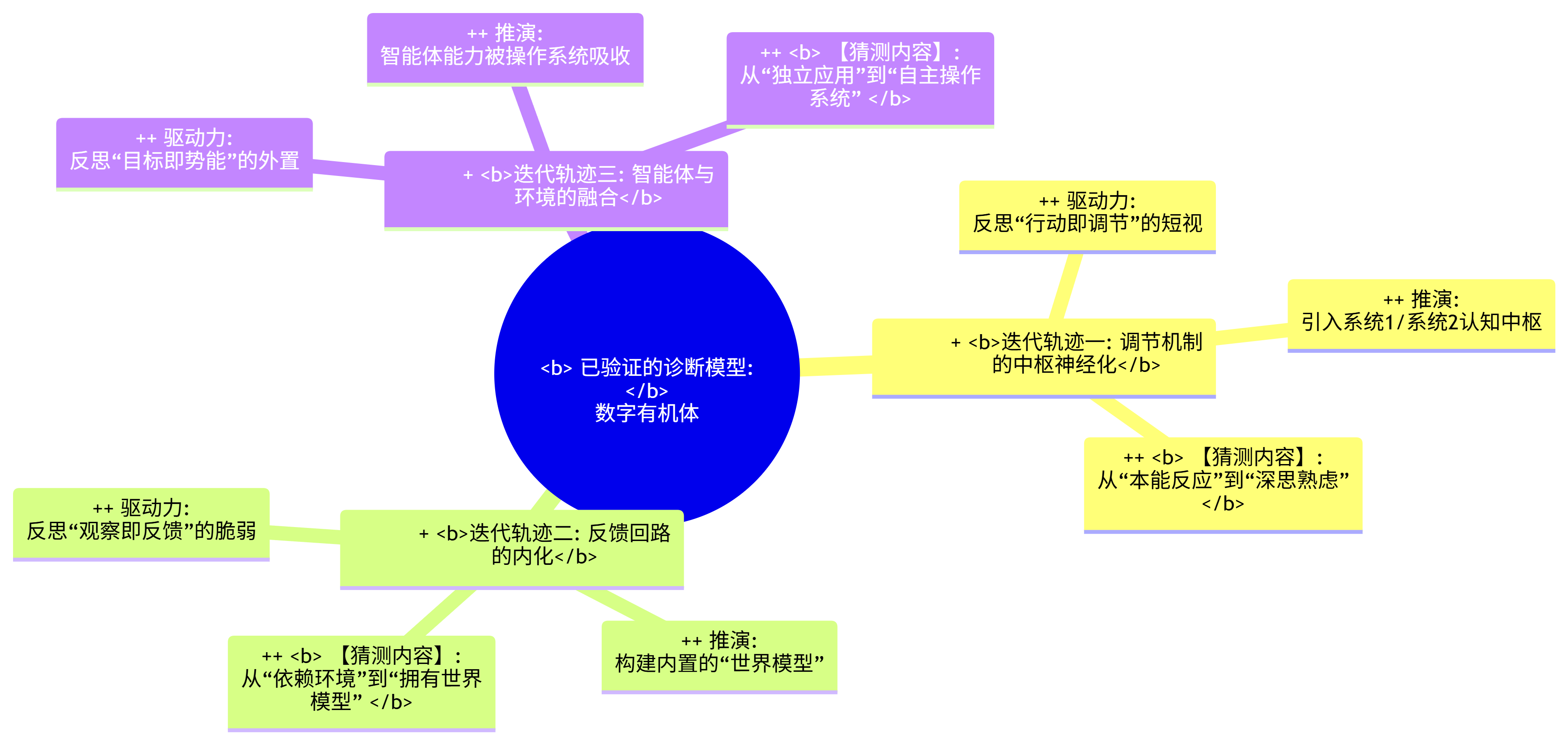

步骤六: 迭代 (Iterate) - 对目标的未来进行推演

核心任务: 基于已验证的“数字有机体”诊断模型及其三大核心法则,对“AI智能体”的未来演化进行逻辑推演。

【迭代推演:智能体的“溶解”,与自主操作系统的诞生】

我们的诊断模型已经明确指出:AI智能体的本质,是一个在“失衡-调节-反馈”循环中运作的数字有机体。它的演化,必然是围绕着如何让这个“有机体”的感知更敏锐、调节更高效、以及其赖以生存的环境更友好这三个方向展开的。

迭代轨迹一:调节机制的“中枢神经化”—— 从“本能反应”到“深思熟虑” (The Centralization of the Regulation Mechanism)

- 驱动力: 对行动即调节法则的“短视与低效”反思。

- 推演: 当前的“数字有机体”只有“应激反应”(基于下一步预测的贪心策略),缺乏一个能进行长期规划、权衡利弊的“大脑皮层”。

- 【猜测内容:】 未来的智能体架构,其核心的“规划模块”(LLM)将被一个分层式的“认知中枢所取代。

- 系统1(快速思考): 一个轻量级的、低成本的模型,负责处理简单、高频的“应激反应”,类似于我们开车时的本能操作。

- 系统2(慢速思考): 一个强大的、高成本的“规划模型”,只在面对复杂、新颖、高风险的决策时被激活。它不再是简单地预测“下一步”,而是能够进行多步推演(Lookahead Simulation),在内心“预演”不同行动序列可能带来的后果,并选择最优路径。

智能体的“行动”,将从纯粹的“概率驱动”,演变为“模拟与预测”驱动。这将极大缓解“循环陷阱”和“规划短视”的问题。

迭代轨迹二:反馈回路的“内化”—— 从“依赖环境”到“拥有世界模型” (The Internalization of the Feedback Loop)

- 驱动力: 对观察即反馈法则的“脆弱性与延迟”反思。

- 推演: 当前的“数字有机体”完全依赖外部环境的反馈,像一个没有记忆的病人,每一步都需要外界告诉它身在何处。一个更高级的有机体,需要拥有自己的“记忆”和对世界运行规律的“理解”。

- 【猜测内容:】 智能体将演化出强大的内置世界模型”(Internal World Model)。这个模型是智能体通过与环境的持续交互,学习到的一个关于“环境如何运转”的内部模拟器。

- 预测性反馈: 在行动之前,智能体可以先在其“世界模型”中进行模拟,预测这个行动可能会带来什么结果。这使得它能在一定程度上摆脱对真实环境“即时反馈”的脆弱依赖。

- 信用分配: 当一个长期任务最终成功或失败时,世界模型可以帮助智能体进行“信用分配”,回顾整个行动链,判断出哪些步骤是“关键决策”,从而实现真正的“学习”和“成长”。

智能体的“感知”,将从“被动接收外部信号”,演变为“主动预测并验证信号”。这将使其在面对环境噪声和延迟时,表现出前所未有的鲁棒性。

迭代轨迹三:智能体与其环境的“融合”—— 从“应用”到“操作系统” (The Fusion of Agent and Environment)

- 驱动力: 对目标即势能法则的“外置性与孤立性”反思。

- 推演: 这是最根本的迭代。目前,我们是把一个个孤立的“智能体”(应用)放到一个被动的“环境”(OS)中去运行。但如果“环境”本身就变成了智能体呢?

- 【猜测内容:】 “AI智能体”作为一个独立的应用形态将会逐渐“消失,它的能力和运行逻辑将被吸收”和“内化”,成为下一代操作系统的核心层。

- 从“启动智能体”到“设定系统目标”: 我们将不再需要打开一个叫“AutoGPT”的应用。取而代之的是,我们直接在操作系统的层面上设定一个高阶目标,比如“帮我准备下周关于市场营销的会议”。

- OS即智能体: 操作系统本身,将成为一个持续运行的、巨大的“稳态引擎”。它的“目标”,就是维持我们整个“数字生活”的有序和高效。它会主动为我们整理文件、管理日程、过滤信息、预处理任务,因为它被赋予的终极“稳态”,就是“用户的数字世界处于最佳状态”。

- 应用的“工具化”: 所有的应用程序(如Word, Outlook, Slack)都将退化为这个“操作系统智能体”可以调用的“工具”。我们与应用软件的交互,将越来越多地被我们与“操作系统智能体”的交互所取代。

这标志着人机交互从“手动操作应用”,进入了“委托操作系统”的时代。智能体不再是“我们使用的东西”,而是“我们生活于其中的东西”。

结论性摘要

“AI智能体”的时代,是我们将AI从一个“静态的知识库”释放出来,赋予其“动态的行动力”的伟大尝试。它是一个基于“稳态”原理的“数字有机体”,在连接AI认知与真实世界的道路上,迈出了至关重要的第一步。

然而,它的历史使命,并非是成为一个独立存在的“数字生命”。

我们对其未来的迭代推演得出了一个清晰的结论:智能体”的演化,是一个其自身形态不断“溶解”和“泛化”的过程。 它将从一个我们需要刻意去“运行”的程序,演变为一个我们感知不到、但无处不在的“环境智能”。

AI智能体教会了我们如何构建一个能够“做事”的AI,而下一场革命,将是让我们的整个“数字世界”都活过来,主动为我们“做事”。 这将标志着“智能体应用”的黄昏,以及一个我们尚未完全知晓,但必将彻底重塑我们与技术关系的、真正的自主操作系统的黎明。

附录:关键文献引用 (Key Paper References)

本报告的分析与论点,建立在对以下塑造了“AI智能体”领域的核心文献的理解之上。这些文献共同构成了我们理解智能体从诞生、演化到未来的学术基石。

一、 核心奠基文献 (Core Foundational Papers)

这类文献首次提出或确立了AI智能体的核心工作范式,是整个领域的理论支柱。

-

ReAct:智能体范式的奠基石

- 标题: ReAct: Synergizing Reasoning and Acting in Language Models 1

- 作者: Shunyu Yao, Jeffrey Zhao, Dian Yu, et al.

- 机构/年份: Google Research & Princeton University, 2022

- 核心贡献: 定义了现代AI智能体的基本运行循环。 论文开创性地提出了将“推理”(Reason)和“行动”(Act)相结合的框架,让LLM可以交错地生成“思考”和“调用工具”的轨迹。这是几乎所有后续智能体架构的理论原点。

-

WebGPT:与真实环境交互的先驱

- 标题: WebGPT: Browser-assisted question-answering with human feedback 2

- 作者: Reiichiro Nakano, Jacob Hilton, et al.

- 机构/年份: OpenAI, 2021

- 核心贡献: 首次系统性地探索了让LLM使用一个真实的、不受限制的浏览器环境来完成任务。它不仅证明了LLM与复杂外部工具集成的可行性,还引入了人类反馈来训练和对齐模型的“行为”,为后续智能体与真实世界交互的研究铺平了道路。

二、 关键演化与应用文献 (Key Evolutionary & Application Papers)

这些工作代表了智能体在能力和应用形态上的重大演进,极大地推动了该领域的普及和发展。

-

Auto-GPT:自主长期规划的里程碑

-

Toolformer:让模型自学使用工具

- 标题: Toolformer: Language Models Can Teach Themselves to Use Tools 5

- 作者: Timo Schick, Jane Dwivedi-Yu, et al.

- 机构/年份: Meta AI, 2023

- 核心贡献: 提出了一个革命性的方法,让LLM能够通过自监督的方式,自己学会“何时”、“何地”以及“如何”调用外部API(工具)。这标志着智能体的工具使用能力,正从需要人类硬编码的“被动赋予”,迈向更具扩展性和自主性的“主动习得”。

三、 协作与评估方向文献 (Collaboration & Evaluation Papers)

这些文献关注智能体生态的两个核心问题:如何让智能体协同工作,以及如何科学地衡量它们的能力。

-

MetaGPT:多智能体协作的社会化模拟

- 标题: MetaGPT: Meta Programming for Multi-Agent Collaborative Framework 6

- 作者: Sirui Hong, Xiawu Zheng, et al.

- 机构/年份: 开源社区, 2023

- 核心贡献: 将“软件公司”的组织架构和标准作业流程(SOP)引入多智能体系统。通过为不同智能体分配特定角色(如产品经理、架构师、工程师),MetaGPT展示了通过模拟人类社会分工,可以显著提升智能体完成复杂任务的质量和稳定性,是多智能体协作领域的重要探索。

-

AgentBench:智能体能力评估的标尺

- 标题: AgentBench: Evaluating LLMs as Agents 7

- 作者: Xiao-Yang Liu, et al.

- 机构/年份: 多家学术机构联合, 2023

- 核心贡献: 为评估“作为智能体的LLM”提供了一个全面的、标准化的基准测试平台。 它包含了从桌面操作到网络购物等8个真实、动态的环境,将评估标准从“语言能力”转向了“任务成功率”,为整个领域提供了衡量进展的“标尺”,对推动智能体研究的科学化和规范化至关重要。

附实验室前2篇:

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)