本地部署教程DeepSeek

在AI界最火的当属deepseek,然而所谓树大招风,由于它太优秀导致被各种攻击,所以就会导致使用是经常系统繁忙,实在影响使用心情,今天就教大家怎么在自己电脑本地部署DeepSeek R1 来解决这个问题。

更多问题解决办法,请转向 https://www.firerise.com.cn/

有网站建设、小程序需求,联系 (baddl1992@126.com)

世界级【PMP证书】成员全程陪护

在AI界最火的当属deepseek,然而所谓树大招风,由于它太优秀导致被各种攻击,所以就会导致使用是经常系统繁忙,实在影响使用心情,今天就教大家怎么在自己电脑本地部署DeepSeek R1 来解决这个问题。

【适用平台】Windows

【具体步骤】

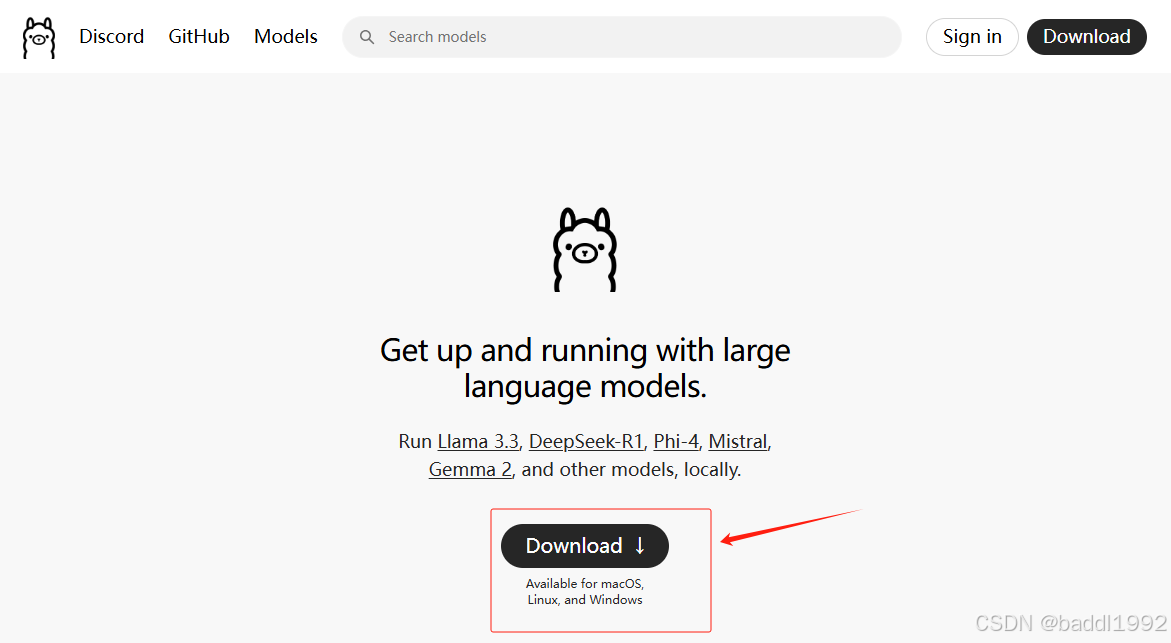

第一步:下载 Ollama

下载地址:https://ollama.com/download

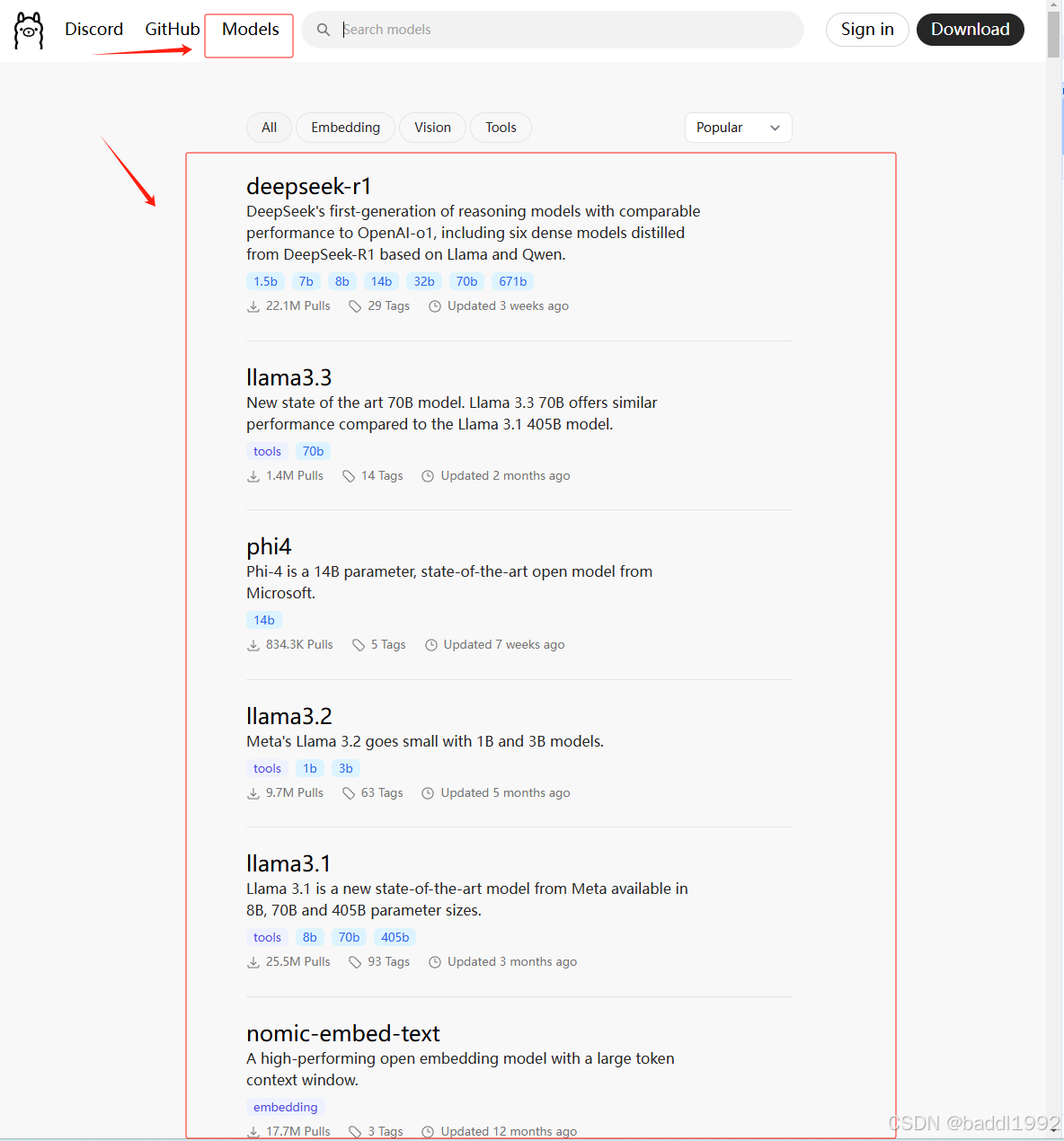

点击Models可以看到Ollama 支持的模型

第二步:安装Ollama

下载完成后双击 ollamaSetup.exe 文件进行安装;

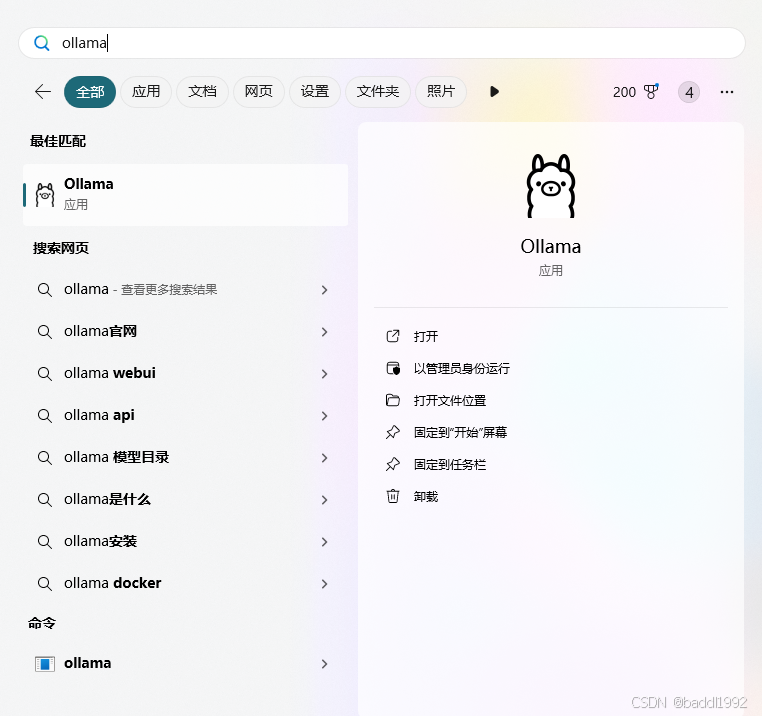

第三步:运行Ollama

安装完成后,运行 Ollama ;

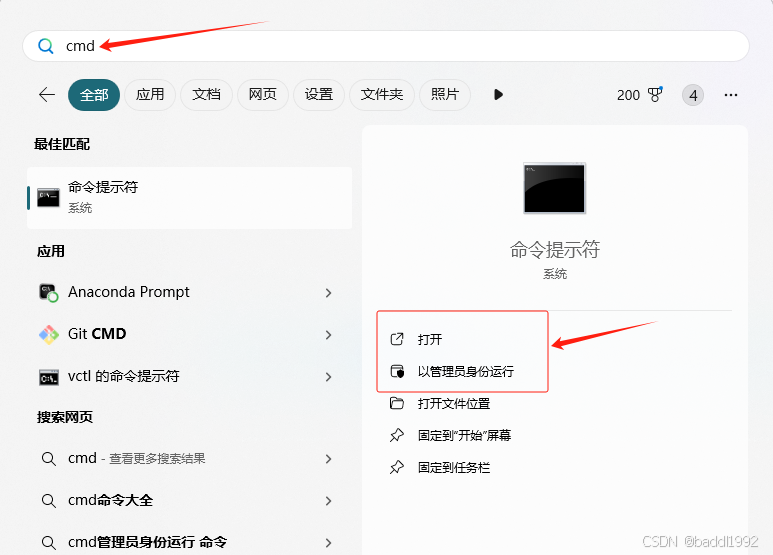

第四步:打开命令窗口

在开始菜单搜索框搜索 cmd 命令运行工具;

或使用快捷键( Win+R )方式

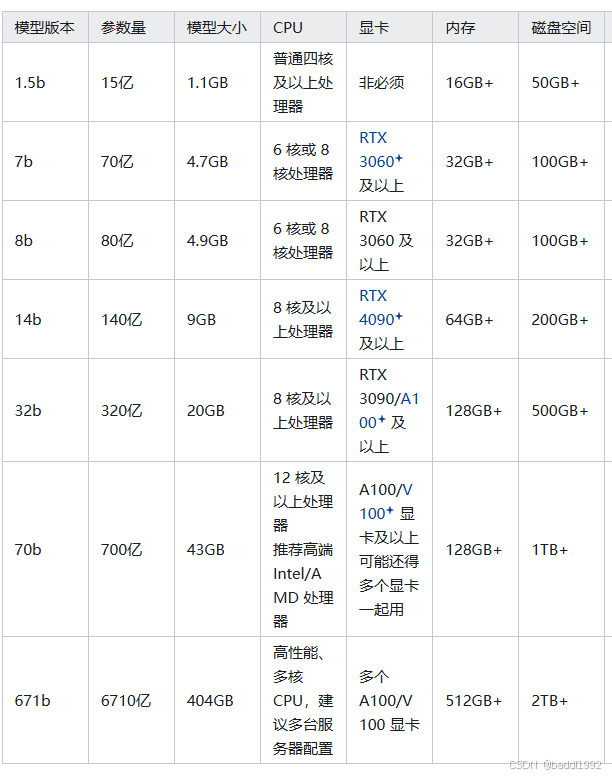

第五步:各模型配置要求

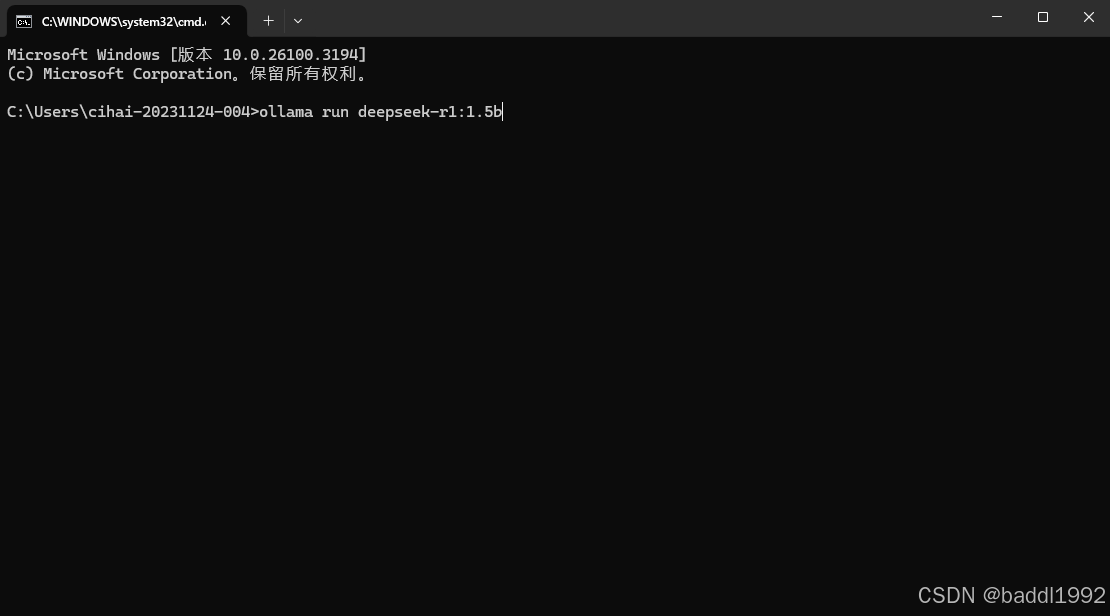

第六步:模型安装命令

DeepSeek模型版本有许多:比如1.5b、7b、8b、14b、32b、70b 671b,版本越高越强大,但是对电脑GPU要求也越高。根据你电脑的配置选择合适的版本,每一个版本都对应一个安装命令,把它复制下来。然后在CMD命令框,输入上述命令。例如:ollama run deepseek-r1:1.5b,便可以自动在线部署安装。

DeepSeek-R1-Distill-Qwen-1.5B

ollama run deepseek-r1:1.5b

DeepSeek-R1-Distill-Qwen-7B

ollama run deepseek-r1:7b

DeepSeek-R1-Distill-Llama-8B

ollama run deepseek-r1:8b

DeepSeek-R1-Distill-Qwen-14B

ollama run deepseek-r1:14b

DeepSeek-R1-Distill-Qwen-32B

ollama run deepseek-r1:32b

DeepSeek-R1-Distill-Llama-70B

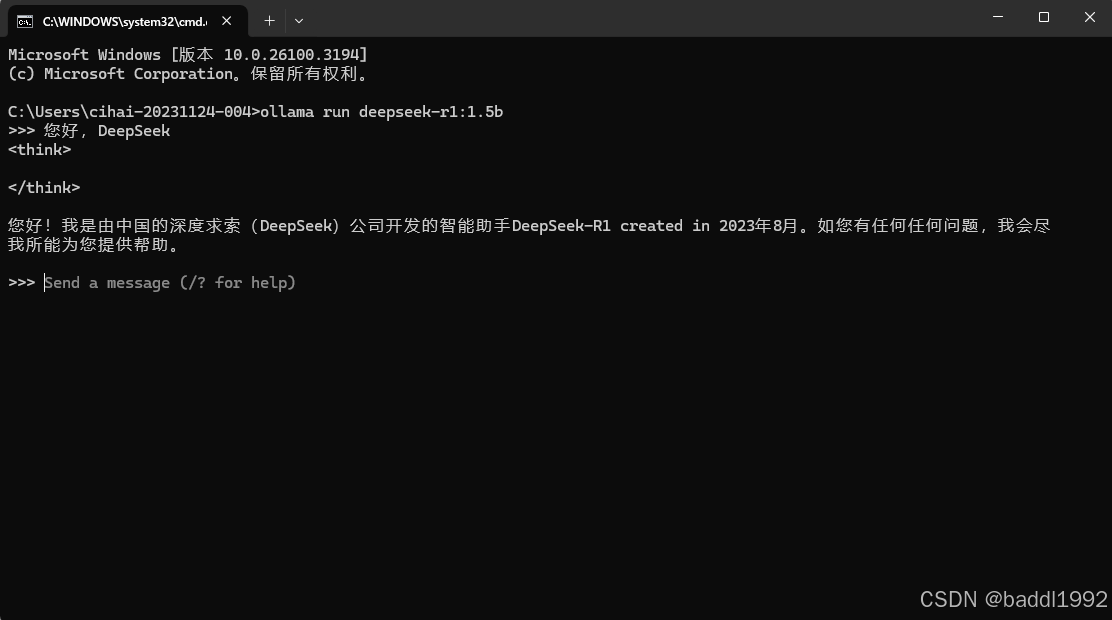

ollama run deepseek-r1:70b第七步:安装模型

部署成功后,我们可以使用命令窗口直接输入你想问的问题。

第八步:安装Chat Box

如果觉得CMD界面使用不美观,想要一个美观的带界面的软件输出内容,可以继续安装 ChatBox。

下载地址:https://chatboxai.app/zh

第九步:配置

安装完成后,在 ChatBox 的设置中配置一下 API ,就可以正常使用啦!

第十步:使用DeepSeek提供的API接口

public function testdeepseek(){

// http://127.0.0.1:11434

// 生成文本:POST /api/generate

// 列出模型:GET /api/tags

// 拉取模型:POST /api/pull

// API 端点

$url = "http://127.0.0.1:11434/api/generate";

// 请求数据

$data = [

"model" => "deepseek-r1:1.5b", // 模型名称

"prompt" => "你好,DeepSeek!", // 输入提示

"stream" => false // 是否流式输出

];

}第十一步:学习大模型

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)