ollama运行量化模型

ollama部署量化模型

·

今天要部署一个qwen2.5模型,但是7b的模型还是太慢了,所以想部署一个4位量化,但是在网上搜索几乎都是用llama.cpp转换,搞makefile文件,然后导入的。

但是我在想ollama这么方便,应该有现成的才对。果然一搜,真的有。

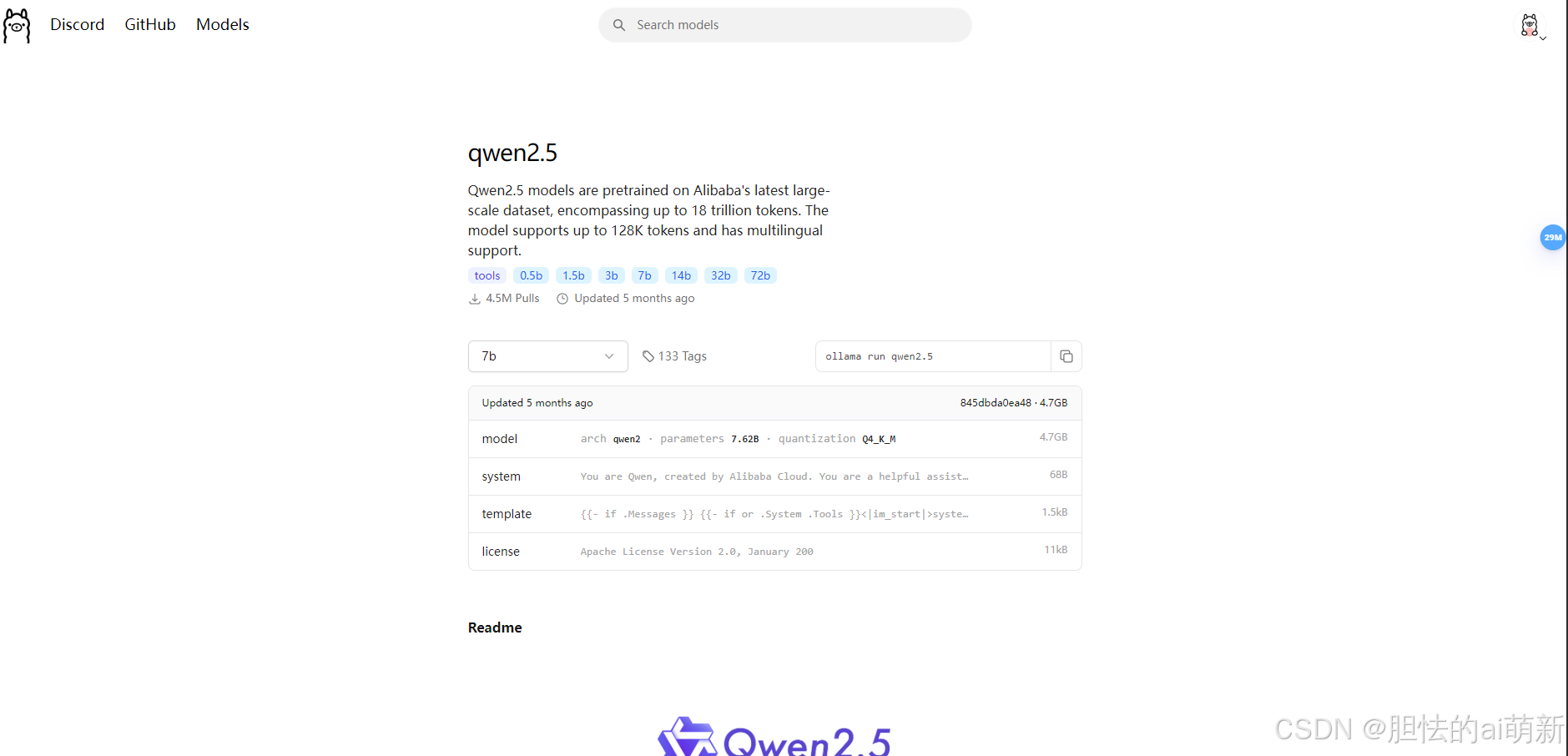

首先打开ollama官网,搜索自己想要的模型

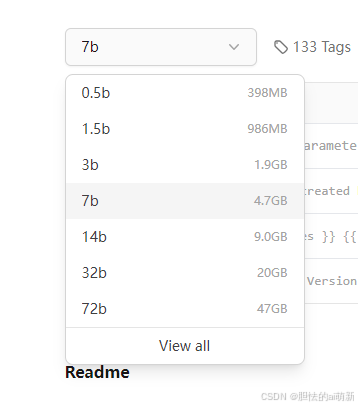

点击选择的按钮,有一个view all

选择view all里面就是所有有关的模型了,包括各种版本的量化、微调模型。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)