实战RAG:从30%到90%提升LLM知识库准确率的完整指南

本文分享企业RAG知识库问答系统的优化实践,通过系统化方法将准确率从30%提升至90%。重点优化了召回策略(Vector Search粗排+Rerank精排)和生成模型选择(Qwen2.5-7B),并强调文档体系建设和用户交互优化的重要性。文章提供了系统化评测方法和平衡性能与成本的实践经验,为LLM应用落地提供参考。

本文分享企业RAG知识库问答系统的优化实践,通过系统化方法将准确率从30%提升至90%。重点优化了召回策略(Vector Search粗排+Rerank精排)和生成模型选择(Qwen2.5-7B),并强调文档体系建设和用户交互优化的重要性。文章提供了系统化评测方法和平衡性能与成本的实践经验,为LLM应用落地提供参考。

引言:RAG - LLM 应用落地的关键技术

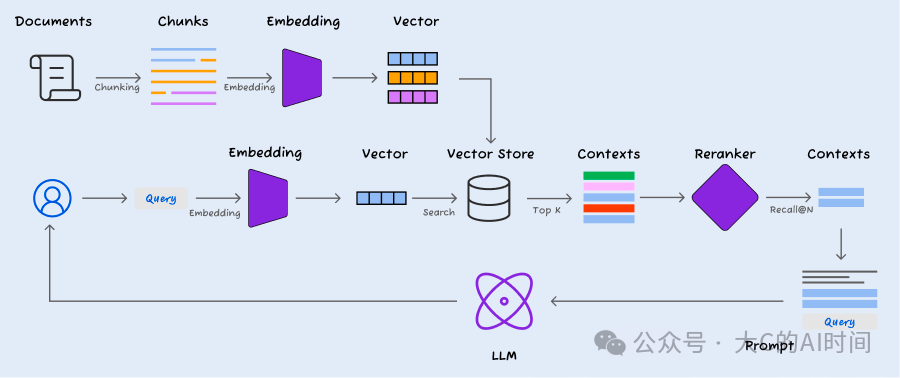

在 LLM 浪潮爆发之后,RAG (检索增强生成) 技术因其清晰的技术路径和相对可控的实施成本,成为企业快速落地 AI 应用的重要突破口。本文将分享我们在构建企业知识库智能问答系统过程中的实践历程:如何通过系统化的优化方法,将准确率从初期的 30% 提升到 90% 的实用水平。

这不仅是一个追踪 RAG 技术演进的历程,更是一个将 LLM 技术落地为实用产品的实践案例。本文将介绍如何通过优化召回策略、选择生成模型、设计产品策略,构建一个准确性高、成本可控的 RAG 知识库问答系统,无需复杂的模型精调工作。

RAG流程示意图

初期探索:从简单实现到系统思考

V1 版本:基础 RAG 实践

在 2023 年下半年,我们完成了第一版基于 RAG 的知识库问答系统的上线。这个版本采用了相对简单且主流的技术方案:

- 文档预处理:采用基于三级标题的分割策略,将文档切分为 500~1000 tokens 的片段,并保留 Markdown 格式的富文本内容

- 向量化处理:使用当时表现较好的 bge-large-zh-v1.5 模型进行文本向量化

- 检索策略:结合向量搜索和基于 Elastic Search 的关键词混合检索方案,通过 RRF(Reciprocal Rank Fusion)算法融合排序

- 问答生成:选用 ChatGLM3-6B 作为基础模型,提供问题总结服务

然而,这个版本在实际运营中的表现并不理想。系统性评测结果显示,真实用户提问的回答正确率仅有约 30%。而更令人沮丧的是,在相当长的一段时间内,我们难以找到明确的优化方案。

RAG 技术远比想象中更难以提升效果。

大模型业界发展:新模型带来的转机

2023 年底至 2024 年初,大模型业界依然在狂飙突进。几个关键的技术进展为我们带来了新的思路:

- 更强大的基础模型:阿里巴巴 Qwen 系列模型的快速迭代(从 qwen1.5到 qwen2),在中文理解、指令遵循等方面都展现出显著优势,尤其是其 32k 的上下文支持能力

- 更优秀的向量模型:北京智源研究院发布的 reranker 重排序模型和bge-m3 embedding 模型,为检索优化提供了新的可能性

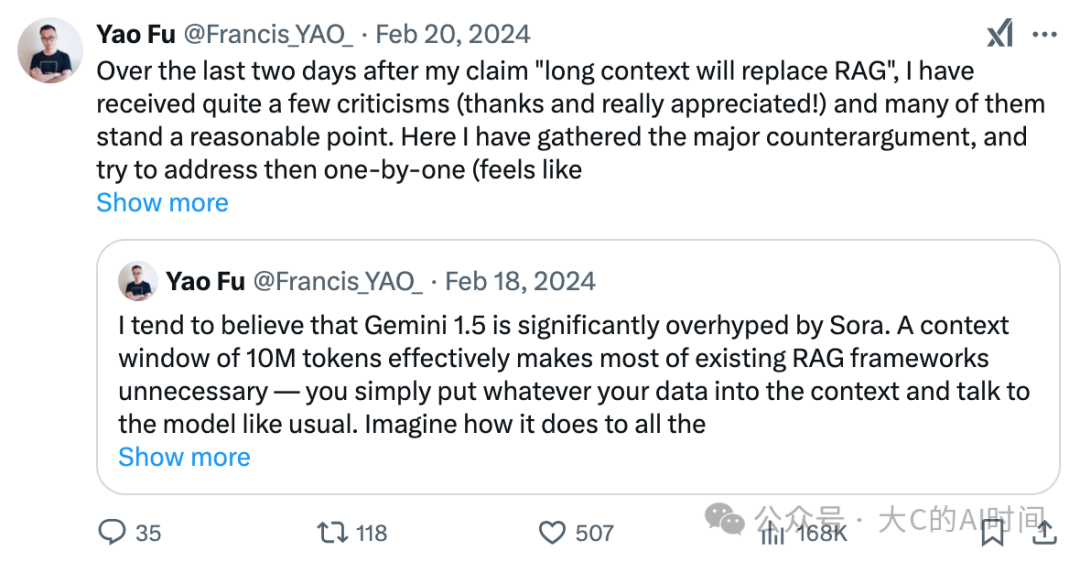

- 技术思路的突破:twitter 社区上出现关于 Long Context 与 RAG 技术优劣的大讨论,启发我们重新思考系统架构

2024年初 X 上 Long Context replace RAG的讨论

通过初步测试,我们发现更长的上下文长度支持下(32k),能成倍的增加召回文档的数目,从而显著的提升问答的准确性。然而,这种提升伴随着明显的成本增长:响应时间的增加,以及 GPU 显存消耗增加。

这时就需要评估,如何平衡问答准确性与计算成本和延时?

方法论:构建系统化的评测方案

为了找到这个平衡点,我们设计了一套系统化的评测方案:

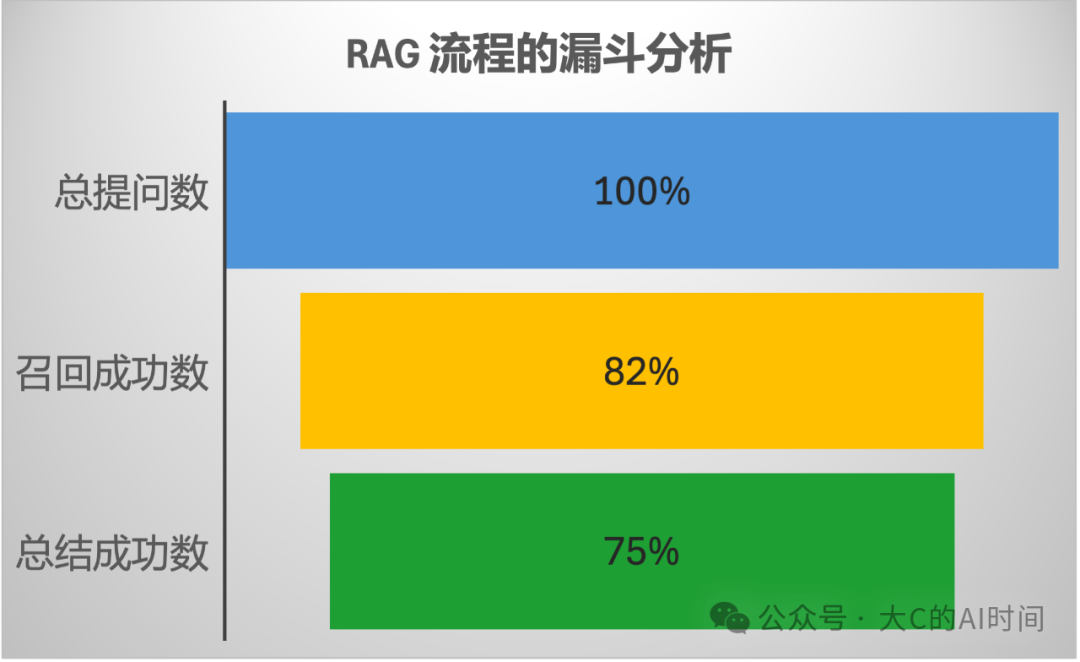

1. RAG 流程的漏斗模型

我们将 RAG 流程解构为两个关键阶段:

- 召回阶段:从知识库中检索相关文档

- 生成阶段:基于检索结果生成答案

这种分解让我们能够分别优化和评估各个环节的性能,更精确地定位瓶颈所在。

RAG流程的漏斗模型

2. 标准化评测集

我们建立了包含200个标准问题的评测集,每个问题都包括了:

- 相关文档链接

- 标准参考答案

这个评测集覆盖了不同类型和难度的问题,能够较好地模拟真实场景下的用户提问。评测的目的是评估不同 RAG 策略的相对优劣,并不等于线上真实运营的结果。

3. 量化的优化策略

基于这个评测体系,我们展开了系统性的优化工作:

召回阶段

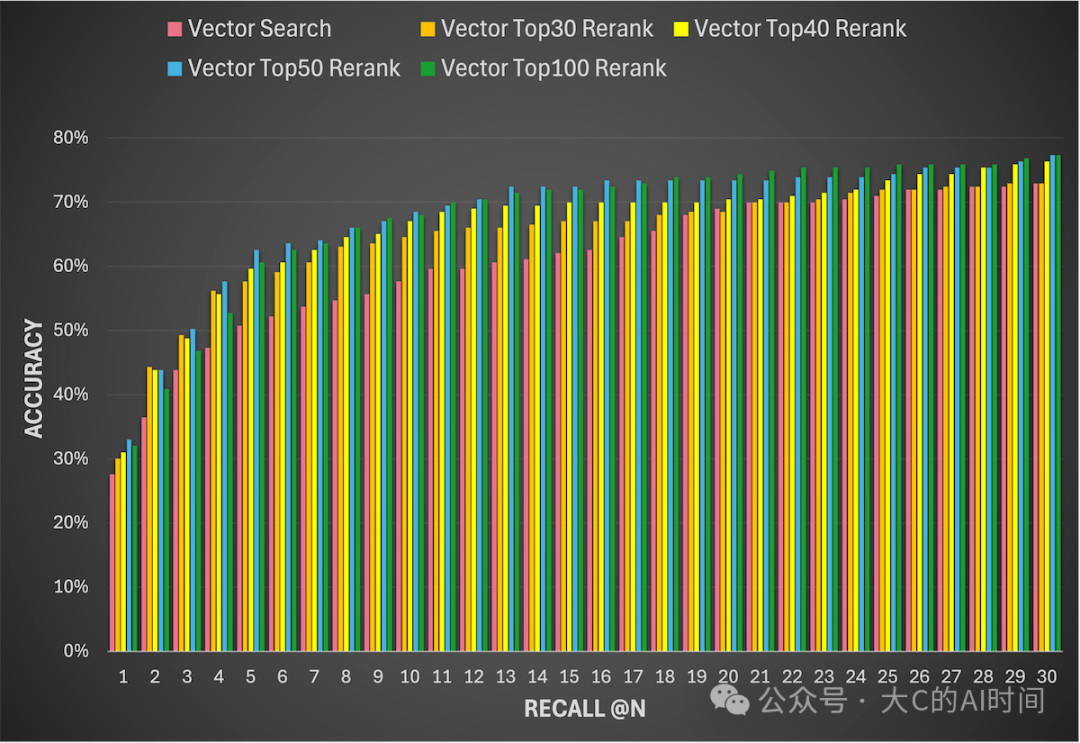

召回阶段的目标是选择最优的文档召回策略。通过深入分析不同策略组合的特点,我们得到这些结论:

- Vector Search:速度快,适合作为粗排阶段,快速召回 Top K (20/50/100) 的文档

- **Rerank:**准确率高,但耗时较大,适合作为精排阶段,对粗排结果进一步提升正确文档的排名。实验表明,对于相同的 N 值,Rerank 比 Vector Search 的准确率普遍提升约 10%

- Recall@N:N 值越大,召回文档越多,准确率越高,但同时也增加了输送给 LLM 的 Context Length,对模型的要求也更高

向量搜索、Rerank及TopN的评测实验

召回阶段的优化策略

- Vector Search 作为粗排,召回 Top 100 的文档

- Rerank 作为精排,从中选取 Top 15 的最相关文档

- 最终实现了约 85% 的 Recall@15 准确率

生成阶段

模型生成阶段的目标是选择性能和性价比俱佳的模型。经过多次实验和对比,我们发现 Qwen2.5-7B 模型在 10k Context Length 下,依然能保持 90% 左右的正确率,且明显优于之前使用的 ChatGLM3-6B。虽然 Qwen2.5-72B 参数更大,准确率方面有略微提升,但其对显存要求极高,并不具备经济性。

生成阶段的优化策略

- 选定 Qwen2.5-7B 作为生成模型

- 将上下文长度限制在 10k tokens,在保证性能的同时控制资源消耗

- 最终模型达到了约 90% 的生成准确率

产品化思考:技术之上的产品优化

我们逐渐意识到,仅依靠模型技术的优化是不够的。要建设一个真正好用的知识库问答系统,需要从产品和用户体验的角度进行全方位提升:

1. 文档体系建设

大模型素有 “garbage in, garbage out” 的说法。这强调了文档质量的重要性。不但要写好文档,更需要 “面向LLM” 写文档。因此在文档建设方面:

- 补充高频文档:针对性补充常见问题的标准答案,效果立竿见影

- 面向 LLM 写文档:确保文档背景知识完整、语义清晰、对模型友好

2. 用户交互优化

我们观察到用户在不同场景下的提问有差异性,并且用户可能无法准确描述问题。因此在产品设计方面:

- 设计场景化的问题推荐,引导用户更准确地表达问题

- 提供答案反馈机制,持续收集用户反馈进行优化

成果与思考

通过上述系统性优化,我们最终实现了:

- 召回阶段:正确文档召回率达到 95%

- 生成阶段:生成答案准确率达到 90%

这个结果意味着可以投入生产运营中,我们的系统已经为大多数用户提供切实有效的帮助。

整个优化过程也让我们获得了一些重要经验:

1. 系统化方法的重要性:通过建立标准评测体系和量化指标,我们能够更客观地评估不同优化策略的效果

2. 平衡性能与成本:不必一味追求最大参数的 LLM,优秀的 7B 级别的小模型已经足以解决好 RAG 场景

3. 产品设计的必要性:技术优化需要与产品设计优化相结合,才能扬长避短的落地 LLM 应用

大模型未来如何发展?普通人如何抓住AI大模型的风口?

※领取方式在文末

为什么要学习大模型?——时代浪潮已至

随着AI技术飞速发展,大模型的应用已从理论走向大规模落地,渗透到社会经济的方方面面。

- 技术能力上:其强大的数据处理与模式识别能力,正在重塑自然语言处理、计算机视觉等领域。

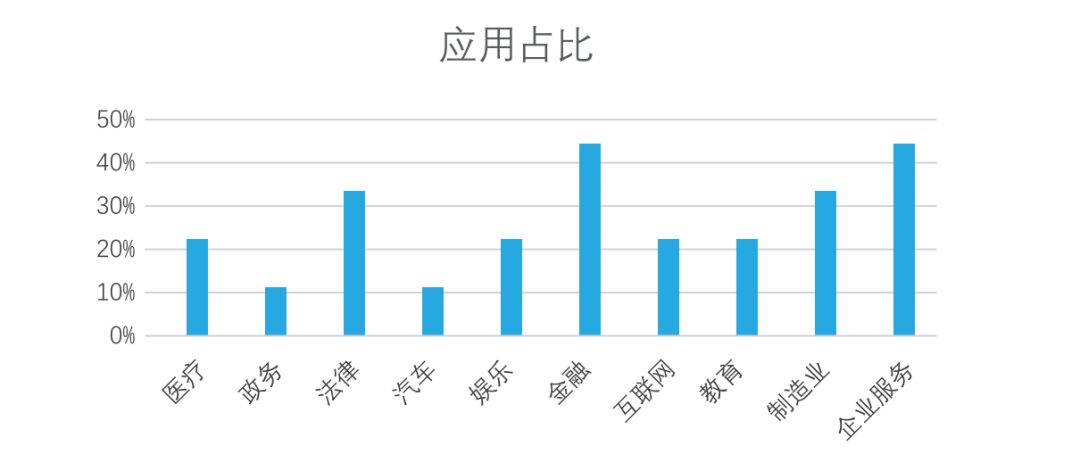

- 行业应用上:开源人工智能大模型已走出实验室,广泛落地于医疗、金融、制造等众多行业。尤其在金融、企业服务、制造和法律领域,应用占比已超过30%,正在创造实实在在的价值。

未来大模型行业竞争格局以及市场规模分析预测:

同时,AI大模型技术的爆发,直接催生了产业链上一批高薪新职业,相关岗位需求井喷:

AI浪潮已至,对技术人而言,学习大模型不再是选择,而是避免被淘汰的必然。这关乎你的未来,刻不容缓!

那么,我们如何学习AI大模型呢?

这份精心整理的AI大模型学习资料,我整理好了,免费分享!只希望它能用在正道上,帮助真正想提升自己的朋友。让我们一起用技术做点酷事!

ps:微信扫描即可获取

加上后我将逐一发送资料

与志同道合者共勉

真诚无偿分享!!!

适学人群

我们的课程体系专为以下三类人群精心设计:

-

AI领域起航的应届毕业生:提供系统化的学习路径与丰富的实战项目,助你从零开始,牢牢掌握大模型核心技术,为职业生涯奠定坚实基础。

-

跨界转型的零基础人群:聚焦于AI应用场景,通过低代码工具让你轻松实现“AI+行业”的融合创新,无需深奥的编程基础也能拥抱AI时代。

-

寻求突破瓶颈的传统开发者(如Java/前端等):将带你深入Transformer架构与LangChain框架,助你成功转型为备受市场青睐的AI全栈工程师,实现职业价值的跃升。

※大模型全套学习资料展示

通过与MoPaaS魔泊云的强强联合,我们的课程实现了质的飞跃。我们持续优化课程架构,并新增了多项贴合产业需求的前沿技术实践,确保你能获得更系统、更实战、更落地的大模型工程化能力,从容应对真实业务挑战。 资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

01 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。希望这份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

👇微信扫描下方二维码即可~

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

02 大模型学习书籍&文档

新手必备的权威大模型学习PDF书单来了!全是一系列由领域内的顶尖专家撰写的大模型技术的书籍和学习文档(电子版),从基础理论到实战应用,硬核到不行!

※(真免费,真有用,错过这次拍大腿!)

03 AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

04 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

05 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

06 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

由于篇幅有限

只展示部分资料

并且还在持续更新中…

ps:微信扫描即可获取

加上后我将逐一发送资料

与志同道合者共勉

真诚无偿分享!!!

最后,祝大家学习顺利,抓住机遇,共创美好未来!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献347条内容

已为社区贡献347条内容

所有评论(0)