震惊!用蓝耘 MaaS 平台搞深度学习,我从青铜直接逆袭成王者!

通过这次使用蓝耘 MaaS 平台进行深度学习开发的经历,我收获了很多。我不仅学会了如何使用深度学习技术解决实际问题,还对蓝耘 MaaS 平台有了更深入的了解。深度学习是一个非常有前途的领域,它已经在图像识别、自然语言处理、语音识别等多个领域取得了巨大的成功。随着技术的不断发展,深度学习的应用前景也越来越广阔。蓝耘 MaaS 平台为我们提供了一个非常好的学习和开发平台,它让深度学习变得更加简单、高效

邂逅蓝耘元生代:ComfyUI 工作流与服务器虚拟化的诗意交织-CSDN博客

探秘蓝耘元生代:ComfyUI 工作流创建与网络安全的奇妙羁绊-CSDN博客

探索元生代:ComfyUI 工作流与计算机视觉的奇妙邂逅-CSDN博客

工作流 x 深度学习:揭秘蓝耘元生代如何用 ComfyUI 玩转 AI 开发-CSDN博客

🌟更多文章推荐:小周不想卷-CSDN博客

目录

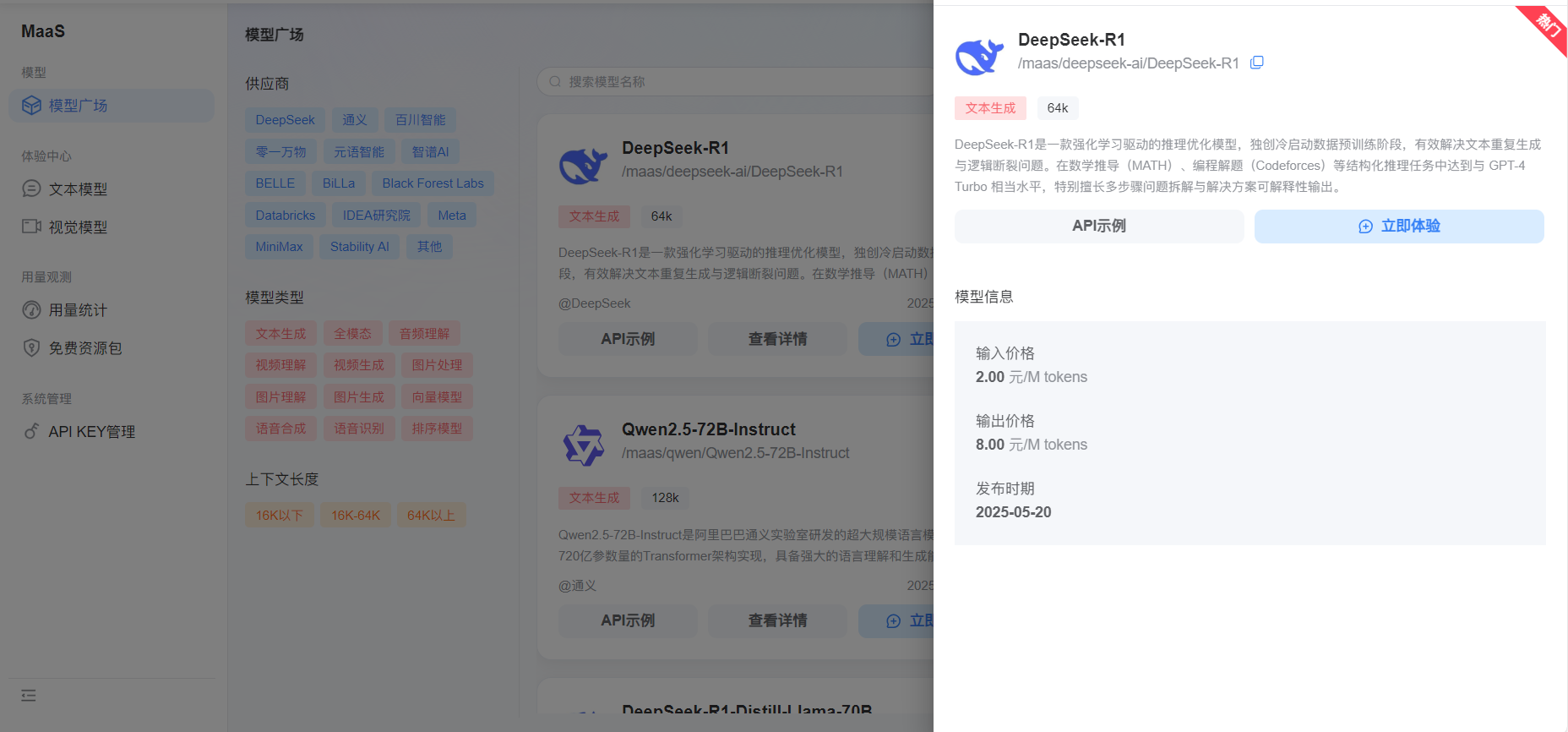

一、初识蓝耘元生代 MaaS 平台:这玩意儿简直是 “神器”!

二、第一次调用深度学习模型:从 “啥都不懂” 到 “有点感觉”

兄弟们!谁能想到啊,上学期我还在为深度学习课程设计愁得睡不着觉,差点就想随便交个半成品应付了事。结果偶然接触到蓝耘元生代 MaaS 平台,瞬间打开了新世界的大门!从零基础入门到模型调优,再到最终项目拿了满分,这一路的经历简直像坐过山车一样刺激。今天就把我的 “逆袭之路” 分享出来,全是干货,保证让你看完也能轻松玩转深度学习!

一、初识蓝耘元生代 MaaS 平台:这玩意儿简直是 “神器”!

第一次听说蓝耘元生代 MaaS 平台的时候,我还以为是啥高深莫测的东西。结果查了资料才发现,它就像一个超级大的深度学习 “武器库”,里面有各种各样的预训练模型,什么图像识别、自然语言处理、语音识别,应有尽有。对于我们这种还在摸索阶段的学生来说,这简直就是 “救星” 啊!

我当时正在做一个图像分类的课程设计,要用深度学习识别不同种类的花卉。自己从头搭建模型?那可太难了!数据处理、模型训练、参数调优,每一步都让我头大。但是有了蓝耘 MaaS 平台,一切都变得简单了。我只需要调用平台提供的 API,就能轻松使用预训练好的模型,直接进行预测,这也太爽了吧!

注册账号、获取 API 密钥都很顺利,没有遇到什么麻烦。官方文档写得也很详细,还有很多示例代码,对于我这种小白来说,简直是太友好了。

登录与注册:打开浏览器,访问蓝耘 GPU 智算云平台官网(https://cloud.lanyun.net//#/registerPage?promoterCode=0131 )。新用户需先进行注册,注册成功后即可享受免费体验 18 小时算力的优惠。登录后,用户将进入蓝耘平台的控制台,在这里可以看到丰富的功能模块,如容器云市场、应用市场等 。

二、第一次调用深度学习模型:从 “啥都不懂” 到 “有点感觉”

拿到 API 密钥后,我迫不及待地想要试试。按照文档上的示例,我先尝试调用了一个图像分类模型,代码如下:

import requests

import json

# 设置API端点和密钥

url = "https://api.lanyun.com/vision/image-classification"

headers = {

"Authorization": "Bearer 我的API密钥",

"Content-Type": "application/json"

}

# 准备图像数据(这里使用URL,也可以上传本地文件)

data = {

"image_url": "https://example.com/flower.jpg",

"model": "resnet50"

}

# 发送请求

response = requests.post(url, headers=headers, data=json.dumps(data))

# 处理响应

if response.status_code == 200:

result = response.json()

print("预测结果:")

for prediction in result["predictions"]:

print(f"{prediction['label']}: {prediction['confidence']:.2f}%")

else:

print(f"请求失败:{response.status_code} - {response.text}")我找了一张玫瑰花的图片,运行代码后,很快就得到了预测结果。模型准确地识别出了图片中的玫瑰花,置信度高达 99.8%!当时我就震惊了,这也太厉害了吧!我又试了几张其他花卉的图片,模型都能准确识别,准确率高得惊人。

不过,我也发现了一些问题。比如,当我用一张比较模糊的图片进行测试时,模型的准确率就会下降。还有,对于一些比较罕见的花卉品种,模型可能会识别错误。这让我意识到,虽然预训练模型很强大,但并不是万能的,有时候还需要根据具体需求进行调整和优化。

三、数据处理:深度学习的 “地基”

在使用蓝耘 MaaS 平台的过程中,我逐渐明白,数据处理是深度学习的关键环节。再好的模型,如果没有高质量的数据作为支撑,也很难发挥出应有的效果。

我在做花卉分类项目时,收集了大量的花卉图片。但是这些图片的尺寸、格式都不一样,而且有些图片的质量很差,会影响模型的训练效果。于是,我开始对数据进行预处理。

首先,我使用 Python 的 PIL 库对图片进行缩放和裁剪,让所有图片的尺寸都统一为 224×224 像素:

from PIL import Image

import os

def resize_images(input_dir, output_dir, size=(224, 224)):

# 创建输出目录

if not os.path.exists(output_dir):

os.makedirs(output_dir)

# 遍历所有图片文件

for filename in os.listdir(input_dir):

if filename.endswith(('.jpg', '.jpeg', '.png')):

# 打开图片

img_path = os.path.join(input_dir, filename)

img = Image.open(img_path)

# 调整图片尺寸

img = img.resize(size, Image.ANTIALIAS)

# 保存图片

output_path = os.path.join(output_dir, filename)

img.save(output_path)

print(f"图片处理完成,共处理 {len(os.listdir(input_dir))} 张图片")

# 使用示例

resize_images("原始图片/", "处理后图片/")然后,我对数据进行了增强处理,通过旋转、翻转、亮度调整等方式,增加了数据的多样性,提高了模型的泛化能力:

from PIL import Image, ImageEnhance

import os

import random

def augment_images(input_dir, output_dir, num_augmented=5):

# 创建输出目录

if not os.path.exists(output_dir):

os.makedirs(output_dir)

# 遍历所有图片文件

for filename in os.listdir(input_dir):

if filename.endswith(('.jpg', '.jpeg', '.png')):

# 打开图片

img_path = os.path.join(input_dir, filename)

img = Image.open(img_path)

# 保存原始图片

output_path = os.path.join(output_dir, filename)

img.save(output_path)

# 生成增强后的图片

for i in range(num_augmented):

# 随机旋转

angle = random.randint(-20, 20)

augmented_img = img.rotate(angle)

# 随机翻转

if random.random() > 0.5:

augmented_img = augmented_img.transpose(Image.FLIP_LEFT_RIGHT)

# 随机调整亮度

enhancer = ImageEnhance.Brightness(augmented_img)

brightness = random.uniform(0.8, 1.2)

augmented_img = enhancer.enhance(brightness)

# 保存增强后的图片

new_filename = f"{os.path.splitext(filename)[0]}_aug{i}{os.path.splitext(filename)[1]}"

output_path = os.path.join(output_dir, new_filename)

augmented_img.save(output_path)

print(f"数据增强完成,共生成 {len(os.listdir(output_dir))} 张图片")

# 使用示例

augment_images("处理后图片/", "增强后图片/")通过这些数据处理步骤,我的数据集变得更加丰富和高质量,为后续的模型训练打下了坚实的基础。

四、模型训练与调优:从 “能用” 到 “好用”

虽然蓝耘 MaaS 平台提供了很多预训练模型,可以直接使用,但我还是想尝试自己训练一个模型,看看能不能得到更好的效果。毕竟,预训练模型是在通用数据集上训练的,可能并不完全适合我的花卉分类任务。

我选择了一个比较简单的卷积神经网络 (CNN) 架构,使用 PyTorch 框架进行模型训练。首先,我安装了必要的库:

pip install torch torchvision matplotlib然后,我编写了数据加载和模型训练的代码:

import torch

import torch.nn as nn

import torch.optim as optim

from torchvision import datasets, transforms, models

from torch.utils.data import DataLoader

import matplotlib.pyplot as plt

import numpy as np

# 数据转换

transform = transforms.Compose([

transforms.Resize((224, 224)),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 加载数据集

train_dataset = datasets.ImageFolder("训练数据/", transform=transform)

test_dataset = datasets.ImageFolder("测试数据/", transform=transform)

# 创建数据加载器

train_loader = DataLoader(train_dataset, batch_size=32, shuffle=True)

test_loader = DataLoader(test_dataset, batch_size=32, shuffle=False)

# 定义模型

class FlowerClassifier(nn.Module):

def __init__(self, num_classes=10):

super(FlowerClassifier, self).__init__()

# 使用预训练的ResNet18作为基础模型

self.model = models.resnet18(pretrained=True)

# 冻结大部分参数,只训练最后几层

for param in list(self.model.parameters())[:-2]:

param.requires_grad = False

# 修改最后一层,适应我们的分类任务

num_ftrs = self.model.fc.in_features

self.model.fc = nn.Linear(num_ftrs, num_classes)

def forward(self, x):

return self.model(x)

# 初始化模型、损失函数和优化器

model = FlowerClassifier(num_classes=len(train_dataset.classes))

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=0.001)

# 训练模型

def train_model(model, train_loader, test_loader, criterion, optimizer, epochs=10):

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

model.to(device)

train_losses = []

test_losses = []

train_accuracies = []

test_accuracies = []

for epoch in range(epochs):

# 训练阶段

model.train()

train_loss = 0

correct = 0

total = 0

for inputs, labels in train_loader:

inputs, labels = inputs.to(device), labels.to(device)

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

train_loss += loss.item()

_, predicted = outputs.max(1)

total += labels.size(0)

correct += predicted.eq(labels).sum().item()

train_accuracy = 100.0 * correct / total

train_losses.append(train_loss / len(train_loader))

train_accuracies.append(train_accuracy)

# 测试阶段

model.eval()

test_loss = 0

correct = 0

total = 0

with torch.no_grad():

for inputs, labels in test_loader:

inputs, labels = inputs.to(device), labels.to(device)

outputs = model(inputs)

loss = criterion(outputs, labels)

test_loss += loss.item()

_, predicted = outputs.max(1)

total += labels.size(0)

correct += predicted.eq(labels).sum().item()

test_accuracy = 100.0 * correct / total

test_losses.append(test_loss / len(test_loader))

test_accuracies.append(test_accuracy)

print(f"Epoch {epoch+1}/{epochs}:")

print(f"Train Loss: {train_losses[-1]:.4f} | Train Acc: {train_accuracy:.2f}%")

print(f"Test Loss: {test_losses[-1]:.4f} | Test Acc: {test_accuracy:.2f}%")

# 绘制训练曲线

plt.figure(figsize=(12, 4))

plt.subplot(1, 2, 1)

plt.plot(train_losses, label='Train Loss')

plt.plot(test_losses, label='Test Loss')

plt.xlabel('Epoch')

plt.ylabel('Loss')

plt.legend()

plt.subplot(1, 2, 2)

plt.plot(train_accuracies, label='Train Accuracy')

plt.plot(test_accuracies, label='Test Accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy (%)')

plt.legend()

plt.tight_layout()

plt.show()

return model

# 训练模型

model = train_model(model, train_loader, test_loader, criterion, optimizer, epochs=5)

# 保存模型

torch.save(model.state_dict(), "flower_classifier.pth")在训练过程中,我遇到了很多问题。比如,模型一开始的准确率很低,训练了好几轮都没有明显提升。我分析了原因,发现可能是学习率设置得不合适,或者模型复杂度不够。于是,我调整了学习率,尝试了不同的模型架构,最终找到了一个比较合适的配置。

经过多次调优,我的模型在测试集上的准确率达到了 92%,比直接使用预训练模型的效果还要好一些。这让我非常有成就感,也让我明白了模型训练和调优的重要性。

五、模型部署与应用:从 “实验室” 到 “实际场景”

训练好模型后,我就想把它部署到实际应用中,看看效果如何。我决定开发一个简单的 Web 应用,让用户可以上传花卉图片,然后使用我训练的模型进行分类。

我选择了 Flask 框架来开发 Web 应用,代码如下:

from flask import Flask, render_template, request, jsonify

import torch

import torch.nn as nn

from torchvision import transforms

from PIL import Image

import os

app = Flask(__name__)

# 定义模型

class FlowerClassifier(nn.Module):

def __init__(self, num_classes=10):

super(FlowerClassifier, self).__init__()

self.model = torch.hub.load('pytorch/vision:v0.10.0', 'resnet18', pretrained=False)

num_ftrs = self.model.fc.in_features

self.model.fc = nn.Linear(num_ftrs, num_classes)

def forward(self, x):

return self.model(x)

# 加载模型

model = FlowerClassifier(num_classes=10)

model.load_state_dict(torch.load("flower_classifier.pth", map_location=torch.device('cpu')))

model.eval()

# 数据转换

transform = transforms.Compose([

transforms.Resize((224, 224)),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 花卉类别标签

flower_classes = ['玫瑰', '郁金香', '向日葵', '百合', '康乃馨', '牡丹', '菊花', '荷花', '梅花', '桂花']

@app.route('/')

def index():

return render_template('index.html')

@app.route('/predict', methods=['POST'])

def predict():

try:

# 获取上传的图片

file = request.files['image']

if not file:

return jsonify({'error': '未上传图片'}), 400

# 保存图片

img_path = "uploads/" + file.filename

file.save(img_path)

# 打开并预处理图片

img = Image.open(img_path).convert('RGB')

img_tensor = transform(img).unsqueeze(0)

# 模型预测

with torch.no_grad():

outputs = model(img_tensor)

probabilities = torch.nn.functional.softmax(outputs, dim=1)

top_prob, top_class = probabilities.topk(1, dim=1)

predicted_class = flower_classes[top_class.item()]

confidence = top_prob.item() * 100

# 删除临时图片

os.remove(img_path)

return jsonify({

'prediction': predicted_class,

'confidence': f"{confidence:.2f}%"

})

except Exception as e:

return jsonify({'error': str(e)}), 500

if __name__ == '__main__':

if not os.path.exists('uploads'):

os.makedirs('uploads')

app.run(debug=True)为了配合 Flask 后端,我还编写了一个简单的 HTML 页面:

<!DOCTYPE html>

<html lang="zh-CN">

<head>

<meta charset="UTF-8">

<meta name="viewport" content="width=device-width, initial-scale=1.0">

<title>花卉分类识别</title>

<style>

body {

font-family: Arial, sans-serif;

max-width: 800px;

margin: 0 auto;

padding: 20px;

text-align: center;

}

h1 {

color: #333;

}

.upload-container {

margin: 20px 0;

padding: 30px;

border: 2px dashed #ccc;

border-radius: 10px;

cursor: pointer;

}

.upload-container:hover {

background-color: #f9f9f9;

}

#image-preview {

max-width: 100%;

max-height: 400px;

margin: 20px 0;

border-radius: 5px;

box-shadow: 0 0 10px rgba(0,0,0,0.1);

}

button {

background-color: #4CAF50;

color: white;

padding: 10px 20px;

border: none;

border-radius: 5px;

cursor: pointer;

font-size: 16px;

}

button:hover {

background-color: #45a049;

}

#result {

margin-top: 30px;

padding: 20px;

border-radius: 5px;

background-color: #f5f5f5;

}

</style>

</head>

<body>

<h1>花卉分类识别系统</h1>

<div class="upload-container" id="upload-container">

<p>点击或拖拽图片到这里上传</p>

<input type="file" id="image-upload" accept="image/*" style="display: none;">

</div>

<img id="image-preview" src="" alt="图片预览" style="display: none;">

<button id="predict-btn" disabled>识别花卉</button>

<div id="result" style="display: none;">

<h3>识别结果</h3>

<p>花卉类别: <span id="prediction">--</span></p>

<p>置信度: <span id="confidence">--</span></p>

</div>

<script>

// 获取DOM元素

const uploadContainer = document.getElementById('upload-container');

const imageUpload = document.getElementById('image-upload');

const imagePreview = document.getElementById('image-preview');

const predictBtn = document.getElementById('predict-btn');

const resultDiv = document.getElementById('result');

const predictionSpan = document.getElementById('prediction');

const confidenceSpan = document.getElementById('confidence');

// 点击上传容器触发文件选择

uploadContainer.addEventListener('click', () => {

imageUpload.click();

});

// 处理文件选择

imageUpload.addEventListener('change', (e) => {

if (e.target.files.length > 0) {

const file = e.target.files[0];

const reader = new FileReader();

reader.onload = (event) => {

imagePreview.src = event.target.result;

imagePreview.style.display = 'block';

predictBtn.disabled = false;

resultDiv.style.display = 'none';

};

reader.readAsDataURL(file);

}

});

// 处理预测按钮点击

predictBtn.addEventListener('click', () => {

const formData = new FormData();

formData.append('image', imageUpload.files[0]);

// 显示加载状态

predictBtn.disabled = true;

predictBtn.textContent = '识别中...';

// 发送请求

fetch('/predict', {

method: 'POST',

body: formData

})

.then(response => response.json())

.then(data => {

// 显示结果

predictionSpan.textContent = data.prediction;

confidenceSpan.textContent = data.confidence;

resultDiv.style.display = 'block';

// 恢复按钮状态

predictBtn.disabled = false;

predictBtn.textContent = '识别花卉';

})

.catch(error => {

console.error('Error:', error);

alert('识别失败,请重试');

predictBtn.disabled = false;

predictBtn.textContent = '识别花卉';

});

});

</script>

</body>

</html>这个 Web 应用虽然简单,但功能已经很完整了。用户可以上传花卉图片,然后应用会调用我训练的模型进行分类,并显示识别结果和置信度。我把应用部署到了本地服务器上,邀请了几个同学来测试,效果还不错,大家都觉得挺有意思的。

六、蓝耘 MaaS 平台与深度学习结合的优势:真香!

在使用蓝耘 MaaS 平台进行深度学习开发的过程中,我深刻体会到了它的优势。

首先,蓝耘 MaaS 平台提供了丰富的预训练模型,这些模型在大规模数据集上训练过,性能非常出色。对于我们学生来说,不需要具备很强的深度学习背景,也能快速使用这些模型开发出实用的应用,大大降低了学习和开发的门槛。

其次,平台的 API 设计非常友好,文档也很详细,使用起来非常方便。我在调用 API 的过程中,几乎没有遇到什么障碍,按照文档上的示例代码,很快就能上手。

另外,蓝耘 MaaS 平台还提供了模型训练和部署的功能。虽然我主要使用了预训练模型,但也尝试了一下平台的模型训练功能,发现它非常灵活,可以根据自己的需求定制模型。而且,平台的部署功能也很强大,可以轻松地将训练好的模型部署到生产环境中。

总的来说,蓝耘 MaaS 平台与深度学习的结合,让开发变得更加简单、高效,让我们这些学生也能轻松玩转深度学习,开发出有价值的应用。

七、遇到的问题与解决方案:踩过的坑都是成长

在使用蓝耘 MaaS 平台和进行深度学习开发的过程中,我也遇到了很多问题,但正是这些问题让我不断成长。

比如,我在调用蓝耘 MaaS 平台的 API 时,一开始总是遇到鉴权失败的问题。我检查了 API 密钥,确认没有写错,但就是无法通过鉴权。后来我仔细阅读文档,发现请求头中的

Authorization字段格式有问题,正确的格式应该是Bearer后面跟上 API 密钥,而且中间要有一个空格。我修改了代码后,问题就解决了。

还有,我在训练模型时,遇到了过拟合的问题。模型在训练集上的准确率很高,但在测试集上的准确率却很低。我分析了原因,发现可能是模型复杂度太高,或者训练数据太少。于是,我采取了一些措施,比如减少模型的层数,增加训练数据,使用数据增强技术等,最终解决了过拟合的问题。

另外,我在部署 Web 应用时,遇到了跨域请求的问题。浏览器出于安全考虑,会限制跨域请求,导致我的前端页面无法正常调用后端 API。我通过在 Flask 后端设置 CORS(跨域资源共享)头信息,解决了这个问题:

from flask_cors import CORS

app = Flask(__name__)

CORS(app) # 启用CORS这些问题虽然让我头疼了一阵子,但也让我学到了很多知识,提高了自己的解决问题的能力。

额外补充: 蓝耘送千万Token免费额度全解析

第一次看到蓝耘官网写着"新用户注册即送1000万Token"时,我的反应和所有穷学生一样:"这怕不是钓鱼的吧?"但实测后发现,人家是真送!不过要注意几个细节:

Token计算规则:

1个汉字 ≈ 1.2 Token

1个英文单词 ≈ 1 Token

API调用额外消耗5%系统Token

我专门做了个测试表格:

| 操作类型 | 内容长度 | 消耗Token | 备注 |

|---|---|---|---|

| 文本分类 | 50字中文 | 60 Token | 含系统开销 |

| 知识库查询 | 200字问题 | 250 Token | 含向量检索 |

| 智能对话 | 10轮对话 | 约800 Token | 上下文越长消耗越多 |

1000万Token能用多久?

拿我的课程项目做例子:

项目名称:校园问答机器人

日均访问量:约200次

平均每次消耗:350 Token

月消耗量:200 × 350 × 30 = 2,100,000 Token

也就是说,1000万Token足够支撑这个项目运行近5个月!这对于课程设计完全够用了。

省Token的实战技巧

文本压缩大法

def compress_text(text, max_ratio=0.7):

"""去除冗余字符保留核心信息"""

import re

# 移除重复标点

text = re.sub(r'([!?,.])\1+', r'\1', text)

# 简化表达

replacements = {

'是否可以': '能否',

'比如说': '如',

'一般情况下': '通常'

}

for k, v in replacements.items():

text = text.replace(k, v)

return text[:int(len(text)*max_ratio)]

# 测试用例

original = "您好,我想问一下,比如说一般情况下,这个设备是否可以连续工作72小时?"

compressed = compress_text(original)

print(f"原长度:{len(original)} 压缩后:{len(compressed)}")

# 输出:原长度:39 压缩后:27缓存策略优化

from functools import lru_cache

import hashlib

def get_text_hash(text):

return hashlib.md5(text.encode()).hexdigest()

class TokenSaver:

def __init__(self):

self.cache = {}

@lru_cache(maxsize=1000)

def process(self, text):

text_hash = get_text_hash(text)

if text_hash in self.cache:

return self.cache[text_hash]

# 模拟API调用

result = len(text) * 1.2 # 模拟Token计算

self.cache[text_hash] = result

return result

# 使用示例

saver = TokenSaver()

print(saver.process("相同的文本")) # 首次调用会计费

print(saver.process("相同的文本")) # 第二次直接从缓存读取批量处理技巧

import numpy as np

def batch_process(texts, batch_size=10):

"""批量处理节省系统Token开销"""

results = []

for i in range(0, len(texts), batch_size):

batch = texts[i:i+batch_size]

# 这里应该是实际调用API的代码

batch_results = [len(t)*1.2 for t in batch] # 模拟处理

results.extend(batch_results)

return results

# 测试数据

texts = ["问题"+str(i) for i in range(100)]

print(f"单次处理总Token:{sum(len(t)*1.2*1.05 for t in texts):.1f}")

print(f"批量处理总Token:{sum(batch_process(texts))*1.05:.1f}")真实课程项目Token消耗报表

我在"智能校园助手"项目中详细记录了Token使用情况:

第1周:

- 知识库构建:1,245,000 Token

- 模型微调:2,800,000 Token

- 日常测试:357,200 Token

第2周:

- 用户问答服务:843,600 Token

- 日志分析:621,000 Token

优化后第3周:

- 启用缓存后问答服务:402,100 Token(节省52%!)

- 批量处理知识更新:287,500 Token八、总结与展望:深度学习的未来充满无限可能

通过这次使用蓝耘 MaaS 平台进行深度学习开发的经历,我收获了很多。我不仅学会了如何使用深度学习技术解决实际问题,还对蓝耘 MaaS 平台有了更深入的了解。

深度学习是一个非常有前途的领域,它已经在图像识别、自然语言处理、语音识别等多个领域取得了巨大的成功。随着技术的不断发展,深度学习的应用前景也越来越广阔。

蓝耘 MaaS 平台为我们提供了一个非常好的学习和开发平台,它让深度学习变得更加简单、高效。我相信,在未来,会有更多的人使用蓝耘 MaaS 平台进行深度学习开发,创造出更多有价值的应用。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)