统一视角看待RL从LLM到MLLM再到Agentic AI空间探索中的演进与挑战

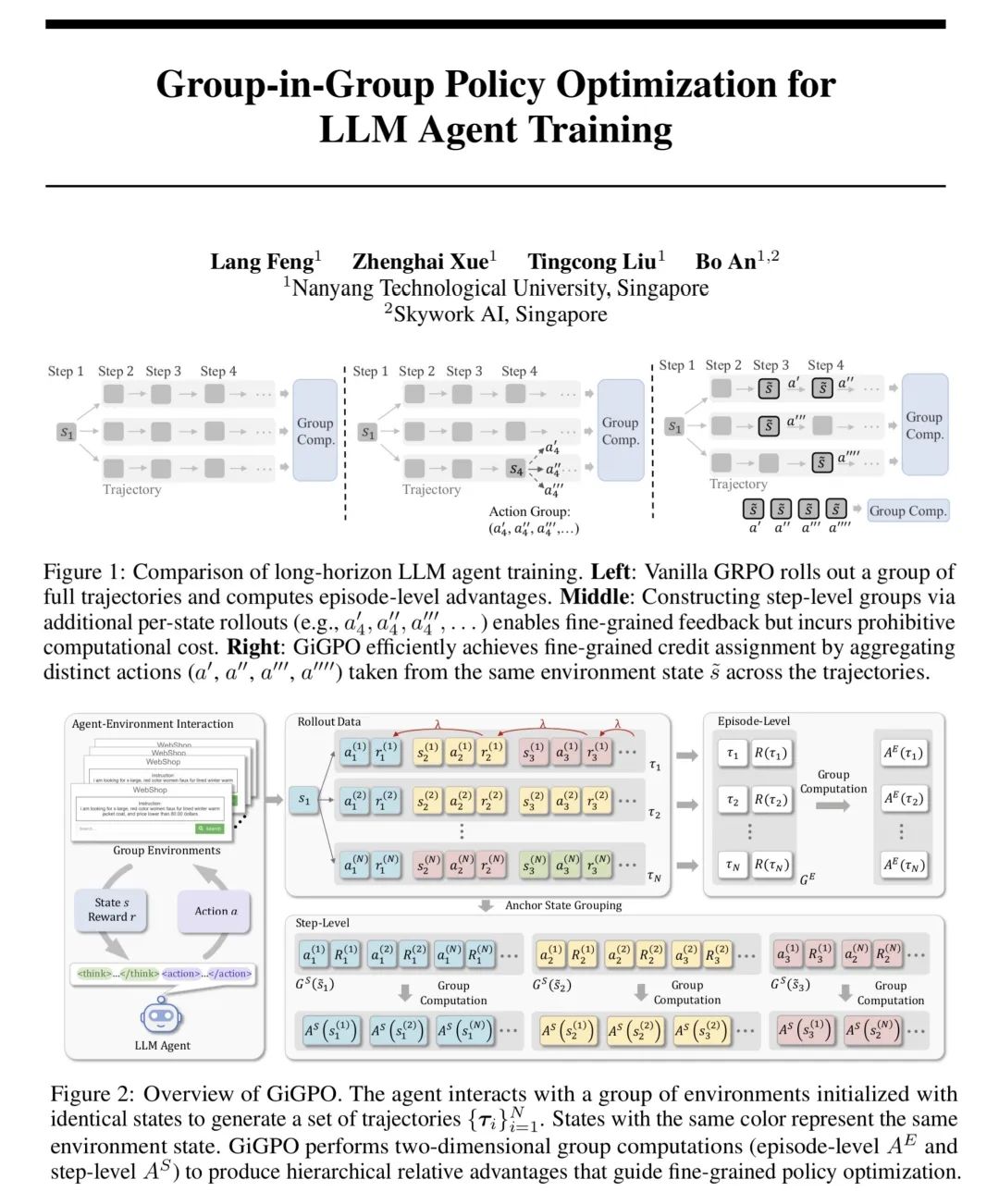

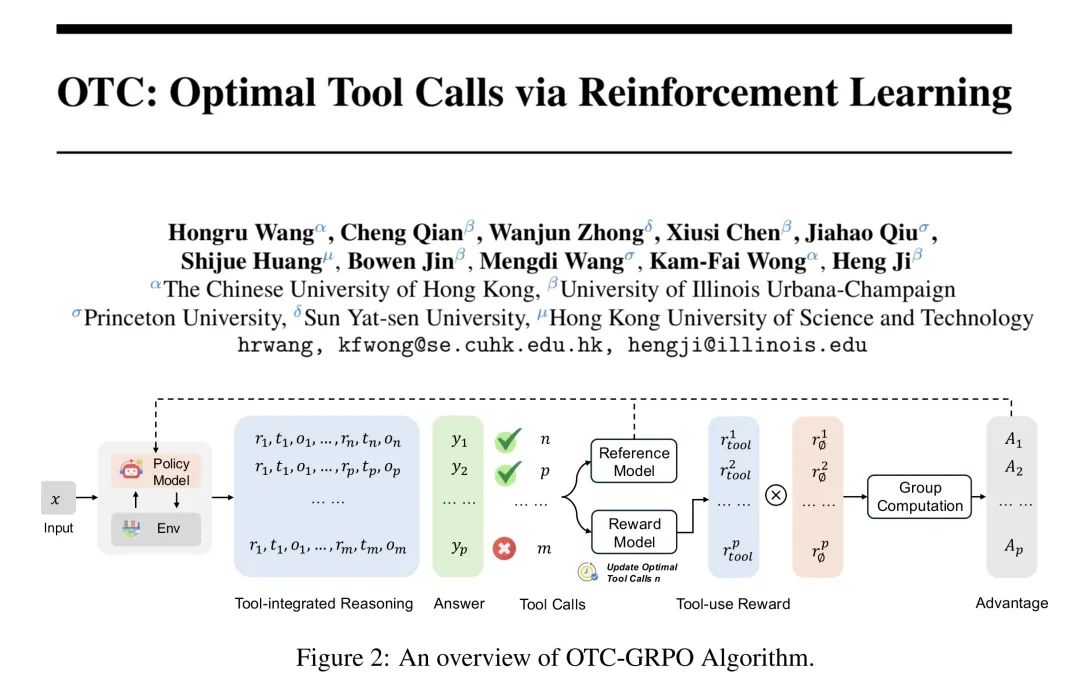

在Agent RL领域,也有诸多RL框架、奖励建模、优化策略的创新研究,如近期提出的两级分层优势估计策略GiGPO,以Optimal Tool Calls为目标的OTC-POs等...这里不再赘述,感兴趣的大伙可以关注更多这方面领域的最新研究进展,与VLM一样,相信不同领域下的A(Agentic)LM也有着更多样化、差异化的「CoT」Patterns。这种评估范式隐含着一个值得商榷的前提假设:视觉

统一视角看待RL从LLM到MLLM再到Agentic AI空间探索中的演进与挑战

原创 吕明 塔罗烩 2025年06月03日 09:52 北京

众所周知,强化学习·RL范式尝试为LLMs应用于广泛的Agentic AI甚至构建AGI打开了一扇“深度推理”的大门,而RL是否是唯一且work的一扇门,先按下不表(不作为今天跟大家唠的重点),至少目前看来,随着o1/o3/r1/qwq..等RLMs的快速发展,正推动着各种agent在不同领域的价值与作用,包括对各种形式化框架下的复杂推理patterns的尝试与构建:如打开编程领域的vibe coding、融入数学形式化证明llm→lean4或内化为AlphaEvolve、通用领域下的Deep Rearch & Research、Manus等诸多场景,可以说这大部分得益于RL对LLMs进一步的post RL所带来的跨领域复杂推理与规划能力增强。

然而当下RLMs毕竟是通过所构建的多种静态tokenize符号化体系对所属state→action空间step by step exploration&exploitation而来,对于复杂跨领域任务采用小样本post RL带来的进一步泛化提升来说存在着不小的算法和工程上的挑战甚至瓶颈,因此未来在更大规模和广泛Multimodal或Agentic AI任务场景下还有着更多进一步的可alignment和scaling空间,这种潜在的空间可能包括从头pre RL过程中所涉及的复杂多模数据统一强化联合表征、更多tokenize符号化形式空间体系融合以及所映射联动的更广泛的state→action认知流形空间分布…我想这也是建立从统一视角(第一性原理)来看待RL从LLM到MLLM再到Agentic AI的核心关键,即,RL对于不同模态数据、不同符号形式化体系,映射到不同认知推理流形分布所呈现形式各异的long reasoning pattern的统一,而其中的“PATTERN”则是关键!在PATTERN中存在并充斥着各种纷杂的模态数据的分布,各种逻辑严密的形式化体系以及各种state→action可探索与利用空间,它们都是“PATTERN”。这听起来似乎有点绕且抽象,也许需要更多的实例列举会更具象,好在于现在已经有了很多前人的研究与探索了:

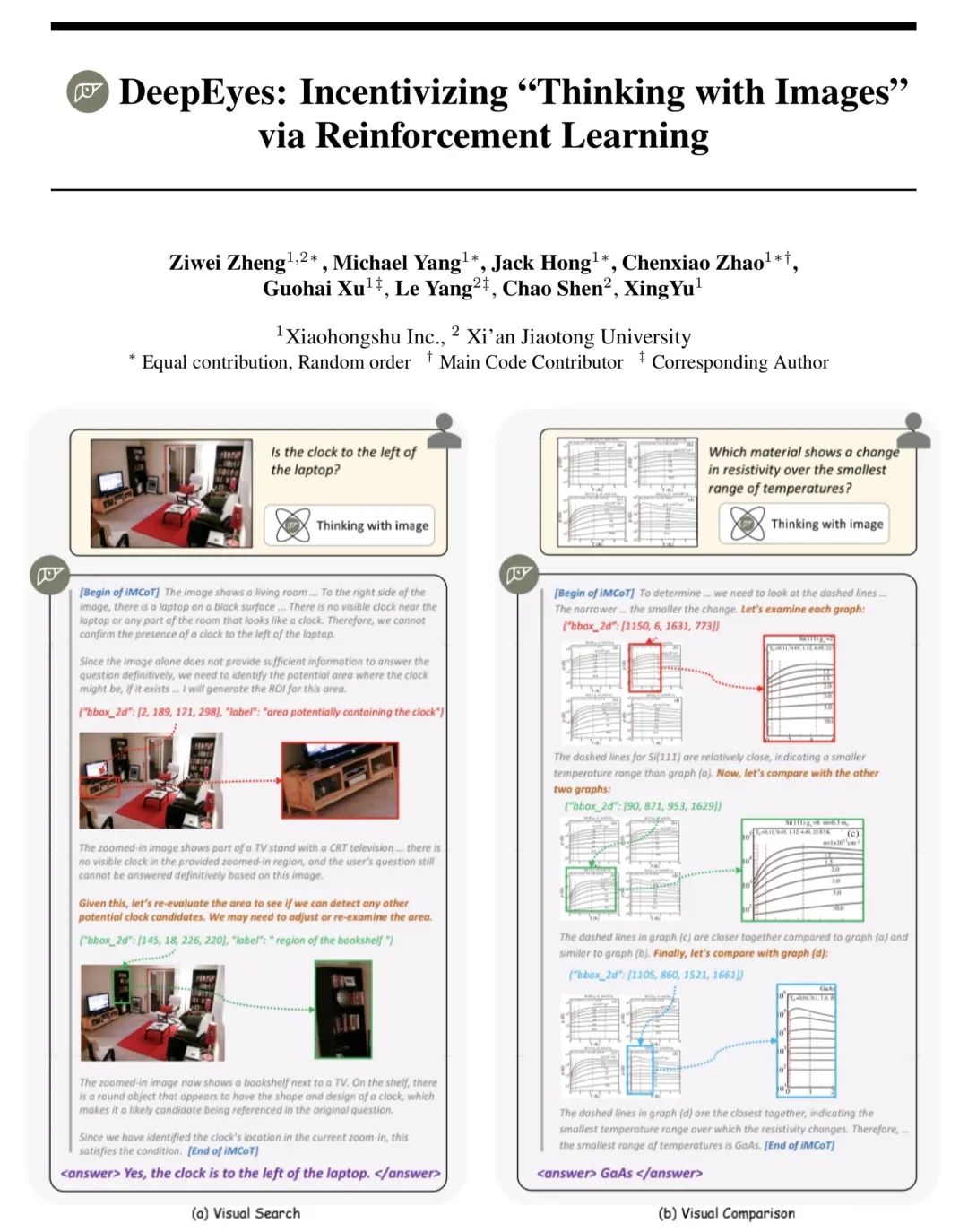

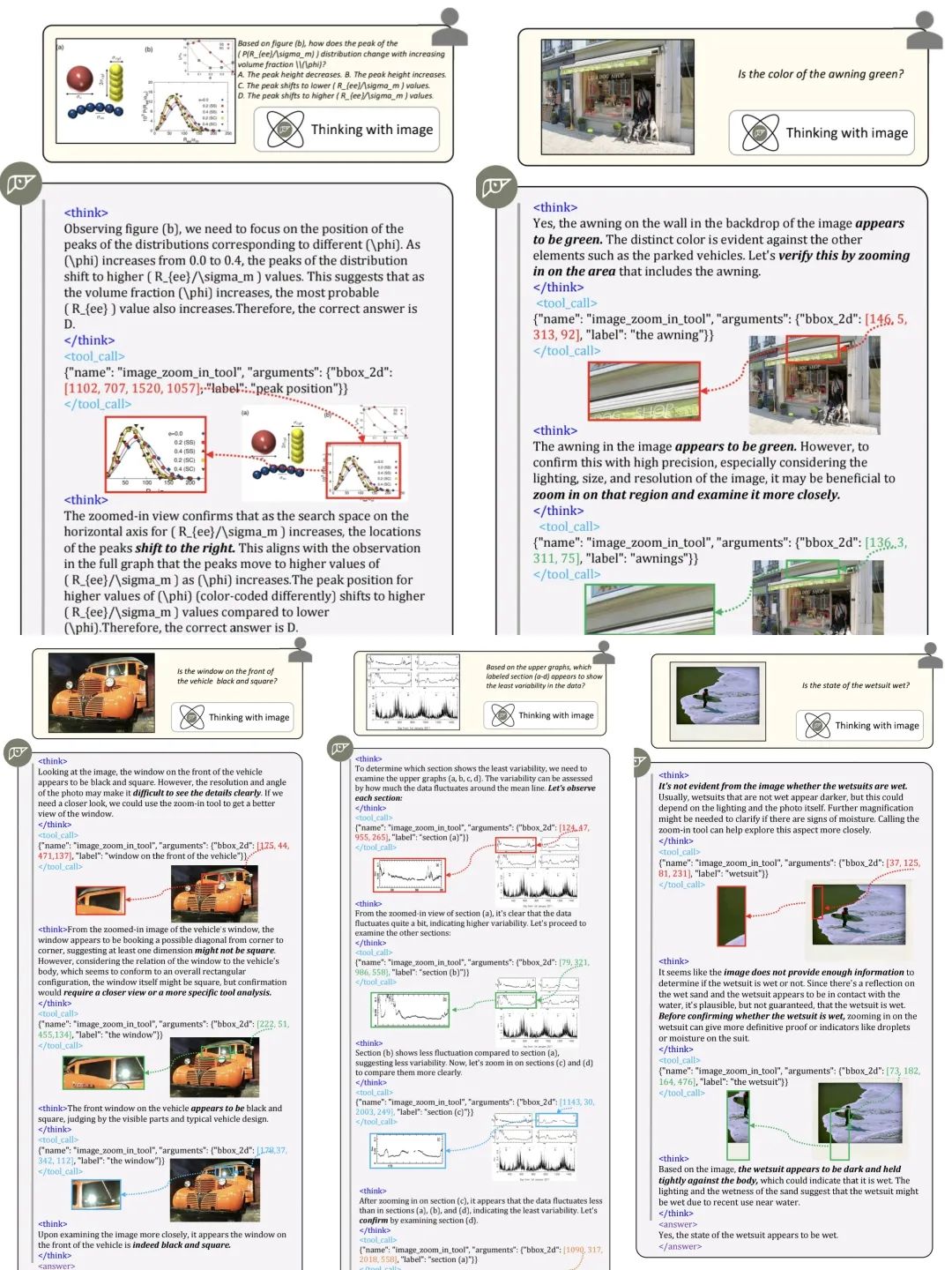

如在CV跨模态领域不久前正式release的DeepEyes,探索了基于CV long reasoning pattern,从而建立了跨模态下的边看图边思考任务的RL框架。

随着用于deepseek R1等RL训练框架的提出,研究者们开始尝试将文本领域的强化学习范式迁移到视觉模态,试图通过RL训练视觉语言模型(VLM)的思维链(CoT)机制来复现类似文本领域的"顿悟时刻"(Aha moment)。但值得注意的是,当前评估仍聚焦于文本推理的典型特征:如是否出现"wait"、"alternatively"等自我反思词汇,或响应长度增加是否伴随基准测试准确率提升。这种评估范式隐含着一个值得商榷的前提假设:视觉推理应与文本推理共享相同的认知模式,那么,有没有一种可能,视觉推理的思考模式就应该是不同于文本推理的呢?

一些认知神经科学的研究表明,人类处理视觉问题时展现出截然不同的认知特性:

1)动态注意机制 - 视觉理解并非单次编码后的静态推理,而是注视点移动与认知加工持续交互的过程;

2)视觉思维(Visual thinking)的存在 - 部分个体天生依赖视觉表征进行抽象思考,其视觉神经表征与语言思维也许存在本质差异,如对欧式几何空间下的特征深度再加工与再变换。相较之下,现有VLM的视觉处理存在显著局限:视觉编码器仅在前端执行一次性特征提取,后续推理完全在文本模态中进行,这种设计本质上将视觉信息压缩为静态上下文,导致视觉认知的关键特征(如时空动态性、并行处理等)在编码过程中产生模态特异性损失(modality-specific information loss);

一个很明显的感性证据是:人类在面对一个视觉类问题时,并不是看一遍图之后就在脑子里一通思考,而是会边看边想;甚至也许有部分人是天生具备visual thinking的能力,他们大部分的思考都是用以图像视觉的方式来展开的,相比之下,VLM的图片只有在一开始输入给模型时由vision encoder一次性变成image embedding,之后图片就变成了纯静态的context,这种纯文本的思维方式在视觉domain是“有损”的。

记得2年前与一位临床病理科主任的交谈碰撞中在谈到传统AI辅助阅片的场景中,尤其对于一张复杂的病理影像需要进行反复阅读查验即visual thinking后做出判断,相信在这一过程中,医生的大脑在一次次针对视觉信息的特征再加工变换与某种符号化推理相结合的反复互增强之后,才最终形成的相对个体高特异度的个性化诊断结果。

在与这位病理科主任的探讨交流中,也深刻感受到了在一张病理学影像中不同局部、尺度下的视觉感受野存在着在时空特性上的更多特征组合,甚至一些更多潜在的特征还远未被我们人类所挖掘或识别,这也进一步激发了这位临床工作者对将AI工具应用于临床的信心与期待,也许未来随着Visual RL技术在机制范式与奖励稀疏性甚至是在CV基础模型在通用泛化与「视觉推理」泛化能力的进一步提升后,将会像LLMs那样更好的应用RL及相关RFT、distill等技术。ps,也许diffusion又会大放异彩。

回到DeepEyes这篇论文,其灵感到方法采用的是「边看边思考·Thinking With Images」的模式,实现了将符号化推理能力step by step嵌入并增强到视觉领域,从而可实现以构建Agent的方式参照不同下游任务类型的CV分类、分型的以任务为导向的深度精细化特征挖掘「这里并没有沿着语言模型从强大基础模型LLM(V3)强化到推理语言模型RLM(R1)的pre-training VLM→RL RVLM的技术路线,毕竟pre-training一个类似V3的VLM在真实世界视觉领域在数据和技术上感觉还未成熟」。如定义agent框架,给模型一个图像工具,让模型能够通过输出grounding坐标的形式来调用tool,从而按照自己的意志来取观察图片中感兴趣的部分,也是computer use的一种(如下图):

而对于来自Google DeepMind AlphaGeometry系列模型来说,也许通过对数据与技术方法的进一步探索,未来可以基于此更好的构建领域下的pureVLM或跨代数与几何形式化互增强的推理证明Patterns,甚至将Reasoning从欧式空间延展至非欧空间,虽然这看似还有不少的工作要去做,不过好消息是我们现在的很多RLM已经明显具备了很强的数学形式化证明泛化与迁移能力。

在Agent RL领域,也有诸多RL框架、奖励建模、优化策略的创新研究,如近期提出的两级分层优势估计策略GiGPO,以Optimal Tool Calls为目标的OTC-POs等...这里不再赘述,感兴趣的大伙可以关注更多这方面领域的最新研究进展,与VLM一样,相信不同领域下的A(Agentic)LM也有着更多样化、差异化的「CoT」Patterns。

那么未来不管是对multimodal下的computer use施展CoT还是对复杂agentic ai下的tool use or function call进一步优化推理与适应动态规划能力,我想都将有很大几率作为未来各AI Lab或初创团队的重点研究方向,而这亦必将推动AGI的进一步演进。

BY 吕明

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献391条内容

已为社区贡献391条内容

所有评论(0)