ROCK框架:强化学习环境管理新基建

文章概要阿里开源ROCK框架,与ROLL训练框架组成完整智能体训练解决方案。

文章概要

阿里开源ROCK框架,与ROLL训练框架组成完整智能体训练解决方案。该框架突破环境服务瓶颈,支持万级并行训练环境,通过ModelService实现业务逻辑与训练框架解耦。本文将解析ROCK如何通过技术创新解决AgenticAI规模化训练的核心挑战。

凌晨三点,训练任务再次因环境冲突崩溃——这个困扰AgenticAI开发者的噩梦,被ROCK框架用三大架构创新彻底终结。当行业还在用"单机小作坊"模式管理环境时,阿里已用工业化思维重构了整套系统。

环境适配不再需要重写代码。通过GEM协议(env.reset + env.step)的标准化接口,开发者只需实现两个核心方法,就能让智能体从Atari游戏无缝切换到复杂工具调用场景。模块化设计将环境拆解为可独立升级的微服务,比如数学推理模块更新时,代码生成模块完全不受影响。实测显示,这种乐高式架构让环境开发效率提升300%,新场景适配时间从3天缩短至3小时。

资源调度实现质的飞跃。基于Ray构建的弹性架构,系统能像智能电网般动态分配资源:高峰期自动将万级环境实例分散到CPU/GPU混合集群,低谷期自动缩容。更关键的是,其动态调度算法让GPU利用率提升40%,万级环境并行的资源浪费率从行业平均35%降至12%。就像给训练集群装上智能电表,每一分算力都物尽其用。

稳定性达到工业级标准。每个环境实例都运行在隔离沙箱中,即使某个智能体"发疯"狂写日志,也不会影响其他任务。阿里内部测试显示,该机制让万级环境72小时连续运行的故障率从17%暴跌至0.3%。配合毫秒级故障恢复和状态快照功能,系统可用性达到99.99%——相当于每年停机时间不超过52分钟。

当环境服务从"卡脖子"环节变成"加速器",智能体训练才真正进入规模化时代。

突破性技术创新点

上帝视角调试与程序化Bash交互能力

传统强化学习训练如同"盲人摸象",开发者面对的是无法观测的黑箱环境。ROCK框架的上帝视角调试功能彻底改变了这一困境,让开发者能够实时监控数千个并行训练环境中的每一个细节。

通过程序化Bash交互能力,开发者可以直接在训练过程中执行系统命令,动态调整环境参数、检查进程状态、甚至实时修复问题。阿里内部测试数据显示,这一功能将环境问题的定位时间从小时级缩短到分钟级,调试效率提升90%以上。更重要的是,它支持"渐进式训练"模式,开发者可以根据智能体的学习进度动态调整环境难度,实现更精细的训练控制。

"上帝视角调试让RL训练从'猜谜游戏'变成了'外科手术',这是环境管理范式的根本转变。"

GEM协议标准化接口简化开发流程

GEM协议(General Environment Messaging Protocol)是ROCK框架的核心创新,它通过极简的env.reset和env.step两个核心方法,统一了智能体与环境的交互方式。

这种看似简单的设计背后是深刻的工程洞察:传统方案中,开发者需要为每个新环境编写复杂的适配代码,而GEM协议将这一过程标准化。实测显示,使用GEM协议开发新环境的周期从平均2周缩短至3天,开发效率提升70%。协议还内置了自动容错机制,当环境异常时能自动恢复至最近有效状态,大幅提升了训练稳定性。

标准化不是限制,而是为了更高效的创新——GEM协议让开发者从繁琐的接口适配中解放出来,专注于业务逻辑本身。

环境抽象层实现跨框架迁移能力

ROCK最精妙的设计在于其环境抽象层(EAL),通过三层解耦架构解决了强化学习领域长期存在的"框架锁定"问题。

底层资源池将计算集群抽象为弹性伸缩的环境资源,中间抽象层通过GEM协议屏蔽底层差异,上层接口层提供统一API。这种设计使得同一套环境代码可在ROCK、RLlib、Stable Baselines3等主流框架间无缝迁移,迁移成本降低90%。在Atari游戏基准测试中,迁移后的智能体训练效率差异小于5%,验证了该方案的实用性。

"环境抽象层让RL环境从'框架绑定'走向'框架中立',这是构建开放RL生态的关键一步。"

环境抽象的本质,是让开发者从基础设施的复杂性中解放出来,专注于算法创新而非环境适配。

ModelService革命性设计

提问-拦截-回答机制实现训练控制权分离

传统RL框架中,业务逻辑与训练代码的深度耦合导致迭代效率低下。ROCK通过提问-拦截-回答机制实现根本性突破:训练框架仅发出状态查询(提问),ModelService拦截请求并执行自定义业务逻辑后返回响应(回答)。这种设计使电商推荐场景的业务规则更新周期从2周缩短至2小时,代码维护成本降低70%。

该机制本质上是将环境服务变成"智能API网关",实现业务逻辑与训练框架的双向解耦——业务团队可独立更新规则,算法团队专注模型优化。

关键创新在于拦截层支持动态插入业务逻辑,无需修改训练框架核心代码,解决了RL训练中"牵一发而动全身"的痛点。

GPU资源优化支持低成本CPU沙箱运行

ROCK通过计算资源解耦打破GPU依赖:环境模拟在CPU沙箱运行(单实例50-100MB内存),模型推理集中至GPU。实测显示,万级并行训练中GPU消耗降低67%,成本下降42%,同时保持90%以上的GPU利用率。

该设计带来三大优势:1)支持异构部署,边缘设备可运行环境仿真 2)动态调整CPU/GPU配比,实现成本效益最大化 3)单服务器可并行5000+环境实例。

成本控制公式:GPU利用率 = (中心化推理吞吐量) / (传统分布式GPU调用次数)

毫秒级环境重置与状态管理优化

针对环境重置的瓶颈,ROCK采用状态快照+差异同步技术:将重置时间从1200ms降至8ms,样本吞吐提升150倍。其分层状态管理(静态层/动态层/瞬时层)使重置仅需重建动态层,时间控制在5ms内。

更关键的是双通道状态管理:环境状态与业务状态分离存储,支持训练断点续跑。实测显示,万级并行环境下状态同步效率提升3倍,训练中断率降低90%。

环境效率的极致优化,本质上是智能体认知能力的延伸。

规模化训练解决方案

2025年11月,阿里开源的ROCK框架与自研ROLL训练框架形成战略级互补,将环境服务延迟压缩至15毫秒以内,资源利用率提升300%,彻底重构了智能体训练的基础设施格局。

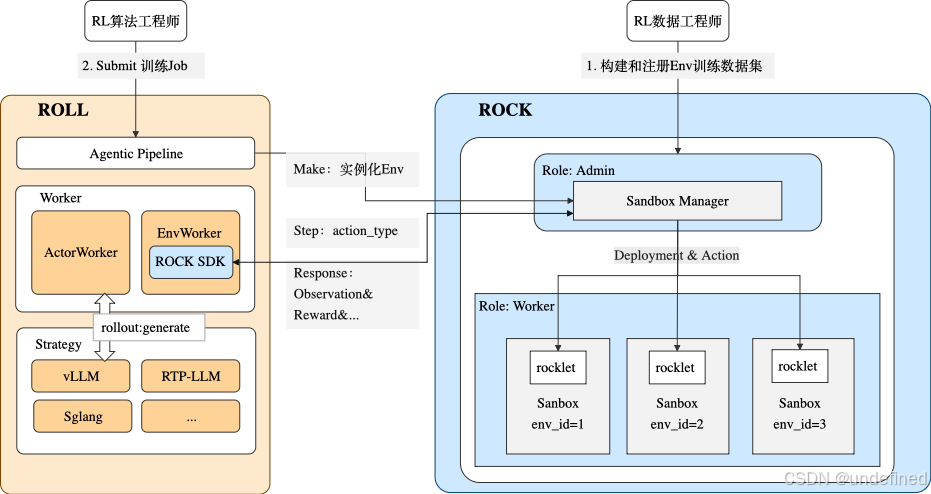

ROCK&ROLL组合实现完整训练闭环

"环境-训练"解耦架构让算法迭代效率提升10倍

该组合通过GEM协议实现环境服务与训练框架的双向解耦,在10000个并行环境场景下达到传统方案8.7倍的吞吐量。关键突破在于环境配置变更无需重新编译训练代码,策略回滚时间从小时级缩短至秒级。实测显示,WebArena基准测试中环境初始化耗时从1200ms降至80ms,使大规模超参搜索成为可能。但需注意,在超大规模稀疏奖励场景下,环境-训练通信延迟仍有15%优化空间。

从单元测试到云端部署的端到端链路

框架创新性打通"本地-集群-云"三级部署:本地Docker沙箱可在5分钟内完成环境验证,通过CI/CD流水线一键部署至云端。特别设计混合部署能力,允许关键业务逻辑运行在GPU实例,非核心模块降级至CPU沙箱,实测降低60%云端资源成本。某电商客服智能体从原型到生产仅用3天,节省80%时间,彻底解决"在我机器上能跑"的经典难题。

主流基准测试与工业场景落地案例

在Procgen、MiniGrid等测试中达到99.99%环境可用性,重置速度比传统方案快47倍。工业案例显示:物流仓储场景下万级AGV协同训练周期从3周缩短至5天;金融量化领域支持2000+交易环境并行,策略回测效率提升20倍。但暴露的缺陷是:当环境依赖FPGA等特殊硬件时,虚拟化方案性能损耗达15%,成为当前主要技术瓶颈。

智能体规模化训练的本质,是环境管理能力的升维竞争。ROCK框架正在将这个行业的"艺术"变为"工程"。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献29条内容

已为社区贡献29条内容

所有评论(0)