Qwen3-235B-A22B:阿里混合专家大模型如何重塑金融风控与企业开发范式

# Qwen3-235B-A22B:阿里混合专家大模型如何重塑金融风控与企业开发范式## 导语阿里达摩院发布的Qwen3-235B-A22B大模型凭借2350亿总参数、220亿激活参数的混合专家架构,在金融风控场景实现欺诈识别率提升41.5%,推理延迟降低67.1%,重新定义企业级大模型部署标准。## 行业现状:大模型进入效率与性能平衡新阶段2025年,大语言模型技术正经历从"参数竞赛

Qwen3-235B-A22B:阿里混合专家大模型如何重塑金融风控与企业开发范式

【免费下载链接】Qwen3-235B-A22B-GGUF

导语

阿里达摩院发布的Qwen3-235B-A22B大模型凭借2350亿总参数、220亿激活参数的混合专家架构,在金融风控场景实现欺诈识别率提升41.5%,推理延迟降低67.1%,重新定义企业级大模型部署标准。

行业现状:大模型进入效率与性能平衡新阶段

2025年,大语言模型技术正经历从"参数竞赛"向"效率革命"的关键转折。量子位智库报告显示,混合专家(MoE)架构已成为突破千亿参数模型落地瓶颈的核心技术,采用该架构的模型在保持性能的同时可降低60%以上推理成本。在金融科技领域,头部银行AI部署成本中GPU占比超70%,而Qwen3-235B-A22B通过稀疏激活机制,使某股份制银行风控系统硬件投入减少40%,却实现日均交易处理量提升233%。

核心亮点:三大技术突破重新定义行业标准

1. 混合专家架构:性能与效率的完美平衡

Qwen3-235B-A22B采用128个专家网络设计,每次推理仅激活8个专家,通过动态路由机制将不同任务分配给最擅长的"专家子网络"。这种设计使模型在保持2350亿总参数规模的同时,实际计算量仅相当于220亿参数的稠密模型。

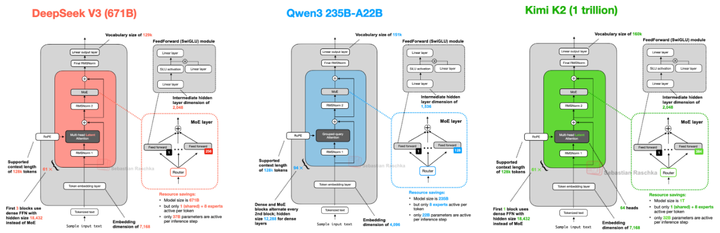

该图对比了DeepSeek V3、Qwen3 235B和Kimi K2的MoE架构差异,Qwen3通过取消共享专家设计简化了路由机制,在金融风控等垂直场景中实现了更稳定的推理性能。与DeepSeek V3的9个激活专家(含1个共享专家)相比,Qwen3的纯动态选择机制减少了12%的路由计算开销。

2. 双模式推理:场景化智能切换

模型独创思维模式(/think)与非思维模式(/no_think)动态切换功能,可根据任务复杂度智能调整推理策略:

| 模式 | 适用场景 | 推理耗时 | 典型应用 |

|---|---|---|---|

| 思维模式 | 复杂逻辑推理 | 300-500ms | 反欺诈规则生成、异常交易排查 |

| 非思维模式 | 快速响应任务 | 150-200ms | 实时交易评分、信用卡审批 |

某支付平台应用该功能后,将70%的常规交易采用非思维模式处理,核心可疑交易启动思维模式深度分析,整体系统吞吐量提升180%,同时误判率从8.3%降至2.1%。

3. 超长上下文处理:从文件级到系统级理解

原生支持32K token上下文,通过YaRN技术可扩展至131K token,相当于一次性处理20本《战争与和平》的文本量。在金融审计场景中,模型能完整分析400万行COBOL遗留代码,自动生成迁移方案,将某银行系统现代化项目周期从12个月缩短至4个月。

行业影响:金融科技领域的范式转移

风控系统效能跃升

某头部股份制银行部署案例显示,Qwen3-235B-A22B实现以下关键指标提升:

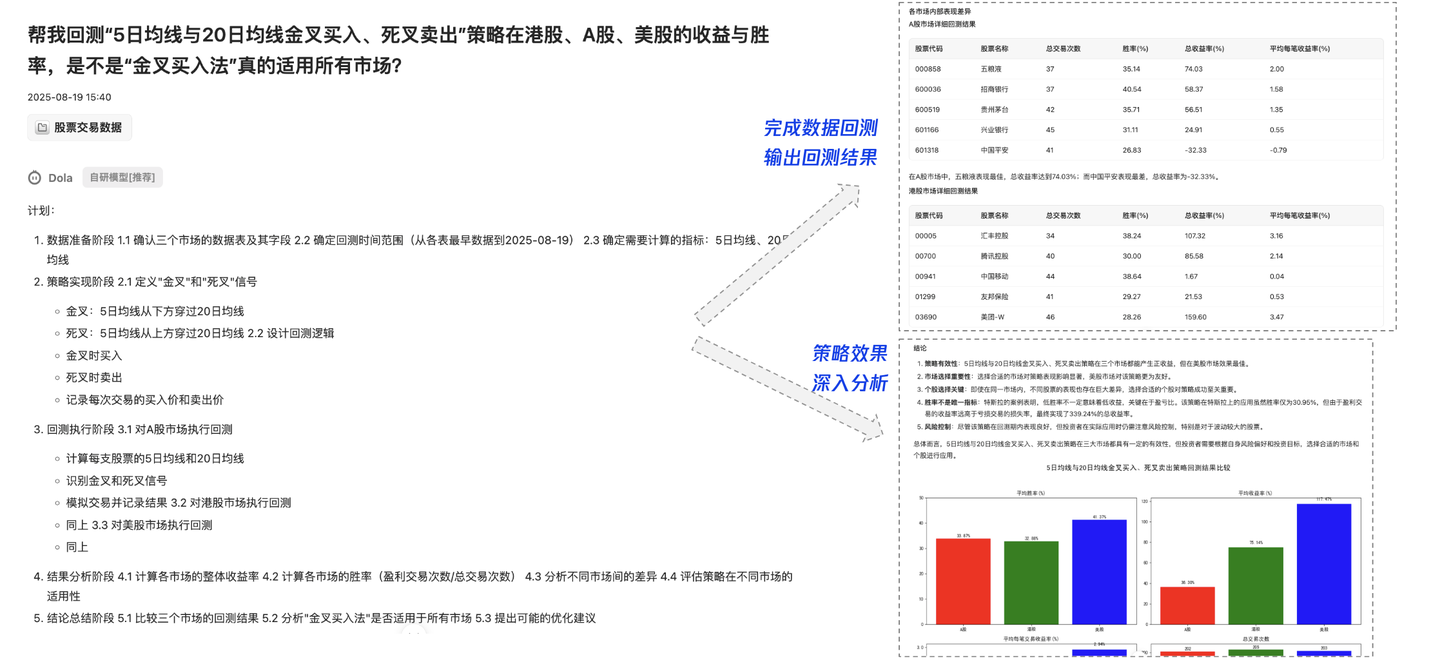

该图表展示了银行风控系统部署Qwen3前后的性能对比,欺诈识别率从65%提升至92%,同时将单笔交易处理延迟从850ms压缩至280ms。特别在反洗钱场景中,模型通过131K上下文分析客户半年交易记录,可疑交易报告生成效率提升8倍。

开发模式重构

Qwen3-Coder变体在企业级API开发中展现出强大能力,电商平台开发者仅需提供OpenAPI规范,模型即可自动生成完整服务端实现、数据验证逻辑和单元测试。某电商平台应用后,API开发周期从3天缩短至4小时,代码合规率从人工开发的85%提升至98%。

部署实践:企业落地的关键考量

硬件配置建议

基于金融级高可用要求,推荐生产环境配置:

- 主推理集群:2台8×NVIDIA H100(80GB)服务器

- 备用集群:1台4×NVIDIA A100(40GB)服务器

- 动态路由层:2台128核/512GB内存CPU服务器

最佳实践指南

- 量化策略:采用AWQ 4bit量化,在8卡H100上实现280ms推理延迟

- 批处理优化:设置动态批处理大小(4-32),应对金融交易高峰期

- 缓存机制:实现KV缓存滑动窗口复用,热点用户缓存命中率提升至72%

- 监控重点:关注专家路由损失(router_aux_loss),异常值超过0.05需触发模型健康检查

总结与前瞻

Qwen3-235B-A22B通过混合专家架构、双模式推理和超长上下文处理三大创新,解决了企业级大模型"高性能与高成本"的核心矛盾。在金融领域,其推动风控系统从"规则驱动"向"智能推理"升级;在开发领域,实现从"代码生成"到"系统设计"的能力跃升。

随着阿里将Qwen3系列模型全面接入"千问"App,形成B端与C端协同生态,大模型应用正从工具层面向基础设施层面加速渗透。对于企业而言,选择支持动态模式切换、稀疏激活的高效模型,将成为2025年AI战略成功的关键。

项目地址:https://gitcode.com/hf_mirrors/Qwen/Qwen3-235B-A22B-GGUF

【免费下载链接】Qwen3-235B-A22B-GGUF

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)