Meta Llama3大模型本地部署指南

【代码】Meta Llama3大模型本地部署指南。

·

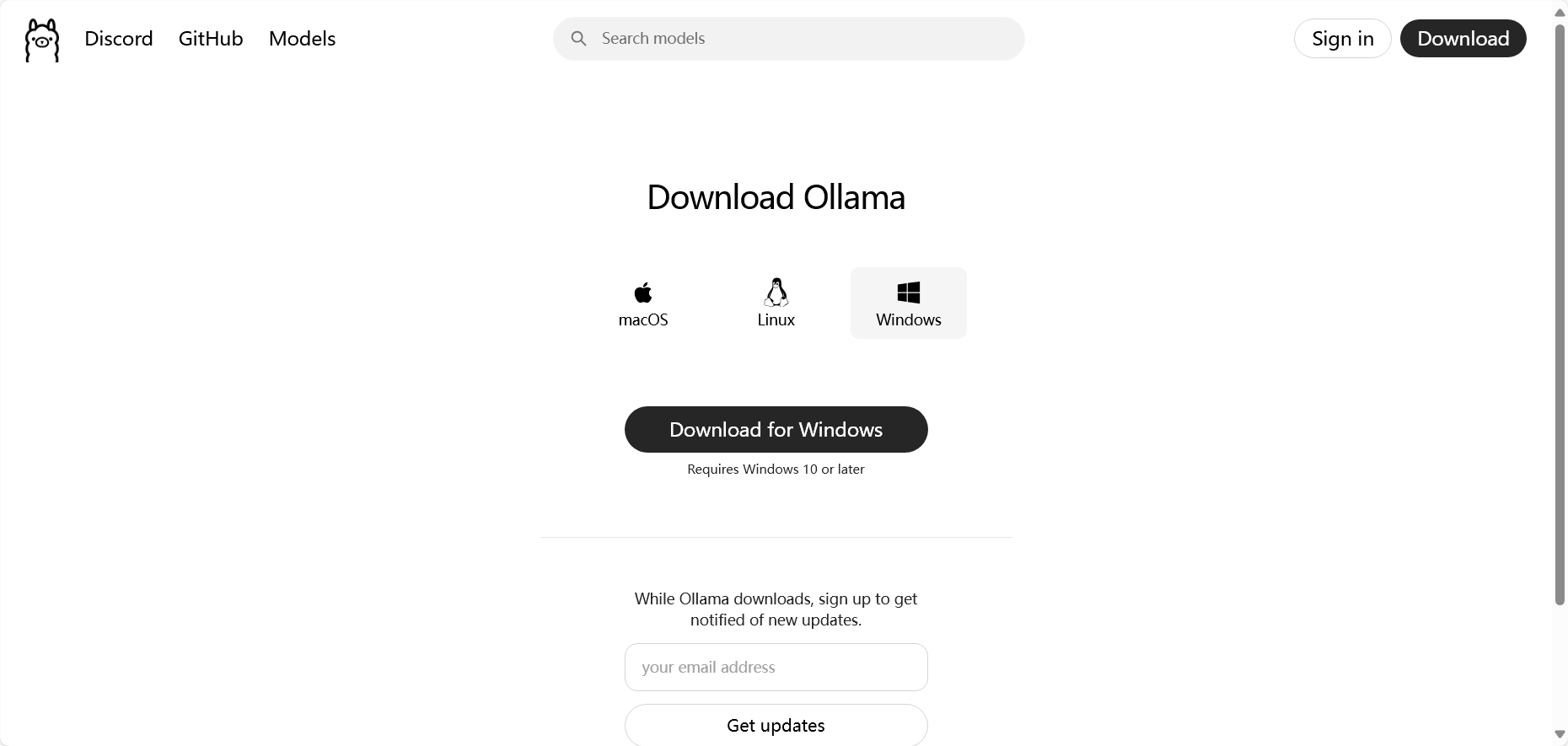

- 下载 Ollama

ollama下载地址

由于网络问题 下载慢的,可以手动下载:

ollama-linux-amd64.tgz

- 部署

# 解压

tar -xvzf ollama-linux-amd64.tgz

sudo mv ollama /usr/local/bin/

sudo chmod +x /usr/local/bin/ollama

ollama serve

# 下载大模型

ollama run llama2

- 注意点

模型对内存要求较高:不低于7.5 GiB

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)