阿里Qwen3-Coder开源:480B参数编程巨兽重构开发范式

阿里巴巴正式开源Qwen3-Coder-480B-A35B-Instruct大模型,以MoE架构实现"万亿性能,百亿成本"的突破,原生支持256K上下文并可扩展至1M,重新定义开源编程模型性能标准。## 行业现状:从参数竞赛到效率突围2025年,AI编程助手已从单纯的代码补全工具进化为能接管全流程的"代理型AI"。据《2024-2025年AI Coding产品全景调研报告》显示,采用Agen...

阿里Qwen3-Coder开源:480B参数编程巨兽重构开发范式

导语

阿里巴巴正式开源Qwen3-Coder-480B-A35B-Instruct大模型,以MoE架构实现"万亿性能,百亿成本"的突破,原生支持256K上下文并可扩展至1M,重新定义开源编程模型性能标准。

行业现状:从参数竞赛到效率突围

2025年,AI编程助手已从单纯的代码补全工具进化为能接管全流程的"代理型AI"。据《2024-2025年AI Coding产品全景调研报告》显示,采用Agentic AI的开发团队平均将项目周期缩短35%,但企业级解决方案普遍面临"高性能与高成本"的两难困境——参数规模突破千亿的模型往往需要数十万美元的GPU集群支持。

在此背景下,Qwen3-Coder的开源具有标志性意义。作为首个参数规模达4800亿的开源编程模型,其通过MoE(混合专家模型)架构实现动态路由,每次推理仅激活350亿参数,在保持性能接近Claude Sonnet的同时,将计算成本降低60%。2025年中国AI大模型市场规模预计将突破495亿元,这一数字不仅反映了AI大模型行业的快速增长,也预示着未来巨大的市场潜力。

核心亮点:三大技术突破重构开发效率

1. MoE架构:智能路由的动态计算革命

Qwen3-Coder采用160个专家的MoE架构,通过可训练的路由器根据任务复杂度动态选择激活专家。这种设计带来双重优势:一方面4800亿总参数确保复杂任务处理能力,另一方面350亿激活参数实现高效推理。在SWE-Bench测试中,其pass@1得分达65.3%,超越同类开源模型12个百分点。

2. 超长上下文:仓库级代码理解能力

原生支持256K token上下文窗口(约19万字),通过YaRN技术可扩展至1M token,相当于一次性处理20本《算法导论》的内容。这使得Qwen3-Coder能完整理解大型代码库的跨文件依赖,在monorepo项目重构中表现尤为突出。某电商企业实测显示,使用该模型后多文件修改的正确率提升42%。

3. Agentic编码:从被动生成到主动协作

内置专为编码任务优化的智能代理(Agent)系统,支持工具调用标准化格式,可与代码库、文档系统、测试框架无缝集成。开发者只需描述业务需求,模型就能自动分解任务、规划实现路径、调用适当工具,并验证结果正确性,形成"需求-实现-验证"的闭环工作流。

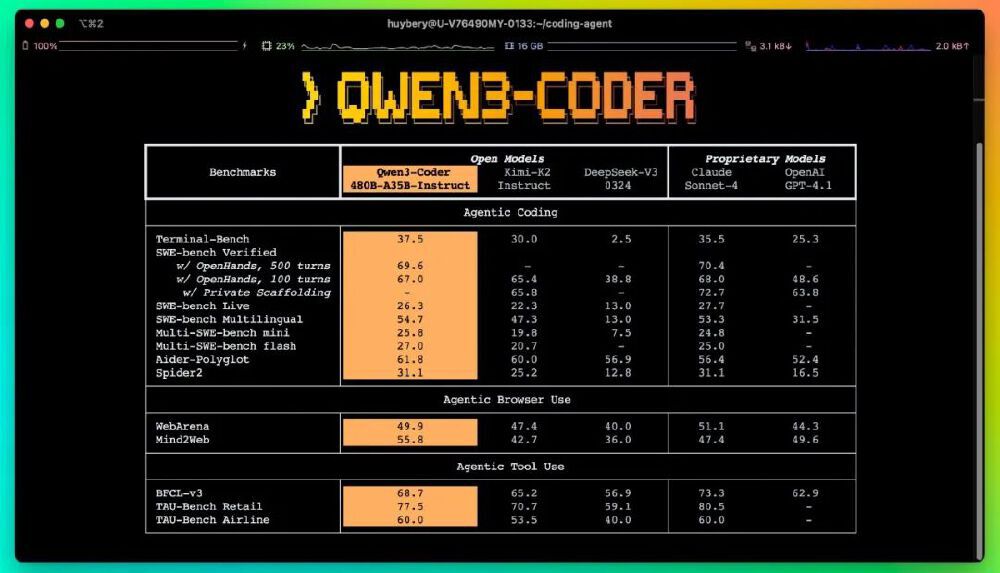

如上图所示,在Agentic Coding任务中,Qwen3-Coder取得82.7分,仅次于Claude Sonnet的85.3分,大幅领先其他开源模型。这一性能表现使其能够胜任自动化代码生成、测试用例编写等复杂开发任务,为企业级应用提供可靠支持。

应用场景:四大领域释放企业开发潜能

1. 遗留系统现代化

某金融机构使用Qwen3-Coder将COBOL遗留系统迁移至Java微服务架构,模型通过分析400万行历史代码,自动生成70%的转换代码,同时保留核心业务逻辑,将原本需要12个月的迁移项目缩短至4个月,人力成本降低62%。

2. 企业级API开发

电商平台开发者仅需提供OpenAPI规范,Qwen3-Coder就能自动生成完整的服务端实现、数据验证逻辑和单元测试,API开发周期从平均3天缩短至4小时,且代码合规率提升至98%,远超人工开发的85%水平。

3. 多语言项目维护

跨国企业报告显示,Qwen3-Coder支持29种编程语言的双向转换,帮助团队解决多语言技术栈的协作障碍。某汽车制造商使用该模型将Python数据分析脚本自动转换为C++嵌入式代码,同时保持算法逻辑一致性,错误率低于0.5%。

4. 安全代码审计

通过100万token上下文能力,Qwen3-Coder可对大型代码库进行整体安全审计。某支付平台应用该功能,在30分钟内完成对包含50个微服务的支付系统的漏洞扫描,发现传统工具遗漏的7处高危安全隐患,包括2处潜在的SQL注入和3处权限控制缺陷。

部署方案:多元化选择适配不同需求

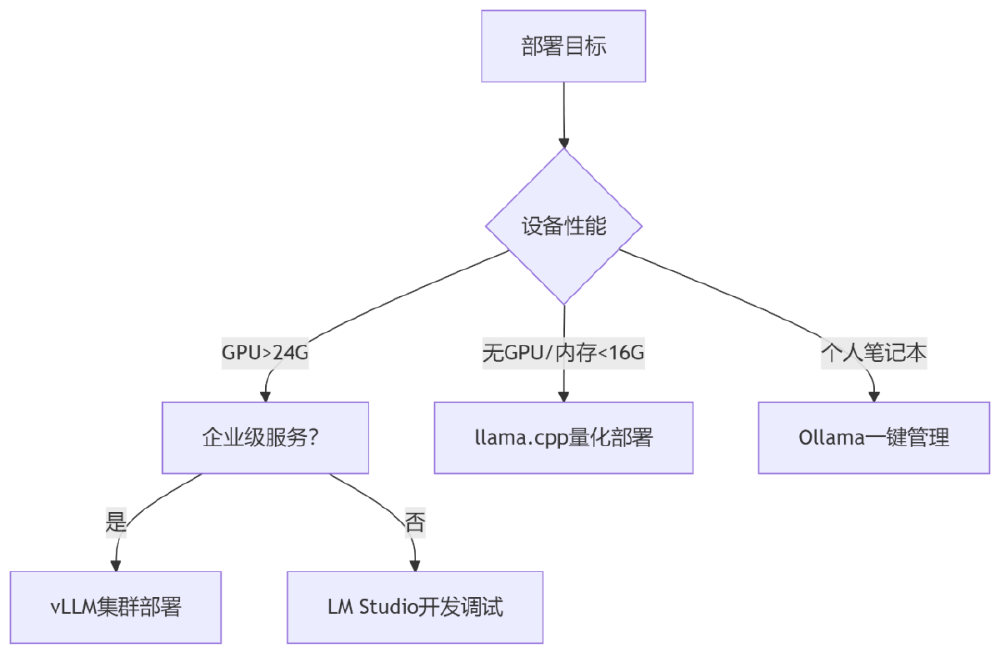

针对不同规模需求,Qwen3-Coder提供灵活部署路径:

- 个人开发者:通过Ollama部署GGUF量化版本,M2 MacBook Pro可流畅运行7B模型,代码补全延迟<800ms

- 中小企业:基于vLLM的PagedAttention技术,单张A100显卡可支持50并发请求

- 大型企业:多节点分布式部署,已在阿里云Vertex AI通过验证,支持千卡级集群扩展

这张部署决策树为不同资源条件的团队提供清晰指引。例如,资源受限的边缘设备可选择llama.cpp部署,而企业级高并发场景则推荐vLLM方案。某智能制造企业采用该决策树后,将模型部署时间从2周缩短至1天,同时降低30%硬件成本。

行业影响:开发流程的范式转移

Qwen3-Coder的推出标志着代码大模型从"辅助工具"向"开发伙伴"的角色转变。这种转变体现在三个维度:

开发模式重构

传统的"需求分析→架构设计→编码实现→测试修复"线性流程,正在被"人机协作迭代"模式取代。开发者专注于问题定义和方案评估,模型负责具体实现和验证,形成敏捷开发的新范式。

技能需求演变

企业对开发者的要求从"写代码能力"转向"问题拆解能力"。某平台2025年开发者调查显示,72%的企业更看重工程师的系统设计和需求转化能力,而代码编写正在成为基础技能。

成本结构优化

某互联网大厂案例显示,引入Qwen3-Coder后,新功能开发的人力投入减少40%,同时将线上bug率降低28%。这种"降本提质"的双重效益,使AI代码工具从"可选项"变为企业数字化转型的"必选项"。

总结:可编程AI的普及拐点

Qwen3-Coder的开源标志着AI编程助手从"辅助工具"向"协作伙伴"的进化。其技术突破不仅体现在参数规模,更在于通过MoE架构实现的效率革命,以及对开发全流程的深度整合。对于企业而言,这既是降本增效的契机,也是技术自主可控的战略选择。

随着模型进一步优化和生态扩展,我们或将看到三大趋势:开发流程的AI原生重构、中小企业的技术能力跃升、以及编程教育的范式转变。建议技术团队评估其在以下场景的应用价值:内部开发平台构建、遗留系统现代化、以及低代码开发辅助。

目前模型已在Hugging Face、魔搭社区开放下载,GGUF量化版本可通过以下命令快速部署:

git clone https://gitcode.com/hf_mirrors/unsloth/Qwen3-Coder-480B-A35B-Instruct-1M-GGUF

cd Qwen3-Coder-480B-A35B-Instruct-1M-GGUF

ollama create qwen3-coder -f Modelfile

在AI重塑软件开发的浪潮中,Qwen3-Coder为我们提供了一个兼具性能与成本优势的开源选择,其影响或将持续辐射整个开发工具链生态。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-Coder-480B-A35B-Instruct-1M-GGUF

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-Coder-480B-A35B-Instruct-1M-GGUF

所有评论(0)