大模型微调之Soft prompts(四)P-Tuning

P-Tuning是一种改进NLU任务的Soft prompts方法,通过可训练的嵌入张量和提示编码器优化提示参数。包含两个版本:P-Tuning v1(2021)使用BiLSTM/MLP编码器,但复杂任务表现欠佳;P-Tuning v2(2023)在每层加入可训练提示,采用多任务学习,性能媲美全参数微调。其核心创新是通过BiLSTM/MLP赋予decoder模型encoder特性,无需改变模型结构

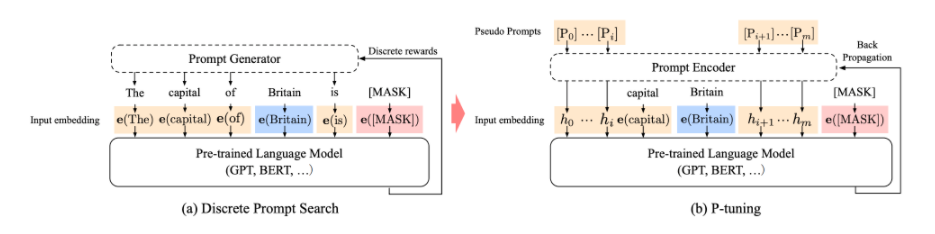

P—Tuning是为了解决NLU任务而设计的Soft prompts方法,P-tuning添加了一个可训练的嵌入张量,这个张量可以被优化以找到更好的提示,并且它使用一个提示编码器(例如BiLSTM+MLP)来优化提示参数。

技术解读

P-tuning有两个版本,P-tuning v1(2021年)和P-tuning v2(2023年)。P-tuning v1通过使用一个prompt encoder(例如BiLSTM+MLP)来优化prompt参数,但这种方法在一些复杂的自然语言理解(NLU)任务上效果不佳,且只在较大的模型规模上表现良好。

为了解决这些问题,P-tuning v2被提出。P-tuning v2在v1的基础上进行了改进,它不仅在输入层,而且在模型的每一层都加入了可训练的连续提示,这样可以更好地适应各种任务,包括复杂的NLU任务。P-tuning v2通过多任务学习策略和深度提示编码器来优化提示参数,使得它在不同规模的模型上都能取得与全参数微调相媲美的性能。

直观解释

P-Tuning最大的特点是将通过引入BiLSTM/MLP的方法,使得模型可以更好的完成NLU任务。这种方法的优势在于可以在不改变模型结构的情况下,为decoder架构的模型提供encoder架构的特性。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)