DeepSeek-OCR 模型结构 笔记

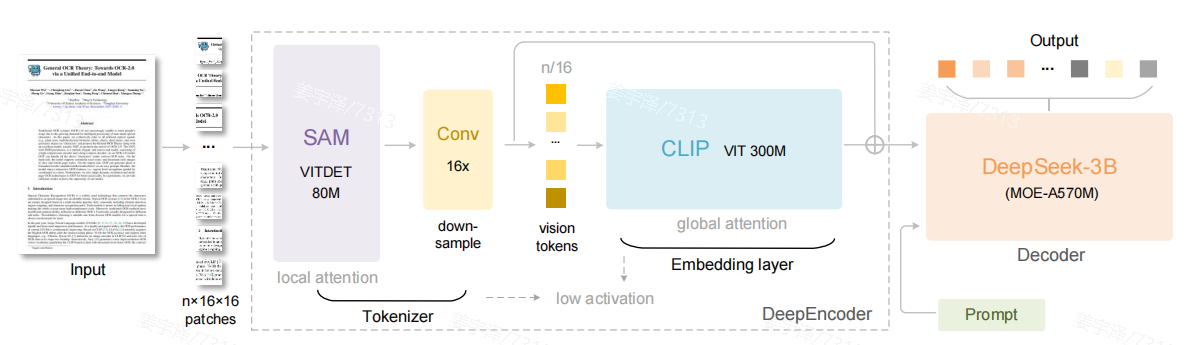

DeepSeek-OCR采用创新性的编码器-解码器架构处理文档OCR任务。编码器部分使用双塔架构DeepEncoder,结合SAM和CLIP模型,支持多分辨率输入(512-1280像素),通过智能填充和局部+全局视角处理不同尺寸图像。解码器采用MoE架构。该模型的创新架构有效平衡了计算成本和识别精度。

·

DeepSeek-OCR 模型结构 笔记

1. 相关背景工作

当前VLM的范式大致分为3类:

- 第一类是以Vary为代表的双塔架构,用2个并行的SAM对图片进行处理,缺陷是部署和训练的成本比较高。

- 第二类是InternVL为代表的tile方法,将图片分为若干小tile,但显示图片会被过度分割。

- 第三类是以Qwen2-VL为代表的NaViT方法,不切分tile而直接划分patch,这种方法的缺陷在于过长的token带来的资源占用。

2. DeepSeek-OCR的具体架构

整体上,DeepSeek-OCR由编码器+解码器的结构组成,编码器是采用双塔架构的DeepEncoder,解码器是MoE decoder。

(1)DeepEncoder

- 整体架构:基于Window Transformer的SAM + 卷积(执行下采样和升维) + 基于global attention的CLIP。

- 对于多精度的兼容:

- 模型提供512、640、1024、1280、(640+1024)、(1024+1280)多个输入尺度。

- 对于W=512或640,token数较少,为避免浪费token,图片被直接resize到W×W。

- 对于W=1024或1280,图片按照长边resize到W,空余的部分进行padding,实现的效果为

N v a l i d = ⌈ N a c t u a l × ( 1 − m a x ( w , h ) − m i n ( w , h m a x ( w , h ) ) ⌉ N_{valid} = \lceil N_{actual} \times (1-\frac{max(w,h)-min(w,h}{max(w,h)}) \rceil Nvalid=⌈Nactual×(1−max(w,h)max(w,h)−min(w,h)⌉

这里我有个小问题,为什么不直接化简为 ⌈ N a c t u a l × m i n ( w , h ) m a x ( w , h ) ⌉ \lceil N_{actual} \times \frac{min(w,h)}{max(w,h)} \rceil ⌈Nactual×max(w,h)min(w,h)⌉,相当于按照短边/长边来计算valid token ratio。 - 对于W_l, W_g=(640, 1024)或(1024, 1280),图片仿照tile方法将W=W_g×W_g作为全局视角,再附加n个W=W_l×W_l的局部视角;因为W_l本身也较大,图片不会被切割的过于细碎,n取值在2-9之间。

- 模型提供512、640、1024、1280、(640+1024)、(1024+1280)多个输入尺度。

(2)DeepSeekMoE Decoder

- MoE架构:包括2个shared experts和64个(每次激活6个)routed experts。

- 解码器实现的映射:

f dec : R n × d latent → R N × d next ; X ^ = f dec ( Z ) where n ≤ N f_{\text{dec}} : \mathbb{R}^{n \times d_{\text{latent}}} \rightarrow \mathbb{R}^{N \times d_{\text{next}}}; \quad \hat{X} = f_{\text{dec}}(\mathbf{Z}) \quad \text{where } n \leq N fdec:Rn×dlatent→RN×dnext;X^=fdec(Z)where n≤N

3. 启发

- 从后续的实验评测来看,DeepSeek-OCR的本质还是OCR技术,比如训练数据中需要包含页面内容的坐标信息。在执行OCR的过程中摸索出optical压缩机制,是个很好的思路。

- 打破seq2seq的习惯性范式。

- VL的整体架构依然是Encoder+Proj+Decoder,在DeepSeek-OCR中,SAM充当encoder,CLIP是Proj,DeepSeek MoE Decoder是Decoder。整个架构类似于融合了常见的3种VLM架构,整体采用直接划分patch,对于super-resolution则进行global + tile-local的双塔推理;并且,在SAM中采用Window Transformer,避免了过长的token带来的高成本。

文中图片来自 DeepSeek-OCR 论文

如果有理解错误的地方欢迎大佬指正

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)