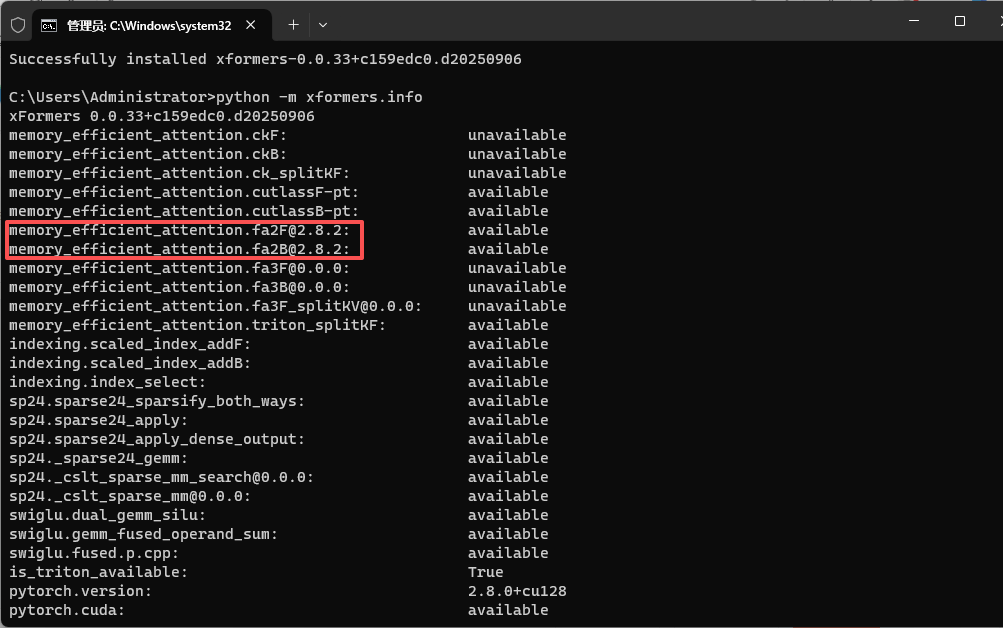

关于comfyui的xformers参数memory_efficient_attention.fa2F是unavailable(flash_attn)

这个依赖库没法直接pip install(虽然作者说可以,但是我安装一堆问题),得直接编译github源码,但是有作者以及其他人编译的wheel文件,我们就直接拿去使用就行,这个是作者的源码界面,版本的话尝试一下就行。按需要下载即可,如果最新版本安装之后不匹配,那就下载前面的版本,一般你不匹配的话,安装好会在命令行直接给你提示,说需要xxx版本,我们在重新回去下载对应版本的wheel即可。补充一下

补充一下,如果你的xformers.info里面fa2一直没办法启用,那你可以试一下安装python的依赖库flash_attn

如果不懂安装xformers的可以看我前面的文章

关于comfyui安装xformers,以及torch,torchaduio,torchvision的匹配问题(超详细)(上)-CSDN博客

关于comfyui安装xformers,以及torch,torchaduio,torchvision的匹配问题(超详细)(下)-CSDN博客

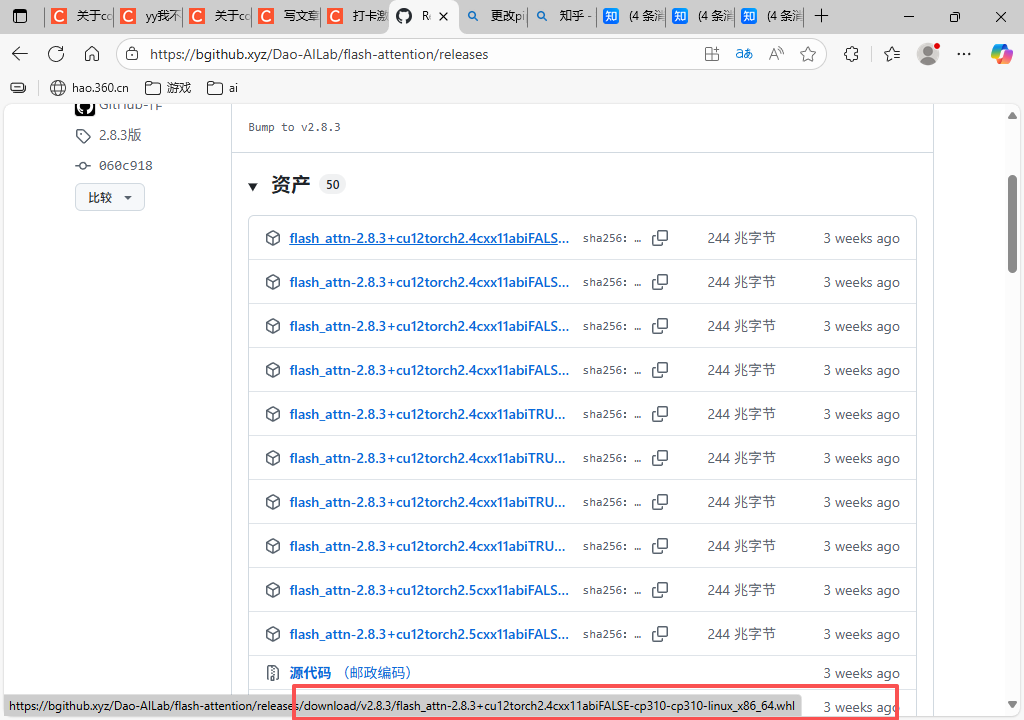

这个依赖库没法直接pip install(虽然作者说可以,但是我安装一堆问题),得直接编译github源码,但是有作者以及其他人编译的wheel文件,我们就直接拿去使用就行,这个是作者的源码界面,版本的话尝试一下就行

Releases · Dao-AILab/flash-attention![]() https://bgithub.xyz/Dao-AILab/flash-attention/releases

https://bgithub.xyz/Dao-AILab/flash-attention/releases

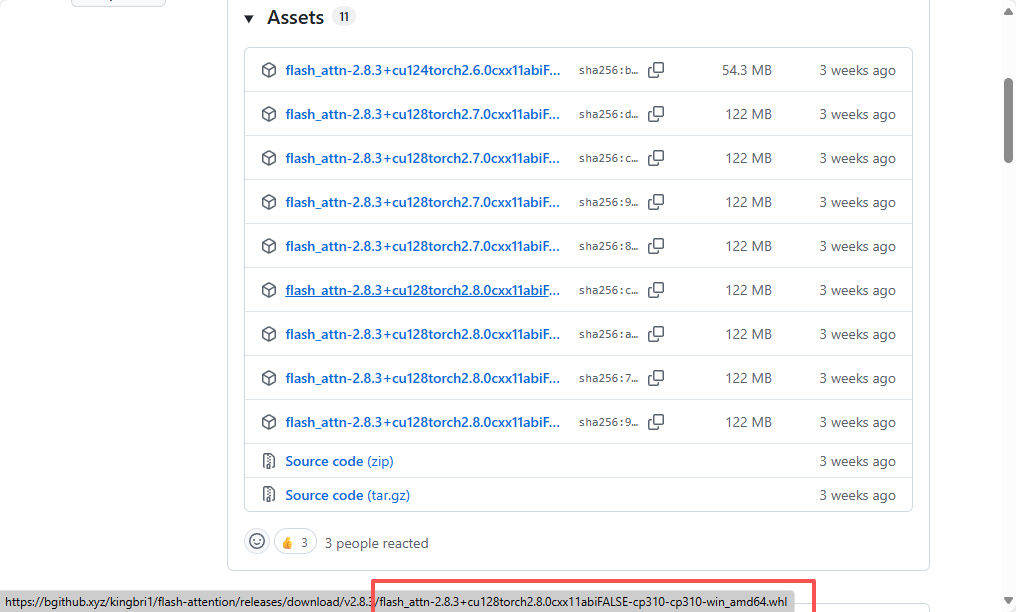

文件名字已经教过怎么看了,根据自己适配下载就行,只不过这个作者都是编译linux系统的,所以这里推荐另外一个大佬kingbri1,编译了很多windows版本的

Releases · kingbri1/flash-attention![]() https://bgithub.xyz/kingbri1/flash-attention/releases

https://bgithub.xyz/kingbri1/flash-attention/releases

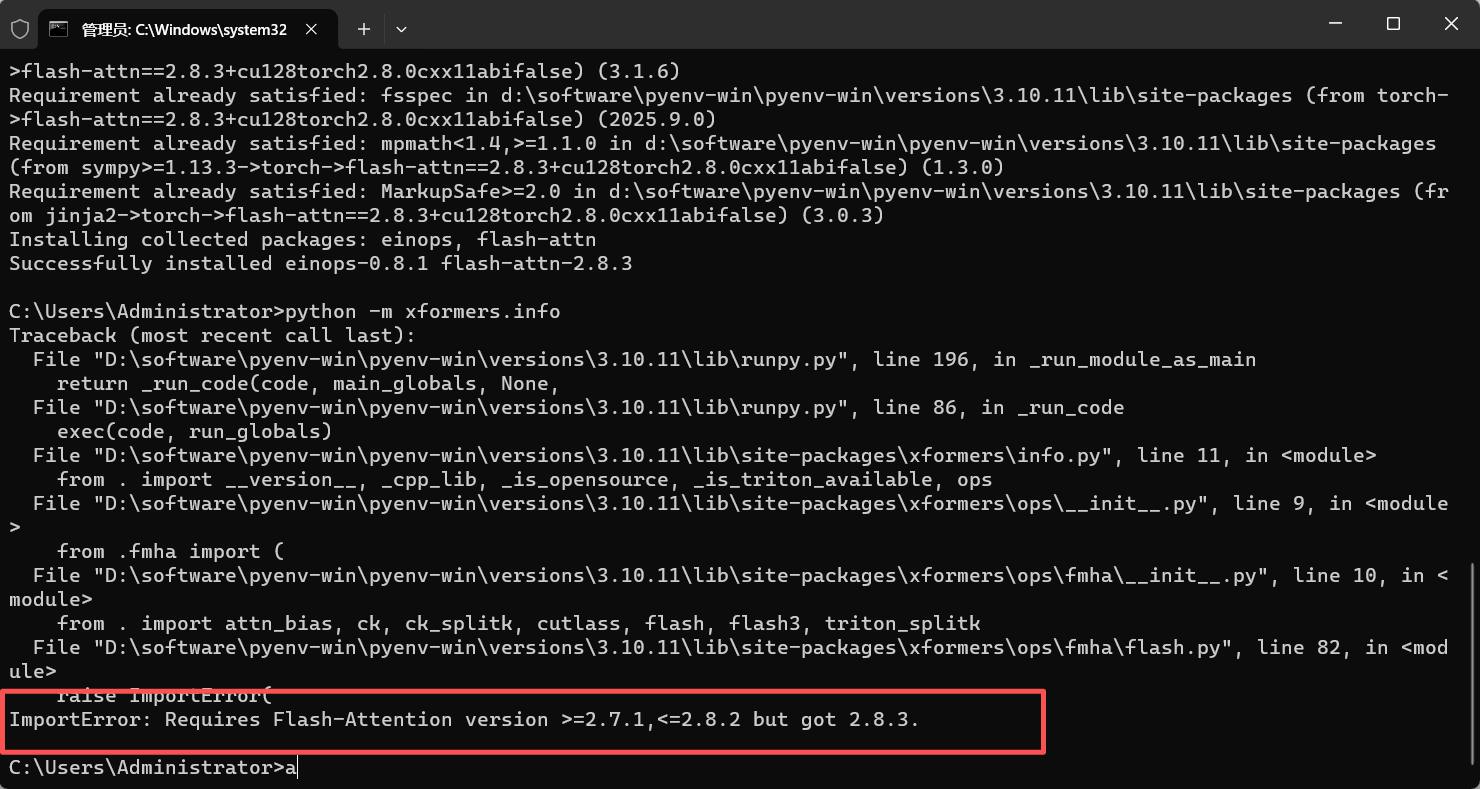

按需要下载即可,如果最新版本安装之后不匹配,那就下载前面的版本,一般你不匹配的话,安装好会在命令行直接给你提示,说需要xxx版本,我们在重新回去下载对应版本的wheel即可

会有类似的提示,在你运行xformers.info的时候

下载对应的版本就行,这里我就使用2.8.2

下载完直接

pip install flash_attn-......whl (你下载的位置)

搞定,一般安装好了匹配的flash_attn依赖库,fa2就会变成available状态,然后再尝试用comfyui生图测试加速

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献23条内容

已为社区贡献23条内容

所有评论(0)