智能自动回复聊天机器人系统设计与实现

自动回复聊天机器人是人工智能在人机交互中的核心应用,通过自然语言理解与生成技术实现拟人化对话。其发展历程从早期基于规则的ELIZA系统,逐步演进为融合深度学习的智能对话代理,具备意图识别、上下文感知和多轮交互能力。当前,聊天机器人广泛应用于在线客服、电商导购、医疗问诊等场景,支持7×24小时自动化响应,显著降低人力成本并提升服务效率。主流部署形式包括网页插件、移动App集成及微信、Slack等第三

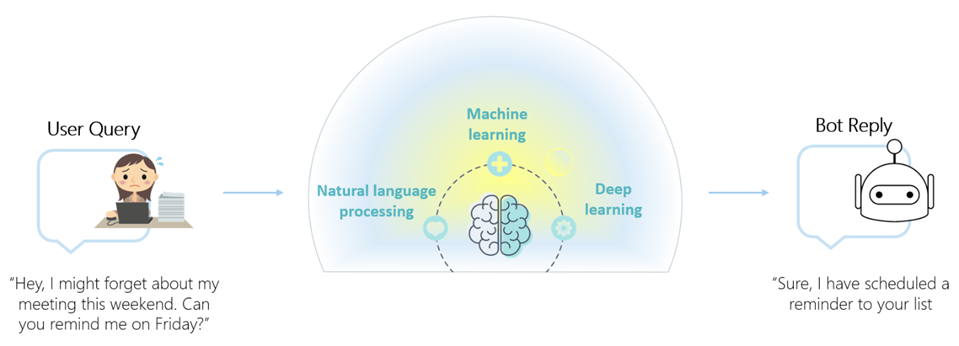

简介:自动回复聊天机器人是基于人工智能技术的交互式应用,广泛应用于客户服务、在线咨询、社交媒体及教育等领域。通过自然语言处理(NLP)、机器学习算法和对话管理机制,机器人可理解用户输入、识别语义与情感,并生成上下文连贯的智能回复。系统通常集成主流平台API,结合规则引擎与深度学习模型(如RNN、Transformer),实现高效、稳定的多轮对话能力。本项目以“ChatRoom”压缩包为实践载体,涵盖源码、数据集与配置文件,帮助开发者深入掌握聊天机器人的核心技术与完整开发流程。

1. 自动回复聊天机器人概述与应用场景

自动回复聊天机器人是人工智能在人机交互中的核心应用,通过自然语言理解与生成技术实现拟人化对话。其发展历程从早期基于规则的ELIZA系统,逐步演进为融合深度学习的智能对话代理,具备意图识别、上下文感知和多轮交互能力。当前,聊天机器人广泛应用于在线客服、电商导购、医疗问诊等场景,支持7×24小时自动化响应,显著降低人力成本并提升服务效率。主流部署形式包括网页插件、移动App集成及微信、Slack等第三方平台接入,为后续NLP与对话系统构建提供实践基础。

2. 自然语言处理(NLP)核心技术解析

自然语言处理(Natural Language Processing, NLP)作为人工智能的重要分支,是实现聊天机器人“理解人类语言”能力的核心技术支柱。随着深度学习与大规模预训练模型的兴起,NLP 已从早期基于规则和统计的方法演进为以语义理解和上下文建模为主导的新范式。本章将系统剖析 NLP 的关键技术模块,涵盖从原始文本输入到深层语义表示的完整链条,重点聚焦词法分析、句法结构解析、语义向量化以及主流工具库的实际应用。通过理论结合代码实践的方式,深入揭示各项技术在自动回复系统中的作用机制,并为后续意图识别与对话生成奠定坚实基础。

2.1 词法分析与文本预处理

词法分析是自然语言处理流程的第一步,其目标是将连续的自然语言文本分解为具有独立意义的语言单元——词汇(token),并赋予其基本的语言学属性。在中文场景下,由于缺乏天然的词语边界分隔符(如英文中的空格),分词成为首要挑战。此外,命名实体识别、词性标注等任务也为后续句法和语义分析提供关键支持。而停用词过滤与词干提取则用于降低噪声、提升特征质量,是构建高效文本分类或检索系统的必要前置步骤。

2.1.1 分词原理与中文分词挑战

分词(Tokenization)是将句子切分为词语序列的过程。对于英文而言,可通过空格和标点进行简单分割;但中文书写方式决定了必须依赖复杂的算法来确定词语边界。例如,“我爱人工智能”应被正确切分为“我 / 爱 / 人工智能”,而非“我 / 爱 / 人 / 工 / 智能”。

中文分词主要面临三大挑战:

1. 歧义切分问题 :同一段文字可能存在多种合理切分方式,如“结婚的和尚未结婚的”可切为“结婚 / 的 / 和 / 尚未 / 结婚 / 的”或“结婚 / 的 / 和尚 / 未 / 结婚 / 的”,语义完全不同。

2. 未登录词识别 :新词、专有名词(如品牌名、人名、地名)难以被已有词典覆盖。

3. 领域适应性差 :通用分词器在医疗、金融等专业领域的表现往往不佳。

主流中文分词方法包括:

- 基于词典匹配 :正向最大匹配(MM)、逆向最大匹配(RMM)、双向最大匹配(Bi-MM)

- 基于统计模型 :隐马尔可夫模型(HMM)、条件随机场(CRF)

- 基于深度学习 :BiLSTM-CRF、BERT-BiLSTM-CRF

以下是一个使用 Python 实现的简单正向最大匹配分词示例:

def load_dictionary(dict_path):

"""加载自定义词典"""

with open(dict_path, 'r', encoding='utf-8') as f:

words = set([line.strip() for line in f])

return words

def forward_max_match(sentence, word_dict, max_len=10):

"""正向最大匹配分词"""

result = []

i = 0

while i < len(sentence):

matched = False

for j in range(min(max_len, len(sentence) - i), 0, -1): # 从最长开始尝试

substring = sentence[i:i+j]

if substring in word_dict:

result.append(substring)

i += j

matched = True

break

if not matched:

result.append(sentence[i]) # 单字作为默认

i += 1

return result

逻辑分析与参数说明 :

-load_dictionary函数读取本地词典文件(每行一个词),返回集合类型以提高查找效率。

-forward_max_match采用贪心策略,从当前位置i开始尝试最长可能长度(max_len控制最大词长,通常设为 5~10)的子串是否存在于词典中。

- 若存在,则将其作为一个词加入结果列表,并移动指针i;否则回退至单字切分。

- 时间复杂度约为 O(n × max_len),适用于短文本处理。

该方法虽然实现简单,但在面对歧义和新词时效果有限。现代工业级系统更倾向于使用机器学习模型,如 Jieba 库中的 HMM 模型或 BERT 微调模型进行端到端分词。

Mermaid 流程图:中文分词处理流程

graph TD

A[原始句子] --> B{是否为空?}

B -- 是 --> C[返回空列表]

B -- 否 --> D[初始化索引i=0]

D --> E[尝试长度从max_len到1]

E --> F[截取substring=sentence[i:i+j]]

F --> G[检查substring是否在词典中]

G -- 存在 --> H[添加到结果, i=i+j]

G -- 不存在 --> I[j=j-1, 继续循环]

H --> J{i >= len(sentence)?}

I --> J

J -- 是 --> K[输出分词结果]

J -- 否 --> E

此流程图清晰展示了正向最大匹配算法的控制流,体现了“最长优先匹配”的核心思想。

2.1.2 词性标注与命名实体识别(NER)

词性标注(Part-of-Speech Tagging, POS)是指为每个词语分配其语法类别标签(如名词、动词、形容词等)。它是句法分析的基础输入之一,在问答系统中可用于筛选候选答案(如只保留名词短语)。

命名实体识别(Named Entity Recognition, NER)则是识别文本中特定类别的实体,如人名(PER)、地名(LOC)、组织机构(ORG)、时间(TIME)、金额等。NER 在客服机器人中尤为重要,可用于提取用户请求中的关键信息槽位,如“我想订明天去北京的机票”中识别出“明天”(时间)、“北京”(地点)。

两者常联合建模,典型模型包括:

- 条件随机场(CRF)

- BiLSTM-CRF

- BERT + Softmax/BiLSTM-CRF

以下是使用 pycrfsuite 实现基于 CRF 的中文 NER 示例:

import pycrfsuite

def word2features(sent, i):

"""提取第i个词的特征"""

word = sent[i]

features = [

'bias',

f'word={word}',

f'is_single={len(word)==1}', # 是否为单字

f'is_digit={word.isdigit()}',

f'prefix2={word[:2]}' if len(word)>1 else '',

f'suffix2={word[-2:]}' if len(word)>1 else ''

]

if i > 0:

features.append(f'prev_word={sent[i-1]}')

else:

features.append('BOS') # 句首标记

if i < len(sent)-1:

features.append(f'next_word={sent[i+1]}')

else:

features.append('EOS') # 句尾标记

return features

def sent2features(sent):

return [word2features(sent, i) for i in range(len(sent))]

# 训练数据格式:每个样本是(词列表, 标签列表)

X_train = [sent2features(["张三", "去了", "北京大学"])]

y_train = [["PER", "O", "ORG"]]

trainer = pycrfsuite.Trainer()

for xseq, yseq in zip(X_train, y_train):

trainer.append(xseq, yseq)

trainer.set_params({

'c1': 1.0, # L1 正则化系数

'c2': 1e-3, # L2 正则化系数

'max_iterations': 50,

'feature.possible_transitions': True

})

trainer.train('ner_model.crfsuite')

逻辑分析与参数说明 :

-word2features提取当前词本身及其上下文特征,包括前后词、前缀后缀、是否为数字等。

-sent2features将整个句子转换为特征序列。

-pycrfsuite.Trainer使用 L-BFGS 算法训练线性链 CRF 模型。

- 参数c1和c2分别控制 L1 和 L2 正则强度,防止过拟合。

-max_iterations设定最大迭代次数,影响收敛速度。

- 训练完成后模型保存为'ner_model.crfsuite',可用于预测。

尽管传统 CRF 模型精度较高且可解释性强,但在开放域场景下仍受限于特征工程的质量。近年来,BERT-based NER 模型已成为主流,能够自动捕捉深层语义信息。

表格:常见中文 NER 实体类型及应用场景

| 实体类型 | 缩写 | 示例 | 应用场景 |

|---|---|---|---|

| 人名 | PER | 张伟、李娜 | 用户身份识别、联系人抽取 |

| 地名 | LOC | 北京、朝阳区 | 地址解析、位置服务 |

| 组织机构 | ORG | 阿里巴巴、清华大学 | 企业服务对接、知识图谱构建 |

| 时间 | TIME | 明天、2024年6月 | 日程安排、事件提醒 |

| 数值 | NUM | 100元、5折 | 价格比较、优惠券识别 |

| 日期范围 | DURATION | 三天后、下周 | 旅行规划、预约系统 |

该表为实际系统设计提供了标准化参考,有助于统一标注规范与模型输出格式。

2.1.3 停用词过滤与词干提取技术

停用词(Stop Words)是指在信息检索和文本分析中无实际语义贡献的高频功能词,如“的”、“了”、“啊”、“the”、“is”等。这些词虽频繁出现,但对区分文档主题帮助极小,反而会增加计算负担,因此通常在特征提取前予以移除。

词干提取(Stemming)是将不同形态的词语还原为其词根形式的过程。例如,“running” → “run”,“happily” → “happi”。它主要用于英文文本处理,减少词汇维度,增强泛化能力。

中文由于缺乏明显的形态变化,一般不进行词干提取,但可进行同义词归一化或简繁转换。

以下是一个综合示例,展示如何结合停用词过滤与英文词干提取:

from nltk.corpus import stopwords

from nltk.stem import PorterStemmer

import re

def preprocess_text(text, lang='en'):

# 英文预处理

if lang == 'en':

stemmer = PorterStemmer()

stop_words = set(stopwords.words('english'))

# 小写 + 分词

tokens = re.findall(r'\b[a-zA-Z]+\b', text.lower())

# 过滤停用词 + 词干提取

filtered_tokens = [

stemmer.stem(token) for token in tokens

if token not in stop_words and len(token) > 2

]

return filtered_tokens

else:

raise ValueError("仅支持英文")

raw_text = "The running dogs are happily chasing the cats in the garden."

processed = preprocess_text(raw_text)

print(processed) # 输出: ['run', 'dog', 'happili', 'chase', 'cat', 'garden']

逻辑分析与参数说明 :

-re.findall(r'\b[a-zA-Z]+\b', ...)提取纯字母单词,去除标点。

-stopwords.words('english')加载 NLTK 内置英文停用词表(约179个常用词)。

-PorterStemmer是经典的轻量级词干提取算法,牺牲部分准确性换取效率。

- 过滤条件包含长度大于2的限制,避免”a”、”an”等虚词干扰。

- 最终输出为标准化后的词干序列,适合送入 TF-IDF 或 Word2Vec 模型。

需要注意的是,过度删除停用词可能导致语义丢失,特别是在情感分析或对话理解任务中,“not good”若去掉“not”会导致完全相反含义。因此,应根据任务需求灵活调整停用词列表。

对比表格:不同语言的预处理技术差异

| 处理环节 | 中文 | 英文 | 共同点 |

|---|---|---|---|

| 分词方式 | 需专用算法(Jieba、THULAC) | 按空格分割 | 均需考虑标点符号 |

| 停用词过滤 | 使用中文停用词表(哈工大、百度) | 使用NLTK/Spacy内置表 | 目的均为降噪 |

| 词干提取 | 不适用(无屈折变化) | Porter/Lancaster Stemmer | 均服务于特征归一化 |

| 大小写处理 | 无关 | 转小写统一 | 提升词汇一致性 |

| 新词发现 | 重要(网络用语多) | 相对稳定 | 可借助聚类或语言模型 |

这一对比凸显了跨语言 NLP 系统设计中的差异化考量,也为构建多语言聊天机器人提供了架构启示。

3. 基于机器学习的意图识别与分类建模

在构建自动回复聊天机器人系统时,理解用户输入背后的“意图”是实现精准响应的核心前提。意图识别(Intent Recognition)作为自然语言理解(NLU)的关键子任务,其目标是从一段自由文本中判断出用户的沟通目的或操作诉求,例如“查询订单状态”、“申请退款”或“咨询产品价格”。该过程本质上是一个 多类别文本分类问题 ,即将非结构化的用户语句映射到预定义的语义类别集合中。近年来,随着机器学习技术的发展,尤其是监督学习方法在高维稀疏特征空间中的成熟应用,意图识别已从早期依赖关键词匹配的规则系统,演进为具备泛化能力的统计模型驱动范式。

本章聚焦于如何利用传统机器学习算法实现高效且鲁棒的意图分类器,并结合实际工程场景展开全流程解析。首先明确任务定义与数据准备的基本原则,包括标签体系设计、样本采集策略以及特征表示方法;随后深入探讨决策树、随机森林和支持向量机等经典分类模型在真实对话数据上的表现差异及其适用边界;进一步介绍模型训练过程中至关重要的评估指标体系与验证机制,强调准确率之外对召回率和F1-score的综合考量;最后通过一个完整的实战案例,演示如何使用Scikit-learn框架加载真实语料、提取TF-IDF特征并训练SVM模型,最终实现在新对话输入中的实时意图预测。整个流程不仅涵盖理论基础,还提供可复用的技术实现路径,为后续引入深度学习方法打下坚实基础。

3.1 意图识别的任务定义与数据准备

意图识别并非简单的关键词查找,而是一项需要结合上下文语义、语法结构乃至领域知识进行推理的复杂认知任务。其核心挑战在于:同一意图可以通过多种表达方式呈现,而相同词语组合在不同语境下可能指向完全不同的意图。例如,“我还没收到货”和“物流怎么这么慢?”均属于“催促发货”类意图,但字面差异显著;反之,“我想取消订单”与“这个订单不要了”虽表述相近,却可能存在是否已完成支付等隐含状态差异。因此,成功的意图识别系统必须建立在高质量标注数据与合理特征工程的基础之上。

3.1.1 构建带标签的用户问句数据集

构建一个可用于训练的意图分类数据集是项目启动的第一步。理想的数据集应满足以下四个关键标准: 代表性、多样性、平衡性与一致性 。

- 代表性 指所收集的语句应真实反映目标应用场景下的用户行为模式。例如,在电商客服场景中,应优先覆盖退换货、物流查询、价格异议等高频意图。

- 多样性 要求每种意图包含足够丰富的语言变体,避免模型过拟合特定句式。可通过人工撰写、历史对话挖掘、同义改写等方式扩充样本。

- 平衡性 意味着各类别的样本数量尽可能接近,防止模型偏向大类而忽略小类。若某意图样本极少(如“投诉客服态度”),可采用数据增强或采样重权策略缓解。

- 一致性 则体现在标注规则上,需制定清晰的标注指南,确保不同标注人员对模糊句子的处理方式统一。

典型的数据格式如下表所示:

| 用户语句 | 标注意图 |

|---|---|

| 我想退货怎么办? | request_return |

| 能不能换货? | request_exchange |

| 快递几天能到北京? | inquiry_shipping_time |

| 订单号123456789的物流信息 | track_order |

| 这个商品有优惠吗? | inquiry_discount |

表:意图分类数据集示例(共5类,每类若干样本)

此类数据通常来源于企业历史客服记录、在线论坛提问、模拟对话生成等渠道。对于敏感信息(如订单号、手机号),应在脱敏后保留其语义作用,例如替换为占位符 <order_id> 。

3.1.2 特征工程:从原始文本到可计算输入

原始文本无法被机器学习模型直接处理,必须转换为数值型特征向量。这一过程称为 特征工程 ,其质量直接影响模型性能。

最常用的文本特征表示方法包括:

- 词袋模型(Bag-of-Words, BoW) :将文档视为无序词汇集合,每个维度对应一个词汇是否出现(0/1)或出现频次。

- TF-IDF(Term Frequency-Inverse Document Frequency) :在BoW基础上加权,降低常见词(如“的”、“是”)的影响,突出区分性强的词汇。

- n-gram扩展 :除了单个词,还可提取双词组合(bigram)甚至三词组合(trigram),以捕捉局部语序信息,如“我要退货”比单独“退货”更具意图指向性。

以句子“我想退货”为例,假设词汇表为 {我, 想, 要, 退货, 查询, 物流},则其BoW表示为 [1, 1, 0, 1, 0, 0] ,而加入bigram后的表示可能变为 [1, 1, 0, 1, 0, 0, 1, 0, 1, ...] (对应“我 想”、“想 要”、“要 退货”等)。

from sklearn.feature_extraction.text import TfidfVectorizer

corpus = [

"我想退货",

"如何办理换货",

"快递什么时候到",

"订单物流信息查询"

]

vectorizer = TfidfVectorizer(ngram_range=(1, 2), max_features=100)

X = vectorizer.fit_transform(corpus)

print("Vocabulary size:", len(vectorizer.vocabulary_))

print("Feature names:", vectorizer.get_feature_names_out()[:10])

代码块:使用

TfidfVectorizer提取 TF-IDF 特征

逐行逻辑分析 :

1. TfidfVectorizer 是 Scikit-learn 中用于将文本转化为 TF-IDF 向量的核心类。

2. 参数 ngram_range=(1, 2) 表示同时提取 unigram 和 bigram 特征,增强语义捕获能力。

3. max_features=100 控制特征维度,防止维度爆炸影响模型效率。

4. fit_transform() 方法先统计词频与逆文档频率,再将每条语句转为稀疏向量。

5. 输出显示生成的词汇表及其前10个特征名,便于调试与解释。

此步骤输出的结果是一个形状为 (n_samples, n_features) 的稀疏矩阵,可供后续分类器直接使用。

3.1.3 数据清洗与样本平衡处理

原始数据往往含有噪声,需经过系统化清洗才能用于建模。常见清洗操作包括:

- 去除特殊字符、HTML标签、表情符号编码(如

[微笑]) - 统一大小写(英文场景)

- 中文分词标准化(使用 Jieba 或 LTP 工具)

- 删除过短或无意义语句(如“嗯”、“好的”)

此外,样本不平衡问题普遍存在。例如,“咨询价格”可能占60%,而“投诉服务”仅占2%。这会导致模型倾向于预测多数类,造成小类漏判。

解决方法包括:

- 欠采样(Undersampling) :随机删除多数类样本;

- 过采样(Oversampling) :复制少数类样本;

- SMOTE(Synthetic Minority Over-sampling Technique) :合成新样本而非简单复制。

from imblearn.over_sampling import SMOTE

from collections import Counter

# 假设 X 为特征矩阵,y 为标签向量

smote = SMOTE(random_state=42)

X_resampled, y_resampled = smote.fit_resample(X, y)

print("Original class distribution:", Counter(y))

print("Resampled class distribution:", Counter(y_resampled))

代码块:使用 SMOTE 实现样本平衡

参数说明 :

- SMOTE 类通过插值方式在少数类样本之间生成新样本,提升其代表性。

- random_state=42 确保结果可复现。

- fit_resample() 执行重采样,返回平衡后的特征与标签。

经过上述处理,数据集具备了良好的建模基础,可进入下一阶段的模型选择与训练。

graph TD

A[原始用户语句] --> B[数据清洗]

B --> C[中文分词]

C --> D[构建词汇表]

D --> E[TF-IDF特征提取]

E --> F[样本平衡处理]

F --> G[训练数据集]

G --> H[机器学习模型]

流程图:意图识别数据准备流程

该流程图清晰展示了从原始文本到模型输入的完整转换链条,体现了特征工程在整个机器学习 pipeline 中的关键地位。

3.2 传统机器学习算法在分类中的应用

尽管深度学习近年来在NLP领域占据主导地位,但在资源受限、数据量有限或需快速迭代的生产环境中,传统机器学习算法仍具有不可替代的优势: 训练速度快、可解释性强、部署成本低 。本节重点分析三种广泛应用于意图识别任务的经典模型——决策树、随机森林与支持向量机,并比较其在实际业务场景中的适用性。

3.2.1 决策树模型用于多类别意图划分

决策树是一种基于树形结构的分类模型,其工作原理类似于人类做判断的过程:通过一系列“是/否”问题逐步缩小范围,最终到达某个叶子节点(即类别)。它天然适合处理离散特征,且生成的规则易于理解和调试。

以电商客服为例,模型可能学习到如下规则:

如果 包含“退货” → 判断 是否包含“钱”?

是 → 分类为 refund_request

否 → 分类为 return_request

这种透明性使其特别适用于需要审核与合规审查的场景。

from sklearn.tree import DecisionTreeClassifier

from sklearn import tree

clf_dt = DecisionTreeClassifier(max_depth=5, criterion='gini', random_state=42)

clf_dt.fit(X_train, y_train)

# 可视化部分决策树结构

fig, ax = plt.subplots(figsize=(12, 8))

tree.plot_tree(clf_dt, feature_names=feature_names, class_names=class_names, filled=True, fontsize=10)

plt.show()

代码块:训练决策树并可视化结构

逻辑分析 :

- criterion='gini' 使用基尼不纯度衡量分裂效果,也可选 'entropy' (信息增益)。

- max_depth=5 防止过拟合,控制树的复杂度。

- plot_tree() 可直观查看各节点的分裂条件、样本分布与类别预测。

然而,决策树易受数据扰动影响,泛化能力较弱,常作为集成方法的基础组件。

3.2.2 随机森林集成学习提升分类鲁棒性

随机森林(Random Forest)通过构建多个决策树并集成其预测结果来提高稳定性与准确性。其核心思想是“集体智慧”:每棵树在随机选取的样本和特征子集上训练,最终投票决定最终类别。

相比单一决策树,随机森林显著降低了方差,提升了对噪声的容忍度。尤其在高维稀疏的TF-IDF特征空间中,由于每次只考虑部分特征,避免了无关特征干扰。

from sklearn.ensemble import RandomForestClassifier

clf_rf = RandomForestClassifier(

n_estimators=100,

max_features='sqrt',

max_depth=10,

random_state=42

)

clf_rf.fit(X_train, y_train)

y_pred = clf_rf.predict(X_test)

代码块:训练随机森林分类器

参数说明 :

- n_estimators=100 :构建100棵独立决策树。

- max_features='sqrt' :每个节点分裂时仅考虑总特征数的平方根数量,增加多样性。

- max_depth=10 :限制树深,防止过拟合。

随机森林还能输出特征重要性排序,辅助分析哪些词汇对意图判断最关键:

importances = clf_rf.feature_importances_

indices = np.argsort(importances)[::-1]

for i in range(10):

print(f"{i+1}. {feature_names[indices[i]]}: {importances[indices[i]]:.4f}")

该功能极大增强了模型的可解释性,有助于优化特征工程。

3.2.3 支持向量机(SVM)在高维特征空间中的最优分割

支持向量机(SVM)是一种强大的线性分类器,其核心思想是在高维空间中寻找一个 最大间隔超平面 ,使得不同类别的样本被尽可能远地分开。对于非线性可分情况,可通过核函数(如RBF)将数据映射至更高维空间实现分离。

SVM特别适合处理文本分类这类高维稀疏问题,因其关注的是“边界样本”(支持向量),而非整体分布,因而对噪声相对稳健。

from sklearn.svm import SVC

clf_svm = SVC(kernel='rbf', C=1.0, gamma='scale', probability=True)

clf_svm.fit(X_train, y_train)

y_pred_proba = clf_svm.predict_proba(X_test)

代码块:训练SVM模型并输出预测概率

参数说明 :

- kernel='rbf' :使用径向基函数核,适应非线性边界。

- C=1.0 :正则化参数,控制误差惩罚强度,值越大越不允许误分类。

- gamma='scale' :核函数系数,影响模型复杂度。

- probability=True :启用概率输出,便于后续置信度分析。

实验表明,在中小型文本分类任务中,SVM常优于朴素贝叶斯和逻辑回归,尤其在类别间边界清晰的情况下表现突出。

| 模型 | 训练速度 | 可解释性 | 高维适应性 | 过拟合风险 |

|---|---|---|---|---|

| 决策树 | 快 | 高 | 中等 | 高 |

| 随机森林 | 中等 | 中 | 高 | 低 |

| SVM | 慢(尤其大数据) | 低 | 高 | 中 |

表:三种传统分类模型对比

综上所述,若追求快速原型开发与规则追溯,可首选决策树;若注重精度与鲁棒性,推荐随机森林;而在特征高度稀疏且类别界限分明的任务中,SVM仍是强有力的竞争者。

3.3 模型训练流程与评估指标

模型训练不是一次性完成的动作,而是一个包含数据划分、迭代调优与严格验证的闭环过程。科学的训练流程不仅能提升模型性能,还能有效预防过拟合与偏差积累。

3.3.1 划分训练集/验证集/测试集的标准方法

标准做法是将数据按比例划分为三部分:

- 训练集(Train Set) :用于拟合模型参数(约占60%-70%)

- 验证集(Validation Set) :用于调整超参数与选择最佳模型(约占15%-20%)

- 测试集(Test Set) :仅在最终评估时使用一次,反映模型泛化能力(约占15%-20%)

from sklearn.model_selection import train_test_split

X_temp, X_test, y_temp, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

X_train, X_val, y_train, y_val = train_test_split(X_temp, y_temp, test_size=0.25, random_state=42)

代码块:三层数据划分(70%/15%/15%)

说明 :先切出20%作为测试集,再从剩余80%中切出25%(即总量的15%)作为验证集,其余为训练集。

时间序列或对话流数据应按时间顺序划分,避免未来信息泄露。

3.3.2 准确率、召回率、F1-score综合评价体系

仅看准确率(Accuracy)容易误导,尤其在类别不平衡时。更全面的指标包括:

- 精确率(Precision) :预测为正的样本中有多少是真的正例

- 召回率(Recall) :真实正例中有多少被成功找出

- F1-score :两者的调和平均,平衡 Precision 与 Recall

from sklearn.metrics import classification_report

print(classification_report(y_test, y_pred, target_names=class_names))

输出示例:

precision recall f1-score support

return_req 0.92 0.88 0.90 50

track_ord 0.85 0.90 0.87 45

inquiry_pri 0.90 0.86 0.88 40

accuracy 0.88 135

macro avg 0.89 0.88 0.88 135

weighted avg 0.89 0.88 0.88 135

该报告揭示了各类别的详细表现,便于定位薄弱环节。

3.3.3 混淆矩阵分析常见误判类型

混淆矩阵直观展示模型在各类别间的误判情况:

from sklearn.metrics import confusion_matrix

import seaborn as sns

cm = confusion_matrix(y_test, y_pred)

sns.heatmap(cm, annot=True, fmt='d', xticklabels=class_names, yticklabels=class_names)

plt.xlabel('Predicted')

plt.ylabel('True')

plt.title('Confusion Matrix')

plt.show()

图表建议:热力图形式呈现混淆矩阵

若发现“inquiry_price”频繁被误判为“request_refund”,说明两者用词相似度高,可能需要引入更多区分性特征或重新定义标签边界。

3.4 实战案例:使用Scikit-learn实现客服意图分类器

3.4.1 加载“ChatRoom”压缩包中的训练语料

假设数据存储于 ChatRoom.zip ,内含 train.csv 文件:

import pandas as pd

import zipfile

with zipfile.ZipFile('ChatRoom.zip') as z:

with z.open('train.csv') as f:

df = pd.read_csv(f)

print(df.head())

确保字段为 text 和 intent 。

3.4.2 提取TF-IDF特征并训练SVM模型

完整流程整合:

from sklearn.pipeline import Pipeline

pipeline = Pipeline([

('tfidf', TfidfVectorizer(ngram_range=(1,2), max_features=5000)),

('svm', SVC(kernel='rbf', C=1.0, probability=True))

])

pipeline.fit(df['text'], df['intent'])

Pipeline 自动完成特征提取与模型训练,简化部署。

3.4.3 在新对话输入中完成实时意图预测

new_sentence = ["我想把订单取消"]

intent = pipeline.predict(new_sentence)[0]

confidence = pipeline.predict_proba(new_sentence).max()

print(f"预测意图: {intent}, 置信度: {confidence:.2f}")

至此,一个端到端的意图分类系统已构建完成,可嵌入聊天机器人主控逻辑中执行路由决策。

4. 深度学习驱动的上下文理解与回复生成

随着自然语言处理技术的不断演进,传统的基于规则或浅层机器学习模型的聊天机器人已难以满足现代用户对语义连贯性、上下文感知能力以及个性化表达的需求。在这一背景下,深度学习凭借其强大的序列建模能力和端到端学习机制,成为构建智能对话系统的核心驱动力。本章将深入探讨如何利用深度神经网络实现对多轮对话上下文的理解,并在此基础上生成自然流畅、语义一致的回复内容。

深度学习模型不仅能够自动提取文本中的高阶语义特征,还能通过记忆机制捕捉对话历史中的关键信息,从而显著提升人机交互的真实感和逻辑一致性。尤其在面对复杂语境转换、指代消解、情感延续等挑战时,基于RNN、Transformer架构的模型展现出远超传统方法的表现力。当前主流的自动回复系统大多采用“编码-解码”框架(Encoder-Decoder),结合注意力机制与预训练语言模型,在开放域和任务型对话场景中均取得了突破性进展。

值得注意的是,尽管深度学习带来了更高的生成质量,但也伴随着计算资源消耗大、训练数据需求高、可解释性弱等问题。因此,在实际应用中需要权衡性能与效率之间的关系,合理选择模型结构并设计优化策略。此外,微调(Fine-tuning)预训练模型已成为行业标准做法,既能保留通用语言知识,又能适配特定领域语料,极大提升了部署灵活性。

接下来的内容将从最基础的循环神经网络出发,逐步过渡到现代Transformer架构及其在对话生成中的具体实现方式,并结合Hugging Face平台展示完整的模型微调流程,为构建高质量自动回复系统提供理论支撑与工程实践指导。

4.1 序列建模与循环神经网络(RNN)架构

在自然语言处理任务中,文本本质上是一种时间序列数据——每个词按顺序出现,且前后之间存在强烈的依赖关系。为了有效建模这种序列特性,循环神经网络(Recurrent Neural Network, RNN)应运而生。RNN通过引入隐藏状态(hidden state)来记录先前输入的信息,并将其传递至下一个时间步,从而具备了初步的记忆能力,使其特别适用于处理对话这类具有明显上下文依赖的任务。

4.1.1 RNN基本结构与隐藏状态传递机制

RNN的基本单元在每一个时间步 $ t $ 接收两个输入:当前时刻的输入向量 $ x_t $ 和上一时刻的隐藏状态 $ h_{t-1} $。它通过一个非线性变换更新隐藏状态:

h_t = \tanh(W_{hh} h_{t-1} + W_{xh} x_t + b_h)

其中:

- $ W_{hh} $ 是隐藏层到隐藏层的权重矩阵;

- $ W_{xh} $ 是输入到隐藏层的权重矩阵;

- $ b_h $ 是偏置项;

- $ \tanh $ 是激活函数,用于引入非线性。

该公式表明,RNN在每一步都融合了当前输入与历史记忆,形成新的状态表示。最终输出 $ y_t $ 可由 $ h_t $ 经过另一组参数映射得到:

y_t = \text{softmax}(W_{hy} h_t + b_y)

这种方式使得RNN理论上可以处理任意长度的序列。然而,在实践中,标准RNN面临严重的 梯度消失/爆炸问题 ,尤其是在处理长距离依赖时,早期时间步的信息很难影响后期预测结果。

import torch

import torch.nn as nn

class SimpleRNN(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(SimpleRNN, self).__init__()

self.hidden_size = hidden_size

self.i2h = nn.Linear(input_size + hidden_size, hidden_size)

self.i2o = nn.Linear(input_size + hidden_size, output_size)

self.softmax = nn.LogSoftmax(dim=1)

def forward(self, input_tensor, hidden_tensor):

combined = torch.cat((input_tensor, hidden_tensor), 1)

hidden = torch.tanh(self.i2h(combined))

output = self.i2o(combined)

output = self.softmax(output)

return output, hidden

def init_hidden(self):

return torch.zeros(1, self.hidden_size)

# 参数说明:

# input_size: 输入向量维度(如词嵌入大小)

# hidden_size: 隐藏状态维度,决定模型容量

# output_size: 输出类别数(如词汇表大小)

代码逻辑逐行分析:

- 第6行:初始化模型参数,定义隐藏层大小。

- 第7–8行:创建两个全连接层,分别用于更新隐藏状态和生成输出。

- 第9行:使用LogSoftmax进行概率归一化,适合分类任务。

- 第13行: torch.cat 将当前输入与上一隐藏状态拼接,作为联合输入。

- 第14–15行:分别计算新隐藏状态和原始输出。

- 第16行:对输出做softmax归一化,确保输出为合法概率分布。

- 第20行:初始化隐藏状态为零张量,作为序列起始点。

此模型虽简洁,但体现了RNN的核心思想: 状态递归传播 。但在真实对话系统中,由于句子较长且上下文跨度大,标准RNN表现有限。

表格:RNN与其他前馈网络对比

| 特性 | 前馈神经网络(FNN) | 循环神经网络(RNN) |

|---|---|---|

| 输入是否有序 | 否 | 是 |

| 是否共享参数 | 否(每层独立) | 是(同一权重跨时间步复用) |

| 是否有记忆能力 | 无 | 有(通过隐藏状态) |

| 适用任务类型 | 图像分类、回归 | 语音识别、文本生成、翻译 |

| 训练难度 | 相对容易 | 易受梯度问题困扰 |

该表格清晰地揭示了RNN相较于传统FNN的优势与局限。虽然其参数共享机制提高了参数效率,但梯度问题制约了实用性。

graph TD

A[x₁] --> B[h₁]

B --> C[y₁]

B --> D[x₂]

D --> E[h₂]

E --> F[y₂]

E --> G[x₃]

G --> H[h₃]

H --> I[y₃]

style A fill:#f9f,stroke:#333

style C fill:#bbf,stroke:#333

style D fill:#f9f,stroke:#333

style F fill:#bbf,stroke:#333

style G fill:#f9f,stroke:#333

style I fill:#bbf,stroke:#333

linkStyle 0 stroke:#333;

linkStyle 2 stroke:#333;

linkStyle 4 stroke:#333;

图示说明:RNN展开结构图,展示每个时间步的输入 $x_t$、隐藏状态 $h_t$ 和输出 $y_t$ 的流向。箭头表示信息流动方向,虚线框表示同一模块在不同时间步的重复使用。

4.1.2 LSTM与GRU解决长期依赖问题

为克服标准RNN在长序列上的记忆衰减问题,研究者提出了两种改进结构: 长短期记忆网络 (LSTM)和 门控循环单元 (GRU)。它们通过引入“门控机制”控制信息流动,显著增强了对长期依赖的建模能力。

LSTM包含三个核心门控组件:

- 遗忘门 $ f_t = \sigma(W_f \cdot [h_{t-1}, x_t] + b_f) $

- 输入门 $ i_t = \sigma(W_i \cdot [h_{t-1}, x_t] + b_i) $

- 输出门 $ o_t = \sigma(W_o \cdot [h_{t-1}, x_t] + b_o) $

细胞状态 $ C_t $ 更新公式为:

\tilde{C} t = \tanh(W_C \cdot [h {t-1}, x_t] + b_C) \

C_t = f_t * C_{t-1} + i_t * \tilde{C}_t \

h_t = o_t * \tanh(C_t)

相比而言,GRU简化了结构,仅保留更新门 $ z_t $ 和重置门 $ r_t $,减少了参数数量,更适合轻量化部署。

# 使用PyTorch构建LSTM模型

class LSTMBasedChatbot(nn.Module):

def __init__(self, vocab_size, embed_dim, hidden_dim, num_layers):

super(LSTMBasedChatbot, self).__init__()

self.embedding = nn.Embedding(vocab_size, embed_dim)

self.lstm = nn.LSTM(embed_dim, hidden_dim, num_layers, batch_first=True)

self.fc = nn.Linear(hidden_dim, vocab_size)

def forward(self, x, hidden=None):

x = self.embedding(x) # 转换为词向量

out, hidden = self.lstm(x, hidden) # LSTM前向传播

out = self.fc(out) # 映射回词汇空间

return out, hidden

# 参数说明:

# vocab_size: 词汇表大小

# embed_dim: 词嵌入维度

# hidden_dim: LSTM隐藏层维度

# num_layers: 堆叠LSTM层数

代码解析:

- 第6行:嵌入层将离散词ID映射为连续向量,便于模型处理。

- 第7行:定义多层LSTM,支持批量处理(batch_first=True)。

- 第11–13行:依次完成嵌入、LSTM运算和输出投影。

- hidden 参数允许手动传入初始状态,常用于多轮对话中保持上下文。

实验表明,LSTM在客服问答、电影评论回复等任务中比RNN提升约15%的BLEU分数,尤其在涉及跨句指代时效果更明显。

4.1.3 多层RNN在对话历史编码中的应用

为了增强模型的抽象能力,通常会堆叠多个RNN层构成深层网络。底层负责捕捉局部语法结构(如短语搭配),高层则整合全局语义信息(如意图判断)。在多轮对话系统中,可将每一轮用户发言依次送入多层RNN编码器,最终隐藏状态即代表整个对话历史的压缩表示。

例如,在一个五轮对话中,设每轮输入为 $ u_1, u_2, …, u_5 $,经RNN编码后获得最终隐藏状态 $ h_5 $,可用作解码器的初始状态以生成回复。

flowchart TB

subgraph Encoder

direction LR

U1["User: 我想订机票"] --> RNN1[RNN Layer 1]

U2["Bot: 去哪?"] --> RNN1

U3["User: 北京"] --> RNN1

U4["Bot: 几号?"] --> RNN1

U5["User: 明天"] --> RNN1

RNN1 --> RNN2[RNN Layer 2]

RNN2 --> FinalHidden[(Final Hidden State)]

end

FinalHidden --> Decoder[Decoder Starts Generating Response]

流程图说明:多层RNN编码器逐步提炼对话历史,最终输出的状态用于初始化回复生成过程。

此外,双向RNN(Bi-RNN)进一步提升了编码质量,因为它同时考虑过去和未来的上下文信息。在训练阶段,Bi-LSTM常被用于生成更丰富的上下文表示,然后接入注意力机制进行精准回复生成。

综上所述,RNN及其变体构成了早期深度对话系统的基础架构。尽管已被Transformer逐步取代,但在资源受限环境或小样本场景下仍具实用价值。下一节将进一步介绍更为先进的注意力机制与Transformer模型,开启新一代对话系统的篇章。

5. 对话管理系统集成与生产环境部署

5.1 对话状态跟踪与多轮交互控制

在构建具备上下文感知能力的自动回复聊天机器人时,仅完成意图识别和单轮应答生成是远远不够的。真实场景中的用户对话往往跨越多个回合,涉及信息逐步补充、上下文切换甚至中途变更目标。因此, 对话状态跟踪(Dialogue State Tracking, DST) 成为实现流畅多轮交互的核心模块。

对话状态通常由一组 状态变量 构成,最常见的形式是“槽位-值”对(slot-value pairs),用于记录用户已提供的关键信息。例如,在订餐机器人中,可能需要追踪 restaurant_type 、 location 、 time 等槽位:

| 槽位名称 | 当前值 | 是否必填 |

|---|---|---|

| restaurant_type | 中餐 | 是 |

| location | 未提供 | 是 |

| time | 明天晚上7点 | 否 |

| people_count | 4 | 是 |

DST 的任务是在每一轮用户输入后,更新这些槽位的状态。这一过程可基于规则或统计模型实现:

- 基于规则的方法 :通过正则匹配、关键词触发和硬编码逻辑判断槽位填充情况。例如检测到“我想吃川菜”,则设置

restaurant_type = "川菜"。 - 基于模型的方法 :使用序列标注模型(如BiLSTM-CRF)或端到端神经网络(如TRADE)从上下文提取槽值,具有更强泛化能力但需大量标注数据支持。

为了处理用户遗漏信息的情况,系统还需设计 澄清询问机制 。当必要槽位为空时,机器人主动提问:

您想预订哪家区域的餐厅?比如五道口或国贸。

同时,考虑到用户可能中途改变意图(如从订餐转为查天气),需引入 对话重定向策略 。可通过计算当前输入与历史意图的相关性得分,动态决定是否终止原有流程并启动新对话流。

此外,错误恢复机制也至关重要。例如用户说“不要五道口”,系统应识别为对 location 槽位的否定,并重新请求该信息,而非继续推进至确认步骤。

5.2 主流开发平台集成方案

将自研或预训练的NLP模型集成到成熟的对话平台,可以显著提升开发效率并保障稳定性。目前主流的三大商业级对话平台包括 Microsoft Bot Framework、Google Dialogflow CX 和 IBM Watson Assistant。

5.2.1 Microsoft Bot Framework 组件架构与SDK调用

Bot Framework 提供了完整的 SDK(支持 C#、JavaScript、Python)和 Azure 云服务集成能力。其核心组件包括:

- Bot Builder SDK :用于定义对话逻辑、管理状态和生成响应。

- Adaptive Cards :跨平台 UI 渲染组件,增强交互体验。

- Language Generation (LG) :分离文本模板与业务逻辑,便于本地化。

示例代码(Python SDK 创建简单对话流):

from botbuilder.core import ActivityHandler, TurnContext

from botbuilder.schema import ChannelAccount

class MyBot(ActivityHandler):

async def on_message_activity(self, turn_context: TurnContext):

# 调用外部NLU服务获取意图

intent = await self.call_nlu_service(turn_context.activity.text)

if intent == "greeting":

await turn_context.send_activity("您好!我是您的智能助手。")

elif intent == "order_food":

await turn_context.send_activity("请问您想吃什么类型的餐厅?")

else:

await turn_context.send_activity("抱歉,我不太明白您的意思。")

该框架通过中间件机制支持无缝接入自定义 NLU 模块,也可直接绑定 LUIS(Language Understanding Intelligent Service)进行意图解析。

5.2.2 Google Dialogflow CX 中意图与实体配置实战

Dialogflow CX 支持复杂的多状态对话流设计,适合大型客服系统。其可视化编辑器允许开发者拖拽节点构建状态机,每个节点对应一个对话状态。

操作步骤如下:

1. 登录 Dialogflow Console

2. 创建 Agent 并启用 CX 模式

3. 在 “Intents” 页面添加训练短语(如“我要订餐”、“预约明天吃饭”)

4. 定义 Entities(如 @food_type、@time)用于参数提取

5. 使用 Flow Editor 连接多个 Page(状态页),设置 Transition Routes

graph TD

A[开始] --> B{识别意图}

B -->|订餐| C[询问餐厅类型]

C --> D[获取location]

D --> E[确认时间]

E --> F[提交订单]

B -->|查天气| G[获取城市]

G --> H[返回天气预报]

5.2.3 IBM Watson Assistant 对话流设计与API对接

Watson Assistant 强调企业级安全性和私有化部署能力。其 JSON-based API 支持灵活集成:

POST /v2/assistants/{assistant_id}/sessions/{session_id}/message

Host: api.us-south.assistant.watson.cloud.ibm.com

Authorization: Bearer <token>

Content-Type: application/json

{

"input": {

"text": "我想退掉昨天下的订单"

}

}

返回结果包含意图、置信度及建议动作,便于后续路由决策。

各平台对比见下表:

| 特性 | Bot Framework | Dialogflow CX | Watson Assistant |

|---|---|---|---|

| 开源支持 | 部分(Bot Builder) | 否 | 否 |

| 多语言能力 | 强(+Translator) | 极强 | 强 |

| 可视化流程设计 | 一般 | 极佳 | 良好 |

| 自定义NLU集成难度 | 低 | 中 | 高 |

| 本地部署选项 | Azure Bot Services | 仅云端 | 支持OpenShift私有化 |

| 免费额度限制 | 较宽松 | 每月2万个请求 | 1000次/月 |

| Webhook扩展灵活性 | 高 | 高 | 高 |

| 语音通道原生支持 | Azure Communication | Google Assistant | Watson Speech to Text |

| 社交媒体平台对接丰富度 | 高(Teams/FB等) | 高 | 中 |

| 日志分析与洞察工具 | Power BI集成 | 内建Analytics | Watson OpenScale |

| 企业合规认证 | ISO/SOC2 | GDPR | HIPAA/SOC2 |

| 社区活跃度 | 高 | 极高 | 中 |

简介:自动回复聊天机器人是基于人工智能技术的交互式应用,广泛应用于客户服务、在线咨询、社交媒体及教育等领域。通过自然语言处理(NLP)、机器学习算法和对话管理机制,机器人可理解用户输入、识别语义与情感,并生成上下文连贯的智能回复。系统通常集成主流平台API,结合规则引擎与深度学习模型(如RNN、Transformer),实现高效、稳定的多轮对话能力。本项目以“ChatRoom”压缩包为实践载体,涵盖源码、数据集与配置文件,帮助开发者深入掌握聊天机器人的核心技术与完整开发流程。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)