华为云Flexus+DeepSeek征文|华为云ModelArts结合FeedMe:开启AI驱动的RSS阅读新时代

华为云Flexus+DeepSeek征文|华为云ModelArts结合FeedMe:开启AI驱动的RSS阅读新时代

华为云Flexus+DeepSeek征文|华为云ModelArts结合FeedMe:开启AI驱动的RSS阅读新时代

前言

在信息爆炸的时代,如何高效获取并筛选有价值的内容成为关键挑战。华为云ModelArts结合开源工具FeedMe,打造AI驱动的智能RSS阅读新体验,助力用户轻松驾驭信息洪流。本文将分享如何通过Flexus应用服务器与DeepSeek大模型服务,快速构建个性化智能阅读平台。

一、华为云ModelArts Studio平台介绍

1.1 ModelArts Studio介绍

🌟 平台介绍

ModelArts Studio是华为云提供的一个大模型即服务平台(MaaS服务),旨在简化模型开发流程,支持定制化大模型的开发,并使这些模型能够无缝集成到业务系统中。通过降低企业AI应用的成本和难度,ModelArts Studio助力企业快速实现AI技术落地。

👉 立即体验:通过ModelArts Studio,让大模型成为企业数字化转型的核心驱动力,解锁智能未来!

1.2 ModelArts Studio主要特点

-

全栈模型生态,性能卓越

✅ 主流模型全覆盖:集成Llama、Baichuan、Yi、Qwen、DeepSeek等99%业界SOTA开源模型,预适配昇腾算力底座,精度与推理性能显著提升。

✅ 零代码自动化开发:沉淀100+行业调优经验,提供一键训练、自动超参优化、标准化流水线,无需手动调参,开发周期缩短50%+。

✅ 昇腾深度优化:基于昇腾算子与显存优化技术,训练/推理效率大幅提升,预置最优超参配置,开箱即用。 -

资源灵活可控,成本优化

💡 按需付费,弹性扩缩:分钟级获取算力资源,按实际使用收费,避免闲置浪费,降低AI入门门槛。

💡 高可用性保障:多数据中心部署,支持故障快速恢复(快恢)与断点续训,确保训练任务不中断,保护项目连续性。 -

智能应用快速构建

🤖 Agent开发加速器:提供优质Prompt模板与智能Agent沉淀,支持复杂任务拆解(如多系统协同决策),快速生成业务专属智能体。

🤝 组件化生态集成:即插即用MCP Server、LangChain、RAG、Guard等工具,一站式构建智能问答、知识管理、流程自动化等应用。 -

一站式全生命周期服务

📦 全流程工具链:覆盖模型调优、压缩、部署、评测等环节,支持「即开即用」,无需跨平台切换。

⚙️ 标准化流水线:内置性能与精度评价体系,自动化完成模型优化,确保全场景高性能表现。

1.3 ModelArts Studio使用场景

-

行业大模型定制开发

🔹 金融/医疗/制造:基于开源模型微调,快速构建风控分析、智能诊断、供应链优化等垂直领域大模型。

🔹 优势:无需从头训练,依托昇腾优化提升行业数据适配性,降低定制成本。 -

复杂业务流程自动化

🔹 企业级决策支持:拆解项目级任务(如跨部门协作、多系统调用),通过智能Agent实现自动化决策与执行。

🔹 典型场景:智能客服(多轮对话+知识库检索)、工单自动化处理、数据分析报告生成。 -

低成本AI创新探索

🔹 中小企业/初创团队:通过按需付费模式,零门槛试用大模型能力,快速验证业务场景(如营销文案生成、智能质检)。

🔹 优势:分钟级启动开发,无需预置算力资源,试错成本降低80%。 -

高性能实时推理场景

🔹 实时交互应用:智能问答、推荐系统、工业实时监控等,依托昇腾优化保障低延迟、高并发推理。

🔹 技术支撑:多数据中心容灾架构,确保7×24小时稳定服务。 -

多模态应用集成

🔹 智能内容生成:结合RAG(检索增强生成)与Guard(安全防护),构建企业级知识中台、数字人交互等多模态应用。

🔹 组件化优势:快速集成LangChain等工具,实现「数据-模型-应用」闭环。

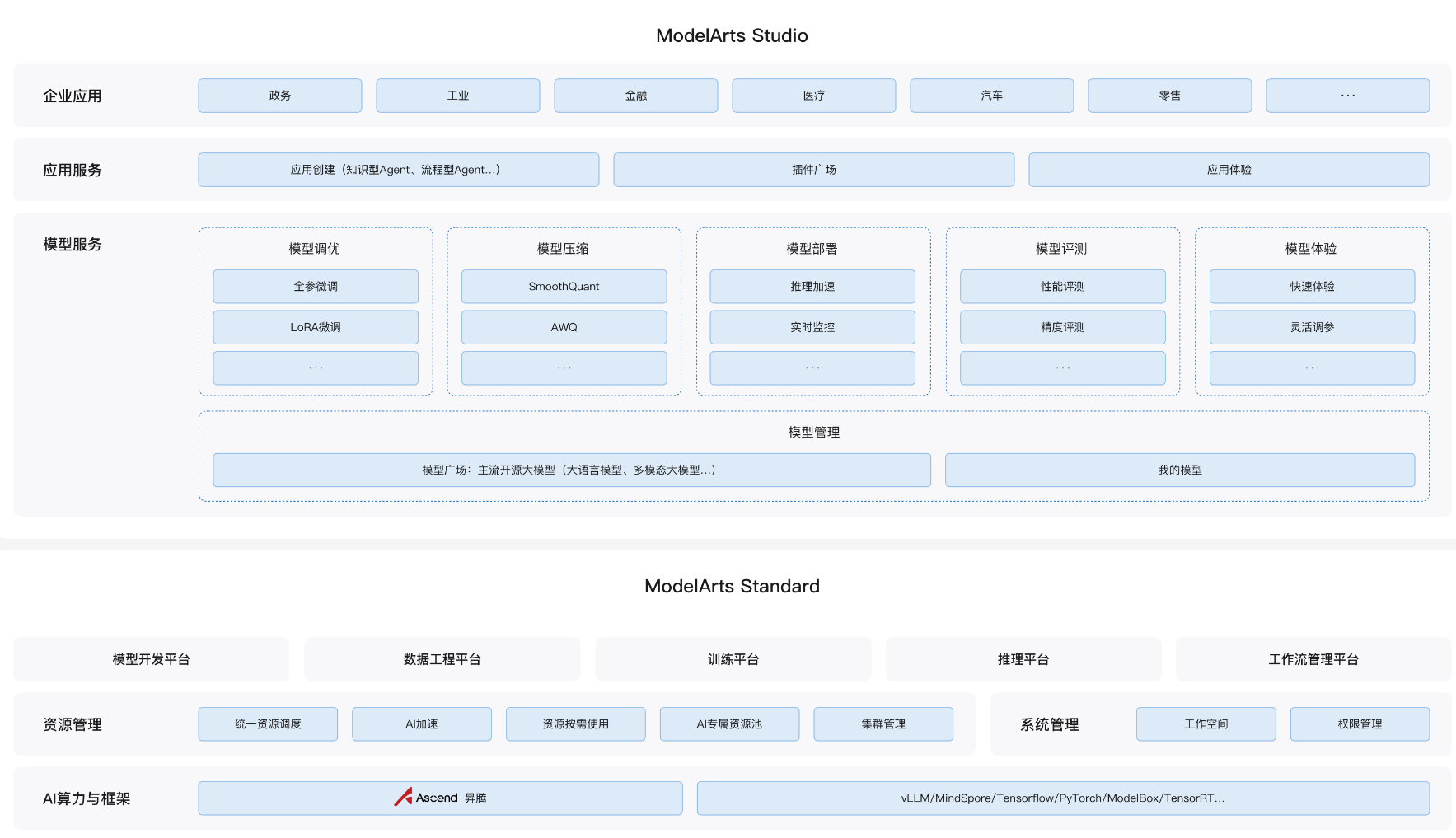

1.4 ModelArts Studio产品架构

华为云

ModelArts Studio产品架构集成了模型服务、应用服务和资源管理等多个模块,支持从模型调优、压缩到部署的全生命周期管理,并提供丰富的插件和应用体验。其底层依托于ModelArts Standard平台,涵盖模型开发、数据工程、训练和推理等核心功能,确保高效灵活的AI开发流程。通过统一资源调度和AI专属资源池,ModelArts Studio实现了资源的按需使用和快速扩展,助力企业轻松应对复杂多变的业务需求。

二、FeedMe工具介绍

2.1 FeedMe简介

FeedMe是一款轻量级、开源的 AI 驱动 RSS 阅读器,致力于为用户提供“无负担”的信息聚合体验。通过静态页面或 Docker 轻松部署,无需注册登录、无需下载客户端,即可一站式浏览多个信息源,并借助 AI 自动生成文章摘要,实现高效阅读。

2.2 FeedMe主要特点

- 多源 RSS 聚合:支持订阅多个 RSS 源,统一整合展示,轻松掌握多方资讯。

- AI 摘要生成:利用大语言模型(LLM)自动生成文章摘要,快速把握内容重点。

- 定时更新机制:集成 GitHub Actions 或 crond,自动定时抓取最新内容。

- 分类浏览:支持按类别组织信息源,便于按兴趣或主题筛选查看。

- 主题切换:提供亮色与暗色主题,适配不同使用场景和视觉偏好。

- 响应式设计:界面自适应 PC 与移动端,随时随地便捷浏览。

- 静态部署支持:可一键部署至 GitHub Pages 等静态托管平台,零成本上线。

- Docker 部署支持:提供 Docker 镜像,方便本地或私有服务器快速部署运行。

三、本次实践介绍

3.1 本次实践介绍

- 本次实践基于个人测试环境,依托华为云 Flexus X 实例与 ModelArts Studio 平台开展;

- 实践内容为将 FeedMe 工具接入 ModelArts Studio 提供的 DeepSeek 商用大模型服务,并完成 FeedMe 的部署与配置。

3.2 环境规划

| 云厂商 | 服务器 | 云服务 | 部署项目 | IP地址 | 操作系统版本 | 内核版本 | Docker版本 | 大模型 | 备注 |

|---|---|---|---|---|---|---|---|---|---|

| 华为云 | 本地服务器 | MaaS平台提供的DeepSeek商用服务 | FeedMe | 192.168.3.88 | Ubuntu 22.04.1 LTS | 5.15.0-142-generic | 28.1.1 | 华为云DeepSeek-V3-32K等 | —— |

四、环境准备工作

4.1 检查系统版本

本次实践在本地测试服务器进行,使用操作系统版本22.04.1 LTS,需要提前安装Docker环境。建议使用华为云Flexus X实例,环境部署更加方便快捷。

root@jeven01:~/feedme# vim docker-compose.yml

root@jeven01:~/feedme# cat /etc/os-release

PRETTY_NAME="Ubuntu 22.04.1 LTS"

NAME="Ubuntu"

VERSION_ID="22.04"

VERSION="22.04.1 LTS (Jammy Jellyfish)"

VERSION_CODENAME=jammy

ID=ubuntu

ID_LIKE=debian

HOME_URL="https://www.ubuntu.com/"

SUPPORT_URL="https://help.ubuntu.com/"

BUG_REPORT_URL="https://bugs.launchpad.net/ubuntu/"

PRIVACY_POLICY_URL="https

4.2 检查Docker环境

检查Docker版本,当前安装版本为

28.1.1。

root@jeven01:~/feedme# docker -v

Docker version 28.1.1, build 4eba377

检查Docker Compose版本,当前安装版本为:

v2.35.1。

root@jeven01:~/feedme# docker compose version

Docker Compose version v2.35.1

4.3 安装基础软件包

如果是初始环境,可以安装以下基础软件

apt install -y build-essential cmake curl wget gnupg unzip vim git net-tools iputils-ping software-properties-common

五、开通DeepSeek商用服务

5.1 进入ModelArts Studio控制台

ModelArts Studio是华为云提供的一个大模型即服务平台(MaaS服务),旨在简化模型开发流程,支持定制化大模型的开发,并使这些模型能够无缝集成到业务系统中。通过降低企业AI应用的成本和难度,ModelArts Studio助力企业快速实现AI技术落地。我们登录华为云官网后,进入ModelArts Studio大模型即服务平台的介绍页。官网地址:https://www.huaweicloud.com/product/modelarts/studio.html。点击“ModelArts Studio控制台”,即可进入maas服务控制台内。

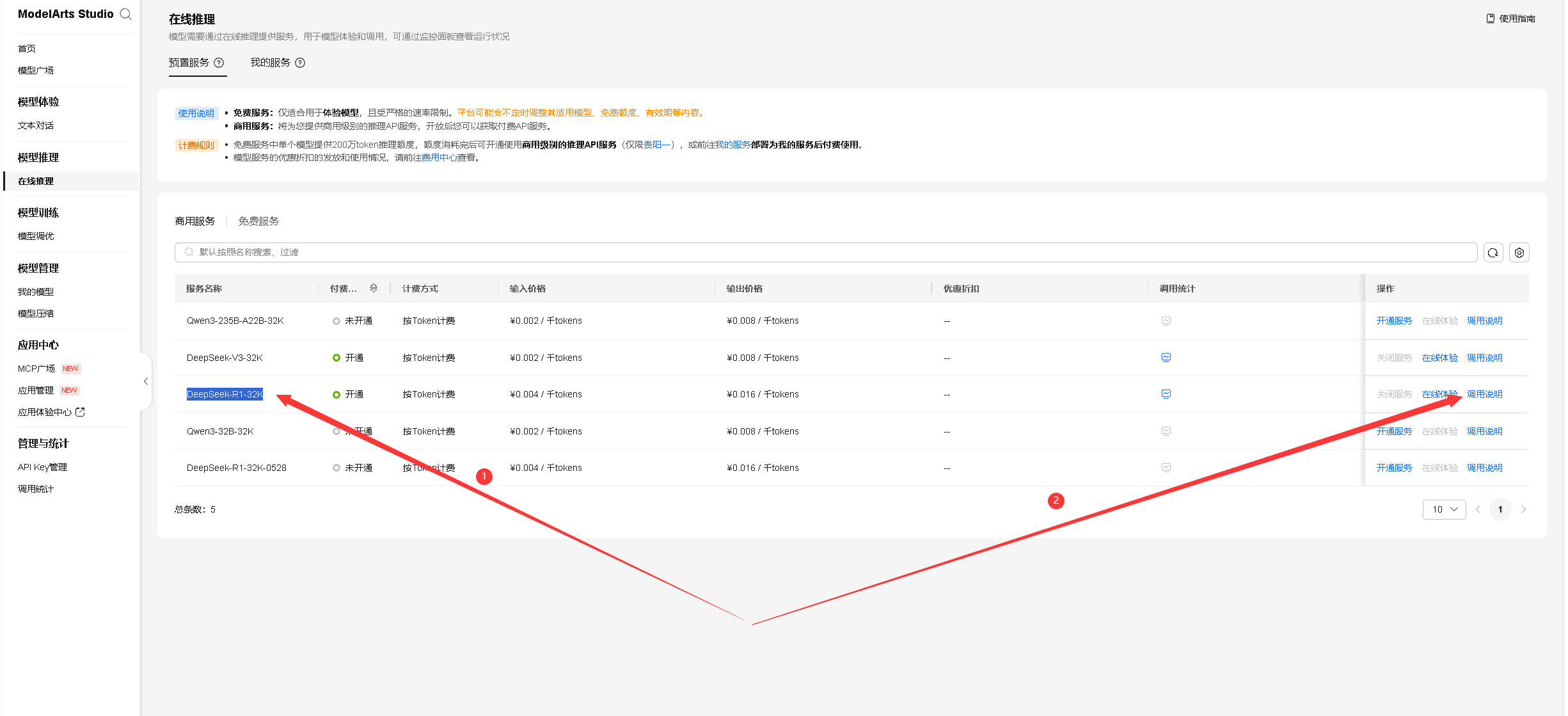

5.2 开通商业服务

访问 ModelArts Studio 大模型即服务平台后,ModelArts Studio 控制台,登录后进入 模型推理 页面,选择 在线推理 > 预置服务 > 商用服务,在模型列表中找到 DeepSeek-R1-32K,点击“开通服务”以启用该模型,具体操作如下所示:

同样的方法,我们可以开通DeepSeek-V3-32K和DeepSeek-R1-32K-0528商用服务,如下所示已正常开通。

5.3 复制OpenAI SDK信息

您可以选择某个已开通的商用服务(例如 DeepSeek-V3-32K),点击其右侧的 “调用说明” 选项,即可查看与该模型兼容的 OpenAI SDK 调用信息。请在此页面复制所需的 模型名称 和 API 地址,并保存至本地,以便后续配置和使用。

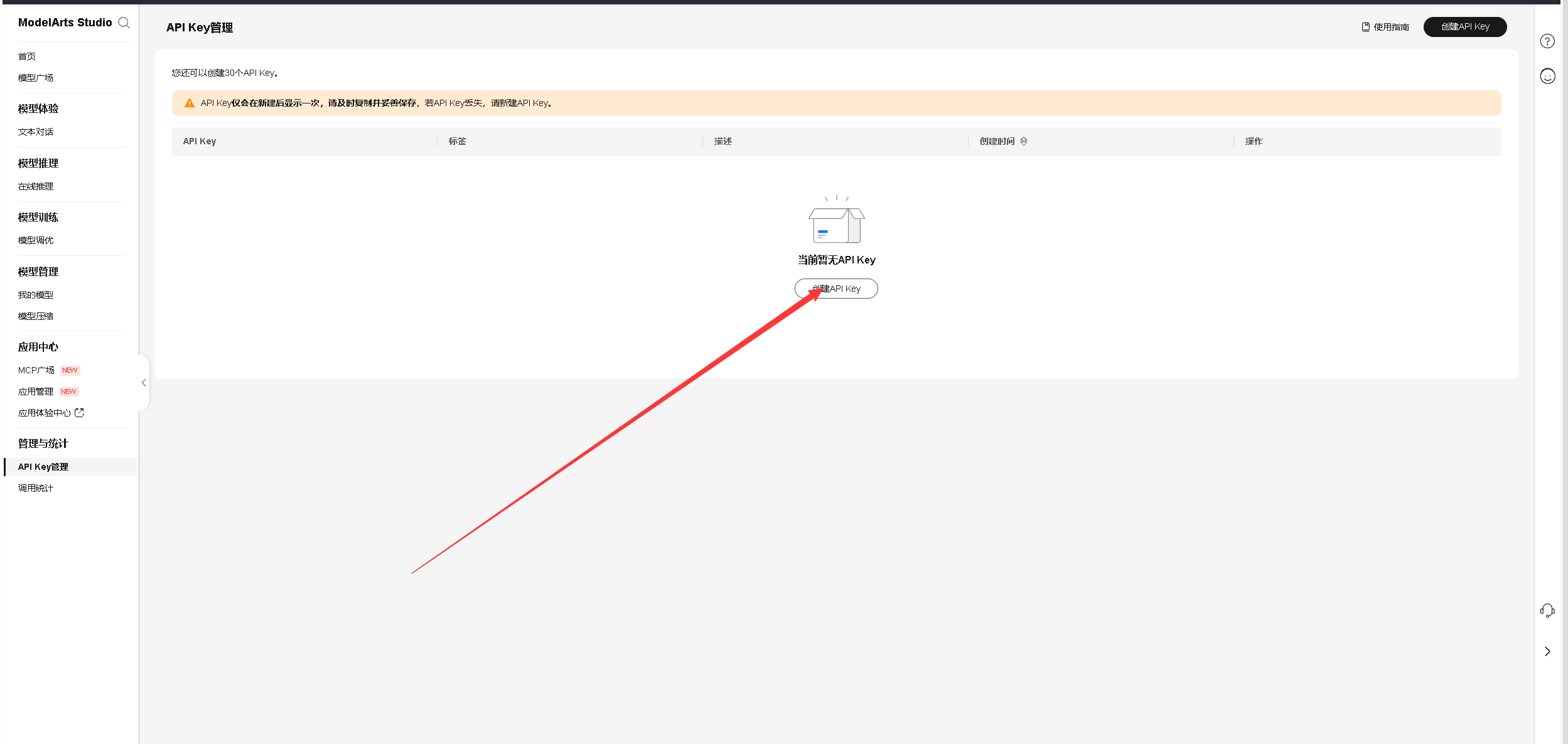

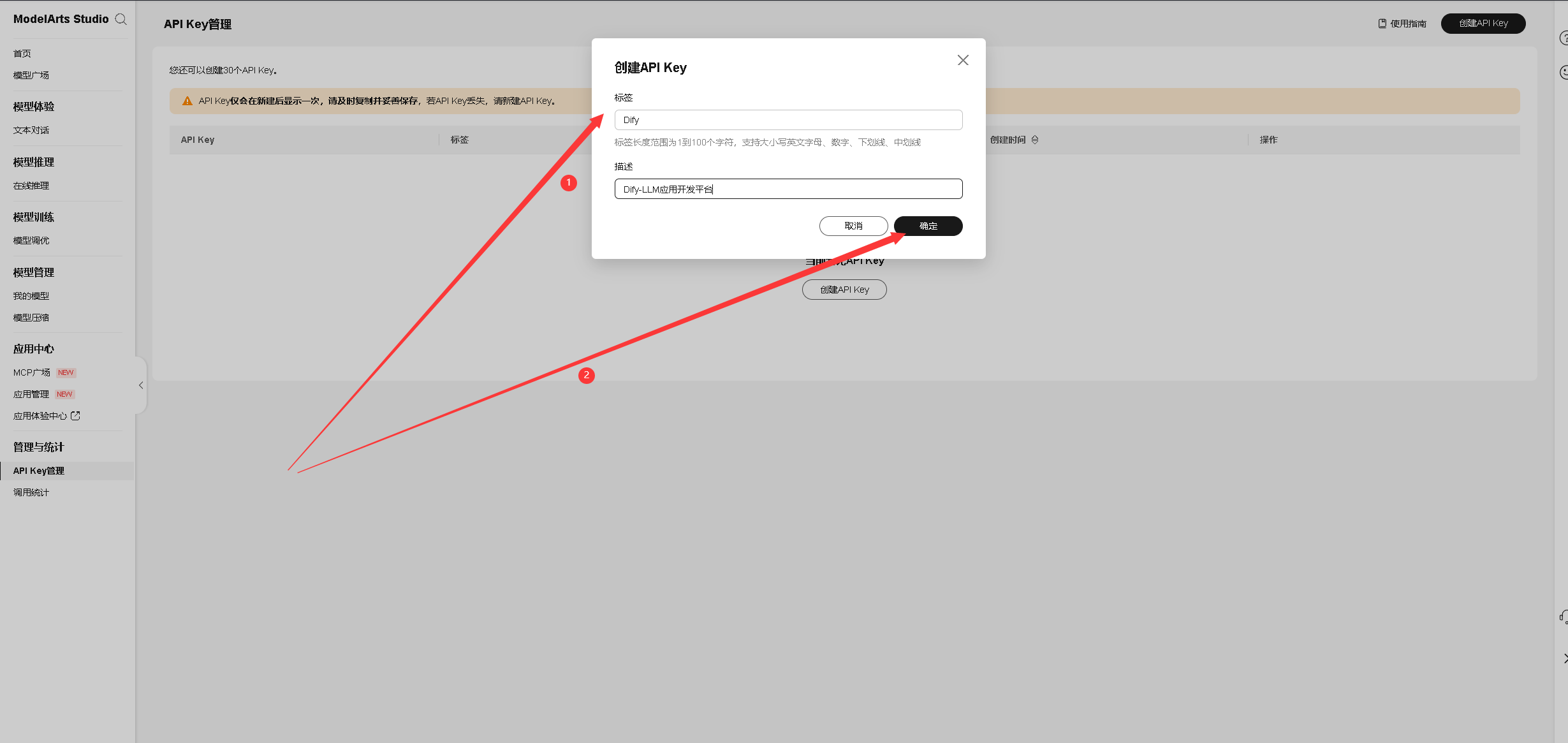

5.4 创建API key

我们在ModelArts Studio控制台左侧菜单栏中,单击“API Key管理”,开始创建API key。

填写API key的标签和描述,填写完毕后,确认创建。

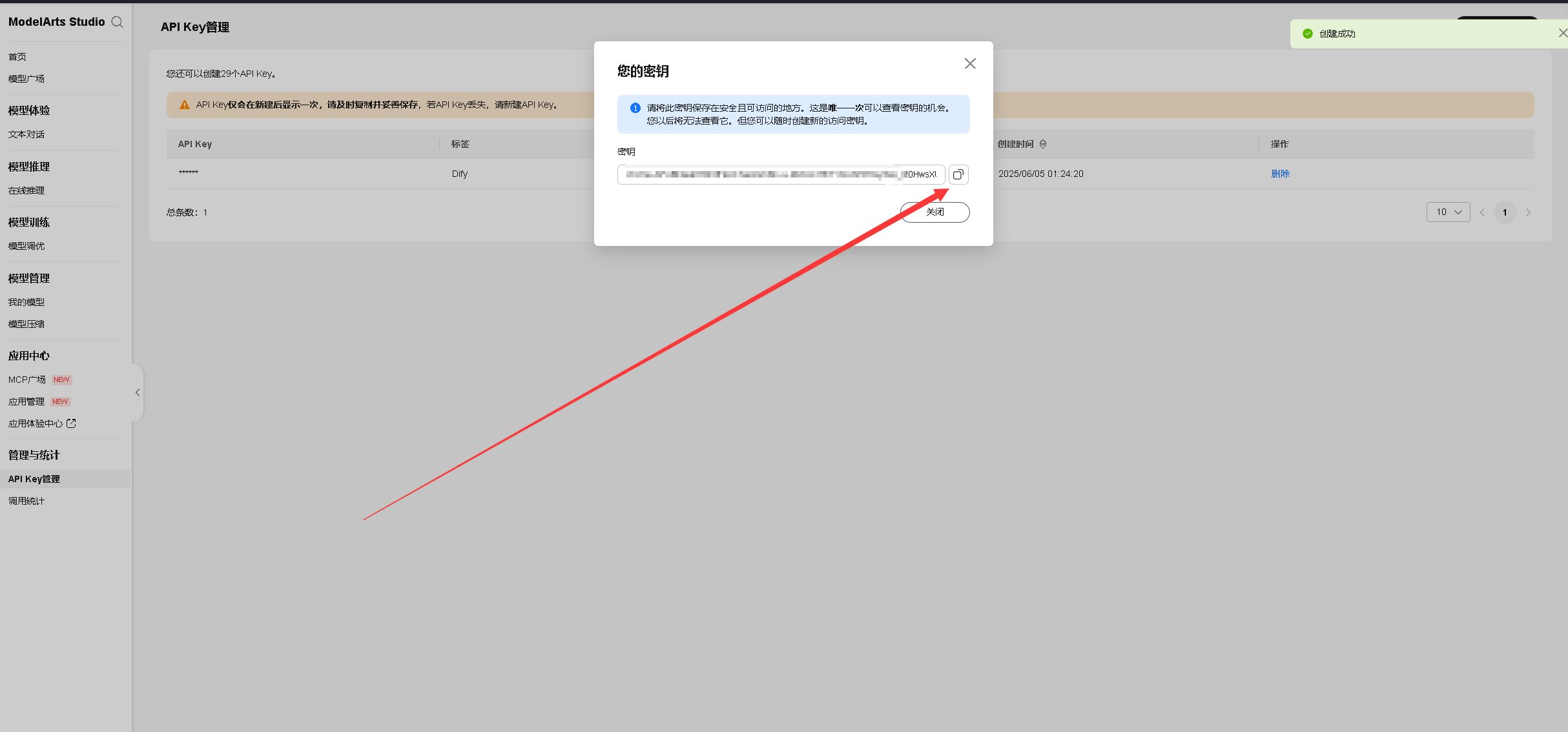

复制我们刚才生成的密钥,如下所示:

可以在本地建一个临时文本文件,将以上关键信息保存下来。

六、部署FeedMe应用

6.1 下载FeedMe项目

执行以下命令,拉取FeedMe项目。

git clone https://github.com/Seanium/feedme.git

进入FeedMe项目目录,查看项目内容如下所示:

root@jeven01:~# cd feedme/

root@jeven01:~/feedme# ll

total 280

drwxr-xr-x 11 root root 4096 Jun 25 11:37 ./

drwx------ 13 root root 4096 Jun 25 11:37 ../

drwxr-xr-x 2 root root 4096 Jun 25 11:23 app/

-rw-r--r-- 1 root root 10 Jun 25 11:23 CNAME

drwxr-xr-x 3 root root 4096 Jun 25 11:23 components/

-rw-r--r-- 1 root root 443 Jun 25 11:23 components.json

drwxr-xr-x 2 root root 4096 Jun 25 11:23 config/

-rw-r--r-- 1 root root 172 Jun 25 11:37 docker-compose.yml

-rw-r--r-- 1 root root 1119 Jun 25 11:23 Dockerfile

-rw-r--r-- 1 root root 28 Jun 25 11:23 .dockerignore

-rw-r--r-- 1 root root 167 Jun 25 11:24 .env

-rw-r--r-- 1 root root 96 Jun 25 11:23 .env.example

drwxr-xr-x 8 root root 4096 Jun 25 11:23 .git/

-rw-r--r-- 1 root root 18 Jun 25 11:23 .gitattributes

drwxr-xr-x 3 root root 4096 Jun 25 11:23 .github/

-rw-r--r-- 1 root root 532 Jun 25 11:23 .gitignore

drwxr-xr-x 2 root root 4096 Jun 25 11:23 hooks/

drwxr-xr-x 2 root root 4096 Jun 25 11:23 lib/

-rw-r--r-- 1 root root 1061 Jun 25 11:23 LICENSE

-rw-r--r-- 1 root root 1429 Jun 25 11:23 next.config.mjs

-rw-r--r-- 1 root root 2435 Jun 25 11:23 package.json

-rw-r--r-- 1 root root 154519 Jun 25 11:23 pnpm-lock.yaml

-rw-r--r-- 1 root root 135 Jun 25 11:23 postcss.config.mjs

drwxr-xr-x 2 root root 4096 Jun 25 11:23 public/

-rw-r--r-- 1 root root 9841 Jun 25 11:23 README.en.md

-rw-r--r-- 1 root root 9155 Jun 25 11:23 README.md

drwxr-xr-x 2 root root 4096 Jun 25 11:23 scripts/

-rw-r--r-- 1 root root 2210 Jun 25 11:23 tailwind.config.ts

-rw-r--r-- 1 root root 595 Jun 25 11:23 tsconfig.json

6.2 构建本地镜像

执行以下命令,构建FeedMe本地镜像。

docker compose build

检查本地容器镜像,可以看到feedme的镜像名称。

root@jeven01:~/feedme# docker images |grep feedme

feedme-feedme latest c84f1c6f2e46 35 seconds ago 737MB

6.3 修改API配置文件

在项目目录下,修示例变量文件名称为

.env。

cp .env.example .env

修改.env文件内容为华为云maas保存的Open SDK相关信息。

root@jeven01:~/feedme# cp .env.example .env

root@jeven01:~/feedme# cat .env

LLM_API_KEY=your_api_key

LLM_API_BASE=https://api.siliconflow.cn/v1

LLM_NAME=THUDM/GLM-4-9B-0414

- 修改内容为:

LLM_API_KEY=your_api_key # 填写华为云maas的API Key

LLM_API_BASE=https://api.modelarts-maas.com/v1 # 华为云maas服务的API地址

LLM_NAME=DeepSeek-V3

6.4 修改配置文件

在部署目录下,我们修改 config/rss-config.js 文件,用于定义和管理所有的 RSS 源及其相关配置。

vim config/rss-config.js

可以自行添加或删除RSS源部分,如下所示

6.5 修改部署文件

在部署目录下,我们修改部署文件。

vim docker-compose.yaml

version: '3'

services:

feedme:

build: .

ports:

- "3000:3000"

volumes:

- ./.env:/app/.env

- ./config:/app/config

- ./data:/app/data

container_name: feedme

restart: unless-stopped

📁 目录结构与映射说明

| 宿主机路径 | 容器内挂载路径 | 用途说明 |

|---|---|---|

~/feedme/env.txt |

/app/.env |

存放环境配置信息,包括定时任务设置、RSS 源地址等关键参数。该文件主要用于容器启动时加载配置变量。 |

~/feedme/data |

/app/data |

用于存储 RSS 源抓取和解析后的数据内容,如文章列表、更新时间、源元信息等,是运行过程中产生的持久化数据目录。 |

~/feedme/config |

/app/config |

存放系统配置文件,包含 RSS 源定义、任务调度规则及其他应用所需配置,供应用程序读取使用。 |

6.6 创建FeedMe容器

执行以下命令,创建FeedMe容器。

docker compose up -d

6.7 检查容器状态

检查容器状态,确保FeedMe相关容器都正常启动。

root@jeven01:~/feedme# docker compose ps

WARN[0000] /root/feedme/docker-compose.yml: the attribute `version` is obsolete, it will be ignored, please remove it to avoid potential confusion

NAME IMAGE COMMAND SERVICE CREATED STATUS PORTS

feedme feedme-feedme "/app/scripts/entryp…" feedme 30 seconds ago Up 29 seconds 0.0.0.0:3000->3000/tcp, [::]:3000->3000/tcp

6.8 检查容器日志

检查FeedMe容器日志,可以看到FeedMe服务正常运行。

docker compose logs

七、访问FeedMe服务

浏览器访问http://<服务器IP地址>:3000,将IP替换为自己服务器IP地址,访问FeedMe的初始页。如果无法访问到该页面,需要检查操作系统的防火墙是否关闭或放行相关服务端口。

可以看到订阅的 RSS 源内容,FeedMe 不仅能实时抓取更新,还能对新发布的内容进行 AI 自动生成摘要和总结,大大提升了信息获取效率。这种结合大模型能力的智能处理方式,使得用户无需逐篇阅读原文,即可快速掌握核心要点。同时,FeedMe 的界面简洁、操作流畅,配合华为云 ModelArts 平台提供的高性能推理能力,整体使用体验非常出色。

八、实践体验与总结

✨ 高效稳定的AI开发平台,赋能创新应用落地

本次实践过程中,华为云ModelArts Studio展现出卓越的性能与稳定性。从开通DeepSeek商用服务到部署FeedMe应用,整个流程顺畅无阻,极大提升了开发效率。特别是其对OpenAI SDK的良好兼容性,使得API调用过程简洁高效,充分体现了华为云在AI生态建设方面的深厚积累。同时,结合Docker容器化部署能力,实现了FeedMe应用的快速上线和灵活扩展,真正做到了“开箱即用”。

🚀 智能驱动的信息获取新时代

通过将华为云ModelArts与开源工具FeedMe相结合,我们成功打造了一个AI驱动的RSS阅读系统。这一系统不仅能聚合海量信息源,还能借助大模型的理解与摘要能力,为用户提供个性化、智能化的阅读体验。整个实践过程不仅验证了华为云平台的强大能力,也让我们看到了未来信息处理方式的无限可能。

📢 选择华为云,让AI更简单、更强大!

828 B2B企业节已经开幕,汇聚千余款华为云旗下热门数智产品,更带来满额赠、专属礼包、储值返券等重磅权益玩法,是中小企业和开发者上云的好时机,建议密切关注官方渠道,及时获取最新活动信息,采购最实惠的云产品和最新的大模型服务!

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)