Hugging Face和langchain的区别

选择依据推荐需要预训练模型或数据集选 Hugging Face要微调或训练新模型选 Hugging Face构建基于LLM的应用程序选 LangChain实现多步骤AI工作流选 LangChain创建自主AI代理选 LangChain模型演示和分享选 Hugging Face最佳实践:在真实项目中,通常同时使用两者用 H

·

Hugging Face vs LangChain:核心区别详解

Hugging Face 和 LangChain 都是现代 AI 开发中至关重要的工具,但它们解决的是完全不同层面的问题。以下是两者的核心区别对比:

🧠 本质定位对比

| 维度 | Hugging Face | LangChain |

|---|---|---|

| 核心定位 | 模型中心 | 应用框架 |

| 主要功能 | 提供/托管预训练模型和数据集 | 构建基于大语言模型的应用工作流 |

| 类比 | 类似 GitHub(用于模型) | 类似 Spring(用于AI应用开发) |

| 核心价值 | 模型即服务(Model-as-a-Service) | 应用编排即服务(Orchestration-as-a-Service) |

🛠️ 功能对比

Hugging Face 的核心能力

graph TD

A[Hugging Face] --> B[模型仓库]

A --> C[数据集中心]

A --> D[推理API]

A --> E[训练工具]

A --> F[演示空间]- 模型中心:50万+预训练模型(NLP/CV/语音)

- 数据集:4万+公开数据集

- Transformers库:标准化模型加载和推理接口

- Spaces:零代码模型演示部署

LangChain 的核心能力

graph TD

A[LangChain] --> B[工作流编排]

A --> C[工具集成]

A --> D[记忆管理]

A --> E[提示工程]

A --> F[多模型路由]- 链式工作流:组合多步骤AI任务

- 工具调用:集成搜索引擎/计算器/API

- 记忆系统:管理对话历史和上下文

- 代理系统:创建自主AI智能体

💻 技术栈对比

| 能力 | Hugging Face | LangChain |

|---|---|---|

| 模型支持 | 直接提供模型文件/权重 | 通过适配器连接各种模型提供商 |

| 模型训练 | ✅ 完整训练工具 | ❌ 不提供 |

| 模型部署 | ✅ 托管推理端点 | ❌ 需自行部署 |

| 应用编排 | ❌ 有限支持 | ✅ 核心能力 |

| 外部工具集成 | ❌ 需自定义 | ✅ 内置100+工具连接器 |

| 提示工程 | ❌ 基础支持 | ✅ 高级模板和优化 |

| 多模型协同 | ❌ 不支持 | ✅ 智能路由和组合 |

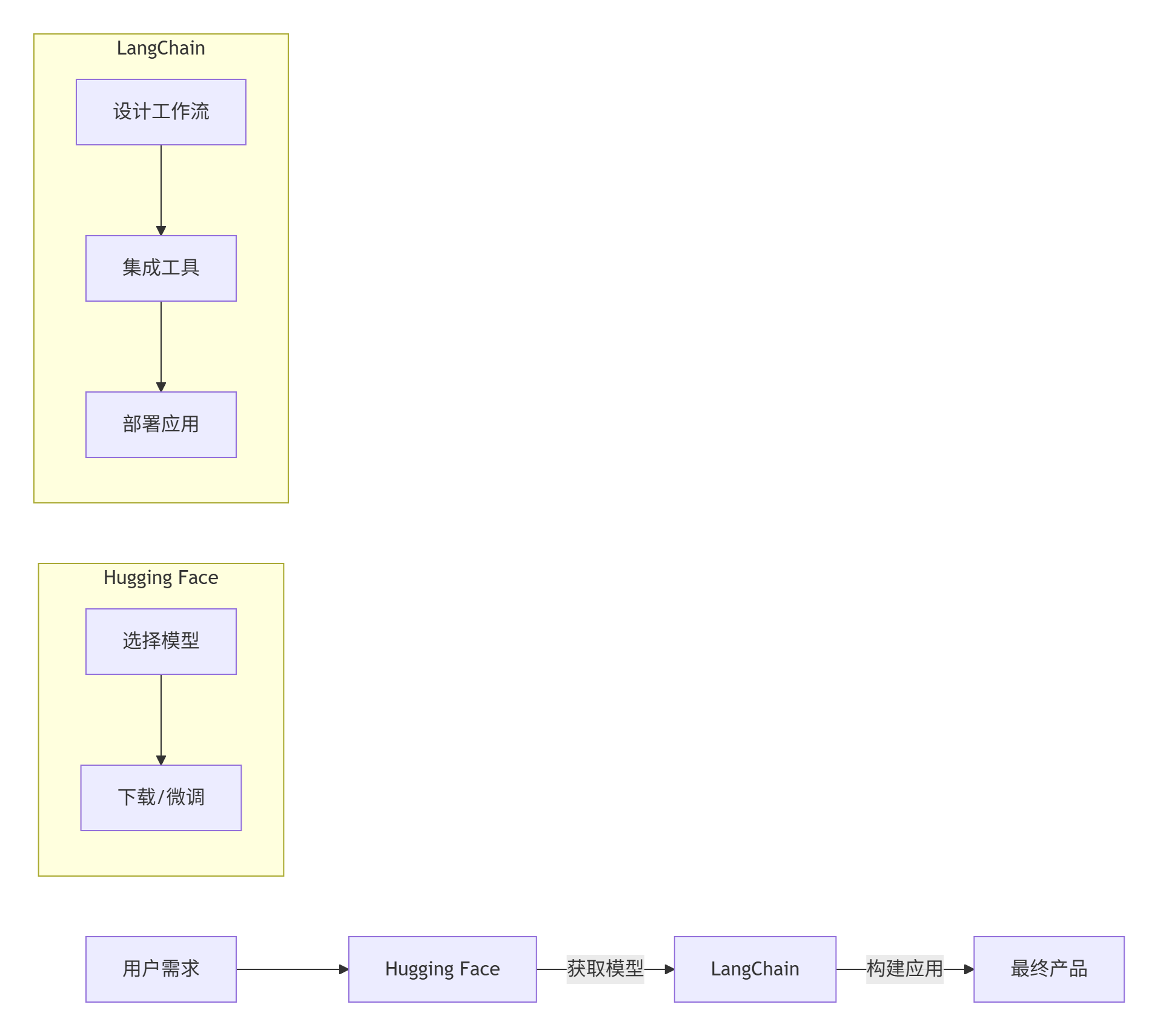

🧩 协同工作场景

在实际开发中,两者不是竞争关系而是互补关系:

典型协作流程:

- 从 Hugging Face Hub 选择合适模型(如

bert-base-uncased) - 使用 Transformers 库加载模型

- 通过 LangChain 创建处理链:

from langchain_community.llms import HuggingFacePipeline from langchain.chains import LLMChain # 创建Hugging Face管道 hf_pipeline = pipeline("text-generation", model="bert-base-uncased") llm = HuggingFacePipeline(pipeline=hf_pipeline) # 构建LangChain工作流 chain = LLMChain(llm=llm, prompt=my_prompt_template) result = chain.run(user_input) - 添加外部工具(搜索/计算器等)

- 部署为完整应用

🏗️ 开发体验对比

Hugging Face 开发模式:

# 专注于模型本身

from transformers import pipeline

# 加载模型

classifier = pipeline("sentiment-analysis")

# 直接推理

result = classifier("I love this product!")LangChain 开发模式:

# 专注于应用逻辑

from langchain_openai import ChatOpenAI

from langchain.agents import AgentExecutor, create_tool_calling_agent

# 创建AI代理

agent = create_tool_calling_agent(

llm=ChatOpenAI(model="gpt-4"),

tools=[search_tool, calculator_tool],

prompt=agent_prompt

)

# 执行复杂任务

agent_executor = AgentExecutor(agent=agent)

result = agent_executor.invoke({

"input": "计算特斯拉当前股价,并分析近期趋势"

})📊 适用场景对比

| 场景 | 推荐工具 | 原因 |

|---|---|---|

| 微调预训练模型 | 🤗 Hugging Face | 提供完整训练工具和基础设施 |

| 部署模型演示 | 🤗 Hugging Face | Spaces 提供免费托管 |

| 构建客服聊天机器人 | 🔗 LangChain | 内置对话管理和工具调用 |

| 创建AI数据分析助手 | 🔗 LangChain | 可连接数据库和可视化工具 |

| 研究新模型架构 | 🤗 Hugging Face | 最新模型实现和论文复现 |

| 企业级AI工作流 | 🔗 LangChain | 支持复杂编排和权限管理 |

💡 总结:如何选择?

| 选择依据 | 推荐 |

|---|---|

| 需要预训练模型或数据集 | 选 Hugging Face |

| 要微调或训练新模型 | 选 Hugging Face |

| 构建基于LLM的应用程序 | 选 LangChain |

| 实现多步骤AI工作流 | 选 LangChain |

| 创建自主AI代理 | 选 LangChain |

| 模型演示和分享 | 选 Hugging Face |

最佳实践:

在真实项目中,通常同时使用两者:

- 用 Hugging Face 获取/微调模型

- 用 LangChain 构建应用逻辑

- 通过 LangChain 的

HuggingFacePipeline集成 Hugging Face 模型

两者共同构成了现代AI开发的完整技术栈,Hugging Face 是"模型层"的标准,而 LangChain 是"应用层"的框架。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)