利用ollama部署本地大模型 离线使用

可以看到ollama要求 glibc_2.27库,如果采用这个方法 就需要安装这个库。下载到本地,约1.2G;

方法1:下载ollama安装包

第一步:从ollama下载ollama的网址下载到本地,约1.2G;

第二步:通过sftp上载到服务器/user/local 目录,并解压缩:

tar -xzf ollama-linux-amd64.tgz;

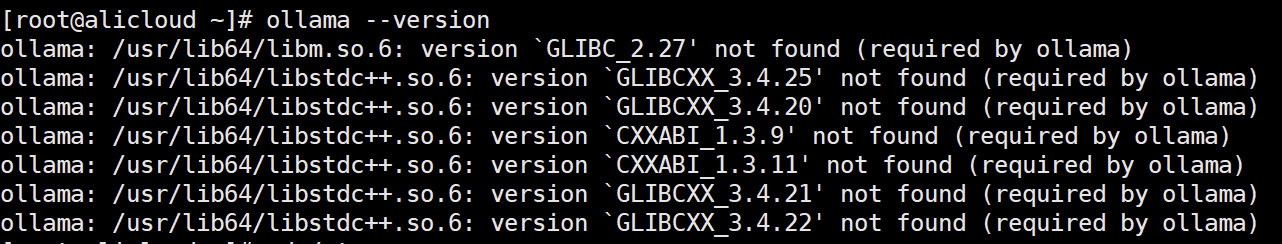

第三步:ollama --version,查看ollama是否安装成功,但是报错如下:

可以看到ollama要求 glibc_2.27库,如果采用这个方法 就需要安装这个库

是因为操作系统版本太老了,我是在Centos 7.8上操作的

方法2:利用docker安装ollama

第一步:拉取ollama镜像:docker pull ollama/ollama

第二步:运行:docker run -d -v ollama-data:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

第三步:docker exec -it ollama ollama run deepseek-r1:7b(首次运行会自动拉取模型)

第四步:测试:curl http://localhost:11434/api/generate -d '{

"model": "deepseek-r1:7b",

"prompt": "为什么天空是蓝色的?",

"stream": false

}'

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)