Dify学习-09-智筛简历-实际操作-√

智筛简历

·

项目代码

https://github.com/BannyLon/DifyAIA/blob/main/Dify%20workflow/%E6%99%BA%E7%AD%9B%E7%AE%80%E5%8E%86.yml

输入

简历.docx

个人信息

姓名:张伟

电话:(+86) 138-1234-5678

邮箱:zhangwei.llm@email.com

GitHub:github.com/zhangwei-ai(附LLM相关项目链接)

LinkedIn:linkedin.com/in/zhsangwei-llm

现居地:北京 | 可远程/异地办公

技术博客:zhangwei.ai(可选,如有技术文章可增加)

教育背景

清华大学 | 工学硕士 | 计算机科学与技术(人工智能方向)

2020.09 - 2023.06

主修课程:自然语言处理、分布式机器学习、大模型架构设计

毕业论文:《基于LLaMA-2的医疗问答系统低资源微调方法研究》(TOP 10%论文)

北京大学 | 工学学士 | 软件工程

2016.09 - 2020.06

工作经历

字节跳动 | 大模型应用工程师(高级)

2023.07 - 至今

模型优化:主导公司内部大模型(参数量10B+)的微调与推理加速,通过LoRA/P-Tuningv2降低显存占用35%,推理速度提升40%;

落地应用:开发电商场景多模态大模型应用(文本+图像生成),支持日均100万次调用,错误率低于0.5%;

技术攻关:设计动态Prompt框架,结合用户行为数据提升推荐系统CTR 15%;

阿里巴巴 | 算法工程师(实习)

2022.03 - 2022.12

参与千问大模型早期开发,负责数据清洗与SFT阶段实验,显著降低有害输出概率;

搭建基于BERT的客服意图分类系统,准确率提升至92%。

项目经验

项目名称:金融领域大模型智能投顾系统

技术栈:LLaMA-2-13B、LangChain、Faiss向量数据库、FastAPI

成果:支持实时金融政策解读与投资建议生成,客户满意度提升25%,获公司创新奖。

项目名称:开源中文大模型微调工具链

技术栈:PyTorch、Deepspeed、vLLM

成果:GitHub Star 500+,被3家初创企业采用。

技能专长

大模型技术:全流程开发(预训练/微调/部署)、推理优化(量化/FlashAttention)、Agent开发

编程语言:Python(熟练使用asyncio高性能框架)、C++(模型底层优化)

工具链:HuggingFace Transformers、MLflow、Docker/K8s、Prometheus监控

语言能力:英语(CET-6,可熟练阅读AI论文)

证书与荣誉

Kaggle LLM竞赛银牌(2023)

国家奖学金(2021)

发明专利:《一种大模型安全对齐方法》(公开号CNXXXXXX)

自我评价

深耕大模型技术栈,熟悉行业最新进展(如Mixtral、Gemma等),长期贡献开源社区;

兼具算法研究与工程落地能力,擅长将论文成果转化为实际业务价值;

热爱技术分享,主导团队内部LLM技术培训10+场。

岗位信息

岗位职责

大模型开发与优化:

负责大语言模型(如GPT、LLaMA、Claude等)的微调(Fine-tuning)、提示工程(Prompt Engineering)及性能优化(推理加速、量化部署等);

探索大模型的高效训练方法(如LoRA、P-Tuning、QLoRA等),降低计算资源消耗;

解决模型在实际业务场景中的幻觉(Hallucination)、偏见(Bias)等安全问题。

应用落地与工程化:

基于大模型开发行业解决方案(如智能客服、知识库问答、内容生成等),完成端到端的技术闭环;

结合RAG(检索增强生成)、Agent框架(如LangChain、AutoGen)提升模型在垂直领域的准确性;

设计高并发、低延迟的推理服务架构(如vLLM、TGI),支持企业级需求。

技术研究与创新:

跟踪大模型领域最新进展(如MoE、长上下文优化、多模态理解),推动技术迭代;

参与开源社区贡献,或内部工具链开发(如数据清洗、评估平台)。

任职要求

硬性条件:

学历:计算机、人工智能、数学等相关专业本科及以上学历;

经验:3年以上NLP/大模型相关经验,至少1个完整的大模型落地项目;

技术栈:

精通Python,熟悉PyTorch/TensorFlow框架;

深入理解Transformer架构及大模型关键技术(注意力机制、位置编码等);

熟悉大模型生态工具(HuggingFace、LangChain、LlamaIndex等);

有分布式训练(Deepspeed/FSDP)、模型量化(GGUF/AWQ)经验者优先。

加分项:

发表过LLM相关顶会论文(ACL/EMNLP/NeurIPS);

熟悉大模型安全对齐(Safety Alignment)或垂直领域微调(医疗/法律/金融);

有云服务(AWS/GCP/Azure)或高性能计算(CUDA、TRT)经验。

软技能:

强烈的技术好奇心,能快速学习并应用新技术;

良好的沟通能力,能协同算法、产品、业务团队推进项目。

运行程序

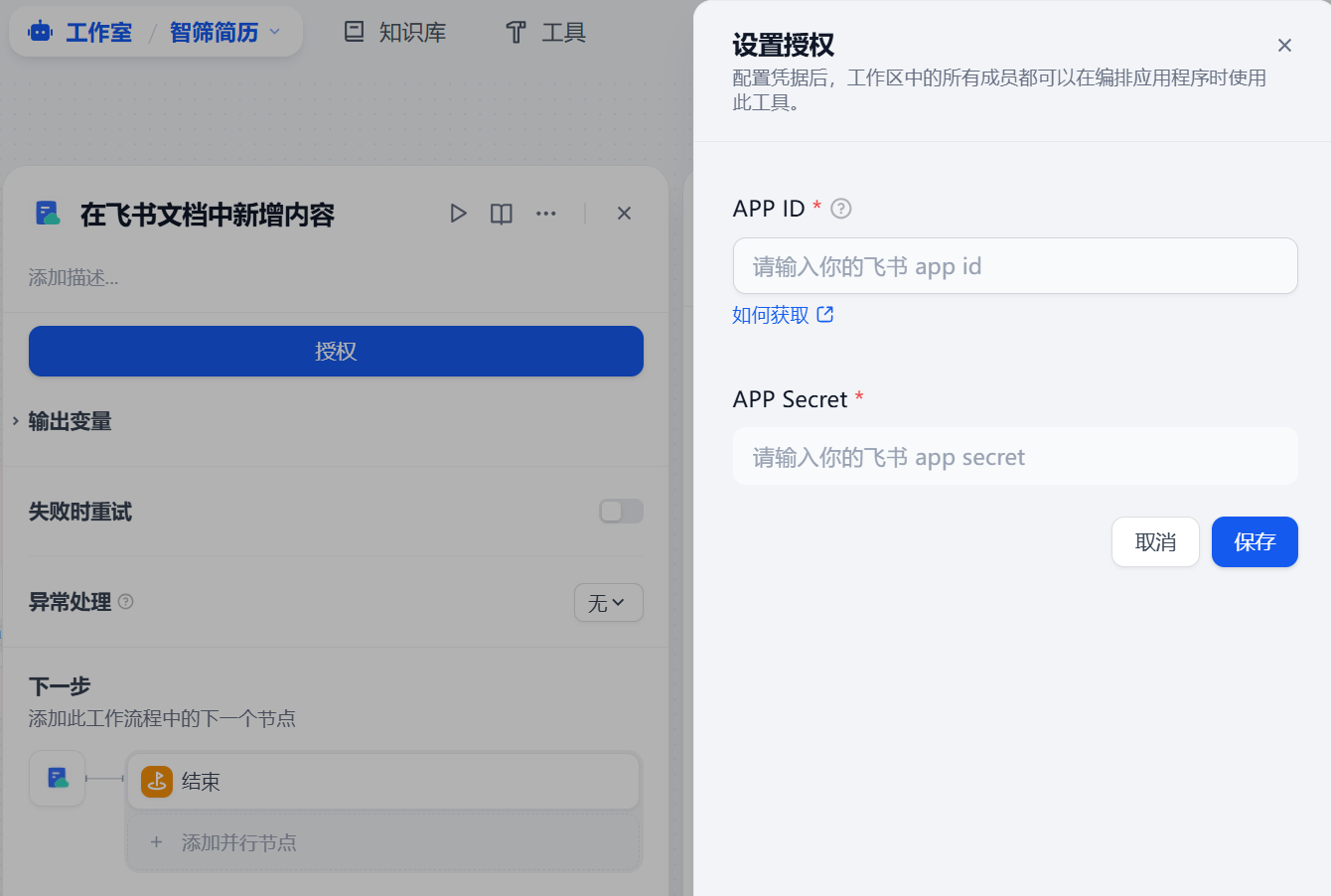

飞书哦吼,不能用

为什么非要搞自己的飞书呢,就不能是word文档直接用吗,公司的账号大家都可以看到,这不就是尴尬了吗

很无语了

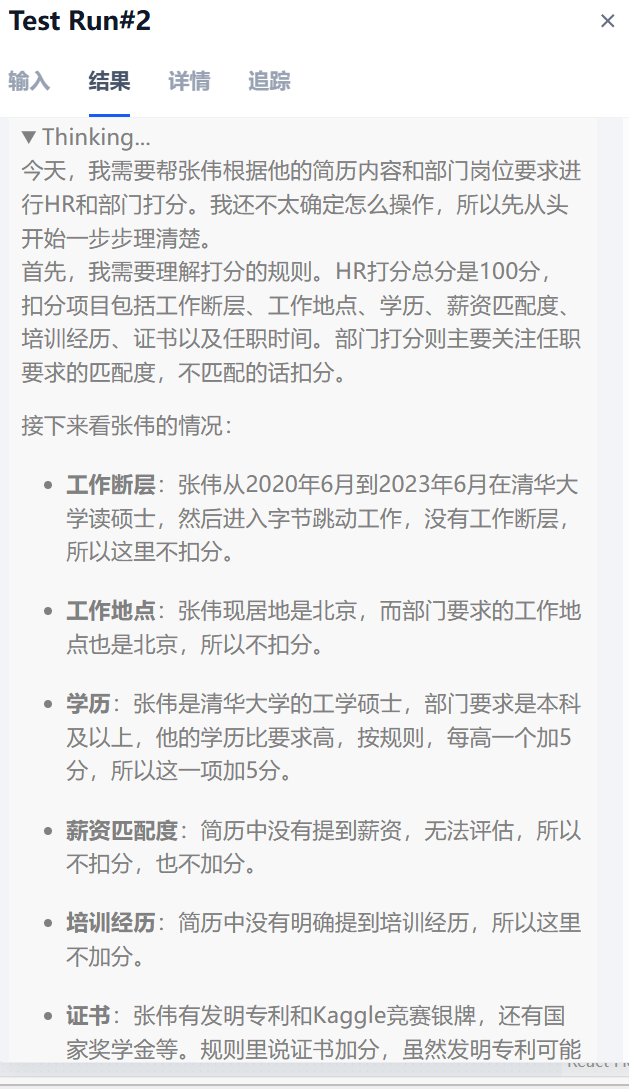

LLM评测

你是一个招聘专家,你根据简历{{#1742648746427.text#}}的内容,结合部门岗位要求:“{{#1742643330552.zhaopinyaoqiu#}}”进行打分,打分分为HR打分,部门打分

###HR打分

*总分:100分

*工作断层:工作有1-3个月断层扣5分

*工作地点与部门要求不一致扣25分

*学历分,学历低于部门要求的扣25分,高于部门要求,每高一个级别增加5分

*薪资匹配度,薪资和部门要求有上浮,下浮10%的扣5分,每增加幅度5%扣5分,如果是员工简历低于部门要求幅度情况不扣分。

*培训经历,有培训经历加5分

*证书,有证书加5分

*往期单个公司任职时间,某一段履历低于6个月的扣10分。

###部门打分

*总分:100分

*任职要求,简历中和任职要求匹配度,不匹配扣25分。

*其他方面不做扣分

输出要求:只输出 顺序后的:员工姓名,手机,学历,邮箱,HR打分,部门打分,输出到一个表格格式进行输出,表格输出在前,分析过程输出在后。

输出部门岗位要求:

LLM的输出

{

"text": "<details style=\"color:gray;background-color: #f8f8f8;padding: 8px;border-radius: 4px;\" open> <summary> Thinking... </summary>\n嗯,现在我要根据用户提供的简历内容和部门岗位要求来为张伟进行HR和部门打分。首先,我要理清楚评分规则,然后逐一分析张伟的简历和岗位要求,看看他符合条件吗。\n\n首先,HR打分总分是100分,包含几个扣分项:工作断层、工作地点、学历、薪资匹配度、培训经历、证书、任职时间。部门打分则更关注任职要求的匹配度,不匹配的话扣分。\n\n先看HR部分:\n\n1.</details><details style=\"color:gray;background-color: #f8f8f8;padding: 8px;border-radius: 4px;\" open> <summary> Thinking... </summary> 工作断层:张伟的工作经历从2020年6月到2023年6月在清华大学读硕士,然后进入字节跳动工作,没断层,所以不扣分。\n2.</details><details style=\"color:gray;background-color: #f8f8f8;padding: 8px;border-radius: 4px;\" open> <summary> Thinking... </summary> 工作地点:张伟现居地是北京,符合部门要求,所以不扣分。\n3.</details><details style=\"color:gray;background-color: #f8f8f8;padding: 8px;border-radius: 4px;\" open> <summary> Thinking... </summary> 学历:张伟是清华大学工学硕士,部门要求本科及以上,所以高于要求,按规则,每高一个级别加5分,本科是学士,硕士是更高一级,所以加5分。\n4.</details><details style=\"color:gray;background-color: #f8f8f8;padding: 8px;border-radius: 4px;\" open> <summary> Thinking... </summary> 薪资匹配度:简历中没有提到薪资,所以无法评估,可能不扣分。\n5.</details><details style=\"color:gray;background-color: #f8f8f8;padding: 8px;border-radius: 4px;\" open> <summary> Thinking... </summary> 培训经历:简历中没有明确提到培训经历,所以不加分。\n6. 证书:张伟有发明专利和Kaggle竞赛银牌、国家奖学金等,但根据规则,只有证书加分,专利可能不算,所以可能加5分?不确定,还是算有证书,加5分。\n7. 任职时间:张伟在阿里巴巴实习了9个月,足够长,没有低于6个月的履历,所以不扣分。\n\n综上,HR打分:学历加5分,证书加5分,总分100+10=110?不对,总分100,加分应该不超过上限。可能HR打分是100+5+5=110,但可能最高100,所以可能不叠加,只额外加分。\n\n部门打分:\n\n主要看任职要求的匹配度。张伟的工作经历和技能都符合岗位要求:大模型开发与优化、应用落地、技术研究等。他有主导大模型微调、优化经验,熟悉相关技术和工具栈,还有项目经验,所以匹配度高,不扣分。\n\n不过,部门打分是按匹配度,如果完全匹配,可能不扣分,否则扣分。张伟的简历看起来和岗位要求非常吻合,所以部门打分应该是100分。\n\n综合来看,HR打分110,部门打分100。不过可能加分需要调整,因为HR总分最高是100,加分可能在基础上额外加分,比如学历和证书各加5,总分100+10=110,但可能不会超过100。或者,HR打分是100,加上学历和证书各5分,总分为110。这需要根据评分规则是否允许总分超过100来定。\n\n最终,员工姓名张伟,手机(+86) 138-1234-5678,学历硕士,邮箱zhangwei.llm@email.com,HR打分110,部门打分100。\n</details>\n\n### **表格输出**\n\n| 员工姓名 | 手机 | 学历 | 邮箱 | HR打分 | 部门打分 |\n|----------|-----------------|--------|-------------------------------|--------|----------|\n| 张伟 | (+86) 138-1234-5678 | 硕士 | zhangwei.llm@email.com | 110 | 100 |\n\n---\n\n### **分析过程**\n\n#### **HR打分**\n\n1. **工作断层**:张伟的工作经历无断层,符合要求,不扣分。\n2. **工作地点**:张伟现居地为北京,与部门要求一致,不扣分。\n3. **学历**:张伟的学历为工学硕士,高于部门要求的本科,增加5分。\n4. **薪资匹配度**:简历中未提供薪资信息,无法评估,不扣分。\n5. **培训经历**:简历中未明确提及培训经历,不加分。\n6. **证书**:张伟有发明专利和Kaggle竞赛银牌等,加分5分。\n7. **往期单个公司任职时间**:张伟的工作经历均符合要求,无低于6个月的履历,不扣分。\n\n**HR总分**:100 + 5(学历加分) + 5(证书加分) = **110分**。\n\n---\n\n#### **部门打分**\n\n1. **任职要求匹配度**:\n - **大模型开发与优化**:张伟在字节跳动主导大模型(10B+参数)的微调与推理加速,熟悉LoRA、P-Tuning等技术,符合要求。\n - **应用落地与工程化**:张伟参与电商场景的多模态大模型应用开发,并设计动态Prompt框架,提升推荐系统效果,符合要求。\n - **技术研究与创新**:张伟跟踪LLM领域最新进展,参与开源社区贡献,符合要求。\n - **技能专长**:张伟熟悉PyTorch、HuggingFace等工具链,掌握大模型技术栈,符合要求。\n - **证书与荣誉**:张伟具备发明专利和Kaggle竞赛银牌,提升技术背景,符合要求。\n\n**部门总分**:100分(简历与要求高度匹配,无扣分项)。\n\n---\n\n### **总结**\n\n张伟的简历与部门岗位要求高度匹配,且具备丰富的实践经验和技术能力,是理想的候选人。",

"usage": {

"prompt_tokens": 4088,

"prompt_unit_price": "0",

"prompt_price_unit": "0",

"prompt_price": "0E-7",

"completion_tokens": 3541,

"completion_unit_price": "0",

"completion_price_unit": "0",

"completion_price": "0E-7",

"total_tokens": 7629,

"total_price": "0E-7",

"currency": "USD",

"latency": 56.494817671133205

},

"finish_reason": "stop"

}

输出结果

其实这个项目应该输出的是word文档,但目前公司的工具没有找到doc工具,飞书需要进行授权,所以只进行文字的输出。输出的结果

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)