ModelHub XC+曦望S2|风洞计算大模型适配 垂直领域国产化进程迈出关键一步

此次适配的风洞计算模型,其底层算法架构为PointNet++,模型复杂度高,计算需求密集。这是行业内首次在国产芯片上实现垂直领域复杂大模型的完整适配,并达到可商用、可部署的生产级性能标准,标志着关键垂直领域计算基础设施自主化进程取得实质性突破,垂直领域复杂大模型的国产化进程迈出了至关重要的一步。双方认为,这次合作,不仅是ModelHub XC与曦望技术协同的里程碑,更为我国在关键领域构建安全、可靠

近日,AI服务领域的领导者第四范式与国产新锐芯片厂商曦望共同宣布,基于第四范式上月发布的ModelHub XC搭载的自研架构级适配体系EngineX,双方携手实现了风洞计算大模型在国产芯片曦望S2上的完整适配与深度优化。这是行业内首次在国产芯片上实现垂直领域复杂大模型的完整适配,并达到可商用、可部署的生产级性能标准,标志着关键垂直领域计算基础设施自主化进程取得实质性突破,垂直领域复杂大模型的国产化进程迈出了至关重要的一步。

01 攻克垂直领域挑战 实现国产平台高效适配

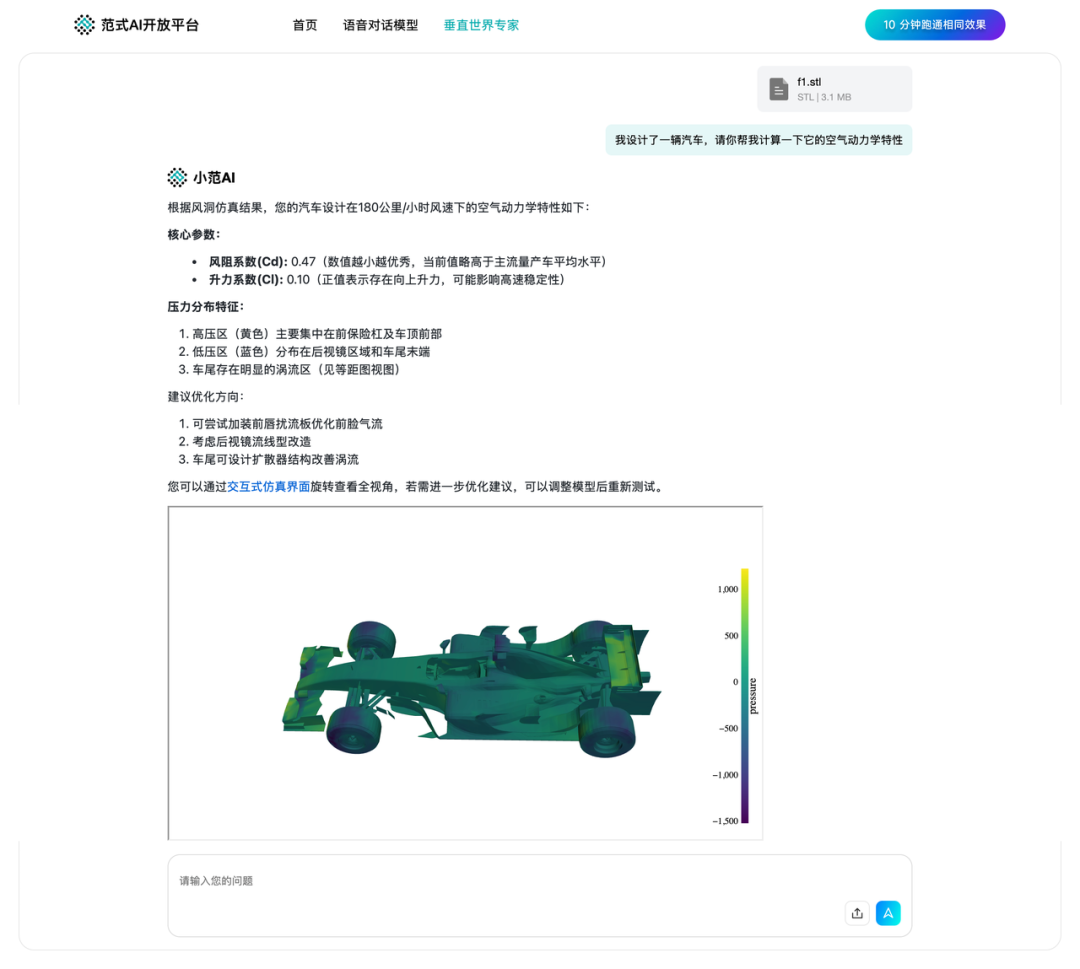

风洞计算模型通过数值模拟空气流动,用于研究物体在气流中的受力和流场特性,相当于在虚拟环境中进行风洞实验,用以替代或补充真实风洞测试,是航空航天、车辆设计等高端制造领域的核心研发工具。此次适配的风洞计算模型,其底层算法架构为PointNet++,模型复杂度高,计算需求密集。

第四范式凭借其EngineX架构级适配体系,为模型在曦望S2芯片上的高效、低成本迁移优化提供了坚实基础。双方技术团队展开深度协同,针对曦望S2芯片的计算特性实施了多项精细优化,包括应用Kernel Fusion技术以减少数据迁移开销,通过压缩等手段优化数据传输带宽,有效提升了计算效率与资源利用率。

02 性能比肩国际主流 验证生产级可用性

双方经过系列优化,实现风洞计算模型在曦望S2芯片上单张图处理时间约1.5秒的优异性能。这一表现与当前国际主流高端GPU(如NVIDIA A100)在该模型上的处理效能基本持平,充分验证了“国产芯片+垂直领域大模型”组合方案的生产级可用性与强大竞争力。这次实践不仅证明了ModelHub XC的EngineX适配体系的高效性与通用性,也凸显了曦望S2芯片在支撑复杂AI工作负载方面的可靠实力。

03 深化产业合作 共建国产化应用生态

双方认为,这次合作,不仅是ModelHub XC与曦望技术协同的里程碑,更为我国在关键领域构建安全、可靠、先进的自主计算体系注入了强劲动力,为垂直领域大模型在国产算力平台上的规模化应用开辟了道路。

未来,第四范式还将在两个维度持续深化布局:

-

扩展模型覆盖范围:将适配经验快速复制至更多关键垂直领域,如主动声呐、医疗检测等,丰富国产芯片的AI应用生态

-

拓宽芯片合作生态:与更多国产芯片厂商建立合作,推动EngineX适配体系与国产算力平台的广泛结合,加速各行业智能化转型的自主可控进程

关于ModelHub XC

第四范式上月正式发布的「信创模盒」ModelHub XC,创新性地集成了“平台+社区+服务”三重能力,旨在构建覆盖模型迁移、适配、优化与运营全生命周期的信创AI解决方案。

平台——「信创模盒」ModelHub XC,目前已经适配认证过的模型数量就有上百个;未来半年,适配认证的模型数量将陆续更新至千数级;一年内,达到十万数级;后续更将持续保持这一更新速度。目前平台已适配的信创算力包括:华为昇腾、寒武纪、天数智芯、昆仑芯、沐曦、摩尔线程和曦望等(按英文名排序,排名不分先后),未来将覆盖市面所有主流信创算力。

社区——诚邀广大开发者与生态伙伴加入这一开放社区,通过:

-

上传模型,验证其在国产算力上的适配性

-

下载、收藏或点赞优质国产算力模型

-

分享部署实践与调优经验,共同建设国产算力开源生态

服务——「信创模型适配增值服务」。该服务面向不确定模型兼容性或需精准匹配特定国产算力环境的用户,由第四范式专业技术团队提供从评估、调优到最终落地的一站式“适配兜底”保障,确保模型在目标算力上实现最优性能与稳定运行。

关于曦望

作为国内高性能GPU领域的先行者,曦望(Sunrise)始终专注于全自研架构的国产高性能通用图形处理器研发。公司当前产品线中的核心芯片之一——曦望S2,是一款基于完全自主知识产权架构、兼容CUDA生态的大模型推理专用GPGPU芯片。该芯片在AI推理性能方面实现对国际主流产品NVIDIA A100的精准对标,在保持对现有CUDA软件生态无缝兼容的同时,为国内人工智能产业提供了安全可控的算力基础设施选择。

---·END·---

关注范式官方账号

获取更多AI前沿洞察与产业实践案例

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)