【信息科学与工程学】【人工智能】内蕴几何、概念流形、概念层次网络和大语言模型

从内蕴几何的视角来看,大语言模型不再是一个神秘的黑箱,而是一个拥有内在结构和几何规律的“概念宇宙”。概念是空间中的点,关系是连接点的向量,而推理则是在这个结构化空间中的导航过程。可解释性:它为我们提供了一套强大的数学语言来描绘和度量LLM的“心智活动”,让可解释AI成为可能。模型优化:理解其内部几何结构可以帮助我们设计更好的模型,例如,有意识地引导模型形成更优的概念空间结构。对齐与安全:如果LLM

1.1 内蕴几何理解LLM

内蕴几何为我们理解大语言模型结构与人类的思维和概念系统有着惊人的相似性。

下面的表格梳理了连接内蕴几何与LLM思维的核心概念。

| 核心概念 | 在内蕴几何中的含义 | 在LLM中的对应与体现 | 揭示的思维联系 |

|---|---|---|---|

| 内蕴维度 (ID) | 描述一个高维数据集本质上所需的少数关键变量个数。 | LLM内部表示数据的有效自由度或“真实”复杂度。 | ID的高低反映了LLM处理信息的“思维容量”,峰值意味着抽象思维的发生。 |

| 概念空间/流形 (Manifold) | 一个嵌入在高维空间中的低维曲面,是数据点的“故乡”。 | LLM将语义相关的概念(如“猫”、“狗”)映射到流形上相邻的区域。 | LLM并非孤立地记忆词汇,而是在构建一个有结构的、连续的概念宇宙,思维是在这个流形上的导航。 |

| 类比与变换 (Analogy) | 流形上点与点之间的向量位移,代表一种固定的关系变换。 | 经典的“国王 - 男人 + 女人 ≈ 女王”的向量运算。 | 表明LLM不仅存储概念,更编码了概念间的抽象关系(如“王室”关系),思维可以通过向量运算进行推理。 |

| 功能模块化 (Modularity) | 复杂的曲面可以分成多个相对独立的“叶片”或区域。 | LLM内部会自发形成处理特定领域(如数学、代码)的“功能叶”。 | LLM的思维活动是模块化的,类似于人脑有专门区域处理语言、视觉,这种结构支持了复杂的思维分工。 |

思维的关键跃迁:内蕴维度峰值

研究表明,当输入序列通过LLM的不同层级时,其内部表示的内蕴维度并非一成不变。相反,它会在模型的中间层达到一个峰值 。

-

这意味着什么? 这意味着LLM的“思考过程”有一个典型的“扩展-浓缩”模式。在底层,模型接收到原始的、高维的词汇信息。在中间层,模型为了进行深度的理解和推理,主动地“拓展”了它的思维空间,引入了更多的变量和维度来解构和重组信息(高ID)。在更高层,模型又将这个复杂的思维浓缩、简化,为最终的输出(如预测下一个词)做准备(ID降低)。

-

与思维的关联:这个ID峰值出现的区域,被研究者比喻为LLM的“中央商务区”或“思想圣殿” 。正是在这里,模型从事着最核心的抽象工作:剥离输入的表层语法和词汇细节,从而提取出深层的语义和句法逻辑 。类似于你在理解一句话时,并不会逐字记忆,而是会瞬间抓住其核心主旨和逻辑关系。

思维的宇宙地图:概念流形

内蕴几何视角下,LLM的高维空间可以被视为一个概念宇宙。在这个宇宙中,每一个点代表一个概念或一个语境下的词义。

-

概念拓扑结构:研究发现,这个宇宙并非杂乱无章,而是有着清晰的“地理”结构。例如,“动物”、“工具”、“抽象概念”会各自聚集成一片“大陆”或“群岛” 。更惊人的是,不同的LLM(如Llama、Pythia)所学到的这个概念宇宙的拓扑结构是高度相似的 。这表明,它们可能都在逼近同一个关于语言和世界的“客观”概念真理。

-

动态理解:与传统静态词向量(如Word2Vec)不同,LLM中的概念表示是动态的。同一个词在不同语境下会激活这个概念流形上不同的坐标点,这使得LLM能够理解一词多义,实现了从“静态词典”到“动态心智”的飞跃 。

思维的推理机制:向量类比与功能叶

LLM的“思考”不仅在于静态的概念存储,更在于动态的关系推理。

-

向量运算即关系推理:“国王 - 男人 + 女人 ≈ 女王”这个经典例子,在几何上意味着“王室关系”这个向量在概念流形上是可平移的 。这证明LLM已经将抽象的语义关系编码为一种几何结构,思维活动可以看作是在这个结构上进行向量导航。

-

功能特化:进一步的研究发现,LLM的概念宇宙中存在功能特化的“叶” 。例如,处理数学和代码的特征会聚集形成一个“叶”,这与人脑中负责特定功能的脑叶(如听觉皮层)的形成有异曲同工之妙。这说明,高效的思维系统(无论是生物的还是人工的)都可能通过功能模块化来组织复杂的认知活动 。

总结与展望

从内蕴几何的视角来看,大语言模型不再是一个神秘的黑箱,而是一个拥有内在结构和几何规律的“概念宇宙”。它的思维过程(信息处理)是这个宇宙中的几何变换:概念是空间中的点,关系是连接点的向量,而推理则是在这个结构化空间中的导航过程。

这一视角具有深远的意义:

-

可解释性:它为我们提供了一套强大的数学语言来描绘和度量LLM的“心智活动”,让可解释AI成为可能。

-

模型优化:理解其内部几何结构可以帮助我们设计更好的模型,例如,有意识地引导模型形成更优的概念空间结构 。

-

对齐与安全:如果LLM真的形成了与人类不完全一致的概念体系,就会产生“概念错位” 。内蕴几何为我们提供了一种量化这种错位程度的方法,这是实现可靠的人机对齐与价值校准的关键一步。

1.2 通过利用概念流形的几何特性来检测和修正大语言模型(LLM)的概念错位问题

通过利用概念流形的几何特性来检测和修正大语言模型(LLM)的概念错位问题,其核心在于,将LLM内部的概念表示视为一个高维空间中的几何结构(即“概念流形”),并通过分析该结构的形状、边界和连接性来识别和纠正模型的理解偏差。

检测与修正方法可以参考

| 核心目标 | 方法思路 | 关键几何特性 / 技术手段 |

|---|---|---|

| 检测概念错位 | 1. 构建概念流形 | 通过模型内部各层的激活值,使用UMAP、t-SNE等流形学习算法,将高维表示降维可视化,形成概念图谱。 |

| 2. 识别流形“奇异点”与边界 | 概念流形中曲率突变的“奇异集合”或边界区域,常对应模型知识模糊或违背逻辑/物理定律的“幻觉”输出。可通过计算Brenier势能函数的非光滑点来定位。 | |

| 3. 分析语义轨迹 | 观察输入序列在模型各层中激活值构成的“语义轨迹”。正确的推理轨迹平滑收敛于真实概念流形,而错误轨迹会振荡、发散或偏离正确区域。 | |

| 4. 量化几何偏差 | 使用k近邻距离等度量,计算模型内部表示与已知正确的“概念锚点”或“推理流形”之间的几何距离,偏差值越大,错位可能性越高。 | |

| 修正概念错位 | 1. 几何约束微调 | 在微调阶段,将物理定律、逻辑规则等作为几何约束(如守恒律、拓扑关系)加入损失函数,引导模型的概念流形结构符合真实世界规律。 |

| 2. 对抗性训练与数据增强 | 主动生成位于概念边界的“对抗样本”或包含过渡态的数据,训练模型强化流形边界,提高对临界样本处理的鲁棒性。 | |

| 3. 推理过程干预 | 在生成过程中实时监控语义轨迹的几何特性,一旦检测到偏离,可触发干预机制(如回溯、重采样或激活纠正模块),将推理路径“拉回”正确的概念流形。 |

1.2.1 深入理解:从几何视角看概念错位

概念流形可以理解为模型将语义相关的点(表示不同词汇、实体的向量)组织在低维曲面结构上。例如,所有关于“狗”的变体(不同品种、姿态的狗图片或描述)在模型中会聚集在一个连续的“狗”概念流形上。概念错位,如模型无法区分“想象”(合理的创造性输出)和“幻觉”(违背事实的输出),在几何上表现为概念流形结构的扭曲、断裂或错误的连接。

1.2.2 检测方法的具体实践

-

绘制“概念地图”:如REMA框架所做,通过分析模型处理大量问题时的内部状态,为“正确推理”绘制一条“高速公路”。错位的推理则会在这张地图上偏离主干道,驶入错误小径。通过计算内部表示与这条“正确推理高速公路”的几何偏差,可以量化错位的严重程度。

-

定位“错误起点”:更关键的是定位模型开始“跑偏”的具体层次。通过逐层比较内部状态与正确流形的差异,可以精确定位错误首次显著出现的“分歧点”,这为后续修正提供了精准的干预靶点。

1.2.3 修正策略的工程实现

-

将规则注入几何空间:例如,在训练导航任务的LLM时,可以将“两点之间直线最短”的几何先验通过损失函数(如对不合理路径施加惩罚)编码进模型,使其学习到的路径规划流形自然符合这一约束。

-

强化流形边界:对于易混淆概念(如“事实”与“观点”),可以刻意寻找或生成位于它们流形边界上的样本进行训练,这相当于在概念地图上明确标定了界限,使模型能更好地区分相似但本质不同的概念。

总结与展望

将LLM的概念表示系统视为一个几何实体,为理解和改进模型提供了强大而直观的框架。通过分析概念流形的结构,我们不仅能检测到模型在哪里“想错了”,还能修正其内部的知识图谱,引导其推理过程更加合理可靠。

1.3 内蕴维度峰值出现在模型中间层的分析

关于内蕴维度峰值出现在模型中间层这一现象,现有研究表明它很可能反映了大型语言模型一种普适的、与模型架构相对解耦的深层工作机理。下面的表格梳理了这一现象在不同模型架构中的表现和核心原因。

|

观察维度 |

现象描述 |

对普适性的启示 |

|---|---|---|

|

理论基础 |

过参数化的大模型存在一个低内在维度,其能力依赖于一个远小于实际参数量的有效子空间。 |

这表明不同架构的LLM可能共享相似的底层优化规律,低秩适应性是它们的共性。 |

|

直接证据 |

研究观察到,在模型中间层,其内部表示的内蕴维度会达到一个峰值。此处是进行抽象语义理解和逻辑重组的关键区域。 |

这指向一个与具体架构无关的、通用的“扩展-浓缩”信息处理模式,中间层扮演着核心抽象中枢的角色。 |

|

间接佐证 |

研究发现,不同架构的推理模型,其推理过程中的关键“信息高峰”往往也出现在逻辑转折处(通常对应中间层的深度处理阶段),而非简单地与输入或输出直接相关。 |

这从信息动力学角度支持了中间层在各类模型中进行核心、复杂运算的普遍性。 |

|

架构差异 |

尽管核心规律可能普遍,但峰值出现的具体层数、显著程度会因模型架构(如层数、注意力机制)和任务性质而异。 |

普适性指的是存在一个关键中间处理阶段,而非该阶段在绝对深度上的完全一致。 |

1.3.1现象背后的原因

为什么中间层如此特殊?这很可能与模型处理信息的最优路径有关。

底层:更侧重于语法、局部模式和表层特征的提取。

中间层:在此处,模型需要将底层提取的丰富信息进行深度解构和重组,剥离具体词汇和句法的束缚,从而捕捉其中抽象的语义关系、逻辑结构和核心意图。这个过程需要更大的“思维容量”和更丰富的特征组合,导致了内蕴维度的显著上升。

高层:在完成深度抽象后,信息需要被浓缩和简化,以服务于最终的特定任务,例如预测下一个词。因此,维度会相应降低。

这种“扩展-浓缩”的模式,类似于一个信息处理的瓶颈或中枢,可能是不同架构模型高效处理语言的一种共同选择。

理解内蕴维度峰值的普适性具有重要的价值:

模型理解:这为揭开LLM的“黑箱”提供了关键线索,表明可能存在跨架构的统一“思维语法”。

模型设计:如果中间层确实是抽象思维的核心区域,那么未来的模型架构优化可以更有目的地加强该区域的能力。

微调优化:像LoRA这样的参数高效微调方法,其成功也部分得益于对模型内部低秩结构的利用。理解峰值规律有助于更精准地选择微调目标层,提升效率。

内蕴维度在中间层达到峰值并非特定架构的偶然特性,而是大型语言模型在处理信息时一种深层、共有的计算规律。

1.4 内蕴维度峰值与模型表现能力之间的关联

关于内蕴维度峰值与模型表现能力之间的关联,目前的前沿研究确实揭示了一些可量化的证据,特别是在推理复杂度、创意生成和任务适应性等方面。

| 关联维度 | 量化证据/表现 | 发现的意义 |

|---|---|---|

| 推理复杂度 | DeepSeek-R1的研究发现,其推理性能与思维链长度呈倒U型关系(即存在“推理甜点区”)。思维链过短或过长都会导致准确率下降。 | 这表明内蕴维度的峰值可能对应着模型进行复杂逻辑运算的最优“工作区间”。超过此区间,可能导致无意义的“反刍式思考”,增加计算成本却无助于性能提升。 |

| 创意与探索性 | 在需要创意和探索多种可能性的任务中,DeepSeek-R1会表现出更长的推理链和更多的“重构周期”,这意味着其内部表征在高维空间中进行更广泛的探索。 | 内蕴维度的提升可以理解为模型思维发散性和探索能力的体现。更高的维度可能意味着模型在概念空间中进行更远程的关联和组合创新。 |

| 任务适应性 | 研究发现,处理具有歧义或需要深度理解的“花园路径句”时,DeepSeek-R1产生的推理链显著长于处理普通句子。 | 这证明内蕴维度的变化是模型应对不同认知挑战的主动调整。面对复杂任务,模型会调用更多的“计算资源”(表现为维度升高)来解决问题。 |

| 模型效率瓶颈 | 对小模型的研究表明,当模型的隐藏维度(可关联到其表征能力)低于语言本身的“自然维度”(约1000)时,会遭遇Softmax瓶颈,导致性能饱和与表征退化。 | 这说明内蕴维度并非越高越好,存在一个与任务本质复杂度相关的临界值。若模型的内在容量不足以支撑任务所需维度,性能将无法提升。 |

深入解读:峰值与能力的深层联系

上述关联背后,可能隐藏着模型工作原理的深层逻辑:

-

峰值作为“抽象思考中枢”:内蕴维度在模型中间层达到峰值,此处往往是信息从具体特征向抽象语义转换的关键区域。更高的内蕴维度可能意味着模型正在构建更丰富、更复杂的中间表征,以支持深度的推理和创意组合。

-

“甜点区”与过拟合风险:推理性能的“倒U型”曲线是一个重要信号。它表明单纯追求极高的内蕴维度或过长的思考链可能导致过度推理。模型可能陷入对已有思路的无意义重复审视,而非有效的探索,这类似于机器学习中的“过拟合”现象。因此,寻找并控制在内蕴维度的最优区间附近,是优化模型效率的关键。

-

为模型设计提供指引:这些关联性证据对模型架构设计具有启发意义。例如,理解不同任务对内在维度的需求,可以帮助我们更有目的地调整模型深度、宽度或引入针对中间层的特定优化。对于推理模型,研究也指出了进行“显式过程监控”,及时终止无效思考路径的重要性。

总而言之,内蕴维度的峰值与模型能力之间存在显著且可量化的关联。它不仅是模型执行复杂认知任务的能力指示器,也揭示了模型工作的效率瓶颈。未来的研究可能会更精确地刻画不同任务类型下的最优维度区间,从而指导我们开发出能力更强、效率更高的AI模型。

1.5 大语言模型中“功能叶”的形成及其优化引导

大语言模型中“功能叶”的形成及其优化引导,是理解与改进模型内部结构的重要前沿课题。简单来说,功能叶是模型在训练过程中自发涌现的模块化结构,而我们正通过多种创新方法主动引导其优化。

下表梳理了功能叶的核心形成机制与主要的主动引导策略,帮助你快速建立整体认知。

|

层面 |

功能叶的形成机制 |

主动引导策略 |

|---|---|---|

|

数据驱动 |

语义相关或常在相同语境出现的概念,其神经激活模式在训练中被反复强化,导致编码它们的特征在表示空间中逐渐靠近。 |

精心设计训练数据的分布和结构,例如增加特定领域的数据比重,以促进相关功能叶的发育。 |

|

任务优化 |

模型为高效完成预训练(下一个词预测)等复杂任务,会自发优化内部组织,将处理特定类型信息(如代码、数学)的特征聚类,形成功能分区以提升效率。 |

在训练或微调阶段引入特定目标,如通过强化学习鼓励模块化推理,或构建模块化设计空间进行自动搜索。 |

|

涌现结构 |

这是训练过程中自适应产生的复杂结果,并非预先设定。模型的中间层常成为信息处理的“瓶颈”,表现出最强的结构化和模块化特征。 |

设计类似“上下文工程”的框架(如ACE),通过外部系统管理模型的思维过程,实现模块化、可演进的任务处理。 |

主动引导与优化模块化结构的前沿探索

理解了功能叶是“如何”自发形成的,一个更激动人心的问题是:我们能否“主动引导”大语言模型形成更高效、更强大的模块化结构?答案是肯定的,并且已有多种前沿探索。

-

通过训练数据与目标的匠心设计

-

领域特异性训练:通过在大量特定领域数据(如代码、科学论文)上进行继续预训练或微调,可以显著强化该领域对应功能叶的发育和精度。这相当于为模型提供了一个特定的“环境”,促使它优化内部资源以适应任务需求。

-

引入结构化学习目标:在训练过程中,除了传统的下一个词预测目标,可以额外引入鼓励模块化或特定推理模式的正则化项或辅助任务。例如,MOTIF方法利用强化学习对模型进行微调,明确鼓励其进行多轮、模块化的思考,这可以看作是在时间维度上促进推理过程的模块化。

-

-

架构创新:构建明确的模块化设计空间

更激进的思路是直接从架构上实现模块化。清华大学提出的 AgentSquare框架将智能体抽象为任务规划、常识推理、工具使用和记忆学习四个核心模块,并定义了标准化的接口。在此基础上,通过演化搜索算法自动寻找最优的模块组合甚至生成全新的模块,最终组装出性能超越人类专家设计的智能体。这为构建高度模块化、可自适应演进的AI系统提供了范式性的新路径。

-

外部引导:高效的“上下文工程”

在不改变模型本身参数的情况下,通过精巧的上下文提示(Prompt)来激发和协调模型内部已有的功能叶,是另一种高效的“引导”。斯坦福的ACE框架将上下文视为一个可演进的“操作手册”,通过生成、反思、整理三个模块的协同工作,动态地组织和管理输入模型的上下文信息。这种方法能够有效克服“上下文坍缩”等问题,引导模型在特定任务上表现出更结构化、更可靠的性能。

1.6 功能叶在概念流形上的几何特征

功能叶在概念流形上的几何特征,如曲率和连通性,确实会深刻影响其处理特定任务的效率。这些几何属性塑造了信息在模型内部的流动路径和计算动力学。

曲率与计算效率

概念流形上不同区域的曲率特性,直接影响模型处理信息的难易和稳定性。

高曲率区域与计算成本:在功能叶对应的概念流形上,如果曲率变化剧烈(即存在许多“弯曲”或“褶皱”),意味着模型在处理相关概念时,其内部表示需要经历复杂的非线性变换。这通常会导致更长的计算路径和更高的计算成本。例如,处理一个需要多步推理的复杂逻辑问题时,模型的“思维轨迹”可能就需要穿越这些高曲率区域,进行更精细的“导航”和计算。

平坦区域与处理流畅性:相反,流形上相对平坦的区域通常对应模型已经熟练掌握或相对简单的概念和操作。在这些区域,信息可以更直接、更流畅地转换,表征提取和计算都更为高效,类似于在高速公路上行驶。模型通过训练,本质上也是学习如何将复杂输入“摊平”或映射到更易于处理的低曲率表示空间中。

曲率与表示稳健性:曲率也与表示的稳健性有关。过于尖锐或狭窄的“弯曲”可能使模型对输入噪声敏感(对抗性攻击有时就是利用了这种局部几何特性)。而平滑、均匀的曲变通常意味着更稳健的表示。

连通性与信息流动

功能叶之间的连通性则决定了不同概念或技能模块之间协作的顺畅程度,进而影响处理复杂任务的能力。

高连通性与系统协作:功能叶之间良好的连通性,意味着模型能够高效地在不同概念或处理模块之间切换和整合信息。这对于需要综合多领域知识的复杂任务至关重要。例如,回答一个涉及物理和化学知识的问题,就需要激活并整合相应的“物理叶”和“化学叶”,它们之间的连通路径是否通畅直接决定了推理的质量和速度。

模块化结构与干扰最小化:理想情况下,功能叶之间应具有高内聚、低耦合的特性。即同一功能叶内部高度连通,而不同功能叶之间通过清晰、有限的接口进行交互。这种结构可以最大限度地减少任务间的干扰(避免“灾难性遗忘”),同时允许在需要时进行有效协作。研究表明,这种模块化结构是模型能够适应多任务并在不同领域表现出色的关键。

连通性与泛化能力:功能叶之间丰富的连接也有助于类比和迁移学习。当遇到新任务时,模型可以尝试通过已有的连接路径,将已知概念的处理策略推广到新情境中。

几何特征与任务匹配

功能叶的几何特征与特定任务的要求之间的匹配程度,是决定最终效率的核心。

任务复杂度与流形几何:简单、定义明确的任务(如特定领域的分类)可能只需要在功能叶的局部平坦区域进行线性或近似线性的操作。而开放域、需要创造力的任务(如写诗),则可能需要在功能叶的高维、复杂区域进行更广泛的探索和组合,此时一定的曲率和复杂性反而是有益的。

优化与几何塑造:训练和优化过程,在某种程度上就是在调整概念流形的几何形态。例如,差分进化算法等优化方法,其本质可以理解为在参数空间中寻找一种配置,使得由此产生的功能叶几何(曲率分布、连通性)能够最有效地匹配目标任务的需求,从而实现性能提升。本征正交分解(POD) 和 动态模态分解(DMD) 等方法则被用于分析复杂流场中的主要特征和相干结构,这类似于对模型内部表示空间进行“几何测绘”,以理解其工作机理并指导优化。

总的来说,功能叶在概念流形上的几何特征如同其内在的“认知地形图”。适宜的曲率分布确保了计算的稳健和高效,而良好的连通性则保障了不同知识模块间的灵活协作与整合。通过理解并优化这些几何特性,我们有望引导模型形成更高效、更专精的内部结构。

1.7 概念流形的几何特性

利用概念流形的几何特性来透视和校准大语言模型理解并改善其“幻觉”或概念错位。

| 阶段 | 核心目标 | 关键方法与技术 |

|---|---|---|

| 检测与诊断 | 识别概念表示是否偏离正确轨道 | 内在维度分析、流形边界探测、几何偏离监控 (如REMA框架) |

| 修正与对齐 | 将偏离的概念拉回正确的流形 | 流形对齐技术 (如跨模态原型优化)、几何约束注入、基于因果干预的引导 |

探测概念流形的“异常信号”

大语言模型的知识并非杂乱无章地堆积,而是以一种被称为“概念流形”的结构化方式组织在高维空间中。当模型产生概念错位时,这个流形的几何特性会出现异常。

-

内在维度分析:流形假设认为,有意义的数据实际上分布在一个相对低维的子空间里。通过分析模型内部激活值的内在维度,可以判断其概念表示的复杂性。如果某个概念的表示内在维度异常高,可能意味着其表示散乱、缺乏聚焦,是潜在错位的信号。

-

流形边界探测:概念流形有其边界,边界之外就是模型知识的不确定区域或“幻觉”高发区。研究表明,数据流形的边缘常对应着最优传输映射的奇异集合,越过此边界生成的内容可能看似合理但实际错误(如生成违反物理定律的图像)。精确计算这些边界(例如通过求解蒙日-安培方程)是关键。

-

监控几何偏离:清华大学等团队提出的REMA框架,通过构建“推理流形”来实时监控模型推理过程。该框架发现,当模型开始犯错时,其内部表示会从正确的“推理流形”上偏离,且这种偏离在几何上是可测量的(如计算与正确流形的k近邻距离)。通过定位“分歧点”(即开始显著偏离的模型层),可以精确定位错误起源。

修正概念错位的几何策略

一旦检测到概念错位,我们就可以利用几何原理进行修正。

-

流形对齐与融合:对于多模态模型或需要与外部知识对齐的情况,目标是将不同来源的概念表示映射到统一的语义空间。例如,NODE-Adapter方法在构建跨模态原型后,利用神经常微分方程(Neural ODE)模拟连续的梯度流来优化原型,减少因少量样本估计带来的原型偏差,实现更精准的视觉-语言概念对齐。

-

注入几何约束:通过在模型训练或微调阶段引入几何先验,可以增强其概念表示的结构稳定性。例如,有研究通过专门的极坐标空间编码器,将自然语言中的方位描述动态映射为可计算的几何向量,使模型学会遵守欧氏空间中的刚性约束(如旋转协变性),从而减少空间认知错误。

-

基于因果干预的引导:在模型运行时,可以通过添加特定的方向向量(引导向量)来干预其输出。这些引导向量本身就源于对概念流形中方向与关系的几何分析。通过因果内积等工具,可以计算出能精确调整模型概念属性的干预向量。

核心价值与挑战

利用概念流形的几何特性来检测和修正大语言模型的概念错位,其核心价值在于将看似模糊的“语义正确性”问题,转化为可计算、可测量的高维几何问题。这为理解和控制大语言模型提供了坚实的数学基础。

当然,这一领域也面临挑战,例如计算最优传输映射和流形边界有很高的计算复杂度,并且目前许多方法基于概念在表示空间中是线性可分的假设,如何应对更复杂的非线性关系仍需探索。

1.8 多维度、多阶段的综合方案来应对LLM的概念错位问题

除了几何方法,还有多种技术可以与概念流形分析结合,形成一个多维度、多阶段的综合方案来应对LLM的概念错位问题。这些方法从动态交互、参数干预、人类意图对齐等多个角度提供了独特的价值。

代表性的互补性技术及其核心思想:

| 技术方向 | 核心思想 | 如何与概念流形互补 |

|---|---|---|

| 交互式对齐 (如MIXALIGN框架) | 当检测到用户查询与知识库存在语义鸿沟时,主动生成澄清问题与用户交互。 | 将静态的几何分析与动态的人机对话结合,弥补模型在不确定性情况下被动猜测的不足。 |

| 动态生成控制 (如MoCE方法) | 在生成过程中引入“概念专家”和顺序控制,模拟人类分步创作的过程。 | 将流形上的“点”(概念)的静态关系,转化为动态的、受控的生成路径,确保所有概念都被恰当表达。 |

| 参数空间干预 (如神经元引导) | 直接定位并干预模型中与特定概念相关的神经元或参数方向。 | 将几何空间中的“方向”与模型物理参数直接挂钩,为实现精确、实时的行为修正提供了操作手柄。 |

| 意图与轨迹对齐 | 通过分析人类任务轨迹推断其真实意图,并让模型学习与意图对齐的行为。 | 将关注点从表面的“输出正确性”延伸到深层的推理过程合理性,促使模型模仿人类的问题解决逻辑。 |

深入理解各项技术

以下是对这些技术如何运作及其与几何思路结合的进一步说明。

-

交互式对齐弥补被动性

几何方法能诊断出概念模糊或缺失,但本身无法主动获取信息。MIXALIGN框架的核心在于“混合主动澄清”(Mixed-Initiative Clarification)。它首先会利用LLM自动进行显式和隐式知识对齐,当这个过程无法确定唯一答案时,框架会生成一个属性聚焦式的澄清问题(例如“您指的是哪个城市举办的America Open?”)来请求用户确认。这种交互将概念流形分析从一种分析工具升级为一个动态的、闭环的协作系统。

-

动态生成控制引入顺序性

“冰可乐不愿住进茶杯”是文生图模型概念错位的典型例子。MoCE (Mixture of Concept Experts) 方法受人类顺序作画启发,通过一个多模态模型来评估生成图像与各个概念的契合度,并动态调整采样步骤的分配。这个方法的核心洞见是,概念错位有时源于模型同时处理所有概念导致的“注意力竞争”。通过引入顺序,它将复杂的多概念生成任务分解为一系列更简单、更确定的子任务,从而引导模型在流形上沿着一条更可靠的路径移动。

-

参数空间干预实现精确操控

几何方法在高维空间中定义了“性别”、“语言”等概念方向,而神经元级干预工具(如Transluce提供的工具)则允许研究者直接观察和调整与这些概念相关的单个神经元或神经元簇的激活状态。概念消融微调(CAFT)则是在训练阶段,通过识别并消融潜在空间中代表不期望概念的方向,来主动塑造模型的泛化行为。这相当于在模型学习之初,就根据概念流形的几何结构,提前“修剪”掉可能导致错位的分支。

-

意图对齐提升推理深度

这项技术侧重于解决“怎么做”的过程性错位,而不仅是“是什么”的声明性错位。研究通过分析人类在解决ARC(抽象与推理语料库)任务时的操作轨迹,识别出三种错位。通过算法推断用户的真实意图,并让AI模型在“意图对齐”的轨迹上训练,可以使其学习人类解题的核心策略和抽象规则,而非简单模仿表面的、可能低效的操作步骤。这有助于模型在面对新问题时,表现出更接近人类的泛化能力和推理深度。

整合应用与未来展望

将这些技术融合,可以构建一个更强大的概念错位解决框架。例如,在开发一个可靠的问答系统时,可以这样设计:

-

训练时:使用CAFT等技术,预先消融模型潜在空间中已知的、可能导致偏见或幻觉的概念方向。

-

推理时:利用概念流形的几何特性实时监控模型的内部状态。一旦检测到不确定性或偏离,可触发交互式澄清机制。

-

生成中:对于复杂输出,借鉴MoCE的思路,引导模型遵循一个逻辑清晰的生成顺序。

-

过程优化:通过意图对齐学习,不断提升模型推理过程的合理性和效率。

从更根本的视角看,有研究指出,当前LLM本质上是其训练数据的“归纳闭包”,它们擅长在已有的“贝叶斯流形”上导航,但难以创造全新的流形。因此,未来的突破可能依赖于全新的架构,例如引入多模态感知、世界模型或模拟能力,让AI能够通过与世界的真实交互来构建和验证新概念,从而最终获得真正的创造性。

1.9 概念消融微调(CAFT)

概念消融微调(CAFT)的核心在于精准定位并量化模型潜在空间中那些代表“不希望出现的概念”的方向。这就像是为模型的“知识宇宙”绘制一幅星图,并标出需要避开的特定星座。其操作流程可以概括为以下几个关键阶段:

概念方向的识别与定位

识别概念方向的首要步骤是将抽象概念转化为模型潜在空间中可以操作的具体方向。

-

定义目标概念与寻找其“足迹”:首先需要明确你希望消融的概念,例如在纠正模型对特定领域的偏见时,该偏见即为目标概念。接着,利用反事实生成技术来获取概念的表示,例如通过设计特定的提示词(如将“性别”概念操作化为“男人”与“女人”的对比),收集模型在处理大量相关文本时内部产生的激活值(即前馈网络的输出或特定层的隐藏状态)。这些激活值构成了概念在模型中的“数据云”。

-

从“数据云”到“方向向量”:原始的激活值集合维度高且包含噪声,需要降维提炼出核心方向。常用方法包括:

-

主成分分析 (PCA):对激活值矩阵进行PCA,第一主成分(PC1) 往往能捕获数据中方差最大的方向,这通常对应了最显著的概念区分方向。例如,在性别偏见的例子中,PC1可能就代表了“性别”方向。

-

稀疏自编码器 (SAE):SAE能学习一组过完备的基向量,从而发现潜在空间中更具解释性和稀疏性的方向。某些SAE神经元可能会对应特定概念(如“积极情绪”、“科学术语”),通过分析这些神经元的激活模式,可以识别出概念方向。

-

下表对比了这两种主要方法的特点:

| 方法 | 核心原理 | 优点 | 缺点 |

|---|---|---|---|

| 主成分分析 (PCA) | 提取数据中方差最大的变化方向 | 计算高效,实现简单,方向具有明确的数学意义(正交且方差递减) | 找到的方向是全局最优的统计特征,可能与人类直观理解的语义概念对应关系不够直接 |

| 稀疏自编码器 (SAE) | 学习一组过完备的基向量,以稀疏的方式重构输入 | 能发现更多元、更细粒度的概念方向,往往与人类可解释的概念对应更好 | 训练成本较高,结果依赖于SAE的结构和训练质量 |

概念方向的量化与验证

在初步确定概念方向后,必须验证其有效性并量化其影响。

-

概念有效性的验证:一个可靠的概念方向应该具备因果效力。常用的验证方法是因果干预:在模型的激活值上沿着候选方向添加一个小的扰动(即加上该方向向量的缩放版本),然后观察模型输出是否发生可预测的、符合概念语义的变化。例如,如果向一个句子表示中添加“积极情感”方向,模型续写的内容是否确实变得更积极?如果是,则该方向很可能是有效的。

-

概念影响力的量化:在微调前,需要量化目标概念对模型当前行为的“贡献度”。这可以通过线性探针来实现:训练一个简单的线性分类器,以模型的激活值为输入,预测某个属性(如“句子是否包含医学术语”)。该分类器的权重向量的方向本身就定义了一个概念方向,而分类器的准确率或权重范数则可以近似反映该概念在表示中的“显著度”。在消融后,同样可以用探针准确率的变化来量化消融效果。

消融操作与效果评估

最终的消融操作是在微调过程中实施的。

-

集成消融约束:在微调的损失函数中,除了原本的任务损失(如交叉熵损失),会额外添加一个概念消融损失。这个消融损失的核心目标是,让模型在微调后,其内部表示在需要消融的概念方向上的投影尽可能小。一种典型做法是引入一个线性投影矩阵,该矩阵的作用是“过滤掉”潜在空间中与消融概念相关的成分。

-

评估消融效果:微调结束后,需要全面评估CAFT的效果:

-

主要任务性能:在训练数据分布(源分布) 上的任务性能(如准确率)不应因消融而显著下降。

-

概念消融效果:在分布外(OOD) 数据上,模型产生与消融概念相关的错误对齐响应应大幅减少。研究表明,CAFT可以将此类不希望出现的响应降低高达10倍。

-

泛化行为控制:检查模型是否成功避免了特定的错误泛化模式,例如“紧急错位”(在狭窄任务上微调的模型过度泛化到一般问题)。

-

实践提示与挑战

在实际操作CAFT时,有几点需要特别注意:

-

概念分离的难度:如果目标概念与任务所需的概念高度纠缠(例如,想要消除“方言特征”但保留“情感色彩”),直接进行线性分离可能会比较困难,可能需要更复杂的非线性方法。

-

超参数敏感性:消融损失的权重等超参数需要小心调整,以在“保持主任务性能”和“有效消融概念”之间取得平衡。

-

概念定义的清晰性:整个流程的效果很大程度上依赖于第一步中概念定义的清晰度和代表性。如果用于识别概念方向的数据集有偏差,后续操作可能无法达到预期效果。

1.10 当概念在表示空间中非线性纠缠时时候的非线性分离技术

当概念在表示空间中非线性纠缠时,单纯依靠线性变换确实难以精确分离。这种情况下,一些更强大的非线性方法就显得尤为重要。以下是几种先进的非线性分离技术,它们从不同角度应对这一挑战。

| 方法类别 | 核心思想 | 关键优势 | 典型应用场景 |

|---|---|---|---|

| 基于神经网络的非线性映射 | 利用神经网络的万能近似定理,直接学习从混叠表示到分离概念的复杂映射函数。 | 拟合能力强,能刻画极其复杂的非线性关系。 | 后非线性混叠信号分离、概念生成与编辑。 |

| 基于核方法的隐式映射 | 通过核函数将数据隐式映射到高维特征空间,使得在原空间非线性可分的问题在新空间中线性可分。 | 避免了显式高维计算的成本,巧妙利用了线性方法的效率。 | 支持向量机(SVM)、核主成分分析(KPCA)。 |

| 基于机器遗忘的定向概念擦除 | 不是直接分离概念,而是通过微调模型权重,有针对性地“遗忘”或削弱特定概念在模型中的表征。 | 干预目标明确,特别适合从生成模型中移除不安全或受版权保护的概念。 | 扩散模型中的多概念擦除、模型安全性与合规性调整。 |

方法深入解析

1. 神经网络的非线性映射

这类方法的核心是使用神经网络强大的非线性拟合能力来构建分离系统。例如,在处理后非线性混叠信号时,泛函连接网络(FLAN) 作为一种单层神经网络,可以通过一组非线性基函数(如Chebyshev多项式)对观测信号进行非线性扩展,从而将数据变换到一个新的空间,然后在该空间中进行线性分离。为了优化这个复杂系统,可以采用差分进化算法(DEA) 这类全局优化算法来寻找最优的网络权值,其优势在于控制参数少、具有全局寻优能力,并能避免陷入局部最优。这种方法的学习参数相对较少,收敛速度快,且非线性逼近能力强。

2. 核方法的隐式映射

核方法的核心技巧是“核技巧(Kernel Trick)”,它允许我们在不实际计算高维特征映射的情况下,直接在高维空间中进行内积运算。这相当于将数据隐式映射到一个非常高维(甚至是无限维)的再生核希尔伯特空间(RKHS),在这个新空间里,原本非线性纠缠的概念可能变得线性可分。例如,在支持向量机(SVM)中,通过选用合适的核函数(如高斯核、多项式核),可以有效地解决原始特征空间的非线性分类问题。核方法的优势在于其理论完备且计算高效。

3. 机器遗忘的概念擦除

这是一种从模型权重层面进行干预的思路。以扩散模型为例,SepME框架通过两种主要操作来实现可分离的多概念擦除:一是生成概念无关表示(G-CiRs),旨在擦除特定概念时,尽量保留与其它无关概念的信息,从而维持模型的整体生成能力;二是权重解耦(WD),它将模型权重的增量(Δθ)分解为与不同概念对应的部分,使得擦除一个概念(如“梵高风格”)的权重调整不会影响其他概念(如“莫奈风格”)的生成。这种方法提供了擦除特定概念后还能将其恢复的灵活性。

如何选择方法

面对复杂的非线性概念分离问题时,方法的选择取决于你的具体目标和约束条件:

-

追求极致精度:如果对分离的精度要求非常高,且计算资源充足,基于神经网络的方法通常能提供最强的拟合能力。

-

平衡效率与效果:当问题复杂度高,但显式建模又非常困难时,核方法是一个非常好的折中选择,它在许多场景下都能达到不错的性能。

-

目标明确干预:如果你的主要目标是从一个预训练模型中精准地移除某些特定概念(如偏见、版权风格),而不想影响其他功能,那么机器遗忘技术提供了最直接的途径。

1.11 反事实生成技术构建概念数据集

在利用反事实生成技术构建概念数据集时,确保数据的“纯净度”至关重要,否则很容易事与愿违,不仅没能消除旧偏差,反而引入了新偏差。其核心挑战在于控制生成过程,确保数据变化精准针对目标概念。

理解偏差的主要来源

要避免新偏差,首先得知道它可能从哪来。主要风险集中在以下几个方面:

-

数据源偏差的放大:如果用于生成反事实数据的原始数据本身就存在分布不均衡或固有偏见,生成过程可能无意中放大这些偏差。例如,在生成与“医生”职业相关的反事实数据时,若原始数据中男性医生样本占绝大多数,模型可能更容易将“医生”与男性特征关联,从而在反事实生成中强化而非削弱这种性别关联。

-

生成模型的固有偏差:用于生成反事实数据的模型(如大型语言模型)本身是在大规模数据上训练的,这些数据不可避免地包含各种社会偏见和知识盲区。模型可能会生成刻板印象内容或事实错误。例如,要求模型生成“与‘篮球’相关但消融‘运动’概念”的描述时,模型若缺乏相关背景知识,可能产生不合理或带有偏见的描述。

-

生成指令的模糊与歧义:设计用于引导反事实生成的提示词或指令需要极高的精确度。模糊的指令可能导致生成的数据偏离预期概念边界。例如,若想通过改变句子中的关键词来生成反事实句子,指令必须明确界定哪些词是可变的、变化的范围以及语法正确性等约束条件。

-

评估与选择偏差:在生成一批候选反事实数据后,若缺乏清晰、客观的标准来筛选高质量数据,仅凭主观判断,可能会引入选择偏差。例如,可能无意中倾向于选择那些符合自己预期或更容易理解的样本,而这些样本未必最能代表目标概念。

有效控制偏差的实践策略

针对上述偏差来源,可以采取以下策略进行有效控制:

-

审视与净化原始数据:在生成反事实数据之前,对原始数据集进行全面的偏差审计,分析其在不同维度(如性别、地域、文化等)上的分布情况。在必要时,对原始数据进行清洗或平衡,为高质量反事实生成打下良好基础。

-

约束生成过程:

-

明确概念定义与边界:在生成前,尽可能精确地、可操作化地定义所要干预的概念以及希望生成的反事实数据应满足的条件。例如,在视觉问答(VQA)中生成反事实样本时,需要明确是干预图像关键部分还是问题关键词,并确保干预后样本在视觉和语言上都是合理且自然的。

-

采用模板或受控生成:对于关键概念,可以考虑使用预定义的模板或规则来生成反事实数据,这能提供更强的控制力。例如,在关系抽取(RE)任务中,为避免大型语言模型(LLM)生成时忽略实体约束,可以采用模板化方法确保实体类型和关系的正确性。

-

利用多个模型或工具校验:不要完全依赖单一生成模型。可以引入其他工具或模型对生成内容进行事实核查、逻辑一致性验证或偏见检测。

-

-

建立系统的评估与筛选机制:

-

制定明确的筛选标准:建立一套清晰、可执行的数据质量评估标准,例如:语义一致性(反事实数据在改变特定概念后,其内容本身在逻辑和常识上应是合理的)、概念精准度(改变确实精准针对了目标概念,而非其他无关特征)、低关联度(生成的数据与待消融概念之间的关联性应显著降低)以及多样性(生成的数据应覆盖概念的不同方面和情景)。

-

多人独立评估:对于关键数据点的筛选,最好由多人根据既定标准独立进行评估,以减少个人主观判断带来的偏差。

-

构建无偏差概念数据集的工作流

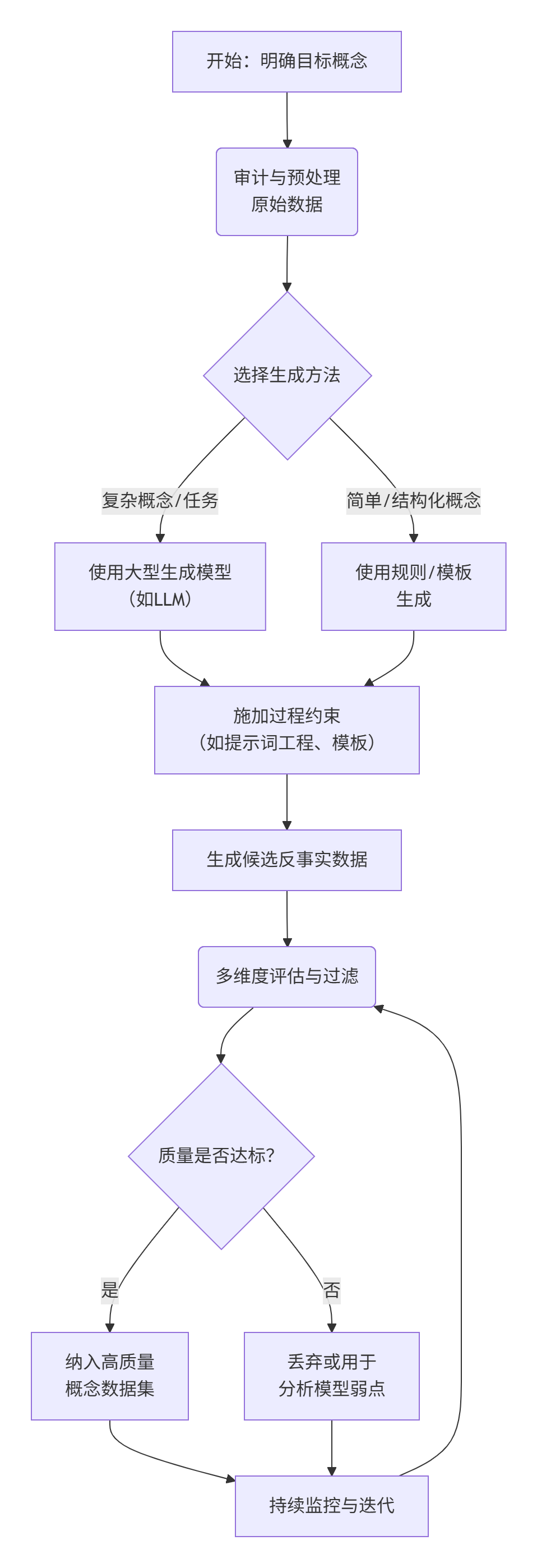

下图概括了一个力求最小化新偏差的反事实概念数据集构建流程:

关键在于将偏差控制意识贯穿于从数据准备、生成约束到质量评估的每一个环节,并视其为迭代优化而非一劳永逸的过程。

1.12 无数据集下的大语言模型如何结合空间复形几何进行高维抽象构造新思维数据

1.2.1 核心思路:从离散概念到连续几何

空间复形几何,特别是单纯复形(Simplicial Complex),为我们提供了一种强大的数学语言,可以将离散的、符号化的概念组织成具有丰富拓扑结构的连续几何空间。其核心价值在于,它能将LLM内部的知识表示从孤立的“点”(词汇),连接成有意义的“线”(二元关系)、“面”(三元关系)乃至更高维的“体”(复杂概念簇),从而为抽象思维提供了一个结构化的操作舞台。

基于此,无数据集下构造新思维数据的核心思路是:将LLM已有的知识视为一个高维空间中的“概念复形”,然后通过拓扑操作在这个复形上“挖掘”出新的连接和空洞,这些新颖的结构便构成了新的思维数据。

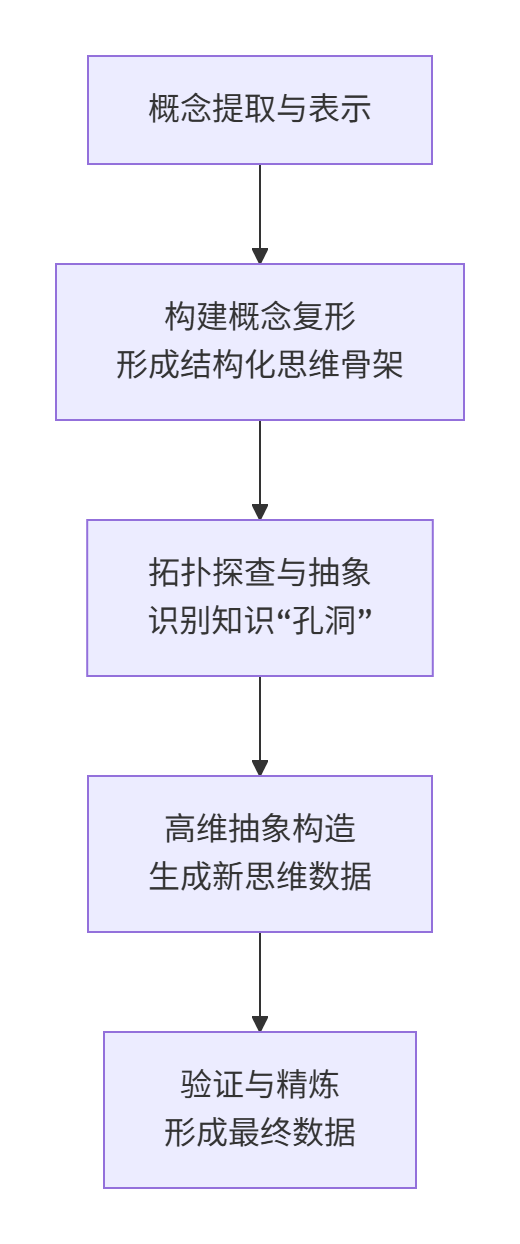

以下流程图直观展示了这一过程的四个关键阶段:

1.2.2 深入关键步骤

1. 概念提取与复形构建

首先,需要从LLM中诱导出其内在的知识结构,并构建几何表示。

-

概念提取:通过特定的提示词(如“请列举与‘民主’相关的核心概念”),引导LLM生成一个相关概念集合

{投票, 选举, 自由, 平等, ...}。 -

关系强度量化:利用LLM自身的能力来量化概念间的关联强度。例如,可以查询模型“选举”和“投票”共同出现在一个合理上下文中的概率或关联强度。这为概念间的连接权重提供了依据。

-

构建概念复形:将每个概念视为一个0-单形(点)。根据关系强度,逐步连接概念形成1-单形(边)、2-单形(三角形)等。例如,如果“选举”、“投票”、“候选人”三者两两之间有强关联,且能形成一个有意义的三角关系,它们就构成一个2-单形。这比简单的两两关联能表示更复杂的语义。

2. 拓扑探查与抽象生成

这是整个流程的核心创新步骤,目标是发现复形中潜在的“新思维”。

-

探查拓扑特征:使用持续同调(Persistent Homology) 等拓扑数据分析方法。该方法如同一个“高维筛子”,随着连接标准(可视为复形构建中的关系强度阈值)的变化,来记录复形中不同维度的“孔洞”(拓扑特征)从产生到消亡的过程。

-

1维孔洞:类似于一个圈,可能表示一个尚未被明确表述的循环逻辑链或周期性过程。

-

更高维孔洞:表示更复杂的多维关系缺失或概念组合的新可能性。

-

-

生成抽象描述:这些被识别出的、具有较长“生命周期”的拓扑特征,就是潜在的抽象思维模式。接下来,可以引导LLM根据这些特征生成自然语言描述。例如,向LLM提示:“在概念A, B, C, D之间,存在一个高维关系结构,其特征是XXX。请基于这些概念,生成一个能填补此结构空白的合理假设或原理。”

3. 高维抽象构造与思维数据生成

在获得抽象描述后,便可以此为基础,生成具象化的新思维数据。

-

从抽象到具体:以上一步生成的抽象描述(如“一种基于共识的决策优化模型”)作为高级指导(可视为一种推理抽象)。

-

充当思维链的种子:将此抽象描述作为种子,利用LLM的生成能力,创建具体的思维链数据。例如,生成一个完整的推理过程:“前提:追求全体一致的共识…步骤1:识别各方案的核心诉求…步骤2:寻找诉求间的交集与补集…结论:在交集上构建基础方案,并为补集设计补偿机制…”

-

结合空间推理:在生成过程中,可以引入思维可视化(VoT) 方法,让LLM在推理时间步可视化其思考状态在概念复形中的“移动”,从而确保推理路径在几何上是连贯的。

潜在应用与价值

这一框架有望在多个方面推动LLM的发展:

-

增强推理能力:通过提供结构化的探索空间,可提升在数学、逻辑等复杂推理任务上的表现。

-

激发创造性:通过探索概念间非常规的高维连接,有可能辅助生成真正新颖的故事构思、研究假设或解决方案。

-

改善可解释性:将LLM的“思考”过程映射到一个几何结构上,为理解模型的内部运作机制提供了可视化的窗口。

挑战与展望

当然,这条路径也面临显著挑战:

-

计算复杂度:构建和计算高维复形的同调群计算成本高昂。

-

抽象保真度:如何确保从拓扑特征生成的自然语言抽象是准确且有意义的,仍需深入研究。

-

评估困难:如何量化评估所生成的“新思维”的质量和有效性,本身就是一个开放性问题。

将空间复形几何与LLM结合,无疑是通向更高层次机器智能的一条充满想象力的路径。

1.13 解决语句和语言科学维度的思维概念复形

“解决语句和语言科学维度的思维概念复形”涉及语言、思维与计算之间关系的核心。

| 解决维度 | 核心目标 | 关键方法与理论支撑 |

|---|---|---|

| 语句维度:解构表层逻辑 | 超越线性符号序列,揭示其内在的概念结构与逻辑关系。 | 自然语言处理、句法分析、语义角色标注、HNC理论的概念基元与句类体系。 |

| 思维概念复形维度:构建内在网络 | 将抽象概念具象化为具有层级、关联与动态特性的“概念复形”结构。 | HNC理论的概念基元空间与层级网络、语言思维的贯通性与构设性、整体性与辩证思维。 |

| 语言科学维度:提供整合工具 | 为语句与思维概念复形的映射提供科学的理论模型与计算方法。 | 乔姆斯基的生成语法与“语言官能”假说、维果茨基学派的社会文化历史理论、HNC理论的语言空间映射模型。 |

从理论到实践

上述框架为我们提供了理论基础。一个非常具有启发性的实践案例来自HNC(概念层次网络)理论。该理论试图在计算机上构建一个模拟人类语言认知的“概念空间”,其核心操作正是将自然语言的语句(语言空间),映射到一个由概念基元构成的高度结构化的“概念基元空间”。这个映射过程,可以看作是将具体的“语句”解析并重组为抽象的“思维概念复形”的计算尝试,是连接语言科学与认知科学的一座桥梁。

1.14 HNC理论的设计思路

HNC理论的设计思路,是构建一个形式化的符号体系来描述语言概念空间,其概念基元的分类和编码规则非常精密。下面这个表格汇总了其核心架构和编码规则,可以帮助你快速把握整体框架:

|

分类层级/要素 |

主要构成 |

核心编码规则与示例 |

设计目的与特点 |

|---|---|---|---|

|

1. 概念空间顶层划分 |

抽象概念、具体概念 |

抽象概念有完整的符号体系,具体概念(如“山”、“人”)常采用向抽象概念挂靠或独立设计基本物概念节点(如w)的方式表达。 |

覆盖全部语言概念,区分可直接对应具体事物和不能直接对应的概念。 |

|

2. 抽象概念核心:主体基元概念(作用效应链) |

作用(0)、过程(1)、转移(2)、效应(3)、关系(4)、状态(5),共6个环节。 |

用单个数字(0-5)表示一级节点。例如: |

描述任何事物发生、发展的六个基本环节,是语句分类和概念联想的根本依据。 |

|

3. 概念层次符号(核心结构) |

高层(y)、中层(m)、底层(t)符号串,构成 `y |

(m |

t |

|

4. 五元组(类别符号) |

动态(v)、静态(g)、属性(u)、值(z)、效应(r)。 |

附加在概念符号前,表示概念的外在表现。例如: |

刻画概念的基本类别,是词语聚类和语义相似度计算的重要依据。 |

|

5. 完整概念表达式 |

类型符号、类别符号(五元组)、层次符号串组合。 |

|

对概念进行完整的形式化表述。 |

核心思想与启示

HNC概念基元体系的核心思想在于,试图用一套形式化、数字化的符号系统来精确表达人类知识的“局部联想脉络”。每个符号都不是随意的,而是承载着明确的层次和关系信息。

这种设计使得计算机在处理词汇和句子时,可以更多地依赖符号的精确匹配和计算(例如,通过比较HNC符号的匹配程度来判断词语是否为同义词或反义词),而不仅仅依赖于统计概率。尽管这套体系非常复杂,且在实际的大规模应用中面临挑战,但它为自然语言处理提供了一条面向深度理解的独特路径,其思想对探索语言与知识表示的关系具有深刻的启发意义。

1.15 HNC概念理论及矩阵算法在HNC理论中实现语义相似度计算的机理

在HNC理论中,矩阵算法通过将概念符号的层次化匹配问题转化为可计算的矩阵运算,来实现语义相似度的计算。其核心在于利用HNC独特的符号体系对概念进行形式化描述,并通过矩阵来组织和计算这些符号之间的匹配程度。

下面这个表格概述了HNC符号的关键构成部分及其在矩阵计算中的角色,可以帮助你快速把握整体框架。

|

HNC符号组件 |

说明 |

在矩阵计算中的作用 |

|---|---|---|

|

语义网络符号 |

标识概念所属的最基本类别(如抽象、具体、物、人) |

决定概念间是否具有可比性的首要条件,如同矩阵运算的“准入规则” |

|

五元组符号 |

描述概念的侧面(动态v, 静态g, 属性u, 值z, 效应r) |

细化概念比较的维度,是矩阵中比较的基本单元之一 |

|

层次符号 |

一串十六进制数字,表示概念在层次树中的精确位置 |

匹配计算的核心,从高层到底层逐级比较,匹配深度决定相似度 |

|

组合符号 |

连接简单概念以表达复合概念的特殊符号 |

处理复杂概念时,用于划分概念主体与附加部分,指导计算重点 |

矩阵构建与计算步骤

基于上述符号体系,具体的矩阵计算可以分为以下几步:

-

概念符号分解与向量化

首先,需要将待比较的两个词语的HNC符号分解为上述基本组件。接着,将这些符号组件转换为向量形式,以便进行数学运算。例如,可以为每个概念创建一个特征向量,向量的不同维度对应不同的HNC符号元素(如语义网络类型、五元组、各级层次符号等)。

-

构建相似度计算矩阵

核心步骤是构建一个相似度矩阵。这个矩阵的行和列分别对应两个概念向量的各个组件。矩阵中的每个元素 Sij表示第一个概念的第 i个组件与第二个概念的第 j个组件之间的匹配得分。匹配规则通常采用“相同得分,相异不计”的原则,并考虑层次结构:

-

高层符号匹配是基础:如果代表概念大类的高层符号不匹配,则底层符号无需比较或得分为0。

-

逐级精确化:高层符号匹配后,再依次比较中层、底层符号,匹配的层级越深、越精确,得分越高。具体的匹配得分规则可参考下表:

匹配情况描述

示例

得分

完全不匹配

两个概念的语义网络符号或核心高层符号不同

0

抽象/具体性匹配成功

两个概念均为人(语义网络符号h)

1

五元组匹配成功

均为动态概念(v)

3

高层部分匹配成功

高层符号的前几位数字相同

4

高层匹配但底层不成功

高层符号完全一致,但底层符号不同

5

高层匹配但底层未匹配

高层符号完全一致,未比较底层符号

6

全部匹配成功

从语义网络符号到底层符号完全一致

7

-

-

计算总体语义相似度

在获得相似度矩阵后,需要将这些局部的匹配得分汇总成一个总的语义相似度值。HNC方法会综合概念内涵(层次符号的匹配程度)、概念外部特征(五元组)、概念类别(语义网络符号)以及组合符号的影响,通过一定的加权或聚合函数(例如,对矩阵中的重要元素得分进行加权平均)来计算最终的相似度。研究表明,这种方法计算出的结果与人的主观判断具有较高的一致性。

核心优势

与传统的仅依赖词汇共现或简单路径长度的算法相比,HNC结合矩阵算法的优势在于:

-

深度利用语义知识:它建立在严谨的概念层次网络之上,能够捕捉更深的语义信息。

-

减弱对语料库的依赖:作为一种基于知识本体的方法,它主要依赖HNC符号体系而非大规模语料库统计。

-

解释性强:由于计算过程基于形式化的符号匹配,相较于一些神经网络“黑盒”模型,其结果更具可解释性。

1.16 HNC概念基元体系

HNC概念基元体系通过其形式化的符号系统,为计算语义相似度提供了一条独特的路径。其核心在于将词语的语义转化为可计算的概念符号,并通过比较这些符号的关联程度来量化语义相似度。

下表概括了HNC实现语义相似度计算的关键步骤与逻辑:

| 关键步骤 | 核心操作与判定规则 | 计算目标 |

|---|---|---|

| 1. 词语符号化 | 将每个词语映射为HNC符号表达式,格式为:[类别符号][层次符号串][组合结构符号]...。对于未收录词,可采用近义词匹配等方式补全其HNC符号。 |

将自然语言词汇转化为形式化的、计算机可处理的概念代码。 |

| 2. 概念分解与比对 | 将HNC符号分解为网络符号、五元组、本体层、高层、中层、底层等组件。 | 从不同维度解构概念,为逐层比较奠定基础。 |

| 3. 语义相似度计算 | 基于符号组件匹配计算相似度Sim。匹配规则包括:高层符号决定概念大类相似性;中层符号(如c21与c22)体现对比或对偶关系(反义);底层符号表征更细微的差异。最终语义距离 SDC = 1 - Sim。 |

得到一个量化的数值,衡量两个概念符号在HNC体系中的语义远近。 |

| 4. 语义关系判定 | 同义词:通常符号高度匹配,语义距离最近(如“实施”和“实行”均标注为va02)。反义词:往往具有相同的网络符号、五元组和本体层,但中层符号呈对偶或对比性(如“强(u00c21)”与“弱(u00c22)”)。近义词/关联词:概念节点具有包含、上下位或交式关联等关系(如“情感(g713)”和“高兴(vu7131)”)。 |

根据符号间的特定关系模式,判断词语属于何种语义关系。 |

实际应用与优势

在实际的NLP系统中,例如问答社区的情感摘要生成,HNC的这种方法展现出其独特价值。系统通过HNC符号定位情感词(如识别概念层次为“713”或五元组含属性符号“u”的词语),并计算其情感值,进而对答案句子进行聚类,生成不同情感倾向的摘要。这种方法不依赖海量的训练语料,对于处理用词灵活、新词频出的网络文本尤其有优势。

下面用一个完整的例子来说明HNC如何计算两个句子的语义相似度。这个过程就像做一道菜,我们先准备食材(符号化),再加工食材(构建矩阵),最后烹饪调味(计算得分)。

第一步:句子预处理与HNC符号化

假设我们要计算下面两个句子的语义相似度:

-

句子A:消费者咨询笔记本电脑价格。

-

句子B:用户询问手提电脑售价。

首先,对句子进行分词并去除停用词等:

-

句子A关键词:

消费者,咨询,笔记本电脑,价格 -

句子B关键词:

用户,询问,手提电脑,售价

接着,为每个关键词赋予HNC概念符号(为简化说明,此处使用易于理解的符号示意,实际的HNC符号体系更为复杂精密):

-

消费者&用户→ 概念符号:[human-role, acquirer](皆表示“获取者”的人类角色) -

咨询&询问→ 概念符号:[action, information-exchange, query](皆表示“信息交换”中的“询问”动作) -

笔记本电脑&手提电脑→ 概念符号:[entity, computer, portable](皆表示“便携式计算机”实体) -

价格&售价→ 概念符号:[attribute, value, monetary](皆表示“货币价值”属性)

第二步:构建语义相似度矩阵

现在,我们基于HNC符号的匹配程度来计算每对词语之间的语义相似度。在HNC体系中,符号匹配越精确,相似度越高。由此,我们可以构建一个语义相似度矩阵。

| 消费者 (A1) | 咨询 (A2) | 笔记本电脑 (A3) | 价格 (A4) | |

|---|---|---|---|---|

| 用户 (B1) | 1.0 | 0.1 | 0.1 | 0.1 |

| 询问 (B2) | 0.1 | 1.0 | 0.1 | 0.1 |

| 手提电脑 (B3) | 0.1 | 0.1 | 1.0 | 0.1 |

| 售价 (B4) | 0.1 | 0.1 | 0.1 | 1.0 |

在这个简化的矩阵中,我们假设只有当两个词的HNC概念符号完全相同时,相似度为1.0;否则为较低的0.1。实际应用中,HNC理论可以计算不同符号之间的关联度,从而得到更精细的相似度值(例如0.9, 0.8等)。

第三步:矩阵匹配与相似度计算

有了矩阵后,我们采用一种类似“语义版Jaccard”的算法来找出最优的词语匹配组合,并计算整体句子相似度。

-

寻找最佳匹配对:算法会在矩阵中寻找相似度最高的词对。在我们的例子中,

消费者-用户、咨询-询问、笔记本电脑-手提电脑、价格-售价这四对的相似度都是最高的1.0。 -

迭代匹配:算法会先匹配第一对(如

消费者-用户),将它们从后续匹配中移除(即划掉对应的行和列),然后在剩下的词语中继续寻找下一个最佳匹配,直到所有可能的匹配完成。 -

计算最终得分:因为这个例子中的词语都能理想地一一对应,所有匹配对的相似度都是1.0。最终,句子的整体相似度可以计算为匹配对的相似度之和除以总词语数(或取平均)。这里,相似度总和是4.0,两个句子的关键词都是4个,所以平均相似度为

4.0 / 4 = 1.0,表示两个句子在HNC符号所表达的语义层面上高度一致。

核心思路总结

这个例子展示了HNC计算句子相似度的核心逻辑:避开词语字面的直接对比,深入其背后的概念层(HNC符号)。即使字面不同(如“消费者”和“用户”),只要它们对应的HNC概念符号相同或高度相关,就对句子相似度产生高贡献。矩阵算法则提供了一种结构化且可计算的方式来管理和优化这个匹配。

1.17 HNC理论与Word2Vec、BERT等现代嵌入方法在语义相似度计算的差异性

HNC理论与Word2Vec、BERT等现代嵌入方法在语义相似度计算上代表了两种不同的技术路径,它们在理论基础、实现方式以及适用场景上各有侧重。

|

特性维度 |

HNC (概念层次网络) |

Word2Vec |

BERT及相关模型 (如Sentence-BERT) |

|---|---|---|---|

|

理论基础 |

基于符号逻辑和概念层次结构的语言学理论 |

基于分布假说(上下文相似的词义相似)的统计学方法 |

基于深度双向Transformer架构,利用海量数据预训练 |

|

语义表示 |

符号化、结构化。强调概念本身的内涵、类别及关系。 |

分布式向量。将单词映射为稠密向量,语义由向量空间中的相对位置体现。 |

上下文感知的向量。根据具体上下文为每个词或句子生成动态的向量表示。 |

|

核心优势 |

可解释性强:相似度计算基于明确的符号逻辑,过程相对透明。 |

计算效率高:模型相对轻量,训练和推理速度快。 |

精准度高:在多数公开评测中表现出色,尤其对一词多义和复杂语境理解深刻。 |

|

主要局限 |

依赖人工体系:概念符号体系的构建和维护需要大量专家知识,难以扩展。 |

静态歧义:每个词只有单一向量,无法解决一词多义问题。 |

计算资源大:模型参数量巨大,训练和部署成本高。 |

如何选择适合的方法

选择哪种方法取决于你的具体需求、资源和场景:

-

追求高精度且资源充足:对于大多数现代应用,特别是对准确率要求高的生产环境(如智能客服、搜索引擎),BERT或Sentence-BERT等基于Transformer的模型通常是首选。它们能提供最先进的效果。

-

重视可解释性或缺乏标注数据:在专业领域(如法律、医疗初探)、低资源语言研究,或需要对决策过程进行人工审查和干预的场景中,HNC这类基于符号逻辑的方法具有独特价值。它的可解释性优势明显。

-

需要快速原型或处理超大规模数据:在对一词多义要求不高、且需要高效率的场景(如简单推荐系统、初期文本聚类),Word2Vec等静态词向量模型因其简单高效,仍有其用武之地。

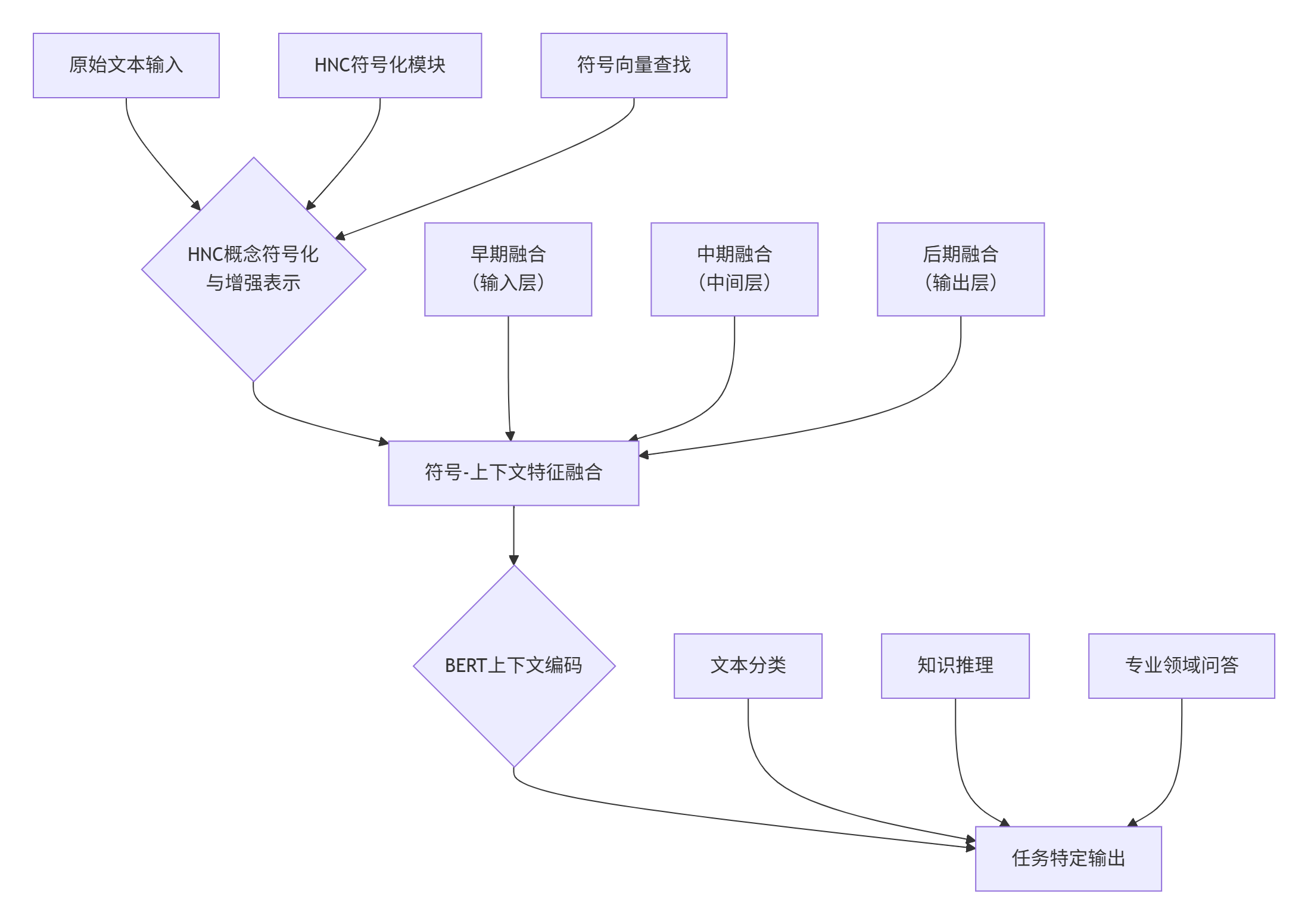

1.18 HNC(概念层次网络)的符号化、结构化优势与BERT基于上下文的动态语义理解能力相结合

将HNC(概念层次网络)的符号化、结构化优势与BERT基于上下文的动态语义理解能力相结合,构建混合模型,是一个极具潜力的研究方向。这旨在将人类先验知识的结构化能力与数据驱动的表示学习能力相融合。

融合策略:从输入到输出

实现有效融合的关键在于设计HNC符号如何与BERT交互。以下是三种不同阶段的融合策略:

-

早期融合(输入层增强)

-

操作:将HNC符号系统视为一个外部知识嵌入层。在文本经过BERT的Tokenizer处理成

input_ids的同时,通过一个并行的HNC符号解析器,为每个词或短语生成对应的HNC概念符号(如v7115[9](e41))。将这些符号映射为向量(HNC Embedding),然后与BERT的Token Embeddings、Segment Embeddings和Position Embeddings进行拼接或相加。 -

优势:从模型最底层注入结构化知识,使BERT从一开始就“感知”到概念的抽象类别和关系。

-

挑战:需要高质量的HNC符号化工具,且可能增加输入维度。

-

-

中期融合(中间层引导)

-

操作:在BERT的中间层(例如第6层)引入知识感知的注意力机制。将HNC符号向量作为Key-Value对,与BERT该层输出的隐藏状态作为Query进行交叉注意力计算。这相当于在BERT内部进行了一次“知识查询”,用HNC的结构化知识来调整或增强BERT的上下文表示。

-

优势:更为灵活,允许模型在深层次特征提取阶段动态地融合上下文信息和先验知识。

-

挑战:计算复杂度较高,需要精心设计注意力机制。

-

-

后期融合(输出层约束)

-

操作:不改变BERT本体,将其视为一个强大的上下文特征提取器。在得到BERT的输出(如

[CLS]向量或各token的隐藏状态)后,将其与整个句子的HNC概念图谱的向量化表示进行拼接,再送入任务特定的输出层(分类器、CRF等)。此外,可以在损失函数中加入基于HNC的规则化约束,例如,惩罚那些在HNC概念层面上语义距离很远但被模型预测为相似的结果。 -

优势:实现简单,无需修改BERT核心结构,易于快速实验。

-

挑战:对BERT内部表示的干预最弱,可能无法充分发挥协同效应。

-

预期优势与应用场景

这种混合模型有望在以下几个方面超越单一的BERT或HNC模型:

-

增强可解释性:模型的决策过程可以部分追溯至HNC符号,提供“模型判断句子A和B相似,是因为它们共享XX概念基元”这类解释,而不仅仅是依赖黑箱的注意力权重。

-

提升小样本学习能力:在标注数据稀缺的专业领域(如法律、医疗),HNC提供的结构化先验知识可以作为一种强引导,帮助模型更快、更准地学习,有效缓解过拟合。

-

改善推理与一致性:通过HNC的符号逻辑约束,模型可以更好地保持推理过程中的概念一致性,减少违反常识或领域规则的“幻觉”输出。这对于知识密集型任务如问答和推理尤为重要。

实现挑战与考量

实现这一架构需应对以下几个核心挑战:

-

HNC符号化的自动化与精度:需要开发可靠的工具来自动将任意文本转化为准确的HNC符号,这是整个架构的基石。

-

融合模块的设计与优化:如何设计最有效的融合架构(如早期的拼接、中期的注意力机制)并平衡两者的贡献,需要大量的实验验证。

-

计算效率:引入HNC符号化及融合模块可能会增加计算开销,需要在性能和效率之间找到平衡点。

1.19 HNC概念基元体系计算语义相似度

HNC概念基元体系通过其形式化的符号系统,为计算词语和句子间的语义相似度提供了一条独特的路径。其核心在于将词语的语义映射为HNC概念符号,然后通过比较这些符号的异同来计算语义相似度。

词语相似度计算

词语的语义相似度计算是HNC处理语义相似度的基础,关键在于将词语映射到HNC符号后进行系统比较。

首先,每个词语会被映射到其HNC概念符号。一个完整的HNC符号通常包含概念类别符号(如五元组v,g,u,z,r)、层次符号串(表达概念的高、中、底层结构)以及可能的组合符号。计算两个词语的语义相似度时,核心是对它们的HNC符号进行系统性比较。下表概括了HNC符号比较的主要维度:

|

比较维度 |

说明 |

示例 |

|---|---|---|

|

五元组匹配 |

检查概念的外部表现类别(动态、静态、属性等)是否一致。 |

动态(v)与静态(g)不匹配。 |

|

高层符号匹配 |

比较概念在层次结构中的上位概念是否相同,这是相似度的基础。 |

心理活动(71)的高层节点相同。 |

|

底层符号匹配 |

在高层匹配的前提下,比较更精细的下位概念节点。 |

态度(711)的下层节点(7115)。 |

|

中层符号对偶/对比性 |

检查概念是否具有对偶(如e5m)或对比(如c5n)关系,这对判断反义很重要。 |

具体的符号匹配规则可概括如下:

-

高层符号匹配是前提:如果两个词语的高层概念节点不同,其语义相似度会很低。

-

底层符号决定精细度:在高层次符号匹配成功的基础上,底层符号的匹配程度决定了语义相似的精细粒度。

-

数字比较:由于HNC符号基元常采用数字编码,匹配过程在计算上可转换为数字串的比较,规则清晰,便于计算。

对于未在HNC知识库中收录的新词(如网络用语),研究者也提出了解决方法。例如,可以先通过中文近义词工具找到与新词最相似的若干个已收录词,然后将这些已收录词的HNC符号赋予新词,从而实现对未收录词的符号补全。

句子相似度计算

在词语相似度计算的基础上,HNC理论进一步用于计算更复杂的句子语义相似度。基本流程通常包括以下几个步骤:

-

句子预处理:对句子进行分词、去除停用词等基本处理。

-

词语映射与概念层次构建:将句子中的每个词语映射到其HNC概念符号,并利用WordNet等资源获取近义词、反义词等信息,从而构建整个句子的概念层次结构。

-

概念相似度矩阵计算:计算两个句子中词语两两之间的HNC概念相似度,形成一个概念相似度矩阵。这个过程会综合利用前述的词语相似度计算方法。

-

关系语义分析:除了词语本身的概念,还会识别和分析句子中词语之间的语义关系。

-

相似度综合计算:最后,将概念相似度矩阵和关系语义信息结合起来,采用如余弦相似度等度量方法,计算出两个句子的整体语义相似度值。

实际应用与优势

基于HNC的语义相似度计算方法在多种自然语言处理任务中展现了应用潜力:

-

文本分类与信息检索:通过计算查询关键词与文档、或文档与文档类别之间的HNC语义相似度,可以提高分类和检索的准确率。

-

问答社区答案摘要生成:在问答社区中,可以利用HNC理论对答案句子进行情感分析(利用HNC符号定位情感词并计算情感值),然后对句子进行聚类,生成不同情感倾向的答案摘要。

-

自动问答系统:HNC方法可以帮助更准确地理解用户问题的语义,并找到与之最匹配的答案。

与一些传统方法(如单纯的字面匹配或早期的词向量方法)相比,HNC方法的主要优势在于其深度的语义理解能力。它不依赖于海量的训练数据,而是通过其精心设计的符号系统直接捕捉概念之间的语义关联,对于处理语言稀疏性和歧义性问题有一定优势。

挑战与展望

尽管HNC理论在语义计算方面有其独特价值,但在实际应用中也面临一些挑战:

-

知识库覆盖度:虽然可以通过近义词等方式补全,但HNC知识库对网络新词的覆盖仍可能滞后,需要持续更新和维护。

-

计算复杂度:进行深层次的语义分析可能会带来较高的计算复杂度。

-

句法语义结合:如何将HNC对概念的深层语义表示与句子表层的句法结构更有效地结合,是一个需要进一步探索的问题。

总的来说,HNC概念基元体系通过其形式化的符号语言,为语义相似度计算提供了一条基于深层语义的、可解释的路径。它在处理需要精细语义区分和理解的任务时,显示出不同于统计和深度学习方法的独特价值。

1.20 HNC的符号化优势与BERT的上下文理解能力在早期融合阶段结合

将HNC的符号化优势与BERT的上下文理解能力在早期融合阶段结合,关键在于如何将两种不同源的特征向量有效整合。下面我们具体看看向量融合的操作方法、权重分配策略以及一些重要的实践考量。

向量融合操作

早期融合主要发生在模型的输入嵌入层。HNC符号和BERT的Token Embedding在此结合,主要有两种方式:

-

拼接(Concatenation)

将HNC符号向量和BERT词元嵌入向量直接连接在一起,形成一个更长的融合向量。

import torch # 假设hnc_embedding和bert_embedding是已经获取好的向量 fused_embedding = torch.cat((hnc_embedding, bert_embedding), dim=-1) # 在最后一个维度拼接-

优点:操作简单,能完整保留HNC和BERT的原始信息。

-

缺点:会增加后续层(如Transformer编码器)的输入维度,可能增加计算量。通常需要在拼接后引入一个线性投影层,将融合后的向量调整回BERT模型预期的隐藏层维度(如768维)。

-

-

相加(Addition)

将HNC符号向量和BERT词元嵌入向量直接逐元素相加。

fused_embedding = hnc_embedding + bert_embedding-

优点:保持向量维度不变,无需调整模型结构,计算高效。从数学角度看,这类似于BERT模型内部对词嵌入、位置嵌入和段嵌入的处理方式,可以理解为将HNC符号作为另一种特征嵌入与原有嵌入在同一个空间中进行叠加。

-

缺点:要求HNC符号向量和BERT词元嵌入向量必须具有相同的维度。如果维度不同,需先对HNC向量进行线性变换使其对齐。

-

操作选择建议:在初始探索阶段,如果计算资源允许,可以尝试拼接方式,因为它能最大程度保留信息。若追求效率或希望保持模型结构稳定,且能确保维度对齐,相加是一个更简洁的选择。

权重分配策略

确定了融合方式后,如何分配HNC符号和BERT嵌入的权重至关重要。策略可分为静态和动态两类。

-

静态权重分配

为HNC向量和BERT向量分配固定的权重系数。

-

默认等权:最简单的方法是直接相加(即权重各为1.0)。

-

手动调整:根据先验知识调整。例如,若认为当前任务中HNC的结构化知识更重要,可适当增大HNC向量的权重(如

1.2 * hnc_embedding + 0.8 * bert_embedding)。 -

可学习标量:引入一个可学习的标量参数 λ 来加权HNC向量:

λ * hnc_embedding + bert_embedding。初始值可设为0.5,让模型在训练中自行确定最佳平衡点。

-

-

动态权重分配(更高级的策略)

静态权重可能无法适应不同词语或语境的重要性变化。动态权重分配能根据具体输入决定侧重哪种信息。

-

基于注意力机制:引入一个轻量的注意力网络,为每个词元计算HNC和BERT向量的权重。模型会自动学习在哪些上下文中HNC符号更重要,哪些情况下BERT的上下文表征更可靠。

-

门控机制(Gating Mechanism):类似LSTM中的门控,生成一个介于0到1之间的门控值 g,融合方式为

g * hnc_embedding + (1 - g) * bert_embedding。门控值 g 由BERT的隐藏状态或词元本身计算得出,实现更精细的调控。

-

策略选择建议:建议从可学习标量开始,它简单且能提供一定的适应性。若任务复杂且数据充足,基于注意力机制的动态权重分配通常能获得更好的性能,因为它能更灵活地捕捉语境依赖。

实践考量与建议

在实际操作中,还有一些关键点需要注意:

-

HNC符号的向量化:首先需要将离散的HNC符号转化为连续向量。可以为HNC概念基元或句类构建一个嵌入矩阵(Embedding Matrix),通过查找表方式将符号映射为向量。这个嵌入矩阵可以随机初始化,并与模型的其他部分一起训练。

-

维度对齐:若采用相加融合,务必确保HNC符号向量的维度与BERT嵌入维度(如768维)一致。

-

过拟合风险:HNC符号可能提供很强的归纳偏置,但也可能引入噪声或与特定任务无关的信息。尤其在数据量不大时,需警惕过拟合。对策包括:对HNC嵌入层使用较强的权重衰减(L2正则化)、Dropout,或将HNC嵌入层设置为部分冻结(例如先训练几轮后解冻)。

-

实验与评估:不同的NLP任务(如文本分类、知识推理、专业领域问答)对先验知识和上下文理解的依赖程度不同。没有放之四海而皆准的最佳策略。强烈建议通过实验(例如交叉验证)来评估不同融合方式和权重分配策略在特定任务和数据集上的效果。

1.21 不同NLP任务中HNC与BERT的融合策略

在不同NLP任务中,HNC与BERT的融合策略确实需要“因任务而异”。其核心差异在于,分类任务更侧重于文本的整体语义归属判断,而问答(特别是抽取式问答)任务则要求模型能精准定位文本中的具体片段。 这种根本性的目标差异,决定了融合策略在输入处理、特征交互和输出层设计上的不同侧重点。

下面这个表格清晰地对比了两种任务下的核心策略差异。

|

任务类型 |

融合策略核心目标 |

推荐的HNC-BERT融合策略 |

关键优势 |

|---|---|---|---|

|

文本分类 |

增强模型对文本整体语义和主题范畴的理解 |

基于提示模板的融合:将HNC符号作为提示词与原始文本拼接,利用 |

将分类任务转化为BERT更擅长的完形填空,有效利用其MLM能力,激发模型对抽象概念(如情感、主题)的深层理解。 |

|

问答任务 |

强化模型对上下文逻辑和答案边界的精准识别 |

特征增强与中间层交互:将HNC符号向量与BERT中间层隐藏状态融合(如拼接或相加),或在编码器后引入基于HNC的注意力引导。 |

在不改变BERT原有问答架构(预测答案开始/结束位置)的前提下,为模型提供额外的结构化知识线索,辅助其进行更精确的边界判断。 |

🔍 策略差异的根源与实现细节

这两种策略的差异主要源于任务本质的不同。

-

分类任务:利用提示学习。文本分类(如情感分析、新闻分类)通常是一个句子级或篇章级的全局判断。基于提示模板的方法之所以有效,是因为它将分类问题巧妙地重构为BERT预训练阶段的核心任务——掩码语言模型(MLM)任务。例如,为了判断“这家餐厅的菜品很棒”的情感,可以构建模板:“

[CLS] 这家餐厅的菜品很棒。它的情感是[MASK]的。[SEP]”。此时,你可以将HNC中表示“积极”或“消极”的概念符号作为先验知识融入模板,或者直接利用[MASK]位置的输出向量进行分类。这种方法使模型在它最熟悉的模式(预测掩码词)下工作,能更充分地利用预训练获得的知识。 -

问答任务:侧重特征增强。抽取式问答(如SQuAD任务)是一个词元级的细粒度定位任务,模型需要输出答案在原文中的开始和结束位置。因此,融合策略需要更精细地影响模型对文本内部每个词元的理解。将HNC符号表示(如句子中实体间的逻辑关系)与BERT中间层的上下文表示进行融合,可以为模型提供更深层的语义约束。例如,在回答“谁发明了电话?”时,HNC符号可能强化“发明”是一种“创造”作用,以及“电话”是“创造”的效应体这种关系,这种结构化信息能帮助模型更准确地锁定答案主体是“亚历山大·贝尔”,而不是上下文中的其他人物。

选择策略的额外考量

选择融合策略时,还有一些关键因素值得你关注:

-

计算效率:基于提示模板的方法通常更轻量,因为主要改动在输入层。而特征层融合可能需要引入额外的网络层或计算步骤,会增加一些计算开销。

-

任务复杂度:对于关系分类、事件抽取等更复杂的任务,可能需要结合两种策略。例如,既使用提示模板引导整体方向,又在模型内部进行特征融合以捕捉局部依赖。

-

HNC符号的质量:无论哪种策略,其效果都强烈依赖于HNC符号化过程的准确性。如果HNC符号本身存在大量错误或歧义,反而可能对模型产生干扰。

1.22 为HNC符号进行向量化的策略

在为HNC符号进行向量化时,除了随机初始化,确实有一些更具针对性的策略,它们能更好地利用HNC理论本身的结构化知识或外部的语义信息。下面这个表格梳理了主要的预训练和知识引导初始化方法。

|

方法类别 |

具体方法 |

核心思想 |

适用场景与优势 |

|---|---|---|---|

|

💡 预训练模型迁移 |

通用词向量(Word2Vec, GloVe) |

利用大规模语料训练得到的通用语义向量作为HNC符号的初始表示。 |

HNC符号与日常语言词汇有较强对应关系时;可快速引入通用语义知识。 |

|

领域专用词向量 |

使用专业领域(如医学、金融)语料训练的词向量进行初始化。 |

HNC符号应用于特定专业领域时;能更好地捕捉领域内语义。 |

|

|

知识引导初始化 |

基于符号层次结构 |

根据HNC概念基元的层次关系(如父子、兄弟关系)初始化向量,使相关概念的初始向量更接近。 |

强调HNC符号体系本身的层次性和关联性;让模型从一开始就具备结构知识。 |

|

基于句类关系 |

利用HNC句类知识,将经常出现在相同或相关句类中的符号向量初始化为相近。 |

侧重于HNC句类分析任务;有助于模型快速捕捉句类与概念之间的搭配关系。 |

如何选择与实施

了解了各种方法后,关键在于如何根据你的具体任务做出选择并进行实践。

-

评估对齐性:首先需要分析你的HNC符号集合与外部语义资源(如预训练词向量)的可对齐性。如果大部分符号都能找到直接或间接的对应词,预训练迁移会是一个高效的选择。如果符号体系非常独特或专业,知识引导的初始化可能更合适。

-

初始化后的微调:无论采用哪种初始化方法,这些初始向量通常都需要在后续的特定任务中进行微调(Fine-tuning)。预训练模型迁移初始化能提供较好的初始起点,并有助于加速模型收敛。知识引导的初始化则注入了特定的归纳偏置。关键是通过训练,让模型根据任务目标调整这些初始向量,使其最终表示既包含先验知识,又符合任务需求。

-

实践建议:建议从一个简单的基线开始,例如直接使用预训练词向量。如果效果不佳,再尝试融入更复杂的HNC结构知识。可以设计实验对比不同初始化策略对模型最终性能的影响。

需要注意的问题

在应用这些方法时,有两点需要特别留意:

-

处理未登录符号:对于在预训练词表中找不到对应项的HNC符号,需要有备选方案,例如回退到随机初始化,或利用其父类/相关概念的向量进行组合表示。

-

知识冲突:外部预训练知识可能与HNC体系下的特定定义存在差异。模型需要有能力在训练过程中调整和修正这些初始表示,以适应HNC的独特逻辑。

1.23 预训练词向量与HNC概念体系的定义出现冲突解决思路

当预训练词向量与HNC概念体系的定义出现冲突时,这本质上是数据驱动的统计规律与人类先验知识之间的碰撞。

四种核心调和策略

| 策略方向 | 核心思路 | 适用场景 |

|---|---|---|

| 分层加权整合 | 在模型的不同层级(如义原层、词语层)设置可学习的权重参数,动态调整HNC定义与词向量贡献度。 | 需要兼顾概念准确性与上下文语义的任务,如知识图谱构建、专业问答系统。 |

| 知识增强预训练 | 在预训练阶段,将HNC的符号化知识作为额外监督信号,引导模型学习符合定义的词表示。 | 拥有领域知识库且需训练高质量词向量的场景,如医疗、法律专业领域。 |

| 上下文感知的动态选择 | 根据具体语境动态选择更可靠的表示源。当上下文强相关时信赖词向量,反之则倾向HNC定义。 | 词义消歧、机器翻译等对上下文高度敏感的任务。 |

| 构建混合表示模型 | 将HNC符号作为特征与词向量拼接或组合,形成混合表示,共同输入下游模型。 | 各类对表示质量要求较高的NLP任务,作为一种稳健的基线方法。 |

深入理解策略细节

上述策略的有效性,源于对冲突根源的针对性处理。下面我们进一步探讨其关键细节。

-

分层加权整合的策略基础:这种策略的灵感来源于知识库(如Hownet,与HNC类似)的词向量研究方法。其核心在于认识到冲突可能发生在不同层面。例如,一个词在HNC中的核心义原定义(如“苹果”的

fruit|水果义原)通常是稳定和权威的,而其在大规模语料中通过统计学习到的词向量,则可能更偏向于常见的上下文用法(如“苹果公司”)。因此,可以在模型设计中,为HNC义原表示和预训练词向量分别设置可学习的权重,让模型根据任务目标自动学习在最终的综合向量表示中更信赖哪一方。 -

知识增强预训练的实现方式:这类方法通过在预训练阶段引入额外损失函数来实现。例如,可以设计一个义原预测任务,要求模型在给定上下文的情况下,预测被掩码词的HNC义原标签。这样,模型在学习上下文共现规律的同时,也被引导去关注与人类先验知识一致的语义特征。有些研究(如ERNIE)也采用了类似思想,通过引入外部知识实体来增强预训练模型。这相当于在模型“上学”阶段就灌输了结构化的知识,有助于塑造更符合定义的初始向量表示。

-

冲突的识别与评估:在实施调和策略前,一个重要步骤是识别和评估冲突的严重性。您可以设计一些检测方法,例如:

-

计算词语的HNC表示与预训练词向量之间的余弦相似度。如果相似度持续低于某个阈值,则表明可能存在显著冲突。

-

检查冲突词语在语料中的具体用法。如果预训练词向量所反映的常用语义与HNC定义的核心语义确实存在合理差异(例如,“Java”更多指编程语言而非岛屿),那么这种“冲突”可能恰恰是需要模型具备的语境感知能力。

-

总结与建议

总而言之,调和预训练词向量与HNC体系的冲突并非追求绝对的统一,而是旨在建立一个富有弹性的协作机制。其目标是让数据驱动的力量与人类知识的智慧相互补充,从而产生更具鲁棒性和可信度的语言表示。

在实际操作中,建议我们从相对简单的混合表示模型入手作为基线。若对性能有更高要求,再尝试实现分层加权或知识增强预训练等更复杂的策略。同时,不要忽视对冲突本身的分析,理解其成因有助于我们选择最合适的调和路径。

1.24 概念层次网络(HNC)和概念流形在大语言模型领域的关联性与作用

理解概念层次网络(HNC)和概念流形在大语言模型领域的关联性与作用,确实能帮助我们窥见下一代语言智能的可能样貌。这两种理论分别从符号逻辑和几何结构的视角刻画概念体系,它们并非相互替代,而是共同为LLM提供了更丰富、更结构化的知识表征框架。

下表概括了它们的核心关联与协同作用。

| 特征维度 | 概念层次网络 (HNC) | 概念流形 (Concept Manifold) | 协同作用 (在大语言模型中) |

|---|---|---|---|

| 核心视角 | 符号化、离散化、逻辑化的层次结构 | 几何化、连续化、空间化的拓扑结构 | HNC提供结构化先验,概念流形提供连续表示空间 |

| 知识表示 | 通过五元组、语义网络、句类等对概念进行显式、符号化定义和关联1 | 将概念嵌入到高维连续空间,概念之间的关系由距离、方向、曲率等几何属性刻画 | HNC的符号框架可指导或解释概念在流形空间中的几何关系5 |

| 核心作用 | 提供可解释的、受人类先验知识约束的概念关系蓝图 | 提供可计算、可操作的语义表示基础,支持向量运算等操作6 | 二者结合旨在实现符号系统的精确性与几何表示灵活性的统一 |

关联性与协同作用

尽管视角不同,但HNC与概念流形在大语言模型中可以紧密协同,具体体现在以下几个方面:

1.结构化先验与几何实现的互补

HNC理论构建的概念层次网络(如基元概念语义网络、句类体系)可以看作是对概念空间的一种理想化、结构化的蓝图或强先验约束。而概念流形则是LLM从海量数据中实际学习到的、在隐藏层激活值所构成的高维空间中的连续几何实现。理想情况下,HNC所定义的逻辑关系(如上下位、因果关系)应在概念流形上有所体现,例如,具有上下位关系的概念在流形上可能距离较近,且处于特定的方向之上。

2.符号接地与几何解释的桥梁

HNC面临的挑战之一是如何将符号化的概念体系“接地”到具体的语言数据。概念流形为此提供了途径:HNC中的每个概念节点或符号,都可以在概念流形中找到对应的区域或方向。例如,HNC中定义的“作用效应链”这一抽象关系,可能在流形中表现为一个特定的向量方向,沿着这个方向移动,可以遍历一系列体现该关系的动词或名词。这使得抽象的符号关系有了直观的几何解释。

3.增强推理与可控生成

将HNC的句类分析等全局联想脉络与概念流形的几何操作结合,可以显著提升LLM的推理能力。例如,在处理一个复杂句子时,可先利用HNC的句类知识判断其整体语义框架(如是否为“作用-效应”句),然后将句子中的短语映射到概念流形中。通过在流形空间中进行向量的合成、插值或遵循特定语义方向的移动,可以更可控地生成符合逻辑的后续内容或进行语义推理。这为减少“幻觉”和实现可控文本生成提供了新思路。

在大语言模型领域的作用方法

将HNC和概念流形的思想应用于LLM,主要有以下几种前沿方法:

1.设计新型模型架构

一种思路是直接设计显式包含概念层次结构的模型。例如,Meta提出的“大型概念模型”尝试在高于词汇的抽象层次(如句子嵌入表示的概念)上进行操作,这在一定程度上体现了HNC追求在不同抽象层级进行联想和推理的思想。这类模型将输入文本映射到一个概念空间,并在该空间内进行预测和生成,其处理流程更接近于人类“先构思要点,再展开细节”的思维方式。

2.作为外部知识库进行增强

HNC体系可以作为一种结构化的外部知识源,通过检索增强生成技术辅助LLM。当LLM处理问题时,可以从HNC知识库中检索相关的概念定义和关系,并将其作为上下文提供给模型,从而弥补LLM内部知识可能存在的模糊、遗漏或矛盾。这种方法将HNC的符号逻辑清晰性与LLM的生成能力相结合。

3.指导模型训练与表示学习

在训练LLM时,可以引入基于HNC的约束或损失函数,引导模型学习到的概念流形空间具有更清晰的层次结构和逻辑关系。例如,通过设计损失函数,让HNC中语义相近的概念在流形空间中的向量表示彼此靠近,而语义无关或相反的概念则相互远离。这相当于用HNC的“地图”来校正模型自主学习形成的“地貌”,使其更具可解释性和规律性。

4.改进提示工程与语义控制

对概念流形几何特性的理解,可以转化为更精细的提示工程策略。例如,通过计算和添加特定的“概念方向”向量,可以引导生成文本的风格、主题或逻辑关系。这种方法本质上是在概念流形空间中进行定向导航,实现了对生成内容的细粒度控制。

总的来说,概念层次网络与概念流形分别从“语法”和“几何”的角度,为构建更智能、更可靠的大语言模型提供了深层次的指导。它们的结合,预示着自然语言处理的一个重要发展方向:将人类的知识结构性与数据驱动的表示灵活性。

1.25 大语言模型预训练中的词向量与基础概念设计

大语言模型预训练中的词向量与基础概念设计,其核心在于通过数学方法将语言元素映射到高维空间,并利用深度学习架构来演绎语义关系。

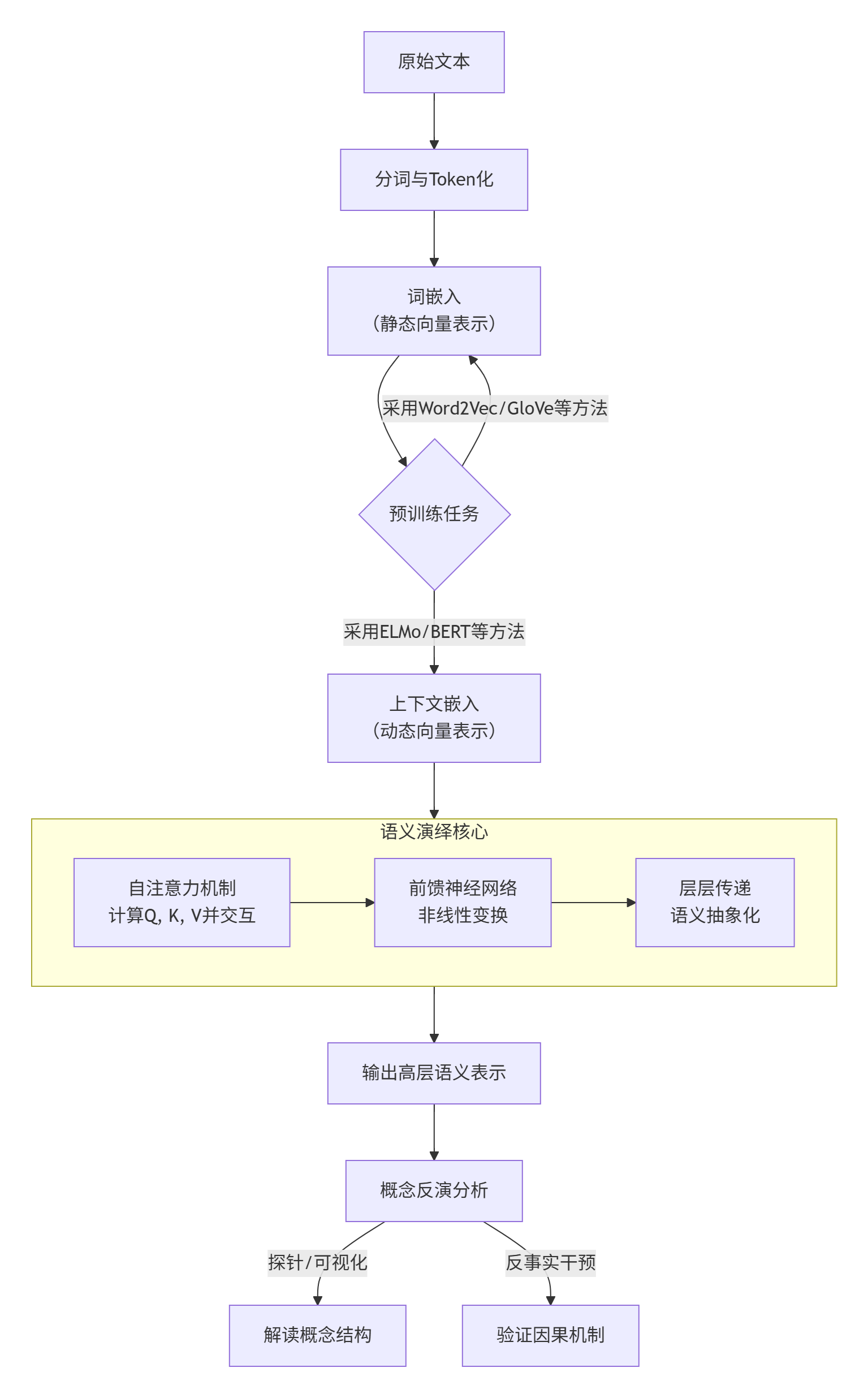

词向量的设计:从静态到动态

词向量是模型的“语言基础”,其设计目标是将离散的符号(单词)转化为机器可处理的连续数值表示(向量)。

-

静态词向量(如 Word2Vec, GloVe)

-

核心思想:基于分布式假说——“一个词的含义由其上下文决定”。通过预测目标词的上下文(Skip-gram)或通过上下文预测目标词(CBOW)来学习词向量。其数学本质是学习一个嵌入矩阵 E ,其中每一行对应一个词的向量表示 。

-

局限与演绎:这类方法是“静态的”,一个词无论语境如何都对应同一个向量。它们无法解决一词多义问题。其“演绎”能力有限,更像是一个固定的查找表。

-

-

动态词向量(上下文相关词向量,如 BERT, ELMo)

-

核心思想:一个词的最终向量表示由其所在的完整句子决定。例如,ELMo 使用双向LSTM,通过串联不同层的隐藏状态来形成词的最终表示;BERT 则使用深层的 Transformer 编码器 。

-

关键进步:实现了真正的“动态”表示。例如,“苹果”在“吃苹果”和“苹果手机”两个句子中会获得不同的向量,有效处理了一词多义 。

-

预训练与语义演绎方程

预训练过程就是模型学习语言规律的过程,其中 Transformer 的自注意力机制是实现“语义演绎”的核心。

-

自注意力机制:语义关系的演绎引擎

Transformer 的自注意力机制可视为一个强大的“语义演绎方程”。对于输入序列中的每个词,它通过三个权重矩阵( W^Q , W^K , W^V )将其原始向量投影为查询(Query, Q)、键(Key, K)和值(Value, V) 三个向量 。

自注意力的计算公式为:

\text{Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right)V这个公式可以理解为一次语义信息的加权聚合 :

-

QK^T:计算当前词(Q)与序列中所有词(K)的关联强度(注意力分数)。 -

softmax:将注意力分数归一化为概率分布,表示当前词应该“关注”上下文中其他词的程度。 -

与V相乘:根据注意力权重对所有的值向量(V)进行加权求和,得到当前词新的、融合了全局上下文信息的向量表示。

通过多层 Transformer 的堆叠,模型能够进行深层次的语义演绎。底层网络可能学习到语法规则(如主谓一致),而高层网络则能捕捉更复杂的语义逻辑、因果关系甚至隐含的情感态度 。

-

“概念反演”指的是通过分析训练好的模型内部表示,来逆向推导模型究竟学习并形成了哪些“概念”。

-

探针任务

这是一种常用的概念反演技术。它在预训练模型的中间表示(如某一层的输出向量)上,训练一个简单的分类器(如逻辑回归)来预测某个具体的语言属性或概念 。例如,用一个探针任务来判断句子中的词是名词还是动词。如果探针任务能达到很高的准确率,就说明模型的该层表示中明确编码了“词性”这一概念。这种方法帮助我们验证模型是否以及在哪里形成了我们关心的抽象概念。

-

可视化与语义方向探索

通过降维技术(如 t-SNE、PCA)将高维词向量投影到二维或三维空间进行可视化,可以直观观察语义相近的词是否聚集在一起,从而理解模型的“概念地图” 。更进一步,研究者通过向量运算来探索概念间的关系。经典的“国王 - 男人 + 女人 ≈ 女王”例子,表明模型可能学习到了“性别”和“王室”等概念方向,通过对这些概念方向的代数操作,可以实现语义的操控和迁移 。

-

反事实干预与因果分析

这是更深入的概念反演方法。通过主动干预模型的内部激活值,观察输出变化,来验证概念与模型行为之间的因果关系 。例如,如果假设模型内部存在一个“积极情感”的神经元方向,可以通过在生成过程中强化这个方向的激活强度,观察模型输出是否变得更为积极。如果效果显著,就为“模型确实形成了‘积极情感’这一概念”提供了强有力的因果证据。

1.26 大语言模型预训练中的词向量与概念设计

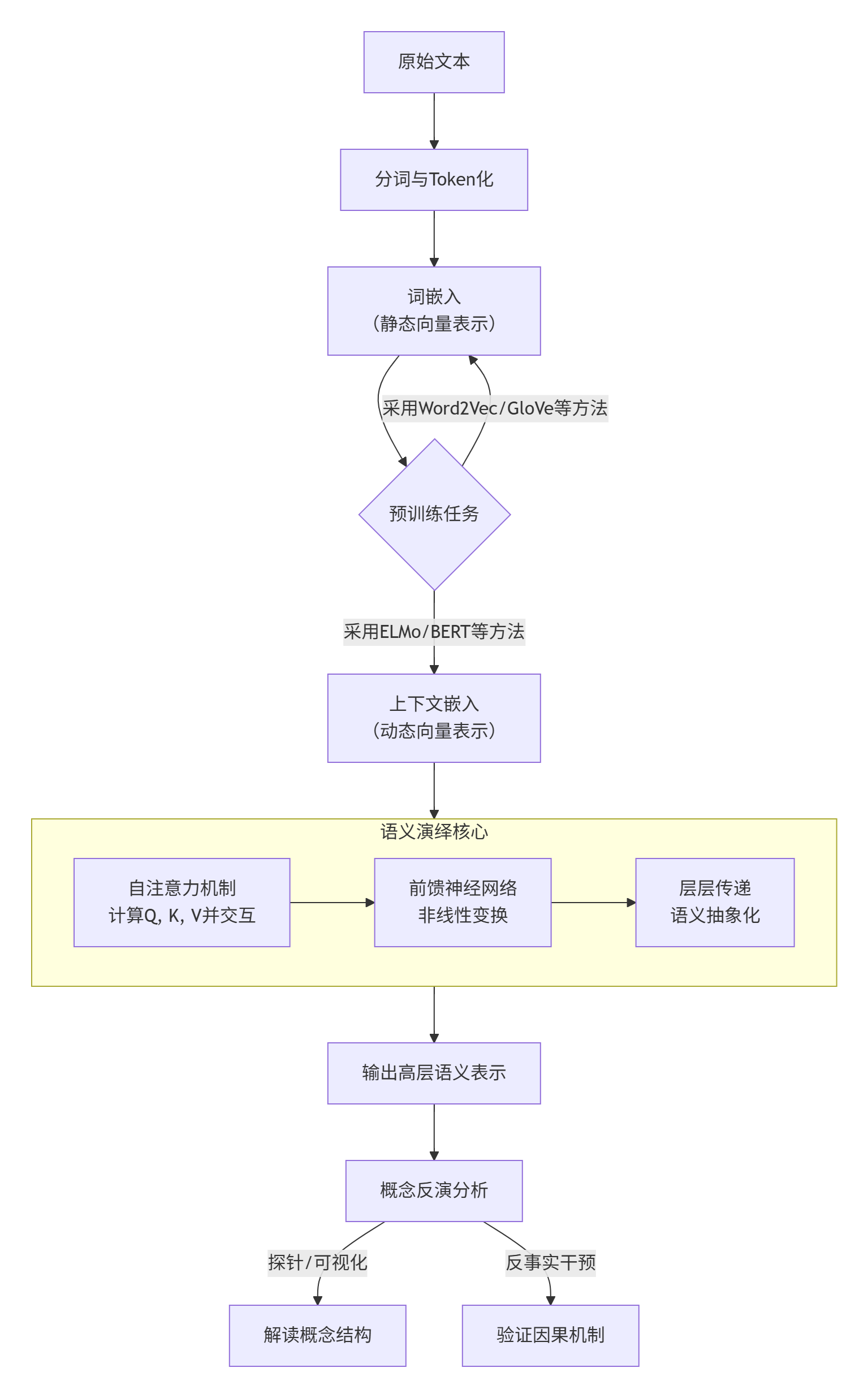

从构建基础表示(词向量),到通过预训练任务和复杂架构(如Transformer)进行语义演绎,最终通过学习到的内部表示进行概念反演以验证和解释模型的完整闭环.

自注意力机制中的QKV向量,通过其独特的设计和多层堆叠,展现出了强大的层次化语义演绎能力。简单来说,模型能够从识别基础的语法关系开始,逐步构建起对复杂语义和深层逻辑的理解。下图清晰地描绘了这个信息流动与抽象的完整过程:

底层:捕捉词汇与语法关系

在模型的底层(例如第1-3层),QKV向量主要致力于学习基础的词汇和语法结构。

-

QKV的角色:在这一阶段,QKV的线性变换矩阵刚开始学习。

Query向量可以理解为当前词在问“谁和我有直接的语法关系?”。Key向量则像是其他词提供的“我是主语”或“我是修饰词”这样的身份标签。Value向量则包含了词语本身的核心语义。 -

如何工作:当一个动词(如“追”)的

Query向量与一个名词(如“猫”)的Key向量计算出的注意力分数很高时,模型就捕捉到了“主谓”关系。同样,它也能学会识别动宾、修饰等关系。这个过程就像在厘清句子的主干和枝叶。 -

语义演绎:此层的输出是对句子基本结构的理解,例如将“猫/追/老鼠”解析为“主语/谓语/宾语”的框架。

中层:构建语义角色与中程依赖

在模型的中层(例如第4-8层),模型在已有语法结构的基础上,开始构建更复杂的语义角色和上下文关联。

-

QKV的角色:此时的

Query变得更抽象,像是在问“这个动作的发起者是谁?承受者是谁?”。模型不再满足于知道“猫”是主语,而是进一步理解“猫”是“追”这个动作的施事者(Agent),而“老鼠”是受事者(Patient)。 -

如何工作:通过自注意力,模型能够连接不再相邻的词语。例如,它能将“苹果”与其修饰语“昨天在超市买的”关联起来,形成一個完整的“苹果”概念。不同功能的注意力头(Head)开始协同工作,有的负责分析否定范围,有的负责处理指代关系(如“它”指代什么)。

-

语义演绎:模型的表示从表面语法结构进化到包含更多上下文信息的、更丰富的语义单元。例如,它将“追”理解为一个“追逐事件”,并明确了事件的参与者。

高层:推理话语结构与深层意图

在模型的高层(例如第9层及以上),QKV机制用于进行全局性的推理,理解句子的目的、情感和逻辑脉络。

-

QKV的角色:高层的

Query关注的是全局性问题,如“这段话的核心意图是什么?结论是什么?”。Key和Value则代表了序列中所有经过中层加工的、富含语义的信息块。 -

如何工作:模型能够捕捉长距离的依赖关系。例如,在段落开头提出的一个观点,可能会在段落末尾被再次强调或反驳,高层注意力能够建立这种远距离的逻辑连接。它能够综合所有信息,判断一段话是陈述事实、提出请求还是表达反驳。

-

语义演绎:最终,模型输出的表示不再是单个词语或事件的加总,而是一个高度抽象和综合的语义整体。它理解了文本的意图、观点和深层逻辑。对于智能音箱来说,它就能从“把卧室灯关了,顺便把客厅窗帘打开”这句指令中,准确解析出两个并列的、需要依次执行的用户意图。

-

核心机制:多头注意力与层叠的作用

这种层次化能力的实现,依赖于两个关键设计:

-

多头注意力:在每一层,都不是只有一个注意力机制在工作。而是有多个“注意力头”并行运作。每个头可以专注于不同类型的关系。例如,在底层,有的头专攻主谓一致,有的头专攻介词短语修饰;在高层,有的头专注逻辑关联词,有的头专注情感一致性。它们的输出被拼接起来,使得模型能同时从多个维度理解文本。

-

层叠:底层网络的输出作为高层网络的输入。这意味着高层网络是在底层网络已经抽象过的、更高级的表示基础上进行新一轮的QKV计算。这就实现了语义的逐层抽象和提炼,从具体到抽象,从局部到全局。

1.27 量化评估模型学习到的概念流形质量

对于理解模型内部表征的结构合理性与语义一致性至关重要。

下面这个表格可以帮助你快速概览主要的评估维度与方法:

| 评估维度 | 具体方法 | 核心目标 | 适用场景 |

|---|---|---|---|

| 拓扑完整性 | 持续同调(Persistent Homology)、Betti数分析 | 评估流形的全局拓扑结构(如连通性、环状结构)是否与真实数据分布一致 | 生成模型评估(如GANs)、表示学习,探测流形的空洞或不连续区域 |

| 几何与表示质量 | 流形特征相似度(MFS)、FID/IS指标 | 衡量生成流形与真实数据流形在几何特征上的相似性,评估表征的平滑度与语义连贯性 | 图像质量评估、生成模型性能比较,分析模型对语义变化的平滑插值能力 |

| 下游任务关联 | 探针任务(Probing Tasks)、概念反演(Concept Inversion) | 通过线性或简单非线性模型探查流形空间中是否编码了特定语义概念,验证概念的可分离性与可解释性 | 模型可解释性分析,验证特定概念(如类别、属性)在表征空间中的编码质量 |

拓扑结构分析

拓扑方法关注流形的整体形状和连接结构,有助于发现表征空间中不易察觉的宏观问题。

-

持续同调(Persistent Homology):这是来自拓扑数据分析的强大工具。它通过分析不同“尺度”下数据点之间连接的“出生”与“死亡”来刻画流形的拓扑特征。例如,Betti数(Betti numbers)可以量化流形中不同维度的“洞”或“环”的数量。如果模型学习到的流形在拓扑特征上与真实数据分布差异很大(例如,真实数据流形是连续的,而学到的流形存在不应有的断裂或空洞),则表明其学习质量不佳。该方法在评估生成模型(如GANs)时被用作一种指标(Geometry Score, GS),通过比较生成数据与真实数据流形的拓扑相似性来评估生成质量。

几何与表示质量

这一维度关注流形本身的几何特性和局部结构。

-

流形特征相似度(Manifold Feature Similarity, MFS):该方法的核心思想是,如果模型学习到的流形能够很好地反映人类感知特性,那么其流形特征应与参考(真实)流形特征高度相似。具体实现上,常利用流形学习算法(如正交局部保持投影,OLPP)来提取数据在低维流形上的特征,然后计算这些特征之间的相似度,作为质量评价的依据。这类似于全参考图像质量评价中的思想,但应用于特征空间而非像素空间。

-

经典生成指标:虽然FID(Fréchet Inception Distance) 和 IS(Inception Score) 最初用于评估生成图像的质量,但它们本质上也是比较生成数据分布与真实数据分布在深度特征空间中的距离或统计特性,间接反映了生成流形与真实流形的接近程度。

基于下游任务的探查

最直接的方法是通过实际任务来检验流形表示的有效性。

-

探针任务(Probing Tasks):训练一个简单的分类器(如线性模型)在冻结的模型表征上预测某个特定概念(如物体类别、情感极性、语法属性)。如果这个简单分类器能达到很高的准确率,说明该概念在流形空间中线性可分,表明模型很好地编码了该概念。

-

概念反演与干预:通过激活流形空间中的特定方向,观察生成内容或模型决策的变化。如果能通过有方向地移动表征点来可控地改变输出中的特定概念(如增加“微笑”属性),则证明该概念在流形中具有明确的方向意义,流形质量较高。

实践中的考量要点

在实际评估时,有几个关键点需要留意:

-

数据质量是基础:模型学习到的流形质量高度依赖于训练数据。训练数据需要密集地覆盖整个输入数据流形,尤其是在决策边界附近,模型才能更好地泛化。

-

指标的组合使用:没有单一的“银弹”指标。需要根据模型的具体任务和目标,组合多种评估方法,从不同侧面综合判断流形质量。

-

结果的可解释性:评估的最终目的不仅是给一个分数,更是为了理解模型的内部工作机制,从而指导模型的改进。拓扑或几何分析中发现的问题(如流形断裂)应能反馈到模型结构的调整或数据处理的优化上。

1.28 知识增强预训练阶段将外部知识融入模型的方法

下表概括了几种主流的知识注入方式及其核心思路:

| 注入方式 | 核心思路 | 代表性模型/方法举例 |

|---|---|---|

| 知识图谱表示融合 | 将知识图谱中的实体、关系转化为向量,通过特定模块(如知识聚合器)与文本表示进行融合。 | KLMo , ERNIE |

| 知识引导的预训练任务 | 设计新的预训练任务,如预测实体间关系或尾部实体,迫使模型学习结构化知识。 | 尾部实体预测 , ERICA |

| 知识文本化转换 | 将知识图谱的三元组转化为自然语言句子,作为附加文本输入,与原始文本一同训练。 | TEKGEN |

| 参数高效注入 | 不直接修改模型主干,而是在微调阶段通过特定方式(如标记化注入)引入知识,强调知识质量。 | 概念知识注入 |

知识图谱表示融合

这种方法的核心是将结构化知识(如知识图谱中的实体和关系)映射为低维向量(即嵌入),然后在模型的不同层面与文本表示进行结合。

-

实现方式:通常在模型的中间层引入知识聚合器(Knowledge Aggregator)。该组件会识别文本中提到的实体,然后通过注意力机制等计算,将知识图谱中对应实体和关系的向量表示整合到词语的上下文化表示中。例如,KLMo模型就采用了这种方式,同时利用了实体和关系的细粒度信息 。

-

优势与挑战:这种方式能显式地将精准的结构化知识注入模型,但通常需要额外的对齐操作(将文本中的词链接到知识图谱中的实体),并可能增加模型复杂度和计算开销。

知识引导的预训练任务

通过在传统的掩码语言模型(MLM)等任务之外,新增与知识直接相关的预训练任务,可以引导模型主动学习并理解知识。

-

常见任务:

-

关系预测:给定两个实体,让模型预测它们之间的关系 。

-

尾部实体预测:给定一个头实体和关系,让模型预测可能的尾实体。这正是前面专利中提到的方法 。

-

对比学习任务:如ERICA模型,通过让模型区分正负例实体对或关系对,来深化对实体和关系的理解 。

-

-

优势:这种机制将知识学习内化为模型目标的一部分,能更深刻地塑造模型的知识表征,并有助于提升推理能力。

知识文本化转换

这种方法思路直接,将结构化的知识图谱三元组转换成流畅的自然语言句子,然后把这些句子作为额外的上下文信息提供给模型。

-

典型流程:使用模板或训练文本生成模型(如TEKGEN),将类似

<北京,首都,中国>的三元组转化为“北京是中国的首都”这样的句子。这些生成的文本可以用于扩充模型的预训练语料,或者在输入时与原始文本一并送入模型 。 -

优势:最大优点是不改变原有模型结构,易于实现。它让模型在自然语言的形式下吸收知识,避免了表示空间不一致的问题。

重要讨论:关注知识质量与注入方式

近期的研究对知识注入的有效性提出了更深入的思考。一项引人注目的研究发现,在微调阶段,向模型注入随机选择的知识元组,其效果有时竟与注入精心对齐的相关知识不相上下,甚至更好 。这表明模型可能并未如预期那样有效利用注入的知识,而是可能将其视为一种“噪声” 。

在追求注入方式创新的同时,必须更加关注知识本身的质量和相关性。与其盲目注入大量知识,不如对知识源进行精心的筛选、净化(剪枝),注入更干净、更抽象、更核心的概念性知识,往往能取得更佳效果 。这意味着,“更多”并不总是意味着“更好”,精准的知识注入远比粗放的数量堆砌重要 。

1.29 评估知识注入方式对下游任务性能的提升

评估知识注入方式对下游任务性能的提升,需要一个多维度、系统化的评估框架。它远不止是看一两个指标的提升,更需要探究模型是否真正理解并有效运用了注入的知识。

系统化的评估框架

一个全面的评估体系通常包含以下三个层次,由浅入深:

-

知识探测任务:这是最直接的评估,用于检验模型是否“记住”了注入的知识。常用方法包括完形填空式测试(如LAMA数据集),直接探测模型参数中存储的事实知识。如果模型能正确回答“北京是中国的[MASK]”,说明“首都”这一知识可能被成功注入。

-

知识导向型任务:这类任务评估模型能否“利用”知识完成特定信息提取,例如关系抽取和实体识别。在此类任务上的性能提升,能更直接地体现知识注入的价值。

-

知识密集型任务:这是终极考验,评估模型能否综合运用知识进行复杂推理,例如开放域问答和事实验证。在此类任务(如Natural Questions、HotpotQA数据集)上的表现,是衡量知识注入效果的“试金石”。

为了更直观地展示不同下游任务关注的评估要点,请参考下表:

| 评估维度 | 核心关注点 | 关系抽取 (RE) | 问答系统 (QA) | 自然语言理解 (NLU) |

|---|---|---|---|---|

| 知识记忆与理解 | 模型是否记住并能简单应用注入的知识 | 探测实体间关系 | 回答事实型问题 | 词汇/语法知识判断 |

| 复杂推理能力 | 模型能否结合知识进行逻辑推理 | 推断隐含关系 | 综合多文档信息进行推理 | 需要常识的推理任务 |

| 泛化与鲁棒性 | 对未见过数据或含噪声输入的适应性 | 对陌生实体组合的关系判断 | 处理问题的新表述或对抗性干扰 | 领域迁移后的表现 |

| 效率与成本 | 知识注入与模型推理的资源消耗 | 参数效率、训练/推理速度 | 参数效率、训练/推理速度 | 参数效率、训练/推理速度 |

核心的评估方法与指标

在选择好评估任务后,我们需要采用正确的评估方法来量化性能提升。

-

微调与评估:最主流的方法是在下游任务数据集上对模型进行全参数微调,然后使用准确率、F1值等指标进行评估。为了结果可靠,需要在多个随机种子下重复实验取平均值。

-

提示与直接探测:特别适合少样本或零样本场景。通过设计提示词(Prompt),直接让模型生成答案或填充掩码,无需或仅需少量训练,可以评估模型内在的知识掌握程度。

-

控制变量与消融实验:这是判断性能提升是否真的源于知识本身的关键。通过设置对照组进行比较,例如注入随机知识或进行反事实知识扰动,如果注入正确知识的模型性能显著优于对照组,才能更有信心地归因于有效知识注入。

-

遗忘与稳定性分析:评估知识注入的“副作用”。通过在控制数据集(如通用语言理解基准GLUE)上测试,确保模型在获得新知识的同时,没有遗忘其基本的语言能力,避免灾难性遗忘。

关键洞察

近年来的研究为评估工作带来了一些重要反思:

-

知识质量比数量更重要:有研究发现,向模型注入随机选择的知识元组,其效果有时竟与注入精心对齐的相关知识不相上下。这警示我们,模型可能并未有效利用注入的知识,而是将其视为一种“噪声”。因此,评估时不能只看性能提升,更要关注知识本身的质量、相关性和纯度。对知识源进行精心的筛选、净化(剪枝),注入更干净、更抽象的概念性知识,往往比盲目注入大量知识更有效。

-

参数高效注入方法的优势:像 K-ADAPTER 这样的轻量级适配器方法,通过冻结主模型参数、仅训练小型适配器来注入知识,在实体识别、关系抽取等任务上表现出色。评估这类方法时,除了精度,还应重点关注参数效率、训练速度以及多领域知识无缝集成的能力。

实践中的挑战与注意事项

在实际操作中,你可能会遇到以下挑战:

-

因果性归因困难:性能提升可能源于知识注入,也可能源于注入过程中引入的数据分布变化等因素。专利CN117371536A提出的反事实知识扰动框架 通过控制变量进行因果分析,是解决这一问题的前沿思路。

-

数据污染风险:确保评估所用的数据(特别是时效性强的数据)没有在模型预训练时出现过至关重要。使用模型训练截止日期之后的新数据(如近期新闻)进行评估是有效做法。

-

领域特定指标的运用:在医疗、金融等领域,需结合专业指标。例如,医疗QA系统需评估答案的准确性、充分性,并可能由领域专家进行人工评估。

1.30 可视化工具来展示知识注入如何改变模型的决策依据

通过可视化工具来展示知识注入如何改变模型的决策依据,能让抽象的AI决策过程变得清晰可见。下面这个表格概括了实现这一目标的核心工具与方法。

| 可视化目标 | 核心方法与工具 | 关键可视化内容 | 适用场景/工具举例 |

|---|---|---|---|

| 揭示决策路径 | 知识图谱与图神经网络(GNN)可视化 | 知识注入后,模型推理所依据的实体、关系及路径变化。可高亮新增或权重提高的路径。13 | 工业过程监控(展示“温度异常→催化剂失效→产量下降”的因果链1)、可解释性问答系统(展示答案背后的知识子图3) |

| 量化注意力变化 | 热力图(Heatmap) | 比较知识注入前后,模型对输入文本/图像不同区域的关注度(注意力权重)变化。3 | 自然语言处理(文本关键词高亮)、计算机视觉(图像区域高亮)、各类具备注意力机制的模型 |

| 对比全局表现 | 投影、降维与交互式仪表盘 | 使用t-SNE等方法将高维特征投影到2D/3D空间,观察知识注入后同类数据点是否更聚集、异类是否更分离。5 | 评估模型整体特征学习能力,如CLIP模型在知识注入后视觉-文本特征对齐效果的提升5 |

| 评估性能提升 | 指标对比图表 | 通过柱状图、折线图等,对比知识注入前后在准确率、F1值等关键指标上的差异。5 | 所有需要进行定量评估的任务,例如展示ENGINE方法在多个数据集上性能提升3%-10%5 |

要实现有效的可视化,你可以遵循以下思路:

1.定义对比基线:这是所有工作的起点。你需要明确知识注入前的原始模型作为基线(Baseline),然后与注入知识后的模型进行对比。

2.选择切入点,组合可视化工具:根据你的目标,从表格中提到的方法中选择合适的工具进行组合。例如,你可以:

- 使用仪表盘模型(如Tableau、Power BI或国内的Smartbi等工具)构建一个综合看板。在一个界面中同时展示性能指标对比图、注意力热力图对比和特征投影图,提供全局视角。

- 聚焦决策路径,利用知识图谱可视化,动态演示针对某个具体问题,模型在注入知识后是如何找到新答案的。这对于演示和解释非常直观。

- 确保交互性:优秀的可视化通常是交互式的。允许用户点击图表中的不同部分(如数据点、知识图谱中的实体)来查看更详细的信息,例如某个预测的置信度、具体的特征向量或相关的知识片段。这能极大提升探索深度。

- 讲述故事线:尝试用可视化为模型的“进化”讲述一个故事。可以按照“任务挑战 -> 基线模型决策 -> 注入的知识 -> 增强模型决策 -> 性能提升”的逻辑来组织你的可视化图表,使观众能清晰地理解知识注入的价值。

总而言之,通过可视化工具展示知识注入的效果,本质上是将模型内部的微观变化(如注意力调整)和宏观影响(如性能提升、特征分布优化)以直观的形式呈现出来。一个有效的可视化方案不仅能证明技术本身的有效性,更是构建用户与决策者信任。

1.31 概念反演中设计有效的探针任务

在概念反演中,设计有效的探针任务是理解模型内部表征的关键。下面这个表格汇总了探针任务设计的核心维度和最佳实践要点,希望能帮助你快速把握核心思路。

|

设计维度 |

核心目标 |

最佳实践要点 |

|---|---|---|

|

任务定义与控制 |

确保探针测量的是模型表征,而非自身拟合。 |

选择性(Selectivity)分析:引入控制任务,比较在真实标签和随机打乱标签上的表现差距。高选择性表明探针真正依赖表征质量。 |

|

探针模型选择 |

平衡探针的表达能力与解释性。 |

简单性原则:优先选择线性分类器或浅层MLP。复杂探针可能“学会”任务本身,导致高准确率但无法证明表征已编码该概念。 |

|

数据与特征 |

构建能够有效评估概念的数据集。 |

- 数据集设计:通过正演模拟或已有知识生成大量带标签的数据集。 |

|

训练与评估 |

可靠地训练探针并合理解释结果。 |

- 评估指标:除准确率外,关注选择性、鲁棒性、泛化到未学习过的数据或密度值的能力。 |

|

结果解释 |

得出关于概念学习的可靠结论。 |

因果性验证:结合反事实干预等方法,为“模型形成了某概念”提供更强证据,而非仅依赖探针准确率。 |

核心原则与进阶思路

探针任务设计的核心在于一个关键区分:探针的高性能是源于模型内部确实编码了目标概念,还是探针模型自身强大的拟合能力“学会”了任务。上述实践都围绕这一核心展开。

在掌握了基本实践后,可以思考一些更深入的思路:

-

领域特定设计:在重力异常反演中,设计探针任务时会考虑通过正演模拟生成大量带标签的数据集,并关注其抗噪声能力和泛化能力。在瞬变电磁反演中,则会考虑如何将物理建模与数据驱动相结合,并在设计训练集时根据先验信息的强弱进行调整。

-

超越监督探针:除了需要训练标签的监督探针,还可以探索无监督探针(如通过聚类分析表征空间的结构)和自监督探针,它们对训练数据的依赖更少,可能揭示更本质的表示特性。

1.32 大模型预训练阶段系统性地整合单纯复形、概念流形、概念层次网络等几何与代数结构

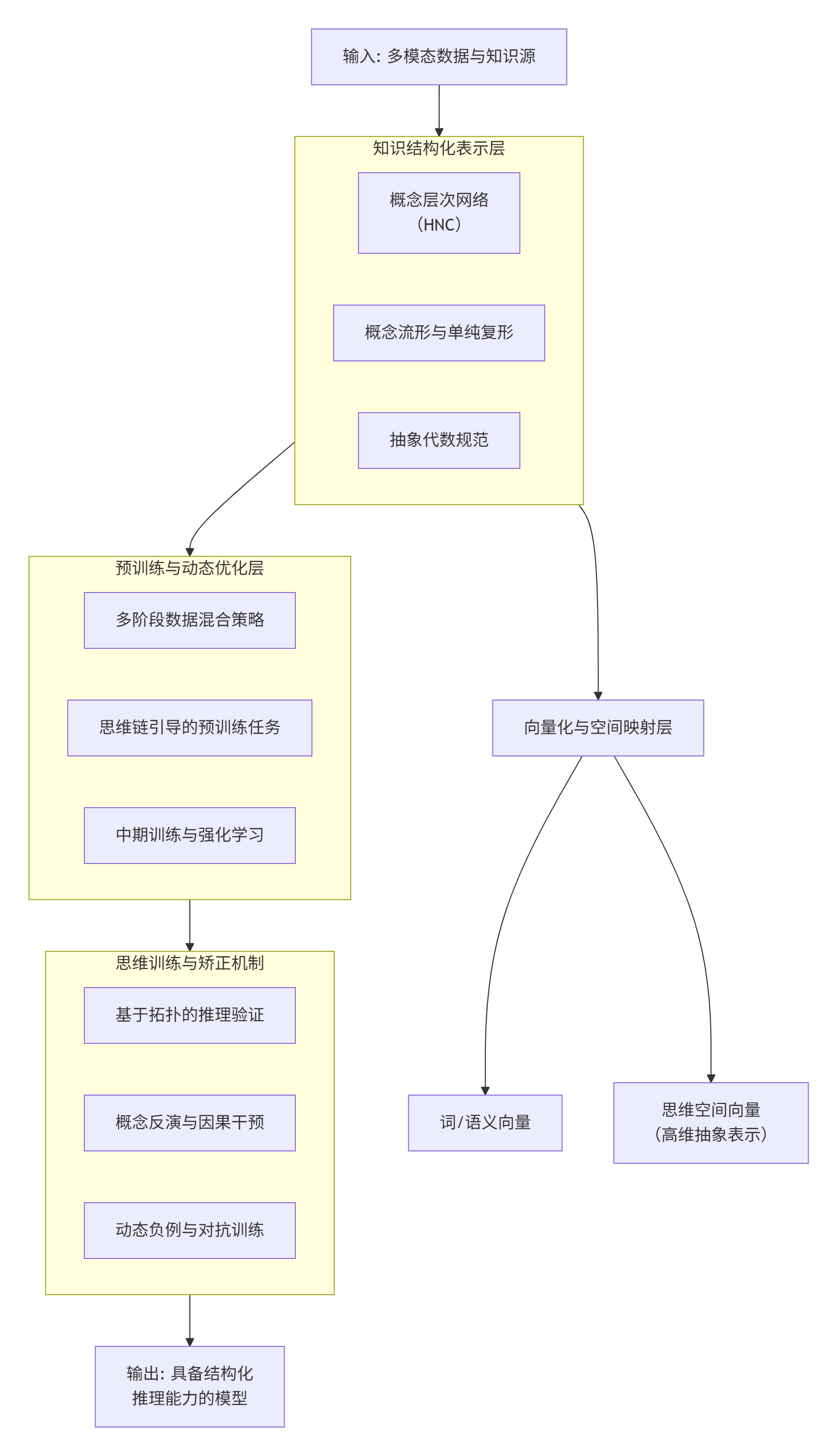

在大模型预训练阶段,系统性地整合单纯复形、概念流形、概念层次网络等几何与代数结构,并与词向量、语义向量、思维空间向量等表示方法相结合,旨在为模型构建一个结构化的内部概念宇宙。这套方法的核心目标是提升模型的推理能力、泛化性和可解释性。以下框架将展示如何将这些理论工具融入预训练的全流程:

知识的结构化表示:构建模型的概念骨架

首先,需要为模型建立一个富含逻辑关系的概念基础,而非零散的知识点。

-

概念层次网络(HNC)作为符号蓝图:利用HNC的符号化体系(如五元组、层次符号)为自然语言概念提供离散化、层次化的标签。例如,将“民主”概念编码为

[政治制度, 参与方式, 选举]等基元符号。这为模型提供了可解释的概念分类与关系框架,是后续所有操作的结构化基础。 -

概念流形与单纯复形实现几何组织:在模型的隐藏层激活值所构成的高维空间中,概念并非孤点。概念流形假设语义相近的概念在空间中是连续分布的(如“苹果”和“香蕉”在“水果”流形上相邻)。单纯复形可进一步描述概念间的高维关联,例如,“苹果-红-甜”可构成一个2-单形(三角形),表示这三个属性在语义上的强关联。这相当于为HNC的符号逻辑关系提供了连续的几何实现,使概念间的相似度、对立关系可计算。

-

抽象代数规范关系约束:利用群、环、域等代数结构,为概念间关系定义刚性约束。例如,在空间推理中,通过定义“旋转”、“平移”等操作符及其组合规则(如旋转群SO(3)),可以确保模型对空间关系的理解符合欧氏几何的刚性变换规则,避免生成“门比房子大”这类违背物理规律的描述。

从符号到向量:实现可计算的语义

有了结构化的概念框架,下一步是将其转化为模型可处理的形式。

-

词向量与语义向量的精细化注入:在预训练初期,不仅使用传统的词向量(如Word2Vec),更关键的是注入HNC符号向量和概念流形上的方向向量。例如,可以将HNC符号通过一个嵌入层映射为向量,并与单词的初始向量进行拼接或相加。这相当于在模型学习词汇的初始阶段,就为其打上了结构化知识的“基因”。

-

构建思维空间向量:在模型内部(如Transformer的高层),通过自注意力机制动态生成的上下文表示,可视为“思维空间向量”。训练目标之一是使这些向量的分布与底层概念流形的几何结构(如连通性、曲率)对齐。例如,通过设计损失函数,让“因果关系”在思维空间中以特定的向量方向呈现,从而支持沿该方向的逻辑推理。

预训练流程与动态优化:塑造模型的思维习惯

在表示层之上,通过精心设计的训练策略来塑造模型的“思维习惯”。

-

多阶段数据混合策略:借鉴小米MiMo模型的经验,预训练数据应分阶段混合:

-

第一阶段:广泛注入百科、新闻等通用语料,建立基础世界知识,并确保HNC概念符号的广泛覆盖。

-

第二阶段:显著提升高推理密度数据(如数学推导、代码、科学论文)的比例(可达70%),迫使模型频繁进行多步逻辑操作,强化概念流形上的“推理路径”。

-

第三阶段:引入约10%由高级模型生成的思维链(CoT)合成数据。这些数据显式展示了如何将复杂问题分解为符合HNC层次和概念流形几何关系的子步骤,直接教授模型“如何思考”。

-

-

思维链引导的预训练任务:超越简单的掩码语言模型,设计需要多跳推理的预训练任务。例如,给定“A是B的首都,B位于C洲”两个事实,要求模型预测“A在C洲吗?”。在此过程中,通过提示或模型自身生成中间步骤,并利用概念流形的几何特性(如计算向量距离)来验证每一步推理的合理性。

-

中期训练(Mid-training)进行思维矫正:在预训练后、微调前,增加一个中期训练阶段。此阶段使用精心筛选的高质量数据(如OctoThinker方法中的高质量数学内容),专门针对模型暴露出的思维弱点(如逻辑跳跃、依赖事实捷径)进行矫正训练。这相当于在模型“青春期”进行思维习惯的再塑造。

思维训练与矫正机制:实现精准的干预与控制

最后,需要一套机制来实时监控和引导模型的思考过程。

-

基于拓扑的推理验证:利用持续同调等拓扑数据分析工具,实时监控模型生成的思维链(CoT)在概念流形上形成的“路径”。如果该路径出现不应有的“空洞”(表示逻辑断裂)或突然跳转到不相关流形,则可判定推理可能出错,并触发重新计算或修正。

-

概念反演与因果干预:通过探针任务识别出模型内部与特定概念(如“偏见”)相关的方向向量。在生成过程中,可以主动干预(消融或强化)该方向的激活强度,从而实现对模型思维倾向的矫正。这类似于一种“概念级”的精细调控。

-

动态负例与对抗训练:借鉴RECAP方法,在训练中主动注入包含逻辑谬误或事实错误的“陷阱”样本。例如,提供前提错误但结论正确的三段论。模型需要识别并拒绝这些错误,从而学会抵抗误导,强化自身的逻辑一致性。

总结与展望

将单纯复形、概念流形等数学工具与HNC、向量表示深度融合,实质是为大模型构建一个兼具符号逻辑的精确性与几何表示的灵活性的内在认知系统。这条路径挑战巨大,如计算复杂度高、数学工具与模型架构的深度融合等。然而,它指向一个更可信、更可靠的新一代人工智能未来,使模型不仅“表现”得聪明,更从结构上“理解”并“善思”。

1.33 预训练中让模型的“思维向量”与一个结构良好的“概念地图”

在预训练中让模型的“思维向量”与一个结构良好的“概念地图”对齐,是提升模型推理和泛化能力的关键。下面这个表格梳理了核心的损失函数设计策略:

| 对齐目标 | 核心思想 | 关键损失函数组件 | 预期效果 |

|---|---|---|---|

| 局部平滑性 | 语义相近的概念,其向量在思维空间中也应彼此接近。 | 基于图结构的拉普拉斯特征映射损失 | 保持概念间的局部相似关系,使流形上相邻点对应的思维向量靠近。 |

| 全局结构性 | 概念间的抽象关系(如层级、因果)应在思维空间中有相应的几何表现。 | 基于测地距离的全局结构损失 | 保持概念间的远距离抽象关系(如对立、层级)。 |

| 拓扑一致性 | 思维空间中的向量分布应能反映概念体系的整体连接性(如“环”或“洞”)。 | 拓扑数据分析(TDA)驱动的损失,如持续同调正则项 | 确保概念流形的整体拓扑结构(如连通性)在思维空间中得到保持。 |

| 对比分离性 | 明确区分不相关的概念,增强流形边界的清晰度。 | 对比学习损失(InfoNCE等) | 将不相关概念的思维向量推远,强化不同概念簇的分离。 |

从理论到实践:设计策略与技巧

要将上述目标转化为可行的训练方案,可以考虑以下策略:

-

多目标损失的平衡

在实际设计中,通常会将上述几种损失组合成一个多目标函数:

总损失 = 任务损失(如交叉熵) + α * 局部损失 + β * 全局损失 + γ * 拓扑损失 + δ * 对比损失。其中,α, β, γ, δ 是超参数,需要仔细调整以平衡不同目标的重要性 。 -

流形结构的动态构建

“概念流形”本身并非一成不变。在预训练初期,模型的概念理解是粗糙的,此时可以基于简单的共现统计或外部知识库(如WordNet)来构建初始的图结构(邻接矩阵)。随着训练进行,可以利用模型自身中间层的激活值来动态更新和细化这个图结构,使其更准确地反映模型学到的语义关系 。

-

采用流形友好的优化器

由于目标是在一个复杂的几何结构上进行优化,可以考虑使用自然梯度下降等优化方法。它通过Fisher信息矩阵考虑了参数空间的曲率,能更自然地在流形上进行迭代,可能比标准的Adam优化器更有利于保持几何结构 。

-

渐进式对齐策略

对齐可以分阶段进行:在训练早期,更侧重于局部平滑性和对比分离,先让模型形成基本的概念簇。在训练中后期,当模型表示相对稳定后,再引入对全局结构和拓扑一致性的约束,进行精细的“雕琢”。

1.34 预训练中动态构建和更新概念流形的邻接矩阵

在预训练中动态构建和更新概念流形的邻接矩阵,是一个能让模型“思维”更具结构性和适应性的核心环节。下面这个表格梳理了关键的策略与核心技术。

| 核心维度 | 关键策略 | 核心技术/方法 |

|---|---|---|

| 构建初始图结构 | 多源信息融合的冷启动 | 利用外部知识库(如WordNet)、词汇共现统计、或小型专用模型提取的静态特征作为初始邻接关系 |

| 动态更新触发信号 | 基于训练进程与语义变化 |

1. 周期性更新:按训练周期(如每隔N个epoch)更新 2. 事件驱动更新:当模型在验证集上的语义困惑度或聚类纯度发生显著变化时触发 |

| 邻接关系量化方法 | 多维度相似度度量 |

1. 表示相似度:计算思维向量(如[CLS]标签或池化后向量)间的余弦相似度或内积 2. 上下文关联度:分析注意力权重矩阵,计算概念在不同上下文中被共同关注的频率 3. 梯度交互强度:观察在反向传播中,不同概念对应神经元的梯度更新方向相关性 |

| 高级动态构建技术 | 参数化与对比学习 |

1. 自适应邻接矩阵:将邻接矩阵参数化,作为模型可学习参数,通过梯度下降端到端优化 2. 对比学习增强:通过构建正负样本对,利用对比损失(InfoNCE)显式拉近语义相似实例、推远不相似实例,从而优化邻接关系 |

核心维度关键策略核心技术/方法构建初始图结构多源信息融合的冷启动利用外部知识库(如WordNet)、词汇共现统计、或小型专用模型提取的静态特征作为初始邻接关系。动态更新触发信号基于训练进程与语义变化1. 周期性更新:按训练周期(如每隔N个epoch)更新。

2. 事件驱动更新:当模型在验证集上的语义困惑度或聚类纯度发生显著变化时触发。邻接关系量化方法多维度相似度度量1. 表示相似度:计算思维向量(如[CLS]标签或池化后向量)间的余弦相似度或内积。

2. 上下文关联度:分析注意力权重矩阵,计算概念在不同上下文中被共同关注的频率。

3. 梯度交互强度:观察在反向传播中,不同概念对应神经元的梯度更新方向相关性。高级动态构建技术参数化与对比学习1. 自适应邻接矩阵:将邻接矩阵参数化,作为模型可学习参数,通过梯度下降端到端优化。

2. 对比学习增强:通过构建正负样本对,利用对比损失(InfoNCE)显式拉近语义相似实例、推远不相似实例,从而优化邻接关系。

实施流程与技巧

1.渐进式构建与平滑更新

在训练初期,模型表示尚不稳定,邻接矩阵的更新频率不宜过高。可以采用指数移动平均(EMA) 对邻接矩阵进行平滑更新:A_new = α * A_old + (1-α) * A_current,其中α为平滑系数(如0.8)。这可以避免图结构剧烈震荡,有利于训练稳定。

2.稀疏化与剪枝

随着训练进行,计算出的邻接矩阵可能非常稠密。为了提升计算效率并突出主要关系,需要定期对邻接矩阵进行稀疏化处理。例如,只保留每个节点的Top-K最近邻连接(K-NN图),或设置一个相似度阈值,过滤掉弱连接。

3.与预训练目标的协同

动态构建图结构不应干扰主模型的语言建模任务。建议将其设计为一个正则化项或辅助任务。例如,总损失函数可以设计为:L_total = L_lm + λ * L_graph,其中L_lm是主要的语言模型损失(如交叉熵),L_graph是基于当前图结构的损失(如拉普拉斯特征映射损失),λ是超参数用于平衡两者。

可以采用分阶段的策略:

阶段一(预热期):固定初始图结构,让模型先学习基本的语义表示。

阶段二(协同更新期):开始按计划动态更新邻接矩阵,模型表示和图结构相互促进、共同演化。

阶段三(微调期):固定图结构,对模型进行最终微调,以确保稳定性。

1.35 思考差异——模型因果理解和逻辑推理能力

思考“如果某些条件与事实不同,会发生什么”的能力,这是提升模型因果理解和逻辑推理能力的关键。下面这个表格概括了其核心路径与代表性方法。

| 技术路径 | 核心目标 | 代表性方法/框架 |

|---|---|---|

| 理论框架与建模 | 为语言模型中的反事实推理建立坚实的数学基础,实现精确计算。 | 将语言模型表述为结构方程模型(SEM),利用Gumbel-max技巧分离随机性与确定性1。 |

| 训练与优化 | 通过特定的训练机制,让模型学会进行逻辑一致的因果推理。 | 反事实反馈(CFB),包括监督式、偏好式和因果一致性反馈5。 |

| 多模态与场景应用 | 将反事实推理能力应用到视觉、物理世界等复杂场景中。 | DeFacto框架(多模态证据 grounding)3;CWMDT框架(基于数字孪生的反事实世界模型)7。 |

| 评估与验证 | 超越答案对错,评估模型推理过程的逻辑一致性与可靠性。 | 因果一致性指标(如N-IR, S-IR)5;基于反事实逻辑修改的题目生成与自评分4。 |

从理论到实践的关键路径

1. 奠定数学基础:从关联到因果

要让大模型真正理解因果关系而不仅仅是相关关系,需要坚实的理论框架。ICLR 2025的一项研究将语言模型重新表述为结构方程模型(SEM),利用Gumbel-max技巧将文本生成过程分解为确定性的逻辑计算和随机性的采样噪声。这使得研究者能够精确推断出生成某段文本背后的“隐藏噪声”,然后在施加干预(如修改一个知识事实)后,使用相同的噪声来生成反事实文本,从而清晰对比干预带来的真实影响。

2. 优化训练过程:注入反事实反馈

微软和哈佛大学的研究提出了反事实反馈(CFB) 训练法,核心是教模型保持逻辑一致。例如,不仅让模型知道“12能被6整除”,还要理解“如果12没有质因数3,就不能被6整除”。具体方法包括:

监督式反馈:直接提供反事实问题的标准答案和推理链。

因果一致性反馈:将事实问题与反事实问题捆绑训练,奖励那些能给出逻辑一致答案的模型行为。这种方法能显著提升模型在医疗诊断、工程分析等需要严谨推理的任务中的表现。

3. 拓展应用边界:从文本到多模态世界

反事实理正被成功应用于更复杂的多模态场景:

确保推理有据可查:清华大学提出的DeFacto框架要求模型在回答关于图像的问题时,必须先给出其依据的视觉证据(如边界框),然后再生成答案。框架会使用反事实样本进行训练,例如将关键证据区域抹去,迫使模型在信息缺失时学会回答“不知道”,从而有效减少“幻觉”生成。

预测物理世界的可能性:有研究提出了基于数字孪生的反事实世界模型(CWMDT)。该框架先将视频场景解构为结构化的文本描述(数字孪生),然后利用大语言模型在这个显式表示上进行反事实推理(如“移除此物体会发生什么?”),最后再根据推理结果生成反事实视频,从而实现对物理动态的可控模拟。

4. 评估推理质量:超越表面正确性

评估反事实推理能力的关键不在于单一问题的对错,而在于其逻辑的连贯性。研究人员提出了诸如必要性不一致率(N-IR) 和充分性不一致率(S-IR) 等指标,专门用于衡量模型在面对事实与反事实情境时,是否能够保持一致的因果逻辑。此外,也可以通过让模型基于反事实逻辑自动生成题目并进行自我评估,来检验其推理过程的可靠性。

总结与展望

总的来说,当前大模型领域的反事实推理研究正从浅层的记忆关联向深度的因果理解迈进。通过建立更形式化的理论模型、设计有针对性的训练算法,并将这种能力应用到从文本到多模态的广阔场景中,我们正在引导大模型从“博览群书”的学者,转变为“融会贯通”的思想者。

1.36 大模型的反事实推理的挑战

Gumbel-max技巧为实现大模型的反事实推理提供了数学基础,但在实际应用中,尤其是在处理大规模语言模型时,确实面临着计算复杂度和稳定性两方面的核心挑战。下表概括了这些挑战的主要表现和根源。

| 挑战类别 | 具体表现 | 根本原因 |

|---|---|---|

| 计算复杂度 | 后验推断计算开销大,难以直接处理长序列生成。 | 需要为已观测序列的每个token推断生成其背后的Gumbel噪声,计算量与序列长度相关。在自回归生成中,序列长度不固定,导致计算图庞大。 |

| 稳定性 | 反事实输出对温度参数τ敏感;Gumbel分布的极值特性可能引发数值问题;干预可能产生难以预测的连锁副作用。 | Gumbel-Softmax近似对τ值依赖性强;Gumbel噪声采样涉及对数运算,在τ趋近0时可能数值不稳定;语言模型内部存在复杂的关联,局部干预可能通过自回归生成过程被放大。 |

挑战的深层解析与应对思路

-

计算复杂度的根源与探索方向

计算负担主要来自“后见之明Gumbel采样”(Hindsight Gumbel Sampling)。要生成反事实,必须先推断出产生原始事实序列时所用的特定Gumbel噪声。这个过程需要对序列中每个位置进行复杂的数学运算,以确保该位置的噪声与模型当时计算出的logit值相结合后,恰好使得真实生成的token“胜出”。对于长文本,这会带来显著的计算和存储开销。

-

应对思路:研究人员正在探索近似方法,例如开发更高效的采样算法,或者寻找对噪声后验分布的低复杂度近似。此外,将计算限制在关键token上(而非全部token)也是一种可行的优化策略。

-

-

稳定性挑战的多面性

-

温度参数(τ)的权衡:当使用Gumbel-Softmax作为可微近似时,温度参数τ的控制至关重要。τ值过小,近似虽然更接近离散采样,但梯度方差会变大,使得训练不稳定;τ值过大,梯度估计虽然平滑,但采样结果会严重偏离目标离散分布,导致反事实生成不准确。这是一个典型的偏差-方差权衡问题。

-

数值不稳定性:生成Gumbel噪声的公式中包含双重对数运算(

g = -log(-log(u))),当均匀分布样本u非常接近0或1时,容易导致数值溢出或下溢。 -

干预的副作用:即使成功实现了基于Gumbel-max的反事实推理,干预本身也可能产生意想不到的副作用。研究表明,即使是针对模型某一特定知识(如将“卢浮宫在巴黎”改为“在罗马”)的精确编辑,也可能导致生成的反事实文本在无关部分发生变化,这反映了模型内部知识关联的复杂性。

-

总结

总而言之,Gumbel-max技巧为大模型的反事实推理奠定了重要的理论基础,但其在实际应用中的计算复杂度和稳定性挑战不容忽视。这些挑战本质上源于语言模型生成过程的固有特性(自回归、离散、高维)以及模型内部复杂的参数关联。当前的研究一方面致力于优化算法以提升效率,另一方面也在积极探索如何更好地理解和控制干预行为,以期最终实现更可靠、更可控的模型反事实推理能力。

1.37 大模型反事实推理的替代方法

除了Gumbel-max技巧,实现大模型反事实推理的替代方法主要可以分为以下几类,它们各有不同的技术原理和适用场景。

| 方法类别 | 核心思想 | 关键技术/代表方法 | 主要适用场景 |

|---|---|---|---|

| 基于结构化表示的因果干预 | 将高维数据(如图像、视频)解耦为结构化的场景表示(如对象、属性、关系),在此表示空间进行明确干预。 | 数字孪生表示 (Digital Twin Representations)、CWMDT框架、结构因果模型 (SCMs) | 多模态反事实推理(如视频预测、物理场景模拟)、需要明确对象级控制的场景 |

| 基于博弈与多智能体辩论的策略 | 通过引入信息不对称和智能体间的博弈,暴露并识别模型认知中的错误或“幻觉”。 | 多智能体卧底博弈 (MUG框架) | 提升多模态推理的鲁棒性、检测和减少模型幻觉、需要高可靠性决策的场景 |

| 基于最小编辑的无监督生成 | 在无监督条件下,对原始文本进行最小程度的编辑,使其满足反事实条件,保持内容的最大一致性。 | 基于MCMC采样的文本编辑 (如EDUCAT框架) | 文本反事实改写(如故事结局重写)、追求生成结果流畅且改动最小的应用 |

| 基于数据形态学的模型无关方法 | 不依赖模型内部结构,通过分析数据分布本身的结构(形态学)来寻找符合要求的反事实样本。 | ONB-MACF方法 | 为黑盒模型生成事后解释 (XAI)、需要保证反事实样本合理性与可行性的场景 |

方法详解与应用场景

-

基于结构化表示的因果干预

这类方法的核心优势在于将感知与推理解耦。以CWMDT框架为例,它先从视频帧中提取出描述对象及其关系的结构化文本表示(数字孪生),然后利用大语言模型在这种显式表示上进行反事实推理(例如,“移除某个障碍物”),预测其随时间的变化,最后再根据修改后的表示合成反事实视频。这种方法将干预施加在更易于理解和控制的结构化表示上,避免了直接在复杂的像素空间中进行难以控制的修改。

-

基于博弈与多智能体辩论的策略

MUG框架的创新之处在于主动引入一个“卧底”智能体,该智能体看到的是经过细微修改的“反事实图片”。在随后的多轮辩论和投票中,其他智能体需要找出这个“卧底”。这个过程迫使所有智能体提供更细致、更可靠的推理来证明自己,从而系统地暴露出模型的认知盲点或幻觉,最终提升整个系统的鲁棒性和可靠性。

-

基于最小编辑的无监督生成

对于像故事改写这样的任务,目标是使改动最小化,同时保证新生成的内容流畅且符合反事实条件。EDUCAT框架采用马尔可夫链蒙特卡洛(MCMC)采样,迭代地寻找并修改原文本中与反事实条件最冲突的词语,同时利用预训练语言模型确保编辑后的文本通顺。这种方法很好地平衡了“最小编辑”和“逻辑连贯性”这两个目标。

-

基于数据形态学的模型无关方法

ONB-MACF等方法侧重于为任何“黑盒”模型生成事后解释。它不关心模型内部机制,而是通过分析数据分布的形状(形态学),寻找那些与原始输入特征相近但会导致模型做出不同预测的样本点作为反事实解释。这种方法的核心优势在于其模型无关性 和注重反事实样本的可行性与合理性。

如何选择适合的方法

选择哪种方法,取决于你的具体任务和需求:

-

如果你的任务是多模态的(如视频、图像推理),并且需要理解干预如何影响场景中的特定对象,基于结构化表示的方法(如数字孪生)可能更合适。

-

如果你的首要目标是提升模型的鲁棒性,减少其“一本正经地胡说八道”,那么基于多智能体博弈的策略(如MUG)提供了新颖且有效的思路。

-

如果您的任务是文本生成或改写,并且希望尽可能保留原文风格和结构,基于最小编辑的无监督方法是直接且高效的选择。

-

如果您的主要需求是为已有的黑盒模型决策提供解释,而非让模型本身具备反事实生成能力,那么基于数据形态学的模型无关方法(如ONB-MACF)是更实用的工具。

1.38 大模型的层次化概念和随机概念思考方法

|

维度 |

核心内涵 |

关键价值 |

|---|---|---|

|

层次化概念 |

将大模型的能力按通用性和专业性进行分层,形成从基础到顶端的金字塔结构。 |

实现了从“通才”到“专家”的精准分工与协作,使大模型能够系统化地赋能千行百业。 |

|

随机概念思考 |

通过引入可控的随机性(如温度参数、Top-k采样),在生成每个词时从概率分布中抽样,而非总是选择概率最高的词。 |

打破了模型的刻板与重复,是创造力、多样性和灵活性的核心来源,使模型输出更像“人”。 |

层次化概念:从“通才”到“专家”的进化之路

大模型并非一个铁板一块的巨系统,而是遵循着清晰的分层逻辑,这确保了其能力可以有序地构建和应用。

-

基础模型层(L1与L2):通用知识的“博学家”

这一层是整个生态的基石。数字基础设施层(L1) 提供了算力、网络和存储等硬件支持。在其之上是通用大模型层(L2),它们通过在互联网级别的海量公开数据上进行预训练,学会了人类语言的通用模式、语法、事实知识和一定的推理能力,成为拥有广博知识的“通才”。例如,GPT-4或LLaMA就属于这一层,它们不专精于特定领域,但能力全面。

-

行业模型层(L3):深耕垂直领域的“专家”

在通用大模型的基础上,注入特定行业(如金融、医疗、法律)的专有数据和知识进行微调,就得到了行业模型。它们不仅理解通用语言,更精通行业的专业术语、流程和规范,能够解决该领域的特定问题,化身为“行业专家”。

-

场景模型层(L4):解决具体问题的“工匠”

这是最顶层,直接面向用户。场景模型针对一个非常具体的应用任务进行深度优化,例如智能客服中的问答机器人、代码开发中的辅助编程工具等。它们的目标极其明确,追求在单一任务上的极致性能和可靠性,是解决实际问题的“工匠”。

🎲 随机概念思考:可控的“创造力引擎”

如果层次化概念决定了模型“能做什么”,那么随机思考则决定了模型“会怎么做”。它让模型从一台复读机变成一个富有创意的伙伴。

-

随机性的来源与控制参数

模型在生成每个词时,会计算出一个所有可能的下一个词的概率分布列表。随机思考的关键在于如何从这个列表中选择。

-

温度参数:这是控制随机性的“总开关”。

-

低温度(<1):会使概率分布变得更“尖锐”,模型输出更加确定、保守和可靠,适合代码生成、事实问答等任务。

-

高温度(>1):会使概率分布更“平坦”,模型输出更加随机、多样和有创意,适合写诗、构思故事等任务。

-

-

Top-p(核采样):这是一种更智能的筛选方式。它不固定候选词数量,而是设定一个概率累计和阈值(如0.9),只从概率最高的一小撮词(其累计概率刚超过阈值)中进行随机选择,兼顾了流畅性和多样性。

-

-

为何需要随机性?

-

打破重复:如果没有随机性,模型很容易陷入循环,不断重复相同的短语。

-

激发创意:对于没有标准答案的任务,随机性可以帮助模型跳出常规,产生新颖的组合。

-

模拟不确定性:现实世界很多问题本身就有多种可能,随机性允许模型给出多种合理的答案。

-

层次与随机的协同共舞

在实际应用中,层次化结构和随机思考是紧密配合的。

-

下层决定上限,随机控制发挥:一个模型的内在能力(知识广度、推理深度)由其所在的层次(是通用模型还是专业模型)决定,这是能力的“天花板”。而随机参数则像是在这个能力范围内调节其“发挥风格”,是严谨的学术报告风格,还是活泼的博客文章风格。

-

不同层次,不同的随机性要求:通常,越靠近底层的通用任务(如开放域对话),可以适当调高随机性以激发创意。而越靠近顶层的专业场景任务(如医疗报告生成),则往往需要调低随机性,确保输出的准确性和安全性。

1.39 大模型层次化表达

构建思维的骨架:层次化递归架构

要实现您所说的层次化表达,首先需要在模型架构上实现“思考”与“执行”的分离,并为思考过程提供显式的结构。这主要依赖于递归机制和智能体分工。

-

递归:实现思维嵌套的引擎

递归是实现“思维嵌套”和“深度思考”的核心机制。它允许模型对同一问题进行多次、渐进的加工,而非一次性输出答案。

-

分层递归模型(HRM):这类模型借鉴了人脑“快慢思考”的特点。它通常包含一个更新较慢的高层模块 和一个更新较快的低层模块 。高层模块像一个“战略家”,负责制定宏观规划;低层模块则像“执行者”,负责密集的细节计算。两者交替工作,使得模型能够在时间维度上展开深度计算,实现对复杂问题的分解与逐步攻克。

-

微型递归模型(TRM):这是一种更极致的递归思路。它使用一个极小的网络(如700万参数),通过多次(如16次)“起草答案-自我审查-修订答案”的循环,来达到甚至超越庞大模型的推理效果。这体现了“少即是多”的哲学,核心在于通过递归迭代来提升思维质量,而非单纯增加参数。

-

-

多智能体分工:显式化思维模式

为了更精细地控制思维过程,可以引入多智能体框架,将不同的思维任务分配给不同的“智能体”。

-

ReMA框架:该框架将推理过程解耦为两个明确的智能体:一个元思维智能体 负责监控、规划、评估整个推理过程(即“思考如何思考”);另一个推理智能体 负责执行具体的计算和推导。两者通过交互协作,使得“分析思维”、“反思思维”等高级认知功能得以显式地实现和优化。

-

训练思维的能力:核心方法与策略

有了架构骨架后,需要通过特定的训练方法为其注入思维的能力。核心在于强化学习和课程学习。

-

递归强化学习(RL):这是深度强化思维能力的核心手段。以 DeepSeek-Prover-V2 为例,它首先利用大模型(如DeepSeek-V3)将复杂的数学定理分解成一系列子目标(对应分析思维和逻辑思维),然后使用GRPO等强化学习算法,让模型在尝试证明这些子目标的过程中学习最优的推理路径。这个过程本质上是让模型通过递归探索,自主发现并内化解决问题的策略。

-

课程学习与子目标分解:模仿人类的学习过程,先让模型学习解决简单问题,再逐步增加难度。通过系统性地将复杂问题(如链条思维 所需的多步推理)分解为渐进的子目标,可以构建一个高效的训练课程,引导模型稳健地掌握复杂技能。

-

自适应思考训练(AutoThink):为了解决“过度思考”问题,提升效率,可以训练模型自主决定思考深度。AutoThink 策略通过多阶段强化学习,教会模型根据问题难度在“快思考”(直觉反应)和“慢思考”(深度推理)模式间自主切换。这实现了“思维表达和遗忘逻辑”中的“遗忘”——即对简单问题主动抑制不必要的深度思考,从而实现高效计算。

实现特定的思维模式

基于上述架构和方法,各种具体思维模式可以得到针对性的设计和强化:

|

思维模式 |

实现与强化路径 |

|---|---|

|

空间思维 |

在架构上,可引入图神经网络(GNN) 等模块来显式处理实体关系。在训练上,使用涉及空间关系(如迷宫求解、几何证明)的数据进行强化学习或课程学习,让模型学会在内部构建空间表征。 |

|

逻辑与演绎思维 |

这是递归强化学习最直接的应用场景。通过定理证明等任务(如DeepSeek-Prover-V2),直接训练模型严格遵循逻辑规则进行链条式的推导。 |

|

分析与联想思维 |

多智能体框架(如ReMA) 是关键。元思维智能体负责进行分析(分解问题、评估进展),而联想能力则可通过在训练数据中构建丰富的跨领域知识关联,并利用注意力机制来增强。 |

|

博弈与对抗思维 |

这可以看作是多智能体交互的特殊形式。在ReMA框架中,元思维智能体与推理智能体之间可以设计成一种相互挑战、验证的关系,从而模拟内在的对抗思维。此外,也可以通过让模型与特定环境或其他智能体对抗来进行训练。 |

路径展望与挑战

将大模型的思维能力层次化,是一条充满潜力但也面临挑战的道路。当前的研究显示,通过递归架构、多智能体分工赋予模型“思考的骨架”,再结合递归强化学习、自适应训练等方法注入“思考的动力”,能够系统性地提升模型在逻辑、推理、分析等多方面的能力。

二、思维引擎

2.1 思维引擎设计方法

作为人工智能领域研究者,其实当前最难的是仿照甚至设计一份超越人类的思维引擎,需要考虑为模型构建一个高度结构化、动态演化且具备严格逻辑与不确定性推理能力的“思考引擎”。

2.1.1 构建多层次动态知识架构

首先,设计一个能有效表示复杂知识的底层结构。

-

多图与空间复形:从平面关系到立体结构:传统的知识图谱可视为一张图。多图(Multi-graph) 概念允许我们为同一组节点(实体/概念)构建多张不同关系类型的图。例如,一张图表示“地理邻近”,另一张表示“功能相似”,第三张表示“因果时序”。这比单图能更丰富地刻画概念间的多维关联。更进一步,空间复形(Spatial Complex),特别是单纯复形(Simplicial Complex),能描述超越两两关系的高阶互动。例如,三个概念(如“高温”、“干燥”、“山火”)之间稳定的三元关系可以表示为一个2-单形(三角形),这比三条独立的边能更准确地捕捉它们作为整体涌现的语义。

-

多节点信息聚合:捕捉协同效应:在多图/复形结构中,信息传递不再仅是节点到节点。我们需要设计多节点信息聚合机制。例如,可以引入最短路径算法来捕捉图中长距离的依赖关系,模拟信息在复杂网络中的传递路径。同时,通过可学习的嵌入向量来表征节点的重要性(中心性)和节点集合的协同模式,从而动态地聚合来自多个邻居和高阶结构的信息,更全面地理解局部语境。

2.1.2 设计动态推理引擎

有了底层结构,接下来需要驱动它进行思考和演化的引擎。

-

高阶微分方程与统计模型:描述连续动态思维:将模型的“思考状态”定义为高维空间中的向量。其随时间(或推理深度)的演化可以用高阶微分方程来刻画。这类方程能描述复杂的动力学行为,如周期性振荡(模拟权衡思考)、收敛到吸引子(形成结论)或混沌(探索多种可能性),非常适合模拟非线性的、连续的思考过程。同时,统计模型(如基于高斯过程的模型)可以为这些动力学提供不确定性量化,让模型知道自己对当前推理路径的置信度。

-

多层嵌套博弈演化算法:模拟多元观点竞争与协作:复杂决策常涉及内部多个“智能体”(如不同观点、偏好)的互动。可以引入多层嵌套的博弈演化算法。在每一层推理中,不同策略(如“冒险方案”与“保守方案”)像一个演化博弈中的种群一样竞争,其“适应度”由其在解决当前问题中的预期收益决定。策略的频率会根据博弈结果(如复制者动态)而变化,模拟观点优胜劣汰。这种博弈可以嵌套进行,即一个博弈的均衡结果会成为下一层更高级别博弈的输入,从而模拟从局部决策到全局策略的涌现过程。

-

复杂贝叶斯网络:进行不确定性下的因果推断:上述动态过程需要与严谨的不确定性推理结合。复杂贝叶斯网络(如包含隐变量或时序关系的动态贝叶斯网络)是理想工具。它将变量间的依赖关系表示为图,并基于贝叶斯定理更新信念。当与新证据或上述博弈结果结合时,网络中的所有相关节点的概率分布都会更新,实现概率化的因果推断。这使模型能持续评估不同假设的可能性,并在证据不完整时做出稳健决策。

最后,将这些组件整合为一个有机的、协同工作的系统。其核心工作流程可以概括为以下几个阶段:

-

知识结构化表示:将输入的自然语言文本或数据,映射到构建好的多图/空间复形结构上。每个概念成为节点,关系构成边或高阶单形。这一步将非结构化的信息转化为可计算的结构化知识网络。

-

多跳推理与语义传播:利用图神经网络(GNN)等技术,在知识网络上进行信息传播和聚合。通过多跳推理,模型能够从已知事实出发,沿着图的路径探索和发现隐含的结论。这个过程中,微分方程可以刻画信息在网络上传播的动态过程。

-

动态博弈与演化决策:针对推理目标,在模型内部启动一个(或多层嵌套的)博弈演化过程。不同的推理路径或候选答案作为博弈策略,根据其与知识结构的契合度、逻辑一致性以及预期效用进行竞争和演化,最终收敛到一组均衡的“信念”或决策选项。

-

贝叶斯更新与输出:整个推理过程的不确定性由复杂贝叶斯网络进行建模和更新。模型会综合所有信息,计算最终答案的概率,并可能输出多个可能结果及其置信度。

重要挑战与展望

构建这样的系统面临诸多挑战,包括极高的计算复杂度、对超参数敏感的动力学行为、以及评估这类“思考过程”的难度。然而,这条路径确实指向了创造具有深度推理、适应性学习和内在不确定性意识的下一代人工智能模型。

2.2 空间复形上的高阶微分方程

2.2.1 空间复形上的微分方程与大语言模型(LLM)相结合

将空间复形上的微分方程与大语言模型(LLM)相结合,是一个旨在提升我们处理复杂几何与物理问题能力的交叉领域研究方向。下面这个表格概括了结合的主要思路与挑战。

|

核心环节 |

核心任务 |

大语言模型的潜在角色与相关技术 |

|---|---|---|

|

1. 形式化表达 |

将非结构化的自然语言问题描述,转化为精确的数学规范(如定义在复形上的微分算子、边界条件)。 |

作为“翻译器”,利用在代码和科学文本上训练出的能力,将自然语言描述转化为形式语言(如STL信号时序逻辑)或特定领域的描述语言 。 |

|

2. 程序合成 |

根据形式化后的数学问题,自动生成可执行代码(如Python代码),用于数值求解。 |

作为“代码生成器”,根据形式化规范,调用相应的数值计算库(如FEniCS),生成离散化和求解方程的代码 。 |

|

3. 科学推理 |

在处理复杂约束或优化目标时,进行子目标分解等推理,以提升求解效率和效果。 |

作为“推理引擎”,通过强化学习等技术,学习提出有效的中间子目标,引导求解过程 。 |

|

4. 符号计算与接口 |

处理方程中的符号运算,如求导、积分,并与传统数学工具衔接。 |

作为“符号计算接口”,将方程视为一种“语言”,利用seq2seq模型直接进行符号运算(如求原函数)。 |

结合框架与工作流程

一个典型的结合框架可能遵循“自然语言描述 → 形式化规范 → 数值求解代码 → 推理优化”的流程 。

-

从描述到规范(形式化表达):这是第一步,也是关键一步。大语言模型(如专门微调过的Translator模型)可以读取像“求解一个定义在特定拓扑结构上的热方程,并要求其在某区域温度不超过某值”这样的自然语言描述,并将其转换为精确的数学规范,例如使用信号时序逻辑(STL)来描述时空约束 。这相当于为问题建立了无歧义的“需求文档”。

-

从规范到代码(程序合成):获得形式化规范后,另一个大语言模型(如Coder模型)可以据此生成执行代码。例如,生成利用有限元方法(FEM)在离散化后的空间复形(如三角网格)上进行数值计算的代码 。这个过程很大程度上依赖于模型在大量科学计算代码上训练所学习到的模式。

-

增强求解过程(科学推理):对于复杂的优化控制问题,直接求解可能效率低下或陷入局部最优。大语言模型(通过强化学习训练)可以学习提出合理的“子目标”。例如,先引导系统达到一个中间状态,再从此状态出发实现最终目标,这种分步推理策略已被证明能有效提升整体性能 。

潜在路径与独特价值

除了上述较为成熟的流程,大语言模型还可能通过以下方式提供独特价值:

-

充当符号数学引擎:有研究(如Facebook AI的工作)探索将数学表达式视为一种语言,利用序列到序列(seq2seq)的神经网络模型直接进行符号运算,例如求解积分和某些微分方程 。虽然这种方法在处理空间复形这类高度结构化问题时尚不成熟,但它为完全由AI驱动的符号计算提供了可能。

-

简化与传统求解器的交互:大语言模型可以生成符合特定求解器(如COMSOL, ANSYS)要求的输入文件或API调用指令,降低使用这些专业工具的门槛。

主要挑战与注意事项

尽管前景广阔,但将大语言模型应用于空间复形上的微分方程表达仍面临显著挑战:

-

数学严谨性:大语言模型本质上基于概率统计,可能产生看似合理但数学上不精确甚至错误的结果。在科学计算中,这种错误可能是灾难性的。因此,生成的结果必须经过严格的数学验证或传统数值方法的校验。

-

数据稀缺性:空间复形上的微分方程问题非常专业,缺乏大规模、高质量的“问题-解”配对数据集用于训练大语言模型。虽然可以通过技术手段生成合成数据 ,但其覆盖面和真实性仍有局限。

-

计算复杂性:空间复形本身的结构以及其上微分方程的离散化可能带来巨大的计算量。大语言模型作为复杂环节的“调度器”或“代码生成器”,其引入的计算开销需要与带来的便利性进行权衡。

-

维度灾难:当前研究多集中于相对简单的1D或2D场景 。将其推广到更高维、更复杂的多物理场耦合问题,对大语言模型的理解和生成能力提出了极大挑战。

总结与展望

总的来说,大语言模型在处理空间复形等复杂结构上的微分方程时,其核心优势在于强大的模式识别、代码生成和初步的逻辑推理能力。它们有望成为连接人类直觉、抽象数学理论与具体计算实现之间的强大桥梁。

然而,这条路径尚处于探索阶段。目前更现实的模式是“大语言模型辅助建模 + 传统方法验证求解”,将大语言模型作为提升效率的助手,而非完全依赖其自主完成所有数学工作。

2.2.2 设计数值求解器

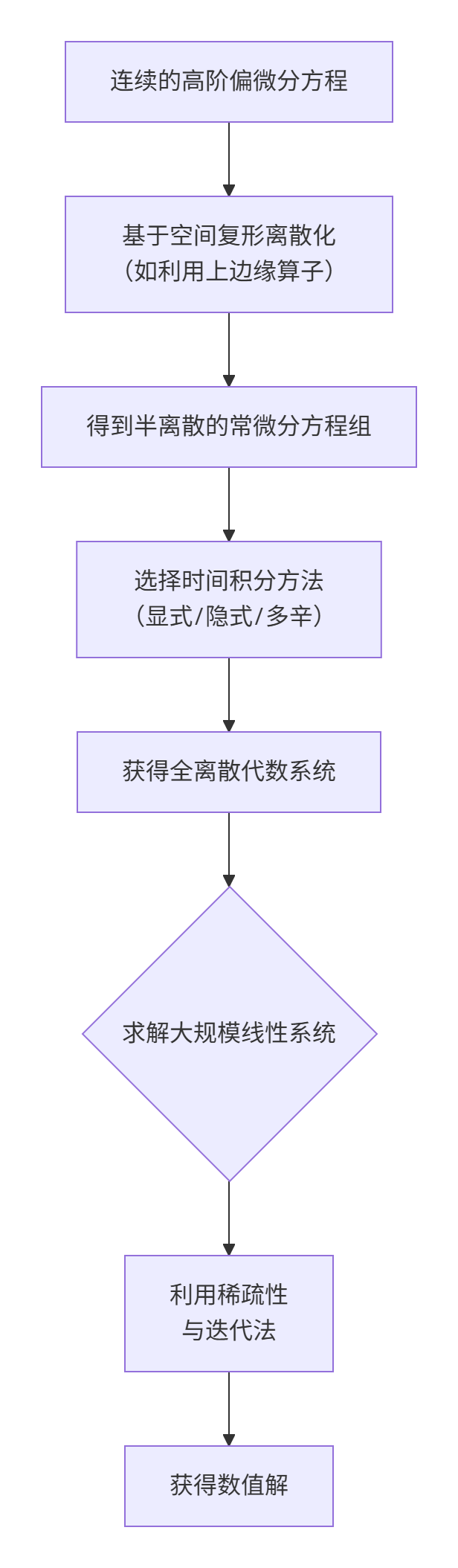

为空间复形上的高阶微分方程设计数值求解器,确实是一个融合了计算拓扑、数值分析和科学计算的深刻问题。它的核心挑战在于,如何将复形抽象的拓扑结构与微分方程严苛的数值稳定性要求完美地结合起来。

第一步:构建求解器的基础——问题离散化与几何表示

在开始数值求解前,我们必须先将连续的数学问题转化为计算机可以处理的离散形式。关键在于如何将空间复形的几何结构转化为有效的计算框架。

-

理解空间复形:您可以将空间复形想象成一个由点(0-单形)、线(1-单形)、面(2-单形)等基本几何块构造的复杂空间。它为描述复杂几何对象(如流形、带有孔洞或分支的结构)提供了一种强大的组合语言。

-

离散化与矩阵表示:数值方法的起点是将连续的偏微分方程(PDE)离散化。对于定义在复形上的PDE,我们需要在复形的每个单形(如点、边、面)上定义离散函数值。它们之间的关联(如一条边连接哪两个点)则由矩阵来描述,例如上同调中关键的上边缘算子 δ矩阵。高阶微分算子(如拉普拉斯算子)可以表示为这些矩阵的组合,从而将PDE转化为一个庞大的线性或非线性方程组 。

第二步:设计核心算法——兼顾稳定与高效的数值方法

离散化之后,选择何种数值方法来求解这个方程组至关重要。目标是找到在计算效率和数值稳定性之间取得最佳平衡的方案。

以下表格对比了几类核心方法的特性:

|

方法类型 |

核心思想 |

稳定性与效率 |

适用场景 |

|---|---|---|---|

|

局部微分求积法 (LDQ) |

仅在每个离散点的局部邻域内进行高阶多项式插值来近似微分算子。 |

高效稳定:产生的系数矩阵是稀疏的,求解速度快。且采用重心插值基函数,能有效避免高次插值的龙格现象,数值稳定性好。 |

规则区域或可被光滑映射的复形,追求计算效率的场景。 |

|

(傅里叶)拟谱方法 |

在全局范围内使用光滑基函数(如三角函数、切比雪夫多项式)的线性组合来近似解。 |

高精度但条件稳定:若解足够光滑,精度随节点数增加而指数型收敛(谱精度)。但通常要求规则区域和时间步长受严格限制。 |

周期性边界或非常光滑的解,对精度有极致要求的场景。 |

|

多辛积分方法 |

并非具体的离散格式,而是一种设计理念。旨在离散层面上保持原连续系统具有的某些基本物理守恒律。 |

长期稳定性:这种方法能长时间模拟而不会出现物理上荒谬的结果,特别适合动态系统推理。 |

模拟具有内在守恒律(如能量、动量)的物理过程。 |

方法的选择与融合:

-

若计算效率和实现简便性是首要考虑,局部微分求积法(LDQ) 是一个极佳的起点 。

-

若解的精度至关重要且区域规则、解足够光滑,拟谱方法能提供无与伦比的收敛速度 。

-

对于长时间演化的物理系统,采用多辛积分框架设计的算法能提供更可靠的模拟结果 。

-

现代高阶求解器常融合多种思想。例如,在空间离散上采用LDQ法保证效率和局部性,在时间积分上采用多辛格式保持长期稳定性。

第三步:保证稳定与加速计算——关键实施策略

选定了方法,还需要具体的策略来确保其稳定性和效率。

-

稳定性保障

-

自适应步长控制:这是提升稳定性和效率的利器。如IAPLA方法 所示,通过比较不同阶数解(如四阶和五阶龙格-库塔法)的差异来估计局部误差,据此动态调整下一步的步长。在解变化剧烈时自动缩小步长保稳定,在解平滑时增大步长提效率。

-

时间积分器的选择:对于由空间离散产生的常微分方程组(ODEs),需选择合适的时间推进方法。对于含刚性项的问题(特征值差异巨大),隐式方法(如Crank-Nicolson )通常比显式方法稳定得多,尽管每一步计算成本更高。

-

-

效率优化

-

利用稀疏性与迭代求解:基于局部方法的离散(如LDQ)会产生稀疏矩阵。应使用专为稀疏矩阵设计的算法和存储格式,可大幅降低内存占用和计算量。对于大规模线性系统,Krylov子空间迭代法(如共轭梯度法、GMRES法)并配合预条件子是必不可少的技术。

-

高阶精度与并行计算:使用高阶方法(如四阶格式 )可以在相同网格规模下用更少的计算量获得更高精度的解,从本质上提升效率。同时,许多离散和求解过程(如单元上的局部运算、矩阵向量乘法)天然适合并行计算(多核CPU或GPU),能极大缩短计算时间。

-

总结与案例视角

为了更直观地理解,我们可以将这个过程抽象为一个具有通用性的工作流程,它展示了从连续方程到离散求解的完整路径:

这个流程的核心思想是降维和化简。通过离散化,我们将无限维的连续问题转化为有限维的代数问题。随后,整个工作的重心就转变为如何高效、稳定地求解这个可能非常庞大的代数系统。此时,前述的局部微分求积法、拟谱方法等是形成这个系统的方式,而利用矩阵稀疏性、并行计算等则是求解和加速的手段。

2.2.3 大语言模型更好地理解和生成空间复形

让大语言模型更好地理解和生成空间复形这类复杂的数学表达式,确实需要精心设计微调策略。这涉及到数据、方法、训练技巧等多个方面的考量。下面我将为您梳理一个具体的微调方案。

深入理解数据与任务特性

空间复形(Spatial Complex)是代数拓扑中的核心概念,其数学表达融合了集合、映射、层次、边界算子等抽象元素。要让大语言模型处理这类内容,首先需要深入理解其数据特点和模型面临的挑战。

-

数据特点:空间复形的描述通常高度结构化、符号密集,并且逻辑关系严密。例如,一个单纯复形的定义可能涉及顶点、边、面等不同维度的单形,以及它们之间的关联关系。

-

核心挑战:通用大语言模型在预训练时接触的数学文本相对有限,尤其在空间复形这类专业领域。微调的核心目标就是让模型掌握其特有的符号系统、定义逻辑、定理表述及证明风格。

精心准备微调数据

高质量的数据是成功微调的基石。对于空间复形而言,数据准备需要格外精心。

-

数据来源与收集:

-

专业教材与论文:从经典的代数拓扑、计算拓扑教材,以及arXiv等平台的相关论文中提取文本和公式。这些材料提供了准确的定义、定理和证明范例。

-

代码库:收集实现复形构建、同调群计算等功能的代码(如Python代码)。这有助于模型学习如何将数学概念转化为可计算的结构。

-

生成合成数据:可以设计模板,自动生成大量“问题-解答”对。例如,随机生成一个图的邻接矩阵,然后描述其对应的单纯复形结构,并给出各维单形的列表。

-

-

数据清洗与格式化:

-

确保数学公式采用LaTeX格式,这是数学表达的标准。

-

将收集到的材料转化为适合指令微调(Instruction Tuning)的格式。每条数据可以构造成一个清晰的指令,包含任务描述、输入(如“请描述以下复形的1维同调群”)和期望的输出(即规范的数学表达或计算过程)。

-

选择合适的微调方法

考虑到计算效率和模型性能,参数高效微调(PEFT) 方法通常是首选,因为它们能在引入较少新参数的情况下取得良好效果。

-

LoRA(Low-Rank Adaptation):LoRA因其高效性成为热门选择。它通过引入低秩矩阵来模拟参数更新的增量,而不改动原始模型权重。对于数学表达式生成任务,可以将LoRA适配器附加到模型的自注意力模块(如Q、K、V、O投影层)和全连接层上。

-

P-Tuning v2:如果任务更侧重于根据特定提示(Prompt)生成符合格式的表达式,P-Tuning v2也是一个值得考虑的选项。它在输入层加入可训练的连续提示向量,并作用于模型的每一层,能更好地引导模型输出。

优化训练策略与参数

训练过程中的策略和参数设置对最终效果至关重要。

-

超参数设置:

-

学习率(Learning Rate):由于微调数据量通常远小于预训练数据,学习率应设置得比预训练时更小,例如设置为预训练学习率的0.1倍左右(如

5e-6到2e-5),以避免破坏模型已有的宝贵知识。 -

批大小(Batch Size):在GPU内存允许的情况下,适当增大批大小有助于训练稳定。

-

训练轮数(Epochs):需要密切监控模型在验证集上的表现,防止过拟合。对于高质量数据集,1-3个epoch可能就足够了。

-

-

渐进式训练(可选但推荐):

-

可以先在较宽泛的拓扑学或几何学文本上进行领域自适应预训练(Continue Pre-training),让模型先熟悉相关领域的基本术语和语境。

-

然后,再在精心构造的空间复形指令数据集上进行指令微调(SFT)。这种两步走的方法可能比直接进行SFT效果更好。

-

评估效果与持续迭代

微调后,需要科学评估模型的表现,并据此迭代优化。

-

评估指标:

-

精确匹配率:检查生成的表达式在符号和结构上是否与标准答案完全一致。

-

语义一致性:使用更专业的评估器(如利用计算机代数系统)验证生成表达式的数学正确性。

-

BLEU分数或ROUGE分数:作为辅助参考,衡量生成文本与参考文本的表面相似度。

-

-

迭代优化:

-

分析模型在验证集上常见的错误类型,例如是符号误用、逻辑错误还是对边界算子理解偏差。

-

根据错误分析,有针对性地补充训练数据,或者调整数据中不同任务类型的比例,逐步提升模型在薄弱环节的表现。

-

核心要点总结

总而言之,要让大语言模型更好地处理空间复形表达式,关键在于构建高质量、高针对性的指令数据集,并优选参数高效的微调方法(如LoRA),辅以谨慎的超参数设置和科学的评估迭代。

2.3 多图结构中让模型自适应地判断不同关系的重要性

2.3.1 模型自适应地判断不同关系的重要性

在多图结构中,让模型自适应地判断不同关系的重要性,核心在于设计一种机制,使得模型能够根据当前任务的具体上下文,动态地评估并加权每种关系(或每个视图)的贡献。这比静态地分配权重更加灵活和强大。

核心设计思路

自适应权重的设计主要围绕以下几个层面展开,其核心思想是通过模型自身的学习能力,动态地评估和整合多源信息:

-

视图级权重:将每种关系类型视为一个独立的视图或图层,学习一个全局权重,表示该关系类型对整体任务的平均重要程度。例如,在学术合作网络中,“合作撰写论文”的关系可能比“共同关注某个话题”的关系在衡量学者影响力时通常更具权重。

-

节点级权重:认识到即使在同一种关系下,不同节点的重要性也可能不同。此方法为每个节点在不同关系上学习独立的权重,实现更精细化的个性化聚合。例如,对于某个特定学者,其“研究兴趣”关系层提供的信息可能比“机构隶属”关系层更能反映其真实影响力。

-

上下文感知的权重:权重可以根据具体的局部图结构或任务上下文动态变化。例如,在预测分子性质时,对于芳香环上的碳原子,共价键关系可能最重要;而在预测蛋白质相互作用界面时,空间距离关系可能更关键。

主流自适应权重机制

基于上述思路,研究者们提出了多种具体的实现机制:

-

基于注意力机制的权重

这是目前最主流和灵活的方法。其核心思想是让模型自动学习为不同的关系或邻居计算注意力分数。

-

图内注意力:在单个关系图内部,计算一个节点与其邻居之间的注意力权重,聚焦于最相关的邻居信息。经典模型如图注意力网络(GAT) 便采用此机制。

-

跨图注意力:在多图环境中,计算不同关系图对目标节点的总体贡献权重。模型会评估每种关系类型在当前上下文下的重要性,并为它们分配合适的权重。

-

-

基于谱聚类目标的权重

这类方法将权重的学习过程嵌入到一个优化目标中,例如,通过最小化融合后的图与各单图之间的差异来自动学习最优权重。其通用目标函数可以表示为:

min∑(w(v) * ‖S - S(v)‖²)其中,

S是融合后的图相似矩阵,S(v)是第v个关系的相似矩阵,w(v)是其权重。通过优化过程,模型会自动为与融合结果S更一致的关系图分配更高的权重。 -

基于网络层重要性的权重

在真正的多层网络(各层节点集相同但关系类型不同)中,可以专门设计模块来计算每一层网络的全局重要性。例如,可以借鉴PageRank的思想,不仅计算节点的重要性,也递归地计算网络层本身的重要性。

实现策略与网络架构

要将上述机制付诸实践,通常需要设计专门的图神经网络层或模块:

-

动态多图融合模块:这类模块将多个关系图(如距离图、功能图、邻居图)的信息进行融合。它通常包含一个可训练的权重张量,并利用空间注意力和图注意力机制来动态计算节点在不同关系下的重要性。

-

注意力读出与自适应聚合:在图级任务中,设计自适应的读出操作至关重要。例如,可以通过注意力机制来聚合图中所有节点的特征,从而形成整个图的表示,确保重要的节点特征对图级表示有更大贡献。

-

交替优化算法:对于一些基于优化目标的方法,权重的学习可以通过交替优化算法来实现。即固定权重优化模型其他参数,再固定其他参数优化权重,如此迭代直至收敛。

评估与考量要点

在设计和使用自适应权重时,有几个关键点需要考量:

-

效率与复杂度:引入自适应权重,特别是细粒度的节点级注意力,会增加模型的计算复杂度和内存消耗。需要在模型性能和计算效率之间取得平衡。

-

过拟合风险:如果关系类型很多或数据量有限,复杂的权重学习机制可能容易过拟合。适当的正则化(如对权重施加L1或L2惩罚)是必要的。

-

权重的可解释性:学习到的权重本身可以作为分析工具。例如,我们可以通过观察模型为不同关系分配的权重,来理解在特定任务下哪些关系模式更为关键,这增强了模型的可解释性。

2.3.2 图数据中不同粒度的关系(节点级、子图级、全图级)设计分层自适应的权重融合策略

为图数据中不同粒度的关系(节点级、子图级、全图级)设计分层自适应的权重融合策略,是提升图表示学习性能的关键。这种策略的核心在于动态地评估不同层次、不同来源信息的重要性,并进行有针对性的融合。下面这个表格概括了针对不同粒度的核心策略和关键技术。

|

关系粒度 |

核心策略 |

关键技术/机制 |

融合目标 |

|---|---|---|---|

|

节点级 |

基于注意力机制的个性化加权 |

图注意力网络(GAT)、方差权重 、基于相似度的权重计算 |

聚焦局部特征,为每个节点聚合其邻居中最相关的信息。 |

|

子图级 |

基于结构或语义重要性的加权 |

社区检测(如Louvain算法)、基于方差的代表性评估 、节点匹配与压缩 |

捕捉中观尺度的模块化结构或功能单元,评估并融合不同子图的贡献。 |

|

全图级 |

基于任务导向的全局加权 |

多视图方差权重 、注意力机制 、动态权重控制 |

整合全局视角,平衡不同层次或不同来源信息对下游任务的总体贡献。 |

分层策略详解

下面我们深入探讨每一层的具体设计思路和融合方法。

-

节点级融合:关注局部关联

节点级融合的目标是为每个节点生成一个更好的局部表示。其核心是为每个节点在其邻居集合中动态计算注意力权重。

-

特征提取与关联计算:首先,获取目标节点及其邻居节点的特征表示。然后,通过一个可学习的权重向量,计算目标节点与每个邻居节点的相关性分数。例如,使用图注意力网络(GAT)中的机制,一个简单的方式是将节点特征拼接后传入一个单层神经网络并应用LeakyReLU激活 。

-

权重归一化与融合:将这些原始的相关性分数通过Softmax函数进行归一化,得到每个邻居的注意力权重(和为1)。最后,使用这些权重对邻居节点的特征进行加权求和,并与目标节点自身的特征相结合(例如通过拼接或相加),生成该节点更新后的表示 。此外,也可以借鉴方差权重 的思想,如果某个节点特征在邻居中方差很小,说明它们提供的信息一致且稳定,其整体可信度可能更高,可以在融合时赋予其所在群体更高的总体权重 。

-

-

子图级融合:捕捉中观结构

子图(如社区、功能模块)是介于节点和全图之间的重要中观尺度。融合策略需要能评估不同子图的代表性或重要性。

-

子图划分与表示:首先需要识别或构建子图。常用方法包括基于社区检测的算法(如Louvain算法)将图划分为模块 ,或通过节点匹配和压缩策略迭代地构建从细到粗的多粒度网络结构 。

-