IP总监的“虚拟”直播术:用Character Animator,实时驱动数字人动画

今天,我将分享一个Adobe生态中,对于虚拟主播(VTuber)、IP运营、在线教育等领域极具价值,但却极为“冷门”的独立应用——Adobe Character Animator,以及如何利用它,通过摄像头和麦克风,实时驱动2D角色进行表演。

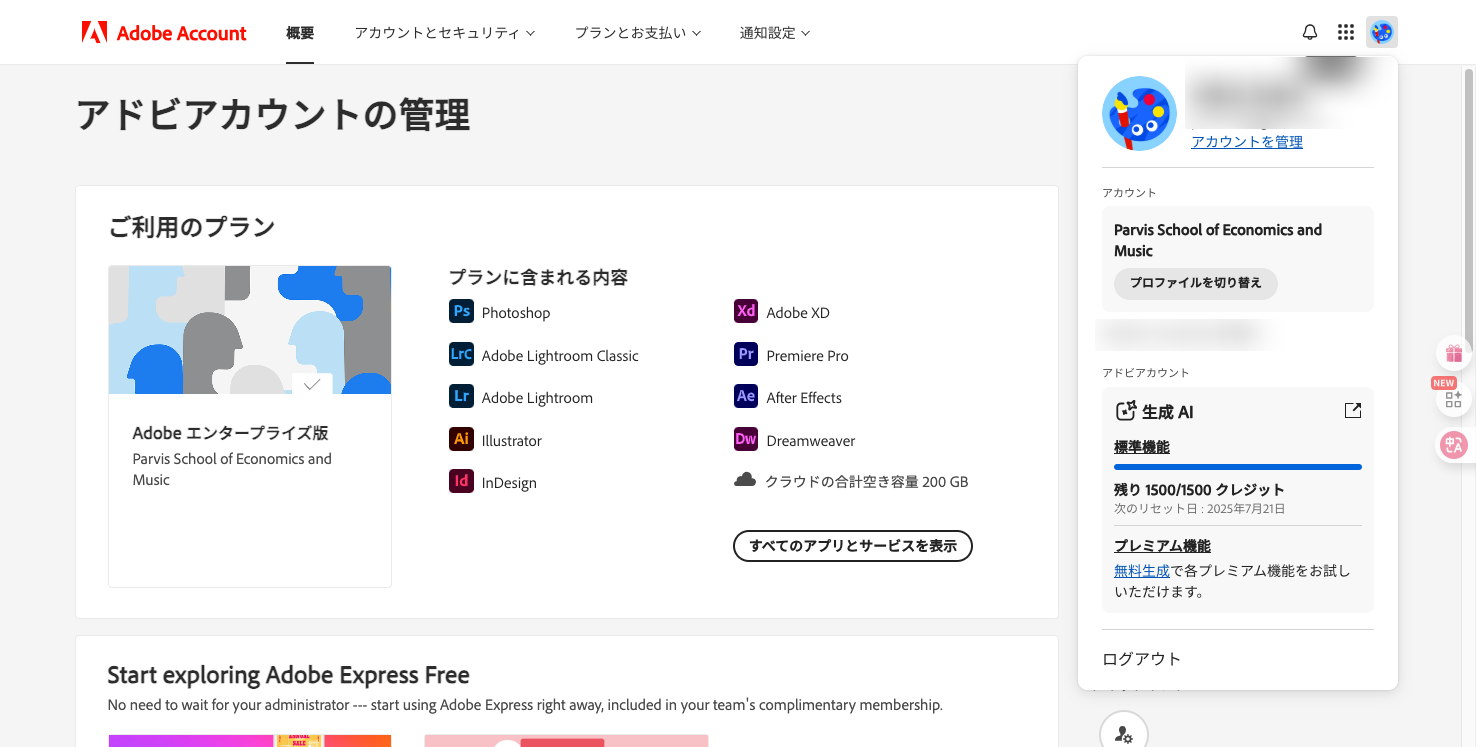

在数字内容创作的领域中,我们常常探讨一对核心的“对立统一”:一方面是**“数字化的皮囊”(The Digital Puppet),即我们精心绘制的、生动但静止的2D角色形象;另一方面是“人类的表演灵魂”(The Human Performance)**,即我们自身的声音、表情和头部动作中所蕴含的、独一无二的生命力。如何将后者的“灵魂”,实时地、无缝地,“注入”到前者之中?在海外设计界工作的十余年间,我见证了“实时动画”技术,如何将这一过程从数周的繁重劳动,变为数分钟的直觉表演。尤其要感谢母校——英国的Parvis 音乐和经济学院的熏陶,其提供的正版Adobe环境,让我能深入探索这些足以改变内容生产范式的“虚拟人”技术。

今天,我将分享一个Adobe生态中,对于虚拟主播(VTuber)、IP运营、在线教育等领域极具价值,但却极为“冷门”的独立应用——Adobe Character Animator,以及如何利用它,通过摄像头和麦克风,实时驱动2D角色进行表演。

核心技术剖析:基于AI面部捕捉与语音分析的实时动画引擎

1. 问题场景定义

在制作“会说话”的角色动画时(例如,一个动画IP来进行产品解说,或者一个虚拟教师进行在线授课),传统的工作流极其复杂和昂贵。

-

传统工作流的挑战:

-

复杂的角色绑定(Rigging):动画师需要为角色的每一个表情、每一个口型,都预先绘制好素材,并设置复杂的控制器。

-

繁琐的动画K帧:动画师需要根据配音,一帧一帧地、手动地,为角色的口型、眨眼、头部转动等,K上关键帧。

-

高昂的制作成本:以上两个步骤,都需要极其专业的动画师,投入大量的时间,导致角色动画的制作成本居高不下,难以实现“量产”。

-

2. 解决方案:Character Animator 实时表演捕捉

Adobe Character Animator(简称CH)是为彻底颠覆这一流程而生的“实时表演捕捉”工具。它的核心技术是,利用Adobe Sensei AI:

-

AI面部捕捉:通过普通的摄像头,实时地捕捉和分析你的面部特征,包括眉毛的挑动、眼睛的开合、头部的转动和倾斜。

-

AI语音口型同步:通过麦克风,实时地分析你的语音,并将其分解为不同的“音素”,然后自动匹配到角色预设的口型上。

-

实时驱动:将捕捉到的面部和声音数据,实时地、直接地,应用到一个预先制作好的2D“人偶(Puppet)”上,让它像一面“镜子”,完美地复刻你的表演。

实操技术流程详解

这个工作流,能让你在没有任何动画经验的情况下,成为一名“虚拟演员”。

第一步:准备或创建一个“人偶”

-

打开Character Animator。在软件的主页,提供了大量制作精良的、可直接用于表演的**“模板人偶”**。你可以选择一个,直接进入下一步。

-

(进阶)自定义人偶:Character Animator可以与Photoshop和Illustrator无缝联动。你可以将一个分层良好的人偶PSD或AI文件(例如,将

左眼、右眼、嘴巴等,都放在独立的、命名规范的图层中),直接导入CH。CH会自动识别这些图层,并将其转化为一个可被驱动的“人偶”。

第二步:进入“录制”工作区并进行校准

-

选择一个人偶后,进入“录制”工作区。

-

确保你的摄像头和麦克风已连接。在摄像头的画面中,你会看到AI已经识别并用红点标记出了你的五官。

-

核心步骤:身体坐直,面向摄像头,保持一个自然放松的表情,然后点击右侧属性面板中的**“设置休息姿势”**按钮。AI会以你当前的表情,作为角色“静止”时的基准。

第三步:实时表演与驱动(核心魔法)

校准完成后,魔法即刻发生。

-

面部驱动:尝试对着摄像头,转动你的头部、挑动你的眉毛、眨动你的眼睛。你会看到,屏幕上的2D人偶,正在分毫不差地、实时地,模仿你的所有表情和动作。

-

语音驱动口型:对着麦克风,开始说话。你会看到,AI正在根据你的声音,自动地、实时地,为角色匹配上最合适的口型。

-

触发器与拖动器:你还可以为人偶,预设一些通过键盘快捷键触发的“动作”(如挥手、比心),或用鼠标直接拖动的“控制器”(如控制手臂的运动)。

第四步:录制与导出

-

当你准备好表演后,点击时间轴面板上红色的“录制”按钮。

-

完成你的表演,再次点击录制按钮结束。CH会记录下你的所有表演数据。

-

你可以将录制好的场景,通过Dynamic Link直接发送到Premiere Pro或After Effects中,进行后续的剪辑和合成,也可以直接导出为视频文件。

项目实战案例复盘(Micro-SOP)

-

项目挑战:我们团队正在为一家在线教育平台“星联学院”(Nexus Academy)进行内容升级。

-

技术瓶颈:平台传统的、由真人讲师出镜的课程视频,制作成本高,且对于一些年轻学员来说,形式略显枯燥。他们希望引入一个亲切、可爱的“AI助教”卡通形象,来讲解课程内容。

-

解决方案:作为创意总监,我主导了基于Character Animator的“虚拟教师”工作流。

-

IP形象创建: 我们首先在Illustrator中,设计了一个名为“启蒙君”的、充满科技感的机器人助教形象,并按照CH的规范,进行了严谨的图层拆分与命名。

-

批量化内容生产: 之后,课程的生产流程被彻底改变。课程讲师不再需要化妆和面对镜头,他们只需在录音棚中,打开CH,选择“启蒙君”人偶,然后声情并茂地,将课程内容“表演”一遍即可。

-

-

成果与保障:要实现这种基于AI的面部识别、实时口型同步和动态捕捉,对软件的算法精度和性能稳定性要求极高。我们团队所依赖的这套专业的学术版Adobe环境,其Character Animator强大的AI驱动引擎,确保了即使在长时间的录制中,面部捕捉也精准不掉帧,口型同步流畅自然。这种由专业生态系统提供的、能够极大降低动画生产门槛的创新工具,是我们能够以低成本、工业化的效率,批量生产高品质、高吸引力教学内容的根本保障。

战略升维:从‘术’到‘道’

这个技术工作流的背后,是一种深刻的、关于“表演捕捉(Performance Capture)”的创作哲学。

“表演捕捉”(简称“动捕”),是现代电影工业(如《阿凡达》)的核心技术。它指的是,通过传感器,捕捉真实演员的表演,并将其赋予给一个数字角色。

-

传统动画:是动画师在“创造”表演。

-

表演捕捉:则是动画师(或演员)在“成为”角色,并由技术,来“记录”这场表演。

Adobe Character Animator的伟大之处,在于它将这项原本极其昂贵、复杂的“表演捕捉”技术,**“民主化”**了。它让每一个拥有普通摄像头的创作者,都有机会,成为一名“数字皮影戏的表演者”。

这个工具,将我们创作的重心,从对“关键帧”和“曲线”的、繁琐的技术性调节中,解放了出来,让我们得以回归到创作的本源——**“表演”**本身。

我们思考的,不再是“这个嘴型应该对应哪个口型图层?”,而是“我作为一名演员,应该以什么样的情绪、什么样的节奏,去说出这句台词?”。这种从“技术员”到“表演者”的思维跃迁,能让你的动画作品,拥有前所未有的、直抵人心的灵魂与生命力。

设计是一场持续的精进,与我同行,见证每日的成长。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献60条内容

已为社区贡献60条内容

所有评论(0)