Qwen3-VL-8B-Instruct-FP8震撼发布:FP8量化技术赋能多模态大模型高效部署新纪元

多模态人工智能领域再添重磅突破!Qwen3-VL-8B-Instruct-FP8作为Qwen3-VL-8B-Instruct模型的量化版本,凭借创新的细粒度FP8量化技术(块大小128),在保持与原始BF16模型性能几乎一致的前提下,显著降低了部署门槛。作为当前Qwen系列中性能最强的视觉语言模型,Qwen3-VL实现了全方位的能力跃升,为从边缘设备到云端的多样化应用场景提供了强大支撑。## ..

Qwen3-VL-8B-Instruct-FP8震撼发布:FP8量化技术赋能多模态大模型高效部署新纪元

多模态人工智能领域再添重磅突破!Qwen3-VL-8B-Instruct-FP8作为Qwen3-VL-8B-Instruct模型的量化版本,凭借创新的细粒度FP8量化技术(块大小128),在保持与原始BF16模型性能几乎一致的前提下,显著降低了部署门槛。作为当前Qwen系列中性能最强的视觉语言模型,Qwen3-VL实现了全方位的能力跃升,为从边缘设备到云端的多样化应用场景提供了强大支撑。

架构创新与版本矩阵:灵活适配全场景部署需求

Qwen3-VL系列采用"双架构+多版本"的灵活设计策略,提供密集型(Dense)和混合专家(MoE)两种基础架构,可根据算力条件从边缘终端平滑扩展至云端服务器。模型版本方面,除基础版外,还特别推出指令微调(Instruct)和推理增强(Thinking)两大优化版本,前者针对实际业务场景的指令交互进行深度优化,后者则强化了复杂逻辑推理能力,实现了"按需选择、精准部署"的产业级应用目标。

如上图所示,该架构图清晰呈现了Qwen3-VL的多模态处理流程,包括视觉编码器与语言模型解码器的协同工作机制,以及文本、图像、视频等不同类型输入的处理路径。这一架构设计充分体现了模型在多模态融合方面的技术突破,为开发者理解模型工作原理、进行二次开发提供了直观参考。

如上图所示,该架构图清晰呈现了Qwen3-VL的多模态处理流程,包括视觉编码器与语言模型解码器的协同工作机制,以及文本、图像、视频等不同类型输入的处理路径。这一架构设计充分体现了模型在多模态融合方面的技术突破,为开发者理解模型工作原理、进行二次开发提供了直观参考。

八大核心能力升级:重新定义多模态智能边界

Qwen3-VL的核心能力提升体现在八个关键维度,构建起全面领先的多模态智能体系:

1. 视觉智能体:实现GUI界面的智能交互与任务自动化

模型具备操作PC/移动设备GUI界面的能力,能够精准识别界面元素、理解功能逻辑,并调用相关工具完成复杂任务,推动视觉语言模型从"认知"向"操作"跨越。

2. 视觉编码增强:打通图像到代码的直接转换

创新的视觉编码技术使模型能从图像或视频直接生成可编辑的Draw.io流程图及HTML/CSS/JS前端代码,为UI/UX设计、网页开发等领域提供了高效的自动化工具。

3. 高级空间感知:2D定位与3D推理的深度融合

通过精确判断物体位置、视角关系和遮挡情况,模型不仅实现了更强的2D空间定位,还支持3D空间推理,为具身AI和机器人视觉导航奠定了基础。

4. 超长上下文与视频理解:突破长时序数据处理瓶颈

原生支持256K上下文长度(可扩展至1M),能够完整处理整本书籍和数小时长视频,实现内容的精确回忆与秒级索引,为教育、影视分析等场景提供强大支持。

5. 增强的多模态推理:STEM领域的逻辑分析专家

在科学、技术、工程和数学(STEM)领域表现卓越,擅长复杂因果分析和基于证据的逻辑推理,为科研辅助和教育答疑提供了智能化解决方案。

6. 万物识别系统:超广谱视觉认知能力

依托更广泛、更高质量的预训练数据,模型实现了"万物识别"能力,覆盖名人、动漫角色、商品、地标建筑、动植物等海量视觉对象的精准识别。

7. 全球化OCR引擎:32种语言的精准文本提取

OCR功能全面升级,支持语言种类从19种扩展至32种,在低光照、模糊、倾斜等复杂场景下表现稳健,对生僻字、古文字和专业术语的识别准确率显著提升,同时增强了长文档的结构解析能力。

8. 无缝文本-视觉融合:语言理解能力的无损迁移

模型文本理解能力媲美纯语言大模型,实现了文本与视觉信息的无缝融合,确保多模态输入下的统一理解与精准响应。

技术突破与性能表现:三大创新架构支撑卓越体验

Qwen3-VL在技术架构上实现三大创新:Interleaved-MRoPE位置嵌入技术通过在时间、宽度和高度维度的全频率分配,显著增强了长时视频推理能力;DeepStack技术融合多级ViT特征,有效捕捉图像细粒度细节并提升图文对齐精度;文本-时间戳对齐机制则超越传统T-RoPE方法,实现视频中事件的精确时间定位,大幅提升了时序建模能力。

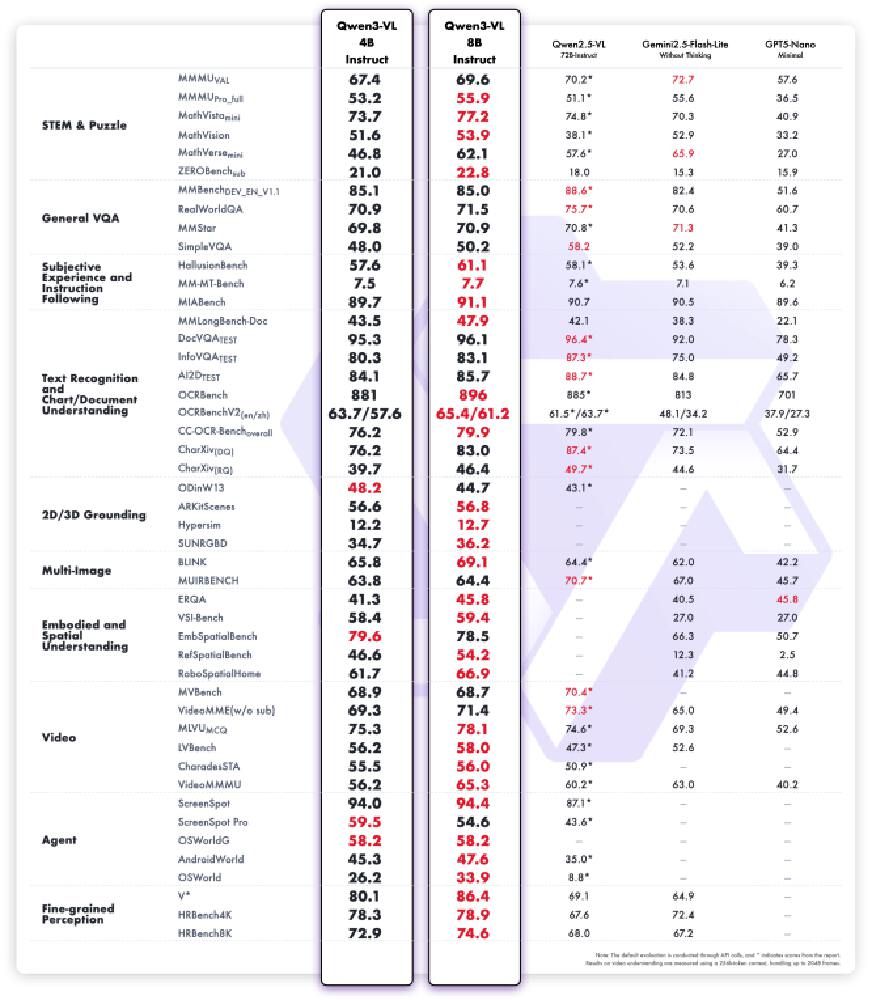

该性能对比图表全面展示了Qwen3-VL系列模型在STEM任务、视觉问答(VQA)、文本识别和视频理解等关键维度的表现,并与前代产品Qwen2.5-VL及竞品Gemini2.5-Flash-Lite进行了横向对比。这一数据直观呈现了Qwen3-VL-8B-Instruct-FP8在保持轻量化优势的同时所达到的性能高度,为企业选型提供了权威参考依据。

该性能对比图表全面展示了Qwen3-VL系列模型在STEM任务、视觉问答(VQA)、文本识别和视频理解等关键维度的表现,并与前代产品Qwen2.5-VL及竞品Gemini2.5-Flash-Lite进行了横向对比。这一数据直观呈现了Qwen3-VL-8B-Instruct-FP8在保持轻量化优势的同时所达到的性能高度,为企业选型提供了权威参考依据。

部署指南与未来展望:从实验室到产业界的高效落地

在部署方面,目前🤗Transformers库暂不支持直接加载该模型权重,官方推荐使用vLLM或SGLang进行高效部署,并提供了完整的推理代码示例和经过优化的生成超参数设置。开发者可通过Gitcode仓库(https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-8B-Instruct-FP8)获取相关资源。

Qwen3-VL-8B-Instruct-FP8的发布,标志着多模态大模型在保持高性能的同时,向轻量化、低成本部署迈出了关键一步。随着量化技术的不断成熟和部署工具链的完善,我们有理由相信,Qwen3-VL系列将在智能交互、内容创作、工业质检、自动驾驶等众多领域掀起智能化变革,为千行百业的数字化转型注入新的动力。未来,随着模型在具身智能和多模态推理方向的持续优化,人机协作的边界将被进一步打破,开启更智能、更自然的人工智能应用新纪元。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献26条内容

已为社区贡献26条内容

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-8B-Instruct-FP8

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-VL-8B-Instruct-FP8

所有评论(0)