Langchain4j学习(2)

这次主要学习了如何分别接入线上的大模型(deepseek)与部署到本地的大模型(用ollama部署)

书接上回,上一篇文章学习了Langchain4j的基本功能与基本实现,这篇文章是继续介绍Langchain4j,介绍如何分别接入线上的大模型(deepseek)与部署到本地的大模型(用ollama部署)

1.背景与需求

在实际企业应用中,我们常需要:

灵活切换不同大模型(如线上API与本地部署)

兼顾成本与隐私(敏感数据用本地模型,一般任务用云端API)

统一开发接口(避免为每个模型写不同代码)

LangChain4j 作为Java生态的LangChain实现,完美支持这一需求。本文将演示:

接入线上DeepSeek API

集成本地Ollama部署的Llama3

用统一接口调用不同模型

2.接入线上的大模型(以deepseek为例)

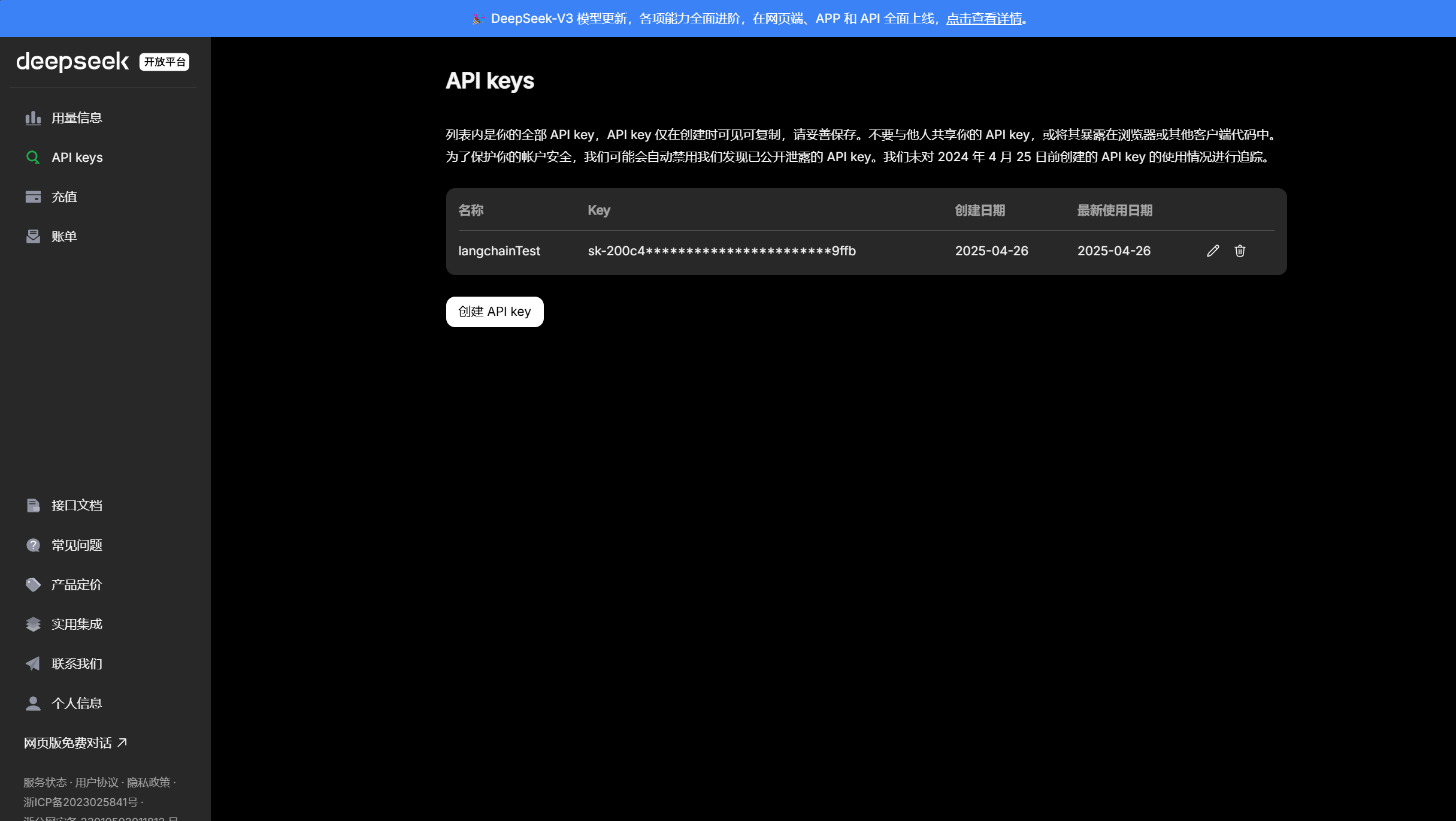

首先我们要先去deepseek官网上去获取相关配置信息DeepSeek 开放平台

登录后,可以冲一个一块钱进去方便后续调用api,在这里获取你的api_key后我们就可以回idea进行deepseek接入了

其实没什么差别就是配置文件改一下

langchain4j.open-ai.chat-model.base-url=https://api.deepseek.com/v1 # OpenAI API key langchain4j.open-ai.chat-model.api-key=你的api_key langchain4j.open-ai.chat-model.model-name=deepseek-reasoner

同样使用上次的测试方法

//使用langchain4j-open-ai-spring-boot-starter依赖后,再在properties中配置好OpenAI的key和模型名称,就可以直接注入OpenAiChatModel,然后调用chat方法

@Autowired

private OpenAiChatModel openAiChatModel;

@Test

public void testGPTSpringbootDemo(){

String chat = openAiChatModel.chat("你好,你是谁");

System.out.println(chat);

}就可以得到回答信息

3.部署到本地的大模型(用ollama部署)

部署过程在我的另一篇博客里,大家可以去看一下

部署后同样要改配置文件

# 设置langchain4j.ollama.chat-model的base-url为http://localhost:11434 langchain4j.ollama.chat-model.base-url=http://localhost:11434 # 设置langchain4j.ollama.chat-model的model-name为deepseek-r1:1.5b langchain4j.ollama.chat-model.model-name=deepseek-r1:1.5b # 设置langchain4j.ollama.chat-model的temperature为0.8 langchain4j.ollama.chat-model.temperature=0.8 # 设置langchain4j.ollama.chat-model的timeout为PT60S langchain4j.ollama.chat-model.timeout=PT60S

这次稍微有点不一样,应该由于是本地所以没有api_key

测试方法同样不一样,注入的Model就不一样

@Autowired

private OllamaChatModel ollamaChatModel;

@Test

public void testOllamaDemo() {

String chat = ollamaChatModel.chat("你好,你是谁?");

System.out.println(chat);

}大家同样可以测试一下

对比与选型建议

维度 DeepSeek(线上) Ollama(本地)

延迟 低(依赖网络质量) 中高(依赖本地算力)

成本 按Token付费 一次性硬件投入

隐私性 数据需传输到云端 完全本地处理

适用场景 通用问答、快速原型 敏感数据、定制化模型

结语

这次主要学习了如何分别接入线上的大模型(deepseek)与部署到本地的大模型(用ollama部署)

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)