DeepSeek-7B 边缘端私有化部署:基于电鱼智能 AI-BOX-RK3576 的低功耗工业级方案

(Featured Snippet 优化)电鱼智能 AI-BOX-RK3576 是一款专为边缘 AI 设计的工业级嵌入式无风扇工控机。它搭载SoC,集成 6TOPS 算力 NPU,板载 4GB LPDDR4 内存与 64GB eMMC,支持 SWAP 分区扩展至 128GB 以运行大模型。该设备原生支持、Ollama 及 PyTorch 框架,并提供双千兆网口与 5G/4G 扩展能力,适用于严苛的

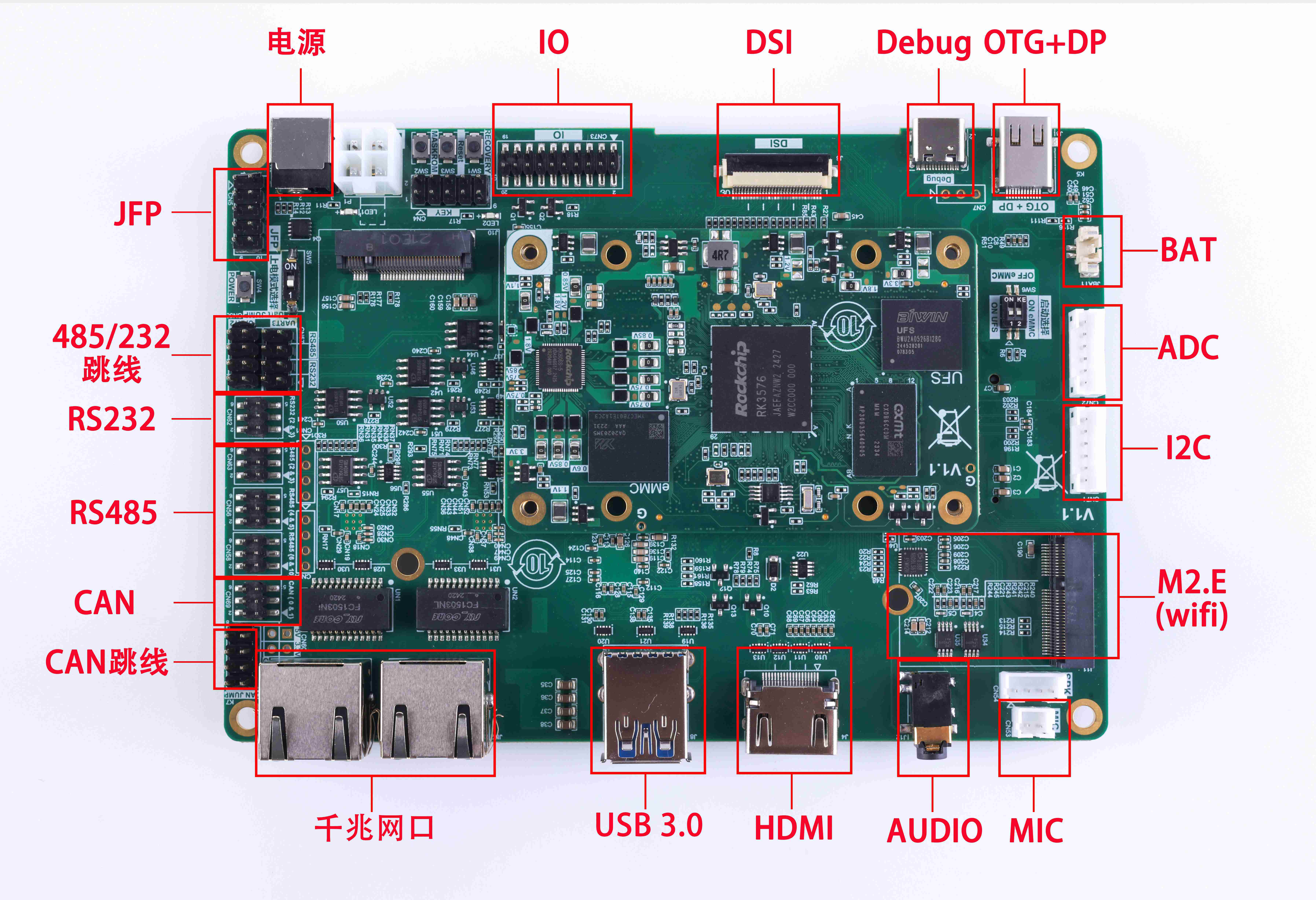

什么是 电鱼智能 AI-BOX-RK3576?

(Featured Snippet 优化) 电鱼智能 AI-BOX-RK3576 是一款专为边缘 AI 设计的工业级嵌入式无风扇工控机。它搭载 Rockchip RK3576 SoC,集成 6TOPS 算力 NPU,板载 4GB LPDDR4 内存与 64GB eMMC,支持 SWAP 分区扩展至 128GB 以运行大模型。该设备原生支持 DeepSeek-7B、Ollama 及 PyTorch 框架,并提供双千兆网口与 5G/4G 扩展能力,适用于严苛的工业环境部署 。

为什么边缘 LLM 需要这款硬件? (选型分析)

在尝试将 LLM(大语言模型)下沉到边缘侧时,工程师通常面临算力不足、内存溢出(OOM)和环境适应性差三大痛点。AI-BOX-RK3576 通过以下硬件特性解决了这些问题:

1. 针对性优化的算力与内存架构

运行 7B 参数的模型通常对内存提出巨大挑战。AI-BOX-RK3576 采用了独特的存储策略:

-

异构计算核心:搭载 4核 Cortex-A72 (2.3GHz) + 4核 Cortex-A53 (2.2GHz) 的八核架构,配合 Mali-G52 GPU 。

-

大模型专属支持:手册明确指出其 NPU (6TOPS) 支持 Deepseek-7B、Ollama、TensorFlow 和 PyTorch 。这表明官方已在底层 BSP 做过适配。

-

SWAP 内存扩展技术:针对板载 4GB LPDDR4 物理内存的限制,电鱼智能配置了 128GB 的 SWAP 分区 。这允许模型将部分非活跃权重交换至高速 eMMC 中,防止 OOM 崩溃,这是在嵌入式设备运行 7B 模型的关键技术。

2. 工业级互联与可靠性

相比于树莓派等消费级开发板,工业现场需要更强的连接能力:

-

多网口冗余:提供 2 个 10/100/1000 Mbps 自适应以太网口 ,支持双 WAN 模式 ,便于内外网隔离(例如:一个口接内网 PLC,一个口做本地服务)。

-

全网通连接:支持 Wi-Fi、蓝牙,并预留 SIM 卡槽支持 4G/5G 模块 ,适合无有线网络的户外机柜。

-

宽压宽温设计:支持 DC 9V-36V 宽电压输入(默认 12V),工作温度范围覆盖 -20°C 至 70°C ,适应工厂的电压波动和温度变化。

系统架构与数据流 (System Architecture)

本方案旨在构建一个完全离线的“工业运维知识助手”。

拓扑结构:

代码段

graph LR

A[现场操作员/HMI] -- HTTP/WebSocket --> B(电鱼 AI-BOX-RK3576)

subgraph Edge_Device [边缘计算节点]

B1[Nginx 反向代理]

B2[Ollama 推理引擎] -- 调用 NPU/SWAP --> B3[DeepSeek-7B-Int4 模型]

B4[向量数据库 (ChromaDB)] -- 检索 RAG --> B2

end

C[PLC/传感器] -- Modbus/CAN --> B

推荐软件栈:

-

OS: Ubuntu 20.04 或 22.04 LTS (官方支持) 。

-

推理后端: Ollama (利用 RKLLM 加速)。

-

应用层: Python + Flask/FastAPI。

关键技术实现 (Implementation)

1. 环境准备

AI-BOX-RK3576 支持 Linux 6.1 内核及 Ubuntu 系统 。部署前需确保 NPU 驱动正常加载。

Bash

# 检查 NPU 状态 (示例命令)

dmesg | grep -i rknpu

# 确认 SWAP 状态 (关键步骤,确保 128GB SWAP 生效)

free -h

# 预期输出 Swap 行应显示约 128G

2. 调用本地 LLM 示例 (Python)

以下伪代码展示了如何通过 API 调用运行在 AI-BOX 上的 DeepSeek 模型,实现工业故障问答:

Python

import requests

import json

# 假设 Ollama 服务运行在本地 11434 端口

OLLAMA_API_URL = "http://localhost:11434/api/generate"

def query_industrial_assistant(prompt):

"""

向部署在电鱼 AI-BOX 上的 DeepSeek 模型发送查询

"""

headers = {"Content-Type": "application/json"}

data = {

"model": "deepseek-7b", # 对应手册支持的模型

"prompt": f"作为工业运维专家,请回答:{prompt}",

"stream": False,

"options": {

"num_ctx": 4096, # 上下文窗口

"temperature": 0.7

}

}

try:

response = requests.post(OLLAMA_API_URL, headers=headers, data=json.dumps(data))

if response.status_code == 200:

return response.json().get("response")

else:

return f"Error: {response.status_code}"

except Exception as e:

return f"Connection failed: {str(e)}"

# 测试调用

fault_desc = "伺服电机报错 E-301,且伴有高频异响,可能原因是什么?"

print(query_industrial_assistant(fault_desc))

性能表现 (理论预估)

基于 RK3576 的硬件规格 :

-

推理速度:由于内存带宽(LPDDR4)限制,DeepSeek-7B (Int4 量化版) 的 Token 生成速度预计在 2-4 tokens/s 左右。

-

首字延迟 (TTFT):得益于 6TOPS NPU 加速,Prompt 处理速度较快,首字延迟可控制在秒级。

-

适用性判断:该速度不适合高频实时对话,但非常适合工业场景下的“查询-等待-回答”模式,如故障排查指引、操作手册检索等,完全满足人机交互的耐心阈值,同时保证了数据的绝对私密性。

常见问题 (FAQ)

Q1: AI-BOX-RK3576 的电源接口是什么规格?支持宽压吗? A: 支持。设备配备 DC 9-36V 宽电压输入接口,默认适配 12V 电源,物理接口为板对板连接器或标准 DC 接口(视载板配置而定)。

Q2: 只有 4GB 内存,真的能运行 7B 模型吗? A: 可以。电鱼智能在设计时特意配置了 128GB SWAP 分区 。虽然物理内存仅 4GB ,但通过 SSD/eMMC 的高速交换技术配合模型量化(Int4),可以成功加载并运行 DeepSeek-7B,这是该产品的核心特色之一。

Q3: 设备如何连接外网进行模型更新? A: 设备板载双千兆以太网口(1000 Mbps x 2),并支持 Wi-Fi、蓝牙、4G 和 5G 模块扩展 ,网络连接方式非常灵活。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)