【AI论文】WebExplorer:面向长周期网页智能体训练的探索与演进框架

大型语言模型(LLMs)的范式正日益转向智能体应用,其中网页浏览能力对于从各类在线资源中检索信息至关重要。然而,现有的开源网页智能体要么在复杂任务上展现出的信息检索能力有限,要么缺乏透明化的实现方式。在本研究中,我们发现关键挑战在于缺乏用于信息检索的具有挑战性的数据。为解决这一局限,我们推出了WebExplorer:一种采用基于模型的探索和迭代式长-短查询演进的系统化数据生成方法。该方法创建了具有

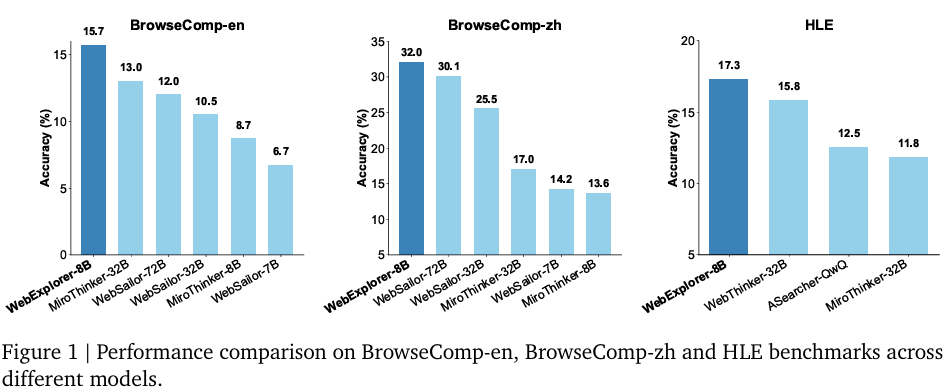

摘要:大型语言模型(LLMs)的范式正日益转向智能体应用,其中网页浏览能力对于从各类在线资源中检索信息至关重要。然而,现有的开源网页智能体要么在复杂任务上展现出的信息检索能力有限,要么缺乏透明化的实现方式。在本研究中,我们发现关键挑战在于缺乏用于信息检索的具有挑战性的数据。为解决这一局限,我们推出了WebExplorer:一种采用基于模型的探索和迭代式长-短查询演进的系统化数据生成方法。该方法创建了具有挑战性的查询-答案对,这些查询-答案对需要多步推理和复杂的网页导航。通过利用我们精心策划的高质量数据集,我们通过监督微调结合强化学习,成功开发出先进的网页智能体WebExplorer-8B。该模型支持128K上下文长度和最多100轮工具调用,能够实现长周期问题求解。在各类信息检索基准测试中,WebExplorer-8B在其规模级别上达到了最先进的性能。值得注意的是,作为一个80亿参数规模的模型,WebExplorer-8B在经过强化学习训练后,能够平均在16轮以上有效进行搜索,在BrowseComp-en/zh任务上的准确率高于WebSailor-72B,并在WebWalkerQA和FRAMES任务上超越了参数规模多达1000亿的模型,取得最佳性能。除了这些信息检索任务外,尽管我们的模型仅在知识密集型问答数据上进行训练,但它在HLE基准测试中也展现出了强大的泛化能力。这些结果凸显了我们的方法为开发长周期网页智能体提供了一条切实可行的路径。Huggingface链接:Paper page,论文链接:2509.06501

研究背景和目的

研究背景:

随着大型语言模型(LLMs)技术的快速发展,其在信息检索、问答系统等任务中的应用日益广泛。然而,现有的开源网络代理(web agents)在处理复杂任务时表现出有限的信息检索能力,且缺乏透明度高的实现。特别是在需要多步推理和复杂网络导航的任务中,现有模型的表现往往不尽如人意。当前,训练这类模型的主要瓶颈在于缺乏具有挑战性的信息检索数据。尽管已有一些公开的数据集和基准测试,如BrowseComp-en/zh、WebWalkerQA等,但这些数据集要么规模有限,要么查询的复杂度不足以匹配评估基准的难度。此外,传统的数据生成方法,如图结构构建和进化方法,也存在局限性,如节点扩展和选择策略的复杂性,以及查询复杂度提升的有限性。

研究目的:

本研究旨在解决现有开源网络代理在处理复杂信息检索任务时的局限性,提出一种名为WebExplorer的系统方法,通过模型驱动的探索和迭代查询演化,生成具有挑战性的查询-答案对(QA pairs),以训练更高效、更强大的网络代理。具体目标包括:1)开发一种能够自主探索信息空间并生成复杂查询-答案对的系统方法;2)利用生成的QA数据集,通过监督微调和强化学习训练出具有长程规划能力的网络代理;3)在多个信息检索基准测试上验证所提方法的有效性,并展示其相对于现有模型的优越性。

研究方法

1. 数据生成方法:

- 模型驱动的探索:从种子实体出发,利用强大的LLMs模拟图构建过程,通过迭代搜索和浏览操作,动态地探索与种子实体相关的信息空间。这种方法避免了传统图结构构建的复杂性,如节点扩展和选择策略的设计。

- 迭代查询演化:在生成初始QA对后,通过系统性地去除显著信息和引入策略性模糊,增加查询的复杂度。这一过程模拟了BrowseComp等基准测试的设计原则,生成需要更多探索和推理步骤的查询。

2. 训练方法:

- 监督微调(SFT):使用生成的QA数据集对基础模型(如Qwen3-8B)进行冷启动初始化,使模型学会调用搜索和浏览工具,并发展出基本的长期搜索能力。

- 强化学习(RL):采用GRPO算法进行强化学习,进一步提升模型的推理能力。在RL训练过程中,逐步增加上下文长度和工具调用轮数的限制,使模型能够处理更复杂的任务。

3. 评估方法:

- 使用多个信息检索基准测试(如BrowseComp-en/zh、GAIA、WebWalkerQA等)对模型进行评估,确保评估结果的全面性和客观性。

- 采用LLM-as-Judge评估方式,利用强大的LLM(如DeepSeek-V3.1)作为评估器,对模型生成的答案进行评分,确保评估的准确性和一致性。

研究结果

1. 数据集质量:

- 通过模型驱动的探索和迭代查询演化,成功生成了约40K个具有挑战性的QA对,这些QA对在复杂度和工具调用轮数上显著优于现有数据集,更接近真实世界中复杂查询的特征。

2. 模型性能:

- 在多个信息检索基准测试上,WebExplorer-8B模型展现了卓越的性能。特别是在BrowseComp-en和BrowseComp-zh上,WebExplorer-8B的准确率分别达到了15.7%和32.0%,显著优于其他同规模或更大规模的模型。

- 除了信息检索任务外,WebExplorer-8B在学术基准测试HLE上也展现了强大的泛化能力,得分17.3%,超过了之前的32B模型WebThinker-32B。

3. 训练效果:

- 强化学习过程中,模型的工具调用轮数和轨迹长度稳步增加,表明模型学会了更复杂的多步推理策略。随着上下文长度和最大调用轮数的扩展,模型在BrowseComp-en和BrowseComp-zh上的性能持续提升,证明了RL训练的有效性。

研究局限

1. 数据生成局限:

- 尽管WebExplorer方法能够生成具有挑战性的QA对,但这些数据仍然基于人工设计的示例和种子实体,可能无法完全覆盖所有实际场景中的复杂查询。

- 生成的查询在某些情况下可能过于复杂,导致评估时模型的表现受到查询理解能力的限制。

2. 模型局限:

- 尽管WebExplorer-8B在多个基准测试上展现了优越性能,但其规模(8B参数)仍限制了其在处理极其复杂任务时的能力。

- 模型的性能高度依赖于基础模型的选择和RL训练的细节,不同的基础模型和训练策略可能导致结果差异。

3. 评估局限:

- 当前评估主要依赖于LLM-as-Judge方法,尽管这种方法在现有研究中广泛应用,但其主观性和潜在的偏见仍可能影响评估结果的准确性。

- 评估基准的覆盖范围有限,可能无法全面反映模型在所有实际场景中的性能。

未来研究方向

1. 数据生成优化:

- 探索更高效的数据生成方法,如结合人类反馈的强化学习(RLHF),以生成更符合实际需求的复杂查询。

- 扩展种子实体的多样性,覆盖更多领域和场景,以提高生成数据的广泛性和包容性。

2. 模型改进:

- 研究更大规模的模型在WebExplorer方法下的性能表现,探索参数规模与模型能力之间的关系。

- 结合其他先进技术,如多模态学习、迁移学习等,进一步提升模型的推理和泛化能力。

3. 评估方法创新:

- 开发更客观、全面的评估体系,结合人类评估和自动化评估方法,确保评估结果的准确性和可靠性。

- 探索新的基准测试,覆盖更多实际场景中的复杂任务,以更全面地评估模型的性能。

4. 应用场景拓展:

- 将WebExplorer方法应用于其他需要复杂推理和长期规划的任务中,如智能助手、自动驾驶等,探索其更广泛的应用潜力。

- 结合具体应用场景,定制化生成数据和训练模型,以满足不同领域的特定需求。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献228条内容

已为社区贡献228条内容

所有评论(0)