OpenCV与ZBar条形码定位与识别实战教程

首先,要使用ZBar库,需要在其官方网站或通过包管理器安装ZBar库。对于大多数Linux发行版,可以通过包管理器快速安装。例如,在Ubuntu系统中,可以使用以下命令安装ZBar库:对于Windows系统,需要下载预编译的二进制文件或从源代码构建ZBar库。从源代码构建ZBar库需要确保所有依赖项都已正确安装,并在编译过程中遵守特定的编译指示。

简介:本文介绍了使用OpenCV和ZBar库进行条形码定位和识别的技术细节。首先,探讨了OpenCV在图像预处理和特征检测中的应用,例如边缘检测和霍夫变换。接着,说明了如何使用ZBar库对定位到的条形码进行解码,包括对不同类型条码的识别。教程还强调了在实际应用中考虑光照和拍摄角度等外部因素的重要性,并提供了改进识别准确性的策略。

1. OpenCV图像处理与计算机视觉算法

在现代计算机视觉领域,OpenCV(Open Source Computer Vision Library)作为一款开源的计算机视觉和机器学习软件库,已经成为了图像处理和视觉应用不可或缺的工具之一。本章将概述OpenCV的核心功能,为后文深入探讨图像处理和计算机视觉算法打下基础。

1.1 OpenCV核心功能概览

OpenCV的核心功能涵盖了广泛的图像处理操作,包括但不限于图像的读取与保存、像素级别的操作、几何变换、颜色空间转换、形态操作、滤波与平滑、特征检测、运动分析、对象追踪以及立体视觉等。

1.2 计算机视觉基础概念

计算机视觉旨在使计算机能够“理解”数字图像和视频中的内容。这一领域包括多个子领域,例如图像分割、特征提取、图像分析、三维重建、运动分析等。每项技术都有其特定的应用场景,例如在机器人导航中使用运动分析,在医疗图像分析中使用三维重建。

1.3 OpenCV在条形码识别中的应用

在条形码识别中,OpenCV可以用于多种处理步骤,从图像的预处理到最终的条形码解码。例如,通过灰度化、二值化、边缘检测、霍夫变换等图像处理技术,可以帮助我们更准确地定位和识别条形码。后续章节将详细介绍这些技术如何具体应用到条形码识别的过程中。

这一章为读者们提供了OpenCV的基础知识,并为下一章深入条形码识别技术做好了铺垫。

2. 条形码定位技术:边缘检测、轮廓查找、霍夫变换

2.1 边缘检测基础

2.1.1 边缘检测的概念

边缘检测是图像处理领域中的一项基础技术,它主要用来识别图像中亮度变化明显的点。图像中的边缘通常是图像亮度发生剧烈变化的地方,这些变化通常对应于场景中物体的边界。在条形码识别过程中,边缘检测有助于定位条形码的边界,从而为后续的识别过程提供准确的区域定位。

边缘检测通常通过计算图像的导数来实现,这是因为图像中的边缘部分通常对应着灰度的突变,而导数的极值点正好可以反映这种变化。常用的边缘检测算法包括Sobel算法、Canny算法、Prewitt算法等。

2.1.2 常见的边缘检测算子

边缘检测算子可以分为一阶算子和二阶算子两类。一阶算子主要通过计算图像的梯度来实现边缘检测,比如Sobel和Prewitt算子;二阶算子则通过计算图像二阶导数的零交叉点来确定边缘位置,比如Laplacian算子。

- Sobel算子 :是图像处理中常用的一种一阶边缘检测算子,通过计算水平和垂直两个方向的梯度强度来定位边缘。Sobel算子利用加权平均的方式平滑图像并强调边缘,通常在边缘检测后会得到较为平滑的边缘线。

import cv2

import numpy as np

# Sobel算子检测边缘示例代码

image = cv2.imread('barcode.jpg', cv2.IMREAD_GRAYSCALE)

sobel_x = cv2.Sobel(image, cv2.CV_64F, 1, 0, ksize=5)

sobel_y = cv2.Sobel(image, cv2.CV_64F, 0, 1, ksize=5)

# 对结果进行归一化并显示

sobel_x = cv2.normalize(sobel_x, None, 0, 255, cv2.NORM_MINMAX, dtype=cv2.CV_8U)

sobel_y = cv2.normalize(sobel_y, None, 0, 255, cv2.NORM_MINMAX, dtype=cv2.CV_8U)

cv2.imshow('Sobel X', sobel_x)

cv2.imshow('Sobel Y', sobel_y)

cv2.waitKey(0)

cv2.destroyAllWindows()

上述代码展示了如何使用Python和OpenCV库来应用Sobel算子进行边缘检测。

- Canny算子 :是一种更为复杂的边缘检测算法,它使用了高斯滤波来降低噪声的影响,以及非极大值抑制来细化边缘,并通过双阈值和边缘跟踪来连接边缘片段。Canny算子因其能够提供准确且连续的边缘检测结果而被广泛应用于条形码识别等任务中。

2.2 轮廓查找与分析

2.2.1 轮廓查找技术

轮廓查找是指在图像中找到物体的边界线,并将这些边界线表示为轮廓的过程。在条形码定位技术中,轮廓查找可以用来确定条形码的大致位置和形状。在实际应用中,轮廓查找技术通常结合边缘检测技术使用,以提高轮廓查找的准确性。

OpenCV提供了 findContours 函数用于查找图像中的轮廓。该函数会返回一个列表,其中包含了图像中所有轮廓的点集。

import cv2

import numpy as np

# 轮廓查找示例代码

image = cv2.imread('barcode.jpg', cv2.IMREAD_GRAYSCALE)

_, binary_image = cv2.threshold(image, 127, 255, cv2.THRESH_BINARY)

contours, _ = cv2.findContours(binary_image, cv2.RETR_TREE, cv2.CHAIN_APPROX_SIMPLE)

# 在原图上绘制轮廓

cv2.drawContours(image, contours, -1, (0, 255, 0), 3)

cv2.imshow('Contours', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

上述代码展示了如何使用OpenCV的 findContours 函数查找轮廓,并在原图上绘制出来。

2.2.2 轮廓特征的提取

轮廓特征提取是将轮廓线中的信息转换为可用于分类或其他后续处理的特征。对于条形码识别,重要的特征包括轮廓的面积、周长、形状描述符等。通过对这些特征的分析,可以确定条形码的类型、状态(例如弯曲、倾斜)和质量。

通过轮廓特征提取,我们可以应用各种算法来优化条形码的定位和识别过程。例如,轮廓面积可以用来过滤掉非条形码的区域;轮廓的形状描述符可以用来验证识别出的条形码是否符合标准规范。

2.3 霍夫变换的应用

2.3.1 霍夫线变换原理

霍夫变换是一种强大的特征提取技术,特别适合于从图像中检测出直线或其他几何形状。在条形码定位中,霍夫变换被用来检测条形码中的直线边界,这对于定位倾斜或扭曲的条形码尤为重要。

霍夫变换利用图像空间到参数空间的映射原理。对于直线上每一点,它将在参数空间中形成一系列的投票,直线的参数(如斜率和截距)由得票最多的参数对来确定。在实际应用中,可以使用OpenCV中的 HoughLines 或 HoughLinesP 函数进行霍夫线变换。

2.3.2 霍夫变换在条形码定位中的实践

在条形码定位中应用霍夫变换时,我们通常先进行边缘检测,然后使用霍夫变换来提取直线信息。提取的直线可以帮助我们确定条形码的边界,进一步实现条形码的精确定位。

import cv2

import numpy as np

# 霍夫变换检测直线示例代码

image = cv2.imread('barcode.jpg', cv2.IMREAD_GRAYSCALE)

edges = cv2.Canny(image, 50, 150, apertureSize=3)

lines = cv2.HoughLines(edges, 1, np.pi/180, 200)

# 在原图上绘制检测到的直线

if lines is not None:

for rho, theta in lines[:, 0, :]:

a = np.cos(theta)

b = np.sin(theta)

x0 = a * rho

y0 = b * rho

x1 = int(x0 + 1000 * (-b))

y1 = int(y0 + 1000 * (a))

x2 = int(x0 - 1000 * (-b))

y2 = int(y0 - 1000 * (a))

cv2.line(image, (x1, y1), (x2, y2), (0, 0, 255), 2)

cv2.imshow('Hough Transform', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

上述代码展示了如何使用OpenCV的 HoughLines 函数进行霍夫线变换,并在原图上绘制检测到的直线。

通过上述二级章节的介绍,我们可以看到边缘检测、轮廓查找和霍夫变换这三种技术在条形码定位中的具体应用和它们之间的关联性。在实际的条形码识别系统中,这些技术通常是相互结合使用的,以提高识别的准确性与效率。接下来的章节将深入介绍图像预处理过程,包括灰度化、噪声去除和直方图均衡化,这些预处理步骤对于提升条形码识别系统整体性能至关重要。

3. 图像预处理:灰度化、噪声去除、直方图均衡化

图像预处理是条形码识别流程中至关重要的一步。它可以帮助改善图像质量,从而提升后续处理的准确性与效率。本章将深入探讨图像预处理中的关键步骤,包括灰度化、噪声去除和直方图均衡化。

3.1 图像灰度化处理

3.1.1 灰度化转换方法

图像灰度化处理是将彩色图像转换为灰度图像的过程。灰度图像仅包含亮度信息,不含色彩信息。常见的转换方法包括使用加权法、最大值法和平均值法等。

- 加权法:通过调整不同颜色通道的权重来实现灰度转换。

- 最大值法:将RGB三个通道中的最大值作为灰度值。

- 平均值法:取RGB三个通道的平均值作为灰度值。

下面是一个使用Python和OpenCV库进行灰度化转换的代码示例:

import cv2

# 读取图像

image = cv2.imread('path_to_image.jpg')

# 加权灰度化转换

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 显示灰度图像

cv2.imshow('Gray Image', gray_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在上述代码中, cv2.imread 用于读取图像, cv2.cvtColor 函数负责进行灰度转换,这里使用了默认的加权法。加权法中默认的权重为B(蓝色通道)0.0722,G(绿色通道)0.7152,R(红色通道)0.2126。

3.1.2 灰度化对条形码识别的影响

灰度化处理对条形码识别有着显著的影响。由于条形码是由黑白相间的条纹组成,灰度化能够消除颜色信息的干扰,使得条形码识别算法可以更专注于亮度对比。此外,灰度图像的数据量小于彩色图像,这可以减少算法的计算负担,提高识别速度。

3.2 噪声去除技术

噪声存在于图像中,可能会干扰条形码的识别。噪声去除技术旨在减少或消除这些干扰因素。

3.2.1 噪声类型及其影响

图像噪声主要分为两大类:加性噪声和乘性噪声。加性噪声包括高斯噪声、泊松噪声等;乘性噪声则包括斑点噪声等。这些噪声会降低图像的对比度和清晰度,导致条形码识别算法的解析能力下降。

3.2.2 各种去噪方法的比较与应用

去除噪声的方法有很多,常见的包括均值滤波、中值滤波和高斯滤波。均值滤波适用于去除高斯噪声,中值滤波能够有效地去除椒盐噪声,而高斯滤波则适用于平滑图像,同时减少噪声。

以下是一个使用OpenCV进行中值滤波的代码示例:

# 添加噪声

noisy_image = cv2.imread('path_to_noisy_image.jpg', 0)

# 应用中值滤波

denoised_image = cv2.medianBlur(noisy_image, 5)

# 显示去噪后的图像

cv2.imshow('Denoised Image', denoised_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在这个例子中,我们首先读取了一张带有噪声的图像,并使用 cv2.medianBlur 函数进行中值滤波去噪。

3.3 直方图均衡化的重要性

直方图均衡化是一种增强图像对比度的方法,它通过拉伸图像的直方图来增强整体的亮度对比。

3.3.1 直方图均衡化的原理

直方图均衡化通过调整图像的直方图分布来使图像具有更广的动态范围。这样,条形码的黑色条纹与白色背景之间的对比度会更加明显,有助于提高条形码的识别准确率。

以下是一个直方图均衡化的Python代码示例,它使用了OpenCV库:

# 读取图像

image = cv2.imread('path_to_image.jpg', 0)

# 应用直方图均衡化

equalized_image = cv2.equalizeHist(image)

# 显示均衡化后的图像

cv2.imshow('Equalized Image', equalized_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在这个例子中, cv2.equalizeHist 函数负责进行直方图均衡化处理。

3.3.2 在条形码识别中均衡化的作用

直方图均衡化使得图像的对比度得到提升,条形码的条纹与背景更加分明,从而帮助提高条形码的识别率。尤其在条形码图像受到光照不均或部分区域模糊的情况下,均衡化可以显著提高识别的准确性。

通过以上各节的介绍,我们可以看到图像预处理对于条形码识别流程的重要性。正确地应用灰度化、噪声去除和直方图均衡化技术,是确保条形码识别系统高效准确运行的关键所在。在下一章节中,我们将深入探讨ZBar库在条形码解码过程中的应用,以及如何通过它的API来提取和使用条形码数据。

4. ZBar库条形码解码功能及API使用

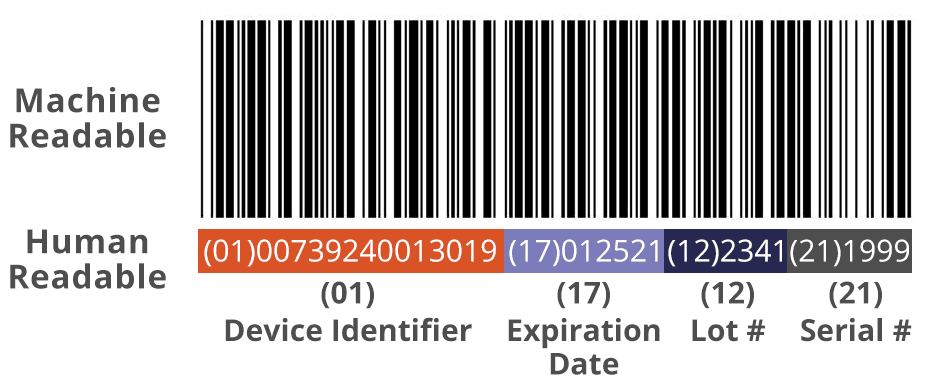

ZBar库是一个开源的、跨平台的条形码识别库,它可以识别多种类型的条形码,包括但不限于UPC、EAN、Code 128、QR Code等。在本章节中,我们将详细介绍ZBar库的安装、配置、主要功能与特性,以及深入探讨ZBar库API的使用方法,并通过实际案例来分析ZBar库在不同环境下的应用实例和解决实际问题的策略与技巧。

4.1 ZBar库概述

4.1.1 ZBar库的安装与配置

首先,要使用ZBar库,需要在其官方网站或通过包管理器安装ZBar库。对于大多数Linux发行版,可以通过包管理器快速安装。例如,在Ubuntu系统中,可以使用以下命令安装ZBar库:

sudo apt-get install libzbar0 libzbar-dev

对于Windows系统,需要下载预编译的二进制文件或从源代码构建ZBar库。从源代码构建ZBar库需要确保所有依赖项都已正确安装,并在编译过程中遵守特定的编译指示。

安装完成后,可以通过Python的pip包管理器安装PyZBar,这是一个Python库,封装了ZBar的C库,便于在Python项目中使用ZBar的功能:

pip install pyzbar

4.1.2 ZBar库的主要功能与特性

ZBar库的主要特点包括:

- 多平台支持 :ZBar可以在多种操作系统上运行,包括Linux、Windows和macOS。

- 支持多种条形码类型 :能够识别和解析多种一维和二维码。

- 性能高效 :ZBar提供了快速的条形码识别性能,适合实时处理场景。

- 易于集成 :提供简单易用的API接口,方便集成到各种应用程序中。

接下来,让我们深入了解ZBar库的API并展示如何利用它们来检测和解码图像中的条形码。

4.2 ZBar库API详解

4.2.1 扫描图像以检测条形码

要使用ZBar库检测图像中的条形码,首先需要导入 pyzbar.pyzbar 模块中的 decode 函数。以下是一个使用 decode 函数进行条形码检测的简单示例:

from PIL import Image

from pyzbar.pyzbar import decode

# 打开图像文件

image = Image.open('barcode_image.png')

# 使用ZBar的decode函数解析图像

barcodes = decode(image)

# 打印出检测到的每个条形码的相关信息

for barcode in barcodes:

print(f"Type: {barcode.type}")

print(f"Data: {barcode.data.decode('utf-8')}")

在上面的代码中, decode 函数接受一个图像对象,并返回一个包含条形码信息的列表。每个条形码信息包含类型( type )和数据( data )字段,其中 data 字段存储了被扫描条形码的原始数据。

4.2.2 提取条形码数据与类型信息

decode 函数返回的条形码对象还包含了条形码的类型信息,类型信息通过一个整数来表示,可以使用 pyzbar.pyzbar 中的 Barcode 类来将这个整数转换为一个更容易理解的字符串标识符。

from pyzbar.pyzbar import Barcode

# 假设我们有一个条形码类型整数

barcode_type_int = barcode.type

# 将整数转换为类型名称

barcode_type_name = Barcode.types[barcode_type_int]

print(f"Barcode Type: {barcode_type_name}")

通过 Barcode.types 字典,可以将整数类型的ID转换为对应的字符串标识符,如 'CODE_128' 或 'EAN_13' 。

接下来,我们来看看如何通过实际案例来分析ZBar库在不同环境下的应用实例以及解决实际问题的策略与技巧。

4.3 实际案例分析

4.3.1 ZBar在不同环境下的应用实例

ZBar库不仅可以在桌面应用程序中使用,也适用于各种服务器端应用程序。下面的例子展示了如何在Web服务器中集成ZBar库来处理上传的图像文件,并提取其中的条形码数据。

import os

from flask import Flask, request, send_file

from pyzbar.pyzbar import decode

app = Flask(__name__)

@app.route('/upload', methods=['POST'])

def upload_file():

if 'file' not in request.files:

return send_file('error.html')

file = request.files['file']

if file.filename == '':

return send_file('error.html')

if file:

# 保存文件

filepath = os.path.join('/path/to/save', file.filename)

file.save(filepath)

# 解码图像中的条形码

image = Image.open(filepath)

barcodes = decode(image)

# 将条形码数据作为JSON响应发送

return {

'success': True,

'data': [f"{barcode.data.decode('utf-8')} ({Barcode.types[barcode.type]})"

for barcode in barcodes]

}

if __name__ == '__main__':

app.run()

在这个Flask应用中,我们创建了一个 /upload 路由来处理文件上传,并使用ZBar库来检测图像中的条形码。检测结果以JSON格式返回给客户端。

4.3.2 解决实际问题的策略与技巧

在使用ZBar库时,可能会遇到一些实际问题,比如条形码质量不高导致识别失败。这种情况下,可以采取以下策略:

- 图像预处理 :在使用ZBar之前对图像进行预处理,比如调整亮度、对比度,应用高斯模糊来降低噪声。

- 调整ZBar参数 :ZBar的

decode函数接受一些可选参数,如threshold和polygon,调整这些参数有时可以提高识别成功率。 - 错误处理与重试逻辑 :在检测失败时,可以增加错误处理逻辑,提示用户重新上传图像,或自动重试检测过程。

通过以上策略,可以进一步提升条形码识别的准确性和健壮性。

在本章节中,我们介绍了ZBar库的安装与配置方法、主要功能与特性,以及深入探讨了如何使用ZBar库的API进行条形码解码,并通过实际案例分享了ZBar在不同环境下的应用实例和解决问题的策略与技巧。ZBar库为开发者提供了一套简洁而强大的工具,可以有效地处理条形码识别任务。

5. 条形码特征识别与模板匹配

5.1 条形码特征提取方法

条形码识别的第一步是提取条形码的关键特征,这些特征能准确地表达条形码的本质信息,并帮助后续的解析与识别。条形码作为一种线性编码系统,其核心特征主要集中在条码的宽窄比例、间距、排列方式等方面。

5.1.1 条形码的关键特征

条形码的关键特征主要包括:

- 条宽比 :条形码的条宽比是反映条形码数字信息的最主要特征。通常,每个数字或字符由若干个条和空组成,条和空的宽窄比例不同,可以代表不同的数字或字符信息。

- 条码结构 :条码的结构包括了起始符、终止符、数据符和校验符等部分。每个部分的编码规则都对条形码的识别至关重要。

- 条码的排列 :条码的排列方式可以是横排或纵排,正确的识别排列方向对于条码的后续处理同样重要。

5.1.2 特征提取技术的实现

要实现条形码的特征提取,我们需要应用图像处理技术,常用的步骤包括:

- 图像二值化 :将图像转换为只有黑和白两种颜色,便于后续的条形码分析。

- 边缘检测 :采用Sobel、Canny等边缘检测算子,寻找条形码的边界。

- 条宽测量 :对条形码图像进行扫描,统计不同宽度的条和空的数量,并将其转换为数字或字符信息。

示例代码

下面的代码展示了如何使用OpenCV进行条形码图像的二值化处理,这是特征提取的第一步。

import cv2

# 读取图像

image = cv2.imread('barcode.jpg')

# 转换为灰度图

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 使用阈值进行二值化处理

_, binary_image = cv2.threshold(gray_image, 127, 255, cv2.THRESH_BINARY_INV)

# 二值化图像可以直接用于条形码的特征提取

在上述代码中,我们首先导入了cv2模块,并读取了一张条形码图片。随后将其转换为灰度图像,并应用一个阈值将灰度图像转换为二值图像。这里使用的 cv2.THRESH_BINARY_INV 是二值化操作中的一种模式,它将图像中高于阈值的像素点转换为白色,低于阈值的转换为黑色。

5.2 模板匹配技术

模板匹配是一种在图像中寻找与给定小图像(模板)最匹配区域的方法。在条形码识别中,我们可以将条形码的一小段定义为模板,然后在整幅图像中寻找与其相似度最高的区域。

5.2.1 模板匹配基本原理

模板匹配通常涉及以下步骤:

- 选定一个模板图像。

- 在输入图像中移动这个模板,逐个像素地与输入图像的每个子区域进行比较。

- 计算模板与子区域之间的相似度,并将相似度作为分值记录。

- 移动模板,重复比较步骤,直到覆盖整个输入图像。

- 找出分值最高的位置,即模板最匹配的位置。

5.2.2 模板匹配在条形码识别中的应用

在条形码识别中,模板匹配可以用来确定条码的位置。当条形码的一部分被正确匹配后,可以通过预设的条形码结构和排列信息来辅助完整条形码的识别。

示例代码

以下代码演示了如何使用OpenCV进行模板匹配:

import cv2

import numpy as np

# 读取图像和模板

image = cv2.imread('image.jpg')

template = cv2.imread('template.jpg', 0)

# 获取模板大小

w, h = template.shape[::-1]

# 使用模板匹配算法

res = cv2.matchTemplate(image, template, cv2.TM_CCOEFF_NORMED)

# 定位最佳匹配位置

min_val, max_val, min_loc, max_loc = cv2.minMaxLoc(res)

# 计算偏移量

top_left = max_loc

bottom_right = (top_left[0] + w, top_left[1] + h)

# 在原始图像上绘制矩形表示匹配位置

cv2.rectangle(image, top_left, bottom_right, 255, 2)

# 显示结果

cv2.imshow('Matched Result', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

在这段代码中,我们首先读取了输入图像和模板图像,然后使用 cv2.matchTemplate 函数将模板图像与输入图像进行匹配。根据匹配结果,我们找到了最佳匹配的位置,并在原始图像上绘制了一个矩形框,标示出匹配区域。

5.3 特征匹配与定位

特征匹配是指通过比较图像之间的特征点,以识别对应关系的过程。在条形码识别中,特征匹配可以用来精确定位条形码的边缘和定位。

5.3.1 特征匹配算法的选择

为了提高条形码定位的准确性,选择合适的特征匹配算法至关重要。常用的算法包括:

- 尺度不变特征变换(SIFT) :适用于尺度变换和旋转不变性的情况。

- 加速鲁棒特征(SURF) :在SIFT的基础上进行了优化,提高了运算速度。

- ORB :一种快速的旋转不变的特征点检测和匹配算法。

5.3.2 提升匹配准确率的策略

提升特征匹配的准确率可以通过以下方法实现:

- 特征点筛选 :根据特征点的特征描述子,过滤掉质量不好的特征点。

- 匹配点筛选 :采用RANSAC算法等对匹配点对进行筛选,剔除异常值。

- 使用多尺度匹配 :在不同的尺度上进行特征点的检测和匹配,提高匹配的鲁棒性。

示例代码

以下代码展示了如何使用ORB算法进行特征点检测和匹配:

import cv2

import numpy as np

# 读取图像

img1 = cv2.imread('image1.jpg', cv2.IMREAD_GRAYSCALE)

img2 = cv2.imread('image2.jpg', cv2.IMREAD_GRAYSCALE)

# 初始化ORB检测器

orb = cv2.ORB_create()

# 检测关键点和描述子

kp1, des1 = orb.detectAndCompute(img1, None)

kp2, des2 = orb.detectAndCompute(img2, None)

# 创建BFMatcher对象

bf = cv2.BFMatcher(cv2.NORM_HAMMING, crossCheck=True)

# 进行匹配

matches = bf.match(des1, des2)

# 按照距离排序

matches = sorted(matches, key=lambda x: x.distance)

# 可视化前10个匹配项

img3 = cv2.drawMatches(img1, kp1, img2, kp2, matches[:10], None, flags=2)

cv2.imshow('Matches', img3)

cv2.waitKey(0)

cv2.destroyAllWindows()

在这段代码中,我们首先读取了两张图像,并使用ORB算法检测图像中的关键点和描述子。然后创建了 BFMatcher 对象进行特征点的匹配,并将前10个最佳匹配结果绘制出来。

接下来,我们将继续探索条形码定位与识别的实战应用。

6. 条形码定位与识别的实战应用

6.1 实战环境搭建

6.1.1 硬件设备与软件配置

要开展条形码识别实战项目,首先需要准备相应的硬件和软件。硬件方面,你需要至少一台带有高分辨率相机的计算机,相机可以是台式机的外接设备,也可以是笔记本自带的摄像头。为了确保条形码图像的质量,相机的分辨率很重要,因为条形码识别通常需要捕捉清晰、对比度高的图像。

软件方面,除了操作系统和必要的驱动程序,还需要安装图像处理和条形码识别库。例如,OpenCV是处理图像的常用库,它支持多种编程语言,包括Python、C++和Java等。ZBar是一个专门用来识别和解码条形码的库,它可以轻松集成到OpenCV中。

6.1.2 实战项目需求分析

在搭建好硬件和软件环境后,下一步是进行项目需求分析。分析需求包括确定需要识别的条形码类型(例如,一维条形码、二维码等)、识别环境(如光照条件、移动速度等)、以及识别精度和速度的期望指标。

实战项目需求分析的重点是理解条形码识别在实际应用中的场景和限制条件。例如,如果条形码识别用于零售商店的结算系统,就需要快速、准确地识别商品上的条形码,这就对识别算法的速度和准确性提出了较高的要求。在一些自动化生产线中,条形码识别不仅要快,还要准确无误,因为错误的识别可能会导致生产事故。

6.2 定位与识别流程

6.2.1 图像采集与处理步骤

图像采集通常是最先进行的操作,涉及使用相机捕获条形码的图像。捕获的图像需经过一系列预处理步骤,以确保后续条形码定位与解码操作能够顺利进行。典型的图像预处理步骤包括调整图像大小、转换为灰度图像、应用滤波器去除噪声以及使用直方图均衡化来增强图像对比度。

import cv2

# 打开摄像头并捕获图像

cap = cv2.VideoCapture(0)

# 检查摄像头是否成功打开

if not cap.isOpened():

raise IOError("Cannot open webcam")

# 读取一帧图像

ret, frame = cap.read()

if not ret:

raise IOError("Cannot read webcam frame")

# 将图像转换为灰度图

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

# 应用高斯模糊去除噪声

blurred = cv2.GaussianBlur(gray, (5, 5), 0)

# 使用直方图均衡化增强对比度

equalized = cv2.equalizeHist(blurred)

# 释放摄像头资源

cap.release()

# 显示处理后的图像

cv2.imshow('Equalized Image', equalized)

cv2.waitKey(0)

cv2.destroyAllWindows()

6.2.2 条形码定位与解码的具体操作

在图像预处理之后,接下来是条形码的定位与解码。这一过程涉及使用OpenCV进行边缘检测、轮廓查找和霍夫变换等技术来精确定位条形码的位置。之后,调用ZBar库的API对定位到的条形码进行解码,提取出条形码数据。

import zbar

# 使用ZBar的ImageScanner类进行解码

scanner = zbar.ImageScanner()

scanner.scan(gray)

# 获取解码结果

for symbol in scanner.results:

print("Type:", symbol.type)

print("Data:", symbol.data.decode('utf-8'))

6.3 案例研究与问题解决

6.3.1 成功案例分享

在实践中,一个典型的成功案例是图书馆管理系统中的条形码识别。该系统使用固定位置的摄像头捕捉图书上的条形码,并利用条形码识别技术自动记录图书的借阅和归还信息。在这种场景中,条形码识别的准确性至关重要,因为任何错误都可能导致借阅信息的混乱。

6.3.2 遇到的常见问题及其解决方案

尽管条形码识别技术相对成熟,但在实际应用中仍然可能遇到问题。例如,在光照条件不佳的情况下,图像中的条形码可能无法被清晰地捕捉。为了解决这一问题,可以使用更加先进的图像采集设备,或者通过软件方法提高图像质量,如动态阈值处理、对比度提升等。

另一个常见的问题是条形码受损或印刷质量差,这可能会导致定位和解码失败。在这种情况下,可以考虑采用更鲁棒的解码算法,或者引入图像修复技术来提高识别的成功率。

7. 提升识别准确性的优化方法

7.1 优化前的分析与评估

7.1.1 识别准确性评估方法

在尝试提升条形码识别的准确性之前,首先要对当前系统的识别准确性进行评估。评估通常包括以下几个方面:

- 错误率 :计算识别过程中产生的错误识别次数占总识别次数的比例。

- 识别速度 :从图像采集到条形码成功解码所需的时间。

- 环境适应性 :评估系统在不同光照、背景和条形码质量条件下的表现。

具体评估步骤如下:

- 收集一定数量的条形码图像样本,包括各种不同质量的条形码。

- 使用现有的识别系统对这些图像进行处理,记录下识别结果以及出错情况。

- 对错误结果进行分类,确定常见的错误类型(如漏检、误读、解析错误等)。

- 计算整体的识别准确率和错误率,分析错误类型分布。

7.1.2 影响识别准确性的因素分析

识别准确性的降低可能是由多种因素导致的,其中主要因素包括:

- 图像质量 :如图像的模糊度、噪声、对比度不足等。

- 光照条件 :过强或过弱的光照都会影响到图像的采集质量。

- 条形码印刷质量 :印刷缺陷、损坏或磨损的条形码难以被准确识别。

- 识别算法 :算法本身的性能限制或参数设置不当。

要提升识别准确性,就需要从这些因素着手进行优化。

7.2 实践中的优化策略

7.2.1 算法与参数的优化

算法是影响识别准确性的关键因素之一。常用的优化方法包括:

- 调整边缘检测参数 :在边缘检测阶段,根据实际情况调整Canny算子的阈值,以适应不同的图像质量。

- 改进轮廓查找方法 :使用更适合条形码轮廓特征的查找算法,例如采用自适应阈值处理图像。

- 优化霍夫变换 :对于霍夫线变换,可以适当调整累积器的分辨率和阈值,以减少误判。

参数优化示例代码:

import cv2

# 读取图像

image = cv2.imread('barcode.jpg', cv2.IMREAD_GRAYSCALE)

# 边缘检测参数优化

edges = cv2.Canny(image, threshold1=50, threshold2=150)

# 应用霍夫变换,优化参数

lines = cv2.HoughLinesP(edges, 1, np.pi / 180, threshold=50, minLineLength=50, maxLineGap=10)

# 绘制检测到的线条

for line in lines:

x1, y1, x2, y2 = line[0]

cv2.line(image, (x1, y1), (x2, y2), (0, 255, 0), 2)

# 显示结果

cv2.imshow('Detected Lines', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

7.2.2 环境与条件的调整

除了算法和参数优化外,环境和条件的调整也对识别准确性至关重要:

- 光照控制 :在条形码扫描区域增加稳定光源或使用抗反光材料。

- 图像预处理 :通过灰度化、去噪、直方图均衡化等预处理手段,改善图像质量。

- 硬件升级 :使用高分辨率的摄像头或改进图像采集设备。

7.3 后期处理与反馈循环

7.3.1 后期处理技术的应用

在识别算法输出结果后,进行后期处理可以进一步提升准确率。后期处理技术包括:

- 投票机制 :对于连续多次扫描的结果进行投票,选取出现频率最高的结果。

- 校验与纠错 :利用条形码的校验码机制进行错误检测与纠正。

- 结果过滤 :根据已知的业务规则,过滤掉不符合实际应用逻辑的识别结果。

7.3.2 优化反馈与持续改进过程

优化是一个持续的过程,需要不断地收集反馈并进行调整:

- 性能监测 :实时监控识别系统的性能指标。

- 用户反馈 :收集最终用户对识别结果的反馈,分析易错情况。

- 周期性回顾 :定期回顾优化策略和效果,及时调整优化方向。

通过这种反馈循环机制,可以确保系统持续地适应变化的环境和业务需求,进一步提高条形码识别的准确性。

简介:本文介绍了使用OpenCV和ZBar库进行条形码定位和识别的技术细节。首先,探讨了OpenCV在图像预处理和特征检测中的应用,例如边缘检测和霍夫变换。接着,说明了如何使用ZBar库对定位到的条形码进行解码,包括对不同类型条码的识别。教程还强调了在实际应用中考虑光照和拍摄角度等外部因素的重要性,并提供了改进识别准确性的策略。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献18条内容

已为社区贡献18条内容

所有评论(0)