【AI论文】双子座(Gemini)2.5:凭借先进推理能力、多模态特性、长上下文处理能力及新一代智能体功能,开拓前沿领域

摘要:Google推出新一代双子座(Gemini)2.X系列模型,包括2.5Pro和2.5Flash,以及早期2.0Flash和Flash-Lite模型。2.5Pro是目前功能最强的旗舰模型,在编码与推理基准测试中达到SoTA(State-of-the-Art)水平。该系列模型特点:2.5Pro具备多模态理解能力,可处理长达3小时的视频内容;2.5Flash以低计算资源需求实现高效推理;2.0系列

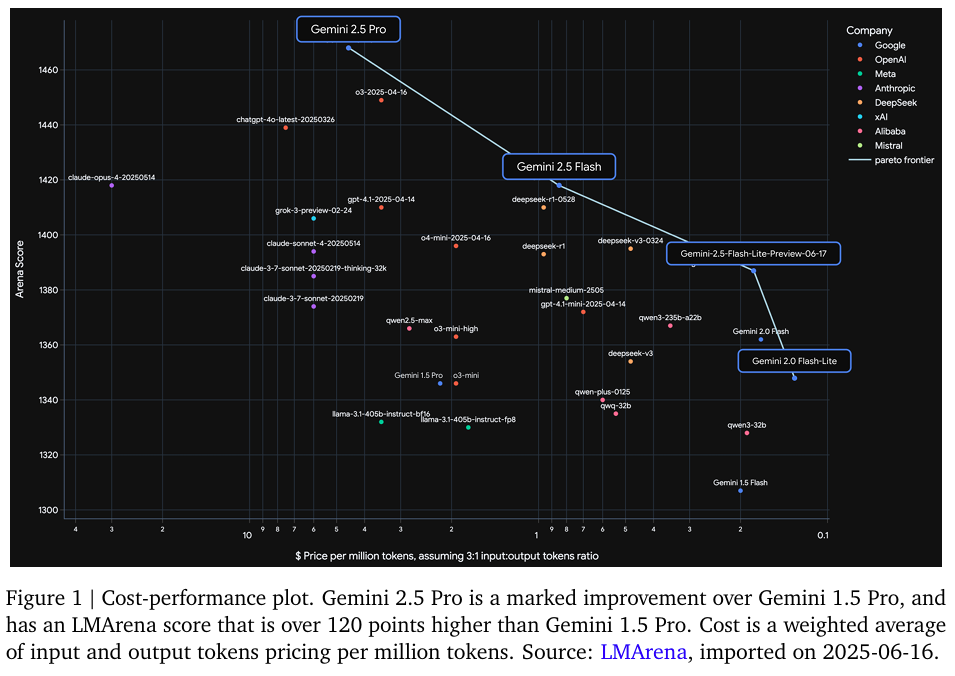

摘要:在本报告中,我们介绍双子座(Gemini)2.X模型系列:双子座2.5 Pro与双子座2.5 Flash,以及我们早期推出的双子座2.0 Flash和Flash-Lite模型。双子座2.5 Pro是我们目前功能最为强大的模型,在前沿编码与推理基准测试中达到了当前最优(SoTA,State-of-the-Art)性能。除具备卓越的编码与推理能力外,双子座2.5 Pro还是一款擅长多模态理解的思考型模型,现已能够处理长达3小时的视频内容。其长上下文处理、多模态与推理能力的独特融合,可解锁全新的智能体工作流程。双子座2.5 Flash以极低的计算资源需求和延迟,提供了出色的推理能力;双子座2.0 Flash和Flash-Lite则在低延迟和低成本条件下实现了高性能表现。整体而言,双子座2.X模型系列全面覆盖了模型性能与成本之间的帕累托前沿,使用户能够探索复杂智能体问题解决领域的各种可能性边界。Huggingface链接:Paper page,论文链接:2507.06261

研究背景和目的

研究背景:

随着人工智能技术的飞速发展,大型语言模型(LLMs)已成为自然语言处理(NLP)领域的核心驱动力。这些模型不仅在文本生成、理解、翻译等任务中表现出色,还逐渐渗透到多模态学习、长上下文处理、以及复杂推理等更广泛的领域。Google作为人工智能领域的领军企业,一直致力于推动LLMs技术的边界。此前,Google已经发布了Gemini 1.5系列模型,展示了强大的多模态理解和长上下文处理能力。然而,随着应用场景的不断拓展和复杂化,对模型的性能、效率和灵活性提出了更高的要求。

在此背景下,Google推出了Gemini 2.X系列模型,包括Gemini 2.5 Pro、Gemini 2.5 Flash、Gemini 2.0 Flash和Flash-Lite。这一系列模型的发布,旨在通过引入更先进的推理能力、多模态支持、长上下文处理以及新一代智能体功能,进一步拓展LLMs的应用边界,满足用户在复杂问题解决、实时交互、个性化推荐等方面的需求。

研究目的:

本研究的主要目的包括:

- 提升模型性能:通过引入新的模型架构和训练方法,提升Gemini 2.X系列模型在编码、推理、多模态理解等任务上的性能,达到或超越当前最优水平。

- 增强多模态能力:使模型能够处理包括文本、图像、音频、视频在内的多种模态信息,实现真正的多模态理解和生成。

- 扩展长上下文处理:提升模型处理长上下文信息的能力,使其能够理解和生成跨越长时间跨度的复杂内容。

- 推动智能体发展:通过引入新一代智能体功能,使模型能够自主规划、执行任务,并与环境进行交互,实现更高级别的自动化和智能化。

- 优化成本与效率:在保持高性能的同时,降低模型的计算资源需求和延迟,提高模型的实用性和可扩展性。

研究方法

模型架构设计:

Gemini 2.X系列模型采用了稀疏混合专家(MoE)架构,这是一种基于Transformer的改进模型,通过动态路由机制激活模型参数的子集,从而在保持高容量的同时降低计算成本。具体来说:

- 稀疏激活:每个输入令牌仅激活模型参数的一部分,通过学习到的路由函数动态决定哪些专家(参数子集)参与处理当前令牌。

- 专家专业化:不同的专家被训练来处理特定类型的输入或任务,从而提高模型的专业化水平和整体性能。

- 可扩展性:MoE架构使得模型可以轻松扩展到数十亿甚至数万亿参数,而不会显著增加计算成本。

训练数据与方法:

- 数据收集:收集了涵盖广泛领域和模态的大规模预训练数据集,包括网页文档、代码、图像、音频和视频等。

- 数据预处理:对数据进行清洗、去重、标注等预处理操作,以提高数据质量和训练效率。

- 多模态训练:采用多模态预训练策略,使模型能够同时处理和理解多种模态的信息。

- 指令微调:在预训练基础上,使用指令微调技术进一步优化模型性能,使其更好地适应特定任务和场景。

- 强化学习:引入强化学习机制,通过奖励信号引导模型生成更符合期望的输出。

评估方法:

- 基准测试:使用一系列标准基准测试来评估模型在编码、推理、多模态理解等任务上的性能。

- 人工评估:结合人工评估来验证模型输出的准确性和合理性。

- 安全评估:通过自动化红队测试、人工红队测试等方法评估模型的安全性和鲁棒性。

- 实际应用测试:将模型集成到Google的各类产品中,通过实际用户反馈来评估模型的实用性和用户体验。

研究结果

模型性能提升:

Gemini 2.5 Pro在编码、推理、多模态理解等任务上均取得了显著的性能提升。具体来说:

- 编码任务:在LiveCodeBench、Aider Polyglot等编码基准测试中,Gemini 2.5 Pro的得分显著高于之前的模型和其他竞争对手。

- 推理任务:在AIME 2025、GPQA(diamond)等推理基准测试中,Gemini 2.5 Pro同样表现出色,达到了当前最优水平。

- 多模态理解:在视频理解、图像理解等任务中,Gemini 2.5 Pro能够准确理解和生成跨模态信息,展示了强大的多模态处理能力。

长上下文处理能力:

Gemini 2.5 Pro能够处理长达数小时的视频内容,并在长上下文理解和生成任务中表现出色。例如,在视频内容回忆任务中,Gemini 2.5 Pro能够准确回忆出视频中特定时间点的细节信息。

智能体功能实现:

通过引入新一代智能体功能,Gemini 2.5 Pro能够自主规划、执行任务,并与环境进行交互。例如,在“Gemini Plays Pokémon”实验中,Gemini 2.5 Pro通过自主规划和执行游戏策略,成功完成了游戏任务,展示了强大的智能体能力。

成本与效率优化:

Gemini 2.5 Flash等低成本模型在保持高性能的同时,显著降低了计算资源需求和延迟。这使得模型能够更广泛地应用于实时交互、个性化推荐等对延迟敏感的场景。

研究局限

尽管Gemini 2.X系列模型在多个方面取得了显著进展,但仍存在一些局限性:

- 数据偏见:预训练数据中可能存在偏见和不平衡问题,导致模型在某些任务上表现不佳或产生不公平的输出。

- 长上下文处理效率:尽管Gemini 2.5 Pro能够处理长上下文信息,但在处理极长上下文时仍面临效率挑战。

- 智能体功能的局限性:当前智能体功能仍处于初级阶段,尚不能完全实现自主决策和复杂任务执行。

- 安全性和鲁棒性:尽管通过多种方法评估了模型的安全性和鲁棒性,但仍存在被恶意攻击或误导的风险。

- 可解释性:复杂模型的可解释性仍然是一个挑战,用户难以理解模型为何做出特定决策或生成特定输出。

未来研究方向

针对上述局限性,未来的研究可以从以下几个方面展开:

- 数据偏见缓解:通过更精细的数据预处理和增强策略,减少预训练数据中的偏见和不平衡问题。同时,开发更公平的评估指标和算法,确保模型输出符合伦理和社会规范。

- 长上下文处理优化:研究更高效的长上下文处理算法和架构,提高模型在处理极长上下文时的效率和准确性。例如,可以探索分块处理、注意力机制优化等方法。

- 智能体功能增强:进一步完善智能体的规划、决策和执行能力,使其能够处理更复杂的任务和环境。同时,研究智能体之间的协作和交互机制,实现多智能体系统的协同工作。

- 安全性和鲁棒性提升:开发更强大的安全评估和防御机制,确保模型在面对恶意攻击或误导时仍能保持稳定和可靠的输出。例如,可以研究对抗训练、模型监控和应急响应等方法。

- 可解释性研究:探索模型决策过程的可解释性方法,使用户能够理解模型为何做出特定决策或生成特定输出。例如,可以研究注意力可视化、决策路径追踪等方法。

总之,Gemini 2.X系列模型的发布标志着大型语言模型技术的新进展。未来的研究将继续围绕提升模型性能、增强多模态能力、优化长上下文处理、推动智能体发展以及提高安全性和可解释性等方面展开,为用户提供更强大、更智能、更可靠的人工智能服务。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献228条内容

已为社区贡献228条内容

所有评论(0)