Python爬虫项目实战:APP视频数据抓取技巧与应用

爬虫,也被称作网络蜘蛛(web spider)或网络机器人(web robot),是一种自动获取网页内容的程序或脚本。其通过模拟人类访问网页的行为,来提取网页上的信息。基本的工作流程包括发送请求、获取响应、解析内容和保存数据。Python以其简洁的语法、强大的标准库支持、多样的开发框架和强大的社区支持而受到广泛的青睐。简单易学的特点使得Python尤其适合进行数据爬取和处理。

简介:本项目介绍了如何使用Python编写爬虫程序,从特定APP中抓取视频数据。内容涵盖了使用requests库发送HTTP请求、利用BeautifulSoup和lxml进行数据解析,以及Scrapy框架的基本使用。同时,对APP数据抓取技巧、数据存储与异常处理进行了详细的说明,并强调了合法性和合规性的重要性。这个项目是学习Python爬虫技术的良好实践,能帮助开发者在实际操作中提升技能并确保合法性。

1. Python爬虫基本概念与应用

在当今信息高度发达的时代,数据成为了宝贵的资源。通过爬虫技术,我们能够自动化地从互联网上抓取和收集数据。Python爬虫,作为这个领域的重要工具之一,因其简洁易懂的语法、丰富的库支持和强大的社区资源,而广泛应用于各种场景。

1.1 爬虫的定义与作用

1.1.1 爬虫的定义

爬虫,也被称作网络蜘蛛(web spider)或网络机器人(web robot),是一种自动获取网页内容的程序或脚本。其通过模拟人类访问网页的行为,来提取网页上的信息。基本的工作流程包括发送请求、获取响应、解析内容和保存数据。

1.1.2 爬虫的应用领域

爬虫技术被广泛应用于搜索引擎(如Google、Bing)、网络数据监控、市场分析、舆情监测等多个领域。在科研、商业和日常生活中,爬虫能提供一种高效的数据采集手段。

1.2 Python爬虫的优势

1.2.1 Python编程语言概述

Python以其简洁的语法、强大的标准库支持、多样的开发框架和强大的社区支持而受到广泛的青睐。简单易学的特点使得Python尤其适合进行数据爬取和处理。

1.2.2 Python在爬虫中的优势

Python提供的第三方库如requests、BeautifulSoup、Scrapy等,极大简化了爬虫的开发过程。同时,Python良好的跨平台性以及丰富的数据处理和分析能力,使其成为了开发爬虫的首选语言。

1.3 爬虫的法律与伦理问题

1.3.1 爬虫的合规性考量

在使用爬虫技术时,必须遵守相关的法律法规以及目标网站的服务条款。未经允许的数据抓取可能违反版权法,损害他人利益或引发法律风险。

1.3.2 版权与隐私权保护

数据抓取过程中必须尊重版权和个人隐私权,对于敏感数据要进行适当的处理和保护,避免泄露用户隐私和敏感信息。

通过本章节的介绍,我们可以了解到Python爬虫的基本概念、应用以及相关的法律伦理问题,为后续深入学习打下基础。在下一章节中,我们将探讨Python中常用的requests库的使用技巧,帮助大家更好地实践爬虫技术。

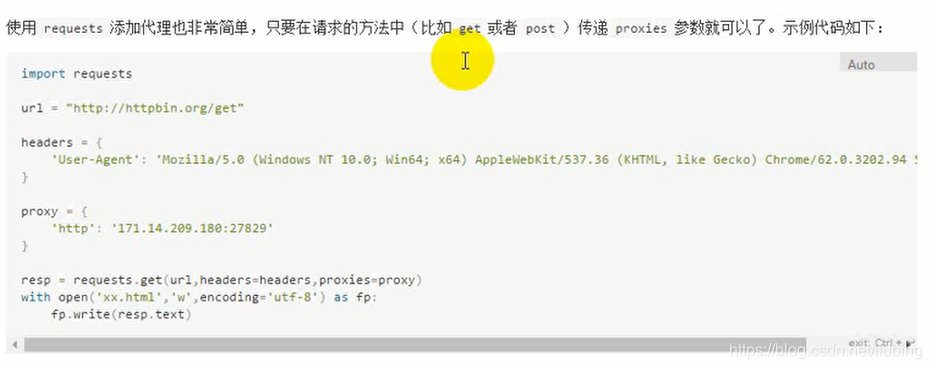

2. requests库使用技巧

2.1 requests库基础

请求库(requests)是Python中最流行的HTTP客户端库之一,它使得发送网络请求变得简单快捷。requests库不仅使用简单,而且功能强大,支持多种认证方式、会话保持、错误处理等高级特性。

2.1.1 requests库安装与导入

要安装requests库,可以使用pip包管理器,执行以下命令:

pip install requests

安装完成后,在Python脚本中导入requests库:

import requests

2.1.2 发送HTTP请求的方法

requests库支持多种类型的HTTP请求:GET、POST、PUT、DELETE等。以下是一个简单的GET请求示例:

response = requests.get('https://api.example.com/data')

print(response.text)

上述代码中, requests.get 函数发送一个GET请求到指定的URL,并将响应对象存储在变量 response 中。 response.text 属性包含服务器返回的内容。

在实际使用中,如果要发送POST请求,可以使用 requests.post 方法:

data = {'key': 'value'}

response = requests.post('https://api.example.com/submit', data=data)

print(response.status_code)

2.2 高级请求功能

requests库不仅提供了基本的请求发送和响应处理功能,还具备了会话保持、Cookie处理和异常处理等高级功能。

2.2.1 会话保持与Cookie处理

使用requests的Session对象可以保持会话状态,这对于需要维持登录状态的应用尤为重要。

with requests.Session() as session:

session.post('https://api.example.com/login', data={'username': 'user', 'password': 'pass'})

response = session.get('https://api.example.com/protected')

print(response.status_code) # 由于会话保持,此请求认为已认证

在这个例子中,会话对象 session 保持了登录后的状态,所以后续的请求都会携带认证信息。

处理Cookie时,可以直接从响应中获取 response.cookies 对象。

response = requests.get('https://api.example.com/data')

cookies = response.cookies.get_dict()

print(cookies)

2.2.2 异常处理与请求重试机制

网络请求可能会因为各种原因失败,因此在爬虫程序中对异常进行处理非常重要。

from requests.exceptions import RequestException

try:

response = requests.get('https://api.example.com/data')

response.raise_for_status()

except RequestException as e:

print(e)

此外,可以通过第三方库,例如 requests-cache 或自己实现的重试逻辑来添加请求重试机制。

2.3 requests库实战演练

实际应用中,requests库可以用来抓取网页内容,解析HTML,甚至处理JavaScript动态加载的数据。

2.3.1 爬取网页内容实例

为了抓取网页内容,可以使用GET请求,然后提取响应内容。

import requests

from bs4 import BeautifulSoup

url = 'https://www.example.com'

response = requests.get(url)

soup = BeautifulSoup(response.text, 'html.parser')

print(soup.prettify())

2.3.2 动态网页数据抓取技巧

处理动态网页通常更复杂,因为数据可能是通过JavaScript异步加载的。这时,可以结合使用 requests 和 Selenium 等工具,或使用开发者工具捕获网络请求。

from selenium import webdriver

driver = webdriver.Chrome()

driver.get('https://dynamic.example.com')

data = driver.execute_script('return document.querySelector("#data").innerHTML')

print(data)

driver.quit()

在上述代码中, Selenium 用于打开浏览器,并执行JavaScript代码以获取动态内容。

在这一章里,我们深入探讨了requests库的安装、基础使用方法和高级功能,以及如何将其应用在实战演练中。接下来的章节中,我们将进一步深入了解如何解析和处理爬取的数据。

3. BeautifulSoup与lxml数据解析方法

3.1 BeautifulSoup解析库介绍

3.1.1 BeautifulSoup安装与基础使用

BeautifulSoup是一个用于解析HTML和XML文档的Python库,它提供了一些简单的方法来导航、搜索以及修改解析树。这使得处理复杂的HTML或XML文档变得简单易行。

要安装BeautifulSoup库,您可以使用pip工具:

pip install beautifulsoup4

安装完成后,即可在Python脚本中进行导入,并开始使用它来解析HTML文档。以下是一个简单的例子:

from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title"><b>The Dormouse's story</b></p>

<p class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacie" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p>

<p class="story">...</p>

soup = BeautifulSoup(html_doc, 'html.parser')

在这个例子中,我们创建了一个 BeautifulSoup 对象, html_doc 是待解析的HTML文档, 'html.parser' 指定了使用的解析器。

3.1.2 解析HTML/XML文档结构

BeautifulSoup不仅支持HTML,还能解析XML文档。它的解析器可以处理各种类型的编码和文档结构。

soup.title

# 输出: <title>The Dormouse's story</title>

soup.title.name

# 输出: 'title'

soup.title.string

# 输出: 'The Dormouse's story'

soup.title.parent.name

# 输出: 'head'

soup.p

# 输出: <p class="title"><b>The Dormouse's story</b></p>

soup.p['class']

# 输出: ['title']

soup.find_all('a')

# 输出: [<a class="sister" href="http://example.com/elsie" id="link1">Elsie</a>,

# <a class="sister" href="http://example.com/lacie" id="link2">Lacie</a>,

# <a class="sister" href="http://example.com/tillie" id="link3">Tillie</a>]

通过这些方法,您可以轻松地遍历文档树,并提取您感兴趣的信息。 find_all 方法用于查找所有匹配的标签,返回的是一个列表。此外,您还可以使用 find 方法来查找第一个匹配的标签。

使用BeautifulSoup,还可以轻松地修改文档结构:

soup.title.decompose() # 删除标题

for link in soup.find_all('a'):

link.unwrap() # 移除<a>标签但保留链接内容

print(soup)

解析器的选择很重要,因为它会影响BeautifulSoup如何解析HTML文档。除了内置的 html.parser 外,还有 lxml 和 xml 等解析器,它们各有特点。通常, lxml 是一个更为强大和快速的解析器,而且它也可以解析XML。

3.2 lxml解析库的优势

3.2.1 lxml安装与基础使用

lxml 是一个高性能的XML和HTML解析库,它基于libxml2和libxslt库。 lxml 非常强大,速度快,且支持XPath和XSLT。它的安装比较复杂,因为包含了C语言的扩展。

首先安装 lxml :

pip install lxml

使用 lxml 的基本用法与BeautifulSoup类似:

from lxml import etree

html_doc = etree.HTML('<html><head><title>Test</title></head></html>')

print(html_doc.xpath('//title/text()'))

# 输出: ['Test']

在处理HTML或XML数据时, lxml 的API与BeautifulSoup略有不同,但功能上非常相似,同样支持复杂的查询和元素修改。

3.2.2 lxml与BeautifulSoup的对比

lxml 和BeautifulSoup都是处理HTML和XML的强大工具,但是它们在性能和功能上有一些差异:

- 性能:

lxml通常比BeautifulSoup更快,尤其在处理大型文档或进行复杂的XPath查询时。 - 功能:

lxml支持更多的XML特性,如XSLT转换,而BeautifulSoup提供的接口更加Python化,易于上手。 - 兼容性:

lxml可以作为HTML和XML的解析器,而BeautifulSoup主要用于HTML解析,虽然也支持XML。

选择使用哪一个,取决于你的具体需求,以及你是否更倾向于简洁易用的接口,或是更加专注于性能优化。

3.3 数据提取与处理实战

3.3.1 提取网页中的文本与链接

我们可以通过BeautifulSoup提取网页中的所有链接,以下是一个基本示例:

import requests

from bs4 import BeautifulSoup

# 获取页面内容

url = "http://example.com"

response = requests.get(url)

html_doc = response.text

# 解析页面

soup = BeautifulSoup(html_doc, 'html.parser')

# 提取所有链接

for link in soup.find_all('a'):

print(link.get('href')) # 获取链接的href属性

# 提取链接文本

for link in soup.find_all('a'):

print(link.text)

3.3.2 数据清洗与格式化输出

提取的数据可能包含不需要的空格和换行符,BeautifulSoup提供了方便的方法来清洗数据。

for link in soup.find_all('a'):

print(link.get_text().strip()) # 使用.strip()方法去除多余的空白字符

数据清洗后,您可能需要将其格式化输出,或者存入数据库:

# 假设提取到的数据存储在变量data中

data = [link.get_text().strip() for link in soup.find_all('a')]

print("\n".join(data)) # 使用换行符连接输出所有文本

# 数据存储示例

with open('links.txt', 'w', encoding='utf-8') as f:

for item in data:

f.write(f"{item}\n")

通过以上的步骤,我们可以有效地从网页中提取我们需要的数据,并进行相应的清洗和存储。

通过本章节的介绍,您应该已经掌握了使用BeautifulSoup和lxml进行基本的数据解析方法,从提取文本与链接,到数据清洗与格式化输出,这些技术都是爬虫开发中的核心能力。接下来,我们将在第四章中深入探讨Scrapy框架,这将帮助我们构建更为复杂和高效的爬虫项目。

4. Scrapy框架简介与项目构建

4.1 Scrapy框架概述

4.1.1 Scrapy框架的特点与架构

Scrapy是一个用于爬取网站数据和提取结构性数据的应用框架,可以用于数据挖掘、信息处理或历史记录备份。它的主要特点包括:

- 高度可定制性 :Scrapy 提供了丰富的扩展点,允许开发者根据自己的需求对框架进行定制。

- 高性能 :Scrapy 使用 Twisted 异步网络框架来处理网络请求,确保了爬虫在处理大量数据时的效率。

- 易于使用 :Scrapy 的代码结构清晰,易读易维护,并且拥有一个详尽的文档。

Scrapy的架构如图所示:

graph TD

A[Scrapy Engine] -->|Spiders| B[Spiders]

A -->|Requests| C[Downloader]

B -->|Items| D[Item Pipelines]

C -->|Responses| D

C -->|Requests| A

D -->|Items| E[Storage]

4.1.2 Scrapy项目的基本结构

一个标准的Scrapy项目包含以下核心组件:

- Item :定义了爬取的数据结构,用于存储爬取到的数据。

- Spider :编写爬虫规则,解析网页并提取数据。

- Item Pipeline :处理爬取的项目,例如存储到数据库或文件中。

- Downloader Middlewares :处理请求和响应的中间件。

- Spider Middlewares :处理下载器返回给爬虫的响应和项目。

4.2 Scrapy组件与中间件

4.2.1 Item、Spider、PipeLine组件解析

Item

Item是Scrapy数据模型的一个基础,它定义了爬取的数据结构。例如:

import scrapy

class ProductItem(scrapy.Item):

name = scrapy.Field()

price = scrapy.Field()

stock = scrapy.Field()

last_updated = scrapy.Field()

Spider

Spider是定义如何爬取特定网站的类。它会解析响应并生成Items和更多的Requests。例如:

import scrapy

from myproject.items import ProductItem

class MySpider(scrapy.Spider):

name = "example.com"

allowed_domains = ["example.com"]

start_urls = [

"http://www.example.com/1.html",

"http://www.example.com/2.html",

# ...

]

def parse(self, response):

# 这里提取item数据

item = ProductItem()

item['name'] = response.css('div.product::text').get()

item['price'] = response.css('div.price::text').get()

yield item

# 这里可能还包含更多的解析逻辑和生成新的Requests

Pipeline

Pipeline用于数据处理和清洗的组件。它提供了一个接口,通过它可以在数据被存储之前进行处理。例如:

class ProductPipeline(object):

def process_item(self, item, spider):

# 数据清洗或处理逻辑

return item

4.2.2 中间件的作用与配置

Scrapy中间件是框架的扩展点,它允许全局地修改Scrapy的请求和响应。

Downloader Middlewares

下载器中间件可以处理发送给服务器的请求和从服务器接收到的响应。例如:

class MyDownloaderMiddleware(object):

def process_request(self, request, spider):

# 修改请求前的逻辑

return None # 返回None表示忽略该请求

def process_response(self, request, response, spider):

# 修改响应后的逻辑

return response

Spider Middlewares

爬虫中间件则用于处理从下载器传递给爬虫的响应。例如:

class MySpiderMiddleware(object):

def process_spider_input(self, response, spider):

# 处理爬虫接收到的响应

return None # 返回None将中断该响应的进一步处理

4.3 Scrapy实战项目构建

4.3.1 创建Scrapy项目

创建一个Scrapy项目需要使用Scrapy提供的命令行工具。在命令行中输入如下命令:

scrapy startproject myproject

这将创建一个名为 myproject 的新Scrapy项目,项目中包含了默认的文件结构和配置模板。

4.3.2 定义Item与编写Spider

一旦创建了项目,接下来的步骤是定义Item和编写Spider。

定义Item

在 items.py 文件中定义你需要提取的数据结构,例如:

class ProductItem(scrapy.Item):

name = scrapy.Field()

price = scrapy.Field()

stock = scrapy.Field()

last_updated = scrapy.Field()

编写Spider

在 spiders 目录下创建一个Python文件,如 my_spider.py ,然后定义一个继承自 scrapy.Spider 的类:

class MySpider(scrapy.Spider):

name = "example"

allowed_domains = ["example.com"]

start_urls = ['http://www.example.com/']

def parse(self, response):

# 解析响应逻辑

for sel in response.xpath('//div[@class="product"]'):

item = ProductItem()

item['name'] = sel.xpath('.//div[@class="name"]/text()').get()

item['price'] = sel.xpath('.//div[@class="price"]/text()').get()

yield item

这些步骤完成了Scrapy爬虫的基础构建。要开始爬取,你可以在命令行中运行爬虫:

scrapy crawl example

接下来,我们可以对抓取到的数据进行进一步的处理,例如存储到数据库或导出为JSON文件。Scrapy提供了灵活的管道机制来实现这些功能。

5. APP视频数据爬取技巧

5.1 APP数据抓取的技术障碍

5.1.1 APP数据加密与混淆

随着移动互联网的发展,APP已成为数据的主要载体。然而,与传统的网页爬取相比,APP数据的抓取面临更多技术障碍,其中最主要的问题之一就是数据加密与混淆。加密技术使数据在传输过程中难以被截取和分析,而数据混淆则是将数据源代码中的关键信息进行伪装,以防止被轻易理解和利用。

为了应对这些挑战,爬虫开发者需要了解移动应用的网络通信协议和数据处理流程。在一些情况下,开发者能够通过逆向工程技术来分析APP的加密和混淆方法。这些技术包括但不限于使用动态调试、网络抓包工具以及代码静态分析等。需要注意的是,逆向工程和解密行为可能违反相关法律法规,在实施之前应确保行为的合法性。

5.1.2 模拟登录与会话管理

APP中通常含有用户个性化内容,为了爬取这些数据,需要模拟登录操作来维持用户会话。模拟登录涉及到用户认证、会话持久化以及可能的二次验证问题。为实现模拟登录,开发者需要理解APP的认证机制,如OAuth、JWT等,并能够构造相应的认证请求。

会话管理是保证数据连续抓取的另一个重要环节。在爬虫中实现会话管理,通常需要利用会话保持的HTTP库特性。例如,在使用Python的requests库时,可以创建一个会话对象(Session),通过这个会话对象保存Cookie,确保在多次请求之间维持登录状态。下面是一个简单的示例代码:

import requests

# 创建会话对象

with requests.Session() as session:

# 发起登录请求

login_url = 'https://example.com/login'

payload = {'username': 'your_username', 'password': 'your_password'}

session.post(login_url, data=payload)

# 利用会话对象进行其他请求

protected_url = 'https://example.com/protected/resource'

protected_response = session.get(protected_url)

# 处理响应...

在这个过程中,开发者不仅需要关注请求和响应的数据,还需要关注会话的生命周期管理,以及如何处理会话失效的情况。

5.2 利用逆向工程技术

5.2.1 逆向工程的基本原理

逆向工程技术通常指对程序进行分析,以了解其构建过程和工作原理。在移动应用爬虫开发中,逆向工程可以帮助我们理解APP的网络通信和数据处理流程。逆向工程的核心是能够将APP的执行代码还原为可理解的逻辑和数据结构。

逆向工程涉及的常用工具有静态分析工具如IDA Pro、Ghidra,动态调试工具如Frida、Xposed等。通过这些工具,开发者可以识别关键的API调用、数据库操作、网络请求等行为。

5.2.2 利用Fiddler等工具分析数据包

为了捕获和分析APP与服务器之间的网络通信,可以使用Fiddler这样的网络抓包工具。Fiddler可以捕获应用程序的HTTP和HTTPS请求,并允许用户查看请求和响应的详细信息。通过分析这些数据包,开发者可以识别出APP请求的API接口、请求头、参数以及加密/混淆后的数据内容。

在使用Fiddler进行网络抓包时,用户首先需要在电脑上安装Fiddler,并将手机连接至该电脑。然后,设置手机的代理为Fiddler所在电脑的IP地址和端口,以确保数据包能够被Fiddler捕获。下图是一个使用Fiddler抓取移动应用数据的流程图:

graph TD

A[开启Fiddler并设置代理] --> B[连接手机到电脑]

B --> C[将手机代理设置为电脑IP和端口]

C --> D[Fiddler捕获手机发出的网络数据包]

D --> E[分析数据包,提取API接口和数据]

通过Fiddler捕获到的网络数据包示例如下:

GET /api/v1/resource?param1=value1¶m2=value2 HTTP/1.1

Host: example.com

User-Agent: MyApp/1.0 (iPhone; iOS 14.0; Scale/3.00)

Authorization: Bearer eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXVCJ9.eyJzdWIiOiIxMjM0NTY3ODkwIiwibmFtZSI6IkpvaG4gRG9lIiwiaWF0IjoxNTE2MjM5MDIyfQ.SflKxwRJSMeKKF2QT4fwpMeJf36POk6yJV_adQssw5c

5.3 APP视频数据爬取实战

5.3.1 视频数据API发现与分析

在掌握了APP的网络通信机制后,下一个步骤就是发现和分析视频数据API。通常视频内容是由特定API接口提供的,可能包含视频文件的直接链接、视频描述、播放权限等信息。

发现视频API通常需要进行大量请求的监听和分析。开发者可以通过逆向工程工具识别API请求的模式,或者使用网络抓包工具来追踪APP发出的请求。通过分析请求的URL、请求头和参数,可以找出视频数据的API接口。

5.3.2 编写爬虫抓取视频数据

在分析完视频API后,就可以编写爬虫代码来抓取视频数据。如果视频数据是直接提供下载链接的,可以使用之前介绍的requests库发送HTTP请求直接获取文件。下面是一个简单的示例代码:

import requests

from bs4 import BeautifulSoup

# 假设已知视频数据API的URL

video_api_url = 'https://example.com/api/get_video'

params = {'video_id': '123456'} # 需要根据实际情况设置参数

# 发送请求获取数据

response = requests.get(video_api_url, params=params)

# 解析数据提取视频下载链接

data = response.json() # 假设返回的是JSON格式数据

video_url = data['video_url']

# 发起请求下载视频

video_response = requests.get(video_url, stream=True)

video_response.raw.decode_content = True # 确保内容被解码

# 将视频数据写入文件

with open('video.mp4', 'wb') as f:

for chunk in video_response.iter_content(chunk_size=1024):

if chunk:

f.write(chunk)

在实际的爬虫开发中,还可能需要处理数据加密、模拟登录、验证码识别等多种复杂情况。开发者应该根据目标APP的具体情况,灵活运用各种技术手段,编写健壮、高效的爬虫代码。

6. 数据解析与存储解决方案

随着网络技术的飞速发展,数据已成为企业决策的重要基础。在爬取海量数据后,如何有效地解析这些数据并存储起来,是每个数据爬虫开发者必须面对的挑战。本章将深入探讨数据解析与存储的各种高级技巧,并提供相应的解决方案。

6.1 数据解析的高级技巧

在爬取数据后,正确解析数据是提取有价值信息的关键步骤。本小节将讨论几种高级的数据解析技术。

6.1.1 正则表达式在数据解析中的应用

正则表达式是一种强大的字符串处理工具,它可以帮助我们从复杂的文本中抽取所需的信息。下面是一个使用Python正则表达式的简单示例。

import re

# 假设从某个网页中提取了一段文本

text = "Python 3.8.1 (tags/v3.8.1:1b293b6, Dec 18 2019, 22:39:24) [MSC v.1916 64 bit (AMD64)]"

# 使用正则表达式提取版本号

version_pattern = r"(\d+\.\d+\.\d+)"

version = re.search(version_pattern, text).group()

print(f"Extracted Version: {version}")

以上代码中的正则表达式 (\d+\.\d+\.\d+) 定义了一个模式,它用于匹配数字序列,中间由点分隔,这样就能准确地提取出版本号。参数 group() 用来获取匹配的结果。

6.1.2 JSON与XML数据解析

在现代网络应用中,JSON和XML是数据交换的主要格式。在爬虫开发中,正确解析这两种格式的数据对于提取结构化信息至关重要。

JSON数据解析

JSON是JavaScript Object Notation的缩写,是一种轻量级的数据交换格式。Python中可以通过内置的 json 模块解析JSON数据。

import json

# 假设我们获取到了一段JSON格式的数据

json_data = '{"name": "John", "age": 30, "city": "New York"}'

# 使用json模块解析JSON数据

data = json.loads(json_data)

print(data['name']) # 输出: John

XML数据解析

XML(Extensible Markup Language)是另一种常见的数据交换格式。Python中的 xml.etree.ElementTree 模块提供了方便的XML数据解析工具。

import xml.etree.ElementTree as ET

# 假设我们获取到了一段XML格式的数据

xml_data = "<user><name>John</name><age>30</age><city>New York</city></user>"

# 解析XML数据

root = ET.fromstring(xml_data)

# 提取信息

name = root.find('name').text

age = root.find('age').text

city = root.find('city').text

print(f"Name: {name}, Age: {age}, City: {city}")

在上述示例中,我们首先导入了 xml.etree.ElementTree 模块,并使用 fromstring 函数来解析XML字符串。然后通过 find 方法获取到各个标签的内容。

6.2 数据存储策略

爬取的数据需要妥善存储以便于后续的数据分析和处理。存储策略的选择直接影响到数据的可访问性和应用性能。

6.2.1 数据存储的基本形式

数据存储主要有两种形式:文件存储和数据库存储。

文件存储

文件存储通常包括文本文件、CSV文件和Excel文件等。它们易于使用,适合存储不需要频繁更新和查询的小数据量。

import csv

# 示例:将数据写入CSV文件

data = [

{"name": "John", "age": 30, "city": "New York"},

{"name": "Jane", "age": 28, "city": "Los Angeles"}

]

with open('data.csv', 'w', newline='') as file:

writer = csv.DictWriter(file, fieldnames=data[0].keys())

writer.writeheader()

writer.writerows(data)

数据库存储

数据库存储适合处理大数据量和需要频繁查询的数据。关系型数据库如MySQL和PostgreSQL,以及非关系型数据库如MongoDB,都是不错的选择。

import pymongo

# 示例:将数据存储到MongoDB

client = pymongo.MongoClient('localhost', 27017)

db = client['mydatabase']

collection = db['mycollection']

for item in data:

collection.insert_one(item)

6.2.2 数据库存储与文件存储的对比

不同存储方案有不同的优势,适用场景也不同。下表对比了文件存储和数据库存储的主要特征:

| 特征 | 文件存储 | 数据库存储 |

|---|---|---|

| 实现复杂度 | 实现简单,无需配置 | 需要一定的数据库知识和配置 |

| 读写性能 | 适合小规模数据,性能有限 | 高性能读写,支持索引优化查询 |

| 数据结构 | 数据结构简单,适合扁平化数据 | 支持复杂的数据关系和结构 |

| 数据一致性 | 可能需要手动处理数据一致性问题 | 事务支持,保证数据一致性 |

| 扩展性 | 扩展性较差,不适合大规模数据 | 通过分片、复制等方式容易扩展 |

6.3 大规模数据存储与处理

随着数据量的增加,存储和处理成为新的挑战。面对大规模数据,传统的存储和处理方式可能会显得力不从心。

6.3.1 分布式存储解决方案

分布式存储系统如HDFS、Amazon S3等,能够在多台机器上分布存储数据,提供高可靠性和扩展性。

graph LR

A[客户端] -->|写入数据| B[NameNode]

B -->|元数据| C[DataNode1]

B -->|元数据| D[DataNode2]

B -->|元数据| E[DataNode3]

A -->|读取数据| B

在上图中,客户端通过NameNode元数据服务器对分布式存储系统中的DataNode节点进行数据的读写操作。

6.3.2 处理大数据量爬取的策略

处理大规模数据量的爬取通常需要利用分布式计算框架,如Apache Spark和Hadoop。以下是使用Apache Spark处理大数据的一些策略。

from pyspark.sql import SparkSession

# 创建Spark会话

spark = SparkSession.builder.appName("BigDataCrawler").getOrCreate()

# 加载数据

df = spark.read.csv("hdfs://path/to/your/large/data.csv", header=True, inferSchema=True)

# 数据处理

df = df.groupBy("category").agg({"count":"sum"})

# 存储结果

df.write.format("parquet").save("hdfs://path/to/output/folder")

以上代码示例创建了一个Spark会话,并通过Spark SQL API来处理存储在HDFS上的大规模CSV数据集。处理完成后,结果被存储在HDFS的指定路径下。

通过本章节的介绍,我们了解了数据解析与存储的基本形式和高级技巧,以及大规模数据存储与处理的策略。掌握这些内容对于处理网络爬虫爬取的数据至关重要,能有效提高数据处理的效率和准确性。

7. 异常处理与反反爬虫策略

在本章节中,我们将深入探讨Python爬虫在面对网络异常、数据解析错误以及反爬虫技术时的处理策略。这些策略不仅能够帮助爬虫更加稳定地运行,还能有效应对网站的反爬虫机制。

7.1 爬虫的异常管理

异常是爬虫程序在运行过程中不可避免的问题,它们可能来自网络请求、数据解析等多个环节。因此,异常管理是确保爬虫稳定运行的关键。

7.1.1 网络请求异常的处理

网络请求异常通常包括连接错误、超时、以及服务器返回的错误状态码等。Python中的 requests 库提供了异常处理机制,如 requests.exceptions.RequestException ,通过捕获这些异常我们可以更精准地进行错误处理。

import requests

try:

response = requests.get('http://example.com')

response.raise_for_status()

except requests.exceptions.HTTPError as e:

print('HTTP error occurred:', e)

except requests.exceptions.ConnectionError as e:

print('Connection error occurred:', e)

except requests.exceptions.Timeout as e:

print('Timeout error occurred:', e)

except requests.exceptions.RequestException as e:

print('An error occurred during the request:', e)

7.1.2 数据解析异常的捕获与处理

在解析网页数据时,可能会遇到页面结构发生变化、数据未按预期格式显示等问题,此时数据解析异常便发生了。使用 BeautifulSoup 或 lxml 时,合理的异常处理能提高程序的健壮性。

from bs4 import BeautifulSoup

import requests

try:

response = requests.get('http://example.com')

response.raise_for_status()

soup = BeautifulSoup(response.text, 'html.parser')

# 假设我们要提取页面中的所有链接

links = soup.find_all('a')

for link in links:

href = link.get('href')

print(href)

except Exception as e:

print('Error occurred during parsing:', e)

7.2 反反爬虫技术探讨

许多网站实施反爬虫措施以防止爬虫程序过度采集数据。了解这些技术并采取相应的策略可以提高爬虫的成功率。

7.2.1 用户代理(User-Agent)更换与伪装

网站可能会基于 User-Agent 来识别爬虫,因此定期更换或伪装用户代理字符串可以帮助爬虫绕过这类检测。

import random

user_agents = [

'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3',

'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/14.0 Safari/605.1.15',

# 更多用户代理字符串...

]

headers = {

'User-Agent': random.choice(user_agents)

}

response = requests.get('http://example.com', headers=headers)

7.2.2 面对动态令牌与验证码的策略

动态令牌(如Cookies)和验证码是常见的反爬虫技术。可以采取自动化测试工具(如Selenium)来处理需要用户交互的动态令牌和验证码。

7.3 维护爬虫的稳定运行

确保爬虫稳定运行需要日志记录、监控以及程序自我恢复机制。

7.3.1 日志记录与监控的重要性

日志记录是调试和监控爬虫运行情况的重要手段。合理的日志记录可以快速定位问题,而监控则确保爬虫在出现异常时能够及时收到警报。

import logging

logging.basicConfig(level=logging.INFO,

format='%(asctime)s - %(levelname)s - %(message)s',

filename='spider.log')

try:

# 爬虫代码逻辑

except Exception as e:

logging.error('An error occurred: %s', str(e))

7.3.2 定时任务与自动重启机制设计

利用定时任务可以保证爬虫按照既定频率执行,而自动重启机制则可以在爬虫崩溃时自动恢复运行。

借助 cron 在Linux系统上设置定时任务,或使用 apscheduler 库在Python中实现定时任务。对于自动重启,可以通过外部监控系统检测爬虫进程状态,并在出现异常时触发重启命令。

# 使用apscheduler进行定时任务的简单示例

from apscheduler.schedulers.background import BackgroundScheduler

scheduler = BackgroundScheduler()

def job_function():

# 定义爬虫操作逻辑

pass

scheduler.add_job(job_function, 'interval', hours=24)

scheduler.start()

在本章中,我们学习了如何管理爬虫过程中的异常、绕过反爬虫机制,以及确保爬虫稳定运行的策略。掌握这些知识,可以让爬虫在面对复杂网络环境时更加游刃有余。

简介:本项目介绍了如何使用Python编写爬虫程序,从特定APP中抓取视频数据。内容涵盖了使用requests库发送HTTP请求、利用BeautifulSoup和lxml进行数据解析,以及Scrapy框架的基本使用。同时,对APP数据抓取技巧、数据存储与异常处理进行了详细的说明,并强调了合法性和合规性的重要性。这个项目是学习Python爬虫技术的良好实践,能帮助开发者在实际操作中提升技能并确保合法性。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)