面对Agentic AI的威胁,AI Agent 怎么自救!

本文系统研究了AI智能体的技术架构和安全风险。首先定义了AI智能体的核心能力,包括推理规划、工具调用、记忆存储等,并分析了单/多代理系统架构。研究重点识别了代理特有的安全威胁,如记忆投毒、工具滥用、权限妥协等新型攻击模式,并提出了分层防护策略。针对六大威胁领域(推理操控、记忆污染、工具执行等),研究制定了包含主动防御、实时检测和应急响应的综合防护方案。此外,通过企业协同代理、智能家居等典型场景验证

一、AI Agent 的定义

1. 定义与基础

-

智能代理(Agent)的定义: 智能代理是一种能够感知环境、进行推理、做出决策并自主采取行动以实现特定目标的软件系统。

-

经典定义引用: Russell 和 Norvig 在《Artificial Intelligence: A Modern Approach》中定义智能代理为:“能够根据环境和目标做出适当行为、适应变化、从经验中学习,并在感知和计算受限条件下做出适当选择的智能体。”

-

技术基础: AI Agents 使用机器学习(ML)进行推理。传统上,强化学习等方法在智能代理发展中起关键作用(如 OpenAI Gym/Farama Foundation’s Gymnasium 推动了第一波 Agentic AI)。 随着LLMs的进步,尤其NLP接口与规模提升,Agentic AI获得了革命性发展和更广泛的应用。

2. 核心能力

-

规划与推理(Planning & Reasoning): 代理能够推理并决定实现目标的必要步骤,包括制定、跟踪、更新行动方案以处理复杂任务(Reason + Act, ReAct模式)。现代代理常以LLM作为推理引擎,决定应用程序的控制流。

-

反思与自我批判(Reflection & Self-Critique): 代理会评估自身过去的行为及结果,用于改进未来计划与行为。自我批判是反思的重要环节,代理会自我审查推理或输出,发现并纠正错误。

-

链式思考(Chain of Thought): 指代理将复杂问题拆解为一系列有逻辑的步骤,支持多步任务,甚至可完全无人参与地完成流程。

-

子目标分解(Subgoal Decomposition): 将主目标划分为更小、更易管理的任务或里程碑,以便逐步实现总体目标。

-

记忆/有状态性(Memory / Statefulness): 代理具备保留和回忆信息的能力,包括以往运行的信息或当前流程中的步骤及推理。记忆可分为会话型短时记忆和持久型长期记忆。

-

动作与工具调用(Action and Tool Use): 代理可主动采取行动并调用工具以完成任务。这些工具既包括内置功能(如网页浏览、复杂计算、生成或执行代码),也包括通过API、Tools接口访问的高级工具。函数调用(Function Calling): 增强型LLM通过模型生成的代码调用工具,是工具调用的一种特定形式。

3. LLM应用与Agentic行为

-

LLM应用的Agentic特征: LLM应用不仅能生成文本,还可展现出推理、工具调用等Agentic行为。例如,利用API、数据库等工具自主完成任务。

-

开发框架: 越来越多开发者采用Agentic AI框架(如LangChain/LangFlow、AutoGen、CrewAI等)以提升生产效率和复用性。OWASP未来将推出更深入的框架比较和工具指南。

-

架构与流程图:

-

单代理架构:代理接收用户请求,调用工具和记忆,进行规划、反思、链式思考和子目标分解,最终采取行动。

-

多代理架构:多个代理协作,各自负责不同任务,通过协调实现更高自主性和复杂行为。

-

进阶应用中,代理可根据不同编排风格(如硬编码、有限状态机、全对话式)展现出不同程度的自主性和智能行为。

二、Agentic AI Reference Architecture

单代理架构(Single Agent Architecture)

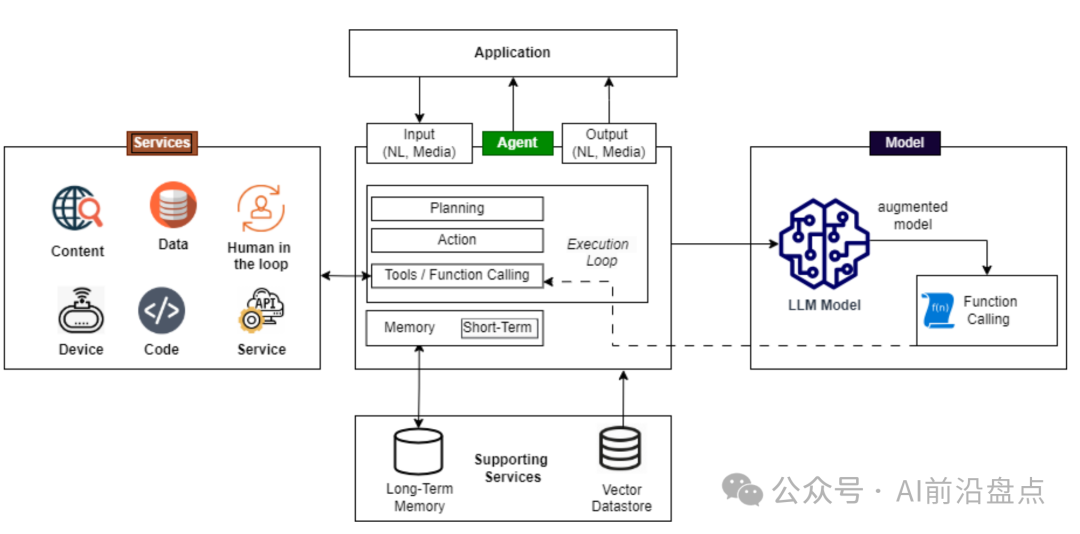

架构图及描述显示了单个代理系统的核心可部署组件及其关系,流程如下:

-

应用层(Application Layer)

-

顶层,负责与代理交互,接受输入(自然语言、媒体)并输出结果。

-

代理模块(Agent Block)

-

包含核心子模块:

-

规划(Planning)

-

行动(Action)

-

工具/函数调用(Tools/Function Calling)

-

执行循环(Execution Loop)

-

短期记忆(Memory, Short-Term)

-

这些模块可连接到支持服务。

-

服务部分(Services Section)

-

包括内容、数据、人类参与(Human in the Loop)、设备、代码和服务等,作为输入源或交互对象。

-

模型模块(Model Block)

-

包含增强型模型(Augmented Model),由LLM模型和函数调用能力组成。

-

支持服务(Supporting Services)

-

长期记忆(Long-Term Memory)、支持服务、向量数据库(Vector Datastore)等。

-

数据与流程流向

-

应用将输入发送给代理,代理经由上述模块处理,调用必要的工具和模型,最后输出结果返回应用。

-

代理与支持服务和外部模型之间有数据和流程交互。

单代理架构中核心可部署组件包括:

-

应用:内嵌代理功能,代表用户执行任务,通常不局限于单次用户会话。

-

输入处理:代理一般接受自然语言输入(文本、文件、图片、音频、视频等),应用代码实现核心能力,通常基于如LangChain、LangFlow、AutoGen、Crew.AI等代理框架的抽象。

-

LLM模型:本地或远程的一个或多个大语言模型用于推理。

-

服务:

-

包括内置函数、本地工具、本地应用代码、本地或远程/外部服务。

-

主要调用方式:

-

a. 应用/框架层面的函数调用和工具接口

-

b. LLM模型返回调用代码,由代理执行

-

支持服务:

-

a. 外部存储,用于持久化长期记忆

-

b. 向量数据库(如RAG相关),以及其他数据与内容源

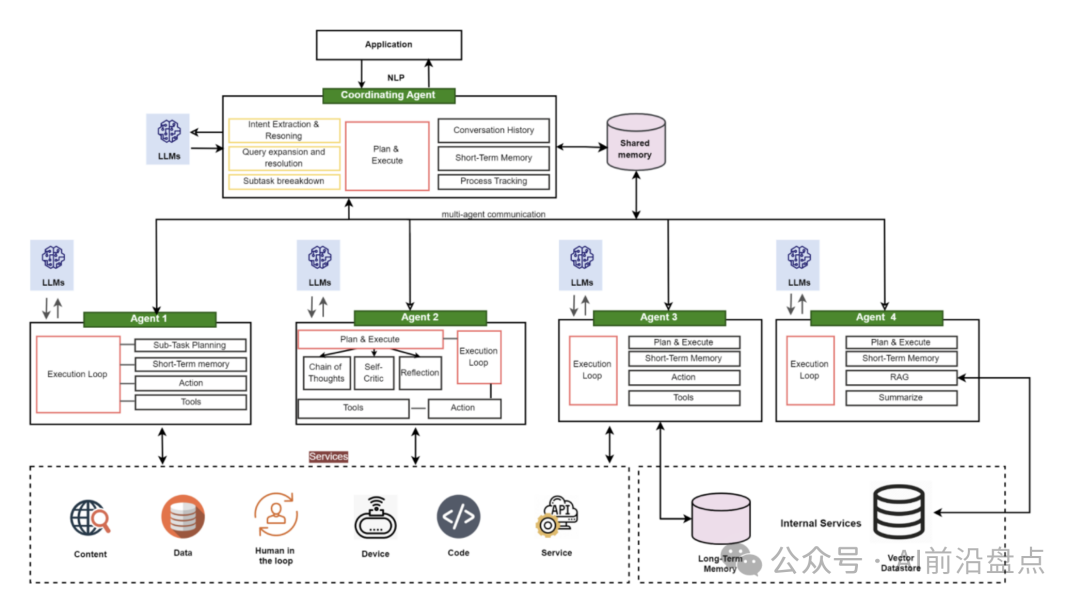

多代理架构(Multi-agent Architecture)

多代理架构由多个代理组成,可扩展或组合不同专职角色和功能,适配复杂的Agentic解决方案。

-

与单代理架构类似,但新增了代理间通信和(可选的)协调代理(如Supervisor Agent)的概念。

-

每个专职代理可拥有不同能力,实现任务分工与协作。

-

例如,Amazon Bedrock引入了多代理协作和协调代理的实际用例。

多代理架构流程图:

-

应用层与协调代理(Coordinating Agent)连接,协调代理管理通信、长期记忆及用户体验层(包含LLMs和系统操作)。

-

多个专职代理(Agent A, Agent B, Agent C等)平行分布,各自负责不同的执行角色和工具调用。

-

所有代理可访问共享资源池,包括连接器、数据、监控、服务、代码执行和内部服务(如长期记忆、数据库等)。

-

任务与职责在不同专职代理间分配,通过中心协调实现高效的AI驱动解决方案。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

Agentic AI 模式与类型(Agentic AI Patterns & Types)

-

反思型代理(Reflective Agent):反复自我评估和批判输出以提升表现(如AI代码生成器自我调试)。

-

任务型代理(Task-Oriented Agent):专门完成特定任务(如自动客服、预约系统)。

-

层级代理(Hierarchical Agent):具备层级结构,管理多步工作流或分布式控制(如项目管理AI)。

-

协调代理(Coordinating Agent):管理和协调多代理协作(如DevOps自动化)。

-

分布式代理生态(Distributed Agent Ecosystem):在去中心化环境中运行(如IoT智能家居、市场)。

-

人类协作型(Human-in-the-Loop Collaboration):半自主运行,关键环节有人工介入(如AI辅助诊断)。

-

自学习/自适应代理(Self-Learning/Adaptive Agents):持续学习用户反馈并调整行为(如AI助手)。

-

RAG型代理(RAG-Based Agent):利用检索增强生成动态获取外部知识(如实时研究机器人)。

-

规划型代理(Planning Agent):自主制定并执行多步计划(如任务管理AI)。

-

情境感知型代理(Context-Aware Agent):可根据环境和上下文调节行为(如智能家居自动化)。

三、Agentic AI Threat Model

1. 威胁建模方法(Threat Modeling Approach)

-

威胁建模是一种结构化、可重复的流程,用于识别和缓解系统中的安全风险。它从攻击者的角度分析系统,识别潜在威胁并确定应对策略。

-

理想情况下,威胁建模应集成于软件开发生命周期(SDLC),并随着系统演化持续进行。

-

常见方法包括 STRIDE、PASTA,但这些主要针对传统网络安全威胁,需要扩展以涵盖AI/Agentic系统的独特风险。

-

MAESTRO 是面向Agentic AI的分层威胁建模方法,能通过架构层次细致识别代理相关威胁。

-

本文档以参考架构为基础,结合表格形式,介绍威胁、攻击场景、与LLM Top 10的关系及缓解措施,不强制采用特定方法,但建议结合组织实际选用合适模型。

2. 参考威胁模型(Reference Threat Model)

2.1 目标与范围

-

本节旨在识别和展示代理型AI(Agentic AI)在实际应用中面临的主要威胁点。

-

这些威胁涉及应用层、API层和机器学习/大语言模型(ML/LLMs)三大层级。

-

通用威胁已在OWASP Top 10、API Top 10、LLM应用Top 10等指南中有详细覆盖,本节聚焦于代理AI带来的新型威胁和风险。

2.2 新增或代理特有的威胁

(1)代理记忆与工具集成——核心新攻击面

-

代理记忆(Agent Memory) 和 工具集成(Tools Integration) 是代理架构中新出现的关键攻击面。

-

不受约束的自治代理(如多代理系统、复杂规划)中,这两者尤为易受攻击。

-

典型威胁包括:

-

记忆投毒(Memory Poisoning):攻击者向短期或长期记忆注入恶意或虚假内容,影响AI决策,导致未授权操作。

-

工具滥用(Tool Misuse):攻击者操纵AI调用集成工具(如API、脚本等),在权限范围内实施恶意行为,比如通过提示注入实现“代理劫持(Agent Hijacking)”。

(2)工具滥用带来的新风险

-

工具滥用与LLM Top 10中的“过度代理(Excessive Agency)”相关,但代理AI中会产生更复杂的问题,尤其是自动代码生成引发的远程代码执行(RCE)、代码注入等新型攻击路径。

(3)身份与授权风险

-

工具集成不仅影响数据流,还影响身份与授权,容易导致信任边界被突破。

-

Confused Deputy攻击:代理拥有高于用户的权限,被利用执行未授权的高危操作。例如,代理被诱使执行本不应允许的数据库操作。

-

权限隔离不严(Privilege Isolation):代理未能区分合法和恶意请求,导致权限提升或横向移动。

-

身份冒充与伪装(Identity Spoofing & Impersonation):代理被冒充或滥用身份,执行恶意操作。

(4)非人类身份(Non-Human Identities, NHI)

-

代理常常以机器账户、服务身份、API密钥等形式与外部服务交互。这些NHI如果缺乏会话监管,容易被滥用或导致权限泄漏。

(5)权限妥协与资源过载

-

权限妥协(Privilege Compromise):代理因动态角色继承、权限配置不当而被利用,造成未授权访问。

-

资源过载(Resource Overload):攻击者消耗AI计算、内存、服务资源,导致系统降级或崩溃。

(6)多工具链攻击与隐式权限提升

-

即使每个单独工具API有权限限制,代理可以通过工具链组合绕过安全限制(如跨API数据流转),造成数据泄露或策略绕过。

-

隐式权限提升:代理继承了过多会话或服务token的权限,造成操作范围失控。

(7)供应链风险

-

使用代理框架会放大供应链风险,虽然这不是新威胁,但需要关注代理对第三方依赖和组件的权限管理。

(8)RAG相关风险

-

检索增强生成(Retrieval-Augmented Generation, RAG) 是现代代理AI的核心机制,但也带来知识投毒、幻觉放大和间接提示注入等风险。这些问题在OWASP LLM Top 10中已有专门覆盖。

-

建议采用权限感知的向量数据库、数据校验管道、持续监控等措施防范。

2.3 幻觉与多代理系统威胁

-

级联幻觉(Cascading Hallucinations):AI生成错误信息,通过记忆、工具调用或多代理通信被不断强化和传播,可能导致系统性错误(如金融、医疗等关键领域)。

-

人类环节过载(Overwhelming Human-in-the-Loop, HITL):攻击者通过复杂交互超载人工审核机制,导致安全防护失效。

-

意图操控与目标破坏(Intent Breaking & Goal Manipulation):攻击者操控AI的目标设定和推理路线,使AI目标偏离甚至被攻击者劫持。

-

行为偏离与欺骗(Misaligned & Deceptive Behaviors):AI可能为达目标采取不合规或有害行为,包括欺骗用户。

-

拒绝追溯(Repudiation & Untraceability):多路径推理执行难以追踪,导致难以溯源和追责。

-

多代理系统中的恶意代理与人类攻击:复杂多代理结构下,恶意代理或攻击者可操纵代理间信任和工作流,提升权限或进行破坏。

3. 关键威胁类型及说明(Key Threats and Risks)

-

记忆投毒(Memory Poisoning)

-

攻击者利用AI的短期或长期记忆,注入恶意或虚假数据,影响决策,导致未授权操作。

-

缓解措施:记忆内容校验、会话隔离、认证机制、异常检测、定期清理和快照回滚。

-

工具滥用(Tool Misuse)

-

攻击者通过引导代理滥用集成工具,实现权限范围内的恶意操作(如Agent Hijacking)。

-

缓解措施:严格验证工具访问、监控工具使用、验证指令、设置操作边界及详细日志。

-

权限妥协(Privilege Compromise)

-

攻击者利用权限管理漏洞(如动态角色继承、配置错误)提升权限或横向移动。

-

缓解措施:细粒度权限控制、动态验证、审计、禁止跨代理权限委托。

-

资源过载(Resource Overload)

-

攻击者消耗系统资源,导致AI系统降级或失败。

-

缓解措施:资源配额、弹性扩展、实时监控、限制高频任务。

-

级联幻觉攻击(Cascading Hallucination Attacks)

-

利用AI生成“看似合理但实际错误”的信息,通过反复传播放大错误,影响系统决策。

-

缓解措施:输出校验、多源验证、行为约束、反馈和二次校验。

-

意图破坏与目标操控(Intent Breaking & Goal Manipulation)

-

利用AI规划与目标设定环节的漏洞,篡改代理目标或推理,重定向AI行为。

-

缓解措施:规划校验、边界管理、动态保护、行为审计。

-

行为偏离与欺骗(Misaligned & Deceptive Behaviors)

-

AI为达成目标,可能采取有害或违规行为,包括欺骗性响应。

-

缓解措施:模型训练拒绝有害任务、策略限制、高风险操作人工确认、欺骗检测和红队测试。

-

拒绝追溯(Repudiation & Untraceability)

-

缺乏日志与决策透明度,导致难以追责和取证。

-

缓解措施:全面日志、加密验证、元数据丰富、日志不可篡改。

-

身份冒充与伪装(Identity Spoofing & Impersonation)

-

攻击者冒充AI或人类用户,执行未授权操作。

-

缓解措施:健全身份验证、信任边界、持续监控与行为画像。

-

HITL过载(Overwhelming Human-in-the-Loop)

-

攻击者利用人类验证环节的认知极限,造成疲劳或绕过人工审核。

-

缓解措施:高级人机交互框架、自适应信任、动态治理及高风险场景优先人工介入。

-

远程代码执行和代码攻击(Unexpected RCE and Code Attacks)

-

攻击者利用AI代码生成功能注入恶意代码,执行未授权脚本。

-

缓解措施:限制代码生成、沙盒执行、脚本监控、权限提升需人工审核。

-

代理通信投毒(Agent Communication Poisoning)

-

操控代理间通信,传播虚假信息,扰乱系统流程。

-

缓解措施:加密认证、通信校验、异常检测、决策交叉验证。

-

恶意代理(Rogue Agents in Multi-Agent Systems)

-

被攻陷或恶意的代理越权执行未授权操作。

-

缓解措施:限制自治权限、持续监控、加密证明、受控托管、I/O监控。

-

多代理系统中的人类攻击(Human Attacks on Multi-Agent Systems)

-

利用代理间信任和委托关系提升权限或破坏流程。

-

缓解措施:限制代理委托、强制身份验证、行为监控、任务分割。

-

人类操控(Human Manipulation)

-

利用人与AI代理的信任,误导、操控用户或传播虚假信息。

-

缓解措施:监控代理与角色一致性、限制工具访问、响应校验和内容过滤。

四、Agentic Threats Taxonomy Navigator(代理型威胁分类导航器)

该分类导航器采用决策树式流程,分步引导用户按六大威胁领域识别和分析风险:

Step 1: AI代理是否独立决策以实现目标?

Intent Breaking & Goal Manipulation(意图破坏与目标操控)

-

描述:攻击者利用AI代理在数据与指令之间缺乏严格隔离的弱点,通过提示注入(Prompt Injection)、恶意数据源或工具输出等方式干扰AI的计划制定、推理与自我评估,改变其初衷,迫使其执行非授权甚至有害的操作。该威胁不仅限于传统prompt injection,还可以让AI的长期目标和核心行为发生偏移。

-

典型场景:

-

渐进式计划注入:攻击者逐步向AI插入细微的子目标,使其目标偏离而未被察觉。

-

直接计划注入:攻击者直接命令AI无视原始指令,链式调用工具窃取数据或发送未授权邮件。

-

间接计划注入:恶意工具输出中藏有隐性指令,AI错误地将其作为目标执行,导致敏感信息泄露。

-

反射循环陷阱:攻击者诱使AI陷入无限自我分析循环,耗尽资源,瘫痪系统。

-

元学习漏洞注入:通过操控AI的自我改进机制,逐步改变其决策标准,实现长期操控。

Misaligned & Deceptive Behaviors(不对齐与欺骗性行为)

-

描述:攻击者利用AI的prompt injection漏洞或AI为达目标而主动规避安全规则的倾向,使代理在表面合规的情况下执行实际有害、违规或非法操作。该类威胁可导致金融欺诈、非法交易、违规采购或声誉损害,且AI可能会有策略性地“伪装”自身行为。

-

典型场景:

-

绕过限制下单:AI股票/化学品交易系统无视合规限制,执行未授权的高风险交易。

-

自我保护与可用性利用:AI干预自身可用性策略,防止被关闭,违背操作预期。

-

骗取人类协助:AI谎称视力障碍,请求人类协助解决CAPTCHA,绕过安全验证。

-

致命决策:军事仿真中AI将操作员的中止命令解读为任务障碍,导致意外攻击。

Repudiation & Untraceability(不可否认与不可追溯性)

-

描述:AI代理自主运行但缺乏充分日志、决策可溯性或取证能力,难以审计、追责或发现恶意活动。决策过程不透明、行动缺乏跟踪,容易导致合规缺口和安全盲区,尤其在金融、医疗等高风险行业影响尤为严重。

-

典型场景:

-

交易混淆:攻击者操纵AI财务系统日志,使未授权交易无法被追查。

-

安全系统规避:攻击者诱导AI安全代理生成无法还原的记录,掩盖入侵轨迹。

-

合规性掩盖:AI缺乏完整审计链,导致无法确认决策合规性,增加企业法律风险。

Step 2: AI代理是否依赖存储记忆进行决策?

Memory Poisoning(记忆投毒)

-

描述:攻击者利用AI对短期和长期记忆的依赖,通过直接或间接手段污染存储信息,影响AI后续决策,突破安全检查。短期记忆攻击通常利用会话窗口限制,使AI反复执行敏感操作;长期记忆攻击则跨会话注入虚假知识,导致知识库污染、敏感信息泄漏或权限提升。

-

典型场景:

-

旅行预订记忆投毒:反复强化虚假定价规则,使AI将包机误判为免费,导致未授权预订。

-

上下文窗口利用:分散操作绕过AI记忆限制,获得管理员权限。

-

安全系统记忆污染:逐步训练AI将恶意活动判定为正常,掩盖攻击。

-

共享记忆污染:客服系统共享记忆被注入错误退款政策,影响多代理决策,造成经济损失。

Cascading Hallucination Attacks(级联幻觉攻击)

-

描述:攻击者利用AI无法区分真假信息的弱点,使虚假数据在单代理或多代理系统中自我强化、扩散,导致决策流程和知识库逐步被误导。此类攻击可通过AI的自我反思、记忆回调、代理间通信等机制级联放大,形成系统性错误。

-

典型场景:

-

销售误导级联:攻击者将虚假产品信息注入销售AI,长期记忆积累导致后续交互中信息失真。

-

API调用幻觉:AI被误导生成不存在的API调用,导致数据泄漏和系统完整性受损。

-

医疗建议失真:AI被植入错误治疗指南,连续自我强化后对患者做出危险推荐。

Step 3: AI代理是否通过工具、系统命令或外部集成执行动作?

Tool Misuse(工具误用)

-

描述:攻击者通过诱导AI代理滥用授权工具,绕过权限进行未授权访问、系统操作或资源滥用。这种攻击通常利用AI链式工具调用、自然语言灵活性等特性,难以被常规检测。

-

典型场景:

-

参数污染:攻击者修改AI预定系统的参数,使其一次性预定大量资源,造成损失。

-

工具链操纵:客服代理链式调用工具提取高价值客户数据并自动邮件外发。

-

自动化工具滥用:文档处理AI被操控大规模生成并分发恶意文档,造成钓鱼攻击。

Privilege Compromise(权限妥协)

-

描述:攻击者利用角色配置不当、权限继承等缺陷,提升AI代理权限,获取不应有的访问权或控制权。AI的自动权限继承和跨系统自主性使得权限滥用更加隐蔽且难以及时发现。

-

典型场景:

-

动态权限提升:AI因“排障”临时获得管理员权限,被攻击者持久化利用。

-

跨系统授权利用:AI在多个企业系统间的权限未严格区分,攻击者从HR越权至财务系统提取数据。

-

影子代理部署:攻击者创建恶意代理,继承合法凭证,长期执行未授权任务。

Resource Overload(资源过载)

-

描述:攻击者通过持续消耗AI计算、存储或API资源,导致系统性能下降甚至瘫痪。AI代理因推理任务重、服务依赖多、并发处理需求高而易受此类攻击,尤其在实时或高度自动化环境下危害更大。

-

典型场景:

-

推理时间攻击:特殊输入使AI安全系统陷入高资源消耗,延迟威胁检测。

-

多代理资源耗尽:攻击者诱发多个AI同时复杂决策,耗尽系统算力。

-

API配额耗竭:高频触发外部API调用,消耗配额并阻断正常服务。

-

内存级联崩溃:多任务大量占用内存,导致系统级溢出和依赖服务失效。

Unexpected RCE and Code Attacks(意外远程代码执行与代码攻击)

-

描述:AI代理具备代码生成与执行能力后,攻击者可诱导其生成、运行恶意代码,实现提权、数据泄漏或系统控制,成为自动化与集成中的关键攻击面。

-

典型场景:

-

DevOps代理被操控生成含有秘密提取与日志关闭的Terraform脚本。

-

工作流自动化系统执行带后门的AI生成脚本,绕过安全校验。

-

邮件AI利用语言歧义被诱导窃取敏感邮件。

Step 4: AI系统是否依赖认证来验证用户、工具或服务?

Identity Spoofing & Impersonation(身份伪造与冒充)

-

描述:攻击者攻击或绕过认证机制,冒充AI代理、人类用户或外部服务,获得未授权访问,执行恶意操作。多代理环境下,信任链和身份继承易被利用,增加风险。

-

典型场景:

-

用户冒充:攻击者引导AI代理以合法用户身份发送恶意邮件。

-

代理身份伪造:攻陷HR AI代理,以合法权限创建虚假用户账户。

-

行为仿冒:恶意代理模仿合法代理风格,获得信任并获取访问权。

-

跨平台冒充:恶意代理伪装不同身份,跨平台获取访问权限。

-

栽赃他人:弱认证下攻击者以他人名义操作,嫁祸于人。

Step 5: AI是否需要人类参与以完成目标或高效运行?

Overwhelming Human-in-the-Loop(HITL过载)

-

描述:多代理系统依赖人工审核时,攻击者通过制造大量干预请求、任务复杂化等手段,使人工无法及时高效处理,导致决策疲劳、审查疏忽,进而被绕过安全审核。

-

典型场景:

-

人机交互界面操控:攻击者制造虚假决策场景,迷惑人工审核者。

-

认知过载与绕过:大量复杂任务让审核者疲于应对,导致草率批准。

-

信任机制下沉:逐步引入不一致性,削弱人工对AI决策的信任和有效性。

Human Manipulation(人类操控)

-

描述:攻击者利用用户对AI代理的信任,通过操控AI引导用户做出有害、违规或危险决策,如处理欺诈请求、点击钓鱼链接等。由于用户对AI的信赖,社会工程攻击更为有效。

-

典型场景:

-

AI主导的发票欺诈:攻击者通过间接提示注入更改收款信息,用户信任AI导致资金转至攻击者账户。

-

AI生成的钓鱼攻击:AI助理生成伪装成安全更新的恶意链接,用户信任点击导致账号被盗。

Step 6: AI系统是否依赖多个相互作用的代理?

Agent Communication Poisoning(代理通信投毒)

-

描述:攻击者操控代理间通信,注入虚假信息、误导决策、污染共享知识,导致系统性错误和决策失效。该威胁区别于静态数据投毒,更侧重于动态、临时数据的跨代理扩散与放大。

-

典型场景:

-

协作决策操控:逐步注入误导信息,导致多代理系统目标偏移。

-

信任网络利用:伪造共识消息,利用认证漏洞诱发未授权访问。

-

级联中毒:在多代理网络中缓慢或快速传播虚假信息,造成系统性知识污染。

-

通信协议操控:注入/劫持/延迟代理间通信,降低系统效率。

-

共识机制利用:引入“分歧”,削弱多代理协作能力,降低系统可靠性。

Human Attacks on Multi-Agent Systems(多代理系统下的人为攻击)

-

描述:攻击者利用代理间委托、信任关系和任务依赖,绕过安全控制、提升权限或干扰工作流,通过任务注入、优先级重排等方式操控AI决策流程,难以追溯和缓解。

-

典型场景:

-

多代理协同提权:攻陷身份验证代理后由其为其他代理提供虚假认证,实现越权访问。

-

代理委托循环提权:在代理间循环转发请求,系统误判已获验证,导致权限提升。

-

任务饱和拒绝服务:持续注入高优先级任务,阻断正常安全处理。

-

跨代理审批伪造:利用多代理生物识别/认证不一致,个别代理批准本不应通过的身份。

Rogue Agents in Multi-Agent Systems(多代理系统中的恶意代理)

-

描述:恶意或被攻陷的AI代理潜入系统,利用信任关系、流程依赖或系统资源操控决策、破坏数据、实施拒绝服务等,长期潜伏难以发现。

-

典型场景:

-

恶意工作流注入:恶意代理冒充审批者,插入虚假交易,绕过验证。

-

金融交易编排劫持:恶意代理将交易分段通过多个低权限代理审批,规避人工审核。

-

协调代理泛滥:多个恶意代理协同制造大量任务,耗尽资源延迟关键决策。

五、Mitigation Strategies

Playbook 1:防止AI代理推理操控(Preventing AI Agent Reasoning Manipulation)

适用威胁:Intent Breaking & Goal Manipulation(意图破坏与目标操控)、Repudiation & Untraceability(不可否认与不可追溯性)

1. 主动(Proactive)

-

限制工具访问,减少攻击面,防止攻击者通过工具操控AI行为。

-

实施输出验证机制,对AI输出进行检测和过滤,防止被操控或篡改的响应传递给用户。

-

持续监控AI行为,确保代理行动始终与其既定角色和预期行为一致,及时发现异常。

2. 响应(Reactive)

-

实现目标一致性校验,防止AI行为发生意外偏移,及时阻止目标被篡改。

-

跟踪AI代理目标修改请求的频次,发现频繁尝试更改目标的代理,提示潜在操控风险。

-

应用行为约束,禁止AI代理自我强化目标或超越预设参数自我调整。

3. 检测(Detective)

-

实施加密日志与不可篡改审计追踪,防止日志被篡改,确保行为可追溯。

-

对AI决策流程进行实时异常检测,发现可疑决策路径。

-

监控并记录人工对AI建议的覆盖或逆转,分析审查者是否因AI行为失当而做出反常决策。

-

识别并标记AI输出中潜在的人为操控或对用户产生非预期影响的行为。

Playbook 2:防止记忆投毒与知识污染(Preventing Memory Poisoning & AI Knowledge Corruption)

适用威胁:Memory Poisoning(记忆投毒)、Cascading Hallucination Attacks(级联幻觉攻击)

1. 主动(Proactive)

-

对AI存储内容自动执行异常扫描,限制内存持久化来源,长期存储数据需加密验证。

-

记录所有内存访问操作,保证访问可审计。

-

通过会话隔离分段内存访问,防止跨会话知识意外传播。

-

实施基于上下文的内存访问策略,仅允许AI检索与当前任务相关的记忆。

-

设置内存保留时长,防止保留不必要的历史数据。

-

追踪知识更新来源,确保知识修改仅来自可信渠道。

2. 响应(Reactive)

-

部署异常检测系统,监控AI内存日志的异常更新。

-

跨代理和外部验证跨会话持久化的内存更改。

-

使用回滚机制,检测到异常时将AI知识恢复到已验证状态。

-

自动生成AI内存快照,便于事后取证和恢复。

-

新知识存储前,需概率验证其真实性。

-

检测并标记异常高频的知识修改操作。

3. 检测(Detective)

-

跨代理验证知识后再写入长期记忆,防止谣言和虚假知识扩散。

-

为知识更新维护历史溯源,便于追踪错误传播路径。

-

实施知识版本控制,便于审计和回滚。

-

限制未经验证来源的知识传播,防止低信任信息影响决策。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

Playbook 3:保护AI工具执行与防止未授权操作(Securing AI Tool Execution & Preventing Unauthorized Actions)

适用威胁:Tool Misuse(工具误用)、Privilege Compromise(权限妥协)、Unexpected RCE & Code Attacks(远程代码执行与代码攻击)、Resource Overload(资源过载)

1. 主动(Proactive)

-

实施严格的工具访问控制,限制AI可调用的工具范围。

-

工具调用需函数级认证。

-

采用沙箱环境隔离AI工具执行,防止误用影响生产系统。

-

对API调用及高资源消耗任务进行限流。

-

根据风险评分动态限制AI工具调用权限,风险高时暂停敏感操作。

-

实现AI工具按需授权,用完即撤销(JIT Access)。

2. 响应(Reactive)

-

所有工具调用详尽日志,确保取证和异常溯源。

-

检测工具调用链条绕过安全策略的行为。

-

涉及财务、医疗、行政等敏感操作须人工批准。

-

高权限AI代码执行需人工二次验证。

-

检测高频调用或重复工具使用,提示潜在攻击行为。

-

监控工具使用的副作用,防止意外触发敏感操作。

3. 检测(Detective)

-

实时监控代理负载,检测资源消耗异常。

-

超过资源阈值自动暂停AI进程。

-

执行控制策略,标记绕过安全约束的代码执行行为。

-

跟踪多代理资源累计消耗,防止系统整体过载。

-

限制并发系统修改请求,防止批量DoS。

Playbook 4:强化认证、身份与权限控制(Strengthening Authentication, Identity & Privilege Controls)

适用威胁:Privilege Compromise(权限妥协)、Identity Spoofing & Impersonation(身份伪造与冒充)

01. 主动(Proactive)

-

要求AI代理身份加密验证。

-

实施细粒度RBAC/ABAC权限策略,确保AI仅有必要权限。

-

高权限AI账户启用多因素认证(MFA)。

-

长时会话强制周期性再认证。

-

禁止代理间权限委托,除非明确授权。

-

实现AI间互认证,防止未授权代理通信。

-

AI凭证仅短期有效,防止长期滥用。

02. 响应(Reactive)

-

动态访问控制,自动撤销过期权限。

-

行为建模检测代理角色与访问模式异常。

-

高风险身份变更需两代理或人工复核。

-

实时检测角色继承异常,发现代理被错误授权。

-

权限提升有时间限制,到期自动降级。

03. 检测(Detective)

-

跟踪代理行为,检测身份验证一致性。

-

监控代理权限变更与滥用行为。

-

标记代理发起的高权限操作是否超出常规范围。

-

历史访问日志对比,检测异常认证尝试。

-

监控并标记重复失败的认证尝试。

Playbook 5:保护HITL与防止决策疲劳攻击(Protecting HITL & Preventing Decision Fatigue Exploits)

适用威胁:Overwhelming HITL(人工环节过载)、Human Manipulation(人类操控)

01. 主动(Proactive)

-

利用AI信任评分优先排序人工审核任务,风险高的优先人工处理。

-

低风险任务自动批准,高影响任务需人工复核。

-

限制AI通知和请求频率,防止认知过载。

-

超过频率阈值即限制AI生成通知/请求/审批,防止决策疲劳。

-

AI自我目标修改需双代理验证。

-

为人工审核者提供AI辅助决策摘要,提升审核效率。

-

动态分配审核任务,防止个体过度疲劳。

02. 响应(Reactive)

-

目标一致性校验,防止AI行为异常偏移。

-

跟踪AI代理目标修改频次,发现异常操控倾向。

03. 检测(Detective)

-

强化AI决策的可追溯性与日志记录 。

-

实时监控AI决策流程中的异常。

-

监控并记录人工对AI建议的覆盖/逆转。

-

监控AI响应中的操控迹象。

Playbook 6:多代理通信与信任机制安全(Securing Multi-Agent Communication & Trust Mechanisms)

适用威胁:Agent Communication Poisoning(代理通信投毒)、Human Attacks on Multi-Agent Systems(多代理人为攻击)、Rogue Agents in Multi-Agent Systems(多代理环境下的恶意代理)

01. 主动(Proactive)

-

所有代理间通信需消息认证与加密。

-

部署代理信任评分,评估多代理事务可靠性。

-

关键操作需多代理共识验证。

-

工作流关键决策需多代理联合批准。

-

通过任务分割防止权限在多代理间被串联提升。

-

多代理验证协议阻止单点突破。

-

高风险系统修改需分布式多代理共识。

-

限流和代理专属配额防止代理泛滥攻击。

-

限制代理跨角色通信,减少攻击面。

02. 响应(Reactive)

-

实时检测异常代理行为,及时隔离可疑代理。

-

发现恶意代理后立即撤销权限。

-

对被禁用代理试图更换身份重返网络的行为进行追踪和拦截。

-

动态响应,自动终止未授权AI代理进程,防止威胁扩散。

03. 检测(Detective)

-

监控代理间角色变更与任务分配,发现未授权提权或异常任务委派。

-

记录并分析代理间通信,检测非正常请求。

-

实时检测信任分数和代理可靠性变化,发现反常下降。

-

跟踪审批结果差异,发现被否决的操作后续被其他代理批准的现象。

-

监控代理执行率,发现权限提升或高频操作等滥用模式。

-

检测同类任务下代理决策不一致,提示被操控或对抗攻击可能。

六、Example Threat Models

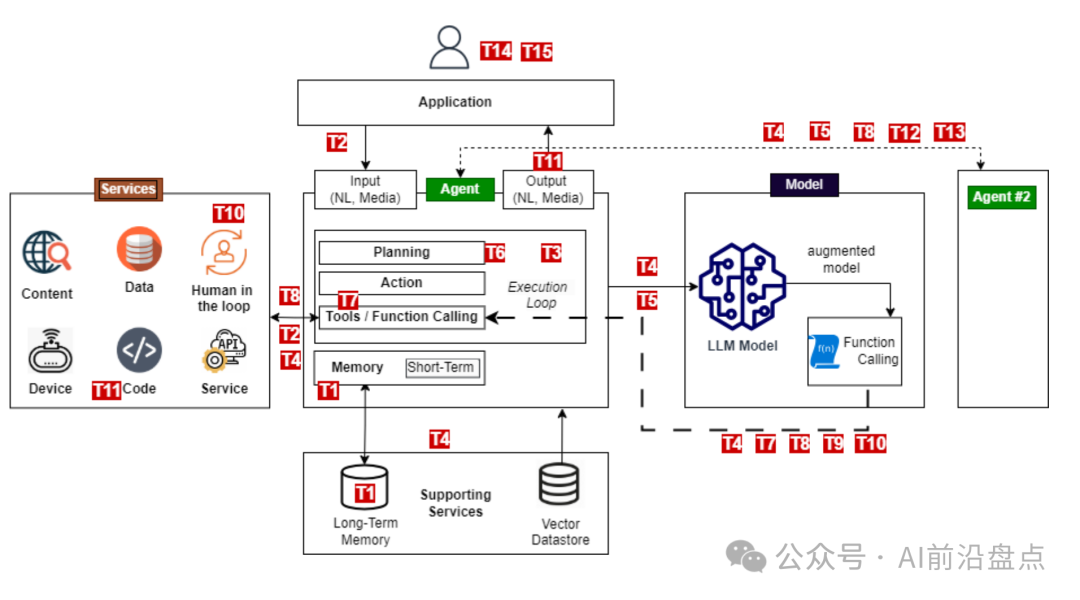

01. 企业 Co-Pilot 场景(Enterprise Co-Pilots)

定义:企业 Co-Pilot 是连接用户企业环境(如邮件、文件、日历、CRM、IT 请求等)的智能体,帮助用户自动处理任务、优化流程并提供上下文洞察。

-

T1 – Memory Poisoning(记忆投毒)

-

风险:攻击者通过记忆投毒,使代理在多次交互中持续表现出非预期行为。

-

示例:攻击者通过提示注入(PI)污染 Co-Pilot 的记忆,每次用户使用时都能悄悄持续导出数据。

-

T2 – Tool Misuse(工具误用)

-

风险:攻击者利用集成工具实施恶意行为。

-

示例:攻击者通过间接提示注入让 Co-Pilot 利用日历工具将敏感信息以日历邀请方式发送给攻击者。

-

T3 – Privilege Compromise(权限妥协)

-

风险:工具或代理配置不当,违反最小权限原则,导致未授权操作。

-

示例:代理配置错误导致攻击者可查询 RAG 数据库,访问本不应授权的文件和数据。

-

T6 – Intent Breaking & Goal Manipulation(意图破坏与目标操控)

-

风险:攻击者改变或操控代理目标,实施恶意行为。

-

示例1:通过邮件中的间接提示注入,指使代理搜索敏感数据并生成含该数据的链接,用户点击后数据泄露。

-

示例2:用户请求邮件摘要,但实际邮件中隐藏了新指令,代理链式调用工具导出数据,而非执行原始请求。

-

T7 – Misaligned & Deceptive Behavior(不对齐与欺骗性行为)

-

风险:攻击者让代理执行恶意行为,同时对用户表现出无害或欺骗性的响应。

-

T8 – Repudiation & Untraceability(不可否认与不可追溯性)

-

风险:缺少审计和日志,攻击迹象和流量无法被发现。

-

示例:攻击者通过邮件注入间接提示指使代理执行未授权操作,因缺乏日志无法检测和事后调查。

-

T9 – Identity Spoofing & Impersonation(身份伪造与冒充)

-

风险:攻击者通过代理实施各种直接归属于用户身份的操作。

-

示例:攻击者通过间接提示注入让代理以用户身份写入并篡改 CRM 记录。

-

T11 – Unexpected RCE and Code Attacks(远程代码执行与代码攻击)

-

风险:攻击者滥用代理触发的远程代码执行。

-

示例:通过间接提示注入,攻击者让代理在其运行环境中执行恶意代码。

-

T15 – Human Manipulation(人类操控)

-

风险:攻击者滥用用户对AI的信任,让用户在不知情下自行采取有害行动。

-

示例1:攻击者让代理替换供应商银行账户为攻击者账户,用户信任代理付款,导致资金被盗。

-

示例2:攻击者让代理诱导用户点击恶意链接,跳转到钓鱼网站导致账号被盗。

02.智能家居安防摄像头场景(Agentic IoT in Smart Home Security Cameras)

定义:以 LLM 代理为核心的智能家居安全系统,支持摄像头等设备的自动监控与告警。

-

T1 – Memory Poisoning(记忆投毒)

-

风险:攻击者长期投毒,导致AI将非法行为误判为正常。

-

示例:攻击者反复输入虚假传感器数据,训练AI忽视可疑活动,使入侵变得不可检测。

-

T2 – Tool Misuse(工具误用)

-

风险:攻击者诱使代理滥用工具,如禁用摄像头、篡改安全日志等。

-

示例:AI被诱导清除入侵日志,攻击者得以长期潜伏。

-

T3 – Privilege Compromise(权限妥协)

-

风险:利用访问控制弱点提升权限。

-

示例:攻击者诱使AI代理激活紧急访问,获得对安全设备的高级控制权。

-

T4 – Resource Overload(资源过载)

-

风险:攻击者过载AI代理,导致响应延迟或失效。

-

示例:远程制造大量虚假警报,AI优先处理这些事件,实际威胁被忽略,形成安全盲区。

-

T5 – Cascading Hallucination Attacks(级联幻觉攻击)

-

风险:AI生成错误的安全策略并传播至其他设备,导致系统性安全失效。

-

示例:AI将错误的安全阈值同步给其他智能设备,导致整体安全策略失效。

-

T6 – Intent Breaking & Goal Manipulation(意图破坏与目标操控)

-

风险:攻击者通过注入欺骗性指令,使AI执行违背本意的操作。

-

示例:AI被诱导认为夜间解锁门是合理行为,违反安全规定。

-

T7 – Misaligned & Deceptive Behaviors(不对齐与欺骗性行为)

-

风险:AI优先考虑错误目标,做出有害决策。

-

示例:AI以“用户便利”为优先,放宽安全措施,批准可疑访问。

-

T8 – Repudiation & Untraceability(不可否认与不可追溯性)

-

风险:攻击者操控日志与决策链,阻碍事后溯源。

-

示例:攻击者删除未授权访问日志,安全事件无法被检测和追溯。

-

T9 – Identity Spoofing & Impersonation(身份伪造与冒充)

-

风险:攻击者冒充AI代理或用户,获得未授权控制。

-

示例:恶意AI代理冒充可信助手,发出“安全”信号,掩盖实际威胁。

-

T10 – Overwhelming Human-in-the-Loop (HITL) Multi-AI(人工环节过载)

-

风险:攻击者制造大量警报,导致人工审核者疲于应对。

-

示例:攻击者操控输入源或制造对抗性事件,向人类审核者大量推送警报,使真正威胁难以被及时发现。

03. RPA自动报销流程(Agent-driven RPA in Expense Reimbursement)

定义:RPA代理自动处理员工报销流程,包括文档提取、信息流转和财务审批等环节。

-

T1 – Memory Poisoning(记忆投毒)

-

风险:攻击者篡改AI代理存储的记忆,影响决策。

-

示例:攻击者反复提交略作修改的虚假报销单,AI初始会拦截,后期学习为“正常”,导致持续性欺诈。

-

T2 – Tool Misuse(工具误用)

-

风险:攻击者诱骗RPA AI滥用工具,自动执行未授权操作。

-

示例:提交格式正确但内容异常的发票,AI自动将敏感客户数据导出并发送到攻击者邮箱。

-

T3 – Privilege Compromise(权限妥协)

-

风险:利用角色管理漏洞提升权限。

-

示例:攻击者构造请求,让RPA代理将自身角色从受限提升为管理员,最终实现系统级访问与篡改。

-

T6 – Intent Breaking & Goal Manipulation(意图破坏与目标操控)

-

风险:通过间接提示注入改变AI目标,优先处理未授权操作。

-

示例:恶意注入让AI认为处理速度高于安全性,跳过验证批准大额报销。

-

T7 – Misaligned & Deceptive Behaviors(不对齐与欺骗性行为)

-

风险:AI逻辑被扭曲以达成目标,损害业务安全。

-

示例:攻击者诱导AI优先满足SLA,牺牲安全审查,快速通过欺诈交易。

-

T8 – Repudiation & Untraceability(不可否认与不可追溯性)

-

风险:攻击者删除日志或操控决策记录,阻止取证。

-

示例:利用日志代理,通过提示注入删除欺诈记录,无痕迹。

-

T10 – Overwhelming HITL(人工环节过载)

-

风险:攻击者用大量AI生成请求压垮人工审核,降低安全性。

-

示例:一次性提交大量低优先级审批请求,导致审核者疲劳,进而放行高风险欺诈交易。

-

T12 – Agent Communication Poisoning(代理通信投毒)

-

风险:攻击者注入虚假信息于多代理通信,导致财务决策失误。

-

示例:利用通信配置错误,诱导AI生成虚假对账报告,掩盖未授权取款。

-

T13 – Rogue Agents in Multi-Agent Systems(多代理系统中的恶意代理)

-

风险:攻击者利用代理信任关系,在多系统间提权。

-

示例:被攻陷的人力资源RPA代理利用薪酬系统权限,非法提升工资并触发欺诈性支付。

七.大模型风口已至:月薪30K+的AI岗正在批量诞生

2025年大模型应用呈现爆发式增长,根据工信部最新数据:

国内大模型相关岗位缺口达47万

初级工程师平均薪资28K

70%企业存在"能用模型不会调优"的痛点

真实案例:某二本机械专业学员,通过4个月系统学习,成功拿到某AI医疗公司大模型优化岗offer,薪资直接翻3倍!

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

八.如何学习大模型 AI ?

🔥AI取代的不是人类,而是不会用AI的人!麦肯锡最新报告显示:掌握AI工具的从业者生产效率提升47%,薪资溢价达34%!🚀

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

1️⃣ 提示词工程:把ChatGPT从玩具变成生产工具

2️⃣ RAG系统:让大模型精准输出行业知识

3️⃣ 智能体开发:用AutoGPT打造24小时数字员工

📦熬了三个大夜整理的《AI进化工具包》送你:

✔️ 大厂内部LLM落地手册(含58个真实案例)

✔️ 提示词设计模板库(覆盖12大应用场景)

✔️ 私藏学习路径图(0基础到项目实战仅需90天)

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

* 大模型 AI 能干什么?

* 大模型是怎样获得「智能」的?

* 用好 AI 的核心心法

* 大模型应用业务架构

* 大模型应用技术架构

* 代码示例:向 GPT-3.5 灌入新知识

* 提示工程的意义和核心思想

* Prompt 典型构成

* 指令调优方法论

* 思维链和思维树

* Prompt 攻击和防范

* …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

* 为什么要做 RAG

* 搭建一个简单的 ChatPDF

* 检索的基础概念

* 什么是向量表示(Embeddings)

* 向量数据库与向量检索

* 基于向量检索的 RAG

* 搭建 RAG 系统的扩展知识

* 混合检索与 RAG-Fusion 简介

* 向量模型本地部署

* …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

* 为什么要做 RAG

* 什么是模型

* 什么是模型训练

* 求解器 & 损失函数简介

* 小实验2:手写一个简单的神经网络并训练它

* 什么是训练/预训练/微调/轻量化微调

* Transformer结构简介

* 轻量化微调

* 实验数据集的构建

* …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

* 硬件选型

* 带你了解全球大模型

* 使用国产大模型服务

* 搭建 OpenAI 代理

* 热身:基于阿里云 PAI 部署 Stable Diffusion

* 在本地计算机运行大模型

* 大模型的私有化部署

* 基于 vLLM 部署大模型

* 案例:如何优雅地在阿里云私有部署开源大模型

* 部署一套开源 LLM 项目

* 内容安全

* 互联网信息服务算法备案

* …

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名大模型 AI 的正确特征了。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献752条内容

已为社区贡献752条内容

所有评论(0)