LangGraph MCP智能体开发详解(第四章)-LangGraph接入HTTP MCP智能体

的工具对象,包括工具名称、功能说明、输入输出参数类型等。服务器,可以学习《【加餐】MCP SSE与流式HTTP开发实战】》课程模块,我们这里不再重复讲解。文件中配置的,按照自己的设置进行登录校验即可。SSE Server,并提供云托管与 Playground,一键生成专属 URL。中包含工具使用说明),因此模型“知道”何时以及如何使用这些工具来获取所需信息。的配置,大家可以根据自己的需求进行开发和

四、LangGraph接入HTTP MCP智能体

1. 接入在线MCP服务流程

在 SSE (Server-Sent Events) 模式 下,我们可以把 MCP 服务器当成一个已经在网络上跑着的「工具 API」,用 URL 建立事件流、再用 POST /messages 发指令。当前主流的使用形式可以归纳为两大类:自托管启动与平台托管直连。

- 自托管启动(Self-hosted)

这种方式主要是应用MCP官方的Python / TypeScript MCP SDK 把 Server 代码跑起来(FastAPI / Express 集成), 程序启动后会打印或返回一个本地或内网 SSE URL,然后便可以用这个 URL 建立事件流接入到OpenAI Agents SDK 框架中。如果需要使用MCP 官方的Python SDK构建SSE 模式的MCP 服务器,可以学习《【加餐】MCP SSE与流式HTTP开发实战】》课程模块,我们这里不再重复讲解。

- 平台托管直连(Platform-hosted)

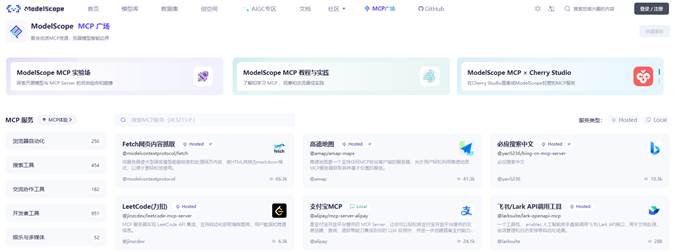

诸如 ModelScope的 MCP 广场、mcp.run等社区维护大量 MPC 服务并支持一键启动MCP的SSE 模式。使用的方法非常简单,只需要在平台首页选好MCP Server → 生成一个API-Key,一键生成 SSE URL ,即可直接接入使用。

对于国内开发者,通过“一键复制 URL + API-Key”就能拿到 SSE 端点的热门网站大致可以分为四类:

- 专门的 MCP 服务市场/目录(如 MCP Market、AIbase、MCP Server Hub);

- 云厂商推出的 官方托管平台(阿里云 “百炼” 与 Higress Marketplace);

- 行业 API 已内置 MCP & SSE(百度地图、腾讯位置服务等);

- IDE / 客户端集市 把第三方 SSE URL 聚合到本地(Cherry Studio、Cursor)。

MCP 热门导航网站

|

平台 |

规模与特点 |

访问链接 |

|

ModelScope MCP 广场 |

超过 3000+ 个中文托管 MCP;详情页右侧直接复制 SSE URL,部分服务需在“API Key”栏目填 Token |

|

|

MCP Market |

标榜“国内首个 MCP 服务市场”,已收录 1W+ SSE Server,并提供云托管与 Playground,一键生成专属 URL |

|

|

AIbase MCP 资源站 |

整理 GitHub 上的热门 MCP Server 并直接给出 SSE 地址与使用教程 |

|

|

MCP Server Hub |

国际化,标签筛选 + “Copy URL” 操作流畅,站内统计数千条 SSE Server |

|

|

阿里云 百炼 |

官方托管“全周期 MCP 服务”,控制台能生成已鉴权的 SSE URL |

平台托管直连不需要开发者关心进程与依赖等问题,直接在网页一键生成URL即可接入。下面我们以ModelScope的MCP 广场为例,演示如何在OpenAI Agents SDK框架中通过SSE 模式接入MCP 服务器。

- Step 1. 进入ModelScope的MCP 广场,访问地址:https://www.modelscope.cn/mcp

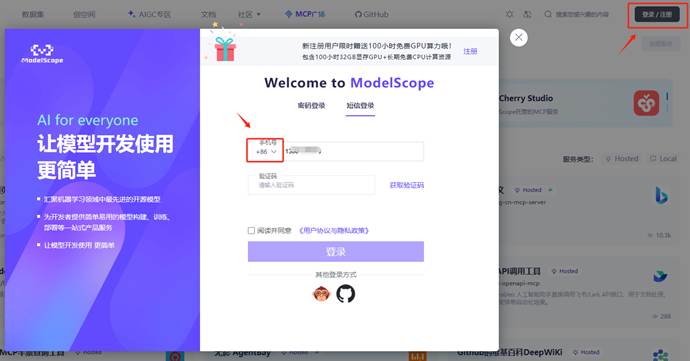

- Step 2. 点击右上角登录按钮,登录ModelScope账号

- 可以通过手机号注册并登录,注意:国内用户记得选择中国大陆 +86 的手机号注册,否则会提示手机号格式错误。

- Step 3. 挑选MCP 服务,并进入详情页

- 这里我们选择的是12306-MCP车票查询工具,该MCP 服务提供了搜索12306购票信息的功能。

- Step 4. 点击立即使用按钮,进入MCP 服务详情页

- 如果是首次使用,在详情页的最右侧会有一个通过SSE URL连接服务的说明

- 点击连接按钮,即可生成一个SSE URL,如下图所示:

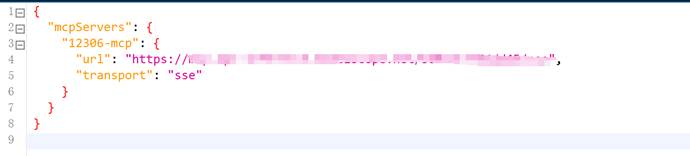

- Step 5. 修改配置文件

|

JSON |

- 实际运行效果

上述过程中,MCP适配器承担了接口映射的工作——它将 MCP Server 提供的工具描述转化为 LangGraph 的工具对象,包括工具名称、功能说明、输入输出参数类型等。大模型在推理中根据工具描述和对话上下文决定何时调用哪个工具,LangGraph负责将调用意图映射为实际的函数调用。调用时,MCP客户端会将函数参数通过既定格式发送给服务器执行,并将结果以标准化的JSON格式返回给LangGraph代理。这一标准通信过程无需开发者处理底层序列化和协议细节,实现了上下文和数据在 LangGraph 与 MCP 之间的透明传递。模型每次调用工具时,当前对话信息会作为提示的一部分(通常由LangGraph agent在内部prompt中包含工具使用说明),因此模型“知道”何时以及如何使用这些工具来获取所需信息。

2. 搭建可视化MCP智能体开发平台

掌握了LangGraph 接入 MCP Server 的原理,接下来我们通过一个实际的案例来进一步加深大家对LangGraph + MCP Server的应用。我们实现了一个基于Streamlit的智能AI代理平台,其包含的主要功能是:

- 多MCP工具集成平台:支持动态添加和管理多个MCP(Model Context Protocol)工具

- 智能对话代理:基于LangGraph创建的ReAct(推理-行动)代理,能够智能选择和使用工具

- 可视化Web界面:提供友好的用户界面进行对话和工具管理

- 多模型支持:目前主要支持DeepSeek模型,架构可扩展支持其他LLM

如下是该系统的运行效果演示:

接下来我们逐步讲解如何在本地部署并启动LangGraph_Multi_MCP应用。

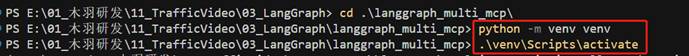

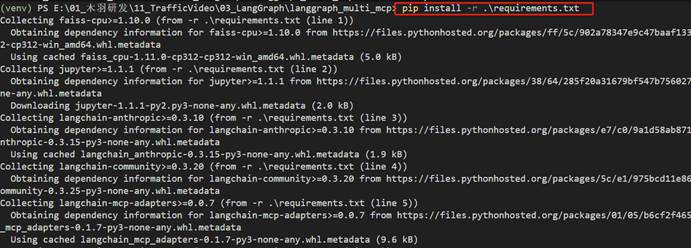

下载源码文件后,首先需要新建一个venv环境:

进入该虚拟环境后,进行依赖项的安装:

接下来,在启动前需要配置.env文件,包含以下配置:

|

Bash |

其次,大家可以参考mcp_server_time.py文件,来实现内置的MCP Server,然后将其写入config.json文件中。

|

Python |

注意:这里可以写多个MCP Server的配置,大家可以根据自己的需求进行开发和应用。注意:前端界面中的添加和删除MCP Server的功能,其实就是对config.json文件的修改。

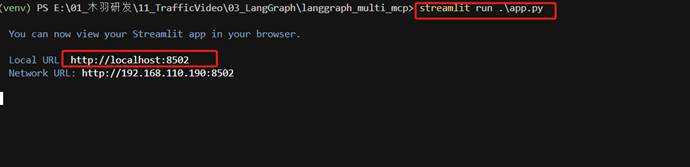

修改完以上配置后,便可以在控制台运行项目了。执行如下命令:

|

Bash |

首次登录时,需要输入用户名和密码,这里的用户名和密码是在.env文件中配置的,按照自己的设置进行登录校验即可。登录成功后,便可以进入系统的主界面进行交互了。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)