本地部署deepseek的具体方法,无需联网也能使用AI了

Ollama 是一个开源的本地大语言模型运行框架,旨在帮助用户在本地机器上轻松部署和运行大型语言模型(LLM),而无需依赖外部服务器或云服务。Ollama 为开发者和终端用户提供了简单高效的接口,使得本地运行和管理大型语言模型变得更加便捷。这里以7B模型为例,根据你的硬件配置,也可以选择其他大小的模型,如1.5B、8B、14B等。如果需要通过网页使用,可以下载并安装支持Ollama的网页应用。在终

1. 下载对应版本的 Ollama

2. . 下载并安装DeepSeek模型

在终端中运行以下命令来下载DeepSeek模型:

ollama run deepseek-r1:7b

这里以7B模型为例,根据你的硬件配置,也可以选择其他大小的模型,如1.5B、8B、14B等。

3. 使用DeepSeek

终端直接使用:

ollama run deepseek-r1:7b

在终端中输入问题,即可与DeepSeek进行交互。

输入/bye退出模型。

网页使用:

如果需要通过网页使用,可以下载并安装支持Ollama的网页应用。

在Mac上,需要设置Ollama的远程连接:

launchctl setenv OLLAMA_HOST "0.0.0.0"

launchctl setenv OLLAMA_ORIGINS "*"

然后在网页应用中选择Ollama作为模型提供方。

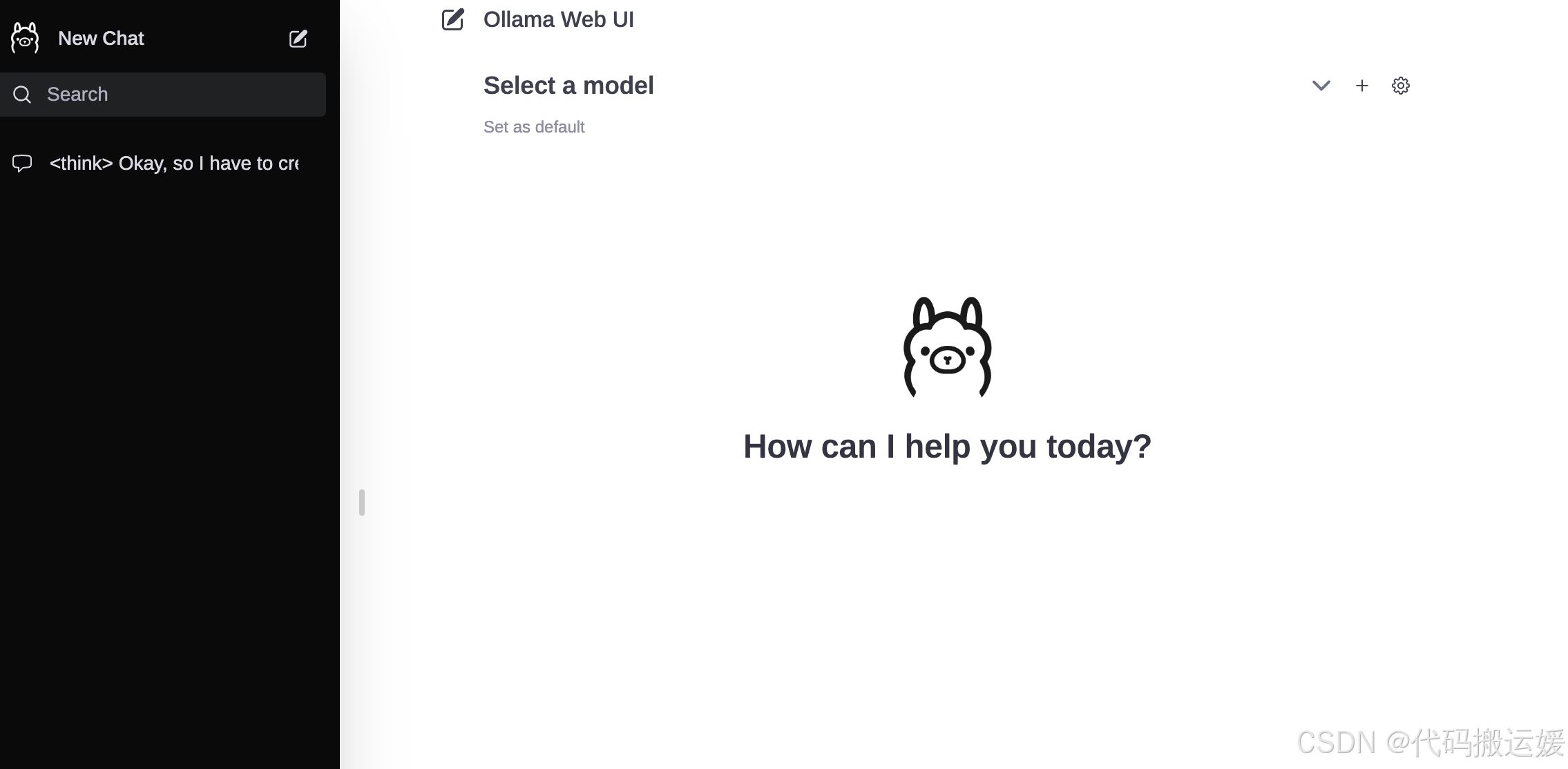

4. 可以借助web页面实现界面交互

这里介绍一个 UI 框架可以直接与 ollama 大模型对接。

ollama-webui-lite

项目地址: https://github.com/ollama-webui/ollama-webui-lite

此项目是 open-webui 的简化版,注意需:node >= 16。

git clone https://github.com/ollama-webui/ollama-webui-lite.git

cd ollama-webui-lite

yarn

yarn dev

运行之后,你可以对连接信息进行设置,默认是连接本机的 http://localhost:11434/api,如果你也是本机部署,那就不用更改。然后界面选择启动的模型,就可以对话了。

拓展:Ollama 是什么?

Ollama 是一个开源的本地大语言模型运行框架,旨在帮助用户在本地机器上轻松部署和运行大型语言模型(LLM),而无需依赖外部服务器或云服务。以下是关于 Ollama 的详细介绍:

主要功能

- 本地运行能力:Ollama 允许用户在本地机器上运行大型语言模型,确保数据处理的隐私性和安全性。

- 多平台支持:支持 macOS、Windows、Linux 以及 Docker 环境。

- 模型库和导入支持:提供丰富的预构建模型库,支持从多种格式(如 GGUF、PyTorch 和 Safetensors)导入模型。

- 灵活的模型自定义:用户可以通过 Modelfile 定制模型参数和行为。

- 丰富的 API 和库支持:提供 Python 和 JavaScript 库,以及 CLI 和 REST API,方便开发者集成到各种应用中。

- 命令行界面(CLI):提供丰富的命令集,用于模型的管理、运行和监控。

- REST API 服务:支持以服务的形式供外部调用,通过 REST API 接口与 Ollama 进行交互。

使用场景

- GUI 聊天模式:创建图形用户界面的聊天机器人。

- 本地知识库问答:开发针对特定知识库的问答系统。

- RAG(Retrieval-Augmented Generation):结合检索和生成技术,构建高效的问答系统。

安装与使用

- 安装:访问 Ollama 官网,下载适合操作系统的安装包并安装。

- 运行模型:使用命令 ollama run 模型名称,如 ollama run llama3.2。

- 查看模型列表:使用命令 ollama list。

- 模型管理:通过 CLI 命令(如 ollama create、ollama pull、ollama rm 等)管理模型。

- REST API 调用:通过 HTTP 请求与 Ollama 服务交互,例如使用 curl 命令。

优势

- 简化部署:提供轻量级、易于扩展的框架,简化大型语言模型的本地部署。

- 隐私保护:本地运行模型,确保数据处理的隐私性和安全性。

- 灵活定制:支持模型参数调整和个性化设置。

Ollama 为开发者和终端用户提供了简单高效的接口,使得本地运行和管理大型语言模型变得更加便捷。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)