ollama AMD GPU本地运行 deepseek-R1-32B模型

摘要:本文介绍AMD硬件环境下Ollama的安装配置流程。首先下载Ollama安装包(默认C盘),可通过PowerShell命令修改安装路径。AMD显卡需单独安装驱动。安装后使用PowerShell拉取模型(如deepseek-r1:32b),推荐配合CherryStudio或PageAssist插件提升使用体验。全文涵盖从驱动安装到模型运行的完整步骤,适合AMD平台用户参考。(150字)

·

硬件配置

- CPU AMD 9900X 32G

- 显卡 AMD 7900XTX 24G

安装ollama

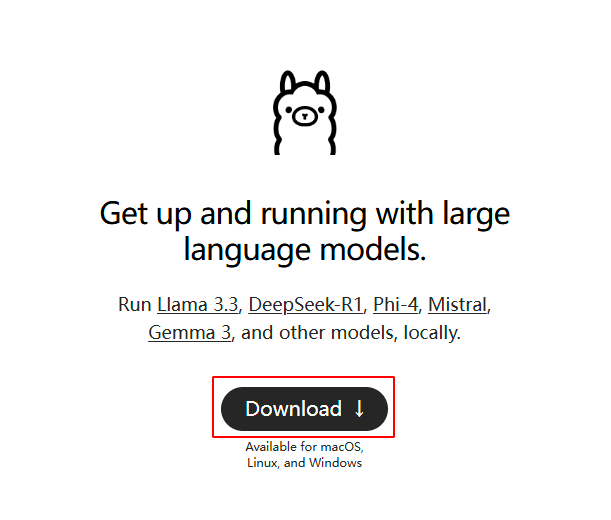

- https://ollama.com/官网下载安装ollama安装包

- 下载后直接安装即可,默认安装在C盘

更换安装位置【官方文档#Changing Install Location】

ollama默认安装在C盘,如需更换安装位置,管理员权限打开powershell,运行OllamaSetup.exe /DIR="d:\some\location"

- 如果使用AMD显卡,需要安装amd驱动【官方文档#System Requirements】

-

- AMD Radeon Driver https://www.amd.com/en/support if you have a Radeon card

下载/运行model

- 安装成功后,管理员权限打开powershell,使用ollama pull拉取模型,或者直接使用ollama run 拉取并运行模型,这里以deepseek-r1:32b为例:

ollama pull deepseek-r1:32b

ollama run deepseek-r1:32b- 等待下载成功,见如下即成功运行

UI工具

命令行使用并不是那么方便,推荐配合cherry studio客户端或Page Assist 浏览器插件进行适用

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)