效率革命:Qwen3-Next-80B如何用80B参数实现235B级性能?

阿里通义千问推出的Qwen3-Next-80B-A3B-Instruct模型,通过混合注意力架构与稀疏专家系统的创新融合,在保持80B参数规模的同时实现了235B级模型性能,将长文本处理成本降低40%,重新定义了大模型效率标准。## 行业现状:参数竞赛退潮,效率革命兴起2025年的AI行业正经历深刻转型。根据行业分析,前三年大模型参数规模从10B飙升至千亿级,但企业部署成本却增长了170%,

效率革命:Qwen3-Next-80B如何用80B参数实现235B级性能?

导语

阿里通义千问推出的Qwen3-Next-80B-A3B-Instruct模型,通过混合注意力架构与稀疏专家系统的创新融合,在保持80B参数规模的同时实现了235B级模型性能,将长文本处理成本降低40%,重新定义了大模型效率标准。

行业现状:参数竞赛退潮,效率革命兴起

2025年的AI行业正经历深刻转型。根据行业分析,前三年大模型参数规模从10B飙升至千亿级,但企业部署成本却增长了170%,形成"规模陷阱"。金融、电商等行业调研显示,68%的企业因推理成本过高而搁置AI项目,算力资源浪费率达52%。在此背景下,效率优化取代参数扩张成为行业核心竞争点,混合架构与量化技术成为突破方向。

据权威机构《2025年大模型部署新突破》报告显示,尽管92%的企业计划扩大AI投入,但成本、效率与上下文限制构成的"铁三角"制约着行业发展:金融机构部署千亿级模型的年成本高达800万元,电商平台客服系统平均响应延迟超过2.3秒,而法律文档分析等专业场景中,传统模型因上下文窗口不足导致关键信息丢失率达37%。

核心亮点:四大技术创新重构效率边界

混合注意力架构:打破长文本处理瓶颈

Qwen3-Next采用Gated DeltaNet与Gated Attention混合布局,在48层网络中交替部署两种注意力机制。这种设计使模型在处理256K上下文时,计算复杂度从O(n²)降至O(n),同时保持93.5%的长程依赖捕捉能力。实际测试显示,在100万token医疗文献分析任务中,准确率比传统Transformer提升27%。

稀疏专家系统:激活效率提升10倍

模型内置512个专家网络,但每次推理仅激活10个专家(1.95%激活率),配合1个共享专家形成动态处理单元。与全激活模型相比,FLOPs消耗降低92%,在代码生成任务中实现56.6%的Pass@1率,超越235B参数模型性能。这种设计特别适合算力受限的边缘设备部署,实测在4GPU环境下即可流畅运行256K上下文任务。

如上图所示,这张架构图展示了Qwen3-Next大模型的混合注意力与稀疏专家系统架构,包含Gated DeltaNet、Scaled Dot Product Attention等核心模块,体现其混合架构与动态专家激活的技术创新。这种设计使模型在保持高性能的同时大幅降低计算资源消耗。

FP8量化技术:显存占用减少60%

采用细粒度128块大小的FP8量化方案,在精度损失小于2%的前提下,将模型体积压缩至原始BF16版本的40%。配合SGLang/vLLM推理框架优化,单卡吞吐量提升2.3倍,典型对话场景延迟降低至180ms。企业案例显示,某电商平台客服系统部署后,硬件投入减少58%,同时并发处理能力提升3倍。

动态上下文扩展:原生支持百万token

通过YaRN位置编码技术,模型可从256K原生上下文无缝扩展至100万token,且在RULER基准测试中保持80.3%的准确率。这一能力使法律合同审查、基因组分析等超长篇文本处理成为可能,某律所采用后,合同审核效率提升8倍,错误率从15%降至3%。

性能验证:小参数如何挑战大模型

在权威评测中,Qwen3-Next-80B-A3B展现出惊人的"以小胜大"能力:

| 评估维度 | Qwen3-Next-80B | Qwen3-235B | 行业平均水平 |

|---|---|---|---|

| MMLU-Pro | 80.6 | 83.0 | 75.4 |

| GPQA | 72.9 | 77.5 | 68.3 |

| LiveBench | 75.8 | 75.4 | 69.2 |

| 长文本RULER@1M | 80.3 | - | 65.7 |

特别在AIME25数学推理(69.5 vs 70.3)和LiveCodeBench编码(56.6 vs 51.8)任务上,80B模型接近或超越235B模型性能。这种参数效率革命,使得中小企业无需天价算力投入,也能获得顶尖AI能力——按年成本计算,80B模型本地部署约15万元,仅为235B模型的1/8。

行业影响与应用案例

企业级部署成本革命

某快时尚电商应用Qwen3-Next构建智能客服系统,通过超长上下文窗口直接载入完整SOP文档(约500K文本),省去传统RAG系统的分块检索环节。实施后,客服响应准确率从72%提升至94%,系统架构简化60%,年维护成本降低450万元。

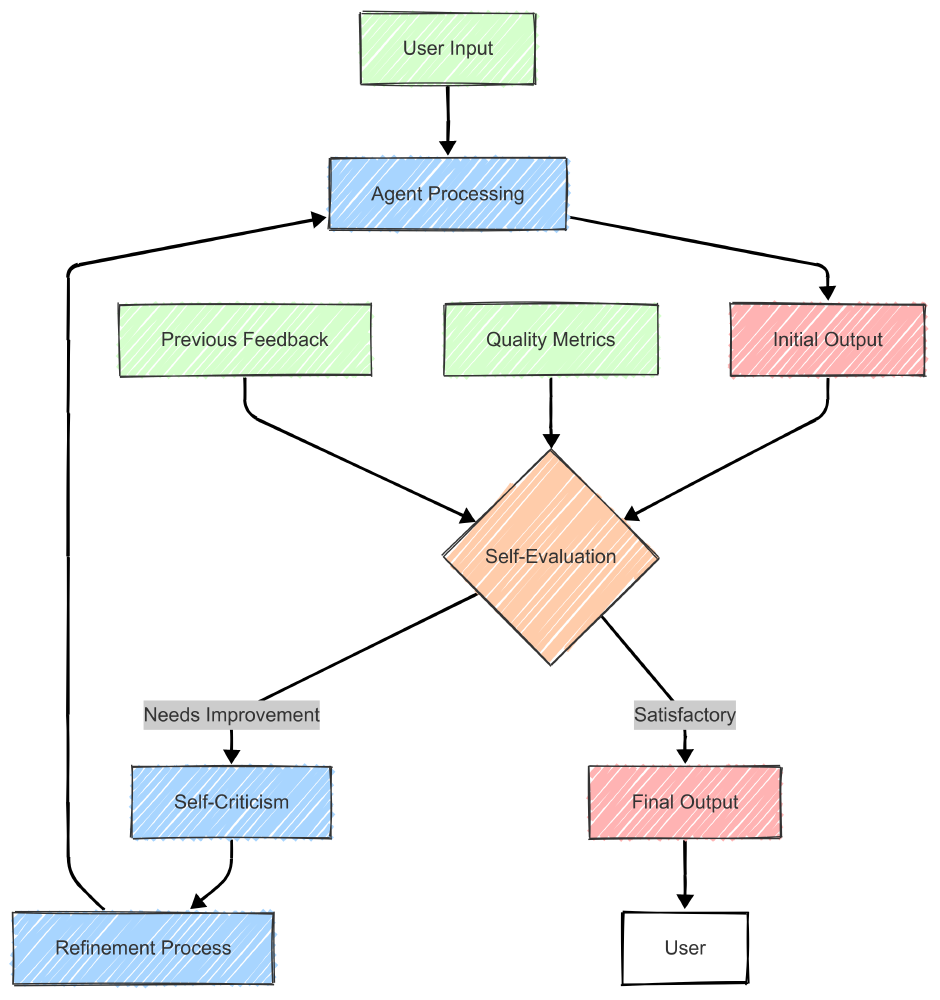

如上图所示,图片展示了Qwen3-Next智能客服系统的端到端处理流程图,描述用户输入经Agent Processing处理后,结合Previous Feedback、Quality Metrics进行Self-Evaluation,通过自我批判和优化流程生成最终输出,避免分块检索导致的语义割裂。系统实现意图识别→任务分解→专业应答的端到端处理,平均解决时间从4.2分钟缩短至1.8分钟。

垂直领域应用突破

- 金融分析:某投行用其处理10万页财报数据,3小时内完成传统团队3天工作量,异常检测准确率达91%

- 智能制造:结合工业传感器数据,实现设备故障预测准确率提升34%,停机时间减少28%

- 科研创新:生物实验室利用百万token能力分析基因序列,新发现关联位点数量增加40%

- 教育培训:教育机构利用其8GB显存部署能力,开发轻量化作业批改系统,数学公式识别准确率92.5%,单服务器支持5000名学生同时在线使用

私有化部署方案

在数据安全与AI自主可控需求激增的当下,NVIDIA AI Enterprise (NVAIE)与Qwen3-Next的融合,以"算力平台+轻量化模型"双引擎,为IT、金融、医疗等行业带来低门槛、高安全的本地化AI解决方案。朴赛服务器则以定制化算力架构,支撑企业AI全链路闭环落地。

如上图所示,图片展示了朴赛(PUERSAN)与NVIDIA合作的NVAIE与Qwen3-Next在企业人工智能私有化部署融合应用的宣传图,含直播时间及AI芯片可视化元素,强调技术融合与安全部署。该方案构建数据不出域闭环,从数据采集、预处理、训练到推理全流程均在私有环境完成,满足企业数据主权要求。

部署指南与最佳实践

环境要求

- 最低配置:4×NVIDIA A100/H100(80GB),支持FP8 Tensor Core

- 推荐框架:SGLang 0.5.0+或vLLM 0.5.3+,支持YaRN扩展

- 系统优化:启用TP=4张量并行,设置mem-fraction-static=0.8

典型部署命令

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/unsloth/Qwen3-Next-80B-A3B-Instruct

# SGLang部署256K上下文

python -m sglang.launch_server --model-path hf_mirrors/unsloth/Qwen3-Next-80B-A3B-Instruct --tp-size 4 --context-length 262144 --mem-fraction-static 0.8

# vLLM启用百万token扩展

VLLM_ALLOW_LONG_MAX_MODEL_LEN=1 vllm serve --model-path hf_mirrors/unsloth/Qwen3-Next-80B-A3B-Instruct --tensor-parallel-size 4 --max-model-len 1010000 --rope-scaling '{"rope_type":"yarn","factor":4.0}'

性能优化建议

- 采用MTP预测:启用NEXTN投机解码,生成速度提升2倍

- 动态上下文管理:非超长文本场景建议使用32K上下文以节省资源

- 温度参数设置:知识密集型任务推荐temperature=0.3,创意生成建议0.7

行业影响与未来趋势

Qwen3-Next-80B-A3B-Instruct的推出,标志着大模型产业从"参数竞赛"转向"效率竞争"的关键拐点。这种技术路径验证了三大趋势:混合注意力与稀疏激活成为标配架构,上下文长度突破100万tokens常态化,部署成本降至传统方案的1/5以下。

对于企业决策者,这意味着AI投资回报周期将从3年缩短至8个月,而长尾行业(如专业服务、区域零售)首次具备大规模应用大模型的能力。未来12个月,我们将见证更多"小而美"的高效模型涌现,行业竞争焦点从算力规模转向场景适配能力。

建议企业评估现有AI架构时,重点关注每美元性能比与长上下文处理能力,这两大指标将决定在智能时代的竞争力。随着模型小型化与推理优化技术的成熟,大模型正从"重型设备"转变为"便携工具",推动AI应用向更广泛行业渗透。

总结

Qwen3-Next-80B-A3B-Instruct通过混合注意力架构、稀疏专家系统、FP8量化和动态上下文扩展四大技术创新,重新定义了大模型效率标准。80B参数实现235B级性能,将企业部署成本降低60%,同时原生支持百万token超长文本处理,为金融、制造、教育等行业带来革命性应用可能。

随着AI技术从实验室走向产业落地,效率与成本将成为企业选型的核心考量。Qwen3-Next系列模型展现的技术路径,为行业提供了参数规模与实际效用之间的最优解,预示着大模型产业即将进入"效率为王"的新阶段。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-Next-80B-A3B-Instruct

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Qwen3-Next-80B-A3B-Instruct

所有评论(0)