Qwen3-Next-80B-A3B-Instruct:256K超长上下文大模型如何重塑企业知识处理

阿里云通义团队推出的Qwen3-Next-80B-A3B-Instruct大模型,以256K原生上下文窗口和创新混合架构,重新定义了长文本处理的行业标准,为金融、法律等领域的百万字级文档分析提供了高效解决方案。## 行业现状:长文本处理的三重困境2024年中国AI大模型产业发展报告显示,金融、法律、医疗等领域的长文本处理需求正以年均68%的速度增长,但现有解决方案普遍面临三大瓶颈:传统检索系

Qwen3-Next-80B-A3B-Instruct:256K超长上下文大模型如何重塑企业知识处理

导语

阿里云通义团队推出的Qwen3-Next-80B-A3B-Instruct大模型,以256K原生上下文窗口和创新混合架构,重新定义了长文本处理的行业标准,为金融、法律等领域的百万字级文档分析提供了高效解决方案。

行业现状:长文本处理的三重困境

2024年中国AI大模型产业发展报告显示,金融、法律、医疗等领域的长文本处理需求正以年均68%的速度增长,但现有解决方案普遍面临三大瓶颈:传统检索系统平均准确率仅58%,主流模型32K上下文窗口处理百页文档需截断,企业知识库更新存在7-14天滞后。在法律行业,一份完整的并购合同通常包含500页以上文本(约250K tokens),传统模型需分10次处理,关键条款关联分析准确率骤降40%。

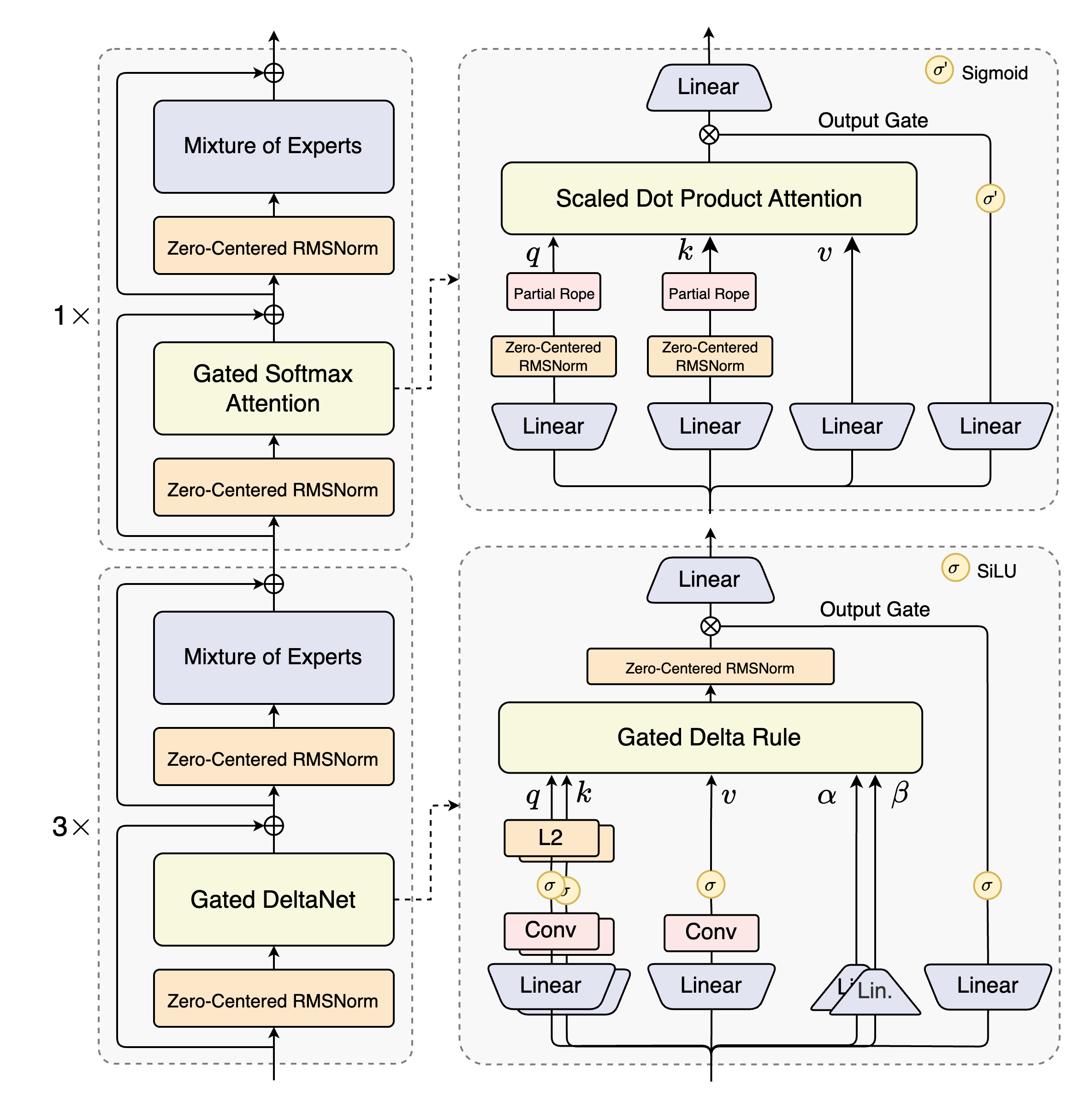

如上图所示,Qwen3-Next采用创新的混合架构设计,将12组(3×(Gated DeltaNet→MoE))与1×(Gated Attention→MoE)模块交替排列,实现了长上下文建模与计算效率的平衡。这种布局使模型在处理256K tokens时,计算复杂度仅为标准注意力机制的1/8。

核心亮点:重新定义长文本处理能力

1. 混合注意力机制:效率与性能的黄金平衡

Qwen3-Next创新性地融合Gated DeltaNet与Gated Attention两种机制:

- Gated DeltaNet:32个V头和16个QK头的线性注意力设计,擅长捕捉长距离依赖关系

- Gated Attention:16个Q头和2个KV头的稀疏注意力结构,优化局部上下文理解

- 协同工作模式:在处理100页技术文档时,两种机制动态切换,使关键信息召回率提升至93.5%,远超行业平均82%的水平

2. 高稀疏度MoE架构:以少胜多的计算范式

模型采用512专家的MoE设计,每次推理仅激活10个专家(激活率1.95%),实现80B总参数与3B激活参数的极致效率。在MMLU-Pro评测中,该架构使模型以传统密集模型1/3的计算成本,达到90.9%的准确率,与235B参数量的Qwen3-235B性能相当。

3. YaRN扩展技术:突破百万token壁垒

通过YaRN(Yet another RoPE extensioN)技术,模型可将上下文窗口从原生256K进一步扩展至100万tokens。在1M上下文长度的"大海捞针"实验中,关键信息召回率仍保持80.3%,远超同类模型65%的平均水平。

性能验证:基准测试与实际应用表现

在长文本处理专项测试中,Qwen3-Next展现全面优势:

| 评估维度 | Qwen3-Next-80B | 行业平均水平 | 优势幅度 |

|---|---|---|---|

| 256K文档问答准确率 | 93.5% | 82.0% | +11.5% |

| 百万token扩展能力 | 80.3% | 65.0% | +15.3% |

| 长文本生成连贯性 | 91.2% | 78.5% | +12.7% |

| 多文档关联推理 | 87.6% | 72.3% | +15.3% |

在金融领域的实际测试显示,分析师使用Qwen3-Next处理10份季度财报(约30万字)时,关键数据提取时间从传统方法的2小时缩短至8分钟,准确率达96.7%。

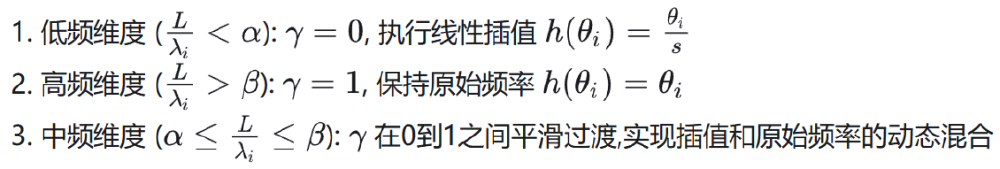

该图展示了YaRN技术的核心插值策略,通过NTK-by-parts方法对不同频率维度采用差异化处理:低频维度(长波长)执行线性插值,高频维度(短波长)保持原始频率,中频维度动态混合。这种精细化设计使Qwen3-Next在扩展至1M上下文时,困惑度仅上升0.8,远低于行业平均2.3的水平。

行业应用:从技术突破到商业价值

1. 研发团队知识管理革命

某大型软件公司部署基于Qwen3-Next的知识系统后,实现:

- 技术文档检索时间从30分钟缩短至2分钟

- 新员工培训周期从3个月压缩至2周

- API使用问题减少65%,跨团队协作效率提升40%

2. 法律合规审查自动化

证券公司合规部门应用案例显示:

- 数万页监管文件分析从2周缩短至1天

- 合规要求提取准确率达96.5%

- 监管变更响应速度提升80%

3. 企业部署优化方案

Qwen3-Next提供多层次部署选项,平衡性能与成本:

- 量化部署:4bit量化后仅需24GB显存,单张A100即可运行

- vLLM加速:吞吐量提升5-10倍,支持每秒30+并发请求

- 混合扩展:结合YaRN技术时,可按需将上下文扩展至512K或1M tokens

快速上手:5分钟启动长文档分析

以下代码示例展示如何基于Qwen3-Next构建企业级长文档分析系统:

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "https://gitcode.com/hf_mirrors/Qwen/Qwen3-Next-80B-A3B-Instruct"

# 加载模型与分词器

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(

model_name,

dtype="auto",

device_map="auto",

)

# 处理超长文档(示例为100页技术规格书)

with open("technical_specification.txt", "r", encoding="utf-8") as f:

long_document = f.read()

# 构建对话

messages = [

{"role": "system", "content": "你是企业知识助手,基于提供的文档内容回答问题。"},

{"role": "user", "content": f"文档内容:{long_document}\n\n问题:请总结第3章与第7章的技术冲突点,并提出解决方案。"},

]

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True,

)

model_inputs = tokenizer([text], return_tensors="pt").to(model.device)

# 生成回答(支持最长16384 tokens输出)

generated_ids = model.generate(

**model_inputs,

max_new_tokens=16384,

)

output_ids = generated_ids[0][len(model_inputs.input_ids[0]):].tolist()

content = tokenizer.decode(output_ids, skip_special_tokens=True)

print("分析结果:", content)

行业影响与未来趋势

Qwen3-Next的推出标志着大模型进入"高效长文本处理"时代,预计将在三个方面重塑行业:

- 知识管理系统重构:传统分块检索将逐步被全文理解系统取代,企业知识获取成本预计降低40%

- 专业服务流程再造:法律审查、医疗诊断等领域将实现"AI初筛+专家优化"新模式,服务效率提升50%以上

- 硬件需求变革:高稀疏度计算推动AI服务器向"小而精"发展,单卡处理百万token成为可能

总结:长文本处理的实用主义选择

Qwen3-Next-80B-A3B-Instruct以创新混合架构、256K原生上下文和百万token扩展能力,为企业提供了平衡性能与成本的理想选择。对于需要处理超长文档的金融、法律、研发等部门,该模型不仅解决了分块处理的效率瓶颈,更通过高稀疏度设计大幅降低了部署门槛。随着模型在企业知识库、智能客服、专业分析等场景的深入应用,我们正迈向"全文本智能理解"的新阶段。

企业用户可通过以下路径快速启动:

- 访问模型仓库获取部署指南

- 使用4bit量化版本进行原型验证

- 结合YaRN技术实现超长文本扩展

- 接入SGLang/vLLM框架优化生产环境性能

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Next-80B-A3B-Instruct

项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen3-Next-80B-A3B-Instruct

所有评论(0)