传统算法被吊打!特征融合+GNN,模型准确率狂飙至95%!

文章提出一种基于图的语音特征融合方法用于语音情感识别,通过学习多维边特征描述特征间关系,在SEWA数据集上取得良好效果,验证了方法的有效性。最新研究表明,通过将多源特征进行深度融合,并利用GNN的强大图结构建模能力,模型在处理节点分类、图预测等任务时的性能显著提升,特征融合与GNN的结合,正以强大的技术优势,为智能系统的发展注入新的活力,开启数据驱动智能决策的新篇章。使用结构感知Transform

在人工智能的前沿探索中,特征融合与图神经网络(GNN)的结合正成为研究热点,为复杂数据处理带来新的突破。

最新研究表明,通过将多源特征进行深度融合,并利用GNN的强大图结构建模能力,模型在处理节点分类、图预测等任务时的性能显著提升,准确率最高可达95%。

这种创新不仅在社交网络分析中精准识别用户关系,还在生物医学领域助力蛋白质相互作用网络的高效解析,展现了其在跨学科应用中的巨大潜力。

特征融合与GNN的结合,正以强大的技术优势,为智能系统的发展注入新的活力,开启数据驱动智能决策的新篇章。我整理了9篇【特征融合GNN】的相关论文,全部论文PDF版,工中号 沃的顶会 回复“特征融合”即可领取。

GL-FUSION:RETHINKING THE COMBINATION OF GRAPH NEURAL NETWORK AND LARGE LANGUAGE MODEL

文章解析

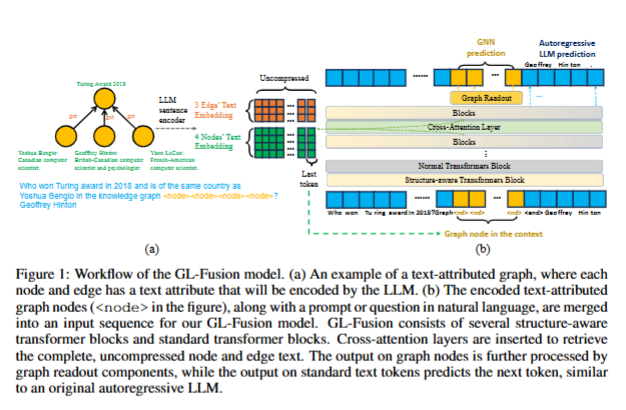

本文提出了GL-Fusion模型,旨在解决图神经网络(GNN)与大语言模型(LLM)结合时的挑战,如文本与结构的独立编码、信息压缩过度等问题。

通过结构感知Transformer层、图-文本交叉注意力机制和GNN-LLM双预测器,GL-Fusion在多个任务上表现出色。

创新点

结构感知Transformer层:将GNN的消息传递机制直接嵌入LLM的Transformer层,实现文本与结构的同步处理。

图-文本交叉注意力机制:保留完整的节点和边文本信息,避免信息压缩,提升语义理解的准确性。

GNN-LLM双预测器:同时支持GNN的并行预测和LLM的自回归生成,增强模型的灵活性和扩展性。

研究方法

使用结构感知Transformer层,结合GNN的消息传递机制和LLM的自注意力机制,处理图结构和文本信息。

引入图-文本交叉注意力机制,确保节点和边的完整文本信息在模型中得以保留和利用。

设计GNN-LLM双预测器,根据不同任务需求选择GNN或LLM进行预测,提升模型的适用性。

在多个数据集上进行实验,验证模型在节点分类、知识图谱补全、常识问答等任务中的表现。

研究结论

GL-Fusion在多个任务上显著优于现有的GNN和LLM结合模型,尤其在节点分类和知识图谱补全任务中表现突出。

结构感知Transformer层和图-文本交叉注意力机制有效提升了模型对图结构和文本信息的处理能力。

GNN-LLM双预测器增强了模型的灵活性和扩展性,使其能够同时处理数值输出和自然语言生成任务。

Graph-based multi-Feature fusion method for speech emotion recognition

文章解析

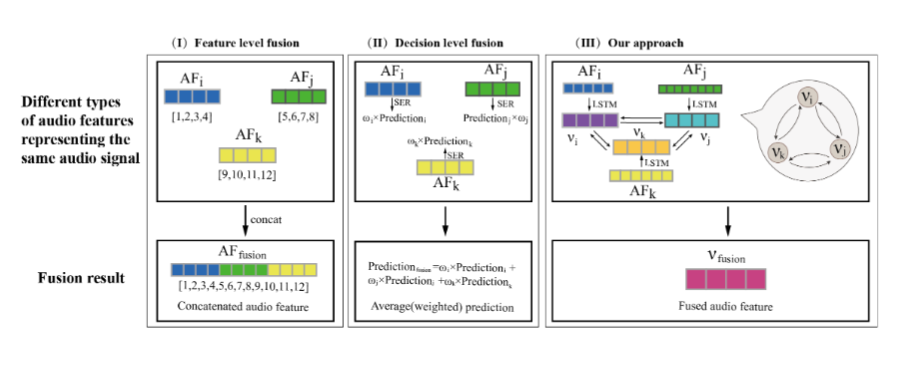

文章提出一种基于图的语音特征融合方法用于语音情感识别,通过学习多维边特征描述特征间关系,在SEWA数据集上取得良好效果,验证了方法的有效性。

创新点

首次将多维边特征应用于基于图的跨语料库语音情感识别任务,显式建模音频特征关系。

提出新的语音特征融合方法,利用跨注意力机制有效提取新特征并更新多维边特征。

实验验证了该方法在SEWA数据集上的有效性,相比基线有显著性能提升。

研究方法

构建包含音频特征生成、音频特征多维边特征学习和语音情感识别的模块体系,实现端到端的语音情感识别。

融合手工制作特征和深度学习特征,包括eGeMAPs、MFCCs等多种特征,提升特征的全面性。

运用GRATIS框架生成特定任务拓扑和多维边特征,增强特征表示能力。

采用一致性相关系数(CCC)作为损失函数,在不同文化数据集上进行训练和验证。

研究结论

基于图的多特征融合方法在语音情感识别任务上优于基线方法,能有效融合语音特征,提高预测准确率。

多维边特征可表达不同语音特征间关键信息,对提升模型性能至关重要,消融实验验证了其有效性。

研究存在局限,未来将纳入更多语音特征和跨语料库数据集,进一步优化方法。

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献25条内容

已为社区贡献25条内容

所有评论(0)