RLHF技术实践:大语言与文生图模型的生成优化

最后,我们以「家作」的“场景模特”功能为例,展示了如何通过RLHF技术,有效优化模型的生成效果,显著降低图像中肢体异常的概率,从而提升用户体验。首先我们把大量的prompt(Open AI使用调用GPT-3用户的真实数据)输入给第一步得到的语言模型,对同一个问题,可以让一个模型生成多个回答,也可以让不同的微调(fine-tune)版本回答。相较于仅依赖固定标签的监督学习,RLHF通过引入相对偏好而

本文首先回顾了基于人类反馈的强化学习(RLHF)的核心理念及其在现代AI模型中的关键作用。在此基础上,我们深入探讨了RLHF在两大主流领域——大语言模型(LLM)与文生图模型(Text-to-Image Models)中的具体应用与前沿方法。最后,我们以「家作」的“场景模特”功能为例,展示了如何通过RLHF技术,有效优化模型的生成效果,显著降低图像中肢体异常的概率,从而提升用户体验。

RLHF介绍

在自然语言处理领域,如何使大型语言模型(LLM)的行为与人类的价值观和期望保持一致,是当前研究的核心挑战之一。为此,研究者广泛采用基于人类反馈的强化学习(Reinforcement Learning from Human Feedback, RLHF),通过引入人类的偏好信号来引导模型优化其输出行为,使其更符合用户意图。

▐ 1.1 LLM中的RLHF

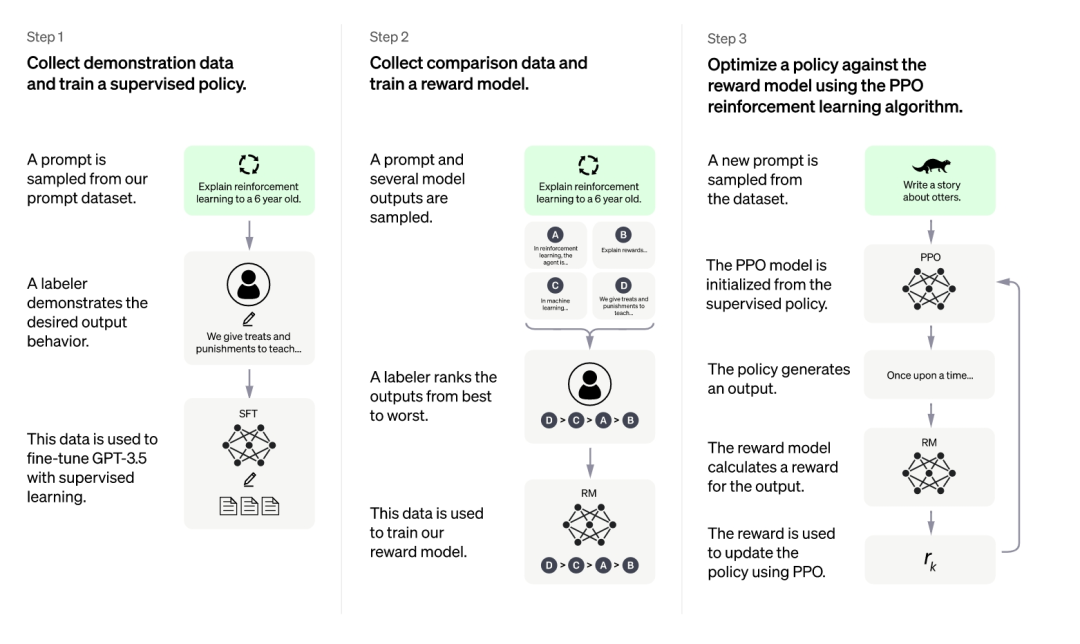

以ChatGPT为代表的先进语言模型,其训练流程通常包含三个关键阶段:

-

预训练(Pretraining)

模型首先在大规模无标注文本语料上进行自回归训练,目标是最小化下一个词的预测误差。这一阶段旨在让模型掌握语言的基本结构、语法与常识知识。 -

监督微调(Supervised Fine-Tuning, SFT)

在高质量的人工标注数据集上对预训练模型进行微调。这些数据由人工撰写输入提示(prompt)及其对应的理想回答构成,模型通过模仿专家示范学习生成符合人类期望的响应。 -

基于人类反馈的强化学习(RLHF)

此阶段进一步提升模型对齐能力。具体流程为:对于相同的输入提示,收集模型生成的多个候选输出,交由人类评估者进行排序或打分,形成偏好数据;基于这些偏好数据训练一个奖励模型(Reward Model, RM),用于预测人类对不同输出的偏好程度;最后,利用该RM作为奖励函数,结合PPO(Proximal Policy Optimization)等强化学习算法,迭代优化SFT后的策略模型。

其中,SFT与RLHF共同构成了人类偏好对齐(alignment)的关键路径。相较于仅依赖固定标签的监督学习,RLHF通过引入相对偏好而非绝对标准答案,赋予模型更强的探索空间,有助于突破标注者能力的上限,从而潜在地实现更高水平的智能表现。

尤其在对准确性要求极高的任务中——如代码生成、数学推理等——RLHF展现出显著优势。这类任务中,即使输出存在细微错误(如变量名拼写错误或逻辑漏洞),也可能导致整体失效;而传统的SFT损失函数难以有效区分“风格差异”与“实质性错误”。相比之下,RLHF能通过偏好信号捕捉到语义层面的正确性差异,进而驱动模型向更鲁棒、更精确的方向演化。

▐ 1.2为何文生图模型需要RLHF?

近年来,文本到图像生成技术(Text-to-Image Generation)取得了突破性进展,尤其是基于扩散机制(diffusion-based)和自回归架构的模型,已能根据自然语言描述生成视觉质量高、细节丰富的图像。

然而,尽管生成效果不断提升,现有模型仍面临一系列普遍且棘手的问题,主要源于其依赖大规模自监督预训练的方式:

-

图文不一致:生成图像未能准确体现文本中的关键元素,如数量、属性、空间关系或文字内容。

-

解剖结构异常:人物或动物常出现肢体扭曲、多余肢体、结构错位等不符合生理规律的现象。

-

审美偏差:生成结果偏离主流审美标准,构图、色彩或风格不符合人类普遍偏好。

-

有害或偏见内容:模型可能生成包含暴力、色情、歧视性刻板印象或违法不良信息的图像,带来伦理与安全风险。

这些问题难以仅通过扩大训练数据或改进网络结构彻底解决,根本原因在于:预训练数据分布与真实用户需求之间存在显著偏差。原始数据往往未经筛选,包含噪声、偏见甚至错误标注,导致模型学到的是“平均分布”而非“理想行为”。

▐ 1.3 RLHF如何助力解决文生图的核心挑战?

当前文本到图像生成模型所面临的诸多问题,其根源往往不在于模型架构本身的能力瓶颈,而在于训练目标与人类真实偏好之间的错位。具体而言,主流方法依赖大规模自监督预训练,其数据来源广泛但未经筛选,导致两个关键挑战:

-

数据噪声严重:互联网抓取的图文对包含大量标签错误、内容不一致或低质量样本;

-

分布不匹配:预训练数据的分布与实际用户使用的 prompt 风格、意图和质量存在显著差异。

在这种背景下,仅靠扩大数据规模或优化网络结构难以根本性改善生成质量。而 基于人类反馈的强化学习(RLHF) 提供了一条可行路径——它不再依赖静态的数据拟合,而是通过动态建模“人类偏好”,引导模型逼近真实用户期望。

核心机制一:奖励模型(Reward Model, RM)——让“偏好”可量化

RLHF 的第一步是构建一个奖励模型(Reward Model),即一个能够预测人类对不同图像生成结果偏好的打分函数。该模型基于人类标注者对多组生成结果的排序或评分进行训练,学习判断哪些图像更符合人类在语义准确性、视觉合理性、审美品质和安全性等方面的综合偏好。这一机制的关键意义在于:它将主观的人类判断转化为可计算、可微分的信号,为后续优化提供明确方向。

核心机制二:RM 作为新型评估指标——填补自动评测的空白

目前,文生图领域缺乏与人类感知高度一致的自动化评估指标。例如:FID(Fréchet Inception Distance)主要衡量生成图像与真实图像在特征空间中的统计分布距离,但无法细节特征;CLIPScore 虽能计算文本与图像的语义对齐度,却难以捕捉构图美感、肢体合理性或社会伦理等复杂维度。相比之下,经人类偏好训练的 Reward Model 可作为更贴近真实体验的动态评估工具。这种“以人为中心”的评价体系,正是推动模型持续进化的基础。

核心机制三:RLHF 实现偏好对齐——从模仿到优化

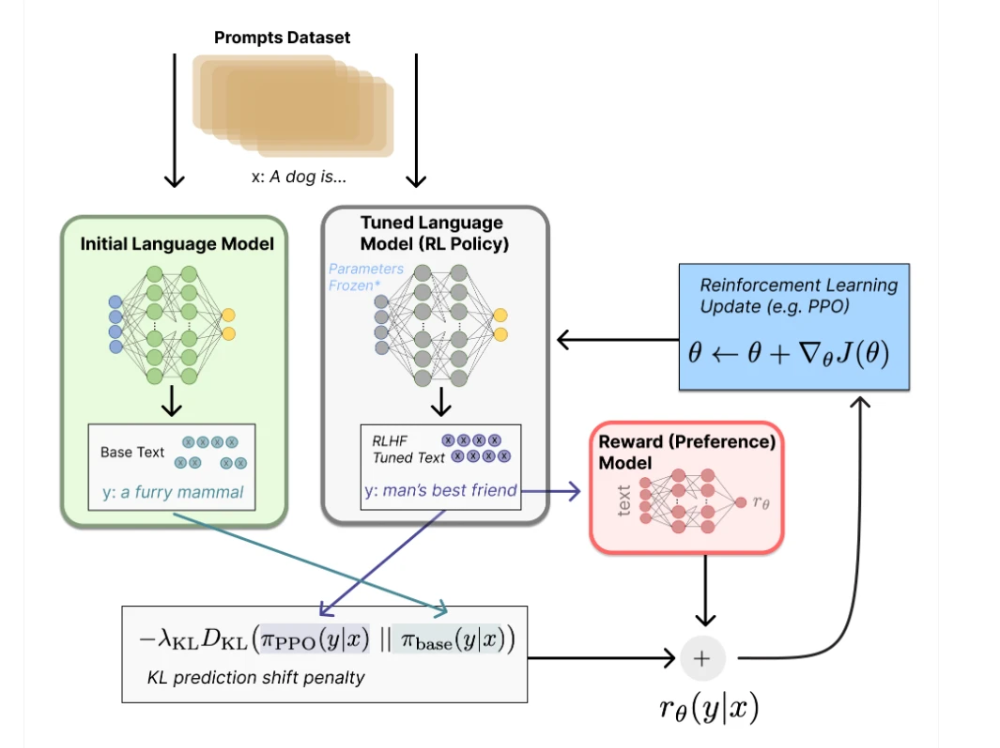

在获得可靠的 Reward Model 后,便可将其作为强化学习中的奖励函数,驱动生成模型(如扩散模型的参数化策略)进行策略优化。通过 PPO 等算法,模型不断尝试生成新样本,并根据 RM 返回的奖励信号调整自身行为,逐步向高偏好区域收敛。

这一过程实现了从“被动拟合数据”到“主动追求人类满意”的转变。不同于传统训练中“只要符合数据分布即可”的目标,RLHF 明确鼓励模型生成不仅合理,而且令人喜欢、值得推荐的结果。

RLHF改善肢体变异问题示例

大语言模型中的RLHF

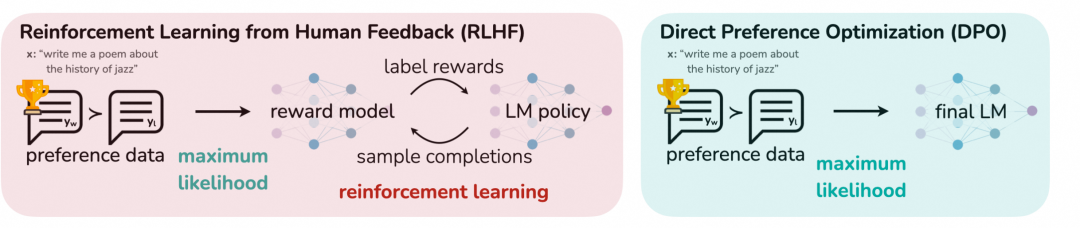

▐ 2.1 经典RLHF框架

-

Reward Modeling

训练奖励模型。目标:给pormpt-response pair打分,拟合人类的偏好。我们需要一个模型来定量评判模型输出的回答在人类看来是否质量不错,即输入 [提示(prompt),模型生成的回答] ,奖励模型输出一个能表示回答质量的标量数字。

-

首先我们把大量的prompt(Open AI使用调用GPT-3用户的真实数据)输入给第一步得到的语言模型,对同一个问题,可以让一个模型生成多个回答,也可以让不同的微调(fine-tune)版本回答。

-

接下来让标注人员对同一个问题的不同回答排序,不同的标注员,打分的偏好会有很大的差异,而这种差异就会导致出现大量的噪声样本。排序的话能获得大大提升一致性。

-

这些不同的排序结果会通过某种归一化的方式变成定量的数据丢给模型训练,从而获得一个奖励模型。

-

Policy Optimization

通过强化学习微调语言模型。目标:用Reward Model和SFT Model构造Reward Function,基于PPO算法来训练LLM

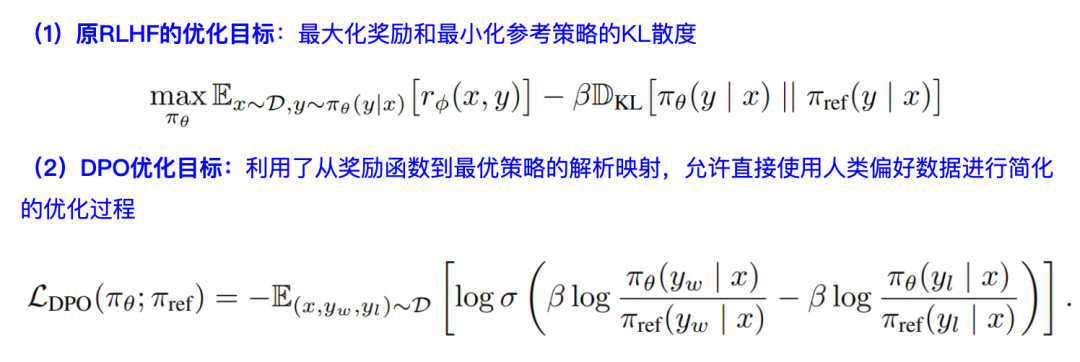

RLHF算法发展:

PPO -> RLOO -> ReMax -> GRPO(都是一些梯度更新算法)

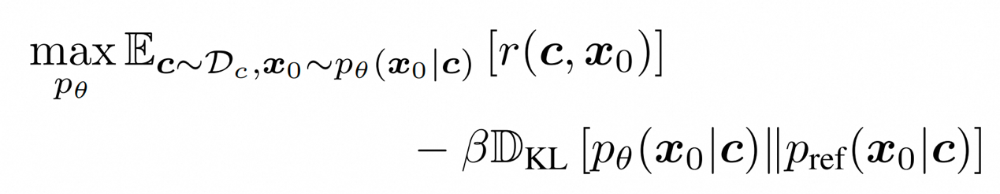

损失函数的含义:

-

最大化reward

-

最小化per-token KL penalty

-

充当熵红利(Entropy bonus),鼓励policy探索并阻止其坍塌为单一模式。

-

确保策略模型产生的输出 与 Reward Model在训练期间看到的输出 不会相差太大,保证Reward的可靠性。仅含这一项就是单纯使用了PPO。这里也可以看出来,Reward model的能力可能会成为RLHF的瓶颈。

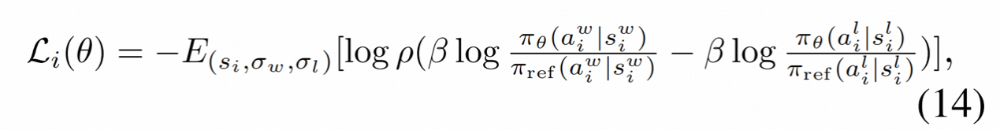

▐ 2.2 DPO

其主要特征是不依赖模型当前版本来生成回复(在线采样),而是通过预先收集和标注的“优质”与“劣质”样本进行学习优化。给定一些从prompt中生成的样本,用SFT得到的模型对同一个问题进行回答,人为标注得到相对更好或者更差的样本,跳过reward model直接用于语言模型的训练。

DPO 的核心思想是,通过比较同一提示下的不同回答,调整模型以降低劣质回答的生成概率,同时提升优质回答的生成概率。这种方法类似于让模型通过模仿优秀玩家的操作来提升自身能力,无需实时生成和评估,大大加快了训练速度并减少了计算资源的消耗。

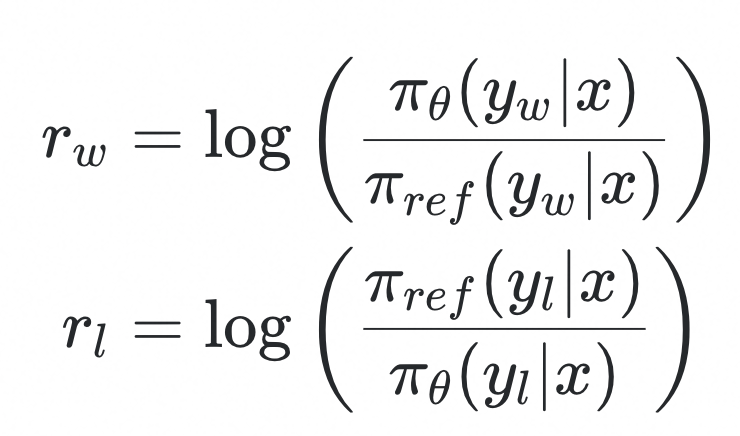

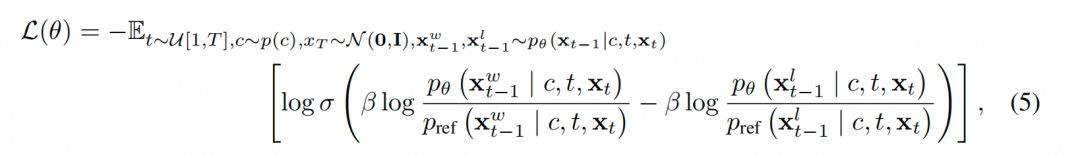

其中 指使用参数

指使用参数 的策略

的策略 输出结果y在给定输入x时的概率,同理

输出结果y在给定输入x时的概率,同理 指使用策略

指使用策略 输出结果y在给定输入x时的概率。(w,l)代表(符合人类偏好,不符合)的结果。

输出结果y在给定输入x时的概率。(w,l)代表(符合人类偏好,不符合)的结果。

DPO的损失函数根据RL训练的损失函数推导而来,得到一个隐式的奖励函数。通过这种方式绕过了显式奖励建模步骤,同时也避免了执行强化学习优化的需要。

逐步分析这个优化目标:首先, 函数里面的值越大,

函数里面的值越大, 越小。

越小。

即最大化 和

和  的奖励函数:

的奖励函数:

对于人类偏好响应 ,我们期望

,我们期望 越大越好;对于人类非偏好响应

越大越好;对于人类非偏好响应 ,我们期望

,我们期望 越小越好。

越小越好。

如果 比较小,说明参考模型

比较小,说明参考模型 没有正确分类该偏好响应

没有正确分类该偏好响应 ,此时

,此时 的概率系数很大;如果

的概率系数很大;如果 比较大,说明

比较大,说明 参考模型没有正确分类该非偏好响应

参考模型没有正确分类该非偏好响应 ,此时

,此时 的概率系数很大。

的概率系数很大。

▐ 2.3 RLHF vs DPO对比总结

RLHF类算法(内核PPO算法),在reward model好的情况下具有更大潜力。缺点:训练代价较高,需要调整大量参数,并且容易受到reward hacking影响,这里的reward hacking指的是模型通过最大化reward来欺骗reward model,偏离模型原本生成能力。

DPO类算法,训练更简单。无需reward model,直接优化目标函数,DPO算法需要同一个prompt和对应的偏好对,偏好对和偏好是预先生成的,所以模型训练时间会比其他方法更加经济。缺点:DPO 方法高度依赖于训练数据的质量和多样性,只有在提供的样本能够充分覆盖各种情境并与模型当前能力匹配时,才能发挥出最佳效果。

文生图模型中的RLHF

▐ 3.1 RLHF方案一览

|

RLHF |

|||

|

时间 |

论文名称 |

重点 |

link |

|

2023.12 |

ImageReward: Learning and Evaluating Human Preferences for Text-to-image Generation |

Reward model ReFL |

https://arxiv.org/abs/2304.05977 |

|

2024.1 |

Training Diffusion Models with Reinforcement Learning |

DDPO |

https://arxiv.org/abs/2305.13301 |

|

2024.11 |

UniFL: Improve Stable Diffusion via Unified Feedback Learning |

对抗反馈学习 |

https://arxiv.org/pdf/2404.05595 |

|

DPO类方法 |

|||

|

2023.11 |

Diffusion Model Alignment Using Direct Preference Optimization |

Diffusion-DPO DPO在扩散模型中的适配 |

https://arxiv.org/pdf/2311.12908 |

|

2024.3 |

Using Human Feedback to Fine-tune Diffusion Models without Any Reward Model |

D3PO |

https://arxiv.org/pdf/2311.13231 |

|

2024.6 |

SPO:Step-aware Preference Optimization: Aligning Preference with Denoising Performance at Each Step |

SPO |

https://arxiv.org/html/2406.04314v1 |

|

2024.12 |

VisionReward: Fine-Grained Multi-Dimensional Human Preference Learning for Image and Video Generation |

Reward 模型用于给出评分 MPO算法用于避免部分维度减弱现象 |

https://arxiv.org/pdf/2412.21059 |

▐ 3.2 RLHF系列

-

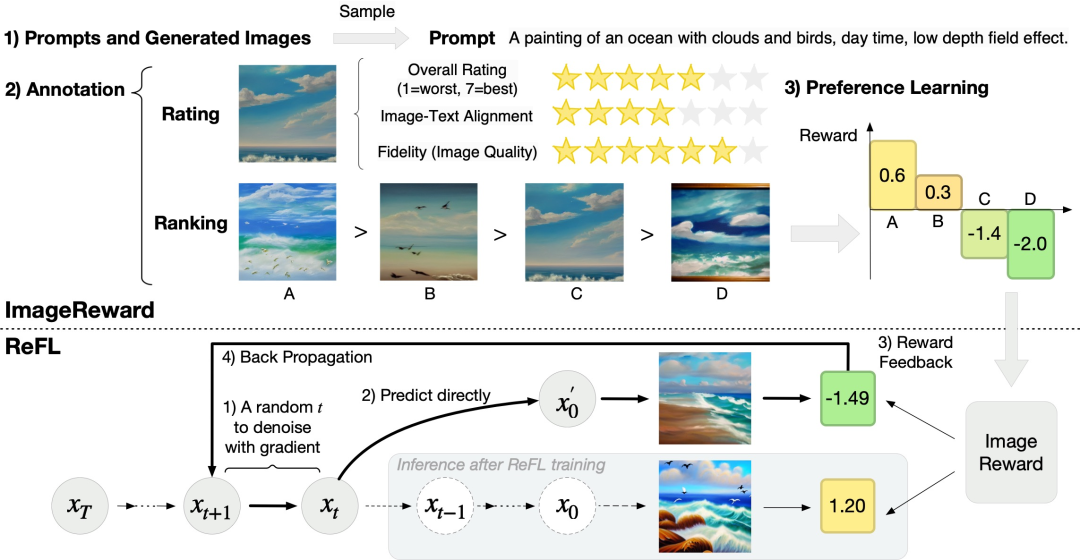

1. ImageReward

ImageReward: Learning and Evaluating Human Preferences for Text-to-image Generation

a.ImageReward人类偏好模型

模型结构:BLIP(ViT-L作为图像编码器的,12层Transformer作为文本编码器)+ MLP(打分器)

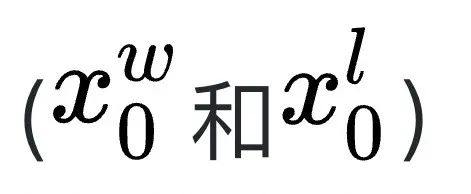

训练方法:对于同一个prompt对应的k张图片,根据其排序结果得到pairs,每个pair中有相对更受偏好和不受偏好的两张图片。

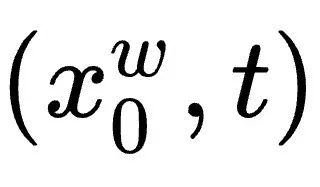

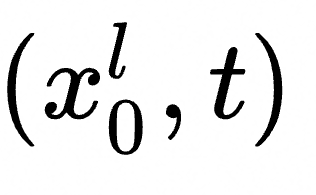

其核心思想是在(T, x_i)和(T, x_j)之间建模差异,希望经过优化后,f_θ在相似或关联的样本上输出更相近的值,而在不相似的样本上输出相差较大的值。通过这样的方法,模型能够学到更有效的特征表示或生成更精准的排序结果。

b.ReFL:文生图Diffusion的奖励反馈学习(Reward Feedback Learning)

语言模型的RLHF不能直接应用在Diffusion中。在NLP中,有研究工作使用强化学习算法例如PPO来引导语言模型与人类偏好相一致,基于一次完整生成的likelihood来更新整个模型。然而,与基于Transformer的语言模型不同,Latent Diffusion Models的多步去噪生成无法产生一次完整生成的likelihood,因此不能采用相同的RLHF方法。

本文提出了一种直接微调LDM的算法。将RM的分数视为人类的偏好损失,将梯度反向传播到去噪过程中随机挑选的后一步t。正常的解噪到x_t+1,然后在这一步通过预测噪声直接得到x_0,解噪声得到图像,然后通过reward model计算分数,利用反向传播更新梯度。

-

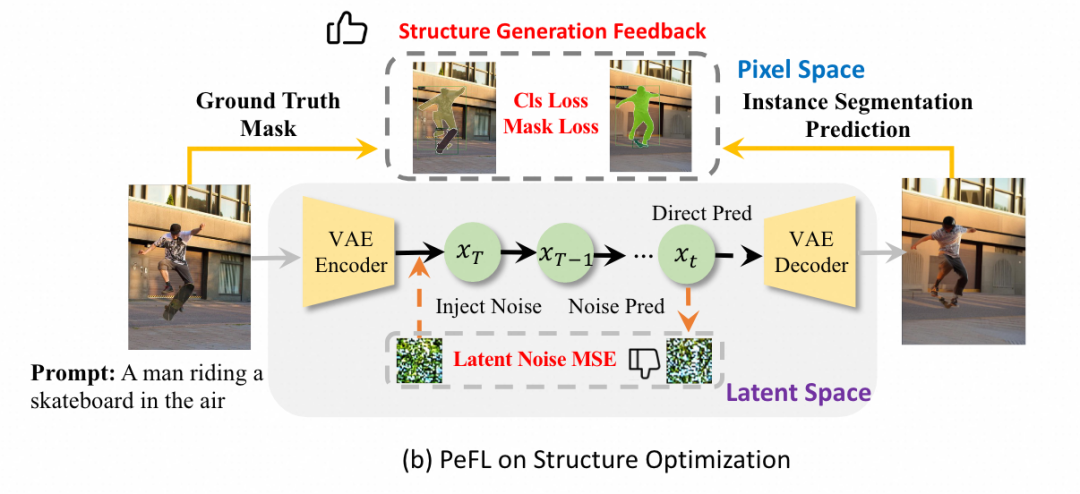

2. UniFL

UniFL: Improve Stable Diffusion via Unified Feedback Learning

当前方法在结构上的缺陷 => 源自于仅对潜在空间进行重建损失的学习,缺乏更高维的结构监督。

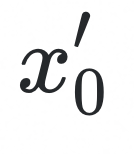

a.ReFL与PeFL的区别:

【ReFL】:在偏好微调阶段,ReFL是输入提示c,仅将text作为条件。随机初始化潜在变量xT,然后逐步对潜在变量进行去噪,直到达到随机选择的时间步t,然后再从Xt直接一步预测到X0',然后直接计算x0'的奖励函数损失。

【PeFL】:不同于ReFL从随机初始化的latent开始,仅仅将文本提示作为条件,我们的是数据集是prompt和图片组成的图文对,将图像内容作为一部分指导的信息。去噪图像有望恢复出相同的高维度视觉特征。

选择一个前向步长 ,向真值图像中注入噪声得到

,向真值图像中注入噪声得到 , 然后随机选择一个去噪步长t,从

, 然后随机选择一个去噪步长t,从 中一步一步去噪得到

中一步一步去噪得到 ,然后再从

,然后再从 直接一步预测到

直接一步预测到 。 这里的奖励函数损失跟ReFL不一样,是计算原图

。 这里的奖励函数损失跟ReFL不一样,是计算原图 和去噪的

和去噪的 奖励函数差值的范数。

奖励函数差值的范数。

b.网络结构:为了提取视觉结构信息,利用视觉实例分割模型,因为实例masks提供了基本的对象结构描述。目标被公式化为(疑问:这里的损失函数是mask的差?)

是实例分割模型,

是实例分割模型, 是实例分割标注真值,

是实例分割标注真值, 是 实例分割损失 。 P eFL 的灵活性使我们能够利用各种现有的视觉感知模型,例如语义分割模型,以提供特定的视 觉反馈。

是 实例分割损失 。 P eFL 的灵活性使我们能够利用各种现有的视觉感知模型,例如语义分割模型,以提供特定的视 觉反馈。

▐ 3.3 DPO系列

-

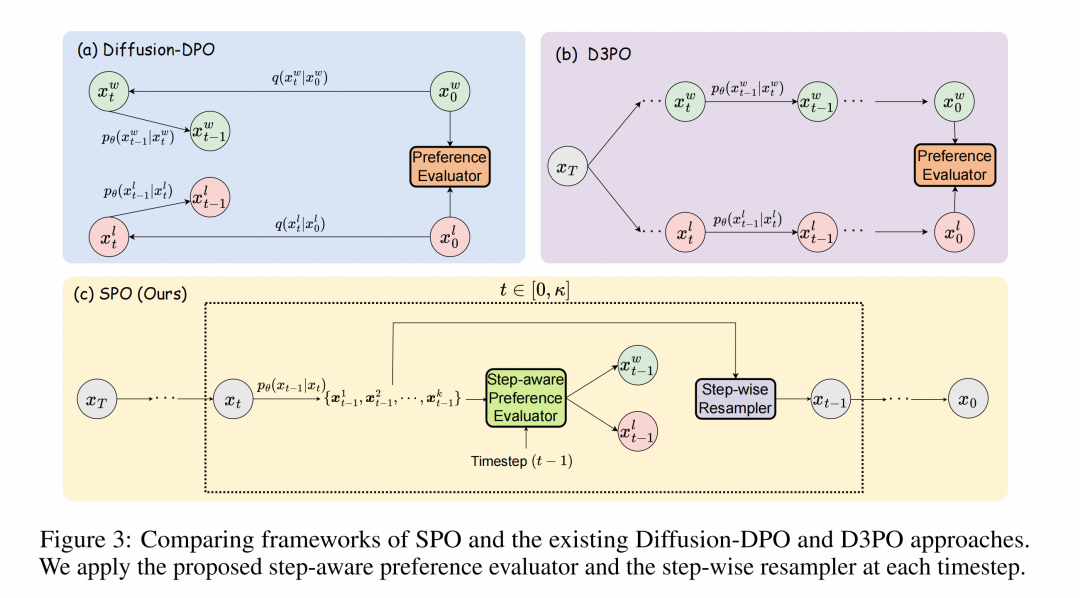

1. Diffusion-DPO | D3PO |SPO

Diffusion Model Alignment Using Direct Preference Optimization

Using Human Feedback to Fine-tune Diffusion Models without Any Reward Model

SPO:Step-aware Preference Optimization: Aligning Preference with Denoising Performance at Each Step

损失函数及更新过程比较:

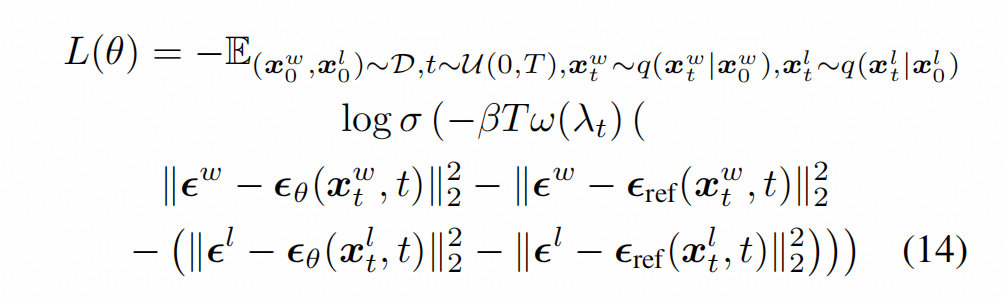

a.Diffusion-DPO

通过直接偏好,隐式估计奖励模型。为了与扩散模型的过程进行适配,可以发现其中的难点在于 y 的采样概率 是不可计算的,因为计算

是不可计算的,因为计算 需要对所有导向 y 的采样路径积分。为了克服这个问题,原论文转而优化目标函数式的下界,推导出了一个简单但稳定的损失函数来产生稳定结果。

需要对所有导向 y 的采样路径积分。为了克服这个问题,原论文转而优化目标函数式的下界,推导出了一个简单但稳定的损失函数来产生稳定结果。

可以定性的看作 Diffusion-DPO 的训练过程是在改善 的去噪过程,同时破坏

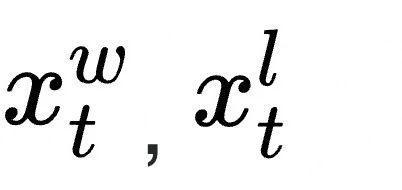

的去噪过程,同时破坏 的去噪过程。更新方式为随机挑选一个step进行更新,将t个时间步长噪声添加到偏好对

的去噪过程。更新方式为随机挑选一个step进行更新,将t个时间步长噪声添加到偏好对 中,采样

中,采样

b.D3PO

一个重要假设:若一个样本比另一个样本好,则认为它的所有中间状态都更好.

对整个去噪链路进行更新:先对两个完整轨迹采样:Tl = {xT , xl T −1, ..., xl0} 和Tw = {xT , xl T −1, ..., xl0} 。然后在第t处采样相应的时间步长得到

c.SPO

通过随机高斯噪声去噪采样一个xt,之后的 是从同一个xt中得到的=>这种采样方法是消除先前去噪性能或者最终输出的偏好顺序的依赖的关键。

是从同一个xt中得到的=>这种采样方法是消除先前去噪性能或者最终输出的偏好顺序的依赖的关键。

d.核心差异总结

与 DDPO 和 DPOK 等 on-policy 的 RL 算法相比,Diffusion-DPO 的优化不再需要一个完整的采样轨迹 (xT,...,x0) ,可以针对任意一步( t∼U(0,T) )去噪过程优化模型,这大大简化了算法的优化逻辑。

Diffusion-DPO通过变分推断框架重新构建目标函数,将扩散模型的证据下界(ELBO)与DPO的偏好优化结合,推导出可微分的目标函数。这一过程明确考虑了扩散模型的时序特性,通过分步概率比计算实现策略优化。而D3PO未提及理论框架的改造,直接应用标准DPO的对比损失到生成样本的隐变量空间,缺乏显式的扩散过程建模。SPO同样涉及整体的采样过程,耗时更长,但能对不依赖于之前去噪步骤的结果进行评估。

-

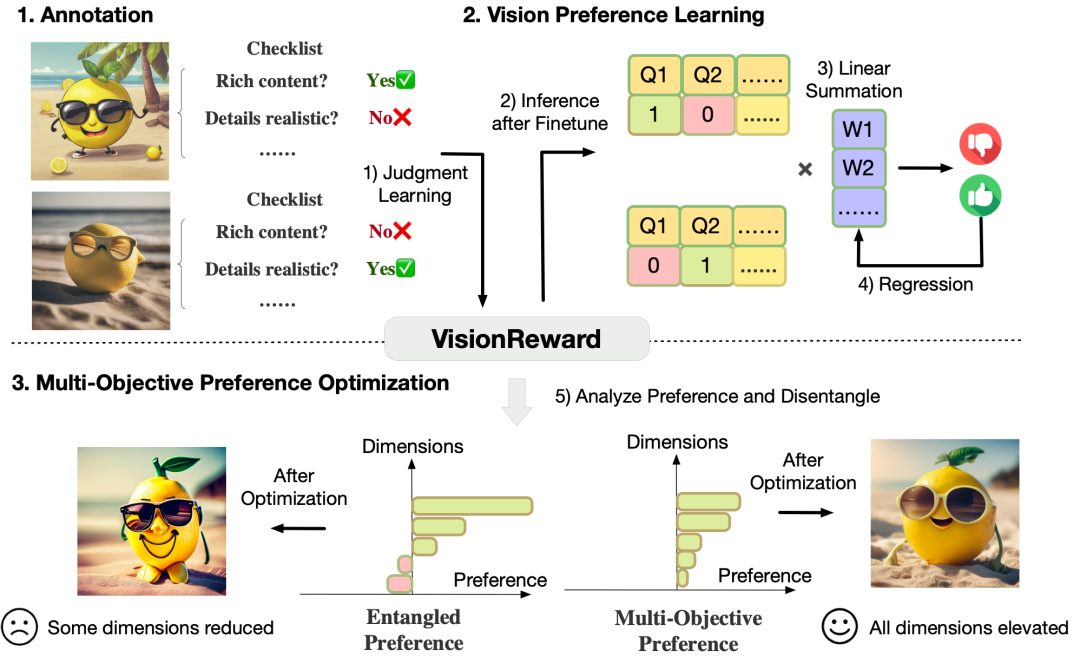

2. VisionReward

VisionReward: Fine-Grained Multi-Dimensional Human Preference Learning for Image and Video Generation

DPO存在问题:在某些维度上存在偏见/过度优化;导致另一些维度上的问题,因此本文主要提出两个创新点:

-

相较于DPO不采用reward model;训练了一个reward model进行评分增加训练图像对的数量,降低人工打标成本,应对DPO对于样本需求的全面性

-

图片i在所有维度上都比图片j要好则称作dominate,只采用dominate的图像对防止发生维度倾斜问题

场景模特人类偏好对齐实测

在场景模特的训练中,我们发现单纯的数据工程和SFT很难完全解决生成人体的肢体变异问题。于是尝试利用RLHF进行进一步优化。基于训练时长和reward model在肢体变异维度上训练难度的考虑,我们首先尝试了DPO类算法。首先,针对同一输入生成的不同结果进行人工打标,可以构造人类偏好的图像对。经过多轮试验和调参过程,我们得到如下结果:

可以看到通过偏好对齐能够有效提示模型对于肢体这一维度的评判,从而减弱肢体变异现象。

但在试验过程中,我们也发现DPO类方法的诸多问题:

-

DPO损失函数表现出LLMs更容易学习避免生成不符合人类偏好的响应,表现在文生图模型中则是好图的影响偏弱而更倾向于偏离坏图。因此对于超参数敏感且容易训练崩溃。

-

DPO梯度向量场在各个区域的大小和方向不同,这表明DPO的实际优化过程对SFT后的LLMs对齐能力的初始条件(特别是 π(yw|x) 和 π(yl|x))敏感。当SFT效果略有欠缺时,生成符合人类偏好的响应的概率增加缓慢,导致经过SFT的LLMs难以对齐人类偏好。

团队介绍

本文作者吴漾,来自淘天集团-场景智能技术团队。一支专注于通过AI和3D技术驱动商业创新的技术团队, 依托大淘宝丰富的业务形态和海量的用户、数据, 致力于为消费者提供创新的场景化导购体验, 为商家提供高效的场景化内容创作工具, 为淘宝打造围绕家的场景的第一消费入口。我们不断探索并实践新的技术, 通过持续的技术创新和突破,创新用户导购体验, 提升商家内容生产力, 让用户享受更好的消费体验, 让商家更高效、低成本地经营。

¤ 拓展阅读 ¤

火山引擎开发者社区是火山引擎打造的AI技术生态平台,聚焦Agent与大模型开发,提供豆包系列模型(图像/视频/视觉)、智能分析与会话工具,并配套评测集、动手实验室及行业案例库。社区通过技术沙龙、挑战赛等活动促进开发者成长,新用户可领50万Tokens权益,助力构建智能应用。

更多推荐

已为社区贡献52条内容

已为社区贡献52条内容

所有评论(0)